Près de la moitié du trafic Internet est désormais générée par des bots. La plupart extraient des liens, des données et des URL à grande échelle. Si vous le faites encore à la main, vous prenez du retard.

J’ai testé 12 outils d’extraction de liens — des extensions Chrome dopées à l’IA aux bibliothèques Python — pour voir lesquels tiennent vraiment la route quand il faut extraire rapidement des milliers d’URL.

Voici ce que j’ai trouvé.

Pourquoi les extracteurs de liens sont importants

Soyons francs : le web déborde de données, et les entreprises se battent pour transformer ce chaos en informations exploitables. Les et les sont aujourd’hui indispensables pour les équipes qui veulent :

- Générer des leads : les équipes commerciales peuvent récupérer en quelques minutes des liens de profils d’entreprises dans des annuaires ou sur LinkedIn, puis envoyer ces URL vers des outils qui en extraient les informations de contact. Fini les clics à n’en plus finir.

- Regrouper du contenu et booster le SEO : les marketeurs peuvent collecter toutes les URL d’articles d’un blog, surveiller les backlinks des concurrents ou auditer la structure d’un site à la recherche de liens cassés.

- Surveiller les concurrents et faire de la veille marché : les équipes opérationnelles peuvent rassembler automatiquement les liens vers de nouveaux produits, des pages de tarifs ou des communiqués de presse — et garder un œil sur la concurrence sans effort.

- Automatiser les workflows et gagner du temps : les extracteurs de liens modernes gèrent les URL en masse, explorent les sous-pages et exportent les données dans des formats structurés (CSV, Excel, Google Sheets, Notion, etc.). Plus besoin de marathons de copier-coller ni de nettoyer des fichiers texte en désordre.

Sachant que , le faire manuellement n’est tout simplement pas viable. Le bon extracteur de liens, c’est un assistant suralimenté qui ne se fatigue jamais, ne rate jamais un lien et ne demande jamais de pause café.

Comment nous avons choisi les meilleurs extracteurs de liens

Avec autant d’outils sur le marché, choisir le bon extracteur de liens peut ressembler à un speed-dating dans une conférence tech : tout le monde promet d’être « le bon », mais seuls quelques-uns tiennent réellement leurs promesses. Voici comment j’ai réduit la liste aux 12 meilleurs :

- Facilité d’utilisation : des non-développeurs peuvent-ils l’utiliser sans doctorat en regex ? Les solutions no-code et low-code ont eu des points supplémentaires.

- Extraction en masse et multi-niveaux : peut-il gérer des centaines d’URL à la fois ? Explore-t-il automatiquement les sous-pages et suit-il les liens ?

- Export et intégration : exporte-t-il vers CSV, Excel, Google Sheets, Notion, Airtable ou via API ? Moins il y a de travail manuel, mieux c’est.

- Type d’utilisateur et flexibilité : est-il pensé pour des utilisateurs métier, des analystes ou des développeurs ? Certains outils sont conçus pour tout le monde, d’autres sont plus spécialisés.

- Fonctionnalités avancées : reconnaissance pilotée par l’IA, planification, montée en charge dans le cloud, nettoyage des données et modèles pour les sites courants.

- Tarification et montée en charge : version gratuite, paiement à l’usage ou offre entreprise ? J’ai examiné ce que vous obtenez pour votre argent.

J’ai inclus aussi bien des extensions de navigateur que des plateformes entreprise, donc que vous soyez fondateur solo ou membre d’une équipe data d’un Fortune 500, vous trouverez forcément une solution adaptée.

Thunderbit : l’extracteur de liens le plus malin pour les utilisateurs métier

Commençons par le meilleur. est ma recommandation de référence pour l’extraction de liens, et pas seulement parce que j’ai contribué à le construire. Thunderbit est une conçue pour les utilisateurs métier qui veulent des résultats — vite.

Qu’est-ce qui distingue Thunderbit ? C’est un peu comme avoir un stagiaire IA qui vous écoute vraiment. Vous pouvez décrire ce que vous voulez en langage naturel (« Récupère tous les liens et les prix des produits sur cette page »), et l’IA de Thunderbit fait le reste. Pas besoin de bidouiller des sélecteurs ni d’écrire des scripts.

Mais ce n’est pas tout :

- Prise en charge des URL en masse : collez une seule URL ou une liste de centaines d’entre elles — Thunderbit les traite toutes d’un coup.

- Navigation entre sous-pages : vous devez extraire des liens depuis une page liste puis visiter chaque page de détail pour récupérer d’autres URL ? La logique d’extraction multi-niveaux de Thunderbit s’en charge.

- Export structuré : une fois les liens extraits, vous pouvez renommer les champs, les classer et les exporter directement vers Google Sheets, Notion, Airtable, Excel ou CSV. Fini les soucis de post-traitement.

Thunderbit est utilisé par plus de 30 000 personnes dans le monde, des équipes commerciales aux agents immobiliers en passant par les boutiques e-commerce indépendantes. Et oui, il existe une (jusqu’à 6 pages, ou 10 avec un bonus d’essai), pour que vous puissiez le tester sans risque.

Les fonctionnalités phares de Thunderbit

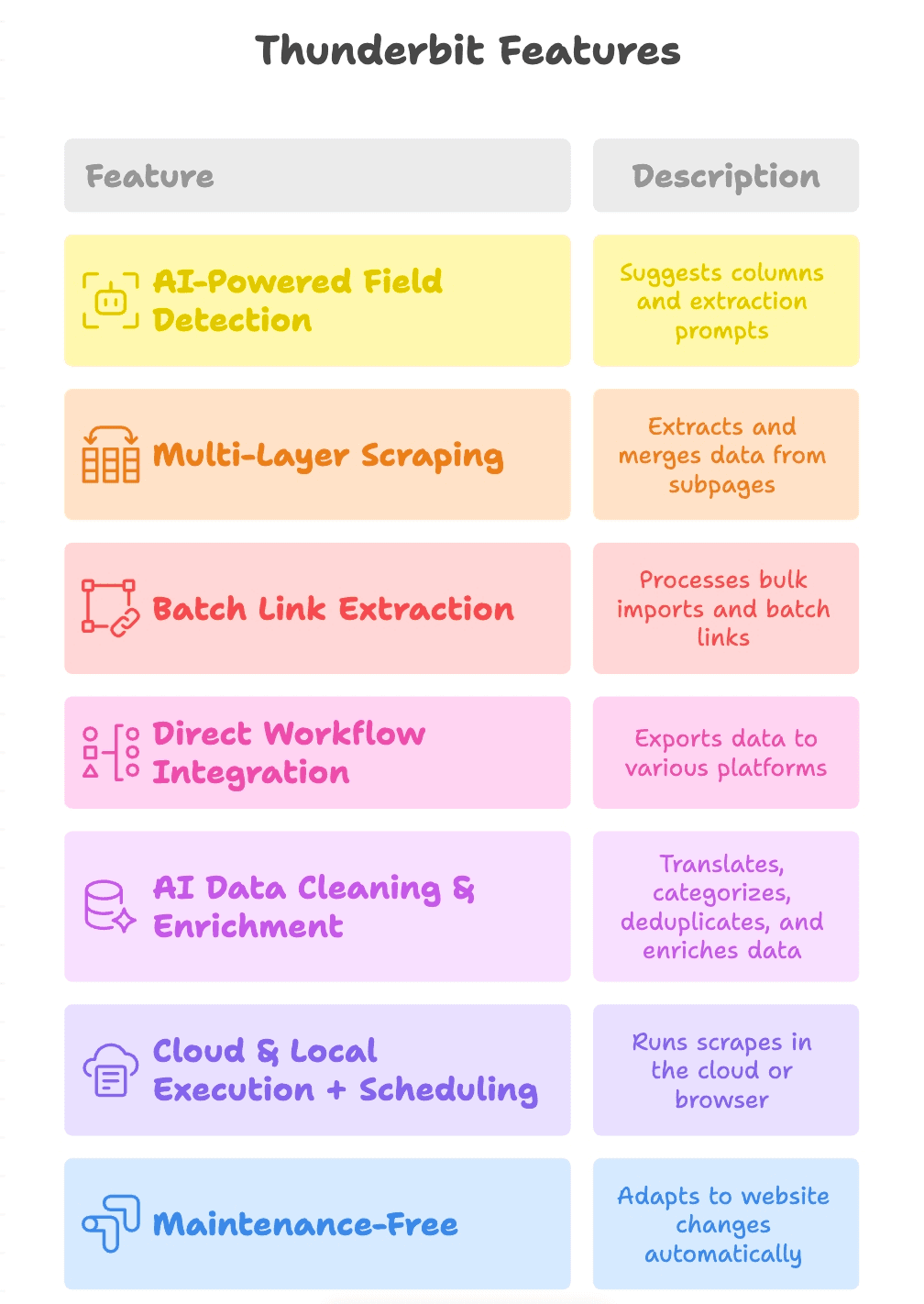

Voyons ce qui fait vraiment la différence :

- Détection de champs propulsée par l’IA : cliquez simplement sur « AI Suggest Fields », et Thunderbit lit la page, propose des colonnes (comme « Lien produit », « URL PDF », « E-mail de contact ») et crée même des invites d’extraction pour chaque champ.

- Extraction multi-niveaux : Thunderbit peut suivre des liens depuis une page principale vers des sous-pages (comme des fiches produit ou des téléchargements PDF), extraire d’autres liens et fusionner le tout dans un seul tableau.

- Extraction de liens par lots : que vous extrayiez une page ou mille, Thunderbit gère sans difficulté les imports en masse et l’extraction par lots.

- Intégration directe aux workflows : exportez les résultats vers Google Sheets, Notion, Airtable, ou téléchargez-les en CSV/Excel. Vos données arrivent exactement là où votre équipe en a besoin.

- Nettoyage et enrichissement des données par l’IA : Thunderbit peut traduire, classer, dédupliquer et même enrichir vos données pendant l’extraction — vos résultats sont donc prêts à l’emploi, pas de simples données brutes.

- Exécution dans le cloud et en local + planification : lancez les extractions dans le cloud pour aller plus vite, ou dans votre navigateur pour les sites nécessitant une connexion. Planifiez des tâches récurrentes pour garder vos données à jour.

- Sans maintenance : l’IA de Thunderbit s’adapte aux changements des sites web, ce qui vous permet de passer moins de temps à réparer des extracteurs cassés et plus de temps à obtenir des résultats.

Octoparse : un extracteur de liens no-code pour tout le monde

est un grand classique du monde de l’extraction no-code. C’est une application de bureau (Windows/Mac) dotée d’une interface visuelle en point-and-click. Vous chargez une page web, vous cliquez sur les liens voulus, et Octoparse fait le reste.

- Idéal pour les débutants : aucun code nécessaire. Il suffit de cliquer, extraire, puis avancer.

- Gère la pagination et le contenu dynamique : Octoparse peut cliquer sur les boutons « Suivant », faire défiler la page et même se connecter à des sites.

- Extraction dans le cloud et planification : les formules payantes permettent d’exécuter les tâches dans le cloud et de programmer des opérations récurrentes.

- Options d’export : téléchargez les données en CSV, Excel, JSON ou envoyez-les vers des bases de données.

L’offre gratuite est généreuse pour les petits besoins (jusqu’à 10 tâches et 50 000 lignes/mois), mais les utilisateurs plus intensifs devront passer à une formule payante (à partir d’environ 75 $/mois).

Apify : un extracteur d’URL flexible pour les workflows personnalisés

est le couteau suisse du web scraping. Il propose une place de marché d’« actors » préconstruits (des outils d’extraction), ainsi que la possibilité d’écrire vos propres scripts en JavaScript ou Python.

- Préconstruit et personnalisable : utilisez les actors de la communauté pour les tâches courantes, ou créez les vôtres pour des workflows sur mesure.

- Extraction en masse et planifiée : mettez des URL en file d’attente, exécutez des tâches en parallèle et planifiez des extractions récurrentes.

- API-first : exportez vers JSON, CSV, Excel ou Google Sheets, et intégrez l’outil à votre pipeline de données.

- Paiement à l’usage : crédits gratuits chaque mois, puis facturation selon l’utilisation.

Apify est idéal pour les équipes semi-techniques et les développeurs qui veulent de la flexibilité et de la montée en charge.

Bright Data URL Scraper : une extraction de liens au niveau entreprise

est conçu pour les entreprises qui ont besoin d’extraire à grande échelle. Leur Data Collector propose un URL Scraper prédéfini pour les travaux à fort volume.

- Gère des volumes massifs : extrayez des milliers ou des millions de pages, avec une infrastructure de proxys robuste pour éviter les blocages.

- Modèles prédéfinis : extracteurs prêts à l’emploi pour l’e-commerce, les réseaux sociaux, l’immobilier, et plus encore.

- Fonctionnalités entreprise : outils de conformité, assistance experte et mécanismes avancés anti-blocage.

- Tarification : à partir d’environ 350 $ pour 100 000 chargements de pages — clairement destiné aux grandes entreprises.

Si vous êtes une startup, ce sera peut-être excessif. Mais pour une extraction critique à haut volume, Bright Data est une véritable machine de guerre.

WebHarvy : un extracteur de liens visuel d’une simplicité point-and-click

est une application de bureau (Windows) qui permet d’extraire des liens en cliquant simplement dessus dans son navigateur intégré.

- Ultra simple : cliquez sur un lien, et WebHarvy met en surbrillance tous les éléments similaires à extraire.

- Prise en charge des expressions régulières : modèles intégrés pour les tâches courantes, sans code.

- Export vers Excel, CSV, JSON, XML, SQL : parfait pour les utilisateurs métier qui veulent des données dans des formats familiers.

- Licence à achat unique : payez une fois, utilisez-la à vie.

Idéal pour les petites entreprises, les chercheurs ou toute personne qui veut récupérer rapidement des liens sans prise de tête ni programmation.

Web Scraper (extension Chrome) : extraction rapide de liens directement dans votre navigateur

L’ est un outil gratuit et open source qui transforme votre navigateur en extracteur.

- Définissez des sitemaps : indiquez-lui comment naviguer et quoi extraire.

- Gère la pagination et l’exploration multi-niveaux : parcourez catégories, sous-catégories et pages de détail.

- Export vers CSV/XLSX : téléchargez les données directement depuis votre navigateur.

- Modèles communautaires : de nombreux sitemaps partagés pour les sites populaires.

C’est parfait pour des tâches rapides, ponctuelles, ou pour des étudiants et petites équipes avec un budget limité.

ScraperAPI : un extracteur de liens scalable pour développeurs

s’adresse aux développeurs qui veulent récupérer des pages web à grande échelle sans se soucier des proxys, des blocages ou des CAPTCHA.

- Piloté par API : envoyez une URL et recevez du HTML ou des données extraites.

- Gère la montée en charge et les protections anti-bot : rotation de proxys, rendu JavaScript et résolution de CAPTCHA intégrés.

- S’intègre à votre code : utilisez-le avec Python, Node.js ou n’importe quel langage.

- Tarification : offre gratuite (environ 1 000 appels API), puis paiement à la requête.

Excellent pour des crawlers sur mesure ou lorsque vous avez besoin de fiabilité et de vitesse à grande échelle.

ParseHub : un extracteur de liens visuel avec sélection avancée

est une application de bureau (Windows, Mac, Linux) qui permet de construire visuellement des projets d’extraction.

- Sélection et navigation avancées : cliquez, bouclez et extrayez conditionnellement des liens — même depuis des éléments dynamiques ou cachés.

- Gère les pages imbriquées : explorez les catégories, puis les pages de détail, puis extrayez davantage de liens.

- Export vers CSV, Excel, JSON : exécutions dans le cloud et accès API avec les formules payantes.

- Formule gratuite : 5 projets, jusqu’à 200 pages par exécution.

ParseHub est très apprécié des marketeurs et des chercheurs qui veulent de la puissance sans coder.

Scrapy : un extracteur de liens Python pour développeurs

est la référence absolue pour les développeurs Python qui veulent un contrôle total.

- Conçu pour le code : construisez des spiders sur mesure pour explorer et extraire des liens à n’importe quelle échelle.

- Gère l’exploration distribuée : efficace, asynchrone et hautement personnalisable.

- Export vers CSV, JSON, XML ou base de données : vous contrôlez la sortie.

- Open source et gratuit : mais vous devrez gérer votre propre environnement.

Si vous maîtrisez Python, Scrapy est aussi puissant que possible.

Diffbot : un extracteur de liens dopé à l’IA pour des données structurées

est le « cerveau IA » du web scraping. Il analyse les pages et renvoie des données structurées — y compris les liens — sans configuration manuelle.

- Reconnaissance automatique du contenu : donnez une URL, récupérez des données structurées (articles, produits, liens, etc.).

- Crawlbot et Knowledge Graph : explorez des sites entiers ou interrogez leur immense index web.

- Piloté par API : intégrez-le à vos outils BI ou à votre pipeline de données.

- Tarification entreprise : à partir d’environ 299 $/mois, mais le résultat est à la hauteur de l’investissement.

Idéal pour les entreprises qui veulent des données propres et structurées sans gérer des extracteurs.

Cheerio : un extracteur de liens léger pour Node.js

est un parseur HTML rapide, façon jQuery, pour Node.js.

- Ultra rapide : analyse le HTML en quelques millisecondes.

- Syntaxe familière : si vous connaissez jQuery, vous connaissez déjà Cheerio.

- Parfait pour les pages statiques : ne rend pas le JavaScript, mais convient parfaitement au contenu généré côté serveur.

- Open source et gratuit : à combiner avec axios ou fetch pour les requêtes.

Idéal pour les développeurs qui créent des scripts sur mesure et veulent de la vitesse et de la simplicité.

Puppeteer : l’automatisation du navigateur pour une extraction de liens avancée

est une bibliothèque Node.js qui permet de contrôler Chrome en mode headless.

- Automatisation complète du navigateur : chargez des pages, cliquez, faites défiler et interagissez comme un vrai utilisateur.

- Gère le contenu dynamique et les connexions : parfait pour les sites très dépendants du JavaScript ou les workflows complexes.

- Contrôle fin : attendez des éléments, prenez des captures d’écran, interceptez les requêtes réseau.

- Open source et gratuit : mais gourmand en ressources et plus lent que les outils légers.

Utilisez Puppeteer lorsque vous devez extraire des liens depuis des sites qui ne se laissent pas facilement faire par des extracteurs classiques.

Comparaison rapide : quel extracteur de liens correspond à vos besoins ?

Voici une comparaison rapide des 12 outils :

| Outil | Idéal pour | Prise en charge du volume et des sous-pages | Options d’export des données | Tarification |

|---|---|---|---|---|

| Thunderbit | Non-développeurs, entreprises | Oui (IA, multi-niveaux) | Excel, CSV, Sheets, Notion, Airtable | Essai gratuit, à partir d’environ 9 $/mois |

| Octoparse | Utilisateurs no-code, analystes | Oui | CSV, Excel, JSON, stockage cloud | Version gratuite, ~75 $/mois |

| Apify | Semi-tech, développeurs | Oui | CSV, JSON, Sheets via API | Crédits gratuits, facturation à l’usage |

| Bright Data | Entreprise | Oui (très grand volume) | CSV, JSON, NDJSON via API | ~350 $/100k pages |

| WebHarvy | Non-développeurs, bureau | Oui | Excel, CSV, JSON, XML, SQL | Licence payante |

| Extension Web Scraper | Tout le monde, rapide/gratuit | Oui | CSV, XLSX | Gratuit, open source |

| ScraperAPI | Développeurs, utilisateurs d’API | Oui | JSON (HTML via API) | 1 000 requêtes gratuites, offres payantes |

| ParseHub | Non-développeurs, avancé | Oui | CSV, Excel, JSON, API | 5 projets gratuits, puis payant |

| Scrapy | Développeurs Python | Oui | CSV, JSON, XML, BD | Gratuit, open source |

| Diffbot | Entreprise, IA | Oui (crawl IA) | JSON (données structurées via API) | ~299 $/mois et plus |

| Cheerio | Développeurs Node.js | Oui (code personnalisé) | Personnalisé (JSON, etc.) | Gratuit, open source |

| Puppeteer | Développeurs, sites complexes | Oui (automatisation complète) | Personnalisé (sortie scriptée) | Gratuit, open source |

Choisir le bon extracteur de liens pour votre entreprise

Alors, comment choisir ? Voici ma fiche mémo :

- Pas de compétences en code ? Commencez avec Thunderbit, Octoparse, ParseHub, WebHarvy ou l’extension Web Scraper.

- Vous avez besoin de workflows personnalisés ? Apify, ScraperAPI ou Cheerio sont d’excellents choix pour les développeurs.

- Besoin d’une échelle entreprise ? Bright Data ou Diffbot sont faits pour vous.

- Développeur Python ou Node.js ? Scrapy (Python) ou Cheerio/Puppeteer (Node.js) vous donnent un contrôle total.

- Vous voulez exporter directement vers Sheets/Notion ? Thunderbit est votre meilleur pari.

Choisissez l’outil en fonction de votre aisance technique, du volume de données et de vos besoins d’intégration. La plupart proposent des essais gratuits, alors n’hésitez pas à tester.

La valeur unique de Thunderbit pour l’extraction de liens en 2026

Revenons à ce qui rend Thunderbit vraiment différent :

- Simplicité portée par l’IA : décrivez ce que vous voulez en langage clair — l’IA de Thunderbit s’occupe du reste.

- Extraction multi-niveaux : récupérez des liens depuis les pages principales, suivez vers les sous-pages et collectez encore plus d’URL — le tout dans un seul flux.

- Import en masse et traitement par lots : collez des centaines d’URL, extrayez des liens en masse et exportez instantanément des données structurées.

- Intégration au workflow : exportez directement vers Google Sheets, Notion, Airtable, ou téléchargez en CSV/Excel.

- Zéro maintenance : l’IA de Thunderbit s’adapte aux changements des sites web, donc vous ne passez pas votre temps à réparer des extracteurs cassés.

Thunderbit fait le pont entre « simplement extraire des données » et « obtenir des données réellement exploitables ». C’est l’outil que j’aurais aimé avoir il y a des années, quand j’étais noyé sous les tâches manuelles de données.

Conclusion : extrayez les liens plus intelligemment et boostez votre workflow

Les données web sont le carburant de la croissance des entreprises — et le bon extracteur de liens est votre moteur. Que vous construisiez des listes de leads, surveilliez des concurrents ou automatisiez de la recherche, vous trouverez ici un outil adapté à vos besoins et à votre niveau.

Si vous voulez voir à quoi ressemble l’extraction de liens moderne, . Je pense que vous serez surpris de tout ce que vous pouvez accomplir en seulement quelques clics. Et si Thunderbit n’est pas parfaitement adapté, testez-en quelques autres de cette liste — il n’a jamais été aussi simple d’automatiser les tâches ennuyeuses et de se concentrer sur ce qui compte vraiment.

Bon scraping — et que vos liens soient toujours propres, structurés et prêts à l’emploi. Si vous voulez aller plus loin dans le web scraping, consultez le pour plus de guides et de conseils.

FAQ

1. Pourquoi les extracteurs de liens sont-ils essentiels ?

Avec près de la moitié du trafic Internet générée par des bots et des entreprises qui extraient agressivement des données, les extracteurs de liens sont indispensables pour transformer le chaos du web en informations exploitables. Ils automatisent des tâches comme la génération de leads, l’agrégation de contenu, les audits SEO et la surveillance des concurrents, ce qui permet d’économiser énormément de temps et d’efforts.

2. Qu’est-ce qui distingue Thunderbit des autres extracteurs de liens ?

Thunderbit utilise l’IA pour simplifier l’extraction : décrivez simplement votre objectif en langage clair, et l’outil fait le reste. Il prend en charge la saisie d’URL en masse, l’extraction multi-niveaux, la détection intelligente des champs et l’export fluide vers des plateformes comme Google Sheets et Notion. Il est idéal pour les non-développeurs et les utilisateurs métier qui veulent des résultats puissants sans complexité technique.

3. Existe-t-il des outils d’extraction de liens adaptés aux développeurs et aux workflows personnalisés ?

Oui. Des outils comme Apify, ScraperAPI, Cheerio, Puppeteer et Scrapy s’adressent aux développeurs. Ils offrent du scripting, des intégrations API et la flexibilité nécessaire pour gérer des tâches d’extraction complexes, des opérations à grande échelle et une automatisation avancée.

4. Quels outils conviennent le mieux aux personnes sans expérience en code ?

Thunderbit, Octoparse, ParseHub, WebHarvy et l’extension Chrome Web Scraper sont les meilleurs choix pour les utilisateurs non techniques. Ces outils offrent des interfaces visuelles, des modèles prédéfinis et des fonctionnalités pilotées par l’IA qui rendent l’extraction de liens accessible à tous.

5. Comment choisir le bon extracteur de liens selon mes besoins ?

Tenez compte de vos compétences techniques, du volume de données et de vos besoins d’export. Les non-développeurs devraient se tourner vers Thunderbit ou Octoparse, tandis que les développeurs préféreront peut-être Scrapy ou Puppeteer. Les entreprises peuvent envisager Bright Data ou Diffbot pour les opérations à grande échelle. Commencez toujours par un essai gratuit pour voir ce qui convient le mieux.