Quel langage de programmation devriez-vous utiliser pour le web scraping ? Tout dépend de votre projet — et j’ai déjà vu des développeurs jeter l’éponge après avoir fait le mauvais choix.

Le marché des logiciels de web scraping a atteint . Le bon langage peut vous faire gagner du temps et limiter la maintenance. Le mauvais, en revanche, finit souvent en scrapers cassés et en week-ends sacrifiés.

Je construis des outils d’automatisation depuis des années. Voici sept langages que j’ai utilisés pour le scraping — avec des extraits de code, des arbitrages honnêtes, et un aperçu du moment où il vaut mieux ne pas coder du tout et utiliser à la place.

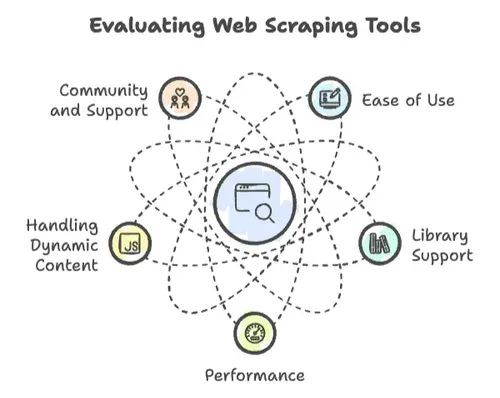

Comment nous avons choisi le meilleur langage pour le web scraping

En web scraping, tous les langages de programmation ne se valent pas. J’ai vu des projets décoller — ou s’écraser — en fonction de quelques critères essentiels :

- Facilité d’utilisation : À quelle vitesse pouvez-vous démarrer ? La syntaxe est-elle agréable, ou faut-il un doctorat en informatique pour afficher simplement « Hello, World » ?

- Support des bibliothèques : Existe-t-il des bibliothèques solides pour les requêtes HTTP, l’analyse HTML et la gestion du contenu dynamique ? Ou réinventez-vous la roue ?

- Performances : Peut-il gérer l’extraction de millions de pages, ou s’essouffle-t-il après quelques centaines ?

- Gestion du contenu dynamique : Les sites modernes adorent JavaScript. Votre langage suit-il la cadence ?

- Communauté et support : Quand vous êtes bloqué — et vous le serez — existe-t-il une communauté pour vous aider ?

Sur la base de ces critères — et de beaucoup de tests nocturnes — voici les sept langages que je vais passer en revue :

- Python : le choix de référence pour les débutants comme pour les experts.

- JavaScript et Node.js : le roi du contenu dynamique.

- Ruby : syntaxe propre, scripts rapides.

- PHP : la simplicité côté serveur.

- C++ : pour les cas où la vitesse brute est indispensable.

- Java : prêt pour l’entreprise et scalable.

- Go (Golang) : rapide et concurrent.

Et si vous vous dites : « Shuai, je ne veux pas coder du tout », restez jusqu’à la fin pour découvrir Thunderbit.

Web scraping avec Python : la puissance accessible aux débutants

Commençons par le favori du public : Python. Si vous demandez à une salle remplie de spécialistes de la donnée : « Quel est le meilleur langage de programmation pour le web scraping ? » — vous entendrez Python résonner comme un chœur à un concert de Taylor Swift.

Pourquoi Python ?

- Syntaxe adaptée aux débutants : Vous pouvez lire du code Python à voix haute, et ça ressemble presque à de l’anglais.

- Support de bibliothèques incomparable : De pour analyser le HTML, à pour l’exploration à grande échelle, en passant par pour HTTP et pour l’automatisation du navigateur — Python a tout.

- Communauté immense : Plus de rien que sur le web scraping.

Exemple de code Python : extraire le titre d’une page

1import requests

2from bs4 import BeautifulSoup

3response = requests.get("<https://example.com>")

4soup = BeautifulSoup(response.text, 'html.parser')

5title = soup.title.string

6print(f"Titre de la page : \{title\}")Atouts :

- Développement et prototypage rapides.

- Des tonnes de tutoriels et de réponses Q&R.

- Excellent pour l’analyse de données — extraire avec Python, analyser avec pandas, visualiser avec matplotlib.

- Les bibliothèques continuent d’évoluer : la version 2.14 de Scrapy (janvier 2026) a apporté

async/awaitnatif dans tout le framework, donc l’asynchrone ne concerne plus seulement Selenium ou Playwright.

Limites :

- Plus lent que les langages compilés pour les gros volumes.

- La gestion des sites très dynamiques peut devenir lourde (même si Selenium et Playwright aident).

- Pas idéal pour extraire des millions de pages à toute vitesse.

En résumé :

Si vous débutez en scraping, ou si vous voulez simplement aller vite, Python est le meilleur langage pour le web scraping — point final. .

JavaScript et Node.js : extraire facilement des sites dynamiques

Si Python est le couteau suisse, JavaScript (et Node.js) est la perceuse électrique — surtout pour extraire des sites web modernes, riches en JavaScript.

Pourquoi JavaScript/Node.js ?

- Natif pour le contenu dynamique : Il s’exécute dans le navigateur, donc il voit ce que voient les utilisateurs — même si la page est construite avec React, Angular ou Vue.

- Asynchrone par défaut : Node.js peut gérer des centaines de requêtes en même temps.

- Familier aux développeurs web : Si vous avez déjà créé un site, vous connaissez déjà un peu JavaScript.

Bibliothèques clés :

- : multi-navigateurs (Chromium, Firefox, WebKit), attente automatique et proxys par contexte. Si vous démarrez un nouveau scraper Node en 2026, c’est le choix par défaut.

- : Chrome en mode headless via le Chrome DevTools Protocol. Toujours très solide pour les tâches limitées à Chrome et avec un besoin de dépendances plus légères.

- : analyse HTML façon jQuery pour Node quand vous n’avez pas besoin d’un vrai navigateur.

Exemple de code Node.js : extraire le titre d’une page avec Puppeteer

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('<https://example.com>', { waitUntil: 'networkidle2' });

6 const title = await page.title();

7 console.log(`Titre de la page : $\{title\}`);

8 await browser.close();

9})();Atouts :

- Gère nativement le contenu rendu par JavaScript.

- Très utile pour le scroll infini, les pop-ups et les sites interactifs.

- Efficace pour du scraping simultané à grande échelle.

Limites :

- La programmation asynchrone peut être délicate pour les débutants.

- Les navigateurs headless consomment beaucoup de mémoire si vous en lancez trop à la fois.

- Moins d’outils d’analyse de données que Python.

Quand JavaScript/Node.js est-il le meilleur langage pour le web scraping ?

Quand votre site cible est dynamique, ou lorsque vous voulez automatiser les actions du navigateur. .

Ruby : une syntaxe propre pour des scripts de web scraping rapides

Ruby n’est pas réservé aux applications Rails ni à la poésie du code. C’est aussi un excellent choix pour le web scraping — surtout si vous aimez que votre code se lise comme un haïku.

Pourquoi Ruby ?

- Syntaxe lisible et expressive : Vous pouvez écrire un scraper en Ruby presque aussi facilement que votre liste de courses.

- Idéal pour le prototypage : Rapide à écrire, facile à ajuster.

- Bibliothèques clés : pour l’analyse, pour automatiser la navigation.

Exemple de code Ruby : extraire le titre d’une page

1require 'open-uri'

2require 'nokogiri'

3html = URI.open("<https://example.com>")

4doc = Nokogiri::HTML(html)

5title = doc.at('title').text

6puts "Titre de la page : #\{title\}"Atouts :

- Ultra lisible et concis.

- Parfait pour les petits projets, les scripts ponctuels, ou si vous utilisez déjà Ruby.

Limites :

- Plus lent que Python ou Node.js pour les gros volumes.

- Moins de bibliothèques dédiées au scraping et une communauté plus réduite sur ce sujet.

- Pas idéal pour les sites très riches en JavaScript (même si vous pouvez utiliser Watir ou Selenium).

Meilleur cas d’usage :

Si vous aimez Ruby ou si vous voulez écrire un script rapide, Ruby est un plaisir. Pour du scraping massif et dynamique, tournez-vous vers autre chose.

PHP : la simplicité côté serveur pour extraire des données web

PHP peut sembler être un vestige des débuts du web, mais il est toujours bien vivant — surtout si vous voulez extraire des données directement sur votre serveur.

Pourquoi PHP ?

- Fonctionne partout : La plupart des serveurs web ont déjà PHP.

- Facile à intégrer aux applications web : Extraire et afficher sur votre site en une seule étape.

- Bibliothèques clés : pour HTTP, pour les requêtes, pour l’automatisation de navigateur en mode headless.

Exemple de code PHP : extraire le titre d’une page

1<?php

2$ch = curl_init("<https://example.com>");

3curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

4$html = curl_exec($ch);

5curl_close($ch);

6$dom = new DOMDocument();

7@$dom->loadHTML($html);

8$title = $dom->getElementsByTagName("title")->item(0)->nodeValue;

9echo "Titre de la page : $title\n";

10?>Atouts :

- Facile à déployer sur des serveurs web.

- Pratique pour le scraping intégré à un workflow web.

- Rapide pour des tâches simples de scraping côté serveur.

Limites :

- Support limité des bibliothèques pour le scraping avancé.

- Pas conçu pour une forte concurrence ni pour du scraping à grande échelle.

- La gestion des sites très riches en JavaScript est délicate (même si Panther aide).

Meilleur cas d’usage :

Si votre stack est déjà en PHP, ou si vous voulez extraire et afficher des données sur votre site, PHP est un choix pragmatique. .

C++ : du web scraping haute performance pour les projets à grande échelle

C++ est la voiture musclée des langages de programmation. Si vous avez besoin de vitesse brute et de contrôle, et que le travail manuel ne vous fait pas peur, C++ peut vous emmener loin.

Pourquoi C++ ?

- Ultra rapide : Surpasse la plupart des langages pour les tâches gourmandes en CPU.

- Contrôle granulaire : Gérez la mémoire, les threads et les optimisations de performance.

- Bibliothèques clés : pour HTTP, pour l’analyse.

Exemple de code C++ : extraire le titre d’une page

1#include <curl/curl.h>

2#include <iostream>

3#include <string>

4size_t WriteCallback(void* contents, size_t size, size_t nmemb, void* userp) {

5 std::string* html = static_cast<std::string*>(userp);

6 size_t totalSize = size * nmemb;

7 html->append(static_cast<char*>(contents), totalSize);

8 return totalSize;

9}

10int main() {

11 CURL* curl = curl_easy_init();

12 std::string html;

13 if(curl) {

14 curl_easy_setopt(curl, CURLOPT_URL, "<https://example.com>");

15 curl_easy_setopt(curl, CURLOPT_WRITEFUNCTION, WriteCallback);

16 curl_easy_setopt(curl, CURLOPT_WRITEDATA, &html);

17 CURLcode res = curl_easy_perform(curl);

18 curl_easy_cleanup(curl);

19 }

20 std::size_t startPos = html.find("<title>");

21 std::size_t endPos = html.find("</title>");

22 if(startPos != std::string::npos && endPos != std::string::npos) {

23 startPos += 7;

24 std::string title = html.substr(startPos, endPos - startPos);

25 std::cout << "Titre de la page : " << title << std::endl;

26 } else {

27 std::cout << "Balise title introuvable" << std::endl;

28 }

29 return 0;

30}Atouts :

- Vitesse inégalée pour les gros travaux de scraping.

- Excellent pour intégrer le scraping dans des systèmes haute performance.

Limites :

- Courbe d’apprentissage raide (préparez le café).

- Gestion manuelle de la mémoire.

- Peu de bibliothèques de haut niveau ; pas idéal pour le contenu dynamique.

Meilleur cas d’usage :

Quand vous devez extraire des millions de pages, ou lorsque la performance est absolument critique. Sinon, vous passerez peut-être plus de temps à déboguer qu’à extraire.

Java : des solutions de web scraping prêtes pour l’entreprise

Java est le cheval de trait du monde de l’entreprise. Si vous construisez quelque chose qui doit tourner indéfiniment, traiter d’énormes volumes de données et survivre à une apocalypse zombie, Java est votre allié.

Pourquoi Java ?

- Robuste et scalable : Excellent pour les gros projets de scraping longue durée.

- Typage fort et gestion des erreurs : Moins de surprises en production.

- Bibliothèques clés : pour l’analyse, pour l’automatisation du navigateur, pour HTTP.

Exemple de code Java : extraire le titre d’une page

1import org.jsoup.Jsoup;

2import org.jsoup.nodes.Document;

3public class ScrapeTitle {

4 public static void main(String[] args) throws Exception {

5 Document doc = Jsoup.connect("<https://example.com>").get();

6 String title = doc.title();

7 System.out.println("Titre de la page : " + title);

8 }

9}Atouts :

- Hautes performances et forte concurrence.

- Excellent pour les bases de code volumineuses et maintenables.

- Bon support du contenu dynamique (via Selenium ou HtmlUnit).

Limites :

- Syntaxe verbeuse ; plus de configuration que les langages de script.

- Disproportionné pour de petits scripts ponctuels.

Meilleur cas d’usage :

Le scraping à l’échelle de l’entreprise, ou lorsque vous avez besoin d’une fiabilité et d’une scalabilité à toute épreuve.

Go (Golang) : un web scraping rapide et concurrent

Go est le petit nouveau, mais il fait déjà beaucoup parler de lui — surtout pour le scraping rapide et concurrent.

Pourquoi Go ?

- Vitesse du compilé : Presque aussi rapide que C++.

- Concurrence intégrée : Les goroutines rendent le scraping parallèle très simple.

- Bibliothèques clés : pour le scraping, pour l’analyse.

Exemple de code Go : extraire le titre d’une page

1package main

2import (

3 "fmt"

4 "github.com/gocolly/colly"

5)

6func main() {

7 c := colly.NewCollector()

8 c.OnHTML("title", func(e *colly.HTMLElement) {

9 fmt.Println("Titre de la page :", e.Text)

10 })

11 err := c.Visit("<https://example.com>")

12 if err != nil {

13 fmt.Println("Erreur :", err)

14 }

15}Atouts :

- Ultra rapide et efficace pour le scraping à grande échelle.

- Facile à déployer (un seul binaire).

- Excellent pour le crawling concurrent.

Limites :

- Communauté plus petite que Python ou Node.js.

- Moins de bibliothèques de scraping de haut niveau.

- La gestion des sites très riches en JavaScript demande une configuration supplémentaire (Chromedp ou Selenium).

Meilleur cas d’usage :

Quand vous devez extraire à grande échelle, ou quand Python n’est tout simplement pas assez rapide. .

Comparer les meilleurs langages de programmation pour le web scraping

Mettons tout cela bout à bout. Voici une comparaison côte à côte pour vous aider à choisir le meilleur langage pour le web scraping en 2026 :

| Langage/Outil | Facilité d’utilisation | Performances | Support des bibliothèques | Gestion du contenu dynamique | Meilleur cas d’usage |

|---|---|---|---|---|---|

| Python | Très élevée | Modérée | Excellente | Bonne (Selenium/Playwright) | Usage général, débutants, analyse de données |

| JavaScript/Node.js | Moyenne | Élevée | Solide | Excellente (native) | Sites dynamiques, scraping asynchrone, développeurs web |

| Ruby | Élevée | Modérée | Correcte | Limitée (Watir) | Scripts rapides, prototypage |

| PHP | Moyenne | Modérée | Moyenne | Limitée (Panther) | Côté serveur, intégration à des applications web |

| C++ | Faible | Très élevée | Limitée | Très limitée | Performances critiques, très grande échelle |

| Java | Moyenne | Élevée | Bonne | Bonne (Selenium/HtmlUnit) | Entreprise, services longue durée |

| Go (Golang) | Moyenne | Très élevée | En croissance | Modérée (Chromedp) | Scraping rapide et concurrent |

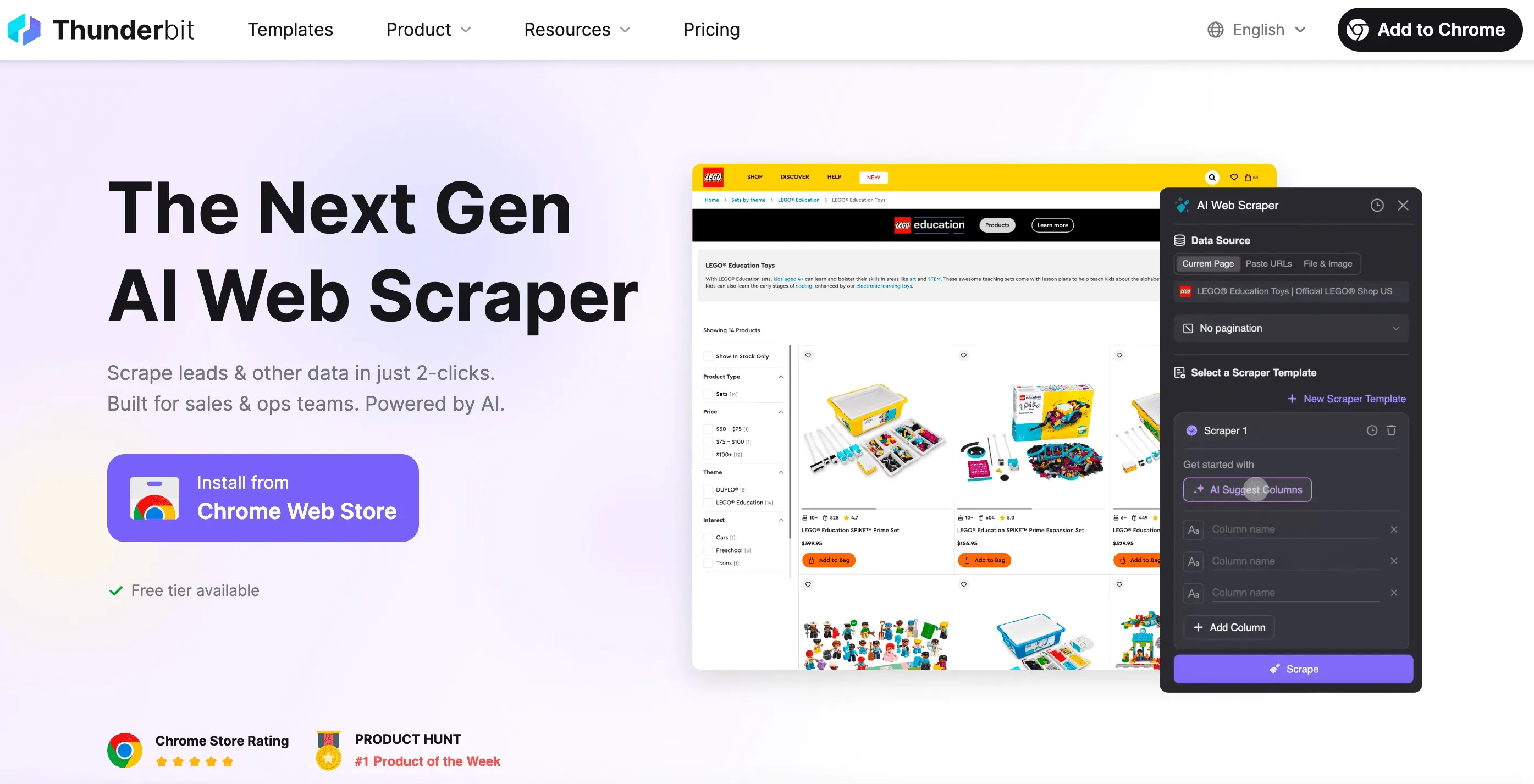

Quand ne pas coder : Thunderbit comme solution de web scraping sans code

Bon, soyons honnêtes : parfois, vous voulez juste les données — sans le code, le débogage ni les crises du genre « pourquoi ce sélecteur ne fonctionne-t-il pas ? ». C’est là que entre en jeu.

En tant que cofondateur de Thunderbit, je voulais créer un outil qui rende le web scraping aussi simple que commander un plat à emporter. Voici ce qui distingue Thunderbit :

- Configuration en 2 clics : Cliquez simplement sur « AI Suggest Fields » puis sur « Scrape ». Pas besoin de manipuler des requêtes HTTP, des proxys ou des techniques anti-bot.

- Modèles intelligents : Un seul modèle de scraper peut s’adapter à plusieurs mises en page. Inutile de réécrire votre scraper à chaque changement de site.

- Scraping dans le navigateur et dans le cloud : Choisissez entre l’extraction dans votre navigateur (idéal pour les sites connectés) ou dans le cloud (très rapide pour les données publiques).

- Gestion du contenu dynamique : L’IA de Thunderbit contrôle un vrai navigateur — elle peut donc gérer le scroll infini, les pop-ups, les connexions, et plus encore.

- Export partout : Téléchargez vers Excel, Google Sheets, Airtable, Notion, ou copiez simplement dans le presse-papiers.

- Aucune maintenance : Si un site change, relancez simplement la suggestion IA. Finies les séances de débogage tardives.

- Planification et automatisation : Configurez des scrapers pour s’exécuter selon un calendrier — pas de cron jobs, pas de serveur à configurer.

- Extracteurs spécialisés : Besoin d’e-mails, de numéros de téléphone ou d’images ? Thunderbit propose aussi des extracteurs en un clic pour cela.

Et le meilleur dans tout ça ? Vous n’avez pas besoin de connaître une seule ligne de code. Thunderbit est conçu pour les utilisateurs métier, les marketeurs, les équipes commerciales, les professionnels de l’immobilier — toute personne ayant besoin de données, vite.

Vous voulez voir Thunderbit en action ? ou consultez notre pour des démonstrations.

Conclusion : choisir le meilleur langage pour le web scraping en 2026

Le web scraping en 2026 est plus accessible — et plus puissant — que jamais. Voici ce que j’ai appris après des années dans les tranchées de l’automatisation :

- Python reste le meilleur langage pour le web scraping si vous voulez démarrer vite et disposer de nombreuses ressources.

- JavaScript/Node.js est imbattable pour le scraping de sites dynamiques riches en JavaScript.

- Ruby et PHP sont parfaits pour les scripts rapides et l’intégration web, surtout si vous les utilisez déjà.

- C++ et Go sont vos alliés quand vous avez besoin de vitesse et d’échelle.

- Java est le choix naturel pour les projets d’entreprise à long terme.

- Et si vous voulez éviter de coder complètement ? est votre arme secrète.

Avant de vous lancer, posez-vous ces questions :

- Quelle est la taille de mon projet ?

- Dois-je gérer du contenu dynamique ?

- Quel est mon niveau de confort technique ?

- Est-ce que je veux construire quelque chose, ou simplement obtenir les données ?

Essayez l’un des extraits de code ci-dessus, ou testez Thunderbit pour votre prochain projet. Et si vous voulez aller plus loin, consultez notre pour davantage de guides, de conseils et d’histoires concrètes de scraping.

Bon scraping — et que vos données soient toujours propres, structurées et à un clic de vous.

P.-S. Si vous vous retrouvez un jour coincé dans un terrier de web scraping à 2 heures du matin, rappelez-vous simplement ceci : Thunderbit est toujours là. Ou le café. Ou les deux.

FAQ

1. Quel est le meilleur langage de programmation pour le web scraping en 2026 ?

Python reste le premier choix grâce à sa syntaxe lisible, ses bibliothèques puissantes (comme BeautifulSoup, Scrapy et Selenium) et sa grande communauté. C’est idéal pour les débutants comme pour les experts, surtout lorsque le scraping est combiné à l’analyse de données.

2. Quel langage est le meilleur pour extraire des sites très riches en JavaScript ?

JavaScript (Node.js) est le meilleur choix pour les sites dynamiques. Des outils comme Puppeteer et Playwright vous donnent un contrôle total du navigateur, ce qui permet d’interagir avec du contenu chargé via React, Vue ou Angular.

3. Existe-t-il une option sans code pour le web scraping ?

Oui — est un extracteur Web IA sans code qui gère tout, du contenu dynamique à la planification. Cliquez simplement sur « AI Suggest Fields » et commencez à extraire. C’est parfait pour les équipes commerciales, marketing ou opérations qui ont besoin rapidement de données structurées.

4. Dois-je encore choisir un langage si un agent de codage IA peut écrire le scraper pour moi ?

Question légitime en 2026. Des outils comme Claude Code, Cursor et OpenAI Codex peuvent générer sans difficulté un spider Scrapy, un script Playwright ou un crawler Go + Colly à partir d’un prompt de quelques lignes — donc la friction liée au « premier langage à apprendre » est réellement plus faible qu’il y a deux ans. Mais l’agent produit quand même du code dans un langage, et vous — ou la personne qui héritera du projet — devrez ensuite le lire, le déboguer et le déployer. Le choix compte donc toujours ; il compte simplement davantage pour la maintenance que pour les 30 premières lignes. Si vous ne voulez toucher à aucun code, c’est là que intervient : il élimine totalement la question du langage.

En savoir plus :