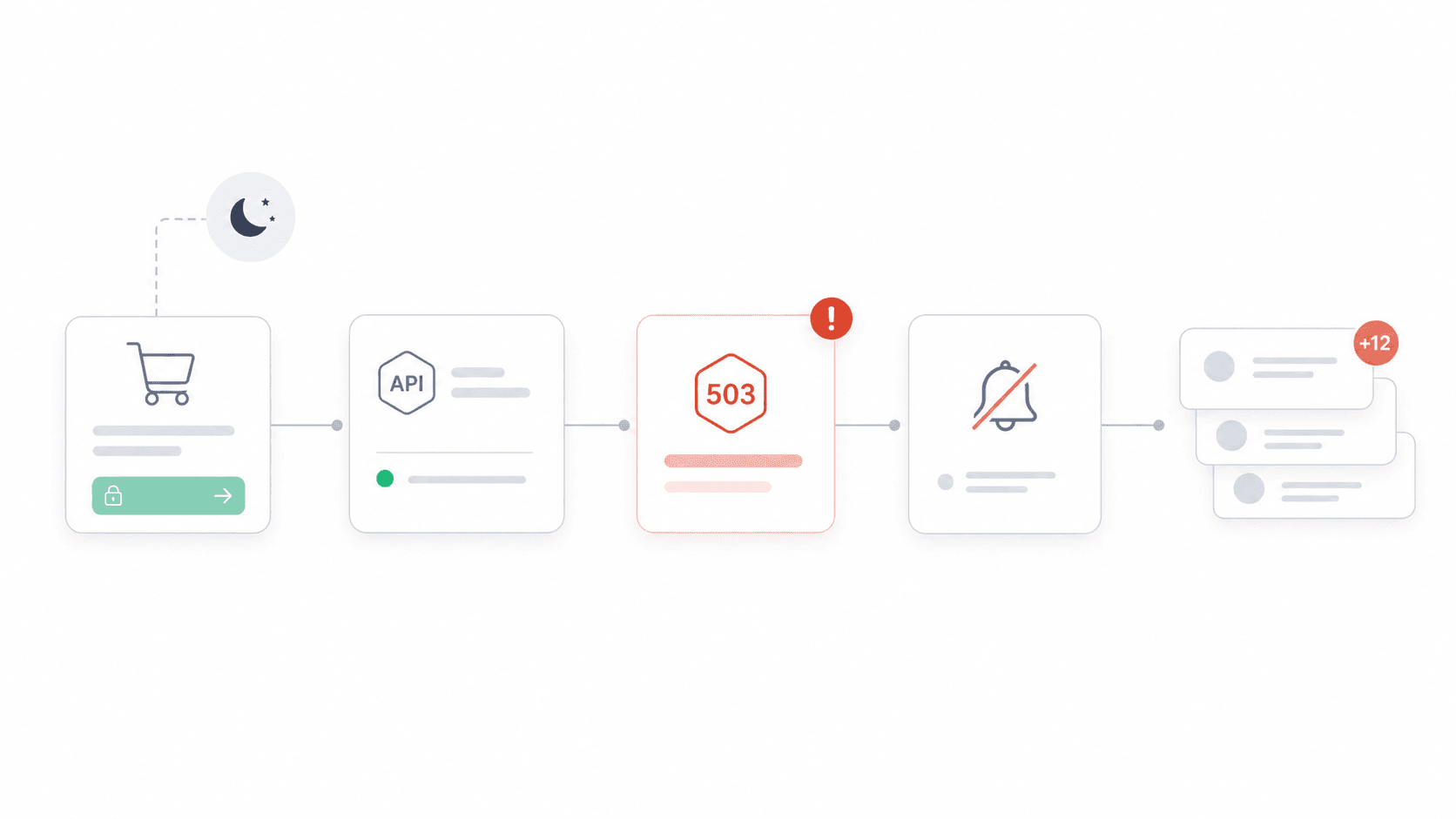

Le mois dernier, l’intégration Stripe d’un ami s’est mise à renvoyer silencieusement des erreurs 503 à 23 h un vendredi. Personne ne s’en est rendu compte avant le samedi matin — quand la boîte mail du support contenait plus de 200 e-mails furieux de clients dont les paiements avaient échoué.

Cette histoire n’a rien d’exceptionnel. Un évalue le coût moyen d’une interruption à 5 600 $ par minute, tandis que . Le chiffre exact dépend du trafic, du taux de conversion, de la valeur des commandes, de l’exposition au SLA et du coût de reprise — mais la tendance est claire : les API non surveillées représentent un risque métier, pas seulement une contrariété pour l’ingénierie. Et avec et , la surveillance n’est plus optionnelle. Ce que je voulais faire avec ce guide, c’était quelque chose que je n’avais pas vu ailleurs : organiser les outils selon votre cas d’usage, évaluer la qualité des alertes (pas seulement leur existence), montrer des tarifs réels pour 2026 et mesurer la rapidité de mise en route. Pas juste une autre liste plate de logos.

Une précision : si votre travail sur les API consiste à collecter des données web, alimenter des LLM, construire des systèmes RAG, surveiller les pages des concurrents ou extraire des données de prix/produits depuis des sites web, la discussion sur les « outils API » ne devrait pas s’arrêter à la surveillance de la disponibilité. Il vous faut aussi un moyen fiable de transformer des pages web complexes en données structurées. C’est là qu’ trouve sa place dans ce guide : ce n’est pas un moniteur de disponibilité, mais c’est l’un des moyens les plus rapides de convertir des sites web en Markdown propre ou en JSON structuré via API.

Qu’est-ce que la surveillance d’API (et pourquoi votre équipe devrait-elle s’en soucier) ?

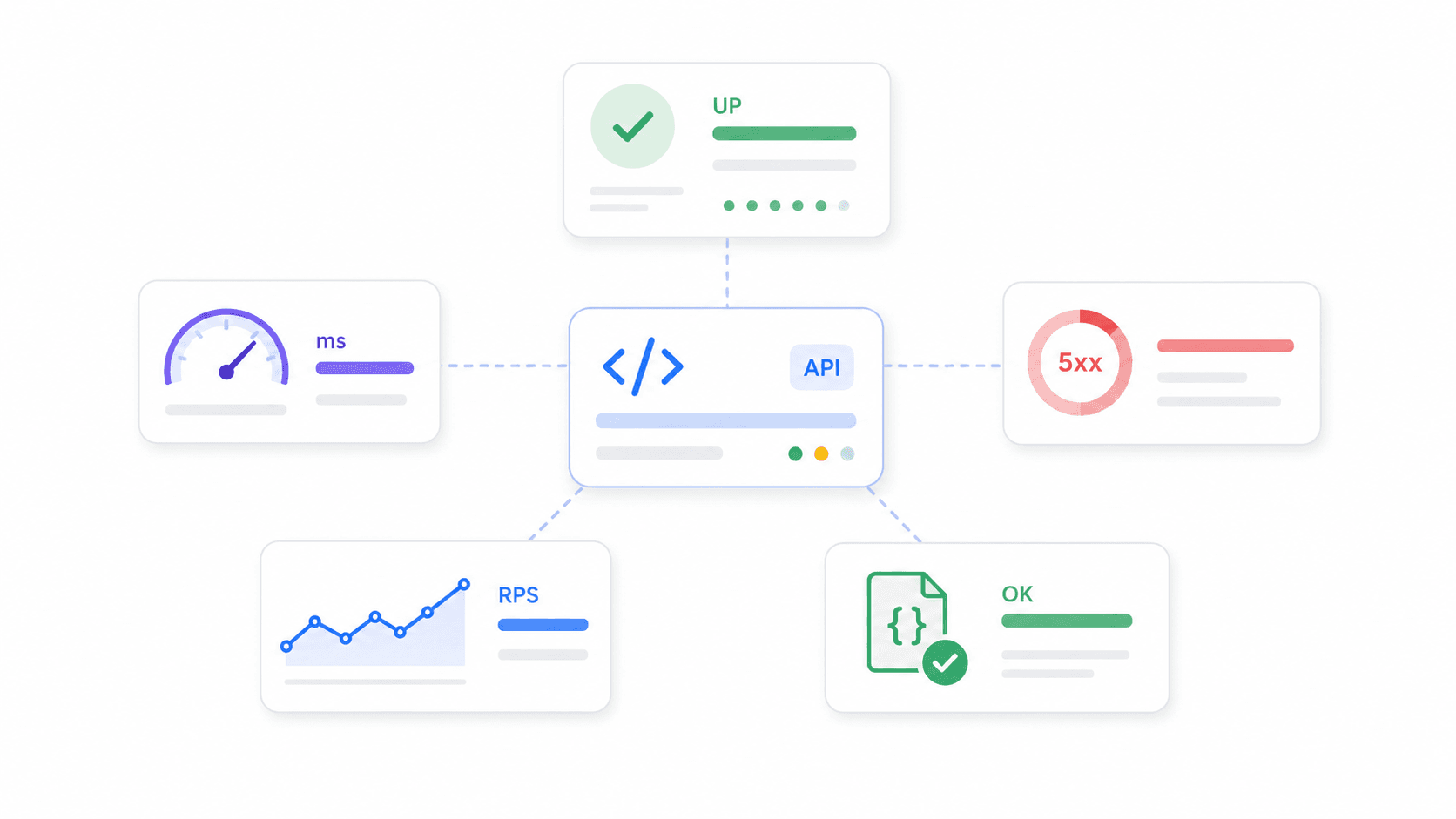

La surveillance d’API consiste à vérifier en continu que vos endpoints API sont disponibles, rapides et renvoient les bonnes données. Pas seulement « le serveur répond-il ? » — un bon moniteur valide les codes de statut HTTP, le contenu de la réponse, la latence, les certificats SSL, les workflows en plusieurs étapes (comme connexion → recherche → commande) et même la conformité du schéma.

C’est différent de la surveillance générale d’un site web (qui vérifie si une page se charge) et de l’APM (Application Performance Monitoring), qui explore les traces au niveau du code, les requêtes de base de données et les aspects internes du runtime. La surveillance d’API se situe à la frontière : elle teste ce que vos utilisateurs, partenaires et intégrations vivent réellement lorsqu’ils appellent vos endpoints.

Il existe aussi une catégorie connexe qui mérite d’être mentionnée : les API de données web. Elles ne surveillent pas la santé de votre propre API ; elles aident votre produit ou votre workflow à collecter de manière fiable des données web externes. Par exemple, peut transformer une page web en Markdown propre, extraire des champs structurés en JSON et exécuter des traitements par lots sur de nombreuses URL. Si votre projet « API » dépend de données fraîches de fournisseurs, de pages produits, d’annonces publiques, de pages de documentation ou de sources de recherche, ce type d’API d’extraction de données peut être tout aussi essentiel opérationnellement que les contrôles de disponibilité.

Pourquoi les non-ingénieurs devraient-ils s’en préoccuper ? Parce que et que . Quand une passerelle de paiement, un service d’authentification ou une API d’expédition tombe en panne, ce n’est pas un problème d’infrastructure abstrait — c’est du revenu perdu, des contrats partenaires fragilisés, des pics au support et une confiance érodée. Product managers, équipes commerciales, opérations et customer success sont tous concernés.

Métriques clés à surveiller :

- Taux de disponibilité : part du temps pendant lequel un endpoint est accessible

- Temps de réponse / latence : temps nécessaire à l’endpoint pour répondre (moyenne, p95, p99)

- Taux d’erreur : part des requêtes renvoyant des 5xx, des timeouts ou des échecs d’assertion

- Débit : requêtes par seconde/minute

- Conformité : l’API renvoie-t-elle les données attendues, et pas seulement un 200 OK ?

Comment nous avons évalué les meilleurs outils de surveillance d’API pour 2026

La plupart des articles « meilleurs outils de surveillance d’API » empilent simplement des noms de fournisseurs et des fonctionnalités. Je voulais être plus rigoureux dans les critères de sélection — en partie parce que j’ai passé beaucoup de temps à lire des forums de développeurs, et en partie parce que l’équipe Thunderbit m’a aidé à des sites des fournisseurs pour construire une comparaison réelle (j’y reviens plus loin).

Voici ce que nous avons pondéré :

| Critère | Pourquoi c’est important |

|---|---|

| Facilité de configuration / délai avant la première alerte | Les petites équipes ont besoin d’une couverture aujourd’hui, pas après un projet plateforme |

| Intelligence des alertes et réduction du bruit | Si les alertes sont bruyantes, les équipes les ignorent et ratent les vrais incidents |

| Générosité de l’offre gratuite | Les side projects et les jeunes startups commencent souvent gratuitement |

| Transparence des prix | Les factures d’observabilité peuvent exploser avec les hôtes, les sièges, les logs, les exécutions synthétiques et l’ingestion de données |

| Largeur des intégrations | Les alertes doivent arriver là où les équipes travaillent déjà (Slack, PagerDuty, etc.) |

| Scalabilité et profondeur des données | Les équipes matures ont besoin de traces, logs, APM, RBAC, SSO, rétention |

| Qualité de la communauté et du support | Les équipes open source ont besoin d’un rythme de publication ; les équipes enterprise ont besoin de SLA |

| Capacité d’extraction de données web | Les apps IA, les workflows RAG et les outils de veille marché ont souvent besoin de données externes propres, pas seulement de vérifier la disponibilité d’un endpoint |

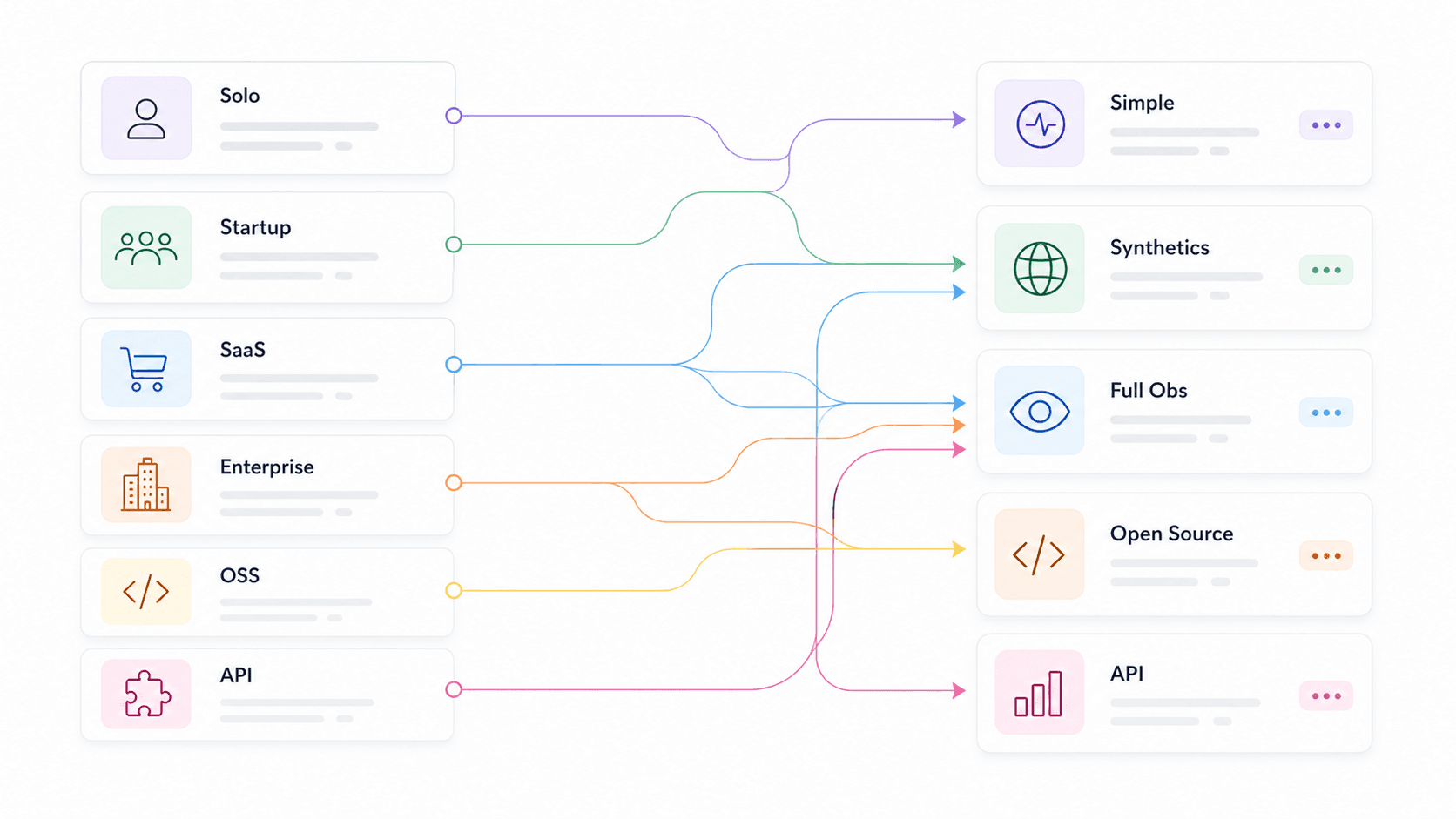

Nous avons aussi segmenté les recommandations par cas d’usage — dev solo, startup, e-commerce/SaaS, enterprise, puristes open source, équipes produit API et équipes web data/IA — afin que vous puissiez aller directement à votre contexte plutôt que de lire 14 résumés d’outils en espérant deviner lequel vous concerne. L’ a montré que et comme critères de sélection, ce qui confirme qu’il ne s’agit pas de simples bonus.

Meilleurs outils de surveillance d’API par cas d’usage : tableau de sélection rapide

Voici le raccourci. Trouvez votre ligne, puis passez aux sections outils ci-dessous pour le détail complet.

| Cas d’usage | Outils recommandés | Différenciateur clé |

|---|---|---|

| Équipes web data / applications IA | Thunderbit Open API, Moesif, Apitally | Transformer des sites web en Markdown propre ou en JSON structuré pour les workflows LLM, RAG, pricing et recherche |

| Dev solo / side project | UptimeRobot, Uptime Kuma, Gatus | Gratuit ou auto-hébergé, configuration minimale, mise en route rapide |

| Startup (équipe de 5 à 15 personnes) | Checkly, Better Stack, Postman | Alerting intelligent, mise en route rapide, prix abordable, pages de statut |

| E-commerce / SaaS | Datadog, New Relic, Moesif, Checkly | Métriques métier, APM/tracing, profondeur SDK, synthetics multi-étapes |

| Enterprise / multi-cloud | Datadog, New Relic, Splunk, Grafana Cloud | Tracing distribué, conformité, hybride, RBAC/SSO |

| Puristes open source | Prometheus + Grafana, Uptime Kuma, Gatus, Uptrace | Contrôle total, natif OTel, pas de verrouillage fournisseur |

| Équipes produit API | Moesif, Apitally, New Relic | Usage par client, tendances des endpoints, alertes d’anomalie |

Le principal schéma : les outils les plus rapides à mettre en place sont souvent moins riches en analytics, tandis que les plateformes les plus profondes demandent davantage de configuration et de discipline budgétaire. Ce n’est pas un défaut — c’est un compromis à connaître. Thunderbit joue dans une case légèrement différente : il est le plus rapide quand il s’agit de transformer des pages web en données prêtes pour une API, pas quand il faut alerter des ingénieurs sur une panne.

Thunderbit Open API : idéal pour transformer des sites web en données API structurées

est l’API que je placerais en premier pour les équipes dont le workflow de « surveillance » ou de recherche dépend de données web externes. Ce n’est pas un outil traditionnel de surveillance de disponibilité comme Checkly ou UptimeRobot. À la place, Thunderbit transforme n’importe quelle page web en données propres et structurées que vos applications, agents, tableaux de bord et pipelines LLM peuvent réellement utiliser.

L’API propose trois workflows principaux. Distill convertit une page en Markdown propre, prêt pour les LLM. Extract prend un schéma et renvoie des champs JSON structurés comme le nom du produit, le prix, la disponibilité, la taille de l’entreprise, le stade de financement ou la note des avis. Batch permet de traiter jusqu’à 100 URL de manière asynchrone avec webhooks, ce qui est utile lorsque vous surveillez des pages de tarification, des catalogues concurrents, des documentations fournisseurs, des sources d’actualité ou de grandes listes de recherche.

Si cet outil mérite sa place dans un guide des outils API, c’est parce que les équipes sous-estiment souvent l’infrastructure nécessaire pour « juste scraper cette page ». Les sites riches en JavaScript nécessitent du rendu. Certaines pages demandent du géoroutage. Le HTML doit être débarrassé des barres de navigation, publicités, modales et éléments génériques avant d’être utile à un LLM. Les sélecteurs cassent quand les mises en page changent. La rotation de proxies, la gestion anti-bot, les retries, les files d’attente et l’interrogation des résultats peuvent transformer un petit workflow de données en projet de maintenance. Thunderbit absorbe une grande partie de ce travail derrière une seule API.

Idéal pour : les équipes qui construisent des applications IA, les équipes RAG, les opérations e-commerce, les équipes commerciales, les growth teams, les analystes marché et les développeurs qui ont besoin de données de sites web via une API sans bâtir et surveiller eux-mêmes une stack de scraping.

Tarifs : , comprenant jusqu’à 600 pages Distill ou 30 pages Extract, avec 2 requêtes simultanées. Starter est affiché à 16 $/mois en facturation annuelle pour 60 000 unités API/an et 30 requêtes simultanées. Pro est affiché à 40 $/mois en facturation annuelle pour 600 000 unités API/an et 50 requêtes simultanées.

Rapidité de mise en route : environ 5 à 15 minutes pour obtenir une clé API et exécuter une première requête Distill ou Extract avec cURL, des SDK ou le .

Limites : Thunderbit ne remplace pas Datadog, New Relic, Better Stack ou Checkly pour les vérifications de disponibilité, l’escalade d’incident, les traces, les logs ou le routage d’astreinte. Voyez-le comme l’API que vous utilisez pour collecter et structurer des données web — y compris les tarifs fournisseurs, la documentation, les pages concurrentes, les fiches produits ou les jeux de données publics — pas comme le système qui alerte votre ingénieur d’astreinte.

Datadog : le meilleur pour la visibilité full-stack

Datadog est l’outil que je vois revenir sans cesse dans les stacks SaaS enterprise et mid-market, et pour de bonnes raisons. Ce n’est pas seulement de la surveillance d’API — c’est une plateforme d’observabilité complète qui relie les tests synthétiques d’API aux traces distribuées, aux logs, aux métriques d’infrastructure et à la surveillance des utilisateurs réels dans une seule vue.

Pour la surveillance d’API en particulier, Datadog prend en charge HTTP, SSL, DNS, WebSocket, TCP, UDP, ICMP, gRPC et les . Ses apprennent les schémas attendus et alertent sur les écarts plutôt que sur des seuils statiques — ce qui représente un vrai progrès par rapport à « alerter quand la latence > 500 ms ». Il propose aussi des qui anticipent quand une métrique dépassera un seuil, ainsi que des moniteurs composites qui combinent plusieurs conditions.

Idéal pour : les équipes e-commerce, SaaS et enterprise qui veulent une vue unifiée des API, de l’infrastructure, des logs et des traces.

Tarifs : les détails de l’offre gratuite varient selon le produit. ; les tests synthétiques d’API coûtent 5 $ pour 10 000 exécutions. Plus de 800 intégrations.

Rapidité de mise en route : environ 15 à 30 minutes pour installer l’agent et lancer un test synthétique basique.

Limites : peut devenir coûteux à grande échelle — le « bill shock » revient souvent sur Hacker News et Reddit. Le nombre important de références commerciales (hôtes, logs, métriques personnalisées, synthetics, utilisateurs) signifie qu’il faut quelqu’un pour surveiller la facture, pas seulement les tableaux de bord. La courbe d’apprentissage est bien réelle pour l’ensemble de la plateforme.

Checkly : idéal pour les contrôles synthétiques pensés pour les développeurs

Checkly est l’outil que je donnerais à une équipe d’ingénierie de startup qui veut que les vérifications API vivent près de son code. Son idée centrale est la « surveillance as code » : définir programmatiquement des contrôles API et navigateur, les exécuter depuis des emplacements mondiaux, les intégrer aux pipelines CI/CD et tout gérer via Git.

L’angle qualité des alertes est très fort ici. La de Checkly est explicitement présentée comme la « première ligne de défense » contre les faux positifs — vous pouvez configurer des retries fixes, linéaires ou exponentiels, des retries depuis le même ou un autre emplacement, ainsi qu’une durée maximale de retry avant déclenchement d’une alerte. L’outil distingue aussi les états dégradé, en échec et rétabli, ce qui aide à réduire les pages inutiles.

Idéal pour : les startups et équipes dev qui veulent des contrôles API programmables, des , une intégration CI/CD et une mise en route rapide.

Tarifs : des données publiques récentes montrent un plan gratuit avec 10 moniteurs de disponibilité, 1 000 contrôles navigateur et 10 000 contrôles API. Starter autour de 24 $/mois en facturation annuelle — avant d’acheter.

Rapidité de mise en route : environ 10 à 20 minutes pour un premier contrôle API et un canal d’alerte.

Limites : centré sur les contrôles synthétiques. Ce n’est pas un remplacement pour un APM poussé, l’analyse de logs ou le tracing distribué. Si vous devez corréler une panne API avec un goulot d’étranglement de base de données, il vous faudra un autre outil en complément.

UptimeRobot : le meilleur pour un suivi simple et abordable de la disponibilité

UptimeRobot, c’est la Honda Civic de la surveillance d’API. Il fait une chose, et il la fait bien : vous créez un moniteur HTTP, mot-clé, ping, port, SSL ou heartbeat, vous choisissez un intervalle et vous recevez une alerte en cas d’échec. C’est tout.

Idéal pour : les devs solo, les petites équipes, les agences ou toute personne ayant besoin d’un suivi de base de la disponibilité et de la latence sans complexité.

Tarifs : . Plan Solo payant autour de 7 $/mois en facturation annuelle. Aucune carte bancaire requise pour l’offre gratuite. Rapidité de mise en route : environ 2 à 5 minutes — le plus rapide de cette liste.

Limites : intelligence des alertes limitée. Alertes basées sur de simples seuils, pas de détection d’anomalies, pas de tracing distribué, pas d’analytics approfondies. Si vous devez savoir pourquoi un endpoint est lent (et pas seulement qu’il est lent), UptimeRobot ne vous apportera pas la réponse.

Uptime Kuma : le meilleur outil gratuit et auto-hébergé pour la surveillance d’API

Uptime Kuma est le chouchou de la communauté self-hosting, et les chiffres GitHub le confirment : , avec la version 2.3.2 en mai 2026. Sous licence MIT, il prend en charge HTTP(s), mot-clé, requête JSON, WebSocket, TCP, ping, DNS, push, Docker, plusieurs pages de statut et plus de 90 services de notification.

Idéal pour : les devs solo et les équipes qui veulent un contrôle total, de la confidentialité et zéro coût SaaS récurrent — si vous avez un serveur.

Tarifs : gratuit. Le vrai coût, c’est votre VM/conteneur, les sauvegardes, les mises à jour et le maintien du moniteur lui-même en ligne. Rapidité de mise en route : environ 5 à 15 minutes avec Docker pour un contrôle basique ; 15 à 30 minutes pour peaufiner notifications et page de statut.

Limites : la maintenance vous incombe. Et voici le piège critique : si vous hébergez Uptime Kuma sur la même infrastructure qu’il surveille, une panne cloud ou DNS fera tomber à la fois votre application et votre moniteur. Hébergez-le ailleurs ou associez-le à une vérification SaaS.

Better Stack : le meilleur pour une réponse rapide aux incidents

Better Stack (souvent encore appelé Better Uptime par les utilisateurs) combine surveillance de disponibilité, gestion d’incidents, planification d’astreinte, politiques d’escalade et pages de statut au sein d’une seule plateforme. Son point fort n’est pas l’analytics, mais le workflow d’incident autour de la surveillance.

Les définissent qui est alerté, dans quel ordre et avec quels délais, jusqu’à prise en compte. Le routage basé sur les métadonnées envoie les incidents selon la gravité ou la responsabilité. L’outil s’intègre avec Slack, Teams, webhooks et Zapier.

Idéal pour : les startups et équipes de taille intermédiaire qui veulent surveillance + réponse aux incidents + pages de statut sans assembler trois outils distincts.

Tarifs : . Team autour de 29 $/mois en facturation annuelle. Rapidité de mise en route : environ 5 à 10 minutes via l’assistant graphique.

Limites : moins de profondeur dans l’analyse des payloads API, le tracing distribué ou l’analyse de KPI métier que Datadog, New Relic ou Moesif.

Prometheus + Grafana : la meilleure stack open source pour surveiller les API

C’est le duo open source standard du secteur. récupère et stocke des métriques en séries temporelles. (73 705 étoiles GitHub, 3 010 contributeurs) fournit des tableaux de bord et des alertes. gère le routage, le regroupement, la déduplication, le silence et l’inhibition. Pour les contrôles d’endpoint API, les équipes ajoutent pour sonder HTTP, HTTPS, DNS, TCP, ICMP et gRPC.

Idéal pour : les puristes open source, les équipes Kubernetes/SRE et les organisations déjà standardisées sur les métriques Prometheus.

Tarifs : gratuit en auto-hébergé. propose une offre gratuite (100 k exécutions de tests API/mois) et des plans payants basés sur l’usage.

Rapidité de mise en route : 1 à 4 heures pour un Blackbox + Prometheus + Grafana + Alertmanager basique. Plusieurs jours pour une haute disponibilité de production et un réglage fin des alertes.

Limites : PromQL, YAML, relabeling, design de tableaux de bord, rétention, stockage, haute disponibilité et réglage des alertes constituent un vrai travail opérationnel. Le compromis récurrent est « moins d’interface, plus de YAML ». C’est la stack pour les équipes qui pensent déjà en métriques et veulent un plan de contrôle unique — pas pour celles qui veulent que la surveillance soit opérationnelle avant le déjeuner.

New Relic : le meilleur pour la performance applicative SaaS

New Relic combine APM, surveillance d’infrastructure, logs, tracing distribué, surveillance synthétique, alertes, tableaux de bord et analyse d’incidents assistée par IA. Son offre gratuite — — est réellement généreuse pour les petites équipes.

L’intelligence des alertes est précisément l’endroit où New Relic brille dans la discussion sur la fatigue d’alerte. Ses fonctionnalités d’ comprennent la corrélation d’événements, la détection d’anomalies, les alertes prédictives, l’analyse de la cause racine et la suppression des oscillations. New Relic a publié un exemple montrant qu’ — c’est un chiffre concret de réduction du bruit.

Idéal pour : les équipes SaaS et les plateformes e-commerce qui veulent une surveillance d’API étroitement intégrée aux traces applicatives, aux erreurs, au débit et à l’impact utilisateur.

Tarifs : gratuit : 100 Go/mois, 1 utilisateur complet. Les offres payantes sont basées sur l’utilisateur et la consommation de données.

Rapidité de mise en route : environ 15 à 30 minutes pour l’installation de l’agent et la configuration guidée.

Limites : la tarification peut devenir complexe à grande échelle. La configuration des alertes a une courbe d’apprentissage — la plateforme est puissante, mais pas immédiatement évidente.

Moesif : le meilleur pour l’analytics API et les métriques métier

Moesif n’est pas un moniteur de disponibilité traditionnel. C’est de l’analytics API et de l’intelligence produit : comprendre l’utilisation des API par client, endpoint, cohorte, entreprise, géographie, SDK, offre et comportement. Si votre question est « quel client est impacté ? » plutôt que « l’endpoint est-il en ligne ? », Moesif est conçu pour cela.

Il prend en charge les pour des métriques API comme les pics/baisses de trafic, la latence et les changements de comportement. Les alertes dynamiques ont besoin de quelques jours de comportement API pour construire un modèle, mais une fois entraînées, elles détectent des changements que les règles statiques manquent.

Idéal pour : les équipes produit API, les sociétés SaaS et les plateformes e-commerce qui veulent relier la performance API au chiffre d’affaires, à l’engagement et à la rétention.

Tarifs : ; les offres payantes évoluent avec le volume d’événements API. Les montants en self-service n’étaient pas entièrement extractibles dans mes recherches — vérifiez la page actuelle.

Rapidité de mise en route : environ 20 à 45 minutes (l’intégration SDK/proxy/gateway est plus poussée qu’un simple ping externe).

Limites : davantage axé analytics que surveillance de disponibilité traditionnelle. Vous voudrez probablement l’associer à Checkly, UptimeRobot ou aux synthetics de Datadog pour les contrôles d’accessibilité externes.

Splunk : le meilleur pour l’analyse de logs d’entreprise et la conformité

Splunk est l’outil vers lequel on se tourne lorsque l’agrégation de logs, la recherche, la corrélation, l’auditabilité conforme et la prise en charge hybride/multi-cloud sont non négociables. couvre l’infrastructure, l’APM, les synthetics, le monitoring des utilisateurs réels, les logs et la réponse aux incidents. peut regrouper les événements notables en épisodes et réduire le bruit à travers les silos de monitoring.

La propre est préoccupante : , et .

Idéal pour : les équipes enterprise et multi-cloud avec des exigences strictes de conformité, de sécurité, d’audit et de recherche dans les logs.

Tarifs : basés sur l’usage et orientés devis. Pas d’offre gratuite simple adaptée à la production.

Rapidité de mise en route : l’onboarding cloud peut être plus rapide, mais un déploiement enterprise prend souvent de quelques jours à plusieurs semaines.

Limites : coûteux à grande échelle. Mise en place complexe. Surdimensionné pour les devs solo et les petites startups.

Postman : le meilleur pour les équipes qui testent déjà des API

Postman est avant tout une plateforme de développement et de test d’API, mais son permet aux équipes de planifier des collections Postman et de les exécuter depuis des emplacements cloud. L’argument le plus fort est la réutilisation : si votre équipe QA ou dev possède déjà des collections Postman avec assertions, les transformer en moniteurs est une suite logique.

Idéal pour : les équipes de développement et de QA qui utilisent déjà des collections Postman et veulent des vérifications planifiées sans acheter un outil synthétique séparé.

Tarifs : une offre gratuite existe. ; lot additionnel de 50 000 appels pour 20 $/mois. Vérifiez la — le packaging de Postman change.

Rapidité de mise en route : environ 10 minutes si les collections existent déjà.

Limites : les capacités de surveillance sont plus légères que celles d’outils dédiés comme Checkly, Datadog ou New Relic. Les options d’alerte sont basiques.

Autres outils de surveillance d’API qui méritent un coup d’œil

: tableau de bord de santé léger, auto-hébergé et piloté par configuration. , prend en charge HTTP, ICMP, TCP, DNS, des métriques compatibles Prometheus et des badges de disponibilité. Idéal pour les devs solo qui veulent quelque chose de plus simple que Prometheus mais préfèrent YAML/config-as-code à l’interface d’Uptime Kuma.

: outil plus récent centré sur l’analytics du trafic API et le suivi qualité pour les startups. Affirme une avec des alertes personnalisées sur 14 métriques. Bon pour de l’analytics API léger sans adopter une plateforme d’observabilité complète.

: monitoring full-stack avec logs, synthetics et visibilité infrastructure. . Une alternative Datadog moins coûteuse pour les équipes mid-market.

: backend APM, tracing, métriques et logs natif OpenTelemetry. . Ce n’est pas un simple vérificateur de disponibilité, mais c’est idéal pour les équipes standardisées sur OTel qui veulent un backend de tracing ouvert.

Construire ou acheter : faut-il créer votre propre surveillance d’API ?

« Est-ce que je devrais simplement écrire un script qui ping mes endpoints, ou utiliser un outil dédié ? »

Cette question revient sans cesse dans les forums de développeurs. J’ai lu suffisamment de fils Reddit pour voir le schéma : les équipes commencent avec curl + cron, cela fonctionne très bien un temps, puis elles passent à autre chose quand elles ont besoin de tableaux de bord, d’historique, de vérifications multi-régions, d’un routage d’alerte fiable ou d’une visibilité inter-équipes.

Une matrice de décision honnête :

| Facteur | Script personnalisé | Outil spécialisé |

|---|---|---|

| Temps de mise en place | 1 à 4 heures (basique) ; plusieurs jours (robuste) | 5 à 30 minutes |

| Maintenance | Vous l’assumez pour toujours | Le fournisseur gère les mises à jour |

| Qualité des alertes | Basique (up/down) | Intelligente (tendances de latence, anomalies, retries) |

| Coût | Gratuit (votre temps) | 0–500 $+/mois |

| Tableau de bord | À construire de zéro | Préconstruit, personnalisable |

| À privilégier quand… | ≤ 3 endpoints, équipe très technique, projet hobby | 5+ endpoints, équipe ops/produit, revenus en jeu |

L’enseignement principal des forums : ceux qui construisent leur propre solution le regrettent souvent dès qu’ils ont besoin de tableaux de bord, d’historique ou de visibilité inter-équipes. Et il y a le problème méta — « il faut surveiller votre système de surveillance ». Un moniteur auto-hébergé, une base de données, des sauvegardes, un chemin réseau et un fournisseur d’alertes doivent eux aussi être fiables.

Construisez si vous avez 2 endpoints et aimez bricoler. Achetez si vous avez un produit à livrer.

La même logique s’applique à l’extraction de données web. Vous pouvez écrire un scraper, exécuter des navigateurs headless, faire tourner des proxies, maintenir des sélecteurs, nettoyer le HTML et construire une file d’attente. Mais si l’objectif est d’alimenter de manière fiable un produit API, un agent IA ou un workflow de recherche avec des données web, utiliser est généralement plus rapide que de reconstruire soi-même une infrastructure de scraping.

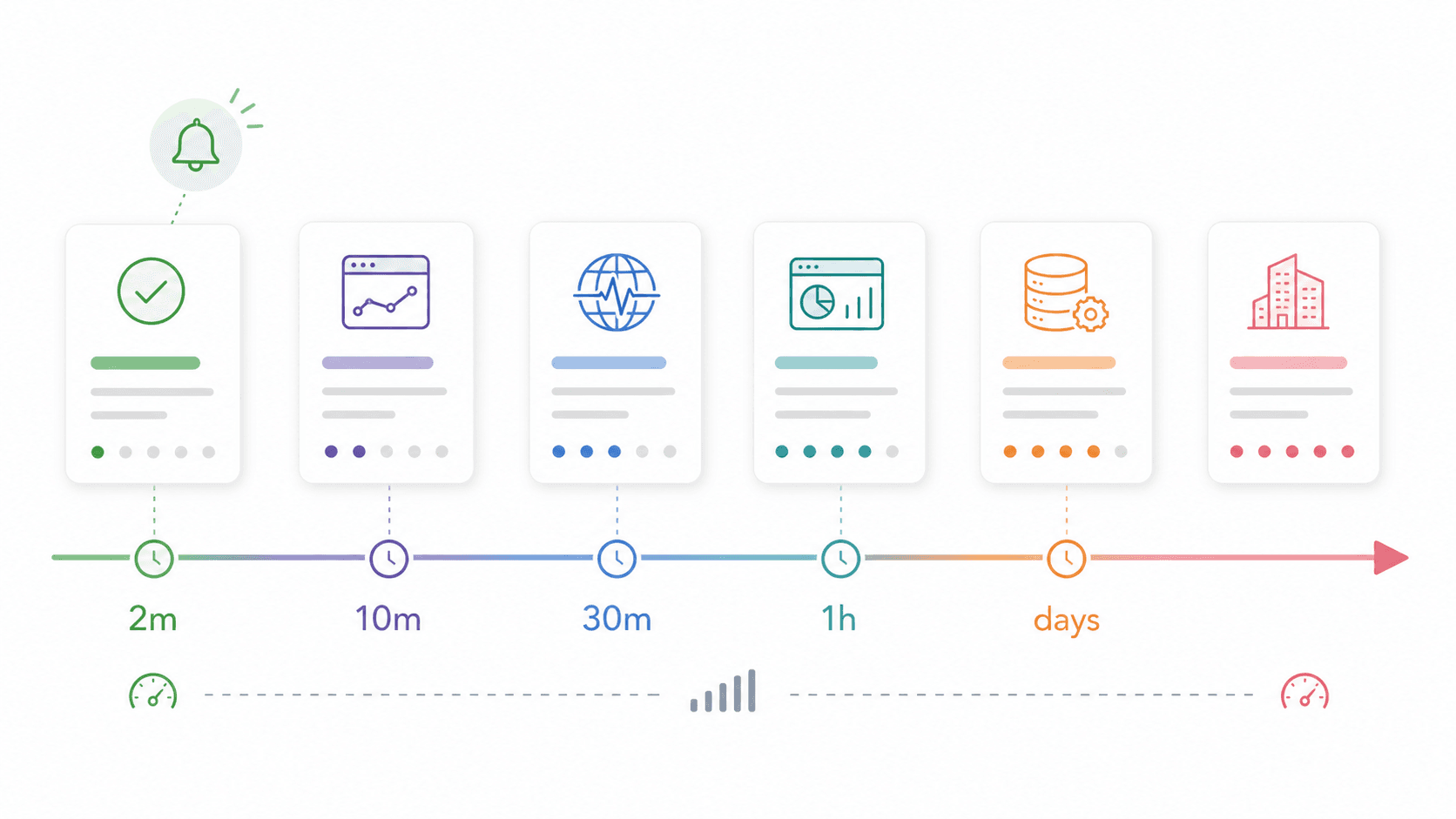

Fatigue d’alerte : pourquoi la qualité des alertes prime sur leur quantité

C’est peut-être le critère le plus sous-estimé lors du choix d’un outil de surveillance d’API. La fatigue d’alerte survient lorsque les équipes reçoivent tellement d’alertes bruyantes, dupliquées ou non actionnables qu’elles finissent par toutes les ignorer — puis ratent les vrais incidents.

Les chiffres sont frappants. Le a révélé que l’organisation médiane générait et . L’actionnabilité médiane des incidents n’était que de — ce qui signifie que moins d’un incident dérivé de cinq alertes était réellement exploitable. L’ a montré que et que .

Le meilleur outil de surveillance est celui dont vous faites vraiment confiance aux alertes. Voici une comparaison de la manière dont les outils gèrent l’intelligence des alertes :

| Outil | Type d’alerte | Méthode de réduction du bruit | Canaux d’alerte |

|---|---|---|---|

| Datadog | Anomalie ML, prévision, composite | Bandes d’anomalie historiques, bases dynamiques, Watchdog AI | Slack, PagerDuty, Opsgenie, Teams, 20+ |

| Checkly | Basée sur seuil + dégradation | Retry avant déclenchement, retries même/différent emplacement | Slack, PagerDuty, Opsgenie, Teams, incident.io |

| New Relic | Regroupement d’incidents IA, anomalie, prédictif | Corrélation d’événements, suppression des oscillations, contexte de cause racine | Slack, PagerDuty, Teams, webhooks |

| Moesif | Anomalie comportementale | Modèles dynamiques après plusieurs jours de comportement | Slack, PagerDuty, e-mail, SMS |

| Better Stack | Disponibilité/incidents/astreinte | Politiques d’escalade, routage par responsabilité, délais | Slack, Teams, webhooks, Zapier |

| Prometheus + Alertmanager | Alertes de règles PromQL | Regroupement, déduplication, silence, inhibition | E-mail, PagerDuty, Opsgenie, webhooks |

| Splunk | Événements, épisodes, santé du service | ITSI Event Analytics, regroupement en épisodes, ticketing | Splunk On-Call, ServiceNow, webhooks |

| Thunderbit Open API | Pas une plateforme d’alerte | À utiliser avec votre propre ordonnanceur, outil de workflow ou stack de monitoring | Webhooks pour les traitements par lots ; alertes gérées à l’extérieur |

Conseil pratique : commencez avec moins d’alertes, mais plus fiables. Utilisez les retries avant déclenchement, la confirmation multi-régions, les alertes de burn rate SLO, la déduplication et le routage par responsabilité. Alertez sur l’impact utilisateur et les flux critiques pour le business (échec du paiement, échec de l’authentification, 5xx sur les paiements), pas sur chaque symptôme interne.

Tarifs et offres gratuites 2026 : ce que vous payez vraiment

Les pages tarifaires changent. Les offres gratuites évoluent. Les coûts cachés (hôtes, sièges, logs, exécutions synthétiques, ingestion de données) peuvent vous surprendre. C’est la section que j’aimerais voir sur chaque article « meilleurs outils ». Snapshot 2026 :

| Outil | Offre gratuite | Prix de départ du payant | Carte bancaire requise ? | Meilleur cas d’usage gratuit |

|---|---|---|---|---|

| Thunderbit Open API | 600 unités API à usage unique | ~16 $/mois en annuel | Non | Extraction de données web pour LLM, RAG, pricing et recherche |

| Uptime Kuma | Illimité (auto-hébergé) | — | Non | Surveillance complète, à votre propre serveur |

| UptimeRobot | 50 moniteurs, intervalles de 5 min | ~7 $/mois | Non | Contrôles de disponibilité basiques |

| Better Stack | 10 moniteurs, 1 page de statut | ~29 $/mois | Non | Disponibilité startup + page de statut |

| Checkly | 10 contrôles de disponibilité, 10k contrôles API | ~24 $/mois | Oui | Contrôles API synthétiques |

| Postman | Compte gratuit + quota de monitoring | ~14 $/utilisateur/mois | Non | Réutilisation de collections existantes |

| Prometheus + Grafana | Illimité (auto-hébergé) | — | Non | Métriques + visualisation |

| Grafana Cloud | 100k exécutions de tests API/mois | 29 $/mois plateforme + usage | Vérifier | Essai de synthetics managés |

| New Relic | 100 Go/mois, 1 utilisateur complet | Par utilisateur + données | Certains plans | APM + observabilité basique |

| Datadog | Essai/variable selon produit | 15 $/hôte/mois (Infra Pro) | Souvent oui | Évaluation full-stack |

| Moesif | Version gratuite/essai disponible | Basé sur le volume | Vérifier | Évaluation de l’analytics API |

| Splunk | Essais disponibles | Sur devis | Parcours commercial | POC enterprise |

| Gatus | Illimité (auto-hébergé) | — | Non | Tableau de statut piloté par YAML |

| Apitally | Version gratuite/essai disponible | Vérifier | Vérifier | Analytics API léger |

| Sematext | Essai/gratuit variable | ~2 $/moniteur HTTP | Vérifier | Synthetics/logs à coût réduit |

| Uptrace | Gratuit en auto-hébergé | Les offres cloud varient | Vérifier | Évaluation APM OTel |

Note sur les coûts cachés : les outils auto-hébergés (Uptime Kuma, Prometheus, Gatus) sont « gratuits » en licence, mais une petite VM, les sauvegardes, le temps de maintenance et un basculement externe peuvent facilement devenir le vrai coût. Pour les API de données web, le coût caché est souvent différent : maintenance de navigateurs headless, sélecteurs cassés, pools de proxies, contournements anti-bot et nettoyage HTML.

Estimation pour petite équipe : pour 10 endpoints API et 3 membres d’équipe, le chemin SaaS le moins cher est généralement UptimeRobot gratuit ou peu payant, Better Stack gratuit/Team, ou Checkly si le volume d’exécution correspond. Datadog et New Relic peuvent être abordables pour l’évaluation, mais la vraie facture dépend des hôtes, des utilisateurs, des logs, des traces et du volume d’exécutions synthétiques. Si votre projet a besoin de données web sous forme d’API, les unités API gratuites de Thunderbit suffisent à tester le workflow avant de passer à un plan payant.

Tableau de complexité de configuration : à quelle vitesse jusqu’à votre première alerte ?

Aucun article concurrent que j’ai trouvé n’évalue le time-to-value — combien de temps il faut, de l’inscription à la réception de votre première alerte pertinente. Pour les petites équipes, c’est plus important que la profondeur fonctionnelle.

| Outil | Temps jusqu’à la première alerte | Niveau technique requis | Approche de configuration |

|---|---|---|---|

| Thunderbit Open API | ~5–15 minutes | Faible à moyen | Clé API, cURL/SDK/CLI |

| UptimeRobot | ~2–5 minutes | Faible | GUI, ajout en un clic |

| Better Stack | ~5–10 minutes | Faible | Assistant graphique |

| Checkly | ~10–20 minutes | Faible à moyen | Code ou GUI |

| Postman | ~10 minutes (avec collections) | Faible à moyen | Planificateur de collections |

| Uptime Kuma | ~5–30 minutes | Moyen | Docker + GUI |

| Gatus | ~15–45 minutes | Moyen | YAML + Docker |

| Datadog | ~15–30 minutes | Moyen | Installation de l’agent + GUI |

| New Relic | ~15–30 minutes | Moyen | Agent + configuration guidée |

| Moesif | ~20–45 minutes | Moyen | Intégration SDK/proxy |

| Grafana Cloud Synthetics | ~15–45 minutes | Moyen | GUI, Terraform facultatif |

| Prometheus + Grafana | 1 à 4 heures | Moyen à élevé | YAML, PromQL |

| Uptrace | 30–90 minutes | Moyen à élevé | Intégration OTel SDK |

| Splunk | De plusieurs heures à plusieurs semaines | Élevé | Onboarding enterprise |

Si la surveillance doit être en ligne avant la fin de journée, commencez dans la moitié supérieure de ce tableau. Si l’objectif est une observabilité de plateforme durable, prévoyez un projet distinct pour la moitié inférieure. Et si votre premier jalon est « obtenir des données propres de ces 100 pages web dans une application », commencez avec Thunderbit avant de bâtir une infrastructure de scraping sur mesure.

Comparatif complet des meilleurs outils de surveillance d’API

Un tableau à scanner avant de décider :

| Outil | Meilleur cas d’usage | Offre gratuite | Intelligence des alertes | Temps de mise en route | Hébergement | Fonction remarquable |

|---|---|---|---|---|---|---|

| Thunderbit Open API | Extraction de données web/pipelines de données API | 600 unités API | Pas un outil d’alerte | 5–15 min | Cloud | Transformer des pages en Markdown ou extraire du JSON basé sur un schéma |

| Datadog | Full-stack enterprise/SaaS | Essai/variable | Anomalie, prévision, IA | 15–30 min | Cloud | Corrèle les synthetics avec les logs/traces/infrastructure |

| Checkly | Synthetics orienté dev | Généreux, basé sur les contrôles | Retries, dégradation | 10–20 min | Cloud | Monitoring as code + Playwright |

| UptimeRobot | Disponibilité simple | 50 moniteurs | Seuils basiques | 2–5 min | Cloud | Moniteur basique le plus rapide et peu coûteux |

| Uptime Kuma | Gratuit auto-hébergé | Illimité | Statut/seuil basique | 5–30 min | Auto-hébergé | Interface propre, pas de frais SaaS |

| Better Stack | Réponse aux incidents/pages de statut | 10 moniteurs | Escalades, routage | 5–10 min | Cloud | Surveillance + astreinte + page de statut |

| Prometheus + Grafana | Stack métriques open source | Illimité (auto-hébergé) | Regroupement Alertmanager | 1–4 h | Auto-hébergé/cloud | Profondeur de l’écosystème PromQL |

| New Relic | APM SaaS + contrôles API | 100 Go/mois, 1 utilisateur | Regroupement IA, suppression des oscillations | 15–30 min | Cloud | APM puissant + synthetics réunis |

| Moesif | Analytics API/métriques métier | Gratuit/essai | Anomalies comportementales | 20–45 min | Cloud | Analytics du comportement API par client |

| Splunk | Logs enterprise/conformité | Essai | Épisodes ITSI, AIOps | Plusieurs jours+ | Cloud/auto-géré | Recherche de logs et gouvernance d’entreprise |

| Postman | Équipes qui testent déjà des API | Compte gratuit | Alertes de monitoring basiques | 10 min | Cloud | Réutilisation des collections de tests API |

Comment Thunderbit peut accélérer l’évaluation de vos outils API

Transparence totale : n’est pas un outil de surveillance d’API — c’est un scraper web IA et une pour transformer des pages web en Markdown propre ou en JSON structuré. Cela le rend utile dans une autre partie du processus de décision sur les outils de monitoring : collecter les tarifs des fournisseurs, les limites de plan, les promesses de fonctionnalités, les détails de documentation et les listes d’intégrations avant de choisir une plateforme.

Au lieu d’ouvrir manuellement plus de 10 pages tarifaires de fournisseurs, de copier les noms des offres, les limites de moniteurs, les intervalles de contrôle, les intégrations et les exigences de carte bancaire dans un tableur, nous avons utilisé l’ pour extraire des données structurées depuis les pages de tarifs et de fonctionnalités de chaque outil. L’IA de Thunderbit lit chaque page et suggère des champs — nom de l’offre, détails de l’offre gratuite, prix payant, intégrations prises en charge — puis structure la sortie dans un tableur exportable.

Pour les workflows développeurs, vous donne la même idée de façon programmatique. Utilisez Distill quand vous voulez un Markdown propre pour des LLM ou du RAG. Utilisez Extract quand vous avez besoin de champs précis renvoyés en JSON. Utilisez Batch quand vous devez traiter une liste de pages tarifaires, d’URLs de documentation, de pages produits ou de pages concurrentes et recevoir les résultats de manière asynchrone.

Le workflow :

- Ouvrez la page tarifaire d’un fournisseur (Datadog, Checkly, UptimeRobot, etc.)

- Cliquez sur « AI Suggest Fields » — Thunderbit propose des colonnes selon le contenu de la page

- Cliquez sur « Scrape » — les données se remplissent dans un tableau structuré

- Utilisez le scraping de sous-pages pour atteindre les pages tarifs, fonctionnalités et documentation de chaque fournisseur

- Exportez vers Google Sheets, Excel, Airtable, Notion ou CSV

Pour les équipes orientées API, le workflow via l’API est tout aussi direct :

- Obtenez une clé API gratuite chez Thunderbit

- Appelez l’endpoint Distill pour obtenir un Markdown propre à partir de n’importe quelle page publique

- Appelez l’endpoint Extract avec des descriptions de schéma pour obtenir du JSON structuré

- Utilisez les endpoints Batch et les webhooks pour les listes d’URL plus importantes

- Envoyez la sortie vers votre application, votre tableur, votre entrepôt de données, votre base vectorielle ou votre workflow de monitoring

Pour un comparatif de plus de 10 fournisseurs, le copier-coller manuel peut facilement prendre 2 à 3 heures une fois incluses les sous-pages tarifaires, la documentation et les pages d’intégration. Thunderbit a réduit notre première passe d’extraction à environ 15 à 30 minutes, le temps restant étant consacré à la vérification et aux arbitrages. Si votre équipe ops, achats, recherche ou produit IA évalue des outils sous contrainte de temps, c’est un raccourci pratique. Vous pouvez en savoir plus sur ce type de workflow dans notre guide , consulter nos ou regarder notre pour des démonstrations.

Comment choisir le meilleur outil de surveillance d’API pour votre équipe

Le « meilleur » outil de surveillance d’API dépend de la taille de votre équipe, de votre maturité technique, de votre budget et de ce à quoi ressemble une panne pour votre produit.

Un dev solo n’a pas besoin de Splunk. Une grande entreprise régulée ne devrait pas dépendre d’un cron job. Une équipe produit API peut avoir davantage besoin d’analytics clients à la Moesif que de simples pings de disponibilité. Une équipe e-commerce devrait prioriser les contrôles des parcours critiques : connexion, recherche, ajout au panier, paiement et autorisation. Une équipe IA ou data peut avoir besoin d’une extraction de données web à la Thunderbit avant même d’avoir besoin d’une observabilité complète.

Trois principes ont tenu tout au long de mes recherches :

- Adaptez l’outil à votre cas d’usage. Le tableau de sélection rapide existe pour une raison — commencez par lui.

- Priorisez la qualité des alertes plutôt que leur quantité. Si votre équipe ignore les alertes, vous n’avez pas de monitoring. Vous avez du bruit.

- Ne sous-estimez pas la vitesse de déploiement. Un moniteur opérationnel aujourd’hui et des alertes fiables valent mieux qu’un plan de plateforme parfait qui laisse les paiements sans surveillance pendant encore un mois.

Si vous comparez plusieurs outils simultanément et voulez accélérer la recherche, essayez pour extraire en masse les données des fournisseurs dans un seul tableur. Si vous construisez un produit API, un pipeline RAG, un agent IA ou un workflow de veille marché qui a besoin de données web propres, commencez avec . Il ne choisira pas l’outil de surveillance à votre place — mais il vous fera avancer plus vite vers la décision, et il peut donner à votre propre produit une couche de données web fiable.

FAQ sur les meilleurs outils de surveillance d’API

Quel est le meilleur outil gratuit de surveillance d’API en 2026 ?

Pour la simplicité SaaS, UptimeRobot offre 50 moniteurs gratuits à intervalles de 5 minutes sans carte bancaire requise. Pour un contrôle auto-hébergé, Uptime Kuma est open source, illimité et propose une interface propre avec plus de 90 services de notification. Pour les équipes qui veulent de la profondeur métrique et disposent déjà des compétences techniques, Prometheus + Grafana + Alertmanager constitue la meilleure stack open source — mais sa mise en place prend des heures, pas des minutes.

Si votre objectif n’est pas de surveiller la disponibilité mais d’extraire des données web via une API, Thunderbit Open API propose une offre gratuite avec 600 unités API à usage unique, suffisantes pour tester la distillation page-vers-Markdown ou l’extraction JSON basée sur un schéma avant de passer à l’échelle.

Quelle est la différence entre la surveillance d’API et l’APM ?

La surveillance d’API vérifie de l’extérieur la disponibilité des endpoints, le temps de réponse, les erreurs et la conformité — elle simule ce que vit un utilisateur ou une intégration. L’APM (Application Performance Monitoring) va plus loin à l’intérieur de l’application : traces au niveau du code, requêtes de base de données, erreurs d’exécution, latence des files d’attente et dépendances des services. Des outils comme Datadog et New Relic proposent les deux ; UptimeRobot et Uptime Kuma se concentrent sur les vérifications externes de disponibilité.

Thunderbit Open API est différent des deux : c’est une API d’extraction de données web. Elle vous aide à transformer des sites web externes en Markdown ou en JSON structuré, ce qui est utile pour les applications LLM, les workflows de recherche, l’intelligence tarifaire et les pipelines de données.

À quelle fréquence dois-je surveiller mes API ?

Les API de production critiques pour le chiffre d’affaires (paiement, authentification, checkout) devraient généralement être vérifiées toutes les minutes. Les API internes ou à faible trafic peuvent souvent être vérifiées toutes les 5 minutes. Mais la fréquence seule ne suffit pas — utilisez des retries, plusieurs régions et des assertions pertinentes pour que chaque contrôle soit à la fois rapide et digne de confiance. Un contrôle à 1 minute qui déclenche de fausses alertes est pire qu’un contrôle à 5 minutes en lequel vous avez confiance.

Pour les workflows d’extraction de données web, la fréquence dépend de la vitesse à laquelle la source change. Les pages de tarification peuvent nécessiter une extraction quotidienne ou hebdomadaire. Des données d’inventaire, de voyage ou de marketplace qui évoluent rapidement peuvent nécessiter une actualisation horaire ou plus fréquente. L’API batch et les webhooks de Thunderbit sont utiles lorsque vous devez traiter de nombreuses URL selon un calendrier.

Puis-je surveiller des API sans écrire de code ?

Oui. UptimeRobot, Better Stack et Uptime Kuma peuvent être utilisés entièrement via des interfaces graphiques. Checkly prend en charge à la fois la configuration par GUI et par code. Postman utilise une interface basée sur les collections. Prometheus/Grafana nécessite généralement du YAML et du PromQL. Datadog et New Relic peuvent démarrer avec une configuration guidée, mais deviennent plus puissants avec une instrumentation plus poussée.

Si vous voulez extraire des données de site web sans écrire de code, l’extension Chrome de Thunderbit est la voie no-code. Si vous voulez automatiser ce même workflow depuis une application, propose aux développeurs les endpoints Distill, Extract et Batch.

Comment réduire la fatigue d’alerte liée à la surveillance d’API ?

Choisissez des outils avec un alerting intelligent : détection d’anomalies (Datadog, New Relic), retry avant déclenchement (Checkly), anomalies comportementales (Moesif) ou regroupement/silence (Prometheus Alertmanager). Commencez avec moins d’alertes, mais plus fiables, centrées sur l’impact côté utilisateur. Utilisez des alertes de burn rate SLO plutôt que des seuils statiques, dédupliquez entre services, routez par responsabilité et mesurez l’actionnabilité — si moins de 20 % de vos alertes mènent à une action réelle, réduisez d’abord le bruit.

En savoir plus