Une recherche GitHub pour « amazon scraper » renvoie environ . Si l’on se limite aux dépôts poussés au cours des six derniers mois, on tombe à environ — à peine 20 %. Le reste ? Des tutoriels abandonnés, des wrappers obsolètes et des scripts qui ont cessé de fonctionner dès qu’Amazon a renforcé ses défenses.

J’ai passé beaucoup de temps à fouiller des dépôts d’Amazon scraper, à lire des issues GitHub et à suivre des discussions sur Reddit et Stack Overflow. Le constat est toujours le même : quelqu’un trouve un dépôt populaire, passe une heure à le configurer, l’exécute une fois, puis se heurte à une avalanche de CAPTCHA ou d’erreurs 503. En 2026, la posture anti-bot d’Amazon n’a plus rien à voir avec celle d’il y a seulement deux ans — le TLS fingerprinting, l’analyse comportementale et le déploiement agressif de CAPTCHA ont rendu l’ancienne stratégie « faire tourner les user agents et espérer » presque inutile. Ce guide couvre les bonnes pratiques qui comptent vraiment si vous voulez obtenir des données Amazon fiables à partir d’un dépôt GitHub, ainsi que la marche à suivre quand votre scraper casse — ou plutôt, quand il casse.

Qu’est-ce qu’un Amazon Scraper sur GitHub (et pourquoi échouent-ils autant) ?

Un dépôt GitHub d’Amazon scraper est généralement un script open source — souvent en Python, Node.js ou basé sur Scrapy — qui extrait des données structurées depuis des pages Amazon. Les cibles de données sont familières : titre du produit, prix, ASIN, notes, nombre d’avis, disponibilité, informations sur le vendeur, cartes des résultats de recherche et texte des avis.

L’architecture est en général assez simple :

- Un client HTTP ou un navigateur headless récupère la page.

- Un analyseur HTML ou JSON extrait les champs.

- Les données sont enregistrées en CSV, JSON ou dans une base de données.

Les dépôts se répartissent généralement en quatre catégories :

- Bibliothèques Python légères (par ex. )

- Spiders Scrapy (par ex. )

- Automatiseurs de navigateur Selenium ou Playwright

- Projets de wrapper d’API qui sont en réalité des interfaces pour un service d’extraction commercial (par ex. )

Le schéma d’échec est prévisible. La plupart des dépôts cassent parce que :

- Amazon modifie la mise en page de ses pages ou des fragments HTML

- Amazon renvoie un 503 ou un CAPTCHA au lieu du contenu réel

- L’empreinte TLS et HTTP du scraper ne ressemble plus à celle d’un navigateur

- Une incohérence de locale, de langue ou d’en-têtes déclenche des soupçons

- Le mainteneur passe à autre chose après avoir résolu son cas d’usage initial, très limité

Un grand nombre d’étoiles et « actuellement utilisable » sont deux choses très différentes. Dans l’audit que j’ai réalisé pour cet article, seuls environ trois des huit dépôts les plus visibles semblaient clairement actifs en 2026.

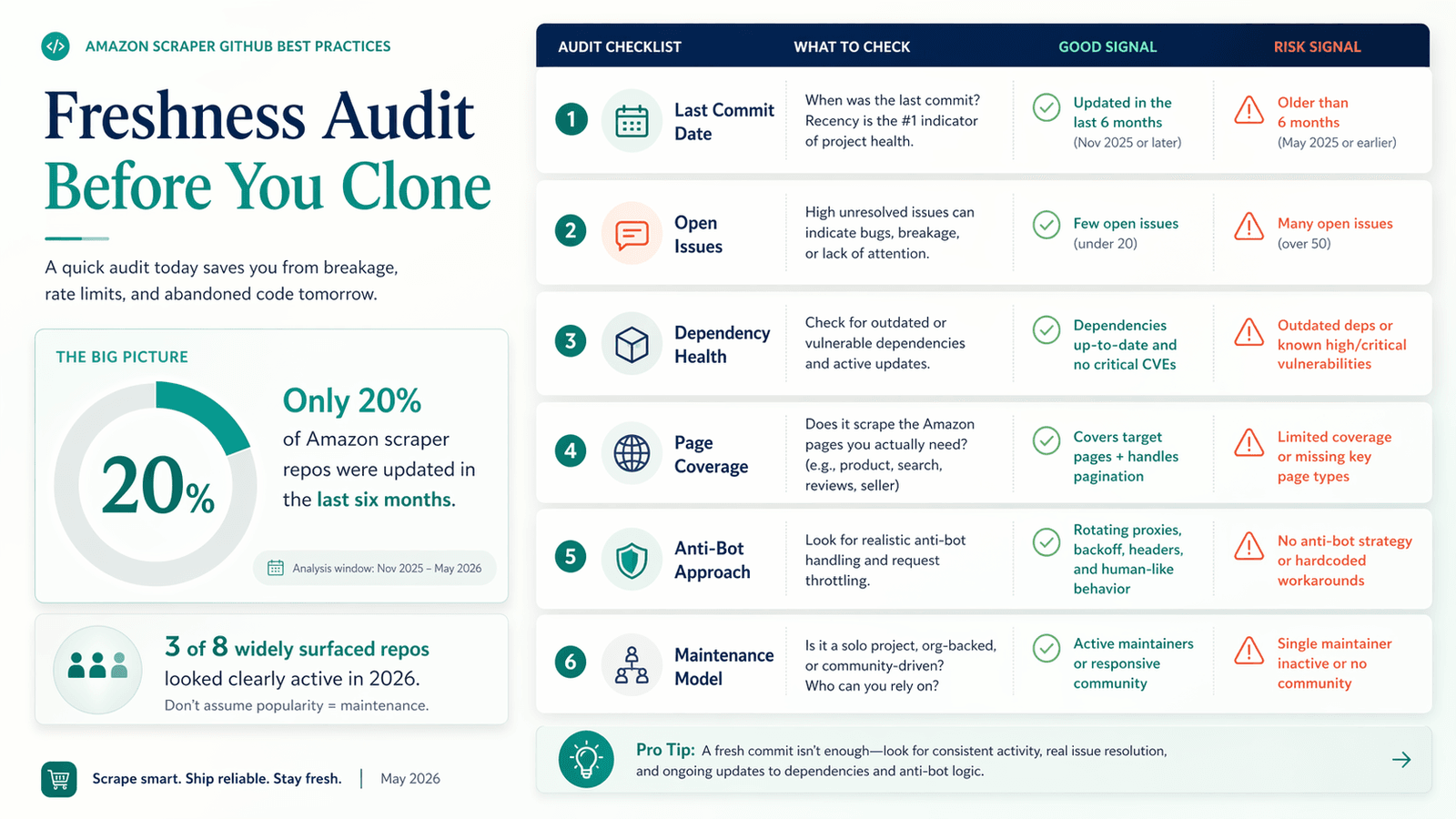

Faites un audit de fraîcheur 2026 avant de cloner n’importe quel dépôt GitHub d’Amazon Scraper

Cette étape compte davantage pour Amazon que pour la plupart des autres cibles. La défense d’Amazon évolue plus vite qu’un site e-commerce typique, donc un dépôt qui fonctionne très bien sur un site vitrine peut devenir inutilisable sur Amazon en quelques semaines. Pourtant, la plupart des listes « meilleur amazon scraper github » recommandent des dépôts sans vérifier s’ils fonctionnent encore. Les utilisateurs perdent des heures à configurer des outils cassés.

Comment vérifier si un dépôt GitHub est encore actif

Avant de faire un git clone, passez ces points en revue :

- Date du dernier commit : tout ce qui date de plus de 6 mois est un fort signal d’alerte sur Amazon.

- Issues ouvertes vs. taux de réponse : cherchez dans l’onglet Issues les mots « captcha », « 503 », « blocked » et « not working ». Si ces signalements s’accumulent sans réponse du mainteneur, passez votre chemin.

- Santé des dépendances : ouvrez

requirements.txtoupackage.json. Les bibliothèques obsolètes (par ex. un ancienrequestssans gestion TLS moderne) sont un signal rouge. - Couverture des types de pages Amazon : le dépôt gère-t-il les pages produit, les résultats de recherche et les avis ? Ou seulement un seul type ?

- Approche anti-bot : des en-têtes codés en dur sans prise en charge des proxys, c’est une approche de 2023 qui ne survivra pas à 2026.

Checklist de fraîcheur pour Amazon Scraper GitHub

| Signal de fraîcheur | À vérifier | Signal d’alerte 🚩 |

|---|---|---|

| Date du dernier commit | Flux des commits ou date de push du dépôt | Plus ancien que 6 mois |

| Issues ouvertes | Onglet Issues — filtrez « captcha », « 503 », « blocked » | Pannes répétées sans réponse du mainteneur |

| Santé des dépendances | requirements.txt / package.json | Bibliothèques obsolètes, aucune stratégie TLS moderne |

| Couverture des pages Amazon | README + exemples de code | Ne gère qu’un seul type de page (par ex. produits, mais pas recherche ni avis) |

| Approche anti-bot | Code source, configuration des proxys | Seulement des en-têtes et chaînes UA codés en dur |

| Modèle de maintenance | S’agit-il d’un vrai scraper, d’un tutoriel ou d’un wrapper d’API commerciale ? | Le dépôt n’est en réalité qu’une interface vers un service payant |

Ce que l’audit a réellement montré

J’ai évalué huit dépôts d’Amazon scraper largement visibles selon ces critères. Les résultats sont plutôt préoccupants :

| Dépôt / Outil | Étoiles | Signal du dernier commit | Périmètre | Statut 2026 | Notes |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2 872 | 2026-04-02 | Wrapper d’API de scraper managé | Actif, mais pas en DIY | Récent, mais il s’agit en réalité d’une interface pour un service managé |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API managée pour recherche, détails, avis | Actif, mais pas en DIY | Bonne couverture, mais c’est un produit API, pas un scraper brut |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Bibliothèque Python légère | Actif | Le scraper GitHub direct le plus clair, utilisant curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Avis uniquement | Étroit mais utilisable | Ancien et très centré sur les avis |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Dernier commit en 2023 ; dépôt poussé le 2024-08-20 | Spiders Scrapy + middleware de proxys | Niveau tutoriel, vieillissant | Utile pour apprendre, pas pour une stack prête à l’emploi en 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI Node pour recherche, détails, avis | Risque élevé | Couverture large, mais maintenance trop ancienne |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Recherche vers CSV | Mort pour 2026 | Populaire historiquement, clairement obsolète |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Tutoriel recherche/produit | Mort pour 2026 | En pratique, à l’archive |

Les issues publiques racontent la même histoire. contient une issue intitulée « All requests receive captcha response. » a « Doesn't seem to be working. » affiche « Bypass Amazon protection. » Ce ne sont pas des cas rares ou marginaux — ce sont les tout premiers problèmes rencontrés par les utilisateurs.

Le plan anti-bannissement : comment éviter d’être bloqué avec un Amazon Scraper GitHub

Être bloqué est, de loin, le plus gros point de douleur pour toute personne qui utilise un projet amazon scraper github. Les conseils génériques comme « utilisez des proxys et faites tourner les user agents » ne suffisent plus. La pile anti-bot 2025-2026 d’Amazon inclut le TLS fingerprinting, l’analyse comportementale et un déploiement agressif de CAPTCHA. Il vous faut une approche multicouche.

Appariement de l’empreinte TLS : pourquoi requests en version vanilla vous fait bannir

C’est l’une des techniques anti-bannissement les plus souvent négligées. Le TLS fingerprinting fonctionne ainsi : lorsque votre script ouvre une connexion sécurisée vers Amazon, le serveur peut en apprendre beaucoup sur le client via sa manière de « négocier » — les suites de chiffrement proposées, l’ordre des extensions, les paramètres HTTP/2. Les navigateurs utilisent des paramètres TLS et HTTP/2 relativement fixes, et ces combinaisons sont identifiables par des techniques comme .

requests classique et les configurations httpx ordinaires peuvent copier les en-têtes, mais pas le comportement TLS et HTTP/2 d’un Chrome. Amazon voit la différence.

traite ce problème directement. Il fournit une impersonation de navigateur — les cibles prises en charge incluent chrome136, safari184 et firefox133 — afin que l’empreinte TLS de votre client HTTP corresponde à celle d’un vrai navigateur. La documentation met explicitement en garde contre la génération de chaînes JA3 aléatoires : les empreintes de navigateur sont en grande partie fixes selon la version, et un hasard incohérent est plus facile à détecter qu’une vraie empreinte copiée.

Les données de la communauté vont dans le même sens. Un confirme que l’argument impersonate est utile, car il fait tourner les profils de navigateur tout en gardant des en-têtes cohérents. Un autre indique qu’Amazon bloque les clients sur la base de l’empreinte TLS « après environ un mois ou deux ». Un demande spécifiquement si Amazon fingerprint les requêtes python-requests (spoiler : oui).

Si vous utilisez encore requests classique comme premier client Amazon, remettez cette hypothèse en question avant de mettre à jour quoi que ce soit d’autre.

Rotation de proxys bien faite (pas juste « utilisez des proxys »)

Le but des proxys n’est pas de tourner le plus possible. Le but est de rendre les sessions crédibles.

Résidentiels vs datacenter : les proxys datacenter sont moins chers mais plus faciles à détecter. Les proxys résidentiels coûtent plus cher, mais sont bien plus difficiles à signaler pour Amazon. La commence à 4,00 $/Go en paiement à l’usage, puis descend à 3,50 $/Go sur les plans plus importants. commence à 6 $/Go. Amazon appartient à la catégorie des cibles « sophistiquées », pour lesquelles les proxys résidentiels valent le surcoût.

Rotation par requête vs par session : c’est là que la plupart des tutoriels se trompent. Faire tourner les proxys à chaque requête tout en gardant les cookies et les en-têtes constants peut paraître moins humain, pas plus. Le schéma le plus sûr :

- Conservez la traversée recherche → produit → avis sur la même session sticky quand c’est possible

- Changez de session au lancement d’une nouvelle recherche, pas à chaque requête

- Faites tourner les proxys entre les sessions, pas aléatoirement au sein d’une même session de navigation

Un a noté que les IP ISP classiques obtenaient des résultats bien moins bons que les IP mobiles sur les sites e-commerce populaires. Un autre rapporte des blocages malgré la rotation des user agents et l’usage de proxys résidentiels — bon rappel que les proxys, à eux seuls, ne suffisent pas.

Rythme des requêtes, backoff et limitation de débit

Les pages 503 d’Amazon ne sont pas une simple malchance. Ce sont des retours d’information.

Un à propos de l’extraction de plus de 500 ASIN a signalé un 503 au même endroit à chaque fois, vers l’ASIN 101, même avec des pauses. Le schéma est ancien, mais la leçon reste valable : un volume brut provenant d’une seule IP ou d’une seule empreinte finit par déclencher les défenses.

Rythme recommandé pour des scrapers GitHub DIY :

- Délais aléatoires entre les requêtes (et non des intervalles fixes, qui sont détectables)

- 2 à 5 secondes entre les requêtes publiques sur des pages produit pour des clients HTTP simples

- Backoff exponentiel après un 503 ou un CAPTCHA — reculez progressivement au lieu de réessayer immédiatement

- Concurrence plus faible que celle que vous pensez nécessaire

- Journalisation en fail-open plutôt que des boucles de retry serrées

La plupart des dépôts amazon scraper github n’intègrent pas de limitation de débit. Vous devrez l’ajouter vous-même.

Orchestration des en-têtes : bien plus que les chaînes User-Agent

Amazon vérifie l’ensemble des en-têtes, pas seulement le User-Agent.

Un ensemble d’en-têtes de navigateur crédible devrait inclure :

User-AgentAcceptAccept-LanguageAccept-Encoding- Les indices

Sec-CH-*lorsqu’ils sont pertinents - Un comportement de connexion cohérent avec le profil de navigateur choisi

Les en-têtes doivent correspondre à la locale de la place de marché. Un a constaté que la même configuration de bot n’était détectée que dans certaines locales, un autre commentateur pointant des en-têtes liés à la région comme Accept-Language.

La règle : les en-têtes, le profil TLS/navigateur et la géographie du proxy ne doivent pas se contredire. N’envoyez pas des en-têtes Chrome avec un UA Firefox. N’utilisez pas un proxy américain avec Accept-Language: de-DE.

Gestion des CAPTCHA : quand résoudre, quand reculer

Rencontrer un CAPTCHA signifie qu’Amazon est déjà méfiant. Le résoudre ne remet pas votre score de confiance à zéro.

Pour des événements CAPTCHA isolés et peu fréquents :

- Le package PyPI est un solveur de CAPTCHA texte Amazon en pur Python, même si sa dernière version date de mai 2023 — considérez-le comme un outil tactique, pas comme une stratégie durable

- affiche le CAPTCHA Amazon à 0,45 $ pour 1 000 résolutions

Pour des boucles CAPTCHA répétées :

- Arrêtez de résoudre et commencez à prendre du recul

- Des CAPTCHA répétés signifient que la session est grillée — les résoudre ne reconstruit pas la confiance dans l’empreinte, l’historique de session ou la réputation IP

- Si les CAPTCHA se regroupent par sous-réseau de proxy, le problème vient de la couche réseau, pas du parseur

Quand un navigateur headless est vraiment nécessaire — et quand c’est excessif

La mauvaise intuition consiste à lancer Playwright pour tout.

Cas d’usage adaptés au navigateur :

- Résultats de recherche dépendant du rendu JavaScript ou d’un état lié à la locale

- Parcours d’avis qui redirigent vers des pages de connexion ou d’authentification

- Flux où les cookies et le contexte navigateur comptent plus que la vitesse brute

Cas d’usage inadaptés au navigateur :

- Pages produit publiques ordinaires

- Extraction statique de fiches produit, lorsqu’un client HTTP ressemblant à un navigateur suffit

- Récupération en masse à grande échelle, quand l’efficacité de calcul compte

Commencez avec le client le plus léger qui fonctionne. Un sur le scraping à grande échelle décrivait la progression : commencer avec requests, puis curl_cffi, et ne passer à un navigateur complet que lorsque les options plus légères échouent. Les navigateurs headless sont nettement plus lents et plus gourmands en ressources que les clients HTTP pour l’extraction de pages produit Amazon.

Matrice de décision anti-bannissement pour les projets Amazon Scraper GitHub

| Scénario | Approche recommandée | Pourquoi |

|---|---|---|

| Pages produit publiques (petite échelle) | curl_cffi + session résidentielle sticky | La voie la moins chère qui ressemble encore à un navigateur |

| Pages de résultats de recherche | curl_cffi d’abord, Playwright seulement si le rendu ou l’état cassent le HTTP | La recherche est plus dépendante de l’état et sensible à la locale |

| Avis (connexion requise) | Mode navigateur avec vrais cookies/session | La connexion et les flux d’avis dynamiques sont plus difficiles à émuler en HTTP pur |

| Grande échelle (5k+ par jour) | API de scraper managée, unlocker ou plateforme no-code | Le code GitHub DIY devient à lui seul un problème d’infrastructure |

Quand votre projet Amazon Scraper GitHub casse : prévoyez un plan de secours no-code

Tout scraper expérimenté garde un plan B.

Les mises à jour d’Amazon finiront par casser n’importe quel dépôt GitHub, et souvent au pire moment possible. Pour les équipes e-commerce, un scraper cassé signifie des changements de prix manqués, des données concurrentielles obsolètes et des trous dans les tableaux de bord.

Beaucoup de personnes cherchant « amazon scraper github » sont en réalité des utilisateurs métier — opérations e-commerce, marketeurs, chercheurs FBA — qui ont essayé des solutions codées faute d’options plus simples. Les données des forums montrent aussi une vraie frustration vis-à-vis de l’ officielle d’Amazon : accès restrictif, données limitées et que de nombreux vendeurs ne peuvent pas satisfaire.

Pourquoi les scrapers Amazon GitHub nécessitent une maintenance constante

L’audit ci-dessus le montre clairement :

- Les dépôts obsolètes accumulent les signalements de casse sans correctifs

- Les dépôts « fonctionnels » parlent désormais ouvertement des mesures anti-bot dans leur README

- Les discussions communautaires tournent de plus en plus autour des empreintes TLS, des boucles CAPTCHA et de la qualité des proxys — pas des sélecteurs CSS

Pour les utilisateurs métier, cette charge de maintenance est le vrai coût caché. Le dépôt est gratuit. Votre temps passé à le déboguer à 2 h du matin ne l’est pas.

Thunderbit comme alternative pratique à Amazon Scraper

propose un qui extrait le titre, le prix, l’ASIN, les notes, la marque, la disponibilité, l’origine d’expédition et l’URL d’origine — sans écrire de code.

Concrètement, cela donne :

- Scraping en 2 clics au lieu de configurer des environnements Python, des dépendances et des proxys

- Modèle Amazon instantané — pas de surcharge IA, juste une extraction en 1 clic

- Mode de scraping navigateur pour les pages nécessitant une connexion (comme les pages d’avis qui frustrent les utilisateurs de scrapers GitHub)

- Scraping cloud pour les pages produit publiques, à grande vitesse (50 pages à la fois)

- Export gratuit vers Google Sheets, Airtable, Notion, Excel — pas seulement CSV/JSON

- Scraper programmé pour un suivi continu des prix

- L’IA s’adapte aux changements de mise en page — sans charge de maintenance pour vous

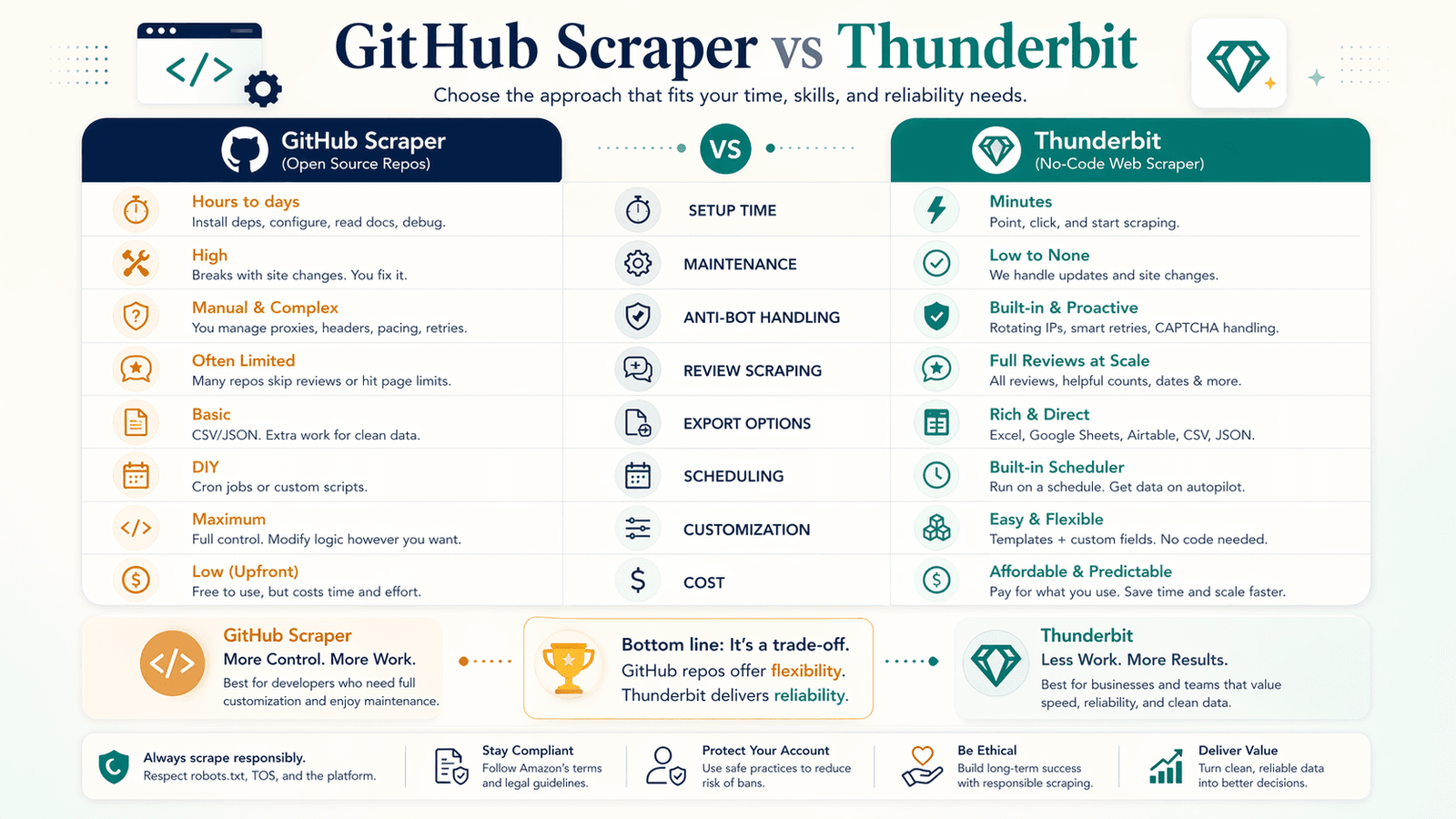

Amazon Scraper GitHub vs Thunderbit : comparaison honnête

| Facteur | Scraper GitHub (ex. AmzPy) | Thunderbit |

|---|---|---|

| Temps de configuration | 15–60 min (Python, dépendances, proxys) | ~2 min (installation de l’extension Chrome) |

| Maintenance | Vous corrigez les cassures | L’IA s’adapte aux changements de mise en page |

| Gestion anti-bot | DIY (proxys, en-têtes, TLS) | Intégrée (modes cloud + navigateur) |

| Scraping d’avis (connexion requise) | Gestion de session complexe | Mode de scraping navigateur |

| Export des données | CSV/JSON uniquement | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Planification | DIY (cron, Airflow, etc.) | Scraper programmé intégré |

| Personnalisation | Plus élevée | Plus faible |

| Coût | Gratuit (plus les coûts de proxy) | Formule gratuite disponible ; système à crédits |

Le compromis est simple : les dépôts GitHub offrent plus de personnalisation ; Thunderbit offre plus de fiabilité. Si votre équipe privilégie la disponibilité à la flexibilité, l’approche no-code est souvent la plus rationnelle.

Bonnes pratiques pour un scraping Amazon programmé et récurrent

La plupart des projets amazon scraper github sont pensés pour des exécutions ponctuelles, mais les vrais cas d’usage métier — surveillance des prix, suivi des stocks, analyse concurrentielle — exigent des extractions récurrentes. Les dépôts GitHub incluent presque jamais de planification native, ce qui oblige les utilisateurs à assembler eux-mêmes des cron jobs, des workflows Airflow ou n8n.

Planification DIY pour les scrapers Amazon GitHub

La configuration récurrente minimale viable :

- Cron job sur Linux ou macOS pour exécuter le script selon un planning

- Journaux en append-only pour pouvoir déboguer les échecs a posteriori

- Déduplication par ASIN + horodatage pour éviter de stocker les mêmes données plusieurs fois

- Alertes d’échec (même un simple email en cas de code de sortie non nul) pour savoir quand une exécution casse à 3 h du matin

Pour les équipes plus avancées :

- n8n pour l’automatisation légère de workflows (souvent mentionné dans les discussions communautaires)

- Airflow pour des pipelines planifiés plus lourds

- État stocké en base de données si vous avez besoin de diffs et d’historique

La bonne pratique clé n’est pas le planificateur lui-même — c’est la gestion d’état. Suivez la dernière exécution réussie, le dernier ensemble d’ASIN, les prix modifiés et les URL en échec.

Planification simplifiée avec Thunderbit

Le de Thunderbit vous permet de décrire l’intervalle en langage naturel, de saisir les URL et de cliquer sur « Planifier ». L’IA convertit le langage courant en planification cron — aucune configuration technique. Pour les équipes e-commerce non techniques qui surveillent les prix ou les lancements produits concurrents, c’est une réduction très concrète de la friction opérationnelle.

Bonnes pratiques pour les extractions Amazon récurrentes

Ces conseils s’appliquent quel que soit l’outil utilisé :

- Dédupliquez par ASIN + fenêtre temporelle — ne stockez pas deux fois le même produit lors d’une même exécution

- Stockez les prix en nombres, pas en chaînes brutes — cela évite du nettoyage en aval

- Ajoutez un horodatage de scraping à chaque ligne — vous en aurez besoin pour l’analyse des tendances

- Suivez les deltas, pas seulement l’état courant — « le prix a baissé de 12 % depuis la semaine dernière » est plus utile que « le prix est à 24,99 $ »

- Déclenchez des alertes sur les changements significatifs — une baisse de 15 % mérite une notification ; une fluctuation de 0,5 % n’est que du bruit

- Pensez au stockage des données — les fichiers plats suffisent pour les petites séries ; pour 5k+ ASIN par jour, envisagez une base de données ou un tableur cloud

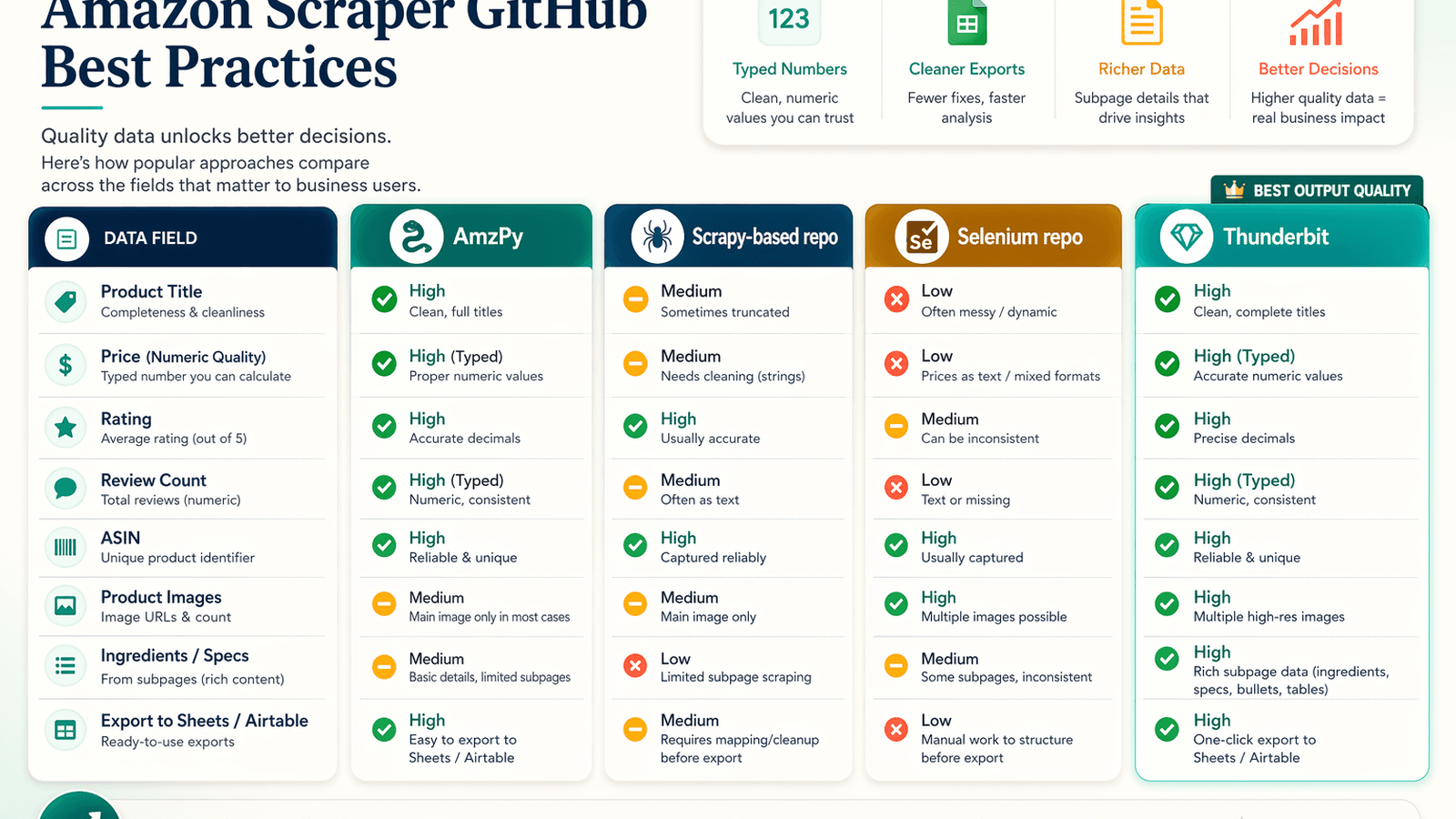

Qualité de sortie côte à côte : ce que chaque approche Amazon Scraper GitHub renvoie vraiment

Personne ne compare réellement la qualité de sortie entre les dépôts amazon scraper github. Les utilisateurs accordent une grande importance à la qualité des données — « quel outil donne les données les plus propres et les plus complètes » — mais doivent cloner et tester chaque dépôt eux-mêmes. Cette section comble ce vide.

Ce que les dépôts GitHub populaires extraient réellement — et ce qu’ils ratent

D’après les exemples du README, les exemples publics et les formats de sortie documentés :

| Approche | Ce qu’elle extrait clairement | Lacunes / compromis fréquents |

|---|---|---|

| amzpy | Titre, prix, devise, URL d’image, notes, avis, variantes, ASIN | Orienté page produit ; moins riche sur les avis complets et les sections de spécifications |

| tducret/amazon-scraper-python | CSV avec titre, note, nombre d’avis, URL produit, URL d’image, ASIN | Obsolète, centré sur les listings, faible stratégie anti-bot |

| python-scrapy-playbook scraper | Résultats de recherche, pages produit, avis, pipelines CSV/JSON | Niveau tutoriel ; dépend d’un middleware proxy externe ; nettoyage supplémentaire probable |

| omkarcloud/amazon-scraper | Recherche, catégorie, détails, principaux avis, nombreuses images/vidéos/spécifications | Ce n’est pas un scraper brut — c’est un service API managé |

| Modèle Amazon de Thunderbit | Titre, prix, ASIN, marque, note, avis, disponibilité, origine d’expédition, enrichissement des sous-pages | Moins de contrôle au niveau du code que des scripts personnalisés |

Tableau de comparaison de la qualité de sortie

| Champ de données | AmzPy | Dépôt basé sur Scrapy | Dépôt Selenium | Thunderbit |

|---|---|---|---|---|

| Titre du produit | ✅ | ✅ | ✅ | ✅ |

| Prix (numérique) | ⚠️ chaîne | ✅ | ⚠️ chaîne | ✅ (type nombre) |

| Note | ✅ | ✅ | ✅ | ✅ |

| Nombre d’avis | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Images produit | ❌ | ⚠️ miniature seulement | ✅ | ✅ (haute résolution, exportable) |

| Ingrédients / spécifications | ❌ | ❌ | ❌ | ✅ (via scraping des sous-pages + IA) |

| Export vers Sheets/Airtable | ❌ | ❌ | ❌ | ✅ gratuit |

Pourquoi le formatage des données compte pour les utilisateurs métier

Des données mal propres créent un travail caché. Même un scraper réussi peut être un échec opérationnel si :

- Les prix sont des chaînes avec des symboles monétaires au lieu de nombres propres

- Les valeurs manquantes sont incohérentes (chaîne vide vs. null vs. « N/A »)

- Les images ne sont que des miniatures basse résolution

- Les champs d’avis ou de spécifications nécessitent un post-traitement avant analyse

Pour les équipes d’opérations e-commerce, des données propres ont un impact direct sur la vitesse d’analyse et la prise de décision. L’IA de Thunderbit formate les données par type — nombres en nombres, dates en dates, URL en URL — pour qu’elles soient immédiatement exploitables. Les dépôts GitHub varient énormément sur ce point, et le temps de nettoyage s’accumule vite.

Récapitulatif rapide : checklist des bonnes pratiques Amazon Scraper GitHub

- Vérifiez la date du dernier commit avant de cloner. Plus de six mois = fort signal d’alerte sur Amazon.

- Cherchez dans les issues les mots « captcha », « 503 », « blocked » et « not working » avant de configurer quoi que ce soit.

- Privilégiez

curl_cffiou un autre client HTTP qui imite un navigateur plutôt querequestsclassique. - Gardez cohérents les en-têtes, le profil TLS, la langue et la géographie du proxy — pas de contradictions.

- Utilisez des sessions sticky pour les parcours de navigation ; ne faites pas tourner chaque requête à l’aveugle.

- Ajoutez un rythme aléatoire et un backoff exponentiel.

- Considérez les CAPTCHA répétés comme une session grillée, pas comme une énigme à forcer.

- N’utilisez les navigateurs headless que lorsque les clients HTTP ne peuvent pas reproduire la page de manière fiable.

- Stockez des checkpoints et un état pour pouvoir reprendre les exécutions en échec en toute sécurité.

- Prévoyez un plan de secours — qu’il s’agisse d’une API managée ou d’un outil no-code comme .

Considérations juridiques et éthiques pour le scraping Amazon en 2026

Quelques points utiles, brièvement.

La posture d’Amazon est restrictive et devient encore plus restrictive. Les signaux les plus forts :

- Les pages d’aide d’Amazon renvoient désormais une page indiquant : « To discuss automated access to Amazon data please contact api-services-support@amazon.com. »

- Le d’Amazon interdit un large éventail de chemins dynamiques, d’avis, de profils, de listes de souhaits et d’offres.

- La s’oppose explicitement à un accès d’agent dissimulé ou déguisé, au contournement des mesures de sécurité et au fait de faire passer un agent pour Google Chrome. Amazon a aussi à propos de l’incident.

- Amazon a contre les crawlers d’OpenAI fin 2025.

Le risque pratique augmente clairement lorsque l’on passe de pages produit publiques à des flux authentifiés, à une automatisation déguisée ou à une extraction commerciale à haut volume. Ceci n’est pas un conseil juridique — consultez votre équipe juridique pour votre situation spécifique.

Points clés à retenir : obtenir des données Amazon fiables sans se faire bannir

Par ordre d’importance :

- Auditez avant de cloner. Supposons que la plupart des résultats GitHub soient obsolètes, des tutoriels ou des wrappers autour d’API commerciales.

- Améliorez d’abord votre couche réseau. Le TLS fingerprinting et la cohérence de session comptent plus que les sélecteurs HTML.

- Utilisez des sessions résidentielles sticky, pas le chaos aléatoire des proxys. Faites tourner entre les sessions, pas à l’intérieur.

- Cadencez les requêtes comme un utilisateur, pas comme un test de charge. Délais aléatoires et backoff exponentiel sont non négociables.

- Résolvez les CAPTCHA isolés ; abandonnez les sessions trop ciblées à répétition. Ne forcez pas une empreinte grillée.

- Préparez une solution de secours. Amazon changera quelque chose en milieu de semaine, et votre scraper GitHub cassera. Un outil no-code maintenu comme ou une API managée peut maintenir votre pipeline de données en vie pendant que vous déboguez.

- Priorisez la qualité de sortie. Des données propres et typées font gagner bien plus de temps en aval qu’un scraper rapide mais sale.

Si vous privilégiez la fiabilité à la personnalisation, Thunderbit offre une alternative maintenue — consultez le ou regardez les tutoriels sur la . Les développeurs qui veulent un contrôle total peuvent absolument utiliser des dépôts GitHub — mais uniquement avec les pratiques anti-bannissement et de maintenance décrites dans ce guide.

FAQ

Est-il légal de scraper les données produit Amazon avec un scraper GitHub ?

Les Conditions d’utilisation d’Amazon restreignent la collecte automatisée de données, et Amazon a activement fait respecter ces règles par des lettres de mise en demeure et des contre-mesures techniques (surtout en 2025-2026). Le scraping de données produit accessibles publiquement se situe dans une zone grise ; le scraping derrière connexion ou le fait de déguiser votre bot en vrai navigateur comporte davantage de risques. Ceci n’est pas un conseil juridique — consultez votre équipe juridique pour votre cas d’usage spécifique.

À quelle fréquence les dépôts GitHub d’Amazon scraper cassent-ils ?

Très souvent. Amazon modifie régulièrement ses mises en page, ajoute de nouvelles couches anti-bot et déprécie des endpoints. Dans l’audit réalisé pour cet article, seuls environ 3 des 8 dépôts les plus visibles étaient clairement fonctionnels en 2026. Même les dépôts « qui fonctionnent » ont souvent des issues ouvertes concernant les CAPTCHA et les erreurs 503. Attendez-vous à devoir dépanner ou mettre à jour votre configuration toutes les quelques semaines ou quelques mois.

Quel est le meilleur Amazon scraper sur GitHub en 2026 ?

Il n’y a pas de gagnant unique — tout dépend de votre cas d’usage et de votre aisance technique. Pour un scraper Python léger et direct, est l’une des options les plus actuelles. Pour une couverture plus large via une API managée, fonctionne, mais n’est pas vraiment du DIY. Appliquez la checklist de fraîcheur de cet article pour évaluer vous-même tout dépôt avant de vous engager.

Thunderbit peut-il scraper Amazon sans coder ?

Oui. Le de Thunderbit extrait en un clic le titre du produit, le prix, l’ASIN, les notes, la marque, la disponibilité et plus encore. Il prend en charge le mode de scraping navigateur pour les pages nécessitant une connexion, le scraping cloud pour les pages publiques à grande vitesse, le scraping programmé pour les tâches récurrentes et l’export gratuit vers Google Sheets, Airtable, Notion et Excel. Vous pouvez commencer en installant l’.

Comment éviter que mon IP soit bannie lors du scraping d’Amazon ?

Adoptez une approche par couches : (1) remplacez requests classique par un client qui imite le TLS, comme curl_cffi, (2) utilisez des proxys résidentiels avec sessions sticky plutôt qu’une rotation aléatoire de proxys datacenter, (3) ajoutez un rythme aléatoire et un backoff exponentiel, (4) gardez votre ensemble d’en-têtes cohérent avec votre profil de navigateur et la locale de la marketplace, et (5) considérez les CAPTCHA répétés comme un signal pour abandonner la session, pas comme un casse-tête à résoudre indéfiniment. Pour plus de détails, voyez la matrice de décision anti-bannissement plus haut dans l’article.