Después de hacer más de mil extracciones con Simplescraper, dejé de contar los aciertos y empecé a catalogar los fallos. Ese cambio —de “¿funcionó?” a “¿por qué se rompió esta vez?”— me enseñó más que cualquier página de documentación.

Simplescraper es una extensión sólida de Chrome para extraer datos de sitios web sin escribir código. Con en Chrome Web Store y una interfaz de clics realmente accesible, se ha ganado su sitio en el kit de herramientas del scraping no-code. Pero esto es lo que nadie te cuenta en la landing page: para conseguir resultados consistentes y fiables a escala, hace falta entender dónde se vuelven frágiles los raspadores visuales. Una que los trabajadores pasan más de nueve horas a la semana introduciendo datos repetitivos, justo el tipo de dolor que empuja a la gente a herramientas como Simplescraper. Pero si no conoces las peculiaridades de la herramienta, esas nueve horas se te irán depurando errores en vez de hacer algo útil. Este artículo recoge cinco buenas prácticas que saqué de experiencia operativa real: solucionar fallos de selección, elegir el modo de scraping adecuado, exprimir el plan gratuito, evitar bloqueos y saber cuándo pasar a otra herramienta.

¿Qué es Simplescraper y por qué importan las buenas prácticas?

Simplescraper es una extensión de Chrome que te permite seleccionar visualmente elementos en una página web —títulos de productos, precios, imágenes, datos de contacto— y extraerlos en datos estructurados sin escribir una sola línea de código. Señalas, haces clic y genera una “receta” que puedes reutilizar en páginas parecidas.

El modelo básico funciona así:

- Selección visual de elementos: haz clic en lo que quieras. Simplescraper detecta automáticamente patrones repetidos (listas de productos, resultados de búsqueda, ofertas de empleo).

- Recetas: guarda tu configuración de extracción para reutilizarla después o ejecutarla sobre lotes de URLs.

- Dos modos de scraping: navegador (local, se ejecuta en tu Chrome) y nube (se ejecuta en los servidores de Simplescraper, sin supervisión).

- Integraciones: exporta a Google Sheets, Airtable, webhooks, Zapier, Make, CSV y JSON.

- Extracción con IA: una función más reciente llamada que genera selectores CSS a partir de un prompt de esquema.

El público objetivo es amplio: especialistas en marketing, equipos de ventas, operadores de e-commerce, investigadores… cualquiera que necesite extraer datos estructurados de sitios web sin contratar a un desarrollador. Y, para páginas sencillas, Simplescraper responde rápido.

Entonces, ¿por qué importan las buenas prácticas? Porque en cuanto sales de una ficha de producto simple o de un directorio limpio, aparece la fricción. Contenido dinámico, medidas antibot, imágenes cargadas bajo demanda, estructuras HTML anidadas: esas son las condiciones reales que separan una experiencia frustrante de una productiva. Saber de antemano cuál es el enfoque correcto te ahorra horas de prueba y error.

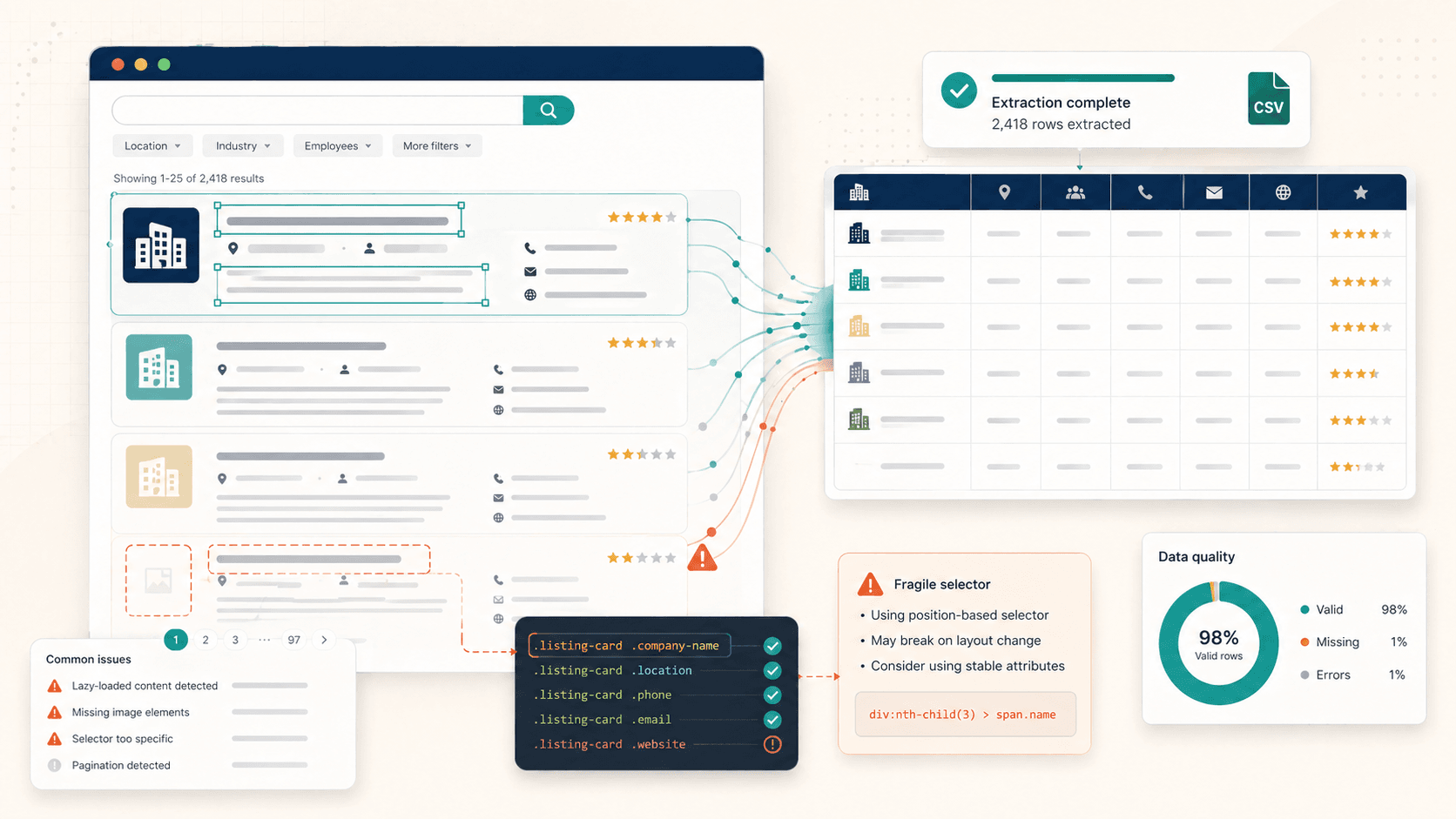

Buena práctica 1: Qué hacer cuando Simplescraper no logra seleccionar elementos

Esta es, con diferencia, la frustración más común que he visto. Haces clic en un elemento, Simplescraper lo resalta, te quedas tranquilo… y luego la salida pierde la mitad de los datos. Las fotos salen en blanco. Las biografías están vacías. Las ubicaciones desaparecen.

El propio fundador que “the element/css selector still ain't 100%”. Esa sinceridad se agradece, pero no arregla una extracción rota a las once de la noche de un miércoles.

Fallos de selección comunes y por qué ocurren

Cuatro patrones hacen tropezar a Simplescraper con más frecuencia:

- Imágenes cargadas bajo demanda: el elemento de imagen literalmente hasta que haces scroll hasta él. Si extraes antes de desplazarte, obtendrás campos de imagen vacíos.

- Contenedores anidados o agrupados: la detección automática de Simplescraper , lo que a veces significa que solo captura una sección de la página en lugar del conjunto repetido completo. Algunos usuarios dicen que las tablas “no seleccionan todas las filas de una vez”.

- Contenido dinámico de JavaScript: los elementos que se renderizan después de la carga inicial, mediante llamadas de React, Vue o AJAX, simplemente no están ahí cuando el scraper actúa demasiado pronto.

- Paginación con scroll infinito: los datos que quieres todavía no se han cargado en el HTML porque requieren desplazarte o hacer clic en “cargar más”.

Pasos prácticos para solucionar problemas

Antes de pasar a los selectores manuales, prueba esto:

- Desplázate por toda la página primero. Así obligas a que las imágenes y el contenido cargados bajo demanda entren en el DOM.

- Usa “Include Similar” cuando el número de elementos parezca sospechosamente bajo. La documentación de Simplescraper lo recomienda para contenido agrupado.

- Espera a que la página termine de renderizar en sitios muy cargados de JS. Dale unos segundos extra antes de lanzar la extracción.

- Empieza con una muestra pequeña. Comprueba el número de filas en 2 o 3 páginas antes de lanzarte a un lote de 500.

Cambiar a selectores CSS manuales

Cuando la selección visual sigue fallando, toca pasar al modo manual. Este es el movimiento que separa a los usuarios ocasionales de los que de verdad sacan partido a la herramienta.

El flujo es este:

- Haz clic derecho en el elemento que quieras en Chrome → Inspect.

- En DevTools, identifica la clase o el atributo de datos del elemento (por ejemplo,

.product-card .priceo[data-test="location"]). - En Simplescraper, cambia a la pestaña y pega tu selector.

- Prueba el selector ejecutando una extracción pequeña.

Consejos para selectores robustos:

- Prioriza nombres de clase (

.listing-title) frente a selectores posicionales (div:nth-child(3)) - Usa cuando estén disponibles: suelen ser más estables ante cambios en el sitio

- Evita rutas demasiado profundas que se rompen cuando cambia la estructura HTML del sitio

La alternativa con IA: deja que Thunderbit detecte los campos automáticamente

Voy a ser claro: mi equipo construyó precisamente porque nos cansamos de este problema tan concreto. La función “AI Suggest Fields” de Thunderbit lee la estructura de la página y recomienda columnas y lógica de extracción automáticamente. No hace falta saber CSS. La IA se adapta al diseño de cada sitio, incluidos los contenidos anidados y las imágenes cargadas bajo demanda.

Si estás perdiendo más de unos minutos por extracción depurando selectores, merece la pena probar otro enfoque por completo.

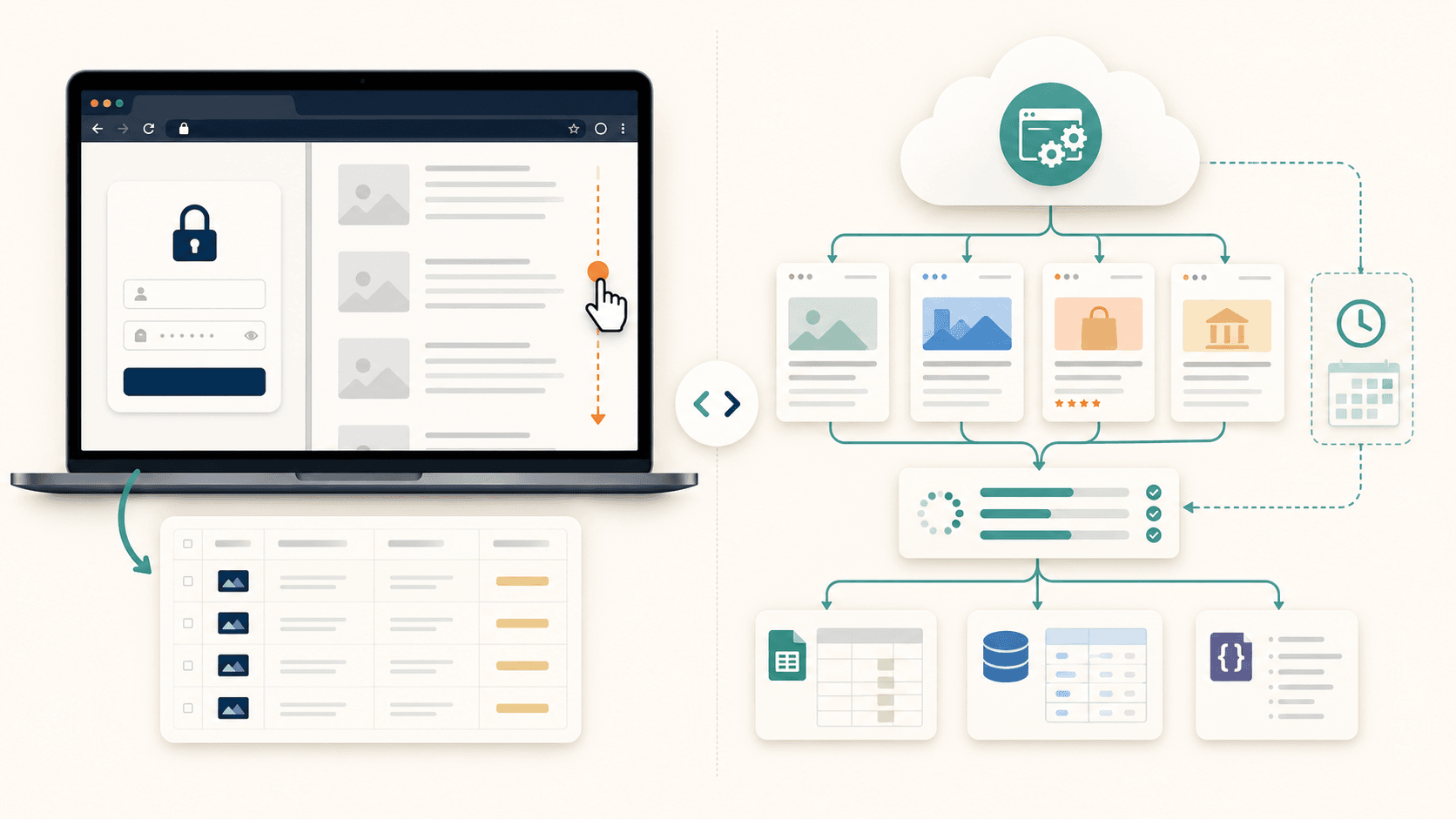

Buena práctica 2: Elegir entre scraping en la nube y scraping en el navegador

La mayoría de los usuarios de Simplescraper eligen un modo por defecto —normalmente el primero que probaron— sin pensar en cuál encaja con su caso real. Eso provoca fallos evitables.

Cuándo usar scraping en el navegador (local)

- Páginas con inicio de sesión: LinkedIn, paneles de CRM, herramientas internas… cualquier cosa detrás de autenticación necesita tu sesión activa del navegador.

- Extracciones puntuales rápidas: ya estás en la página y solo quieres los datos ahora.

- Conservar créditos gratuitos: el scraping en el navegador no consume créditos de nube.

La desventaja: tu ordenador tiene que seguir encendido, y los trabajos grandes van mucho más lentos que en la nube.

Cuándo usar scraping en la nube

- Páginas públicas (listados de e-commerce, directorios, sitios inmobiliarios) que no requieren inicio de sesión.

- Monitorización programada: se ejecuta sin supervisión de forma recurrente.

- Trabajos por lotes: en un solo lote en la nube.

- Entrega a integraciones: envíos automáticos a Google Sheets, Airtable o webhooks.

La desventaja: el scraping en la nube —2 por cada página con JavaScript, 1 por página sin JS— y agota rápido el cupo gratuito de 100 créditos.

Marco de decisión

| Situación | Modo recomendado | Por qué | Riesgo si te equivocas |

|---|---|---|---|

| Páginas que requieren inicio de sesión (LinkedIn, paneles) | Navegador | Necesita tu sesión autenticada | El modo nube se topa con muros de acceso |

| Listados públicos de productos de e-commerce | Nube | Más rápido, se ejecuta sin supervisión | El modo navegador bloquea tu máquina |

| Monitorización recurrente programada | Nube | Se ejecuta sin que estés presente | El navegador requiere tu presencia |

| Sitios con fuerte protección antibot (Amazon, Yelp) | Navegador (respaldo) o nube con proxy | Se necesita rotación de IP o reutilización de sesión | La nube sin proxy se bloquea rápido |

| Extracción rápida de una sola vez | Navegador | Inmediato, sin coste de créditos | Montar la nube para una sola página es demasiado |

Cómo Thunderbit simplifica esto

En , la elección es un simple interruptor dentro de la misma interfaz. El modo nube procesa hasta 50 páginas en paralelo, sin una suscripción aparte para acceder a la nube. El modo navegador gestiona sitios con inicio de sesión sin configuración adicional. La carga mental de “¿qué modo necesito?” baja mucho cuando ambos viven en el mismo flujo de trabajo.

Buena práctica 3: Sacar el máximo partido al plan gratuito de Simplescraper

La confusión con los precios es real. He visto publicaciones en foros donde la gente asume que “extensión gratuita de Chrome” significa “todo gratis”. No es así. Y, por otro lado, he visto gente asumir que Simplescraper es caro porque los planes de pago no se muestran de forma muy visible. Ninguna de las dos ideas ayuda.

Qué incluye realmente el plan gratuito de Simplescraper

Según los :

- Scraping en el navegador: ilimitado (se ejecuta localmente en tu Chrome)

- Créditos de nube: 100 al mes

- Recetas guardadas: 3

- Formatos de exportación: CSV y JSON

- Lo que NO incluye: soporte prioritario, opciones avanzadas de proxy, más créditos de nube

Un escenario realista con el plan gratuito

Supongamos que necesitas extraer 50 páginas de producto de un sitio público de e-commerce.

- Modo navegador (gratis): puedes hacerlo completamente gratis. Abre cada página (o usa una lista), ejecuta la receta y exporta a CSV. Tiempo necesario: depende de tu paciencia y de tu velocidad de internet, pero calcula entre 15 y 30 minutos de trabajo activo para 50 páginas con navegación manual.

- Modo nube (plan gratuito): con el renderizado de JavaScript activado, cada página cuesta 2 créditos. 50 páginas = 100 créditos. Eso consume todo tu cupo mensual de nube en un solo trabajo. Sin programación, sin reintentos si algo falla.

El plan gratuito es realmente útil para extracciones pequeñas y ocasionales. Pero se agota rápido en cuanto necesitas automatización en la nube o escala.

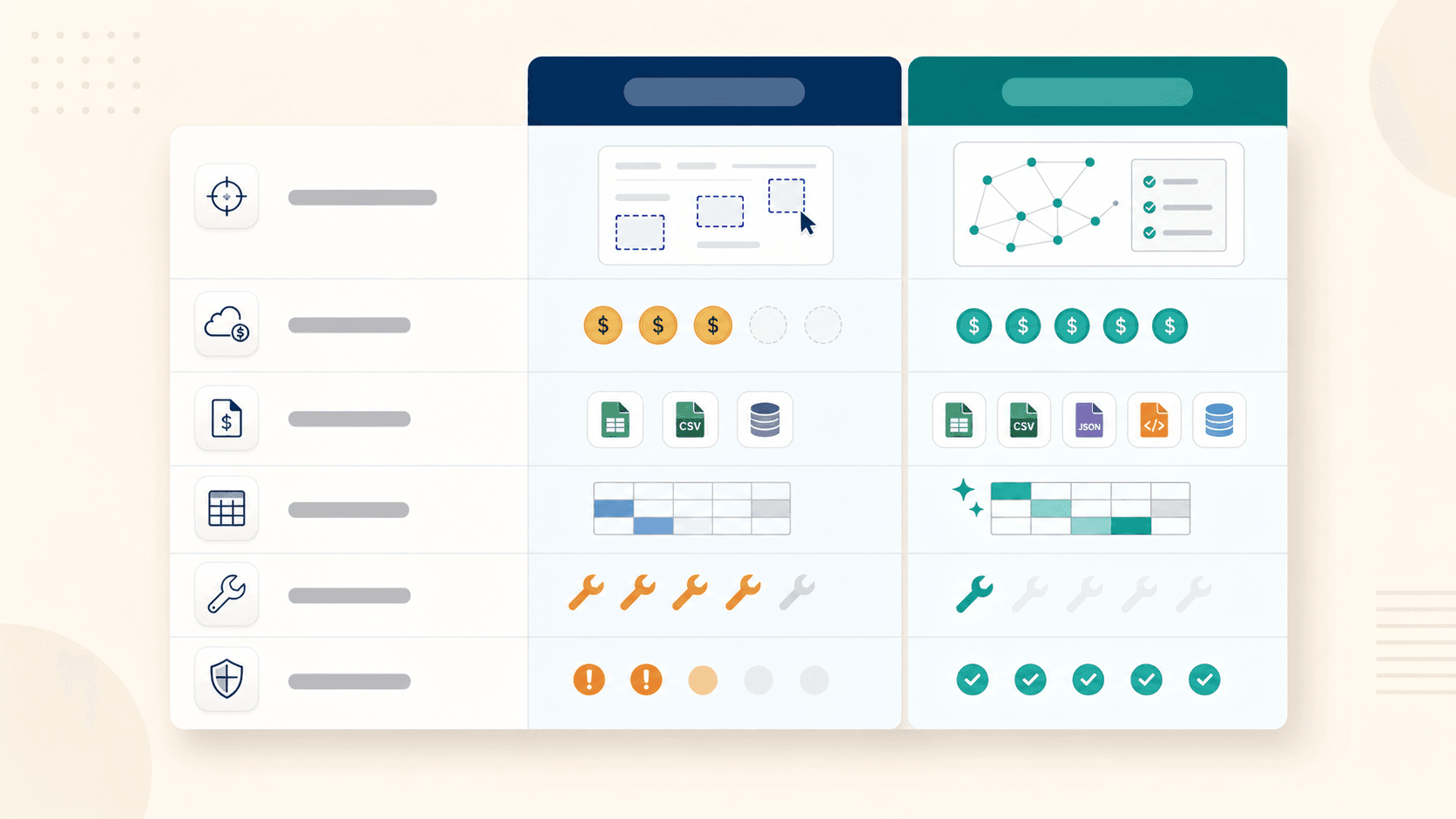

Comparativa del plan gratuito: Simplescraper vs. Thunderbit

| Función | Simplescraper gratis | Thunderbit gratis |

|---|---|---|

| Páginas/créditos | Navegador ilimitado + 100 créditos de nube | 6 páginas con todas las funciones de IA |

| Extracción con IA | Limitada (Smart Extract usa créditos) | Incluye AI Suggest Fields completo |

| Destinos de exportación | CSV, JSON | Excel, Google Sheets, Airtable, Notion: todo gratis |

| Configuraciones guardadas | 3 recetas | Plantillas disponibles |

| Scraping de subpáginas | Configuración manual de recetas | Incluido en el conteo de páginas |

Los modelos son realmente distintos. Simplescraper te da scraping local ilimitado con nube limitada. te da menos páginas, pero mete toda su capacidad de IA en cada una, además de exportaciones gratis a las herramientas que de verdad usa la mayoría de los equipos. El plan gratuito de Simplescraper funciona si necesitas scraping local básico y toleras trabajo manual. Pero si quieres extracción con IA y exportaciones flexibles, el plan gratuito de Thunderbit ofrece más por página.

Buena práctica 4: Cómo evitar bloqueos mientras haces scraping

Nadie piensa en las medidas antibot hasta que se encuentra mirando un muro de CAPTCHA o un conjunto de datos vacío. Para entonces ya has perdido tiempo y, posiblemente, créditos.

La defensa preventiva siempre sale más barata que depurar a posteriori.

Limita la velocidad y marca el ritmo de las peticiones

La principal razón para que te bloqueen: bombardear un sitio con peticiones demasiado rápidas. Para un servidor web, 50 peticiones en 10 segundos desde una sola IP parecen un ataque, no una investigación curiosa.

Reglas generales:

- Añade entre 2 y 5 segundos entre peticiones de página en la mayoría de sitios comerciales.

- Para objetivos delicados (marketplaces, sitios de reseñas), ve más despacio: 5 a 10 segundos.

- Si usas la API de Simplescraper, el parámetro puede ayudar a que las páginas carguen por completo antes de la extracción, lo que también ralentiza el ritmo de forma natural.

Cuándo activar la rotación de proxies

La rotación de proxies cambia tu dirección IP entre peticiones, haciendo que parezcas varios usuarios distintos. La necesitarás para:

- Amazon, Yelp, TripAdvisor, LinkedIn (sistemas antibot agresivos)

- Cualquier sitio que limite la velocidad por IP

- Trabajos grandes por lotes (cientos de páginas de un mismo dominio)

La plataforma de Simplescraper , incluidos los estándar, premium y residenciales. Sin embargo, la disponibilidad exacta según el plan no siempre queda del todo clara en la documentación pública: compruébalo antes de asumir que el plan gratuito cubre objetivos difíciles. Los proxies residenciales suelen costar más, pero es menos probable que los detecten.

Cómo tratar sitios muy pesados en JavaScript

Los sitios modernos construidos con React, Vue o Angular renderizan contenido después de la carga inicial. Si tu scraper actúa antes de que JavaScript termine de ejecutarse, los campos salen vacíos.

Estrategias:

- Usa el modo de scraping en la nube para un mejor renderizado (la nube de Simplescraper puede ejecutar JavaScript).

- Desplázate manualmente por la página antes de ejecutar un scraping en el navegador para activar el contenido cargado bajo demanda.

- Usa

waitForSelectoren flujos basados en API para pausar hasta que aparezcan los elementos objetivo. - Acepta que algunas apps de una sola página muy dinámicas simplemente están fuera del alcance de un scraper visual fiable.

La alternativa sin intervención

gestiona automáticamente la protección antibot, los CAPTCHA y el renderizado de JavaScript, sin configurar proxies, sin ajustar retrasos y sin desplazarte manualmente. Para quienes no quieren convertirse en ingenieros DevOps aficionados solo para extraer un catálogo de productos, eso importa. Los problemas no desaparecen; simplemente pasan a ser problema de otra persona.

Buena práctica 5: Saber cuándo Simplescraper ha llegado a su límite

Ojalá alguien me hubiera escrito esta sección hace dos años.

Hay un punto en el que la herramienta deja de ahorrarte tiempo y empieza a devorarlo. Reconocer ese umbral pronto te evita caer en la trampa del coste hundido de “ya he construido 15 recetas, ahora no puedo cambiar”.

Límites prácticos de Simplescraper

- Aplicaciones de una sola página muy dinámicas que cargan contenido vía AJAX sin navegación tradicional entre páginas

- Scroll infinito que requiere desplazamiento continuo para cargar todos los elementos (no una paginación estándar por clic)

- Enriquecimiento de subpáginas: extraer una página de listados y luego visitar cada página de detalle para obtener más datos. Simplescraper puede hacerlo con , pero la complejidad de configuración crece rápido.

- Cambios de diseño que rompen las recetas existentes. Cuando un sitio actualiza su estructura HTML, tus selectores CSS afinados dejan de funcionar.

Señales de que ya te has quedado pequeño para la herramienta

Probablemente has llegado al límite cuando:

- Ajustas manualmente selectores CSS en cada extracción porque la detección automática sigue fallando

- Las recetas se rompen después de las actualizaciones del sitio y hay que reconstruirlas

- Necesitas extraer decenas o cientos de páginas a la vez, pero sigues chocando con límites de créditos o de velocidad

- Los datos de subpáginas requieren cadenas complejas de varios pasos

- Pasas más tiempo manteniendo las extracciones que usando los datos extraídos

Esa última es la señal más clara. Cuando el mantenimiento se convierte en el trabajo, desaparece el dividendo de comodidad del no-code.

Pasar a un flujo de trabajo impulsado por IA

Aquí hablaré de lo que construyó mi equipo con , porque se diseñó específicamente para los modos de fallo descritos arriba:

- La IA lee cada página desde cero en cada ejecución: no hay recetas frágiles ni selectores CSS que mantener. Si un sitio cambia su diseño, la IA se adapta en la siguiente ejecución.

- El scraping de subpáginas enriquece tu tabla de datos con un clic. Extrae un listado y luego visita automáticamente cada página de detalle para añadir campos.

- Scraping programado usando lenguaje natural (“cada lunes a las 9:00”) en lugar de configurar preajustes de horario.

- Scraping en la nube con 50 páginas en paralelo para ir rápido en sitios públicos.

- Exportaciones nativas gratuitas a Google Sheets, Airtable, Notion y Excel sin configurar webhooks.

Simplescraper vs. Thunderbit: comparación lado a lado

Aquí tienes todo en un solo lugar:

| Capacidad | Simplescraper | Thunderbit |

|---|---|---|

| Configuración de campos | Selectores CSS manuales / selección visual | AI Suggest Fields (inglés simple) |

| Enriquecimiento de subpáginas | Posible mediante flujos por lotes (configuración compleja) | Autoenriquecimiento con 1 clic |

| Adaptación automática a cambios de diseño | Se rompe (requiere arreglo manual) | La IA vuelve a leer la estructura de la página cada vez |

| Concurrencia de páginas en la nube | Lotes de hasta 5.000 URLs (varía según el plan) | 50 páginas simultáneamente |

| Exportación a Notion/Airtable | Mediante webhook (planes de pago) | Nativa y gratis |

| Programación | Controles de horario predefinidos y personalizados | Descripción en lenguaje natural |

| Manejo antibot / CAPTCHA | Modos de proxy disponibles (según el plan) | Automático, sin configuración |

| Plan gratuito | 100 créditos de nube + navegador ilimitado + 3 recetas | 6 páginas con todas las funciones de IA + exportaciones gratis |

En resumen: Simplescraper destaca para extracciones simples, visuales y con poca configuración, donde un ajuste manual ocasional no molesta. Thunderbit toma el relevo cuando ese modelo se queda corto: interpreta la página, se adapta al diseño y maneja la complejidad del flujo para que tú no tengas que hacerlo.

Ninguna herramienta es universalmente mejor. Están en distintos puntos de la curva de complejidad, y eso está bien.

Lista rápida de buenas prácticas de Simplescraper

Guarda esto para tu próxima sesión de scraping:

- Prueba siempre primero con una muestra pequeña. Comprueba el número de filas y la completitud de los campos en 2 o 3 páginas antes de escalar.

- Desplázate por la página antes de extraer para activar el contenido cargado bajo demanda.

- Usa “Include Similar” cuando la detección de listas parezca demasiado limitada.

- Elige el modo de scraping de forma intencional. Navegador para sitios con inicio de sesión; nube para páginas públicas y trabajos programados.

- Configura retrasos entre peticiones: mínimo 2 a 5 segundos para sitios comerciales, más para objetivos con fuerte protección antibot.

- Haz bien las cuentas del plan gratuito. 100 créditos de nube = 50 páginas con JavaScript. Planifica en consecuencia.

- Guarda recetas solo para páginas estables. Si un sitio se actualiza con frecuencia, las recetas se romperán.

- Aprende lo básico de selectores CSS como respaldo. Los nombres de clase y los atributos de datos ganan a los selectores posicionales.

- Vigila los bloqueos de forma proactiva. Si obtienes resultados vacíos o CAPTCHAs, reduce la velocidad o cambia de modo.

- Reconoce el límite. Cuando el tiempo de mantenimiento supera el tiempo de uso de los datos, evalúa alternativas.

Conclusión: haz que cada extracción cuente

La gran lección de más de mil extracciones no va de una herramienta concreta. Va de que el enfoque importa más que el software. Entender por qué falla una extracción —carga diferida, modo incorrecto, antibot agresivo, selectores frágiles— vale más que cualquier lista de funciones.

Simplescraper funciona de verdad bien para trabajos de extracción sencillos. Si tus páginas son limpias, tus necesidades son modestas y no te importa algún ajuste manual ocasional, cumple.

Pero si te descubres peleándote con la herramienta más de lo que la usas —depurando selectores, reconstruyendo recetas rotas, configurando proxies, desplazándote manualmente por páginas— eso es una señal, no un fracaso personal. Significa que ya has superado lo que el scraping visual por sí solo puede manejar.

Si te suena familiar, prueba el : seis páginas con funciones completas de IA y exportaciones gratis a Sheets, Airtable y Notion. Compáralo con tu flujo actual y mira cuál encaja mejor. A veces, la mejor práctica es saber cuándo recurrir directamente a otra herramienta.

Preguntas frecuentes

¿Simplescraper es gratis?

Sí, Simplescraper tiene un plan gratuito que incluye scraping ilimitado local en el navegador, , 3 recetas guardadas y exportación a CSV/JSON. Las páginas en la nube con JavaScript cuestan 2 créditos cada una, así que esos 100 créditos cubren unas 50 páginas en modo nube. Los planes de pago empiezan en 39 $/mes (Plus) por 6.000 créditos y 70 $/mes (Pro) por 15.000 créditos.

¿Puede Simplescraper manejar sitios web con mucho JavaScript?

A veces. El modo nube de Simplescraper puede renderizar JavaScript, y la herramienta anuncia compatibilidad con aplicaciones de una sola página. Sin embargo, las SPAs complejas con mucho renderizado dinámico, scroll infinito o sistemas antibot agresivos pueden seguir dando resultados incompletos. Usar el modo nube con tiempos de espera adecuados mejora la fiabilidad, pero los sitios muy dinámicos siguen siendo un reto para cualquier scraper visual.

¿Cuál es la diferencia entre el scraping en la nube y el scraping en el navegador en Simplescraper?

El scraping en el navegador se ejecuta localmente en tu Chrome: usa tu sesión activa, es ideal para sitios con inicio de sesión, no cuesta créditos, pero requiere que tu ordenador siga encendido. El se ejecuta en los servidores de Simplescraper: es más rápido, funciona sin supervisión, admite programación e integraciones, pero consume créditos por página y no puede acceder a páginas detrás de tu inicio de sesión personal.

¿Cuándo debería pasar de Simplescraper a una alternativa como Thunderbit?

La señal más clara es cuando el tiempo de mantenimiento supera el tiempo de uso de los datos. Si corriges con frecuencia selectores rotos tras actualizaciones del sitio, configuras proxies manualmente, reconstruyes recetas o pasas más tiempo solucionando problemas que analizando los datos extraídos, ya has superado lo que el scraping visual manual puede ofrecer de forma eficiente. Herramientas como , que usan IA para interpretar la estructura de la página en cada ejecución, eliminan gran parte de esa carga de mantenimiento.

¿Cómo evito que me bloqueen al hacer scraping con Simplescraper?

Tres prácticas clave: primero, marca el ritmo de las peticiones con retrasos de 2 a 5 segundos entre páginas (más en sitios con fuerte protección antibot como Amazon o Yelp). Segundo, usa el modo navegador como alternativa en sitios que bloquean de forma agresiva las IP de la nube: tu sesión de navegador parece tráfico normal. Tercero, activa la rotación de proxies para trabajos grandes en objetivos sensibles, aunque conviene verificar qué opciones de proxy incluye tu plan antes de depender de ellas.

Más información