Έπρεπε να τσεκάρω πάνω από 200 ειδησεογραφικές πηγές για άρθρα που «παίζουν» και γίνονται τάση. Χειροκίνητα; Αυτό είναι κανονικά 풀타임 δουλειά. Με έναν κλασικό scraper άρθρων; «Έσπαγε» κάθε φορά που ένα site άλλαζε layout.

Μετά είπα να δοκιμάσω AI scrapers για άρθρα. Ένα κλικ, καθαρά δεδομένα, χωρίς CSS selectors. Η διαφορά ήταν πραγματικά game changer.

Αν είσαι δημοσιογράφος, SEO specialist ή ερευνητής και χρειάζεσαι μαζική συλλογή άρθρων, αυτή η σύγκριση θα σου γλιτώσει άπειρο χρόνο και άσκοπα τεστ. Έβαλα στο μικροσκόπιο και παραδοσιακούς no‑code scrapers και λύσεις με AI — και παρακάτω είναι ό,τι όντως αποδίδει στην πράξη.

TL;DR

| Πλεονεκτήματα | Μειονεκτήματα | Ιδανικό για | |

|---|---|---|---|

| AI Article Scraper | - Μπορεί να κάνει scrape πολλαπλά websites με υψηλή ακρίβεια - Αφαιρεί αυτόματα «θόρυβο» - Προσαρμόζεται σε αλλαγές στη δομή των σελίδων - Υποστηρίζει δυναμική φόρτωση περιεχομένου - Μικρότερο κόστος καθαρισμού δεδομένων | - Υψηλότερο υπολογιστικό κόστος - Μεγαλύτερος χρόνος επεξεργασίας - Ορισμένες σελίδες ίσως χρειαστούν χειροκίνητη παρέμβαση - Μπορεί να ενεργοποιήσει μηχανισμούς anti-scraping | - Sites με σύνθετο ή δυναμικό περιεχόμενο (π.χ. ειδησεογραφικά portals, social media) - Συλλογή δεδομένων σε μεγάλη κλίμακα |

| Traditional No-code Article Scraper | - Γρήγορη εκτέλεση - Χαμηλότερο κόστος - Μικρή χρήση πόρων (server/τοπικά) - Μεγάλος έλεγχος/παραμετροποίηση | - Συχνή συντήρηση λόγω αλλαγών στη δομή των σελίδων - Δεν κάνει scrape πολλά sites ταυτόχρονα - Δυσκολεύεται με δυναμικό περιεχόμενο - Υψηλό κόστος καθαρισμού δεδομένων | - Γρήγορο, μαζικό scraping απλών στατικών σελίδων - Περιορισμένοι πόροι ή αυστηρό budget |

Τι είναι ένας Scraper Άρθρων; Και γιατί έχει σημασία ο AI Article Scraper;

Ένας είναι ένας τύπος που βρίσκει και «τραβάει» πληροφορίες όπως τίτλους, συγγραφείς, ημερομηνίες δημοσίευσης, κείμενο, λέξεις‑κλειδιά, εικόνες και βίντεο από ειδησεογραφικά sites, και μετά τα τακτοποιεί σε δομημένες μορφές όπως JSON, CSV ή Excel.

Οι πατάνε πάνω σε για να «πιάσουν» το περιεχόμενο με βάση τη δομή της σελίδας. Όμως αυτή η λογική έχει σοβαρά κουσούρια:

- Έλλειψη καθολικότητας: Κάθε site θέλει τους δικούς του και μόλις αλλάξει η δομή, οι selectors πάνε περίπατο — άρα θες συνέχεια updates.

- Αδυναμία σε δυναμικό περιεχόμενο: Πολλά sites φορτώνουν περιεχόμενο με AJAX ή JavaScript, κάτι που οι δεν μπορούν να αποσπάσουν απευθείας.

- Περιορισμένη επεξεργασία δεδομένων: Οι συνήθως «τραβάνε» μόνο κομμάτια , χωρίς αυτόματο καθάρισμα, formatting, σημασιολογική ανάλυση ή sentiment analysis.

Η λύση εδώ είναι ο .

Η λύση εδώ είναι ο .

-

Αυτή η τεχνολογία αξιοποιεί LLM για να “καταλαβαίνει” τις σελίδες, προσφέροντας:

- Έξυπνη αναγνώριση: Εντοπισμό τίτλων, συγγραφέων, περιλήψεων και κύριου κειμένου.

- Αυτόματη αφαίρεση θορύβου: Ξεχωρίζει το βασικό περιεχόμενο από μενού, διαφημίσεις και σχετικά άρθρα, ανεβάζοντας ποιότητα και αποδοτικότητα.

- Ανθεκτικότητα σε αλλαγές: Ακόμα κι αν αλλάξει η δομή ή το styling, το AI συνεχίζει να κάνει scrape μέσω σημασιολογικής κατανόησης και οπτικών χαρακτηριστικών.

- Γενίκευση μεταξύ sites: Σε αντίθεση με τους , οι AI scrapers δουλεύουν σε διαφορετικά sites χωρίς χειροκίνητο setup.

- Συνδυασμός με NLP και Deep Learning: Για εργασίες όπως μετάφραση, περίληψη και ανάλυση συναισθήματος.

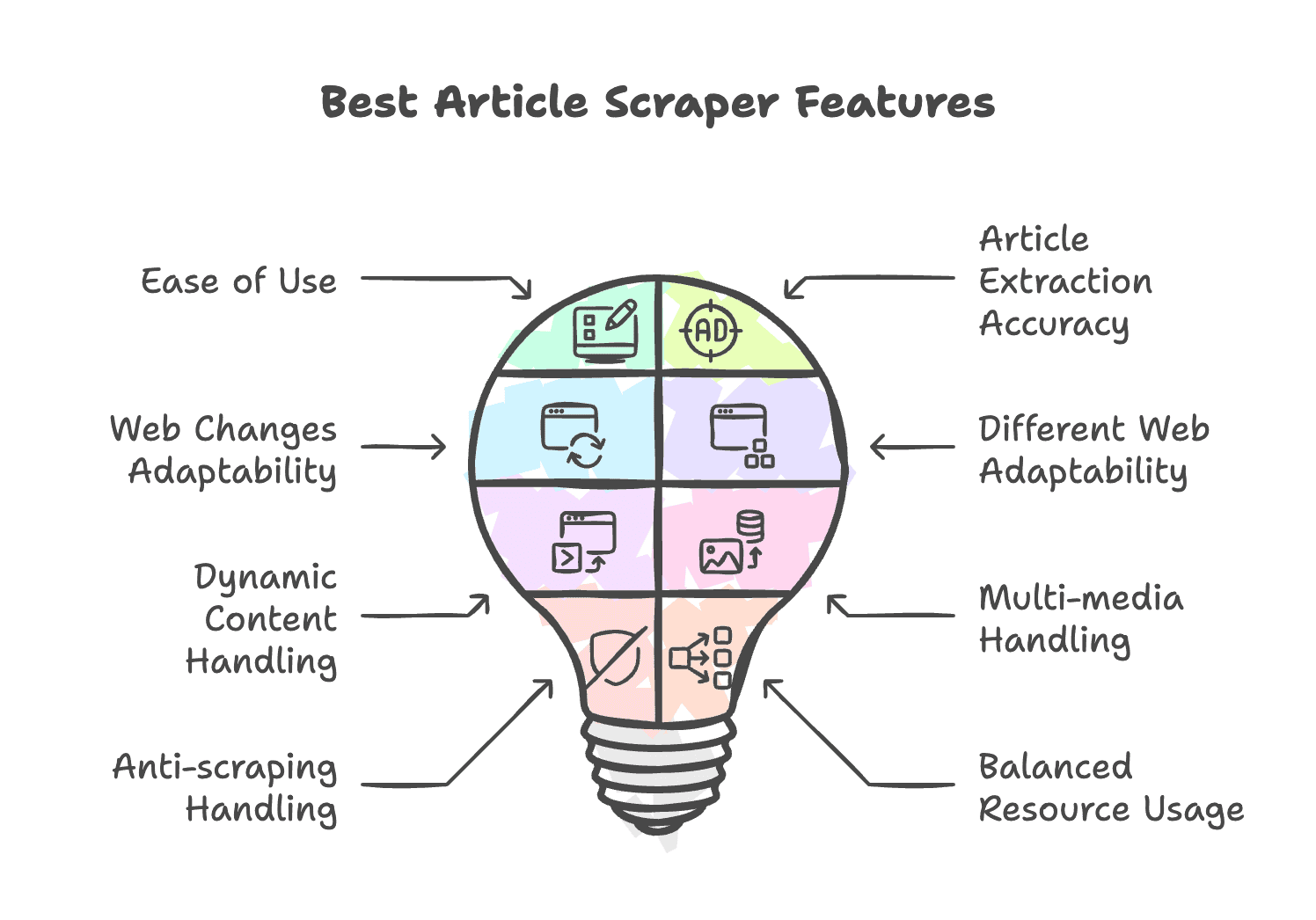

Τι κάνει έναν Article Scraper κορυφαίο το 2026;

Ένας πραγματικά δυνατός scraper ειδησεογραφικών άρθρων κρατά ισορροπία ανάμεσα σε απόδοση, κόστος, ευκολία χρήσης, ευελιξία και scalability. Αυτά είναι τα βασικά κριτήρια για το 2026:

- Ευκολία χρήσης: Φιλικό περιβάλλον, χωρίς να γράφεις κώδικα.

- Ακρίβεια εξαγωγής άρθρων: Σωστός εντοπισμός των χρήσιμων πεδίων χωρίς διαφημίσεις/πλοήγηση.

- Προσαρμογή σε αλλαγές: Αυτόματη προσαρμογή σε αλλαγές δομής ή εμφάνισης χωρίς μόνιμη συντήρηση.

- Προσαρμογή σε διαφορετικά sites: Να «πιάνει» διαφορετικές δομές χωρίς drama.

- Υποστήριξη δυναμικού περιεχομένου: JavaScript/AJAX φόρτωση.

- Υποστήριξη πολυμέσων: Αναγνώριση εικόνων, βίντεο και ήχου.

- Αντιμετώπιση anti‑scraping: IP rotation, λύσεις CAPTCHA και proxies.

- Ισορροπημένη χρήση πόρων: Να μην καίει άσκοπα μνήμη/υπολογιστική ισχύ.

Τα καλύτερα εργαλεία για άρθρα & ειδήσεις με μια ματιά

| Εργαλεία | Κύρια χαρακτηριστικά | Ιδανικό για | Τιμολόγηση |

|---|---|---|---|

| Thunderbit | Scraper με AI; έτοιμα templates; υποστήριξη scraping για pdf, εικόνες & έγγραφα· προηγμένες δυνατότητες επεξεργασίας δεδομένων | Χρήστες χωρίς τεχνικό υπόβαθρο που θέλουν να κάνουν scrape πολλά εξειδικευμένα sites | Δωρεάν δοκιμή 7 ημερών, από $9/μήνα (ετήσιο πλάνο) |

| WebScraper.io | Extension browser· υποστήριξη δυναμικού περιεχομένου· χωρίς ενσωμάτωση proxy | Χρήστες που δεν χρειάζονται σύνθετες σελίδες ή advanced δυνατότητες | Δωρεάν δοκιμή 7 ημερών, από $40/μήνα (ετήσιο πλάνο) |

| Browse.ai | No‑code scraper και monitoring· έτοιμα robots· virtual browser· πολλοί τρόποι pagination· ισχυρές ενσωματώσεις | Επιχειρήσεις που χρειάζονται scraping σύνθετων sites σε μεγάλη κλίμακα | $19/μήνα (ετήσιο πλάνο) |

| Octoparse | No‑code scraper με βάση CSS selector· auto‑detect και δημιουργία ροής scraping· έτοιμα templates για άρθρα· virtual browser· μηχανισμοί anti‑anti scraping | Ομάδες που χρειάζονται scraping σύνθετων sites | Από $99/μήνα (ετήσιο πλάνο) |

| Bardeen | Πλήρεις δυνατότητες web automation· έτοιμα templates· no‑code scraper· άψογη ενσωμάτωση με εργαλεία εργασίας | GTM ομάδες που θέλουν scraping άρθρων μέσα σε υπάρχουσες ροές εργασίας | Δωρεάν δοκιμή 7 ημερών, από $99/μήνα (ετήσιο πλάνο) |

| PandaExtract | Πολύ εύχρηστο UI· αυτόματος εντοπισμός και labeling | Γρήγορη εξαγωγή «με ένα κλικ» χωρίς περίπλοκο setup | $49 LTD |

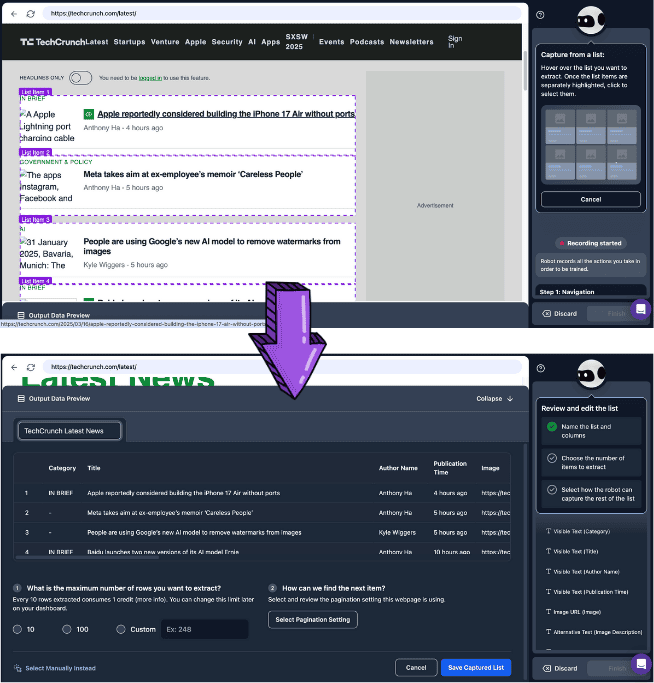

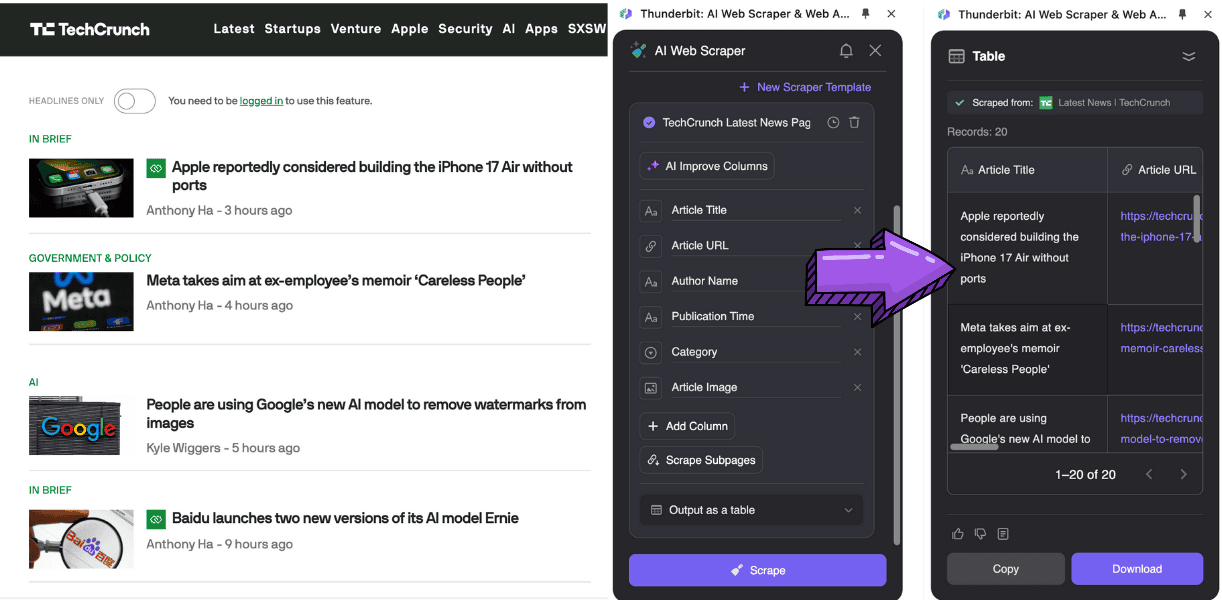

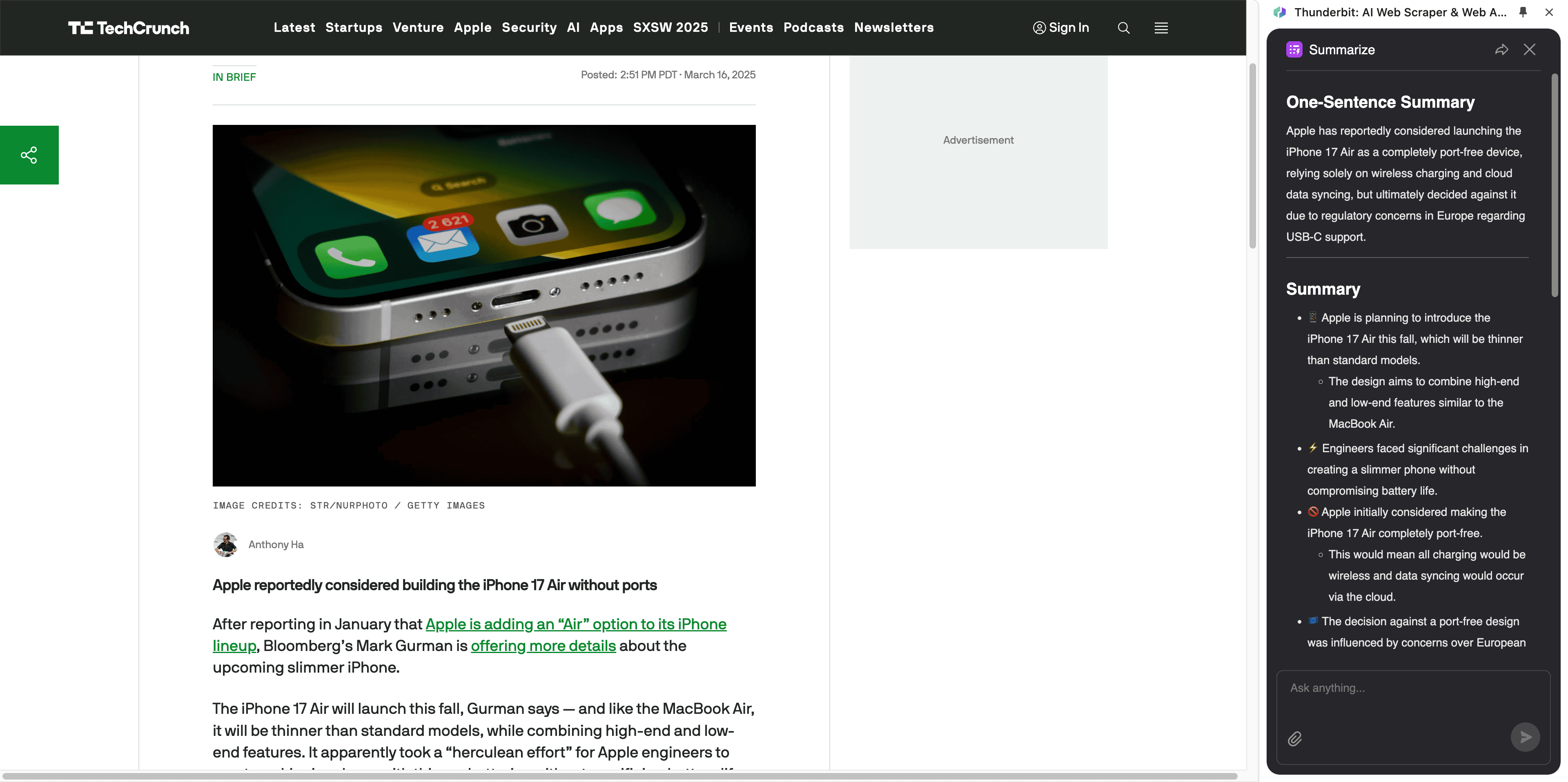

Ο πιο ισχυρός AI Article Scraper για business χρήστες

- Πλεονεκτήματα:

- Χρησιμοποιεί φυσική γλώσσα για να ενεργοποιεί AI αναγνώριση/ανάλυση περιεχομένου, χωρίς CSS selectors

- AI‑βοηθούμενη ανάλυση δεδομένων: μετατροπή format, , κατηγοριοποίηση, μετάφραση και tagging

- για scraping λίστας και πλήρους περιεχομένου με ένα κλικ

- Μειονεκτήματα:

- Προς το παρόν διατίθεται μόνο ως

- Δεν είναι η καλύτερη επιλογή για scraping τεράστιων όγκων δεδομένων

- Πιο αργό σε scraping πολλών σελίδων, αλλά μπορεί να τρέχει στο παρασκήνιο για να ολοκληρώνεται πιο άνετα

Ένας AI Article Scraper για εταιρική χρήση

Browse.ai

- Πλεονεκτήματα:

- No‑code scraper και monitoring για άρθρα

- Υποστηρίζει virtual browser ώστε να μειώνει τον κίνδυνο ενεργοποίησης anti‑scraping μηχανισμών

- Πολλά έτοιμα robots για scraping με ένα κλικ από , , κ.ά.

- Βαθιά ενσωμάτωση με πλατφόρμες όπως και για συνδέσεις εργαλείων

- Μειονεκτήματα:

- Για deep extract χρειάζεται να φτιάξεις δύο robots, κάτι που κάνει τη διαδικασία πιο μπελαλίδικη

- Οι CSS selectors δεν είναι αρκετά ακριβείς για πολύ εξειδικευμένα sites

- Ακριβό — ταιριάζει περισσότερο σε συνεχή scraping μεγάλης κλίμακας

Ένας No‑Code Scraper για μικρής κλίμακας εξαγωγή δεδομένων

PandaExtract

- Πλεονεκτήματα:

- Εντοπίζει αυτόματα λίστες άρθρων και σελίδες λεπτομερειών με πολύ φιλικό UI

- Εξάγει λίστες, λεπτομέρειες, emails και εικόνες — κατάλληλο για μικρής κλίμακας δομημένο scraping

- Εφάπαξ πληρωμή για ισόβια χρήση

- Μειονεκτήματα:

- Μόνο ως browser extension — δεν τρέχει στο cloud

- Η δωρεάν έκδοση υποστηρίζει μόνο αντιγραφή, όχι export σε CSV/JSON κ.λπ.

Ένας «έτοιμος από το κουτί» Article Scraper για οργανισμούς

Octoparse

- Πλεονεκτήματα:

- No‑code scraper με auto‑detect για αναγνώριση δομής και δημιουργία ροής scraping

- Πολλά έτοιμα templates για άρθρα, άμεσα αξιοποιήσιμα

- Virtual browser με IP rotation, λύσεις CAPTCHA και proxies για παράκαμψη anti‑scraping

- Μειονεκτήματα:

- Το auto‑detect εξακολουθεί να βασίζεται σε λογική CSS selectors, με μέτρια ακρίβεια

- Οι advanced δυνατότητες απαιτούν εκμάθηση και τεχνική εξοικείωση

- Υψηλό κόστος για scraping μεγάλης κλίμακας

Η πιο ολοκληρωμένη αυτοματοποίηση για GTM ομάδα

Bardeen

- Πλεονεκτήματα:

- No‑code scraper άρθρων που αξιοποιεί LLM για αυτοματοποίηση με ένα κλικ

- Συνδέεται με 100+ εφαρμογές, όπως , και

- Ισχυρά εργαλεία web automation για AI ανάλυση μετά το scraping

- Ιδανικό για ενσωμάτωση του scraping σε υπάρχουσες ροές εργασίας

- Μειονεκτήματα:

- Βασίζεται πολύ σε έτοιμα playbooks — τα custom workflows θέλουν δοκιμές

- Παρότι είναι no‑code, οι σύνθετες αυτοματοποιήσεις μπορεί να απαιτήσουν χρόνο εκμάθησης για μη τεχνικούς χρήστες

- Η ρύθμιση εξαγωγής από υποσελίδες είναι περίπλοκη

- Πολύ ακριβό

Ένας ελαφρύς Article Scraper για άμεση εξαγωγή δεδομένων

Webscraper.io

- Πλεονεκτήματα:

- No‑code scraper με point‑and‑click περιβάλλον

- Υποστηρίζει δυναμική φόρτωση περιεχομένου

- Λειτουργία στο cloud

- Ενσωματώσεις με , και

- Μειονεκτήματα:

- Δεν έχει έτοιμα templates — χρειάζεται να φτιάξεις custom sitemap

- Καμπύλη εκμάθησης για όσους δεν γνωρίζουν CSS selectors

- Πολύπλοκο setup για pagination και εξαγωγή από υποσελίδες

- Η cloud έκδοση είναι ακριβή

Πιο προχωρημένες λύσεις για μηχανικούς

Αν έχεις τεχνικό υπόβαθρο, υπάρχουν διαθέσιμα . Αυτές οι λύσεις προσφέρουν:

- Ευελιξία: Άμεσες κλήσεις API για custom scraping, με υποστήριξη dynamic rendering και IP rotation

- Κλιμάκωση: Ενσωμάτωση σε δικά σου data pipelines για εταιρικές ανάγκες υψηλής συχνότητας και μεγάλου όγκου

- Χαμηλότερο κόστος συντήρησης: Δεν χρειάζεται να διαχειρίζεσαι proxy pools ή anti‑scraping στρατηγικές, άρα κερδίζεις χρόνο λειτουργίας

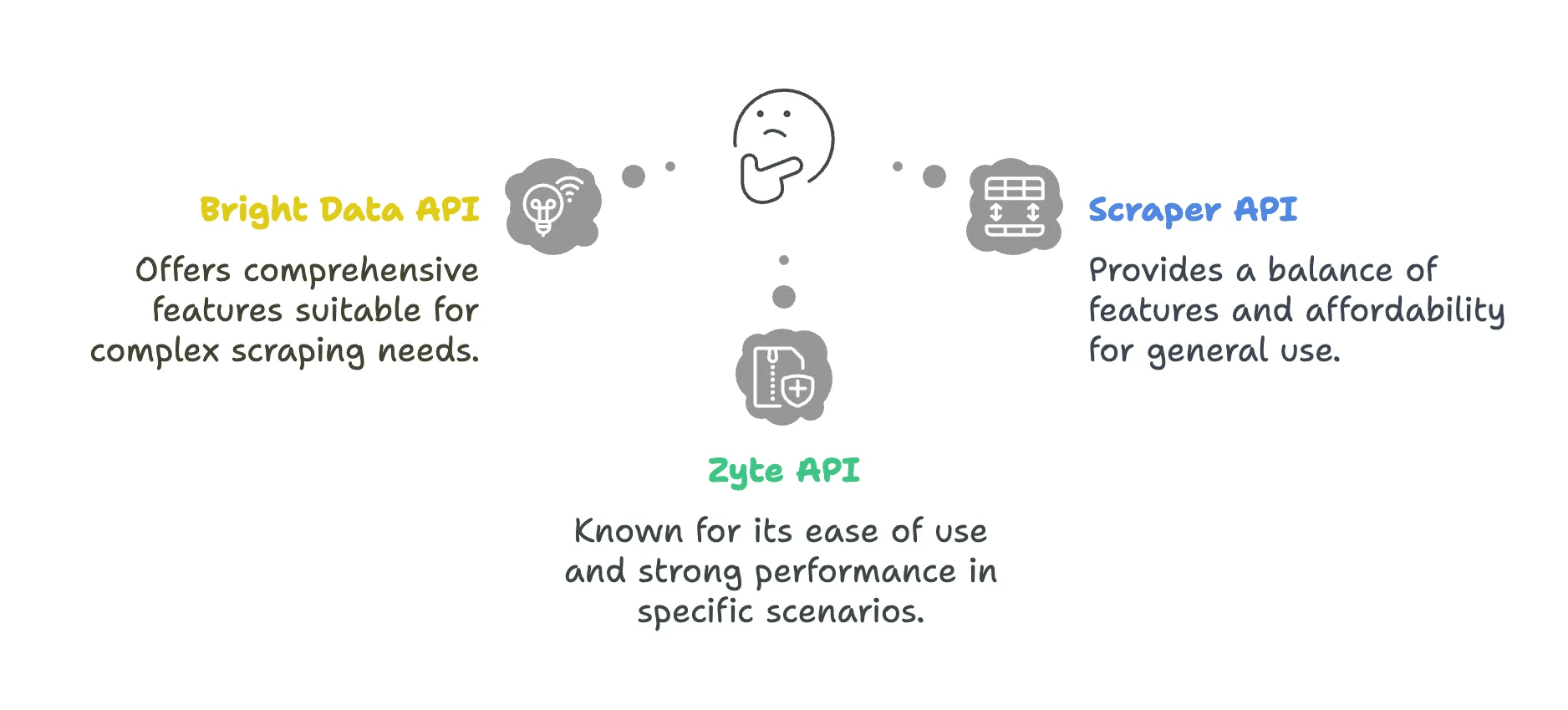

Σύνοψη API λύσεων

| API | Πλεονεκτήματα | Μειονεκτήματα |

|---|---|---|

| Bright Data API | - Τεράστιο δίκτυο proxies (72M+ IPs σε 195 χώρες) - Προηγμένο geo‑targeting έως επίπεδο πόλης/ΤΚ - Ισχυρό Proxy Manager για IP rotation | - Πιο αργοί χρόνοι απόκρισης (μ.ό. 22.08s) - Υψηλή τιμολόγηση, όχι ιδανική για μικρές ομάδες - Πιο απαιτητική ρύθμιση/εκμάθηση |

| ScraperAPI | - Χαμηλότερη είσοδος από $49 - Autoparse για αυτόματη εξαγωγή δεδομένων - Web UI player για δοκιμές | - Συχνά χρεώνει και για blocked requests - Περιορισμένες δυνατότητες JavaScript rendering - Το κόστος μπορεί να αυξηθεί με premium παραμέτρους |

| Zyte API | - AI parsing δυνατότητες - Δεν χρεώνει για αποτυχημένα requests | - Υψηλότερο αρχικό κόστος (~$450/μήνα) - Τα credits δεν μεταφέρονται από μήνα σε μήνα |

- Bright Data Web Scraper API

- Πλεονεκτήματα:

- Κάλυψη 195 χωρών με 72M+ residential IPs, αυτόματο IP rotation και προσομοίωση γεωτοποθεσίας — ιδανικό για sites με αυστηρό anti‑scraping (π.χ. , )

- Υποστήριξη JavaScript δυναμικής φόρτωσης και λήψης snapshot σελίδας

- Μειονεκτήματα:

- Υψηλό κόστος (χρέωση ανά request και bandwidth), χαμηλή σχέση αξίας/κόστους για μικρά projects

- Πλεονεκτήματα:

- Scraper API

- Πλεονεκτήματα:

- 40M proxies παγκοσμίως, αυτόματη εναλλαγή data center/residential IP, παράκαμψη Cloudflare verification, ενσωμάτωση λύσεων CAPTCHA τρίτων (π.χ. )

- Structured endpoints και asynchronous scrapers για μεγαλύτερη ταχύτητα

- Μειονεκτήματα:

- Επιπλέον κόστος για dynamic rendering, περιορισμένη υποστήριξη για σύνθετα AJAX sites

- Πλεονεκτήματα:

- Zyte API

- Πλεονεκτήματα:

- Αυτόματη εξαγωγή δεδομένων με AI, χωρίς ανάπτυξη/συντήρηση κανόνων εξαγωγής ανά site

- Ευέλικτη τιμολόγηση pay‑as‑you‑go

- Μειονεκτήματα:

- Οι advanced δυνατότητες (π.χ. session handling, scriptable browser) απαιτούν εκμάθηση

- Πλεονεκτήματα:

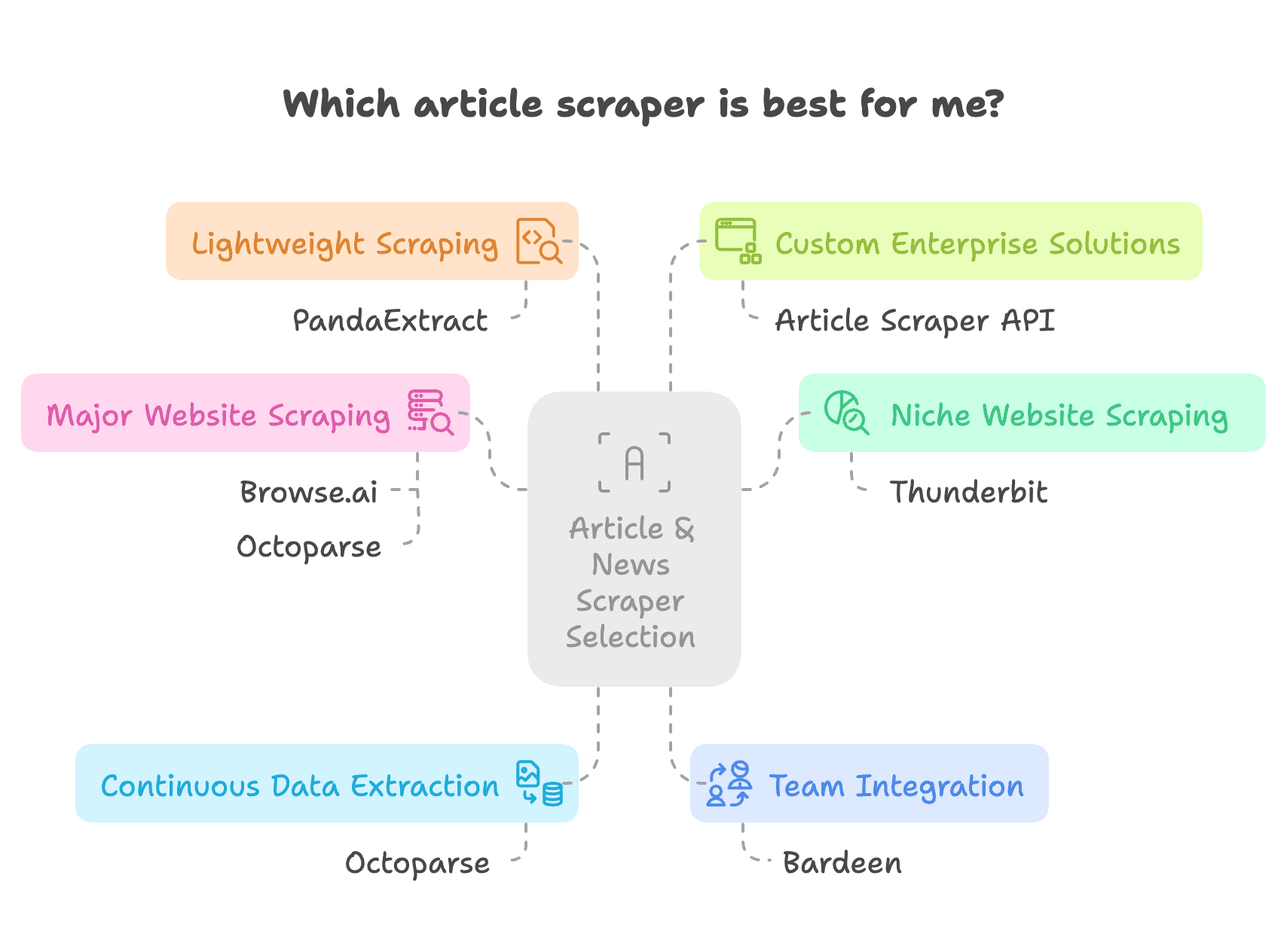

Πώς να επιλέξεις Scraper για άρθρα & ειδήσεις;

Για να διαλέξεις το σωστό εργαλείο, σκέψου τι ζητά η δουλειά σου, το τεχνικό σου επίπεδο και το budget σου.

- Αν θες να κάνεις scrape πολλά εξειδικευμένα sites χωρίς να στήνεις διαφορετικό scraper ειδησεογραφικών άρθρων για κάθε σελίδα και έχεις διαθέσιμο budget, η πιο δυνατή επιλογή είναι το . Δεν βασίζεται σε — χρησιμοποιεί AI για να αναλύει τη δομή και σου δίνει AI ανάλυση μετά το scraping. Με το Thunderbit AI, όλα τα websites αντιμετωπίζονται με την ίδια λογική, ώστε να αποτυπώνει ολόκληρα άρθρα με ακρίβεια.

- Για scraping ειδήσεων/άρθρων από μεγάλα sites όπως ή , θες δυνατούς μηχανισμούς anti‑scraping και έτοιμα templates, όπως Browse.ai ή Octoparse. Παρ’ όλα αυτά, μια Chrome Extension λύση όπως το είναι συχνά η πιο πρακτική επιλογή: η διαδικασία μοιάζει με κανονική περιήγηση/αντιγραφή, και σου επιτρέπει login χωρίς περίπλοκο setup.

- Αν χρειάζεσαι συνεχή scraping σε μεγάλη κλίμακα, εργαλεία με scheduling όπως το Octoparse είναι πιο ταιριαστά.

- Για ομαδική χρήση και ομαλή ενσωμάτωση σε υπάρχουσες ροές εργασίας, το Bardeen είναι ιδανικό, γιατί δίνει web automation πέρα από το scraping.

- Αν θες κάτι ελαφρύ για μικρές εξαγωγές χωρίς να φας χρόνο σε εκμάθηση, πήγαινε σε point‑and‑click λύσεις όπως το PandaExtract.

- Αν έχεις τεχνικό υπόβαθρο ή χτίζεις enterprise λύση, σκέψου API εργαλεία ή δικό σου scraper, πέρα από αυτά τα .

Συμπέρασμα

Σε αυτό το άρθρο είδαμε τι είναι οι scrapers για άρθρα/ειδήσεις και πού «κουμπώνουν» επιχειρησιακά. Οι βασίζονται σε και συχνά θέλουν γνώση και , ειδικά όταν πας σε πιο advanced ρυθμίσεις. Η νέα γενιά πατάει στη σημασιολογική κατανόηση και την οπτική αναγνώριση του AI, ξεπερνώντας τους σε προσαρμογή σε αλλαγές δομής, γενίκευση μεταξύ sites, χειρισμό δυναμικού περιεχομένου, αλλά και σε καθαρισμό/ανάλυση δεδομένων μετά το scraping.

Παράλληλα, παρέθεσα έξι χρήσιμα εργαλεία για scraping άρθρων/ειδήσεων και API επιλογές για developers, με σύγκριση σε πλεονεκτήματα/μειονεκτήματα, κλίμακα δεδομένων, τύπους sites και κοινό-στόχο. Για scraper άρθρων και ειδήσεων, διάλεξε αυτό που ταιριάζει στις ανάγκες σου, κρατώντας μια υγιή ισορροπία ανάμεσα σε απόδοση και κόστος.

Συχνές ερωτήσεις (FAQs)

1. Τι είναι ένας AI article scraper και πώς λειτουργεί;

- Χρησιμοποιεί AI για να αναλύει και να εξάγει περιεχόμενο από σελίδες χωρίς CSS selectors.

- Εντοπίζει με υψηλή ακρίβεια τίτλους, συγγραφείς, ημερομηνίες δημοσίευσης και κύριο κείμενο.

- Αφαιρεί αυτόματα διαφημίσεις, μενού πλοήγησης και άσχετα στοιχεία.

- Προσαρμόζεται σε αλλαγές δομής και λειτουργεί σε διαφορετικά websites.

2. Ποια είναι τα οφέλη ενός AI‑powered article scraper σε σχέση με τους παραδοσιακούς;

- Μπορεί να εξάγει περιεχόμενο από πολλά websites με ένα εργαλείο.

- Διαχειρίζεται δυναμικό περιεχόμενο, όπως σελίδες με JavaScript και AJAX.

- Θέλει λιγότερο χειροκίνητο setup και συντήρηση σε σχέση με scrapers που βασίζονται σε CSS.

- Προσφέρει επιπλέον δυνατότητες όπως περίληψη, μετάφραση και ανάλυση συναισθήματος.

3. Μπορώ να χρησιμοποιήσω το Thunderbit για AI scraping άρθρων χωρίς γνώσεις προγραμματισμού;

- Ναι. Το Thunderbit είναι φτιαγμένο για μη τεχνικούς χρήστες, με απλό no‑code περιβάλλον.

- Χρησιμοποιεί AI για να εντοπίζει και να εξάγει αυτόματα το περιεχόμενο άρθρων.

- Παρέχει έτοιμα templates για γρήγορο και αποδοτικό scraping.

- Επιτρέπει export σε μορφές όπως CSV, JSON και Google Sheets.

Μάθε περισσότερα: