Ich verrate Ihnen ein Geheimnis: Früher dachte ich, Web-Scraping sei Hackern in Kapuzenpullis oder Data Scientists mit mehr Monitoren als gesund ist vorbehalten. Heute gehört das Extrahieren von Daten von einer Website im Business so sehr dazu wie der morgendliche Kaffee – nur eben, zum Glück, ohne dass man Python beherrschen oder vor Mittag drei Espressi trinken muss. Mit dem Aufstieg von KI-Web-Scraper-Tools können inzwischen sogar Leute, die bei „HTML“ an ein neues Sandwich bei Subway denken, strukturierte Daten aus dem offenen Web ziehen.

Wenn Sie schon einmal Produktinfos, Vertriebsleads oder Preislisten Zeile für Zeile in eine Tabelle kopiert und eingefügt haben, sind Sie nicht allein. Nahezu nutzen Web-Scraping inzwischen für Marktanalysen und Wettbewerbsbeobachtung. Und da der Markt für Web-Scraping-Software bis 2032 voraussichtlich erreichen wird, ist klar: Web-Datenextraktion ist längst nicht mehr nur etwas für die Tech-Elite. Ob im Vertrieb, Marketing oder einfach nur, um die manuelle Dateneingabe endlich zu beenden – dieser Leitfaden ist für Sie. Ich zeige Ihnen die Grundlagen, vergleiche klassische und KI-gestützte Ansätze und erkläre, wie Sie loslegen – ganz ohne Kapuzenpulli.

Web-Scraper-Grundlagen: Was bedeutet es, Daten von einer Website zu scrapen?

Fangen wir einfach an. Ein Web-Scraper ist nichts anderes als ein Tool (oder Skript oder eine Chrome-Erweiterung), das automatisch Daten von Websites sammelt. Stellen Sie sich einen superschnellen Praktikanten vor, der sich nie über monotone Aufgaben beschwert. Statt Informationen Zeile für Zeile zu kopieren, erledigt ein Web-Scraper das in Sekunden – und verlangt nicht einmal nach einer Kaffeepause.

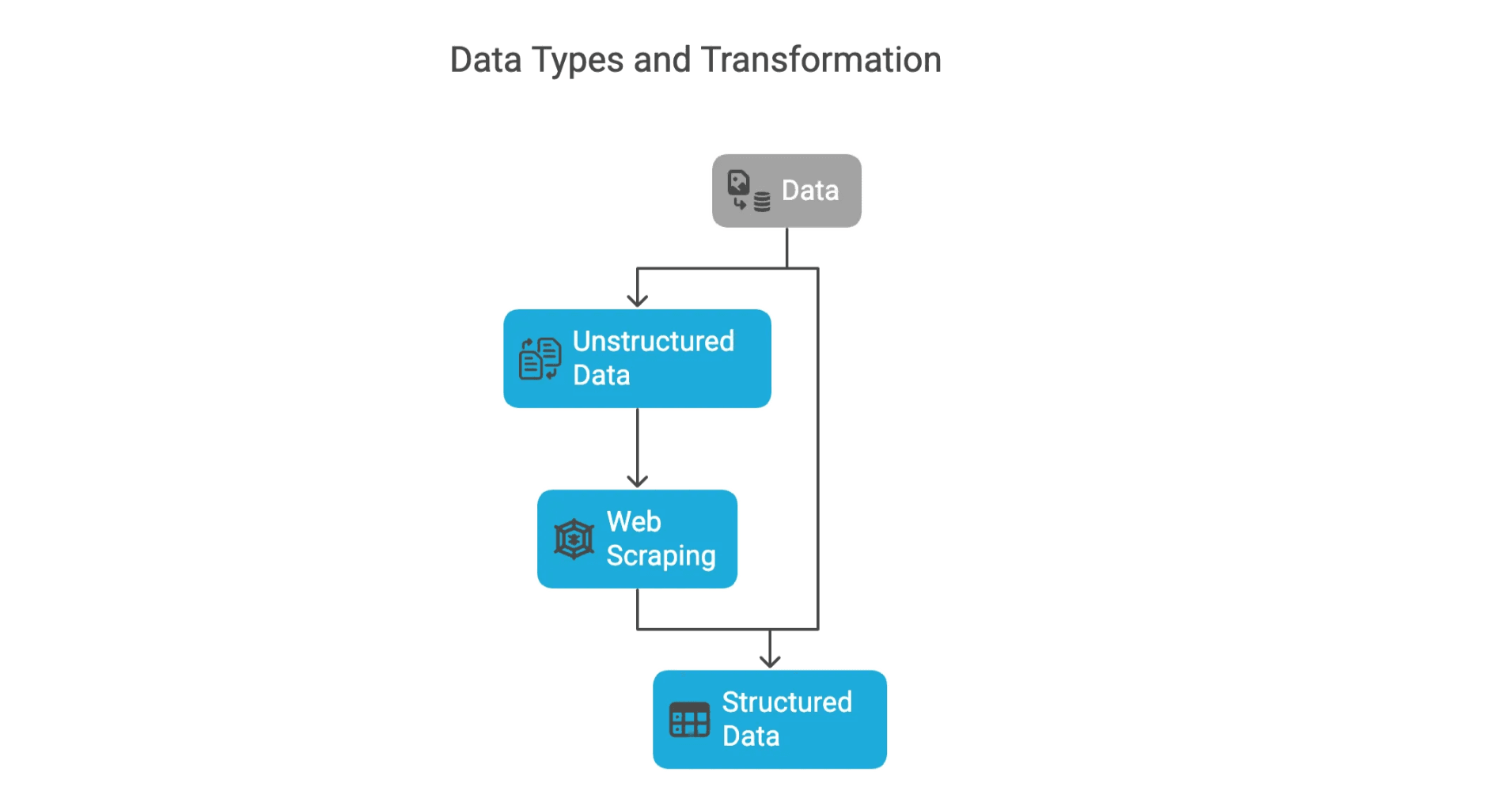

Ihnen begegnen vor allem zwei Arten von Daten:

- Strukturierte Daten: Das sind die sauberen, tabellenfertigen Daten – etwa Produktnamen, Preise oder E-Mails. Sie sind organisiert, beschriftet und leicht auszuwerten.

- Unstrukturierte Daten: Das ist der Wilde Westen – Blogbeiträge, Rezensionen, Bilder oder alles, was sich nicht sauber in Zeilen und Spalten einordnen lässt. Die meisten Web-Scraping-Projekte zielen darauf ab, unstrukturierte Daten in strukturierte Daten zu verwandeln, damit Sie sie wirklich nutzen können.

Wenn Sie schon einmal eine Tabelle von einer Website in Excel kopiert haben, herzlichen Glückwunsch – Sie haben manuell Web-Scraping betrieben. Stellen Sie sich nun vor, Sie müssten das für 10.000 Seiten tun. (Tun Sie das bitte nicht. Dafür gibt es Web-Scraper.)

Warum Daten von Websites scrapen? Wichtige geschäftliche Vorteile

Warum also überhaupt Daten scrapen? Die Kurzfassung: Unternehmen leben von Daten, und das Web ist die größte Datenbank der Welt. Ob Vertrieb, Marketing, E-Commerce oder Immobilien – Web-Datenextraktion verschafft Ihnen einen echten Vorteil.

Hier sind einige der häufigsten Anwendungsfälle im Business:

| Anwendungsfall | Beschreibung | Beispiel-ROI/Nutzen |

|---|---|---|

| Lead-Generierung | Kontaktdaten, E-Mails oder Unternehmenslisten aus Verzeichnissen oder sozialen Netzwerken sammeln | Vertriebsteams sparen Zeit und finden qualifiziertere Leads |

| Preisüberwachung | Preise, Lagerbestände oder Aktionen von Wettbewerbern in Echtzeit verfolgen | Händler passen Preise dynamisch an und steigern den Umsatz um 4 % |

| Marktforschung | Bewertungen, Nachrichten oder Social Sentiment bündeln, um Trends zu erkennen | Marketingteams richten Kampagnen an aktuellen Kundenerkenntnissen aus |

| Wettbewerbsanalyse | Produktkataloge, Launches oder Inhalte der Konkurrenz beobachten | Unternehmen reagieren schneller auf Marktveränderungen |

| Immobilien-Intelligence | Immobilienangebote, Preise und Verfügbarkeiten scrapen | Makler und Investoren entdecken Chancen vor dem Markt |

Tatsächlich nutzen in Großbritannien und Europa dynamische Preisstrategien, die auf Wettbewerber-Preis-Scraping basieren. Und Unternehmen wie John Lewis und ASOS konnten durch die Nutzung von Webdaten für klügere Entscheidungen messbare Umsatzsteigerungen erzielen.

Klassische Web-Scraper-Tools: Wie funktionieren sie?

Spulen wir zurück zur „klassischen“ Art des Daten-Scrapings – bevor KI ihre Muskeln spielen ließ. Traditionelle Web-Scraper sind meist Skripte (oft in Python geschrieben) oder Browser-Erweiterungen, die nach festen Regeln die gewünschten Daten abrufen.

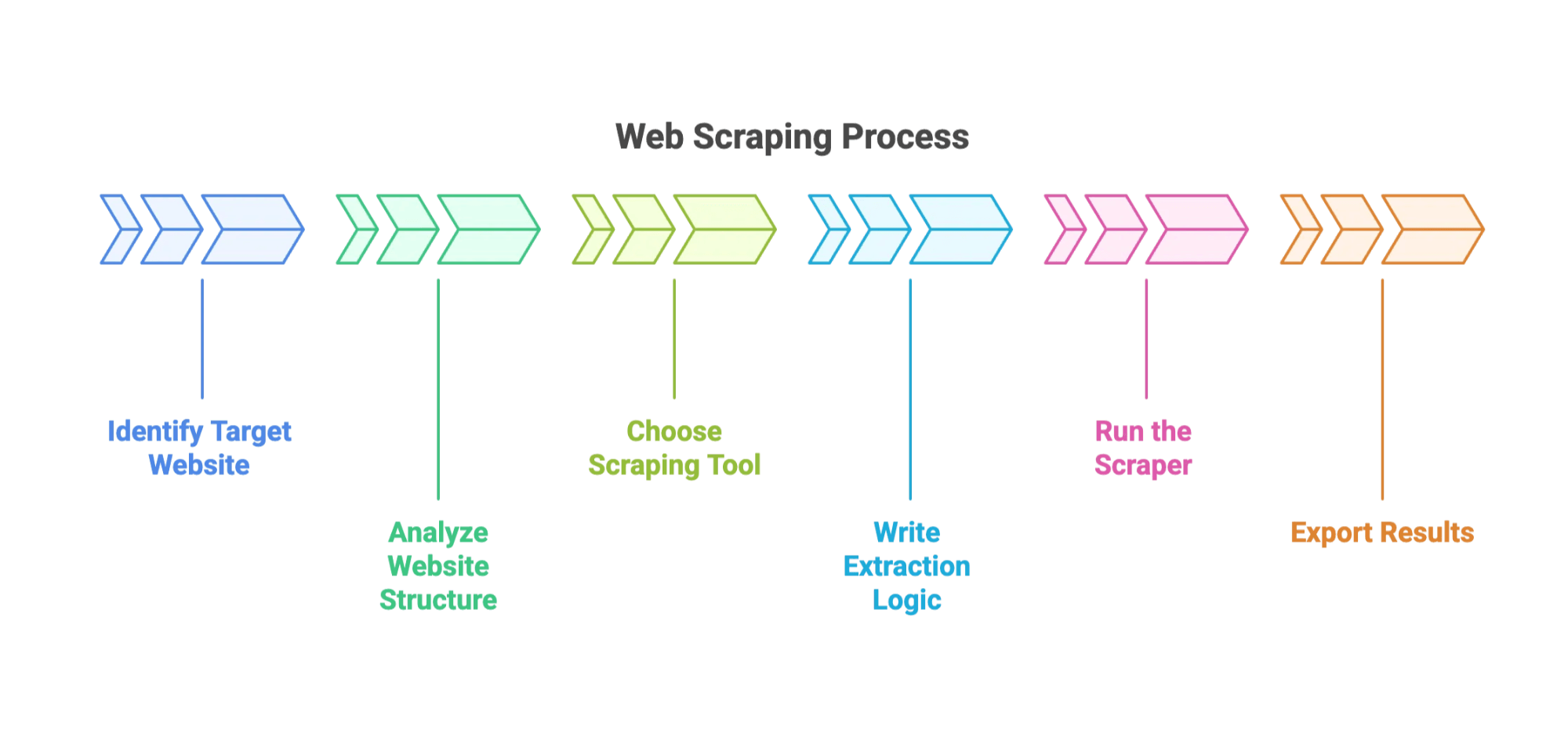

So läuft der Prozess typischerweise ab:

- Zielwebsite und Datenfelder festlegen.

- Die Struktur der Website analysieren. (Das heißt, mit den Developer Tools des Browsers im HTML herumzustöbern. Es ist digitale Archäologie.)

- Tool auswählen: Beliebte Optionen sind , oder Browser-Plugins.

- Extraktionslogik schreiben: Dem Tool sagen, wie es die Daten findet – meist über CSS-Selektoren oder XPath.

- Den Scraper ausführen: Beobachten, wie er Daten über mehrere Seiten hinweg sammelt.

- Ergebnisse exportieren: Meist als CSV, JSON oder direkt nach Excel.

Schritt für Schritt: Daten mit einem klassischen Web-Scraper extrahieren

Nehmen wir an, Sie möchten Produktangebote von einer E-Commerce-Website scrapen. Hier ist eine anfängerfreundliche Anleitung:

- Schritt 1: Installieren Sie Python und die BeautifulSoup-Bibliothek.

- Schritt 2: Untersuchen Sie die Produktseite in Ihrem Browser. Suchen Sie die HTML-Tags, die Produktname und Preis enthalten.

- Schritt 3: Schreiben Sie ein kurzes Skript, das die Seite abruft, das HTML parst und die relevanten Felder extrahiert.

- Schritt 4: Arbeiten Sie mehrere Seiten durch (Pagination berücksichtigen).

- Schritt 5: Exportieren Sie die Daten in eine CSV-Datei.

Das klingt unkompliziert, aber glauben Sie mir: Ihr erstes Skript wird wahrscheinlich mindestens einmal scheitern. (Mein erster Versuch hat 500 Zeilen mit „None“ gescrapt, weil ich einen Klassennamen falsch geschrieben hatte. Ups.)

Häufige Herausforderungen bei klassischen Web-Scraper-Lösungen

Hier wird es knifflig:

- Änderungen an der Website: Schon eine winzige Anpassung im Layout kann Ihren Scraper kaputt machen. fallen jede Woche wegen Änderungen aus.

- Anti-Bot-Maßnahmen: CAPTCHAs, IP-Sperren und Rate Limits können Sie abrupt stoppen. Dann brauchen Sie Proxys, Verzögerungen und manchmal sogar CAPTCHA-Lösungen.

- Technisches Wissen erforderlich: Sie müssen etwas über Programmierung sowie HTML/CSS wissen.

- Wartung: Scraper brauchen ständige Pflege und Updates.

- Unsaubere Daten: Sie verbringen Zeit damit, uneinheitliche Formate, fehlende Werte oder seltsame Kodierungen zu bereinigen.

Für Anfänger fühlt sich das an, als würde man einen Kuchen backen, während sich das Rezept ständig ändert und der Ofen einen gelegentlich aussperrt.

Jetzt kommt der KI-Web-Scraper: Datenextraktion wird zugänglich

Jetzt wird’s spannend. KI-Web-Scraper verändern das Spiel (ups, fast schon wieder die verbotene Formulierung benutzt). Statt Code zu schreiben oder an Selektoren herumzubasteln, sagen Sie dem Tool einfach in klarem Deutsch, was Sie möchten. Die KI erledigt den Rest.

Thunderbit (also wir!) ist ein gutes Beispiel für diese neue Generation. Mit können Sie strukturierte Daten von jeder Website per natürlicher Sprache extrahieren – ganz ohne Programmierung. Ob Vertrieb, Marketing oder E-Commerce: Sie sammeln die benötigten Daten in Minuten statt in Tagen.

Thunderbit KI-Web-Scraper: So vereinfacht er die Datenextraktion

Ich zeige Ihnen, wie Thunderbit das Leben leichter macht:

- KI schlägt Felder vor: Klicken Sie einfach auf „KI-Felder vorschlagen“, und Thunderbit liest die Website, empfiehlt Spaltennamen und schlägt sogar vor, wie jedes Feld extrahiert werden kann.

- Unterseiten-Scraping: Sie brauchen mehr Details? Thunderbit kann jede Unterseite besuchen (z. B. einzelne Produktseiten) und Ihre Datentabelle automatisch anreichern.

- Sofortige Vorlagen: Für beliebte Seiten wie Amazon oder Zillow können Sie vorgefertigte Vorlagen nutzen – ganz ohne Einrichtung.

- Kostenloser Datenexport: Exportieren Sie Ihre Daten nach Excel, Google Sheets, Airtable oder Notion. Oder laden Sie sie als CSV oder JSON herunter. Keine versteckten Gebühren.

- Geplantes Scraping: Richten Sie wiederkehrende Scrapes ein, damit Ihre Daten aktuell bleiben – ideal für Preisüberwachung oder Lead-Updates.

- KI-Autofill: Lassen Sie die KI Online-Formulare für Sie ausfüllen (ja, auch dieses 10-seitige Vendor-Onboarding-Formular).

- E-Mail-, Telefon- und Bild-Extraktoren: Kontaktinformationen oder Bilder mit einem Klick erfassen.

Und das Beste daran? Sie müssen wirklich keine Zeile Code kennen. Die Chrome-Erweiterung von Thunderbit finden Sie , und auf unserer erfahren Sie mehr.

Klassische vs. KI-Web-Scraper-Lösungen im Vergleich

Schauen wir uns an, wie sich beide Ansätze schlagen:

| Aspekt | Klassischer Web-Scraper | KI-Web-Scraper (Thunderbit) |

|---|---|---|

| Benutzerfreundlichkeit | Programmierung oder komplexe Einrichtung erforderlich | No-Code, natürliche Sprachoberfläche |

| Anpassungsfähigkeit | Bricht bei Website-Änderungen leicht | KI passt sich Layout-Änderungen automatisch an |

| Wartung | Hoch – häufige Updates nötig | Gering – die KI erledigt die meisten Änderungen |

| Technische Kenntnisse | Erfordert Programmier- und HTML-Wissen | Für Business-Anwender konzipiert |

| Einrichtungszeit | Stunden bis Tage | Minuten |

| Datenverarbeitung | Manuelle Bereinigung nötig | KI bereinigt und strukturiert Daten automatisch |

| Kosten | Kostenlos (Open Source), aber hoher Zeitaufwand | Erschwingliche Tarife, kostenlose Exportoptionen |

Für die meisten Business-Anwender, besonders für Einsteiger, sind KI-Web-Scraper wie Thunderbit klar im Vorteil, wenn es um Geschwindigkeit, Einfachheit und Zuverlässigkeit geht. Klassische Tools haben weiterhin ihren Platz bei sehr individuellen oder groß angelegten Projekten – aber für 95 % der Anwendungsfälle ist KI der richtige Weg.

Schritt-für-Schritt-Anleitung: Als Anfänger Daten von einer Website scrapen

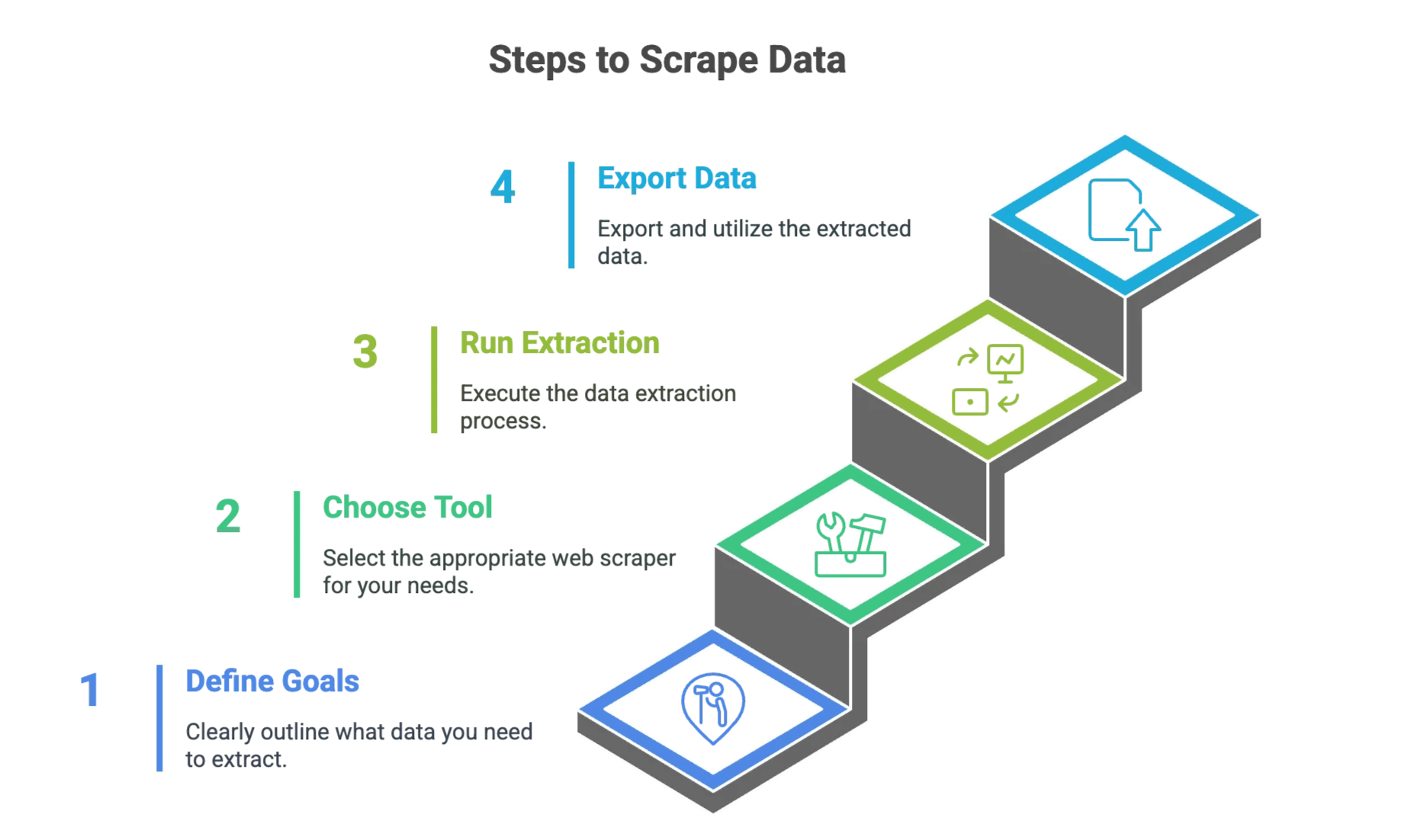

Schritt 1: Definieren Sie Ihre Ziele für die Datenextraktion

Bevor Sie anfangen, machen Sie sich klar, was Sie brauchen. Fragen Sie sich:

- Welche Website(s) möchte ich scrapen?

- Welche Datenfelder sind wichtig? (z. B. Produktname, Preis, E-Mail, Telefonnummer)

- Wie oft brauche ich diese Daten? (einmalig oder wiederkehrend?)

Erstellen Sie eine Checkliste. Zum Beispiel: „Ich möchte Produktnamen, Preise und Bewertungen von den ersten 5 Seiten von sammeln.“

Schritt 2: Wählen Sie das richtige Web-Scraper-Tool

Hier ist ein schneller Entscheidungsbaum:

- Komfortabel mit Code und voller Kontrolle? Probieren Sie ein klassisches Tool wie BeautifulSoup oder Scrapy.

- Wollen Sie Geschwindigkeit, Einfachheit und keinen Code? Dann nehmen Sie einen KI-Web-Scraper wie .

Wenn Sie unsicher sind, starten Sie mit KI. Tiefer einsteigen können Sie später immer noch.

Schritt 3: Richten Sie Ihre Datenextraktion ein und führen Sie sie aus

Klassischer Ansatz

- Tool installieren: Richten Sie Python und die nötigen Bibliotheken ein.

- Website prüfen: Nutzen Sie die Browser-DevTools, um die HTML-Struktur zu finden.

- Skript schreiben: Legen Sie fest, wie jedes Datenfeld gefunden und extrahiert wird.

- Eine Seite testen: Prüfen Sie, ob Sie die richtigen Daten erhalten.

- Skalieren: Ergänzen Sie Pagination oder Schleifen, um weitere Seiten abzudecken.

- Daten exportieren: Als CSV oder JSON speichern.

KI-Ansatz (Thunderbit)

- Thunderbit-Chrome-Erweiterung installieren: .

- Zielwebsite öffnen: Rufen Sie die Seite auf, die Sie scrapen möchten.

- Auf „KI-Felder vorschlagen“ klicken: Thunderbit liest die Seite und schlägt Spalten vor.

- Vorschau prüfen: Kontrollieren Sie, ob die Daten korrekt aussehen. Passen Sie Spalten bei Bedarf an.

- Auf „Scrapen“ klicken: Thunderbit sammelt die Daten für Sie.

- Daten exportieren: Laden Sie sie nach Excel, Google Sheets, Airtable oder Notion herunter.

Eine visuelle Anleitung finden Sie auf unserem .

Schritt 4: Exportieren und nutzen Sie Ihre Daten

Sobald Sie Ihre Daten haben:

- In Ihr bevorzugtes Tool exportieren: Excel, Google Sheets, Airtable, Notion, CSV oder JSON.

- In Ihren Workflow integrieren: Für Vertriebsansprache, Preisanalyse, Marktforschung oder was auch immer Ihr Unternehmen braucht.

- Bereinigen und validieren: Auch mit KI lohnt es sich, die Daten stichprobenartig auf Genauigkeit zu prüfen.

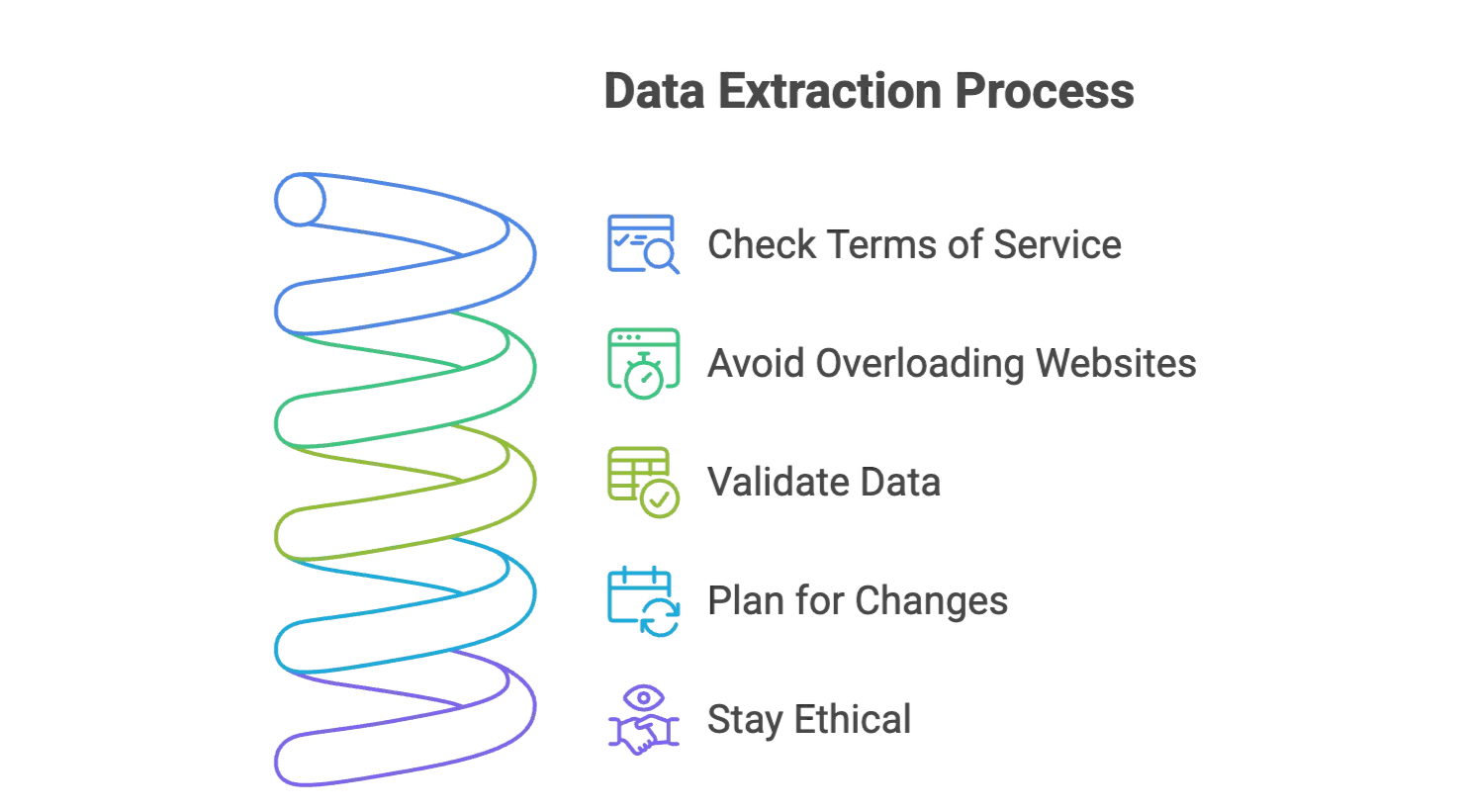

Tipps für erfolgreiche Datenextraktion: Häufige Fehler vermeiden

- Nutzungsbedingungen der Website prüfen: Stellen Sie sicher, dass Sie die Daten scrapen dürfen. Halten Sie sich an öffentliche Informationen und vermeiden Sie sensible personenbezogene Daten.

- Websites nicht überlasten: Fügen Sie bei klassischen Tools Verzögerungen zwischen den Anfragen ein oder lassen Sie Thunderbit das für Sie übernehmen.

- Daten validieren: Prüfen Sie immer eine Stichprobe Ihrer Ergebnisse auf Genauigkeit.

- Mit Änderungen rechnen: Websites werden ständig aktualisiert. KI-Scraper wie Thunderbit passen sich automatisch an, aber bei größeren Änderungen sollten Sie trotzdem aufmerksam bleiben.

- Ethisch bleiben: Scrapen Sie nur, was Sie brauchen, und nennen Sie die Quelle, wenn Sie die Daten in Berichten oder Veröffentlichungen verwenden.

Weitere Tipps finden Sie in unseren Artikeln und .

Fazit und wichtigste Erkenntnisse

Web-Scraping hat einen langen Weg zurückgelegt – von handgeschriebenen Skripten bis zu den heutigen KI-gestützten, einsteigerfreundlichen Tools. Die Hauptunterschiede?

- Klassische Scraper bieten Kontrolle, erfordern aber Programmierung, Wartung und Geduld.

- KI-Web-Scraper wie machen Datenextraktion für alle zugänglich – mit Befehlen in natürlicher Sprache, sofortigen Vorschauen und starken Funktionen wie Unterseiten- und geplantem Scraping.

Wenn Sie neu im Web-Scraping sind, lassen Sie sich nicht einschüchtern. Die Tools waren noch nie so einfach, und der geschäftliche Nutzen ist unbestreitbar. Ob Sie Leads generieren, Preise überwachen oder einfach das Kopieren und Einfügen beenden möchten – KI-Web-Scraper sind Ihr neuer bester Freund.

Wenn Sie also das nächste Mal vor einem Berg von Webdaten sitzen, denken Sie daran: Sie brauchen keinen Doktortitel in Informatik – und nicht einmal einen Kapuzenpulli. Nur ein klares Ziel, das richtige Tool und vielleicht eine gute Tasse Kaffee.

Bereit, es selbst auszuprobieren? und sehen Sie, wie einfach Web-Datenextraktion sein kann.

Neugierig auf mehr? Schauen Sie im vorbei – dort finden Sie ausführliche Beiträge zum Scraping von Amazon, Google, PDFs und mehr. Viel Spaß beim Scrapen!

FAQs

F1: Ist Web-Scraping legal? A: Ja, das Scraping öffentlicher Daten ist in vielen Ländern grundsätzlich legal. Prüfen Sie aber immer die Nutzungsbedingungen der Website und vermeiden Sie das Scrapen sensibler oder persönlicher Daten.

F2: Kann ich Websites scrapen, für die ein Login erforderlich ist? A: Ja, aber das ist komplexer und kann gegen die Richtlinien der Website verstoßen. Sie benötigen Session-Handling oder authentifizierte Scraping-Tools, und die rechtlichen Folgen sollten geprüft werden.

F3: Wie kann ich Daten von JavaScript-lastigen Websites scrapen? A: Verwenden Sie Tools, die dynamisches Rendering unterstützen, etwa Headless-Browser oder KI-Scraper, die menschliche Interaktionen simulieren und JavaScript-gerenderten Inhalt auslesen.

F4: Welche Best Practices helfen, nicht blockiert zu werden? A: Nutzen Sie Rate Limiting, zufällige Verzögerungen, Rotationen des User-Agents und scrapen Sie nicht aggressiv. KI-basierte Scraper übernehmen diese Strategien oft automatisch.

Mehr lesen

-

Überblick über rechtliche Leitlinien, Branchenstatistiken und ethische Best Practices.

-

Trends, Marktwachstum und die Rolle von KI in der Web-Datenextraktion (2024–2025).

-

Erfahren Sie, wie Sie robots.txt-Dateien lesen, um ethisches und legales Scraping zu steuern.