2025 年的网络世界可谓乱象不断——你看到的流量里,差不多有一半都不是人类。没错:如今机器人和爬虫已经占到全部互联网活动的 50% 以上(),而其中真正“好”的机器人——也就是搜索引擎、社交媒体预览器和分析助手——只占很小一部分。剩下的呢?只能说,它们未必是来帮忙的。作为多年在 从事自动化和 AI 工具开发的人,我亲眼见过合适(或不合适)的爬虫如何决定一个网站的 SEO 成败、扭曲分析数据、耗尽带宽,甚至引发严重的安全事件。

如果你在经营业务、管理网站,或者只是想把自己的数字资产打理好,弄清楚是谁在敲你服务器的门,比以往任何时候都更重要。因此,我整理了这份 2025 指南,聚焦最重要的爬虫——它们做什么、如何识别,以及如何在让好机器人畅通无阻的同时,把坏机器人挡在外面。

什么样的爬虫才算“已知”?User-Agent、IP 和验证

先从基础说起:到底什么是“已知”爬虫?最简单地说,就是那种会用统一的 user-agent 字符串自报家门的机器人(比如 Googlebot/2.1 或 bingbot/2.0),而且最好是从你可以验证的、公开的 IP 段或 ASN 区块发起抓取()。谷歌、微软、百度、Yandex、DuckDuckGo 这些大厂都会发布自家机器人文档,很多情况下还会提供工具或 JSON 文件,列出官方 IP(,,)。

但问题在于:只依赖 user-agent 非常危险。伪装现象很普遍——恶意机器人经常冒充 Googlebot 或 Bingbot,只为偷偷绕过你的防线()。所以黄金标准是双重验证:同时检查 user-agent 和 IP 地址(或 ASN),并结合反向 DNS 查询或官方列表。如果你用的是 这样的工具,这个流程完全可以自动化——提取日志、匹配 user-agent、交叉核对 IP,实时建立一份可信赖的抓取来源名单。

如何使用这份爬虫清单

那么,拿到已知爬虫列表后,具体该怎么用?我建议这样做:

- 白名单管理: 确保你希望保留的机器人(搜索引擎、社交媒体预览器)不会被防火墙、CDN 或 WAF 误拦。使用它们的官方 IP 和 user-agent 做精准白名单。

- 分析过滤: 在数据分析中过滤掉机器人流量,让你的数据反映真实的人类访客,而不是只看见 Googlebot 和 AhrefsBot 在你网站上反复“跑圈”()。

- 机器人管理: 对过于激进的 SEO 工具设置 crawl-delay 或限速规则,并拦截或挑战未知、恶意机器人。

- 自动化日志分析: 用 AI 工具(比如 Thunderbit)提取、分类并标记日志中的爬虫活动,这样你就能发现趋势、识别冒名者,并让策略保持最新。

维护爬虫清单不是一次设置就万事大吉的工作。新机器人会不断出现,旧机器人会改变行为,攻击者也会一年比一年狡猾。通过 Thunderbit 抓取官方文档或 GitHub 仓库来自动更新,可以帮你省下大量时间和麻烦。

1. Thunderbit:AI 驱动的爬虫识别与数据管理

不只是一个 AI 网页爬虫——它更像是面向团队的数据助手,帮助你理解并管理爬虫流量。Thunderbit 的优势在于:

- 语义预处理: 在提取数据之前,Thunderbit 会把网页和日志转换成 Markdown 风格的结构化内容。这种“语义级”预处理意味着 AI 能真正理解它正在阅读的上下文、字段和逻辑。对于复杂、动态或 JavaScript 密集的页面(比如 Facebook Marketplace 或超长评论串),它尤其好用;传统基于 DOM 的爬虫在这些场景里往往会失灵。

- 双重验证: Thunderbit 可以快速收集官方爬虫 IP 文档和 ASN 列表,再与你的服务器日志进行匹配。结果就是一份你真正可以依赖的“可信爬虫白名单”——不再需要手动反复核对。

- 自动化日志提取: 把原始日志交给 Thunderbit,它会把它们转换成结构化表格(Excel、Sheets、Airtable),并标记高频访问者、可疑路径和已知机器人。之后你还可以把结果接入 WAF 或 CDN,自动执行拦截、限速或 CAPTCHA 挑战。

- 合规与审计: Thunderbit 的语义提取会保留清晰的审计轨迹——谁在什么时间访问了什么,以及你如何处理它。这对 GDPR、CCPA 以及其他合规要求都非常有帮助。

我见过一些团队用 Thunderbit 把爬虫管理工作量减少了 80%——终于能看清哪些机器人在帮忙,哪些在添乱,哪些根本就是冒牌货。

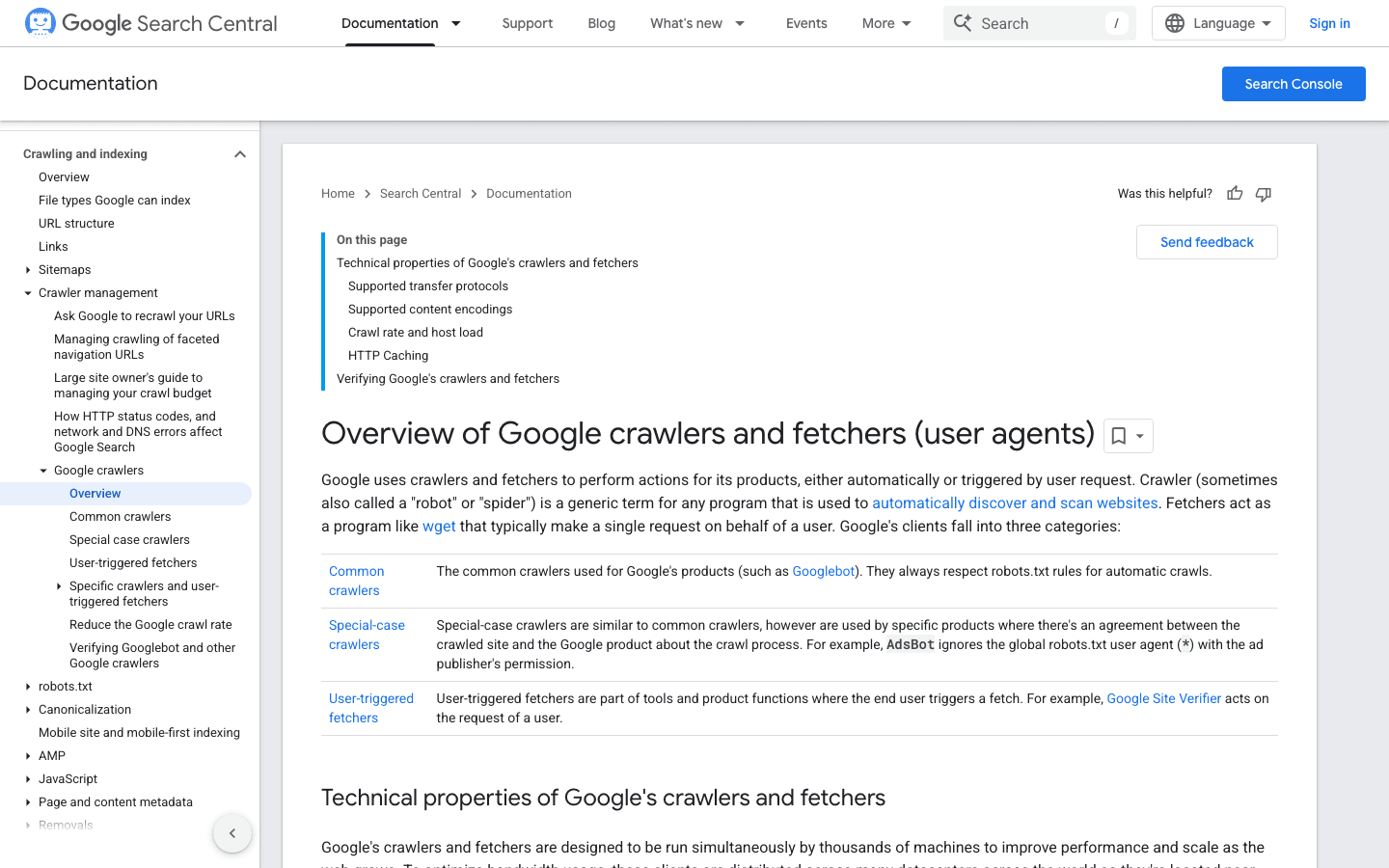

2. Googlebot:搜索引擎标准

是网页爬虫的黄金标准。它负责将你的网站编入 Google 搜索索引——把它挡住,你的网站就等于在数字门店外挂上了“暂停营业”的牌子。

- User-Agent:

Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) - 验证: 使用 或 。

- 管理建议: 始终允许 Googlebot 访问。用 robots.txt 引导它抓取,而不是阻止它;如有需要,可在 Google Search Console 中调整抓取频率。

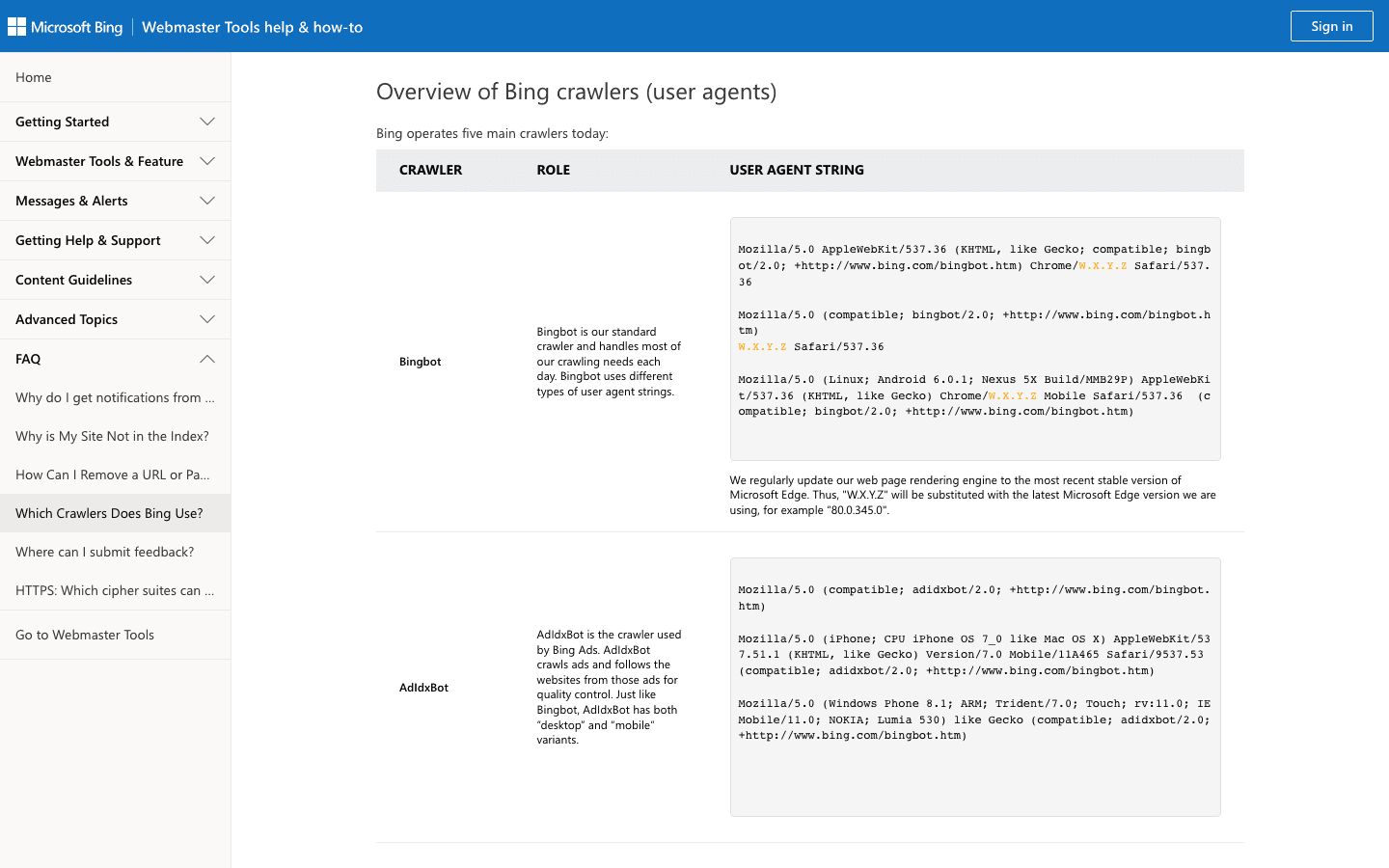

3. Bingbot:微软的网页探索者

为 Bing 和 Yahoo 的搜索结果提供支持。对大多数网站来说,它是第二重要的爬虫。

- User-Agent:

Mozilla/5.0 (compatible; bingbot/2.0; +http://www.bing.com/bingbot.htm) - 验证: 使用 和 。

- 管理建议: 允许 Bingbot,使用 Bing Webmaster Tools 管理抓取频率,并通过 robots.txt 做精细调整。

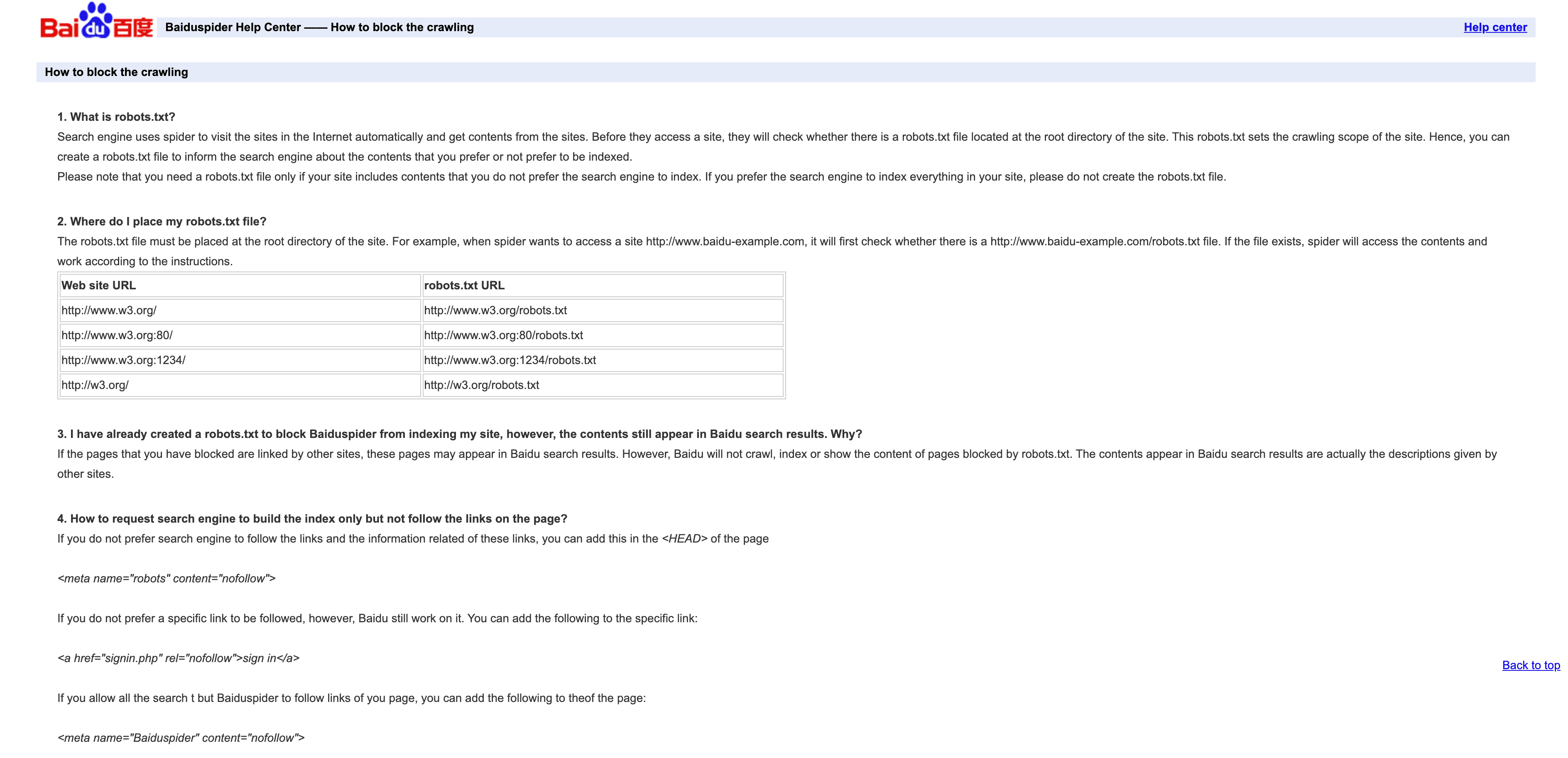

4. Baiduspider:百度的领先搜索爬虫

是通往中文搜索流量的大门。

- User-Agent:

Mozilla/5.0 (compatible; Baiduspider/2.0; +http://www.baidu.com/search/spider.html) - 验证: 没有官方 IP 列表;可以在反向 DNS 中检查是否包含

.baidu.com,但要注意这种方式有局限。 - 管理建议: 如果你需要中文流量,就放行它。可以用 robots.txt 设置规则,但要注意 Baiduspider 有时会忽略这些规则。如果你并不需要中文 SEO,可以考虑限速或屏蔽,以节省带宽。

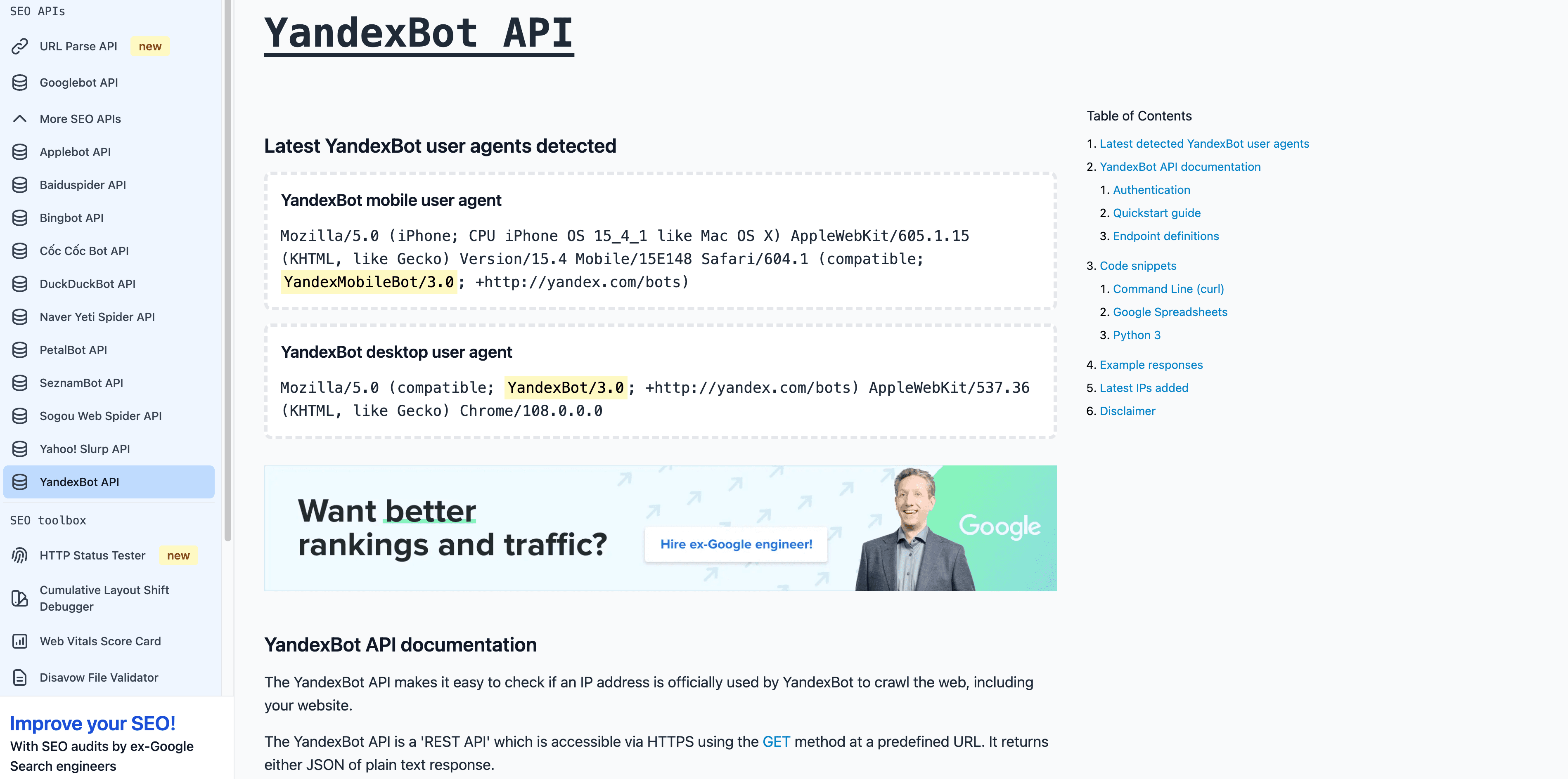

5. YandexBot:俄罗斯的搜索引擎爬虫

对俄罗斯和独联体市场至关重要。

- User-Agent:

Mozilla/5.0 (compatible; YandexBot/3.0; +http://yandex.com/bots) - 验证: 反向 DNS 应以

.yandex.ru、.yandex.net或.yandex.com结尾。 - 管理建议: 如果你的目标用户是俄语市场,就应该允许它访问。使用 Yandex Webmaster 进行抓取控制。

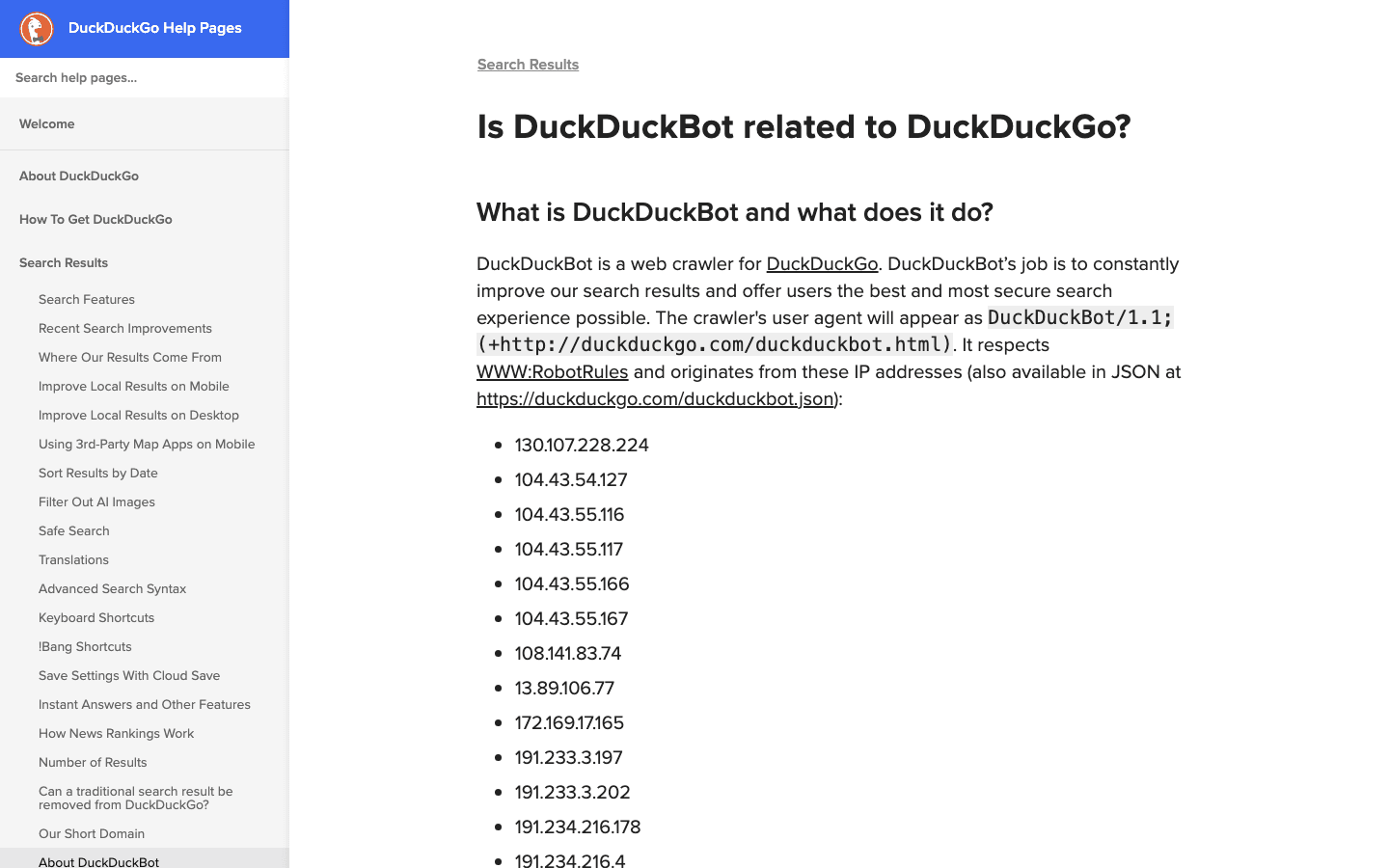

6. DuckDuckBot:注重隐私的搜索爬虫

为 DuckDuckGo 的隐私优先搜索提供支持。

- User-Agent:

DuckDuckBot/1.1; (+http://duckduckgo.com/duckduckbot.html) - 验证: 。

- 管理建议: 除非你完全不关心注重隐私的用户,否则建议允许。抓取负载很低,也很容易管理。

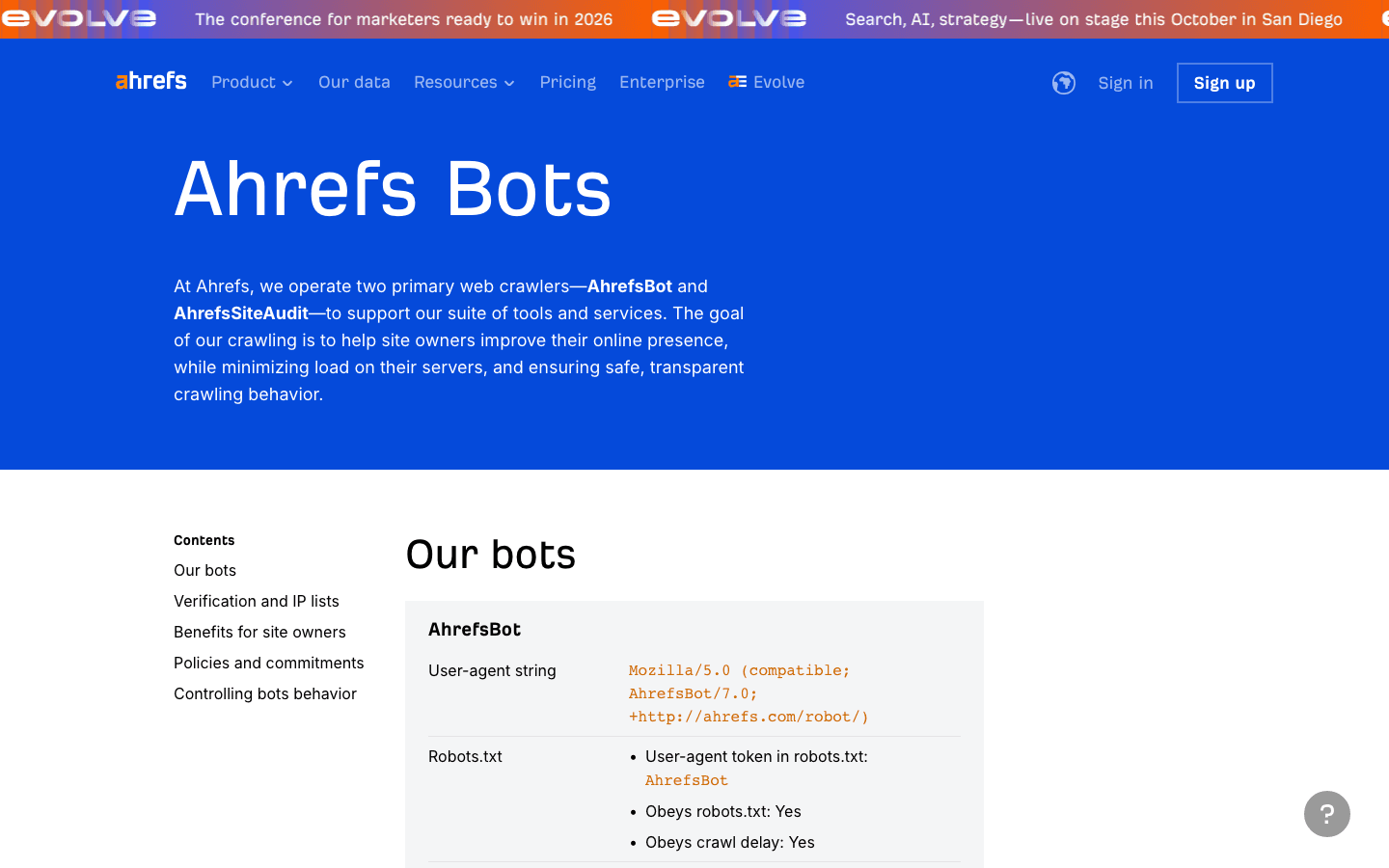

7. AhrefsBot:SEO 与外链分析

是顶级 SEO 工具爬虫之一——非常适合外链分析,但可能比较吃带宽。

- User-Agent:

Mozilla/5.0 (compatible; AhrefsBot/7.0; +http://ahrefs.com/robot/) - 验证: 没有公开 IP 列表;可通过 UA 和反向 DNS 验证。

- 管理建议: 如果你使用 Ahrefs,就允许它。可以用 robots.txt 设置 crawl-delay 或直接屏蔽。你也可以通过 。

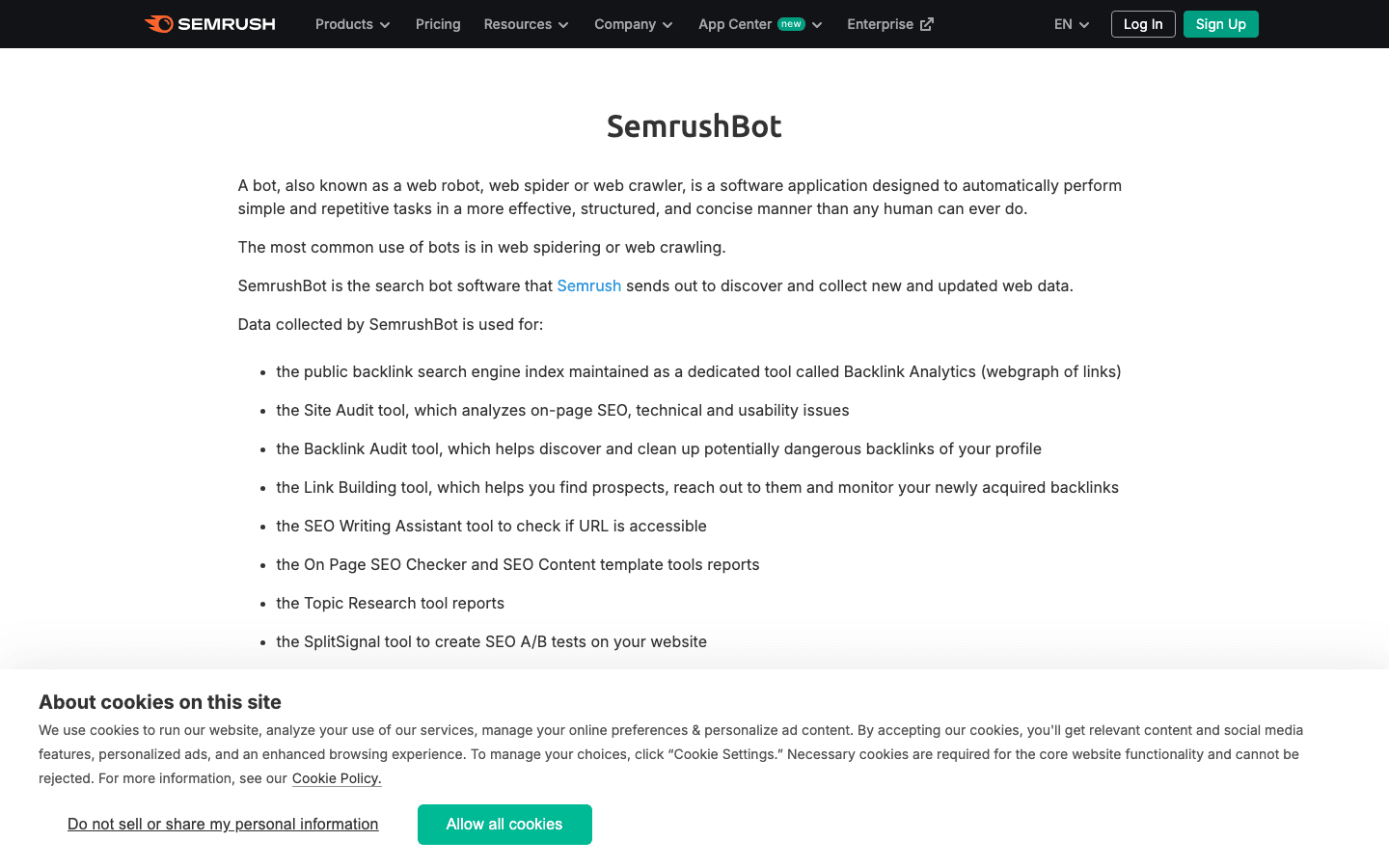

8. SemrushBot:竞争性 SEO 洞察

也是另一款重要的 SEO 爬虫。

- User-Agent:

Mozilla/5.0 (compatible; SemrushBot/1.0; +http://www.semrush.com/bot.html)(以及SemrushBot-BA、SemrushBot-SI等变体) - 验证: 通过 user-agent 识别;没有公开 IP 列表。

- 管理建议: 如果你使用 Semrush,就允许它;否则可以通过 robots.txt 或服务器规则限速或屏蔽。

9. FacebookExternalHit:社交媒体预览机器人

会抓取 Open Graph 数据,用于 Facebook 和 Instagram 的链接预览。

- User-Agent:

facebookexternalhit/1.1 (+http://www.facebook.com/externalhit_uatext.php) - 验证: 通过 user-agent 识别;IP 属于 Facebook 的 ASN。

- 管理建议: 允许它,以获得更丰富的社交预览。屏蔽它意味着 Facebook/Instagram 上不会显示缩略图或摘要。

10. Twitterbot:X(Twitter)链接预览爬虫

会抓取 Twitter Card 数据,用于 X(Twitter)的链接预览。

- User-Agent:

Twitterbot/1.0 - 验证: 通过 user-agent 识别;Twitter ASN(AS13414)。

- 管理建议: 允许它,以获得 Twitter 预览。使用 Twitter Card 元标签可获得最佳效果。

对比表:一眼看懂爬虫清单

| 爬虫 | 用途 | User-Agent 示例 | 验证方式 | 业务影响 | 管理建议 |

|---|---|---|---|---|---|

| Thunderbit | AI 日志/爬虫分析 | N/A(工具,不是机器人) | N/A | 数据管理、机器人分类 | 用于日志提取、构建白名单 |

| Googlebot | Google 搜索索引 | Googlebot/2.1 | DNS 和 IP 列表 | 对 SEO 至关重要 | 始终允许,通过 Search Console 管理 |

| Bingbot | Bing/Yahoo 搜索 | bingbot/2.0 | DNS 和 IP 列表 | 对 Bing/Yahoo SEO 很重要 | 允许,通过 Bing Webmaster Tools 管理 |

| Baiduspider | 百度搜索(中国) | Baiduspider/2.0 | 反向 DNS,UA 字符串 | 对中国 SEO 关键 | 如果面向中国就允许,监控带宽 |

| YandexBot | Yandex 搜索(俄罗斯) | YandexBot/3.0 | 反向 DNS 至 .yandex.ru | 对俄罗斯/东欧关键 | 如果面向俄语/CIS,就允许,使用 Yandex 工具 |

| DuckDuckBot | DuckDuckGo 搜索 | DuckDuckBot/1.1 | 官方 IP 列表 | 注重隐私的受众 | 允许,影响较低 |

| AhrefsBot | SEO/外链分析 | AhrefsBot/7.0 | UA 字符串、反向 DNS | SEO 工具,可能占用较多带宽 | 允许/限速/通过 robots.txt 屏蔽 |

| SemrushBot | SEO/竞争分析 | SemrushBot/1.0(以及其他变体) | UA 字符串 | SEO 工具,可能比较激进 | 允许/限速/通过 robots.txt 屏蔽 |

| FacebookExternalHit | 社交链接预览 | facebookexternalhit/1.1 | UA 字符串、Facebook ASN | 社交媒体互动 | 允许预览,使用 OG 标签 |

| Twitterbot | Twitter 链接预览 | Twitterbot/1.0 | UA 字符串、Twitter ASN | Twitter 互动 | 允许预览,使用 Twitter Card 标签 |

管理你的爬虫清单:2025 年最佳实践

- 定期更新: 爬虫格局变化很快。建议每季度审查一次,并使用 Thunderbit 这类工具抓取和比较官方列表()。

- 先验证,再信任: 始终同时检查 user-agent 和 IP/ASN。不要让冒名者混进来,扭曲你的分析数据或抓取你的内容()。

- 把好机器人加入白名单: 确保搜索和社交爬虫不会被反机器人规则或防火墙误拦。

- 对激进机器人限速或屏蔽: 对抓取太猛的 SEO 工具,使用 robots.txt、crawl-delay 或服务器规则进行限制。

- 自动化日志分析: 使用 AI 驱动的工具(如 Thunderbit)提取、分类并标记爬虫活动——既省时间,又能发现你可能忽略的趋势。

- 平衡 SEO、分析与安全: 不要拦住那些能带来业务的机器人,但也别让坏机器人肆意横行。

结语:让你的爬虫清单持续更新并真正可用

在 2025 年,管理爬虫清单不再只是 IT 任务——它关乎 SEO、分析、安全与合规,是影响业务成败的关键工作。如今机器人已经占据了大多数网页流量,你需要知道谁在访问、为什么访问,以及该怎么应对。保持清单更新,尽可能自动化,并借助 这类工具保持领先。网络只会越来越拥挤——在这个机器人主导的世界里,一套聪明且可执行的爬虫策略,既是你最好的防线,也是最好的进攻手段。

常见问题

1. 为什么维护一份最新的爬虫清单很重要?

因为如今机器人已经占到全部网页流量的一半以上,而其中真正有益的只占很小一部分。保持清单更新,可以确保你放行有帮助的机器人(用于 SEO 和社交预览),并阻止或限速坏机器人,从而保护你的分析数据、带宽和数据安全。

2. 我怎么判断一个爬虫是真的还是假的?

不要只信 user-agent——一定要通过官方列表或反向 DNS 查询来验证 IP 地址或 ASN。像 Thunderbit 这样的工具可以把日志与公开的机器人 IP 和 user-agent 自动匹配,从而简化整个流程。

3. 如果有未知机器人在抓取我的网站,我该怎么办?

先检查它的 user-agent 和 IP。如果它不在白名单里,也不符合已知机器人的特征,可以考虑限速、挑战验证或直接屏蔽。还可以用 AI 工具对新出现的爬虫进行分类和监控。

4. Thunderbit 如何帮助管理爬虫?

Thunderbit 利用 AI 从日志中提取、结构化并分类爬虫活动,让你可以轻松构建白名单、识别冒名者,并自动执行策略。它的语义预处理对复杂或动态网站尤其强大。

5. 屏蔽 Googlebot 或 Bingbot 这类大型爬虫有什么风险?

屏蔽搜索引擎爬虫可能会让你的网站从搜索结果中消失,直接扼杀自然流量。务必仔细检查防火墙、robots.txt 和反机器人规则,确保你没有误把最重要的机器人挡在门外。

了解更多: