Có một cảm giác đúng kiểu “kinh điển” khi bạn mở terminal, gõ đúng một lệnh và thấy dữ liệu web thô tuôn ra—cảm giác như vừa bẻ khóa Matrix vậy. Với dev và người dùng kỹ thuật, chính là cây đũa phép đó: một công cụ dòng lệnh nhìn thì đơn giản thôi nhưng lại đang âm thầm chạy trên hàng tỷ thiết bị, từ server đám mây cho tới… cái tủ lạnh thông minh. Và kể cả đến 2026, giữa rừng công cụ scrape no-code và AI bóng bẩy, web scraping với curl vẫn là “chân ái” cho ai cần tốc độ, quyền kiểm soát, và khả năng tự động hóa bằng script.

Mình đã có nhiều năm xây công cụ automation và hỗ trợ các team “vật lộn” với dữ liệu web, và đến giờ vẫn hay dùng cURL mỗi khi cần kéo nhanh một trang, debug API, hoặc dựng bản nháp cho một flow scraping. Trong bài này, mình sẽ dẫn bạn đi qua một curl web scraping tutorial từ nền tảng đến mẹo nâng cao—kèm ví dụ lệnh thực chiến, tips hữu ích, và góc nhìn thẳng thắn về điểm mạnh của cURL (cũng như lúc nào nó bắt đầu “đuối”). Còn nếu bạn là người dùng business và không muốn đụng tới dòng lệnh, mình cũng sẽ giới thiệu cách —AI web scraper của tụi mình—giúp bạn đi từ “mình cần dữ liệu này” đến “đây là file spreadsheet” chỉ trong hai cú nhấp, không cần code.

Mình đã có nhiều năm xây công cụ automation và hỗ trợ các team “vật lộn” với dữ liệu web, và đến giờ vẫn hay dùng cURL mỗi khi cần kéo nhanh một trang, debug API, hoặc dựng bản nháp cho một flow scraping. Trong bài này, mình sẽ dẫn bạn đi qua một curl web scraping tutorial từ nền tảng đến mẹo nâng cao—kèm ví dụ lệnh thực chiến, tips hữu ích, và góc nhìn thẳng thắn về điểm mạnh của cURL (cũng như lúc nào nó bắt đầu “đuối”). Còn nếu bạn là người dùng business và không muốn đụng tới dòng lệnh, mình cũng sẽ giới thiệu cách —AI web scraper của tụi mình—giúp bạn đi từ “mình cần dữ liệu này” đến “đây là file spreadsheet” chỉ trong hai cú nhấp, không cần code.

Vào việc luôn: vì sao cURL vẫn còn rất đáng dùng cho web scraping trong 2025, dùng sao cho hiệu quả, và khi nào nên chuyển sang một giải pháp “đô” hơn.

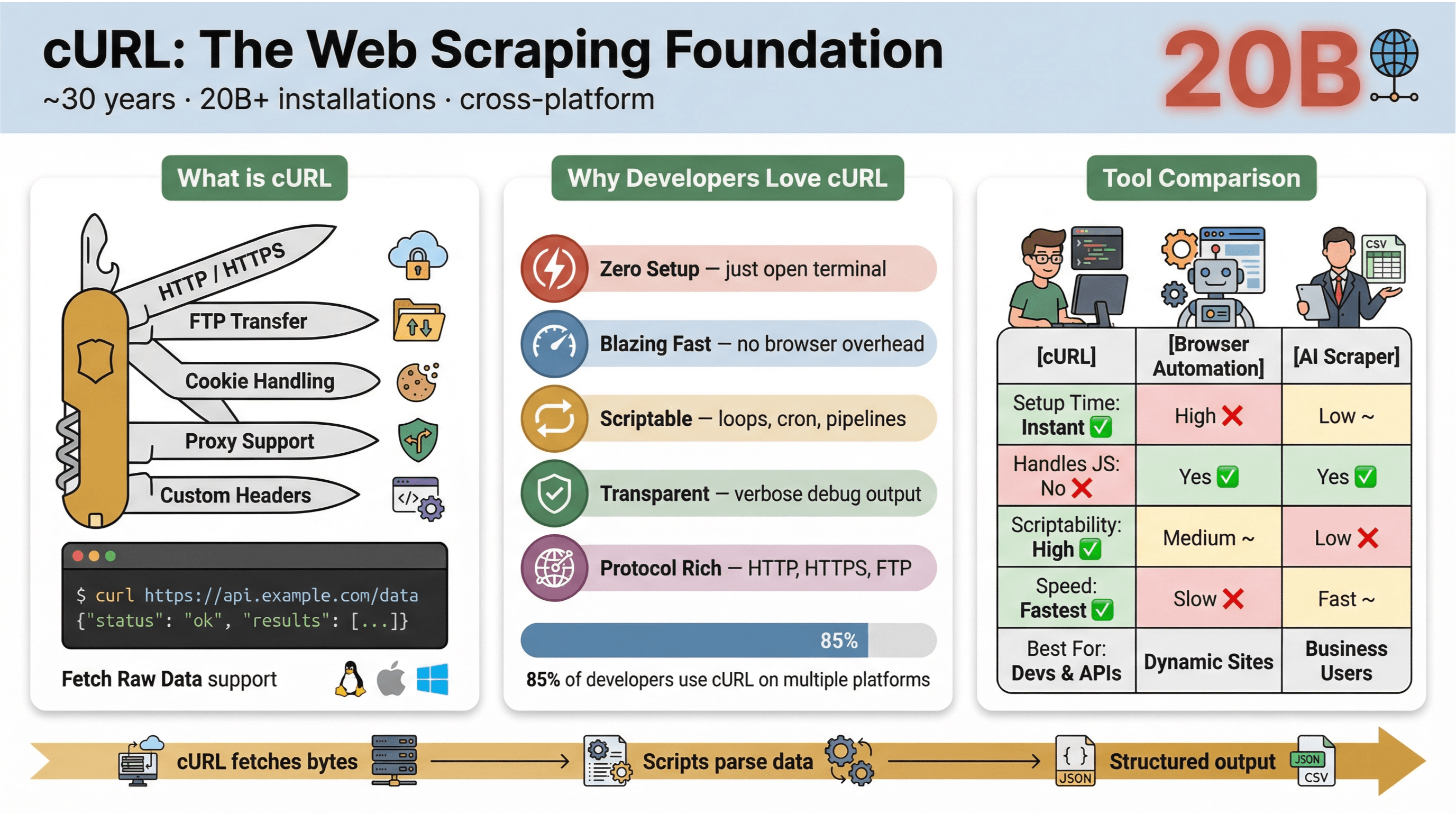

cURL là gì? Nền tảng của Web-Scraping-with-curl

Về bản chất, là công cụ dòng lệnh và thư viện để truyền dữ liệu qua URL. Nó đã tồn tại gần 30 năm (đúng vậy đó), và có mặt ở khắp nơi—tích hợp sẵn trong hệ điều hành, chạy trong script, và âm thầm xử lý truyền dữ liệu trong hơn . Nếu bạn từng chạy lệnh để tải trang web, test API, hay tải file, khả năng cao là bạn đã “đụng” cURL rồi.

Điều khiến cURL được chuộng trong web scraping:

Điều khiến cURL được chuộng trong web scraping:

- Nhẹ và đa nền tảng: Chạy ngon trên Linux, macOS, Windows, kể cả thiết bị nhúng.

- Hỗ trợ nhiều giao thức: HTTP, HTTPS, FTP và nhiều thứ khác.

- Dễ viết script: Rất hợp cho automation, cron job và kiểu “glue code”.

- Không cần tương tác người dùng: Thiết kế cho chế độ non-interactive—tối ưu cho batch job và pipeline.

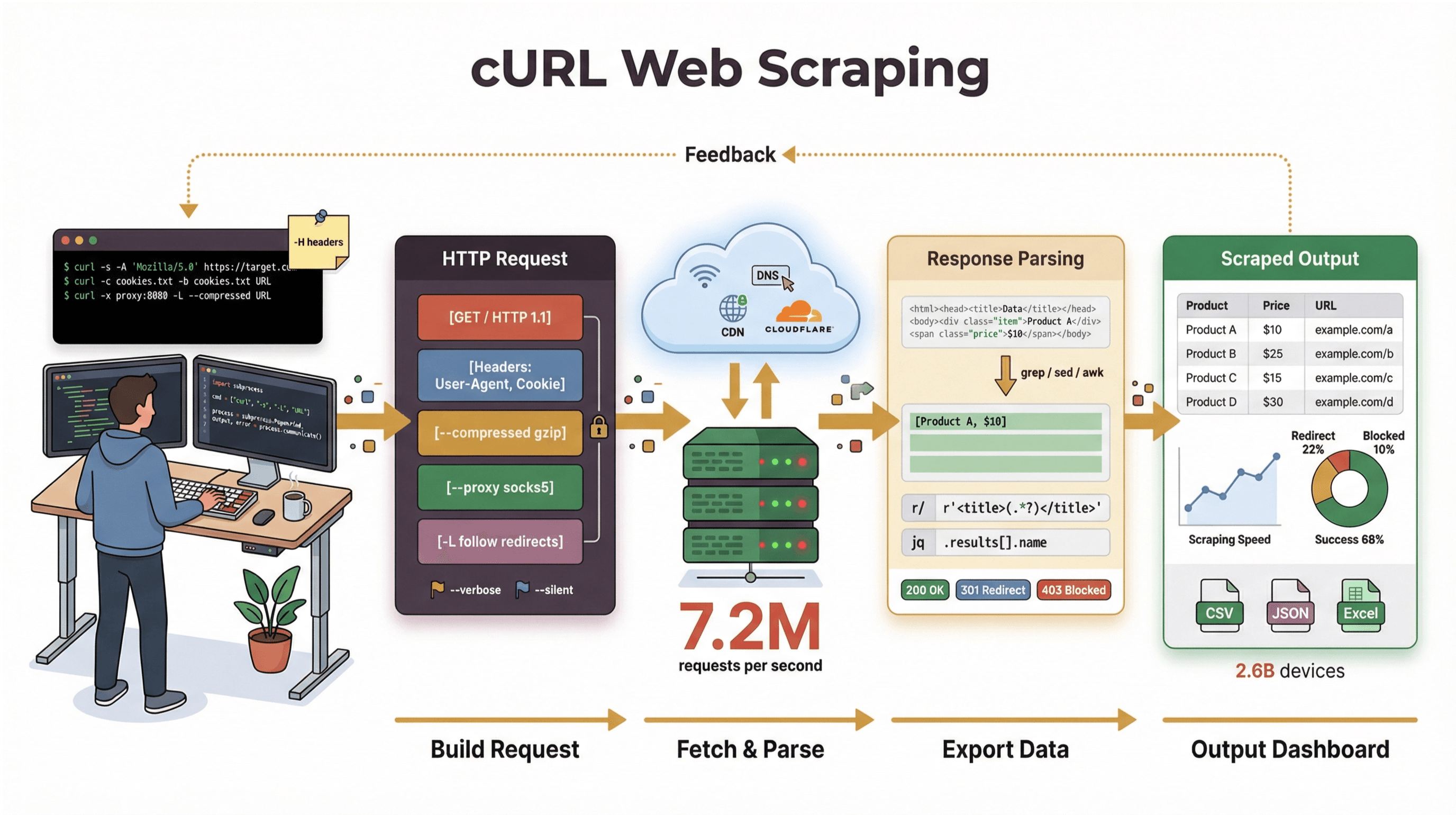

Nhưng nói cho rõ: nhiệm vụ chính của cURL là kéo dữ liệu thô—HTML, JSON, hình ảnh… chứ nó không tự parse, render hay biến dữ liệu thành cấu trúc giúp bạn. Cứ xem cURL như “chặng đầu” của web scraping: nó mang về bytes, còn để biến thành dữ liệu có cấu trúc thì bạn cần công cụ khác (ví dụ Python, grep/sed/awk, hoặc một AI web scraper).

Muốn xem tài liệu chính thức, bạn có thể đọc .

Vì sao dùng cURL để Web Scraping? (curl web scraping tutorial)

Vậy vì sao dev và người dùng kỹ thuật vẫn quay lại với cURL để scrape web, dù ngoài kia có cả tá công cụ mới? Đây là những điểm khiến cURL “ăn tiền”:

- Thiết lập tối giản: Không cần cài thêm, không phụ thuộc—mở terminal là chạy.

- Nhanh: Kéo dữ liệu cái rụp, không phải chờ trình duyệt load.

- Dễ tự động hóa: Lặp URL, tự động request, nối chuỗi lệnh.

- Hỗ trợ tính năng phong phú: Cookie, proxy, redirect, header tùy chỉnh…

- Minh bạch: Có verbose/debug để nhìn rõ request/response.

Theo , hơn 85% người tham gia nói họ dùng cURL command-line, và gần như ai cũng dùng trên nhiều nền tảng. Nó vẫn là “dao đa năng” cho HTTP request: kéo dữ liệu nhanh, xử lý sự cố gọn lẹ.

So sánh nhanh cURL với các cách scrape khác:

| Tính năng | cURL | Tự động hóa trình duyệt (vd: Selenium) | AI Web Scraper (vd: Thunderbit) |

|---|---|---|---|

| Thời gian thiết lập | Ngay lập tức | Cao | Thấp |

| Khả năng viết script | Cao | Trung bình | Thấp (không cần code) |

| Xử lý JavaScript | Không | Có | Có (Thunderbit: qua trình duyệt) |

| Hỗ trợ cookie/session | Thủ công | Tự động | Tự động |

| Chuẩn hóa dữ liệu | Thủ công (tự parse) | Thủ công (tự parse) | Dựa trên AI/Template |

| Phù hợp nhất | Dev, kéo nhanh | Site động/phức tạp | Người dùng business, xuất dữ liệu |

Chốt lại: cURL cực mạnh cho việc “kéo dữ liệu nhanh” và tự động hóa—đặc biệt với trang tĩnh, API, hoặc workflow đơn giản. Nhưng khi bạn cần parse HTML phức tạp, xử lý JavaScript, hoặc xuất dữ liệu có cấu trúc, bạn sẽ muốn một công cụ chuyên dụng hơn.

Bắt đầu: Ví dụ lệnh cURL Web Scraping cơ bản

Giờ mình vào thực hành. Dưới đây là cách dùng cURL cho các tác vụ scraping cơ bản, theo từng bước.

Lấy HTML thô bằng cURL

Case đơn giản nhất: lấy HTML của một trang.

1curl https://books.toscrape.com/Lệnh này tải trang chủ của , một website demo công khai cho web scraping. Bạn sẽ thấy HTML thô in ra trong terminal—có thể tìm các thẻ như <title> hoặc đoạn như “In stock.”

Lưu output ra file

Muốn lưu HTML để parse sau? Dùng cờ -o:

1curl -o page.html https://books.toscrape.com/Giờ bạn có file page.html chứa toàn bộ HTML. Rất tiện để soi cấu trúc hoặc parse bằng công cụ khác.

Gửi POST request bằng cURL

Cần submit form hoặc gọi API? Dùng -d cho POST. Ví dụ với , website chuyên để test HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Bạn sẽ nhận JSON phản hồi, echo lại dữ liệu đã gửi—rất hợp để test và dựng prototype.

Xem header và debug

Nhiều lúc bạn cần xem header hoặc debug request:

-

Chỉ lấy header (HEAD request):

1curl -I https://books.toscrape.com/ -

In cả header lẫn body:

1curl -i https://httpbin.org/get -

Verbose/debug chi tiết:

1curl -v https://books.toscrape.com/

Các cờ này giúp bạn nhìn rõ “bên trong” đang diễn ra gì—cực quan trọng khi troubleshoot.

Bảng tra nhanh các lệnh:

| Tác vụ | Ví dụ lệnh | Ghi chú |

|---|---|---|

| Lấy HTML | curl URL | In HTML ra terminal |

| Lưu ra file | curl -o file.html URL | Ghi output vào file |

| Xem header | curl -I URL hoặc curl -i URL | -I chỉ HEAD, -i in header kèm body |

| POST dữ liệu form | curl -d "a=1&b=2" URL | Gửi dữ liệu dạng form-encoded |

| Debug request/response | curl -v URL | Hiển thị chi tiết request/response |

Xem thêm ví dụ tại .

Nâng cấp: Web scraping nâng cao với cURL (web-scraping-with-curl)

Khi đã quen phần cơ bản, cURL còn nhiều “đồ nghề” nâng cao để xử lý các tình huống khó hơn.

Xử lý cookie và session

Nhiều website cần cookie để giữ đăng nhập hoặc theo dõi phiên. Với cURL, bạn có thể lưu và tái sử dụng cookie giữa các request:

1# Lưu cookie sau khi login

2curl -c cookies.txt https://example.com/login

3# Dùng cookie cho các request tiếp theo

4curl -b cookies.txt https://example.com/accountCách này giúp bạn mô phỏng session như trình duyệt và vào trang sau đăng nhập (miễn là không có “ải” JavaScript).

Giả lập User-Agent và header tùy chỉnh

Một số website trả nội dung khác nhau tùy User-Agent hoặc header. Mặc định cURL tự nhận là “curl/VERSION”, đôi khi dễ bị chặn hoặc trả nội dung khác. Để giả lập trình duyệt:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Bạn cũng có thể set header tùy chỉnh, ví dụ ngôn ngữ:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Nhờ vậy bạn nhận nội dung gần giống như khi mở bằng browser thật.

Dùng proxy khi web scraping

Cần đi qua proxy (test theo vùng địa lý hoặc giảm nguy cơ bị chặn IP)? Dùng cờ -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Hãy dùng proxy có trách nhiệm và tuân thủ điều khoản của website.

Tự động scrape nhiều trang

Muốn scrape nhiều trang—ví dụ danh sách sản phẩm phân trang? Dùng vòng lặp shell đơn giản:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneLệnh này tải trang 2 đến 5 của catalog Books to Scrape và lưu mỗi trang thành một file riêng. (Trang 1 là homepage.)

Giới hạn của Web-Scraping-with-curl: Những điều bạn cần biết

Dù mình rất mê cURL, vẫn phải nói thẳng: nó không phải “chìa khóa vạn năng”. Đây là những điểm yếu hay gặp:

- Không chạy được JavaScript: cURL không xử lý được trang cần JavaScript để render nội dung hoặc vượt qua thử thách chống bot ().

- Phải tự parse thủ công: Bạn nhận HTML/JSON thô, còn bóc tách dữ liệu phải tự làm—thường phải thêm script/công cụ.

- Quản lý session hạn chế: Login phức tạp, token, form nhiều bước… sẽ nhanh chóng rối.

- Không có sẵn “chuẩn hóa dữ liệu”: cURL không tự biến trang web thành hàng/cột hay spreadsheet.

- Dễ bị hệ thống chống bot phát hiện: Nhiều site dùng phòng thủ nâng cao (JavaScript, fingerprinting, CAPTCHA) mà cURL khó vượt ().

Bảng so sánh nhanh:

| Hạn chế | Chỉ dùng cURL | Công cụ scraping hiện đại (vd: Thunderbit) |

|---|---|---|

| Hỗ trợ JavaScript | Không | Có |

| Chuẩn hóa dữ liệu | Thủ công | Tự động (AI/Template) |

| Quản lý session | Thủ công | Tự động |

| Vượt anti-bot | Hạn chế | Nâng cao (trình duyệt/AI) |

| Dễ sử dụng | Cần kỹ thuật | Không cần kỹ thuật |

Với trang tĩnh và API, cURL đúng là “ngon-bổ-rẻ”. Nhưng với site động hoặc được bảo vệ mạnh, bạn nên nâng cấp công cụ.

Thunderbit vs. cURL: Cách tiếp cận tốt nhất cho người dùng không chuyên

Giờ nói về , tiện ích Chrome AI web scraper của tụi mình. Nếu bạn làm sales, marketing, vận hành… và chỉ muốn đưa dữ liệu từ website vào Excel, Google Sheets hoặc Notion—không đụng dòng lệnh—Thunderbit sinh ra là để phục vụ đúng nhu cầu đó.

So sánh Thunderbit với cURL:

| Tính năng | cURL | Thunderbit |

|---|---|---|

| Giao diện | Dòng lệnh | Trỏ-chọn (Chrome Extension) |

| AI gợi ý trường dữ liệu | Không | Có (AI đọc trang, gợi ý cột) |

| Phân trang/Subpage | Tự viết script | Tự động (AI phát hiện và scrape) |

| Xuất dữ liệu | Thủ công (parse + lưu) | Xuất thẳng sang Excel, Google Sheets, Notion, Airtable |

| Trang JS/Trang được bảo vệ | Không | Có (scrape qua trình duyệt) |

| Không cần code | Không (cần script) | Có (ai cũng dùng được) |

| Gói miễn phí | Luôn miễn phí | Miễn phí tới 6 trang (10 trang với trial boost) |

Với Thunderbit, bạn chỉ cần mở extension, bấm “AI Suggest Fields”, để AI tự nhận diện dữ liệu cần lấy. Bạn có thể scrape bảng, danh sách, chi tiết sản phẩm, thậm chí tự động vào subpage. Xong xuôi thì xuất dữ liệu thẳng sang công cụ bạn dùng hằng ngày—không cần parse, không đau đầu.

Thunderbit được hơn tin dùng, đặc biệt phổ biến với các team sales, ecommerce và bất động sản cần dữ liệu có cấu trúc thật nhanh.

Muốn trải nghiệm? .

Kết hợp cURL và Thunderbit: Chiến lược web scraping linh hoạt

Nếu bạn là người dùng kỹ thuật, bạn không nhất thiết phải chọn một trong hai. Thực tế, nhiều team dùng cURL và Thunderbit song song để “xoay” linh hoạt nhất:

- Dựng prototype bằng cURL: Dùng cURL để test endpoint nhanh, xem header, hiểu cách site phản hồi.

- Mở rộng bằng Thunderbit: Khi cần dữ liệu có cấu trúc, scrape nhiều trang, hoặc workflow lặp lại, chuyển sang Thunderbit để trích xuất kiểu point-and-click và xuất thẳng.

Ví dụ workflow nghiên cứu thị trường:

- Dùng cURL tải vài trang và xem cấu trúc HTML.

- Xác định các trường cần lấy (vd: tên sản phẩm, giá, đánh giá).

- Mở Thunderbit, bấm “AI Suggest Fields” để AI thiết lập scraper.

- Scrape toàn bộ trang (kể cả subpage hoặc danh sách phân trang) và xuất sang Google Sheets.

- Phân tích, chia sẻ và hành động—không cần parse thủ công.

Bảng quyết định nhanh:

| Tình huống | Dùng cURL | Dùng Thunderbit | Dùng cả hai |

|---|---|---|---|

| Gọi API nhanh hoặc tải trang tĩnh | ✅ | ||

| Cần dữ liệu có cấu trúc trong spreadsheet | ✅ | ||

| Debug header/cookie | ✅ | ||

| Scrape trang động/nặng JavaScript | ✅ | ||

| Xây workflow lặp lại, không cần code | ✅ | ||

| Prototype rồi mở rộng quy mô | ✅ | ✅ | Quy trình hybrid |

Các vấn đề thường gặp khi Web Scraping với cURL

Trước khi “bung lụa” với cURL, đây là những thách thức thực tế bạn sẽ gặp:

- Hệ thống chống bot: Nhiều site dùng cơ chế nâng cao (JavaScript challenge, CAPTCHA, fingerprinting) mà cURL không vượt được ().

- Chất lượng dữ liệu: HTML thay đổi, thiếu trường, layout không nhất quán có thể làm script hỏng.

- Tốn công bảo trì: Mỗi lần site đổi giao diện, bạn phải cập nhật logic parse.

- Rủi ro pháp lý/tuân thủ: Luôn kiểm tra điều khoản sử dụng, robots.txt và luật liên quan trước khi scrape. Dữ liệu công khai không đồng nghĩa “muốn dùng sao cũng được” (, ).

- Giới hạn khi mở rộng: cURL hợp việc nhỏ; còn scrape quy mô lớn thì bạn phải tự quản proxy, rate limit và xử lý lỗi.

Mẹo troubleshoot và tuân thủ:

- Luôn bắt đầu với site được phép hoặc site demo (như ).

- Tôn trọng rate limit—đừng “dội” request liên tục.

- Tránh scrape dữ liệu cá nhân nếu không có cơ sở pháp lý.

- Nếu gặp tường JavaScript/CAPTCHA, cân nhắc chuyển sang công cụ dựa trên trình duyệt như Thunderbit.

Tóm tắt từng bước: Cách scrape website bằng cURL

Checklist tra nhanh cho web-scraping-with-curl:

- Xác định URL mục tiêu: Bắt đầu với trang tĩnh hoặc API endpoint.

- Tải trang:

curl URL - Lưu output ra file:

curl -o file.html URL - Xem header/debug:

curl -I URL,curl -v URL - Gửi POST data:

curl -d "a=1&b=2" URL - Xử lý cookie/session:

curl -c cookies.txt ...,curl -b cookies.txt ... - Đặt header/User-Agent:

curl -A "..." -H "..." URL - Theo redirect:

curl -L URL - Dùng proxy (nếu cần):

curl -x proxy:port URL - Tự động scrape nhiều trang: Dùng vòng lặp shell hoặc script.

- Parse và chuẩn hóa dữ liệu: Dùng thêm công cụ/script khi cần.

- Chuyển sang Thunderbit nếu cần dữ liệu có cấu trúc, không-code hoặc trang động.

Kết luận & điểm chính: Chọn công cụ web scraping phù hợp

Web-scraping-with-curl vẫn là một kỹ năng rất “đáng tiền” cho người dùng kỹ thuật trong 2026—đặc biệt khi cần kéo dữ liệu nhanh, dựng prototype và tự động hóa. Tốc độ, khả năng viết script và độ phổ biến của cURL khiến nó luôn có mặt trong bộ đồ nghề của dev. Nhưng khi web ngày càng động và được bảo vệ chặt hơn, đồng thời người dùng business cần dữ liệu có cấu trúc mà không phải viết code, các công cụ như đang mở ra một chuẩn mới.

Điểm cần nhớ:

- Dùng cURL cho trang tĩnh, API và prototype nhanh—nhất là khi bạn muốn toàn quyền kiểm soát.

- Chuyển sang Thunderbit (hoặc AI web scraper tương tự) khi bạn cần dữ liệu có cấu trúc, phải xử lý trang động/nặng JavaScript, hoặc muốn workflow no-code thân thiện cho business.

- Kết hợp cả hai để linh hoạt tối đa: thử nhanh bằng cURL, rồi mở rộng và chuẩn hóa bằng Thunderbit.

- Luôn scrape có trách nhiệm—tôn trọng điều khoản website, rate limit và ranh giới pháp lý.

Muốn thấy web scraping có thể đơn giản đến mức nào? để tự trải nghiệm trích xuất dữ liệu bằng AI. Nếu muốn đào sâu hơn, ghé để xem thêm hướng dẫn, mẹo và góc nhìn ngành. Bạn cũng có thể thích:

Chúc bạn scrape vui vẻ—và mong dữ liệu của bạn luôn sạch, có cấu trúc, chỉ cách một lệnh (hoặc một cú nhấp) là tới.

Câu hỏi thường gặp (FAQs)

1. cURL có xử lý được trang web render bằng JavaScript không?

Không. cURL không thể chạy JavaScript. Nó chỉ tải HTML thô do server trả về. Nếu trang cần JavaScript để render nội dung hoặc vượt thử thách chống bot, cURL sẽ không lấy được dữ liệu. Khi đó, hãy dùng công cụ dựa trên trình duyệt như .

2. Làm sao lưu output của cURL trực tiếp ra file?

Dùng cờ -o: curl -o filename.html URL. Lệnh này ghi body của response vào file thay vì in ra terminal.

3. Khác nhau giữa cURL và Thunderbit khi web scraping là gì?

cURL là công cụ dòng lệnh để lấy dữ liệu web thô—phù hợp cho người dùng kỹ thuật và automation. Thunderbit là Chrome Extension dùng AI, hướng tới người dùng business: trích xuất dữ liệu có cấu trúc từ mọi website, xử lý trang động và xuất thẳng sang Excel/Google Sheets—không cần code.

4. Scrape website bằng cURL có hợp pháp không?

Việc scrape dữ liệu công khai nhìn chung là hợp pháp ở Mỹ sau một số phán quyết gần đây, nhưng bạn vẫn nên kiểm tra điều khoản sử dụng của website, robots.txt và luật liên quan. Tránh scrape dữ liệu cá nhân hoặc dữ liệu được bảo vệ khi chưa có phép, và tôn trọng rate limit cũng như nguyên tắc đạo đức (, ).

5. Khi nào nên chuyển từ cURL sang công cụ nâng cao như Thunderbit?

Nếu bạn cần scrape trang động/nặng JavaScript, muốn dữ liệu có cấu trúc trong spreadsheet, hoặc thích workflow no-code, Thunderbit sẽ hợp hơn. Dùng cURL cho tác vụ kỹ thuật nhanh; dùng Thunderbit cho trích xuất dữ liệu lặp lại, thân thiện với business.

Để xem thêm mẹo và hướng dẫn web scraping, hãy ghé hoặc kênh .