Bạn đăng ký ScraperAPI, thấy gói Hobby có “100,000 credits”, rồi bắt đầu cào dữ liệu. Ba ngày sau, bảng điều khiển báo 80% số credit đó đã bay mất — trong khi bạn mới scrape được khoảng 6,000 trang. Chuyện gì đã xảy ra? Câu trả lời nằm ở hệ số credit, và đây cũng là điểm quan trọng nhất về ScraperAPI mà hầu như không bài review nào nói rõ. Tôi đã dành nhiều tuần để đọc kỹ tài liệu của ScraperAPI, tổng hợp dữ liệu giá thực tế từ năm nhà cung cấp khác, và xem qua từng thảo luận trên Reddit lẫn đánh giá trên Capterra mà tôi tìm được. Bài đánh giá ScraperAPI này chính là thứ tôi ước mình có được khi đội của chúng tôi bắt đầu xem xét các API scraping. Tôi sẽ phân tích cách tính credit thật sự, chỉ ra ScraperAPI mạnh ở đâu và hụt hơi ở đâu, tổng hợp phản hồi thực tế từ G2, Capterra và Reddit, và — nói thẳng luôn — giúp bạn xác định liệu bạn có thật sự cần một scraping API hay không.

ScraperAPI là gì và dành cho ai?

ScraperAPI là một web scraping API xử lý hết phần hạ tầng rắc rối phía sau việc cào dữ liệu quy mô lớn: xoay vòng proxy trên , tự động giải CAPTCHA, render JavaScript và tự động thử lại khi lỗi. Bạn chỉ cần gửi một URL qua API call đơn giản, và nó sẽ trả về HTML (hoặc JSON đã được phân tích sẵn nếu dùng các endpoint structured data). Công ty được thành lập năm 2018 bởi Daniel Ni, đặt trụ sở tại Las Vegas, và hiện phục vụ như Deloitte, Sony và Alibaba — xử lý .

Đối tượng chính là các nhóm lập trình và đội vận hành kỹ thuật đang xây dựng pipeline scraping tùy chỉnh. Nếu bạn không viết code, ScraperAPI không được thiết kế cho bạn (phần này tôi sẽ nói kỹ hơn ở dưới).

Bộ tính năng cốt lõi gồm: xoay vòng proxy, render JavaScript, geotargeting, các endpoint structured data cho những website phổ biến và tự động retry khi request thất bại.

Nhưng có một điều mà hầu hết bài review hay bỏ qua: những con số credit nổi bật trên trang giá của ScraperAPI rất dễ gây hiểu nhầm nếu bạn không nắm cách hệ số nhân hoạt động. Vì vậy, ta sẽ bắt đầu từ đó.

Hệ thống credit của ScraperAPI thực sự hoạt động thế nào? (Phần mà đa số bài review bỏ qua)

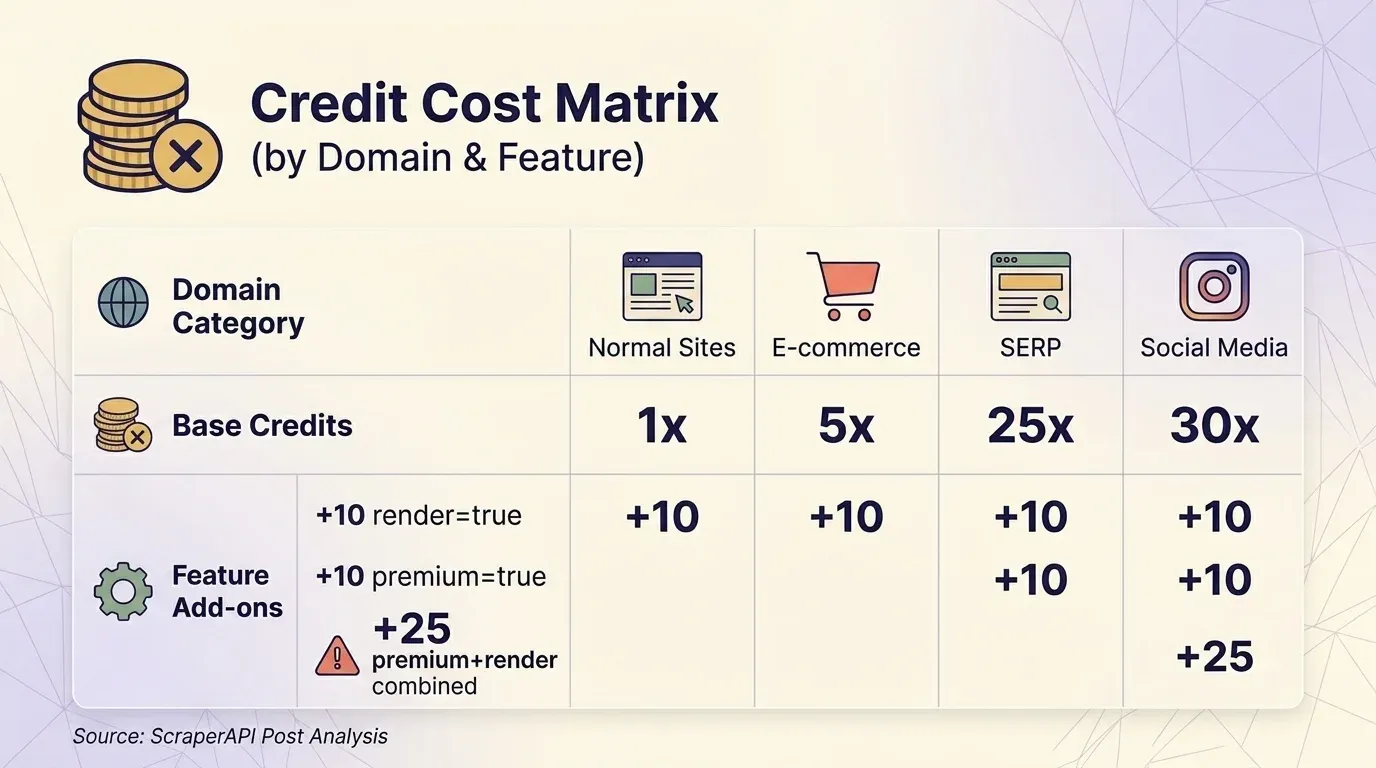

ScraperAPI tính phí theo hệ thống credit. Ý tưởng cơ bản thì đơn giản: 1 API request = 1 credit. Nhưng thực tế thì gần như không bao giờ chỉ có vậy. Chi phí credit thật phụ thuộc vào hai yếu tố: domain bạn đang scrape và các tính năng bạn bật lên. Và các chi phí này cộng dồn theo cách không hề trực quan.

Bảng hệ số credit mà mọi người dùng nên xem trước khi đăng ký

Trước khi bạn bật bất kỳ tham số nào, loại website bạn scrape đã quyết định mức credit cơ bản:

| Nhóm domain | Credit cơ bản mỗi request | Ví dụ |

|---|---|---|

| Website thông thường | 1 | Blog, trang tin, HTML đơn giản |

| Thương mại điện tử | 5 | Amazon, eBay, Walmart |

| SERP (công cụ tìm kiếm) | 25 | Google, Bing |

| Mạng xã hội | 30 |

Bên cạnh đó, các cờ tính năng sẽ cộng thêm credit:

| Tham số | Credit cộng thêm | Ghi chú |

|---|---|---|

render=true (render JS) | +10 | Tất cả gói |

screenshot=true | +10 | Tất cả gói |

premium=true (premium proxy) | +10 | Tất cả gói |

ultra_premium=true | +30 | Chỉ gói trả phí |

| Bypass anti-bot (Cloudflare, DataDome, PerimeterX) | +10 mỗi loại | Tự động phát hiện — bạn không chọn thủ công |

premium=true + render=true cùng lúc | +25 | KHÔNG phải +20 |

ultra_premium=true + render=true cùng lúc | +75 | KHÔNG phải +40 |

Dòng cuối mới là chỗ dễ sốc nhất. Việc kết hợp tính năng tốn NHIỀU credit hơn tổng các phần cộng lại. Premium proxy (+10) cộng với JavaScript rendering (+10) thì theo logic phải là +20 credit, nhưng ScraperAPI lại tính . Ultra-premium (+30) cộng với JavaScript rendering (+10) thì lẽ ra là +40, nhưng thực tế là — gần gấp đôi. Cách cộng dồn phi tuyến tính này không được giải thích nổi bật trong tài liệu, và đó là lý do chính khiến người dùng thấy credit “bốc hơi” nhanh hơn dự tính.

Các tham số không tốn thêm credit: wait_for_selector, country_code, session_number, device_type, output_format, keep_headers=true, autoparse=true.

Mỗi gói thực sự được gì: từ Free đến Enterprise

Đây là các của ScraperAPI:

| Gói | Giá hàng tháng | Giá năm (mỗi tháng) | API Credits | Luồng đồng thời | Geotargeting |

|---|---|---|---|---|---|

| Free | $0 | — | 1,000 | 5 | Không |

| Hobby | $49 | $44 | 100,000 | 20 | Chỉ US & EU |

| Startup | $149 | $134 | 1,000,000 | 50 | Chỉ US & EU |

| Business | $299 | $269 | 3,000,000 | 100 | Theo quốc gia (50+ nước) |

| Scaling | $475 | $427 | 5,000,000 | 200 | Theo quốc gia |

| Enterprise | Tùy chỉnh | Tùy chỉnh | 5,000,000+ | 200+ | Theo quốc gia |

Giờ hãy xem chi phí thực tế cho mỗi 1,000 request ở từng gói, có tính hệ số nhân:

| Gói | Tiêu chuẩn (1×) | Render JS (10×) | E-commerce (5×) | SERP (25×) | Ultra-Premium + JS (75×) |

|---|---|---|---|---|---|

| Hobby ($49) | $0.49 | $4.90 | $2.45 | $12.25 | $36.75 |

| Startup ($149) | $0.15 | $1.49 | $0.75 | $3.73 | $11.18 |

| Business ($299) | $0.10 | $1.00 | $0.50 | $2.49 | $7.48 |

| Scaling ($475) | $0.10 | $0.95 | $0.48 | $2.38 | $7.13 |

Một gói $49/tháng được quảng cáo là có “100,000 credits” nhưng chỉ tạo ra 1,333 request thực khi bạn scrape các trang được bảo vệ bằng ultra-premium kết hợp JavaScript rendering. Điều đó tương đương — còn đắt hơn nhiều dịch vụ scraping được quản lý hoàn toàn.

Vì sao credit biến mất nhanh hơn bạn nghĩ

Có ba điều thường khiến người dùng bất ngờ.

Thứ nhất: giá theo domain được áp dụng tự động. Bạn không phải tự chọn hệ số 5× cho Amazon hay 25× cho Google. Nó được áp dụng ngay khi ScraperAPI phát hiện domain. Tương tự, credit bypass anti-bot (+10 cho Cloudflare, DataDome, PerimeterX) cũng sẽ tự động cộng thêm khi phát hiện.

Thứ hai: credit KHÔNG được cộng dồn sang kỳ sau. Credit chưa dùng sẽ . Không tích lũy.

Và thứ ba — điểm này khá “đau” — Pay-As-You-Go chỉ có ở gói Scaling ($475/tháng) trở lên. Nếu bạn ở Hobby, Startup hoặc Business và hết credit giữa kỳ, bạn sẽ bị ngắt dịch vụ cho đến kỳ thanh toán tiếp theo. Cách duy nhất là nâng cấp lên gói cao hơn.

Một người dùng trên Reddit cho biết họ được báo giá $3,600 cho 60 triệu credit với mức 1 credit mỗi request Amazon, nhưng sau khi thanh toán, hệ số 5 credit lại bị áp dụng mà không được nói trước. Gói 60M của họ thực tế chỉ còn tương đương 12M request — thiếu .

Bẫy credit của DataPipeline

Tính năng DataPipeline không cần code của ScraperAPI (scrape theo lịch và đẩy qua webhook) dùng một bảng credit riêng, cao hơn đáng kể. Một request cơ bản với website thường tốn trên API tiêu chuẩn:

| Loại request | API tiêu chuẩn | DataPipeline | Tỷ lệ |

|---|---|---|---|

| Request cơ bản cho website thường | 1 | 6 | 6× |

| E-commerce cơ bản | 5 | 10 | 2× |

| SERP cơ bản | 25 | 30 | 1.2× |

| Ultra-premium + JS (normal) | 75 | 80 | 1.07× |

Người dùng thiết lập pipeline no-code với kỳ vọng chi phí credit tiêu chuẩn thường phát hiện rằng họ đang đốt credit gấp 6 lần cho các request cơ bản. Điều này có được ghi trong tài liệu, nhưng bạn phải tìm khá sâu mới thấy.

Chi phí thực trên mỗi request: ScraperAPI so với đối thủ

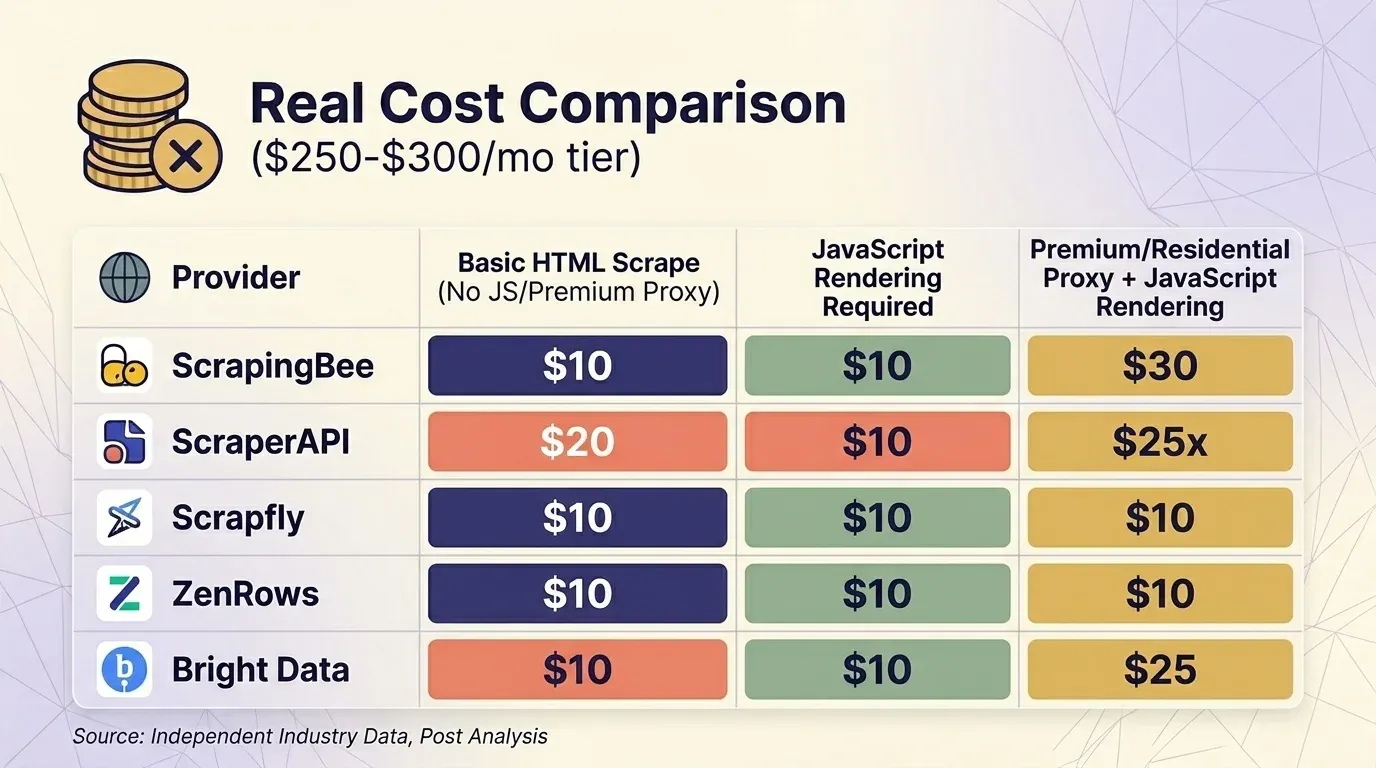

Giá niêm yết không có ý nghĩa nếu không tính hệ số nhân. Tôi đã lấy giá hiện tại của năm nhà cung cấp và chuẩn hóa phép so sánh ở mốc khoảng $300/tháng trong ba kịch bản phổ biến.

Cào HTML cơ bản (không JS, không premium proxy)

| Nhà cung cấp | Gói | Credit mỗi request | Số request thực | Chi phí/1K |

|---|---|---|---|---|

| ScrapingBee | Business $249 | 1 | 3,000,000 | $0.08 |

| ScraperAPI | Business $299 | 1 | 3,000,000 | $0.10 |

| Scrapfly | Startup $250 | 1 | 2,500,000 | $0.10 |

| ZenRows | Business $300 | $0.28/1K | ~1,071,000 | $0.28 |

| Bright Data | PAYG | $1.50/1K | ~200,000 | $1.50 |

Cần render JavaScript

| Nhà cung cấp | Gói | Credit mỗi request | Số request thực | Chi phí/1K |

|---|---|---|---|---|

| ScrapingBee | Business $249 | 5 (mặc định bật) | 600,000 | $0.42 |

| Scrapfly | Startup $250 | 6 | 416,667 | $0.60 |

| ScraperAPI | Business $299 | 10 | 300,000 | $1.00 |

| ZenRows | Business $300 | 5× | ~214,000 | $1.40 |

| Bright Data | PAYG | cố định | ~200,000 | $1.50 |

Premium/residential proxy + render JavaScript (site được bảo vệ)

| Nhà cung cấp | Gói | Credit mỗi request | Số request thực | Chi phí/1K |

|---|---|---|---|---|

| Bright Data | PAYG | cố định | ~200,000 | $1.50 |

| ScrapingBee | Business $249 | 25 | 120,000 | $2.08 |

| ScraperAPI | Business $299 | 25 | 120,000 | $2.49 |

| Scrapfly | Startup $250 | 31 | 80,645 | $3.10 |

| ZenRows | Business $300 | 25× | ~42,857 | $7.00 |

Bright Data Web Unlocker là nhà cung cấp duy nhất — mọi request đều có cùng mức giá cố định. Ở phân khúc khoảng $300, ScrapingBee và ScraperAPI khá cạnh tranh cho việc scrape các site được bảo vệ, trong khi ZenRows là đắt nhất.

Một lưu ý quan trọng về hành vi mặc định: ScrapingBee với chi phí 5×. Nếu bạn so sánh ScrapingBee và ScraperAPI trực tiếp, hãy chắc chắn bạn đang so sánh cùng cấu hình render.

Một phân tích độc lập từ Scrape.do cho thấy ScraperAPI có chi phí trung bình — “cao hơn mọi nhà cung cấp khác được thử nghiệm” — với thời gian phản hồi trung bình , khiến nó trở thành “một trong những nhà cung cấp chậm nhất hiện có.” Đây là điều đáng biết trước khi bạn quyết định gắn bó lâu dài.

Tỷ lệ thành công theo từng website: ScraperAPI mạnh ở đâu và yếu ở đâu

Không có scraping API nào hoạt động tốt như nhau trên mọi website. Các benchmark độc lập từ Scrapeway (tháng 4/2026) cho thấy một bức tranh phân cực khá rõ.

Hiệu năng theo nhóm site

| Website mục tiêu | Tỷ lệ thành công | Tốc độ trung bình | Chi phí/1K (gói Business) |

|---|---|---|---|

| Zillow | 100% | 10.5s | $0.49 |

| Etsy | 99% | 4.8s | $4.90 |

| Amazon | 98% | 6.5s | $2.45 |

| 95% | 17.8s | $14.70 | |

| Walmart | 93% | 11.4s | $2.45 |

| Indeed | 90% | 15.8s | $4.90 |

| StockX | 84% | 3.9s | $4.90 |

| Realtor.com | 12% | 11.8s | $0.49 |

| 0% | — | — | |

| Booking.com | 0% | — | — |

| Twitter/X | 0% | — | — |

Tỷ lệ thành công trung bình toàn bộ: , nhỉnh hơn một chút so với mức trung bình ngành 58.2–59.5%. Tốc độ phản hồi trung bình: 5.2–7.3 giây, tốt hơn mức trung bình ngành là 9.8 giây.

ScraperAPI mạnh ở đâu

ScraperAPI thực sự rất mạnh ở thương mại điện tử (Amazon, Walmart, Etsy) và bất động sản (Zillow). Các endpoint structured data cho những site này trả JSON đã parse với độ tin cậy cao. Nếu mục tiêu chính của bạn là scrape trang sản phẩm Amazon hoặc Google SERP, ScraperAPI là một lựa chọn hợp lý.

ScraperAPI yếu ở đâu

Mạng xã hội gần như là vùng chết. Instagram, Twitter/X và Booking.com đều có tỷ lệ thành công 0% trong các bài kiểm thử độc lập. LinkedIn hoạt động ở mức 95%, nhưng với 30 credit mỗi request thì chi phí rất cao.

Các site yêu cầu đăng nhập bị loại trừ rõ ràng. ScraperAPI có hỗ trợ giữ session bằng tham số session_number, nhưng nó . Nó không xử lý được điền form, xác thực hai lớp hay các luồng xác thực phức tạp.

Dữ liệu lỗi thời trên các target khó. ScraperAPI áp dụng , nghĩa là nếu bạn scrape dữ liệu nhạy thời gian như giá hoặc tồn kho, kết quả có thể chậm hơn thực tế tới 10 phút.

Trong benchmark 2025 của Proxyway, ScraperAPI có ở mức 81.72%.

Tóm tắt hiệu năng theo nhóm site

| Nhóm site | Hiệu năng ScraperAPI | Vấn đề đã biết | Giải pháp thay thế tiềm năng |

|---|---|---|---|

| Amazon / e-commerce | ✅ Mạnh (endpoint SDE) | Tốn credit khi scale lớn | Thunderbit templates (1 click, template không tính credit theo từng dòng) |

| Google SERPs | ✅ Mạnh | Geotargeting tốn thêm; tỷ lệ thành công Google thấp nhất trong một benchmark | — |

| Bất động sản (Zillow) | ✅ Rất tốt (100%) | — | — |

| Instagram / mạng xã hội | ❌ 0% thành công | Thất bại hoàn toàn | Playwright + proxy (tự làm) |

| SPA nặng JS | ⚠️ Trung bình | Cần render headless tốn 10× credit | Scrapfly, ZenRows |

| Site yêu cầu đăng nhập | ❌ Bị cấm theo ToS | Không hỗ trợ session/xác thực | Thunderbit browser scraping (dùng session đăng nhập của bạn) |

| Booking.com / du lịch | ❌ 0% thành công | Thất bại hoàn toàn | Bright Data |

Người dùng thực nói gì: tổng hợp cảm nhận từ G2, Capterra và Reddit

Tôi đã tổng hợp phản hồi từ ba nền tảng. Đây là các điểm xếp hạng hiện tại:

| Nền tảng | Đánh giá | Số review |

|---|---|---|

| G2 | 4.4/5 | 16 |

| Capterra | 4.6/5 | 62 |

| Trustpilot | 4.5/5 | 43 |

Điểm phụ trên Capterra: Dễ sử dụng 4.9/5, Dịch vụ khách hàng 4.6/5, Tính năng 4.5/5, Giá trị so với chi phí 4.5/5.

Tóm tắt cảm nhận theo chủ đề

| Chủ đề | Tín hiệu tích cực | Tín hiệu tiêu cực |

|---|---|---|

| Thiết lập / tài liệu | “Rất dễ để bắt đầu. Bạn có thể scrape trong vài phút.” — Latenode community; Capterra Ease of Use 4.9/5 | — |

| Tính minh bạch về giá | “Gói khởi điểm khá phải chăng” (nhiều review trên Capterra) | “Cách phân bổ chi phí credit có thể gây khó hiểu” — John S., Founder, Capterra (tháng 2/2025); “Giá tăng 1000% và chất lượng giảm” — CTO, Online Media, Capterra (tháng 9/2022) |

| Độ tin cậy | “Hoạt động rất tốt với Amazon/Google” (G2, Capterra) | “ScraperAPI trở nên thiếu ổn định với các job nặng” — emcarter, Latenode; “Tỷ lệ lỗi 80% trên một số target” (Reddit) |

| Hỗ trợ khách hàng | “Đội ngũ phản hồi nhanh” (Capterra) | Có người dùng báo cáo bị báo một giá nhưng lại bị tính phí ở mức gấp 5 lần mà không được thông báo trước (Reddit) |

| Giá trị theo thời gian | Chỉ tính phí cho request thành công (200/404) | “Nếu bạn vận hành quy mô lớn, chi phí có thể tăng rất nhanh” và tự xây hạ tầng có thể “hiệu quả hơn về lâu dài” — mikezhang, Latenode |

Kết luận: ScraperAPI được đánh giá tốt nhờ dễ thiết lập ban đầu và vận hành ổn trên các target phổ biến, lại có hỗ trợ khách hàng khá ổn. Phàn nàn chủ yếu tập trung vào cú sốc giá (hệ số nhân, mức tăng bất ngờ) và độ ổn định trên các target khó.

Các endpoint structured data của ScraperAPI: có đáng để trả credit premium không?

ScraperAPI cung cấp trên 5 nền tảng, trả về JSON đã phân tích thay vì HTML thô:

- Amazon (3 endpoint): Chi tiết sản phẩm theo ASIN, kết quả tìm kiếm, ưu đãi từ đối thủ. Trả về hơn 18 trường gồm giá, rating, mô tả, review, BSR, hình ảnh, thông tin người bán. Hỗ trợ .

- Google (5 endpoint): (kết quả tự nhiên, knowledge graph, video, câu hỏi liên quan, phân trang), Shopping, Maps, News, Jobs.

- Walmart (4 endpoint): Sản phẩm, tìm kiếm, danh mục, đánh giá.

- eBay (2 endpoint): Sản phẩm, tìm kiếm.

- Redfin (4 endpoint): Tìm kiếm, thông tin agent, bất động sản cho thuê, bất động sản bán.

SDE có trên mọi gói, kể cả Free. ScraperAPI quảng bá cho các domain SDE được hỗ trợ — dù các benchmark độc lập cho thấy bức tranh tinh tế hơn tùy website.

Mức độ đầy đủ dữ liệu

Amazon SDP là sản phẩm mạnh nhất của ScraperAPI. Nó trả về bộ trường rất toàn diện: giá, review, BSR, biến thể, hình ảnh, thông tin người bán, v.v. Google SERP SDP trả về kết quả tự nhiên, quảng cáo, featured snippets và People Also Ask. Độ đầy đủ dữ liệu thực sự rất tốt cho hai nền tảng này.

Hiệu quả credit: SDP so với tự parse

Ở gói Business ($299/tháng, 3M credit), scrape 10,000 sản phẩm Amazon qua SDE sẽ tốn 50,000 credit (5 credit mỗi sản phẩm) — khoảng $5 giá trị của gói. Tự xây parser bằng request tiêu chuẩn (1 credit mỗi request) chỉ tốn 10,000 credit, nhưng bạn sẽ phải đầu tư thời gian phát triển và bảo trì parser.

Với nhóm nhỏ không có developer, SDE giúp tiết kiệm rất nhiều thời gian.

Với nhóm có năng lực kỹ thuật và scrape ở quy mô lớn, mức premium 5× credit rất khó biện minh.

SDP so với các scraper template no-code

So sánh này quan trọng hơn nhiều bài review thừa nhận. cung cấp các scraper template tức thì cho Amazon, Shopify, Zillow và , không cần code và không tính credit theo từng dòng cho chính template đó.

| Yếu tố | ScraperAPI SDP (Amazon) | Thunderbit Amazon Template |

|---|---|---|

| Thời gian thiết lập | 30–60 phút (code + tích hợp API) | ~2 phút (cài extension, mở Amazon, bấm template) |

| Chi phí mỗi 1,000 sản phẩm (gói Business) | ~$5 (50,000 credit ở mức $0.10/credit) | ~$16.50 (1,000 dòng × 1 credit ở mức $0.0165/credit trên Pro) |

| Trường dữ liệu trả về | 18+ (rất đầy đủ) | Tên sản phẩm, giá, rating, review, hình ảnh, URL, và hơn nữa |

| Tùy chọn xuất | JSON (cần code để parse) | Excel, CSV, Google Sheets, Airtable, Notion — 1 click |

| Bảo trì | ScraperAPI duy trì SDP | Đội ngũ Thunderbit duy trì template |

| Kỹ năng kỹ thuật | Cần Python/Node.js | Không cần |

Với các đội dev scrape Amazon khối lượng lớn, SDP của ScraperAPI tiết kiệm hơn trên mỗi sản phẩm ở quy mô lớn. Với người dùng doanh nghiệp cần dữ liệu Amazon trong bảng tính mà không muốn viết code, Thunderbit nhanh để triển khai và dùng hơn rất nhiều.

Bạn có thật sự cần một scraping API không? Lối đi no-code mà nhiều bài review bỏ qua

Rất nhiều người tìm kiếm “Scraper API review” vẫn chưa quyết định dùng workflow dựa trên API. Họ đang tìm hiểu xem mình có cần nó hay không.

Bất ngờ là khá nhiều người không cần. Thị trường web scraping API là một ngành với tốc độ tăng trưởng kép 14–18%, nhưng tăng trưởng đó chủ yếu đến từ các đội kỹ thuật doanh nghiệp — chứ không phải người quản lý sales ops chỉ cần 500 lead từ một website.

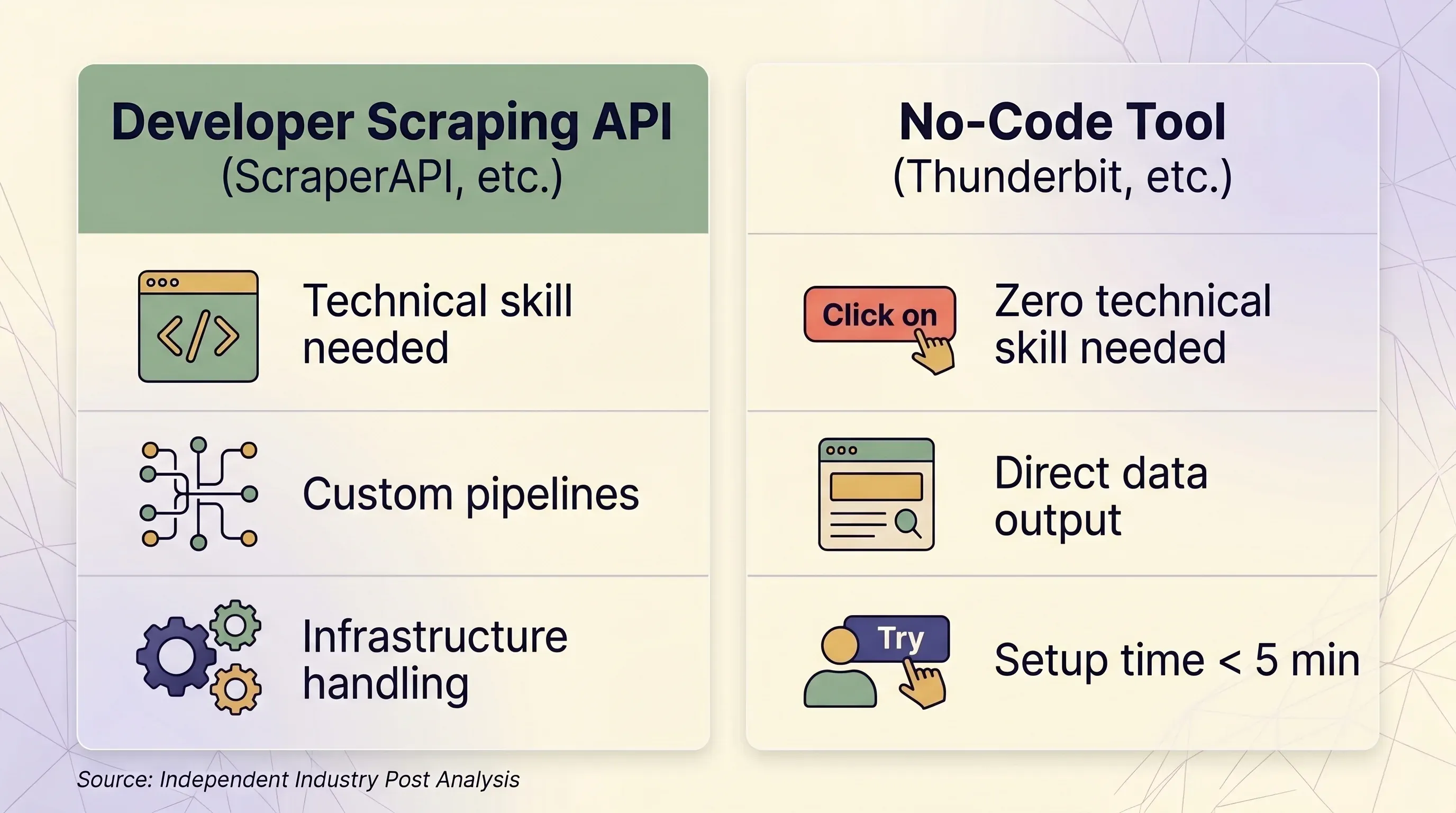

API scraping vs. công cụ no-code: khung quyết định song song

| Yếu tố | Scraping API (ScraperAPI, v.v.) | Công cụ no-code (Thunderbit, v.v.) |

|---|---|---|

| Phù hợp nhất cho | Developer xây pipeline dữ liệu quy mô lớn | Người kinh doanh, marketer, sales team, nhà nghiên cứu |

| Kỹ năng cần có | Python/Node.js, khái niệm HTTP, parse JSON | Không cần — thao tác trực tiếp trên trình duyệt |

| Thời gian thiết lập | Tối thiểu 1–2 giờ (code + test + debug) | Dưới 5 phút |

| Xử lý anti-bot | Premium proxy (10–75 credit/request) | Phiên trình duyệt thật — tự nhiên vượt qua fingerprinting |

| Site cần đăng nhập | ❌ Bị cấm theo ToS của ScraperAPI | ✅ Browser Scraping dùng session đang đăng nhập của bạn |

| Quy mô (trang/ngày) | 100K–3M+ request/tháng | Theo nhu cầu, thường dưới 1,000 trang/ngày |

| Đầu ra dữ liệu | HTML thô hoặc JSON (cần code để parse) | Dạng hàng/cột có cấu trúc — dùng ngay |

| Xuất dữ liệu | JSON, CSV (qua code) | Excel, CSV, Google Sheets, Airtable, Notion, Word, JSON |

| Bảo trì | Phải cập nhật selector, retry logic, hạ tầng | Không cần — AI đọc lại cấu trúc trang mỗi lần |

| Đơn vị tính giá | Credit theo request (dao động: 1–75 credit/request) | Credit theo dòng (1 credit = 1 dòng, 2 cho subpage) |

| Giá khởi điểm | $49/tháng cho 100K credit | $9/tháng cho 5,000 credit (năm) |

| Gói miễn phí | 1,000 credit/tháng, 5 concurrent | 6 trang/tháng, 30 credit/trang |

| Tính dự đoán chi phí | Thấp — hệ số nhân tạo ra chi phí bất ngờ | Cao — 1 dòng luôn = 1 credit |

Khi nào scraping API là hợp lý

- Bạn có developer hoặc team kỹ thuật

- Bạn cần scrape 100K+ trang mỗi ngày bằng chương trình

- Bạn cần tùy biến sâu request header, session và retry logic

- Mục tiêu của bạn là các site được hỗ trợ tốt (Amazon, Google, Walmart, Zillow)

Khi nào công cụ no-code như Thunderbit hợp lý hơn

- Bạn làm sales, e-commerce ops, marketing hoặc bất động sản — không phải engineering

- Bạn cần dữ liệu từ hàng chục website khác nhau mà không muốn viết parser riêng cho từng site

- Bạn muốn xuất thẳng ra Excel, Google Sheets, Airtable hoặc Notion

- Bạn cần scrape các site yêu cầu đăng nhập (browser scraping của dùng session của bạn)

- Bạn muốn AI đọc lại trang từ đầu mỗi lần — không phải bảo trì code khi layout website thay đổi

- Bạn cần scrape subpage: Thunderbit có thể vào từng trang chi tiết và bổ sung dữ liệu cho từng dòng tự động

Quy trình của thực sự rất đơn giản: cài extension, mở bất kỳ trang nào, bấm “AI Suggest Fields”, bấm “Scrape”, rồi xuất dữ liệu. AI sẽ tự nhận diện dữ liệu trên trang và gợi ý cột — bạn không cần viết selector hay code. Muốn hiểu sâu hơn, hãy xem .

đã gặp vượt ngân sách cloud trong năm 2024, và các công ty dùng mô hình tính phí theo mức sử dụng mà thiếu kiểm soát thường có vì cú sốc hóa đơn. Mức độ dự đoán chi phí của mô hình credit theo dòng rất đáng cân nhắc nếu trước đây bạn từng bị “đau ví” vì chi phí API biến động.

Ưu và nhược điểm của ScraperAPI nhìn nhanh

| Ưu điểm | Nhược điểm |

|---|---|

| Hạ tầng proxy mạnh (40M+ IP, 50+ quốc gia) | Hệ thống hệ số credit khó hiểu — kết hợp tính năng tốn nhiều hơn tổng cộng |

| Tài liệu tốt và dễ bắt đầu (Capterra Ease of Use: 4.9/5) | Credit KHÔNG được cộng dồn sang tháng sau |

| Ổn định trên Amazon, Google, Zillow, Etsy | 0% thành công trên Instagram, Twitter/X, Booking.com |

| Chỉ tính phí cho request thành công (200/404) | Response 404 vẫn bị trừ credit |

| 18 endpoint structured data với JSON đã parse | Site cần đăng nhập bị cấm rõ ràng |

| Có trên mọi gói kể cả Free | Pay-As-You-Go chỉ có ở Scaling ($475/tháng) trở lên |

| Chính sách hoàn tiền 7 ngày không cần hỏi lý do | Bị ép cache 10 phút trên target khó — nguy cơ dữ liệu cũ |

| Doanh thu tăng 30–35% YoY cho thấy sản phẩm vẫn được phát triển | DataPipeline có thể tốn đến 6× credit so với API tiêu chuẩn |

| — | Geotargeting ngoài US & EU cần gói Business ($299/tháng) |

| — | Không có cảnh báo mức dùng chủ động — phải tự kiểm tra dashboard |

Mẹo thực tế để tận dụng ScraperAPI tốt hơn nếu bạn quyết định dùng

Theo dõi mức tiêu thụ credit hằng ngày

Bảng điều khiển của ScraperAPI cung cấp thống kê sử dụng gồm độ trễ trung bình, domain đã scrape và chỉ số concurrency. Tuy nhiên, không có cảnh báo chủ động về mức dùng — không email hay SMS khi credit sắp hết. Bạn phải tự kiểm tra. Lịch sử phân tích chỉ lưu 2 tuần ở gói Hobby/Startup và 6 tháng ở Business trở lên.

Hãy đặt nhắc lịch để kiểm tra dashboard mỗi ngày trong tháng đầu tiên. Bạn cần hình thành trực giác về tốc độ tiêu credit trên các target cụ thể của mình.

Bắt đầu bằng gói Free để thử các target của bạn

Hãy dùng 1,000 credit miễn phí (cộng thêm bản trial 7 ngày với 5,000 credit) để kiểm tra tỷ lệ thành công trên các site mục tiêu trước khi trả tiền. Ghi lại site nào cần JavaScript rendering hoặc premium proxy để ước tính chi phí hàng tháng sát thực tế hơn sau khi áp dụng hệ số nhân.

Tắt các tính năng premium nếu target không cần

ScraperAPI KHÔNG tự bật premium proxy hay JavaScript rendering — bạn phải tự set render=true, premium=true hoặc ultra_premium=true. Nhưng giá theo domain THÌ được áp dụng tự động: Amazon luôn tốn 5 credit, Google luôn tốn 25, LinkedIn luôn tốn 30. Credit bypass anti-bot (+10 cho Cloudflare, DataDome, PerimeterX) cũng sẽ tự động cộng khi phát hiện. Hãy nắm rõ điều này trước khi chạy batch.

Dùng endpoint structured data cho các site được hỗ trợ

Nếu bạn scrape Amazon hoặc Google, SDE giúp tiết kiệm thời gian phát triển dù tốn nhiều credit hơn. Với site không được hỗ trợ, hãy cân nhắc xem một có nhanh và rẻ hơn việc tự xây parser hay không.

Luôn có phương án dự phòng cho các target kém ổn định

Nếu tỷ lệ thành công của ScraperAPI trên một site cụ thể dưới 90%, hãy cân nhắc chuyển request đó sang nhà cung cấp khác hoặc dùng công cụ dựa trên trình duyệt. Với các site cần đăng nhập, ScraperAPI đơn giản là không làm được — bạn sẽ cần một công cụ như hoạt động ngay trong session trình duyệt của bạn.

Biết trước các điểm cần lưu ý

- Response 404 vẫn tốn credit — ScraperAPI tính phí cho cả status code 200 và 404

- Request bị hủy vẫn bị tính phí nếu bạn hủy trước khi cửa sổ xử lý 70 giây kết thúc

- Cache bắt buộc 10 phút trên target khó — có thể nhận dữ liệu cũ

- Pay-As-You-Go chỉ có ở Scaling ($475/tháng) trở lên — người dùng gói thấp hơn khi hết credit sẽ bị ngắt

- Geotargeting ngoài US & EU cần gói Business ($299/tháng)

Kết luận chính: ScraperAPI có phải công cụ phù hợp với bạn không?

Sau toàn bộ quá trình nghiên cứu, đây là kết luận của tôi:

- ScraperAPI là lựa chọn tốt cho đội dev đang scrape khối lượng lớn trên các target được hỗ trợ tốt như Amazon, Google, Walmart và Zillow. Các endpoint structured data thực sự hữu ích, hạ tầng proxy rất lớn, và tài liệu ở mức trên trung bình.

- Hệ thống hệ số credit là rủi ro lớn nhất. Nếu bạn không hiểu cách các hệ số cộng dồn, bạn sẽ chi tiêu vượt mức. Khoảng cách giữa credit quảng cáo và số request thực có thể là 5–75×. Hãy tính kỹ cho đúng use case của bạn trước khi chốt gói trả phí.

- Độ ổn định phụ thuộc vào từng website. ScraperAPI rất mạnh với e-commerce và bất động sản, trung bình với job board và mạng xã hội, và hoàn toàn vô dụng trên Instagram, Twitter/X, Booking.com. Đừng mặc định rằng hiệu năng sẽ đồng đều.

- Với team không chuyên kỹ thuật, ScraperAPI là công cụ không phù hợp. Nếu bạn làm sales, marketing hoặc vận hành và cần dữ liệu có cấu trúc mà không muốn viết code, một công cụ no-code như sẽ đưa bạn tới đích chỉ với hai cú click — kèm nhận diện trường bằng AI, xuất thẳng sang bảng tính, bổ sung dữ liệu từ subpage và không phải tốn công bảo trì. Xem hoặc xem video hướng dẫn trên .

- Với developer có ngân sách hạn chế, hãy thử gói free của ScraperAPI trên chính target của bạn, rồi so sánh chi phí thực trên mỗi request với ScrapingBee, Scrapfly và Bright Data trước khi chọn. Lựa chọn rẻ nhất phụ thuộc hoàn toàn vào use case và yêu cầu tính năng của bạn.

Bạn muốn biết con số cụ thể cho nhu cầu scrape của mình? Hãy bắt đầu với gói miễn phí của ScraperAPI để test các site mục tiêu, hoặc để xem hai cú click có thể đưa bạn đi xa đến đâu. Muốn xem thêm về , hãy xem các gói của chúng tôi.

Câu hỏi thường gặp

ScraperAPI có miễn phí không?

Có, ScraperAPI có gói free với và bản dùng thử 7 ngày với 5,000 credit. Tuy nhiên, các hệ số credit cho JavaScript rendering, premium proxy hoặc các domain chi phí cao (Amazon = 5×, Google = 25×, LinkedIn = 30×) có thể khiến năng lực thực tế thấp hơn rất nhiều so với 1,000 request. Ở gói free, ultra-premium proxy không khả dụng.

ScraperAPI tính phí bao nhiêu cho mỗi request?

Điều này phụ thuộc rất lớn vào cờ tính năng và domain mục tiêu. Một request tiêu chuẩn tới site HTML đơn giản tốn 1 credit. Request Amazon tốn 5 credit. Request Google SERP tốn 25 credit. Bật JavaScript rendering sẽ cộng thêm 10 credit. Kết hợp ultra-premium proxy với JavaScript rendering sẽ tốn 75 credit mỗi request. Ở gói Hobby ($49/tháng, 100K credit), chi phí dao động từ $0.00049 mỗi request (tiêu chuẩn) đến $0.0368 mỗi request (ultra-premium + JS). Xem các bảng chi phí ở trên để biết chi tiết.

ScraperAPI có tốt để scrape Amazon không?

Endpoint Amazon Structured Data của ScraperAPI là một trong những tính năng mạnh nhất của họ, với trong các benchmark độc lập và đầu ra JSON đã parse rất đầy đủ (hơn 18 trường). Tuy nhiên, mỗi request Amazon tối thiểu tốn 5 credit, nên chi phí tăng nhanh khi scale lớn. Với nhóm nhỏ muốn có dữ liệu Amazon trong bảng tính mà không cần code, là một lựa chọn 1 click với khả năng xuất trực tiếp.

Những lựa chọn thay thế tốt nhất cho ScraperAPI là gì?

Với developer: (rẻ nhất cho HTML cơ bản), (tốt cho JavaScript rendering), (tốt nhất cho site được bảo vệ — giá cố định bất kể render), và . Với người dùng không chuyên kỹ thuật: — tiện ích Chrome no-code, dùng AI, xuất thẳng sang Excel, Google Sheets, Airtable và Notion. Xem thêm để hiểu sâu hơn.

ScraperAPI có scrape được site yêu cầu đăng nhập không?

ScraperAPI hỗ trợ giữ session qua tham số session_number (cùng IP trong nhiều request), nhưng nó . Nó không xử lý được điền form, xác thực hai lớp hoặc các luồng auth phức tạp. Với site cần đăng nhập, các công cụ dựa trên trình duyệt như — dùng session trình duyệt hiện có của bạn để scrape những gì bạn nhìn thấy — là lựa chọn đáng tin cậy hơn.

Tìm hiểu thêm