Nếu bạn từng thử xây dựng danh sách lead B2B, phân tích đối thủ, hoặc đơn giản là giữ CRM luôn cập nhật, bạn sẽ hiểu vì sao LinkedIn là một mỏ vàng dữ liệu. Nhưng nói thật nhé—copy thủ công thông tin hồ sơ thì chán chẳng khác gì nhìn sơn khô, còn các công cụ sẵn có của LinkedIn thường cũng không cho bạn đúng thứ dữ liệu bạn cần. Đó là lý do đến năm 2026, ngày càng nhiều đội sales và vận hành tìm cách scrape LinkedIn bằng Python—biến hàng giờ click chuột tẻ nhạt thành vài dòng code và một file bảng tính đầy triển vọng kinh doanh.

Nhưng có một sự thật cần nhớ: LinkedIn giờ giống như Fort Knox của dữ liệu doanh nghiệp. Với hơn 1,3 tỷ thành viên và 310 triệu người dùng hoạt động hàng tháng (), đây là nguồn số 1 để tìm B2B leads—đồng thời cũng là nền tảng phòng thủ chống bot và scraper mạnh nhất. Trên thực tế, chỉ riêng năm 2025, LinkedIn đã hạn chế hơn 30 triệu tài khoản vì scraping hoặc tự động hóa (). Vậy làm sao để trích xuất dữ liệu LinkedIn bằng Python trong năm 2026—mà không bị đưa tài khoản vào “trại lưu đày kỹ thuật số”? Hãy cùng đi từng bước, từ khâu chuẩn bị đến scraping an toàn, làm sạch dữ liệu, và cách những công cụ như Thunderbit có thể tăng tốc toàn bộ quy trình của bạn.

Scrape LinkedIn bằng Python nghĩa là gì?

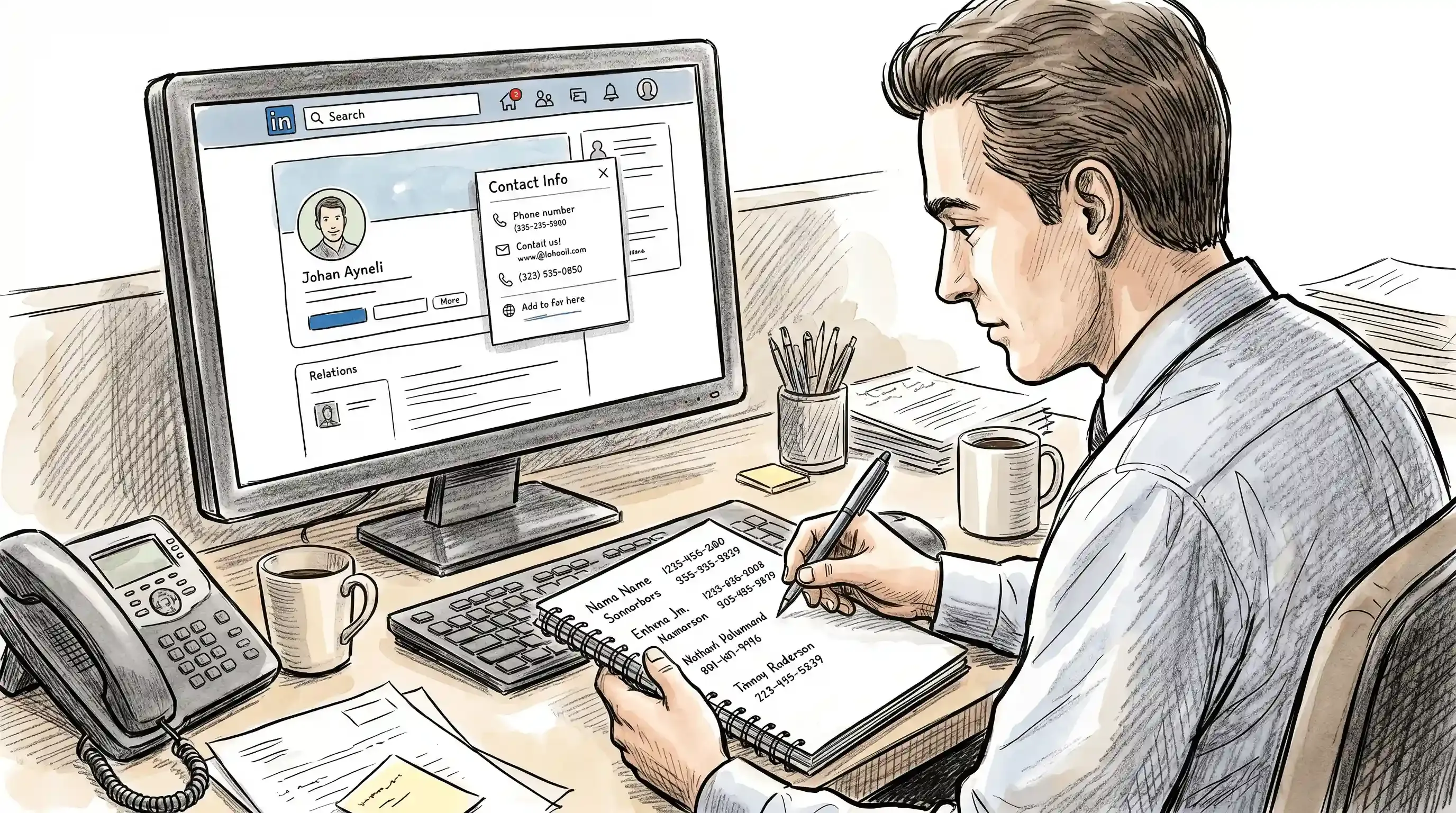

Khi nói đến scrape LinkedIn bằng Python, thực chất là dùng script và thư viện Python để tự động thu thập dữ liệu từ các trang web của LinkedIn. Thay vì phải copy rồi dán từng cái tên, chức danh hay thông tin công ty, bạn viết một script để làm phần nặng nhọc—ghé thăm hồ sơ, lấy các trường dữ liệu cần thiết và lưu lại dưới dạng có cấu trúc.

Thu thập dữ liệu thủ công giống như nhặt táo từng quả một. Trích xuất dữ liệu LinkedIn bằng Python thì giống như rung cả cây rồi hứng táo vào giỏ. Các từ khóa chính như linkedin data extraction python, python linkedin scraper và automate linkedin scraping đều nói về cùng một ý: dùng code để gom dữ liệu LinkedIn ở quy mô lớn, nhanh hơn và (hy vọng là) an toàn hơn bất kỳ người nào có thể làm.

Các tình huống kinh doanh thường dùng LinkedIn scraping:

- Xây dựng danh sách lead mục tiêu cho đội sales outreach

- Làm giàu dữ liệu CRM với chức danh và công ty mới nhất

- Theo dõi xu hướng tuyển dụng hoặc biến động lãnh đạo của đối thủ

- Lập bản đồ mạng lưới ngành để nghiên cứu thị trường

- Tổng hợp bài đăng công ty hoặc tin tuyển dụng để phân tích

Tóm lại, nếu bạn cần dữ liệu LinkedIn có cấu trúc và không muốn dành cả cuối tuần để bấm “Connect”, thì Python chính là người bạn tốt nhất của bạn.

Vì sao nên tự động hóa scraping LinkedIn? Các trường hợp sử dụng trong kinh doanh

Nói thẳng nhé: LinkedIn không chỉ là một mạng xã hội—nó là xương sống của bán hàng và marketing B2B hiện đại. Đây là lý do các đội ngũ đang cực kỳ quan tâm đến việc tự động hóa LinkedIn scraping trong năm 2026:

- Tạo lead: và 62% nói rằng nền tảng này thực sự mang lại lead. LinkedIn tạo ra nhiều lead hơn 277% so với Facebook và Twitter cộng lại.

- Nghiên cứu thị trường và đối thủ: LinkedIn là nơi hiếm hoi bạn có thể xem org chart, xu hướng tuyển dụng và tin tức công ty theo thời gian thực ở quy mô lớn.

- Làm giàu CRM: Nếu không tự động hóa, việc giữ CRM luôn mới là một cơn ác mộng. Scrape LinkedIn giúp bạn cập nhật chức danh, công ty và thông tin liên hệ hàng loạt.

- Phân tích nội dung và sự kiện: Bạn muốn biết ai đang đăng bài, phát biểu hoặc tuyển dụng trong ngách của mình? LinkedIn scraping sẽ cung cấp dữ liệu đó.

Dưới đây là bảng nhanh về các trường hợp sử dụng phổ biến nhất:

| Nhóm | Trường hợp sử dụng | Giá trị mang lại |

|---|---|---|

| Sales | Xây dựng danh sách lead, chuẩn bị outreach | Nhiều cuộc hẹn hơn, tỷ lệ chuyển đổi cao hơn |

| Marketing | Nghiên cứu đối tượng, chọn lọc nội dung | Nhắm mục tiêu tốt hơn, mức độ tương tác cao hơn |

| Vận hành | Làm giàu CRM, lập bản đồ tổ chức | Dữ liệu sạch hơn, giảm nhập liệu thủ công |

| Tuyển dụng | Tìm nguồn ứng viên, theo dõi đối thủ | Tuyển nhanh hơn, pipeline thông minh hơn |

Còn ROI thì sao? Các đội dùng tự động hóa bằng AI cho prospecting báo cáo tiết kiệm 2–3 giờ mỗi ngày (), và những công ty như TripMaster từng ghi nhận ROI 650% từ lead gen dựa trên LinkedIn (). Đây không chỉ là tiết kiệm thời gian—mà còn là cách nhân bội pipeline.

Python so với các giải pháp scrape LinkedIn khác: Bạn cần biết gì?

Vậy tại sao nên dùng Python thay vì tiện ích mở rộng trình duyệt hoặc công cụ SaaS? Đây là bức tranh thật:

Copy-paste thủ công

- Ưu điểm: Không cần cài đặt, không rủi ro (trừ khi bạn bị đau cổ tay)

- Nhược điểm: Chậm, dễ lỗi, không thể mở rộng

Tiện ích mở rộng trình duyệt (như PhantomBuster, Evaboot)

- Ưu điểm: Dễ thiết lập, không cần code, phù hợp cho việc nhỏ

- Nhược điểm: Khó mở rộng, rủi ro bị khóa tài khoản cao, thường cần Sales Navigator, có phí hàng tháng

API SaaS (như Bright Data, Apify)

- Ưu điểm: Quy mô lớn, ít phải bảo trì, nhà cung cấp xử lý phần tuân thủ

- Nhược điểm: Tốn kém khi dữ liệu tăng, đôi khi dữ liệu chậm hoặc bị cache, ít linh hoạt hơn

Script Python

- Ưu điểm: Linh hoạt tối đa, chi phí trên mỗi dòng thấp nhất khi scale lớn, dữ liệu gần thời gian thực

- Nhược điểm: Cần kỹ năng kỹ thuật cao, rủi ro bị khóa tài khoản lớn nhất, phải bảo trì liên tục

Dưới đây là bảng so sánh trực diện:

| Tiêu chí | Python tự làm | Tiện ích trình duyệt | API SaaS |

|---|---|---|---|

| Thời gian thiết lập | Vài ngày–vài tuần | Vài phút | Vài giờ |

| Kỹ năng kỹ thuật | Cao | Thấp | Trung bình |

| Chi phí (10K dòng) | ~$200 (proxy) | $50–300 | $300–500 |

| Trần quy mô | Cao | Thấp–Trung bình | Cao |

| Rủi ro bị cấm | Cao nhất | Cao | Thấp nhất |

| Độ mới của dữ liệu | Thời gian thực | Thời gian thực | Dữ liệu cache |

| Bảo trì | Liên tục | Thấp | Không cần |

| Tuân thủ | Rủi ro thuộc người dùng | Rủi ro thuộc người dùng | Rủi ro thuộc nhà cung cấp |

Kết luận ngắn gọn: Nếu bạn rành kỹ thuật và muốn kiểm soát toàn bộ, Python là lựa chọn rất khó bị đánh bại. Nhưng với hầu hết người dùng doanh nghiệp, các công cụ như mang đến con đường nhanh hơn và an toàn hơn để lấy dữ liệu LinkedIn—đặc biệt khi hệ thống phòng thủ của LinkedIn ngày càng siết chặt.

Bắt đầu: Thiết lập Python LinkedIn scraper của bạn

Sẵn sàng xắn tay áo chưa? Dưới đây là cách thiết lập môi trường Python để scrape LinkedIn trong năm 2026:

1. Cài Python và các thư viện chính

- Python 3.10+ được khuyến nghị để tương thích tốt nhất.

- Các thư viện cốt lõi:

- Playwright (tiêu chuẩn mới cho tự động hóa trình duyệt)

- Selenium (vẫn phổ biến nhưng chậm hơn và dễ bị phát hiện hơn)

- Beautiful Soup (phân tích HTML)

- Requests (cho các request HTTP đơn giản; LinkedIn thì ít dùng được)

- pandas (làm sạch/xuất dữ liệu)

Cài bằng pip:

1pip install playwright selenium beautifulsoup4 pandasVới Playwright, bạn cũng cần cài browser binaries:

1playwright install2. Thiết lập browser drivers

- Playwright tự quản lý driver của nó.

- Selenium cần hoặc .

- Hãy নিশ্চিত bảo phiên bản trình duyệt và driver khớp nhau.

3. Chuẩn bị đăng nhập

- Bạn sẽ cần một tài khoản LinkedIn (tốt nhất là tài khoản đã hoạt động lâu, có tương tác thật).

- Với hầu hết script, bạn sẽ chọn một trong hai cách:

- Tự động hóa luồng đăng nhập (có nguy cơ gặp CAPTCHA)

- Chèn cookie phiên

li_atcủa bạn (nhanh hơn, nhưng vẫn có rủi ro)

4. Tôn trọng điều khoản của LinkedIn

Cảnh báo: Scrape LinkedIn, kể cả bằng chính tài khoản của bạn, vẫn vi phạm User Agreement của họ. Khung pháp lý khá phức tạp (xem vụ hiQ v. LinkedIn), và hiện LinkedIn đang siết thực thi rất mạnh. Hãy dùng các script này cho mục đích học tập hoặc nghiên cứu nội bộ, và tuyệt đối không bán hay công khai phân phối dữ liệu đã scrape.

Đi qua các hạn chế của LinkedIn: Cách giảm nguy cơ bị khóa tài khoản trong năm 2026

Đây là phần bắt đầu khó. Hệ thống chống bot của LinkedIn năm 2026 không phải chuyện đùa. Họ đã đóng cửa cả những doanh nghiệp lớn (như Proxycurl) và chỉ riêng năm 2025 đã hạn chế hơn 30 triệu tài khoản (). Vậy làm sao để scrape mà không “ăn đòn”?

Các rủi ro chính

- Rate limit: Người dùng chưa xác thực chỉ xem được khoảng 50 hồ sơ mỗi ngày trên mỗi IP. Tài khoản đã đăng nhập có thể đi vài trăm hồ sơ trước khi gặp CAPTCHA hoặc bị khóa ().

- CAPTCHA: Xuất hiện thường xuyên, nhất là sau khi xem quá nhanh nhiều hồ sơ hoặc đăng nhập liên tục.

- Hạn chế tài khoản: LinkedIn có thể khóa, hạn chế hoặc cấm vĩnh viễn các tài khoản có dấu hiệu đáng ngờ.

Các chiến lược đã được kiểm chứng để giảm rủi ro

- Dùng mobile proxy hoặc residential proxy đã “nuôi” lâu: Mobile proxy có tỷ lệ sống sót 85% trên LinkedIn, so với 50% của residential và gần như 0% với datacenter IP ().

- Random hóa độ trễ: Đừng dùng

time.sleep(5)cố định. Hãy ngẫu nhiên giữa 2–8 giây. - Nuôi ấm tài khoản: Đừng “đập” 100 hồ sơ trên một tài khoản mới toanh. Hãy bắt đầu chậm và mô phỏng hành vi người dùng thật.

- Scrape trong giờ làm việc: Đồng bộ với múi giờ của tài khoản.

- Luân phiên user agent theo phiên: Nhưng đừng đổi giữa chừng—LinkedIn sẽ đánh dấu.

- Cuộn trang tự nhiên: Dùng browser automation để cuộn và kích hoạt nội dung lazy-load.

- Tách IP cho từng tài khoản: Không bao giờ chạy nhiều tài khoản sau cùng một proxy.

- Theo dõi cảnh báo sớm: Lỗi 429, bị chuyển hướng sang

/authwall, hoặc phần thân hồ sơ trống đều là dấu hiệu bạn đang đến gần ngưỡng bị cấm.

Mẹo nhỏ: Ngay cả những plugin stealth tốt nhất (Playwright Stealth, undetected-chromedriver) cũng chỉ che được dấu vết bề mặt. LinkedIn phát hiện ở tầng sâu hơn nhiều—nên đừng chủ quan.

Chọn thư viện Python phù hợp cho trích xuất dữ liệu LinkedIn

Đến năm 2026, bức tranh thư viện scraping Python đã rõ ràng hơn nhiều. Đây là cách các thư viện chính so kè nhau:

| Thư viện | HTML tĩnh | Kết xuất bằng JS | Luồng đăng nhập | Tốc độ | Phù hợp nhất cho |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | Nhanh nhất | Trang nhỏ, chỉ public |

| Selenium 4.x | ✅ | ✅ | ✅ | Chậm | Dự án cũ, hỗ trợ trình duyệt rộng |

| Playwright (Python) | ✅ | ✅ | ✅ | Nhanh | Lựa chọn mặc định cho LinkedIn năm 2026 |

| Scrapy | ✅ | Có plugin | Cần nhiều công sức | Nhanh | Crawl có cấu trúc, khối lượng lớn |

Vì sao Playwright thắng thế khi scrape LinkedIn:

- Tải trang nhanh hơn 12% và dùng ít bộ nhớ hơn 15% so với Selenium ()

- Xử lý tốt cơ chế tải bất đồng bộ của LinkedIn mà không cần mẹo vá víu thủ công

- Quản lý tab native, thuận tiện cho scraping song song

- Có plugin stealth chính thức để né fingerprint cơ bản

Lời khuyên cho người mới: Nếu bạn mới bắt đầu, Playwright là lựa chọn đáng tin nhất. Selenium vẫn hữu ích cho dự án cũ, nhưng chậm hơn và dễ bị phát hiện hơn.

Từng bước: Script Python LinkedIn scraper đầu tiên của bạn

Hãy cùng xem ví dụ cơ bản dùng Selenium (cho người mới) và Playwright (cho production). Nhớ rằng: các script này chỉ dành cho mục đích học tập.

Ví dụ 1: Selenium tối giản để đăng nhập và scrape hồ sơ

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # độ trễ ngẫu nhiên

10# Mở hồ sơ

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Cuộn để kích hoạt lazy-load

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Lấy dữ liệu (đơn giản hóa)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Tên:", name)

18driver.quit()Lưu ý: Với production, bạn nên chèn cookie li_at thay vì đăng nhập mỗi lần (để giảm CAPTCHA).

Ví dụ 2: Playwright async scraper (khuyến nghị cho năm 2026)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # lưu phiên đăng nhập của bạn

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Nơi nên chèn biện pháp chống khóa:

- Dùng mobile proxy trong browser manager của bạn

- Random hóa độ trễ giữa các hành động

- Scrape theo từng đợt nhỏ, đừng làm ồ ạt một lúc

Cảnh báo: Bất kỳ scraper nào dựa trên selector cũng có thể hỏng khi LinkedIn cập nhật DOM (điều này xảy ra vài tuần một lần). Hãy sẵn sàng bảo trì script của bạn.

Làm sạch và định dạng dữ liệu LinkedIn bằng Python

Scraping mới chỉ là một nửa câu chuyện. Dữ liệu LinkedIn thường khá lộn xộn—tên trùng lặp, chức danh không nhất quán và cả ký tự Unicode kỳ quặc. Cách xử lý như sau:

1. Dùng pandas để xử lý bảng

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # loại trùng chính xác

4df["name"] = df["name"].str.lower().str.strip()2. Ghép mờ cho tên công ty

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Ví dụ: "Acme Corp" và "ACME Corporation"3. Chuẩn hóa số điện thoại và email

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Chuẩn hóa số điện thoại

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# Xác thực email

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("Email không hợp lệ:", e)4. Xuất sang Excel, Google Sheets hoặc CRM

- Excel:

df.to_excel("cleaned_data.xlsx") - Google Sheets: dùng thư viện

gspread - Airtable: dùng

pyairtable - Salesforce/HubSpot: dùng các Python API client tương ứng

Mẹo nhỏ: Luôn làm sạch và khử trùng lặp trước khi nhập vào CRM. Không gì làm sales rep nản bằng việc gọi cùng một khách hàng tiềm năng hai lần.

Tăng hiệu suất scrape LinkedIn với Thunderbit

Giờ hãy nói về cách làm cuộc sống của bạn dễ hơn nữa. Dù tôi rất thích Python, việc duy trì scraper cho LinkedIn đúng là cuộc chơi “đập chuột chũi” không hồi kết. Đó là lý do tại Thunderbit, chúng tôi xây dựng một giúp loại bỏ phần đau đầu trong trích xuất dữ liệu LinkedIn.

Vì sao chọn Thunderbit?

- Scraping 2 lần nhấp: Chỉ cần bấm “AI Suggest Fields”, Thunderbit sẽ đọc trang, đề xuất các cột và trích xuất dữ liệu—không cần code, không cần selector, không đau đầu.

- Scrape trang con: Scrape trang kết quả tìm kiếm, rồi để Thunderbit tự ghé từng hồ sơ và làm giàu bảng dữ liệu của bạn.

- Template có sẵn: Được dựng sẵn cho LinkedIn, Amazon, Google Maps và nhiều nền tảng khác—bắt đầu chỉ trong vài giây.

- Xuất dữ liệu miễn phí: Gửi dữ liệu sang Excel, Google Sheets, Airtable, Notion hoặc tải xuống dưới dạng CSV/JSON.

- AI Autofill: Tự động điền form và xử lý các tác vụ lặp đi lặp lại—rất hợp cho sales ops và quản trị CRM.

- Scraping trên cloud hoặc ngay trong trình duyệt: Chọn chế độ phù hợp với nhu cầu sử dụng và cách bạn đăng nhập.

- Không cần bảo trì: AI của Thunderbit thích ứng với thay đổi giao diện LinkedIn, nên bạn không phải liên tục sửa script bị hỏng.

Thunderbit hiện được hơn 100.000 người dùng trên toàn thế giới tin dùng và có điểm 4,4★ trên Chrome Web Store (). Với hầu hết người dùng doanh nghiệp, đây là cách nhanh nhất và an toàn nhất để trích xuất dữ liệu LinkedIn—mà không phải lo mất tài khoản hay mất kiên nhẫn.

Mẹo nâng cao: Mở rộng quy mô và tự động hóa workflow scrape LinkedIn

Nếu bạn đã sẵn sàng làm chuyên nghiệp, đây là cách mở rộng hoạt động scraping LinkedIn của bạn:

1. Lên lịch script

- cron (Linux/Mac) hoặc Task Scheduler (Windows) cho các tác vụ đơn giản

- APScheduler hoặc Prefect 3 cho lập lịch và retry theo kiểu Python-native

- Airflow cho điều phối cấp doanh nghiệp

2. Triển khai trên cloud

- AWS Lambda (kết hợp Playwright trong container)

- GCP Cloud Run

- Railway / Fly.io / Render để host Playwright dễ dàng

- Apify cho workflow cloud chuyên về scraping

3. Giám sát và phát hiện drift

- Sentry để theo dõi lỗi

- Cảnh báo tùy chỉnh khi lỗi 429 tăng đột biến hoặc DOM thay đổi

- So sánh bằng hash để phát hiện khi LinkedIn đổi bố cục

4. Tích hợp CRM

- Dùng API của Salesforce, HubSpot, Notion hoặc Airtable để đẩy dữ liệu đã làm sạch tự động

- Xây pipeline: Scheduler → Scraper → pandas clean/dedupe → Enrichment → đẩy vào CRM → cảnh báo

5. Giữ tuân thủ

- Không bao giờ scrape quá vài trăm hồ sơ mỗi tài khoản mỗi ngày

- Luân phiên proxy và user agent

- Theo dõi dấu hiệu bị khóa sớm và tạm dừng script nếu thấy chúng

Mẹo nhỏ: Dù tự động hóa đến đâu, LinkedIn vẫn có thể (và sẽ) thay đổi luật chơi. Luôn có phương án dự phòng—và cân nhắc dùng Thunderbit cho những workflow quan trọng nhất.

Kết luận & những điểm chính cần nhớ

Scrape LinkedIn bằng Python trong năm 2026 vừa mạnh mẽ hơn, vừa rủi ro hơn bao giờ hết. Hãy nhớ những điều sau:

- LinkedIn là nguồn dữ liệu B2B số 1—nhưng cũng là nền tảng được bảo vệ gắt gao nhất chống scraper.

- Python cho bạn tính linh hoạt tối đa khi trích xuất dữ liệu LinkedIn, nhưng đi kèm rủi ro bị khóa tài khoản cao và phải bảo trì liên tục.

- Playwright hiện là tiêu chuẩn vàng cho LinkedIn scraping—nhanh hơn và đáng tin hơn Selenium.

- Giảm rủi ro bị khóa là chuyện proxy, độ trễ và mô phỏng hành vi người dùng thật—mobile proxy sống sót 85%, residential 50%, datacenter 0%.

- Làm sạch dữ liệu là bắt buộc—dùng pandas, ghép mờ và thư viện xác thực trước khi nhập vào CRM.

- Thunderbit là lựa chọn an toàn và nhanh hơn—với scraping bằng AI, làm giàu trang con, xuất dữ liệu tức thì và không cần code.

- Mở rộng quy mô nghĩa là tự động hóa mọi thứ—từ lập lịch đến giám sát đến tích hợp CRM.

Và trên hết: hãy scrape có đạo đức và có trách nhiệm. Đội pháp lý của LinkedIn vốn không nổi tiếng vì khiếu hài hước.

Nếu bạn đã mệt mỏi vì phải đối đầu với hệ thống phòng thủ thay đổi liên tục của LinkedIn, . Đây là công cụ mà tôi ước mình có từ lúc bắt đầu—và rất có thể nó sẽ giúp bạn (và cả tài khoản LinkedIn của bạn) tránh được rất nhiều đau đầu.

Muốn tìm hiểu sâu hơn? Hãy xem để đọc thêm các hướng dẫn về web scraping, tự động hóa và best practices cho sales ops.

Câu hỏi thường gặp

1. Scrape LinkedIn bằng Python có hợp pháp trong năm 2026 không?

Khung pháp lý khá phức tạp. Dù vụ hiQ v. LinkedIn cho rằng việc scrape dữ liệu công khai không vi phạm CFAA, LinkedIn vẫn có thể (và thực tế đang) thực thi User Agreement của họ, trong đó cấm scraping. Năm 2025, LinkedIn đã gỡ Proxycurl và hạn chế hơn 30 triệu tài khoản vì scraping. Hãy luôn dùng script cho mục đích nội bộ hoặc học tập, và không bao giờ bán hay công khai phân phối dữ liệu đã scrape.

2. Cách an toàn nhất để tự động hóa LinkedIn scraping là gì?

Hãy dùng tài khoản đã hoạt động lâu, mobile proxy (tỷ lệ sống sót 85%), random hóa độ trễ, và scrape trong giờ làm việc. Đừng bao giờ dùng datacenter IP, đồng thời theo dõi các tín hiệu khóa sớm. Với hầu hết người dùng doanh nghiệp, các công cụ như là lựa chọn rủi ro thấp hơn rất nhiều so với tự viết Python script.

3. Thư viện Python nào tốt nhất cho LinkedIn scraping năm 2026?

Playwright hiện là lựa chọn mặc định—nhanh hơn, đáng tin hơn và xử lý nội dung động của LinkedIn tốt hơn Selenium. Với các trang public đơn giản, Requests + Beautiful Soup vẫn dùng được, nhưng nếu có đăng nhập hoặc JavaScript thì hãy dùng Playwright.

4. Làm sạch và định dạng dữ liệu LinkedIn sau khi scrape như thế nào?

Dùng pandas để xử lý bảng và khử trùng lặp, RapidFuzz để ghép mờ, phonenumbers và email-validator để xử lý thông tin liên hệ, rồi xuất sang Excel, Google Sheets hoặc CRM bằng thư viện Python tương ứng.

5. Thunderbit cải thiện trích xuất dữ liệu LinkedIn như thế nào?

Thunderbit dùng AI để đề xuất trường dữ liệu, xử lý scrape trang con và xuất dữ liệu trực tiếp sang các công cụ bạn thích—không cần code. Nó thích ứng với những thay đổi giao diện thường xuyên của LinkedIn, giúp giảm công bảo trì và giảm rủi ro bị khóa tài khoản. Ngoài ra, bạn có thể dùng thử miễn phí và hiện đã được hơn 100.000 người dùng trên toàn thế giới tin dùng.

Bạn muốn xem LinkedIn scraping hoạt động thực tế—mà không đau đầu? và bắt đầu trích xuất dữ liệu chỉ với 2 cú nhấp chuột. Đội sales của bạn (và cả tài khoản LinkedIn của bạn) sẽ biết ơn bạn.

Tìm hiểu thêm