Tôi vẫn còn nhớ rất rõ ngày đầu tiên có người hỏi tôi: “Shuai, anh có thể scrape dữ liệu từ website này không?” Hồi đó, web scraping vẫn còn là một kỹ thuật khá ngách, chỉ có vài developer biết tới — chỉ cần Python và BeautifulSoup là đủ. Còn bây giờ, thị trường freelancer làm web scraping đã bùng nổ thành một , và dự kiến sẽ còn tăng gấp đôi trước năm 2030. Các job remote mọc lên liên tục, và khách hàng không còn chỉ muốn “một script chạy được” nữa — họ muốn một giải pháp kinh doanh sẵn dùng, giao nhanh, tốt nhất là có luôn CSV!

Điểm cốt lõi là: vai trò của một freelance web scraping developer đã thay đổi hoàn toàn. Không còn đơn thuần là viết code nữa. Giờ bạn phải ôm trọn cả quy trình — từ làm rõ yêu cầu, trích xuất dữ liệu, làm sạch dữ liệu, bàn giao đúng định dạng, cho đến quản lý cả rủi ro pháp lý. Với những công cụ như đang nâng chuẩn về tốc độ và chất lượng, kỳ vọng của khách hàng cũng cao dần lên. Dù bạn đã làm nghề lâu năm hay mới vào nghề, hãy cùng bóc tách xem muốn thành công trong kỷ nguyên mới này thì cần gì. Tôi sẽ chia sẻ kinh nghiệm thực chiến, mẹo áp dụng ngay, và cách Thunderbit có thể trở thành vũ khí bí mật của bạn.

Hôm nay, Freelance Web Scraping Developer thực sự làm gì?

Nói thật nhé: một freelance web scraping developer năm 2025 khác xa hoàn toàn so với 5 năm trước. Ngày xưa, chỉ cần bàn giao một script Python là xong. Bây giờ, bạn được kỳ vọng phải chịu trách nhiệm cho toàn bộ pipeline — từ cuộc gọi Zoom đầu tiên cho đến file Google Sheets cuối cùng.

Vì sao lại thay đổi như vậy? Vì nhu cầu web scraping đã tăng vọt. đang hướng tới mốc 2,5 tỷ USD vào năm 2032, và đã dùng web scraping cho AI và phân tích dữ liệu. Từ thương mại điện tử, bất động sản đến tài chính — ngành nào cũng cần dữ liệu, và xuất hiện dày đặc trên Upwork và Freelancer. Nhưng cạnh tranh cũng căng không kém.

Kỳ vọng của khách hàng bây giờ đã vượt xa chuyện “code chạy được”:

- Hiểu mục tiêu kinh doanh (không chỉ nhìn HTML — mà phải hiểu họ cần dữ liệu đó để làm gì)

- Giao tiếp rõ ràng (“máy tôi chạy được” là chưa đủ)

- Bàn giao dữ liệu sạch, dùng được ngay

- Tuân thủ pháp lý và quản trị rủi ro

- Hỗ trợ sau bàn giao

Tóm lại, bạn phải vừa là kỹ sư, vừa là tư vấn, vừa là quản lý dự án, vừa là data engineer trong cùng một người. Freelancer nào mang lại giá trị “full-cycle” như vậy sẽ dễ có khách quay lại và nhận được mức phí cao hơn.

Kỹ năng cần có cho công việc web scraping: Python thôi là chưa đủ

Python, BeautifulSoup và Playwright chỉ là mức nền thôi. Muốn thắng các job remote và dự án quốc tế, bạn cần một bộ kỹ năng rộng hơn.

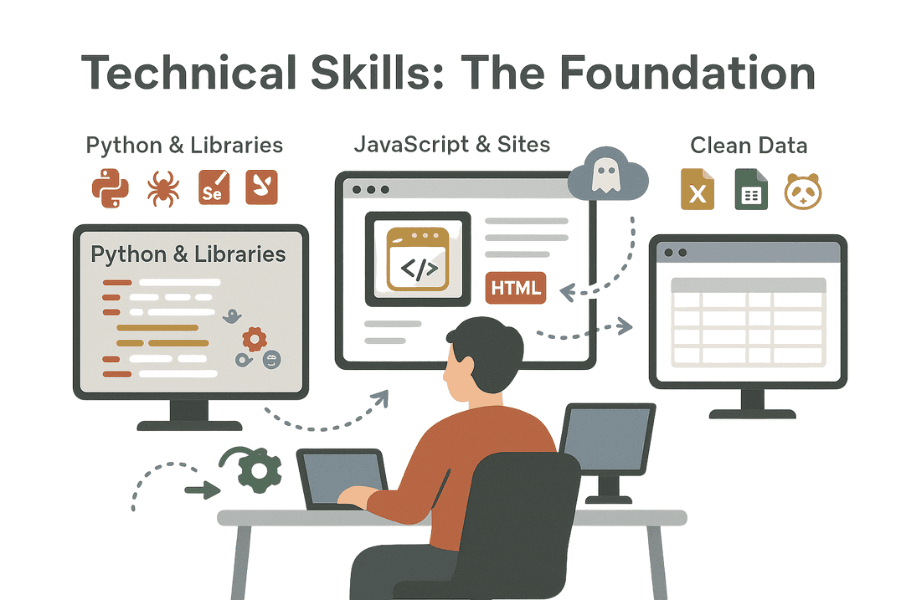

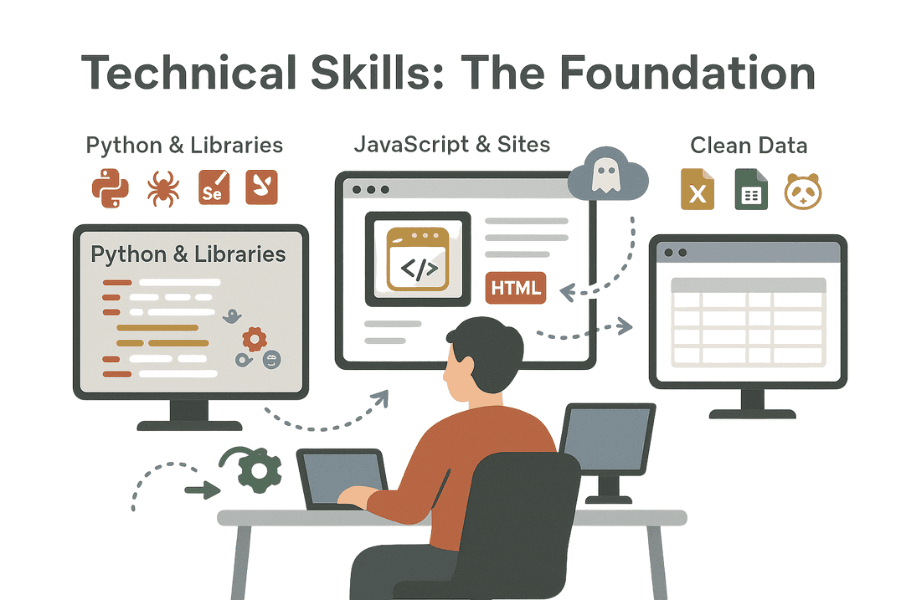

Kỹ năng kỹ thuật: nền móng cốt lõi

- Python & thư viện liên quan: dùng Python, với BeautifulSoup, Scrapy, Selenium và Playwright là những công cụ phổ biến nhất.

- JavaScript & website động: Website hiện đại phụ thuộc rất nhiều vào JavaScript để render nội dung động, nên headless browser và khả năng xử lý dynamic content là bắt buộc.

- API & automation: Biết làm việc với web scraper API và các framework tự động hóa sẽ giúp bạn có lợi thế rõ ràng.

- Làm sạch dữ liệu: Khả năng bàn giao dữ liệu gọn gàng bằng Pandas, Excel hoặc Google Sheets quan trọng hơn bạn nghĩ.

Những điểm khác biệt mới

Đây là những thứ rất nhiều freelancer hay bỏ sót:

- Giao tiếp: Bạn có giải thích được vấn đề kỹ thuật theo cách dễ hiểu không? Bạn có chốt đúng yêu cầu ngay từ buổi kickoff không? Đây là yếu tố biến một job lẻ thành hợp đồng dài hạn.

- Quản lý dự án: Đúng deadline, xử lý thay đổi phạm vi công việc một cách mềm dẻo — sự đáng tin sẽ được ghi nhận và trả công xứng đáng.

- Linh hoạt công cụ: Ngoài code, bạn có tận dụng được các công cụ no-code như và web scraper API để làm nhanh hơn không?

- Tuân thủ pháp lý & đạo đức: [73% doanh nghiệp](https://scrapingant.com/blog/freelance-web-scrapingTôi vẫn còn nhớ rất rõ ngày đầu tiên có người hỏi tôi: “Shuai, anh có thể scrape dữ liệu từ website này không?” Hồi đó, web scraping vẫn còn là một kỹ thuật khá ngách, chỉ có vài developer biết tới — chỉ cần Python và BeautifulSoup là đủ làm. Còn bây giờ, thị trường freelancer làm web scraping đã bùng nổ thành một , và dự kiến sẽ còn tăng gấp đôi trước năm 2030. Các công việc remote mọc lên như nấm, và khách hàng không còn chỉ muốn “một script chạy được” nữa — họ muốn luôn một giải pháp kinh doanh sẵn sàng dùng, giao nhanh, có CSV càng tốt!

Điểm mấu chốt là: vai trò của một freelance web scraping developer đã thay đổi hẳn từ gốc. Không còn đơn giản là ngồi viết code nữa. Giờ đây, bạn phải lo trọn cả quy trình — từ làm rõ yêu cầu, trích xuất dữ liệu, làm sạch dữ liệu, bàn giao đúng định dạng, cho tới quản lý cả rủi ro pháp lý. Với những công cụ như đang nâng chuẩn về tốc độ và chất lượng, kỳ vọng của khách hàng cũng ngày càng cao hơn. Dù bạn đã làm lâu năm hay mới vào nghề, hãy cùng bóc tách xem muốn thành công trong kỷ nguyên mới này thì cần những gì. Tôi sẽ chia sẻ kinh nghiệm thực chiến, mẹo áp dụng ngay, và cách Thunderbit có thể trở thành “vũ khí bí mật” của bạn.

Hôm nay, Freelance Web Scraping Developer thực sự làm gì?

Nói thẳng ra nhé: một freelance web scraping developer năm 2025 khác xa hoàn toàn so với 5 năm trước. Ngày xưa, chỉ cần bàn giao một script Python là xong chuyện. Giờ thì bạn được kỳ vọng phải chịu trách nhiệm cho cả pipeline — từ cuộc gọi Zoom đầu tiên cho đến file Google Sheets cuối cùng.

Vì sao lại thay đổi như vậy? Vì nhu cầu web scraping đã tăng vọt. đang tiến tới mốc 2,5 tỷ USD vào năm 2032, và đã dùng web scraping cho AI và phân tích dữ liệu. Từ thương mại điện tử, bất động sản đến tài chính — ngành nào cũng cần dữ liệu, và xuất hiện dày đặc trên Upwork và Freelancer. Nhưng cạnh tranh cũng gay gắt không kém.

Kỳ vọng của khách hàng bây giờ vượt xa chuyện “code chạy được”:

- Hiểu mục tiêu kinh doanh (không chỉ là HTML — họ cần dữ liệu đó để làm gì?)

- Giao tiếp rõ ràng (“máy tôi chạy được” là chưa đủ)

- Bàn giao dữ liệu sạch, dùng được ngay

- Tuân thủ pháp lý và quản trị rủi ro

- Hỗ trợ sau bàn giao

Tóm lại, bạn phải vừa là kỹ sư, vừa là tư vấn, vừa là quản lý dự án, vừa là data engineer trong cùng một người. Freelancer nào mang lại giá trị “full-cycle” như vậy thì dễ có khách quay lại và được trả phí cao hơn.

Kỹ năng cần có cho công việc web scraping: Python thôi là chưa đủ

Python, BeautifulSoup và Playwright chỉ mới là mức tối thiểu. Muốn thắng các job remote và dự án quốc tế, bạn cần bộ kỹ năng rộng hơn.

Kỹ năng kỹ thuật: nền móng cốt lõi

- Python & thư viện liên quan: dùng Python, với BeautifulSoup, Scrapy, Selenium và Playwright là những công cụ phổ biến nhất.

- JavaScript & website động: Website hiện đại phụ thuộc rất nhiều vào JavaScript để render nội dung động, nên headless browser và khả năng xử lý dynamic content là bắt buộc.

- API & automation: Biết làm việc với web scraper API và các framework tự động hóa sẽ giúp bạn có lợi thế rõ ràng.

- Làm sạch dữ liệu: Khả năng bàn giao dữ liệu gọn gàng bằng Pandas, Excel hoặc Google Sheets quan trọng hơn bạn nghĩ.

Những điểm khác biệt mới

Đây là những thứ rất nhiều freelancer hay bỏ sót:

- Giao tiếp: Bạn có giải thích được vấn đề kỹ thuật một cách dễ hiểu không? Bạn có chốt đúng yêu cầu ngay từ buổi kickoff không? Đây là yếu tố biến job lẻ thành hợp đồng dài hạn.

- Quản lý dự án: Đúng deadline, xử lý thay đổi phạm vi công việc một cách mềm dẻo — sự đáng tin sẽ được ghi nhận và trả công xứng đáng.

- Linh hoạt công cụ: Ngoài code, bạn có tận dụng được các công cụ no-code như và web scraper API để làm nhanh hơn không?

- Tuân thủ pháp lý & đạo đức: ưu tiên cách scraping có đạo đức. Hiểu GDPR và robots.txt là điều bắt buộc.

Vì sao Thunderbit và các công cụ tương tự lại quan trọng

Dùng công cụ chạy bằng AI như Thunderbit là một cú hích rất lớn cho năng suất. Bạn không còn phải mất hàng giờ viết selector hay lo sửa lỗi pagination nữa.

- Dựng prototype chỉ trong vài phút

- Phục vụ cả những khách hàng không rành kỹ thuật

- Tập trung vào việc tạo giá trị — và nhận được nhiều dự án hơn

Freelance web scraping developer lý tưởng ngày nay là một kiểu người lai: một phần kỹ sư, một phần tư vấn, một phần đối tác kinh doanh.

Thunderbit: vũ khí bí mật của Freelance Web Scraping Developer

Tôi đã dành nhiều năm xây dựng SaaS và công cụ automation, và việc làm mọi thứ đơn giản hơn, nhanh hơn chính là công việc cả đời của tôi. Đó cũng là lý do tôi tạo ra — để gỡ bỏ những phần đau đầu nhất của web scraping, đặc biệt là cho freelancer.

Thunderbit là một giúp bạn đi từ “tôi cần dữ liệu này” đến “đây là bảng tính của bạn” chỉ trong vài cú nhấp. Không cần chỉnh selector, không còn đau đầu debug. Đó là lý do nó giúp freelancer giao hàng nhanh hơn và tốt hơn.

Các tính năng AI của Thunderbit được thiết kế để giúp bạn bàn giao dữ liệu sẵn sàng cho kinh doanh một cách nhanh gọn.

AI Suggest Fields: hết phải đoán selector

Bạn biết cái quy trình đó rồi đấy — inspect HTML, đoán CSS selector, rồi cầu trời website không đổi layout. AI Suggest Fields của Thunderbit thay đổi hoàn toàn cách làm này. Chỉ một cú nhấp, AI sẽ phân tích trang, gợi ý các cột nên trích xuất tốt nhất, và tự tạo prompt trích xuất riêng cho từng trường.

- Tốc độ: Việc trước đây mất cả tiếng giờ chỉ còn vài phút

- Độ chính xác: AI phát hiện những trường bạn có thể bỏ sót, giảm thiếu hụt dữ liệu

- Demo cho khách: Có thể trích xuất mẫu ngay tại chỗ để tạo niềm tin tức thì

Chỉ riêng tính năng này đã có thể rút ngắn đáng kể thời gian setup. Nó giống như có một trợ lý 24/7 không bao giờ ngủ.

Subpage & Cloud Scraping: xử lý job phức tạp nhẹ nhàng hơn

Các dự án thực tế hiếm khi chỉ dừng ở việc “scrape một bảng này”.

- Đi vào các subpage (chi tiết sản phẩm, hồ sơ người dùng)

- Xử lý pagination (infinite scroll, nút “next”)

- Scrape quy mô lớn qua hàng trăm, hàng nghìn trang

Subpage Scraping của Thunderbit cho phép AI tự động ghé qua từng subpage và lấy thêm dữ liệu chi tiết — không cần tự viết crawler.

Với Cloud Scraping, bạn có thể lấy dữ liệu tới 50 trang song song từ phía server.

- Bàn giao nhanh hơn: Hoàn thành dự án lớn chỉ trong khoảng một giờ

- Ít phải can thiệp: Proxy, giới hạn tốc độ và retry được xử lý tự động

- Browser Mode: Với các trang cần đăng nhập hoặc dữ liệu nhạy cảm, bạn có thể scrape an toàn bằng chính phiên đăng nhập của khách hàng

Template, export và nhiều hơn nữa

- Template một chạm: Các website phổ biến như Amazon, Zillow, Instagram và Shopify đều có sẵn template — chỉ cần áp dụng là chạy

- Xuất dữ liệu miễn phí: Tải về CSV hoặc export thẳng sang Google Sheets, Excel, Airtable hay Notion — không tính thêm phí

- Scheduled Scrapers: Thiết lập chạy định kỳ theo ngày, theo tuần, rồi biến job một lần thành doanh thu thuê bao

Thunderbit hỗ trợ , nên bạn có thể tự tin nhận dự án quốc tế từ Tokyo đến São Paulo.

Chiến lược toàn cầu để giành job web scraping remote

Giá mà có ai nói với tôi sớm hơn: khách hàng tiềm năng của bạn là cả thế giới. Job web scraping remote không chỉ gói gọn ở Mỹ và Anh — các thị trường tăng trưởng còn trải dài khắp châu Á - Thái Bình Dương và Mỹ Latin. Lực lượng freelancer vẫn đang tăng đều, với , và tốc độ tăng hai chữ số ở những nước như Nam Phi và Canada.

Cách nắm bắt nhu cầu toàn cầu

- Tận dụng khả năng đa ngôn ngữ: Với hỗ trợ 34 ngôn ngữ của Thunderbit, bạn có thể tự tin chào giá cho dữ liệu bất động sản Đức, scraping thương mại điện tử Nhật Bản hoặc trích xuất mạng xã hội Brazil.

- Nổi bật trên các nền tảng: Làm rõ khả năng làm việc đa ngôn ngữ và bàn giao nhiều định dạng trên Upwork, Freelancer và các job board chuyên ngành.

- Thể hiện kinh nghiệm quốc tế: Nếu bạn từng scrape các website tiếng nước ngoài, hãy đưa nó lên đầu hồ sơ. Case study liên quan sẽ tạo uy tín rất nhanh.

Cách tạo khác biệt

- Phản hồi nhanh: Dù lệch múi giờ, việc nói rõ khung giờ bạn có thể hỗ trợ vẫn rất hiệu quả.

- Bàn giao mẫu sớm: Dùng Thunderbit để tạo dữ liệu mẫu từ website mục tiêu ngay lập tức — điều này giúp tăng niềm tin và tỷ lệ chốt.

- Nhấn mạnh compliance: Nhiều khách hàng lo rủi ro pháp lý. Hãy biến cách làm tuân thủ, có đạo đức thành điểm bán hàng rõ ràng.

Trong kỷ nguyên làm việc từ xa, địa lý không còn là rào cản. Có công cụ và chiến lược đúng, bạn có thể chốt khách từ Silicon Valley đến Thượng Hải.

Báo giá và bàn giao: tối đa hóa doanh thu của Freelance Web Scraping Developer

Nói về tiền bạc một chút. Định giá các dự án web scraping có thể khá khó, nhưng làm đúng cách sẽ giúp bạn vừa tăng thu nhập vừa làm khách hàng hài lòng hơn.

Các mô hình định giá phổ biến

- Theo giờ: Mức giá thường dao động từ tùy theo độ phức tạp và trình độ.

- Theo dự án: Báo giá trọn gói cho từng đầu việc. Khách hàng thích vì dễ kiểm soát chi phí.

- Theo giá trị: Định giá dựa trên giá trị dữ liệu mang lại (ví dụ: tự động hóa 50 giờ làm thủ công, thúc đẩy tăng doanh thu).

Thunderbit giúp tăng sức mạnh báo giá như thế nào

Với Thunderbit, bạn có lợi thế rất rõ rệt cả về tốc độ lẫn chất lượng:

- Giao hàng nhanh hơn: Dự án từng mất vài ngày giờ chỉ còn vài giờ

- Ít lỗi hơn: Ít debug hơn đồng nghĩa ít phải làm lại

- Cơ hội dịch vụ định kỳ: Thiết lập scraping theo lịch và bán theo dạng subscription (ví dụ: 200 USD/tháng)

Khách hàng sẵn sàng trả cao hơn cho tốc độ, độ tin cậy và hỗ trợ liên tục. Đừng định giá theo số giờ bạn làm — hãy định giá theo giá trị bạn tạo ra.

Cách truyền đạt giá trị

- Bắt đầu bằng ROI: Giải thích dữ liệu giúp khách tăng doanh thu, tiết kiệm thời gian hoặc giảm rủi ro như thế nào

- Minh bạch: Nêu rõ setup, bảo trì, cập nhật và cách bạn xử lý khi website thay đổi

- Chia gói dịch vụ: Gói Basic (một lần), Standard (kèm làm sạch và phân tích), Premium (cập nhật định kỳ và hỗ trợ ưu tiên)

Hãy nhớ: khách hàng không trả tiền cho code. Họ trả tiền cho kết quả.

Tuân thủ dữ liệu và quản trị rủi ro: xây dựng niềm tin và quan hệ dài hạn

Đây là sự thật hơi khó nghe: chỉ một lần sơ suất về compliance cũng có thể chấm dứt mối quan hệ với khách hàng ngay lập tức. Với lo ngại về tính hợp pháp của việc thu thập dữ liệu, quản trị rủi ro không phải là tùy chọn — mà là điều bắt buộc.

Thực hành tốt nhất

- Tôn trọng Điều khoản sử dụng: Luôn kiểm tra ToS của website mục tiêu. Khi chưa chắc chắn, hãy hỏi khách hàng hoặc xin phép.

- Tuân thủ luật bảo vệ dữ liệu: Với GDPR, CCPA và các quy định tương tự, chỉ xử lý dữ liệu công khai, không nhạy cảm. Không đụng đến dữ liệu cá nhân nếu chưa có sự đồng ý.

- Dùng scraping trên trình duyệt: Browser Mode của Thunderbit cho phép bạn scrape một cách có đạo đức bằng chính phiên đăng nhập hợp lệ của khách hàng.

- Chú ý rate limit: Đừng gửi quá nhiều request làm nghẽn server. Cloud Mode của Thunderbit xử lý phần này tự động, nhưng bạn vẫn nên kiểm tra lại.

Cách truyền đạt về compliance

Chèn một câu ngắn gọn vào proposal sẽ rất hữu ích:

“Toàn bộ hoạt động thu thập dữ liệu đều tuân thủ các quy định bảo mật dữ liệu và chính sách của website liên quan. Chúng tôi chỉ khai thác thông tin công khai. Trong trường hợp cần đăng nhập, chúng tôi sử dụng quyền truy cập được khách hàng ủy quyền để trích xuất dữ liệu theo cách có đạo đức.”

Chỉ một đoạn như vậy đã giúp bạn nổi bật như một chuyên gia thực thụ, chứ không chỉ là người viết code.

Từ dự án một lần sang doanh thu thuê bao: tự động hóa thành công cho khách hàng

Nếu muốn có thu nhập ổn định, chìa khóa là biến các dự án một lần thành dịch vụ định kỳ.

Cách làm

- Scheduled scrapers: Dùng scheduler của Thunderbit để thiết lập chạy hàng ngày, hàng tuần hoặc hàng tháng

- Bàn giao định kỳ: Đề xuất theo dõi giá hàng tuần, phân tích mạng xã hội hằng ngày hoặc báo cáo thị trường hằng tháng

- Mô hình retainer: Tính phí setup ban đầu cộng phí bảo trì hàng tháng. Nhiều khách sẵn sàng trả 100–400 USD/tháng cho dịch vụ dữ liệu liên tục.

Ví dụ thực tế

Một freelancer đã biến dự án trích xuất giá sản phẩm e-commerce hằng ngày thành dashboard tự cập nhật theo hợp đồng tháng. Nhờ Thunderbit lo phần tự động hóa, công sức mỗi ngày giảm rất nhiều — nhưng thu nhập vẫn đều đặn.

Mẹo hay

Sau mỗi lần bàn giao một dự án, hãy luôn gợi ý thêm dịch vụ định kỳ. Phần lớn khách hàng chưa từng nghĩ đến mức giá trị mà dữ liệu cập nhật liên tục có thể mang lại.

Xây dựng thương hiệu cá nhân: tạo dấu ấn trong thị trường freelance web scraping

Trong một thị trường freelance đông đúc, thương hiệu cá nhân chính là thứ khiến bạn được nhớ tới. Đây là cách xây dựng profile nổi bật cho các job remote và quốc tế.

Các bước cụ thể

- Tối ưu hồ sơ: Trên Upwork, LinkedIn và website cá nhân, hãy làm nổi bật cả kỹ năng kỹ thuật lẫn tác động kinh doanh

- Cho thấy kết quả: Đăng case study, lời chứng thực từ khách hàng và dữ liệu mẫu. Đo lường tác động bằng con số — tăng doanh thu bao nhiêu, tiết kiệm bao nhiêu giờ

- Tạo nội dung: Viết về thách thức web scraping, compliance và câu chuyện thành công trên blog hoặc LinkedIn của bạn (bài viết này chính là một ví dụ!)

- Tham gia cộng đồng: Trả lời câu hỏi trên Reddit, group LinkedIn và các diễn đàn web scraping. Đóng góp open-source cũng rất đáng giá

- Nhấn mạnh cả kỹ năng kỹ thuật lẫn kinh doanh: Khách hàng cần một đối tác, không chỉ một nhà cung cấp. Hãy cho họ thấy bạn hiểu mục tiêu của họ và có thể bàn giao dữ liệu có thể hành động ngay

Ngành này không bao giờ đứng yên. Hãy tiếp tục học công cụ mới như Thunderbit, cập nhật thay đổi pháp lý, và thử nghiệm kỹ thuật mới — đó là cách bạn luôn đi trước.

Kết luận: lộ trình dẫn đến thành công trong freelance web scraping

Thị trường freelance web scraping đang tăng trưởng rất nhanh, nhưng kỳ vọng cũng tăng theo. Đây là kế hoạch hành động của bạn:

- Mang lại giá trị trọn vòng đời: Hãy là người giải quyết vấn đề, không chỉ là người viết code

- Mở rộng kỹ năng: Thành thạo cả công cụ truyền thống (Python, API) lẫn nền tảng AI hiện đại (như Thunderbit)

- Ưu tiên compliance: Xây niềm tin bằng cách làm việc có đạo đức và minh bạch

- Chuyển sang dịch vụ định kỳ: Tự động hóa và bán dịch vụ dữ liệu theo subscription

- Xây dựng thương hiệu cá nhân: Đầu tư cho sự hiện diện online, portfolio và học hỏi liên tục

Freelancer làm được những điều này không chỉ tồn tại — họ sẽ chốt được khách tốt hơn, báo giá cao hơn, và xây dựng được doanh nghiệp bền vững.

Dù bạn mới bắt đầu hay đang muốn nâng cấp, hãy nhớ điều này: thành công trong freelance web scraping không chỉ là trích xuất dữ liệu — mà là trích xuất cơ hội. Hãy học tiếp, thích nghi tiếp, và tiếp tục tạo ra giá trị. Khách hàng và thành công sẽ tự tìm đến.

Sẵn sàng tăng tốc sự nghiệp freelance web scraping của bạn chưa?

Dùng thử miễn phí, xem , và khám phá để đọc thêm mẹo hay và hướng dẫn chi tiết.

Và nếu một ngày bạn lại thấy mình đang debug selector lúc 2 giờ sáng... cứ nhớ rằng giờ đã có AI hỗ trợ bạn rồi (hoặc ít nhất, hãy uống một ly cà phê).

Bài đọc gợi ý:

Chúc bạn có thêm một chiến thắng lớn tiếp theo. Mong rằng dữ liệu của bạn luôn sạch, khách hàng luôn hài lòng, và script của bạn đủ bền để sống sót qua lần redesign website tiếp theo!

Câu hỏi thường gặp

1. Một freelance web scraping developer hiện đại cần những kỹ năng gì?

Ngoài Python và BeautifulSoup, bạn còn cần các thư viện như Scrapy, Selenium và Playwright, cùng khả năng xử lý website nặng JavaScript, làm việc với API và làm sạch dữ liệu bằng Pandas hoặc Excel. Kỹ năng giao tiếp, quản lý dự án và hiểu biết về tuân thủ pháp lý cũng quan trọng không kém. Thành thạo các công cụ no-code/AI như Thunderbit sẽ tạo cho bạn lợi thế cạnh tranh rất lớn.

2. Vai trò của freelance web scraping developer đã thay đổi như thế nào trong những năm gần đây?

Nó đã tiến hóa từ việc chỉ bàn giao script đơn lẻ sang cung cấp giải pháp end-to-end: hiểu mục tiêu kinh doanh, bàn giao dữ liệu sạch, đảm bảo tuân thủ pháp lý và hỗ trợ liên tục. Freelancer ngày nay còn kiêm vai trò tư vấn và quản lý dự án.

3. Thunderbit là gì và hỗ trợ freelance web scraping developer ra sao?

Thunderbit là một tiện ích Chrome web scraper chạy bằng AI. Nó cung cấp AI Suggest Fields, scraping subpage và cloud, template có sẵn cho các website phổ biến, cùng hỗ trợ đa ngôn ngữ. Từ tạo prototype nhanh đến xử lý dự án phức tạp và tự động hóa theo lịch, Thunderbit giúp freelancer làm nhiều hơn với hiệu quả cao hơn.

4. Freelancer có thể tối đa hóa thu nhập từ dự án web scraping bằng cách nào?

Hãy kết hợp nhiều mô hình định giá — theo giờ, theo dự án và theo giá trị. Các công cụ như Thunderbit giúp bạn giao hàng nhanh hơn và ít lỗi hơn. Hãy chào bán dịch vụ scraping định kỳ và bàn giao dữ liệu theo subscription. Trình bày rõ ROI và cung cấp các gói dịch vụ theo tầng để tối đa hóa biên lợi nhuận.

5. Các thực hành tốt nhất về compliance và quản trị rủi ro trong web scraping là gì?

Luôn xem xét Terms of Service của website mục tiêu và tuân thủ các luật bảo vệ dữ liệu như GDPR và CCPA. Chỉ scrape dữ liệu công khai, không nhạy cảm nếu chưa có sự đồng ý rõ ràng. Dùng Browser Mode của Thunderbit để truy cập hợp lệ và có đạo đức. Tôn trọng rate limit và truyền đạt rõ cách bạn xử lý compliance cho khách hàng.