CRM của bạn “xịn” tới đâu thì cũng chỉ bằng đúng chất lượng dữ liệu bạn đổ vào. Mà nguồn dữ liệu ngon nhất thì thường nằm ngay trên các website công khai — chứ không phải mấy kho dữ liệu bên thứ ba vừa đắt vừa hên xui.

Các công cụ trích xuất dữ liệu web giúp bạn biến dữ liệu web lộn xộn thành bảng tính gọn gàng, dễ xài. Một trình trích xuất dữ liệu web ngon có thể làm việc đó trong vài phút, không cần viết code.

Mình đã dùng mấy công cụ này trong dự án thật — từ build danh sách lead, theo dõi giá đối thủ, tới trích xuất catalog sản phẩm. Dưới đây là 12 cái “đáng đồng tiền bát gạo”, xếp hạng theo mức độ hiệu quả khi áp vào các tác vụ kinh doanh thực chiến.

Vì sao công cụ trích xuất dữ liệu web là nhu cầu thiết yếu của doanh nghiệp

Nói thẳng luôn: web là cơ sở dữ liệu lớn nhất thế giới (và cũng bừa bộn nhất). Và tới năm 2026, doanh nghiệp nào biết “thuần hóa” mớ hỗn độn đó thành insight thì doanh nghiệp đó bứt tốc. Theo , các công ty ra quyết định dựa trên dữ liệu năng suất cao hơn 5% và lợi nhuận cao hơn 6% so với nhóm còn lại. Đây không phải kiểu “làm tròn cho đẹp” — mà là lợi thế thật sự.

Các công cụ trích xuất dữ liệu web (đôi khi còn được gọi là web page extractor hay giải pháp web extracting) chính là “bí kíp gia truyền”. Chúng giúp đội sales gom dữ liệu từ danh bạ công khai, mạng xã hội và website công ty để tạo danh sách khách hàng tiềm năng đúng mục tiêu — khỏi phải mua file lead lỗi thời hoặc cầu trời cho thực tập sinh không bỏ cuộc giữa chừng vì copy-paste (). Đội marketing và ecommerce dùng web extractor để theo dõi giá đối thủ, giám sát tồn kho và benchmark sản phẩm theo thời gian thực — John Lewis chẳng hạn, ghi nhận web scraping giúp tăng 4% doanh số chỉ nhờ định giá thông minh hơn ().

Nhưng không chỉ là chuyện con số. Web extractor tiết kiệm cực nhiều thời gian (có người nói tiết kiệm “hàng trăm giờ” nhờ tự động hóa thu thập dữ liệu) và giảm sai sót do con người (). Đội vận hành giờ có thể set scraper chạy đều đều để gom dữ liệu — thứ mà trước đây thực tập sinh phải cày cả tuần — giải phóng hàng giờ bị “đốt” vào các việc copy-paste nhàm chán (). Và với các công cụ trích xuất có AI, ngay cả người không rành kỹ thuật cũng có thể biến website thành dữ liệu có cấu trúc để phân tích ().

Chốt lại: nếu tới năm 2026 bạn vẫn chưa dùng web extractor, khả năng cao là bạn đang bỏ lỡ insight (và tiền) ngay trước mắt.

Cách chúng tôi chọn Top 12 công cụ trích xuất dữ liệu web

Giữa cả rừng công cụ web extracting, chọn cái hợp không hề đơn giản. Mình đã nghía qua hàng chục lựa chọn, nhưng chỉ 12 cái lọt vào danh sách này. Các tiêu chí mình ưu tiên gồm:

- Dễ dùng: Người không kỹ thuật có thể vào việc nhanh mà không cần viết code không? Mình ưu tiên công cụ no-code/low-code, giao diện trực quan ().

- Khả năng AI: Thế hệ công cụ mới dùng AI để đơn giản hóa việc trích xuất — tự nhận diện trường dữ liệu, xử lý điều hướng trang, hoặc cho phép mô tả nhu cầu bằng ngôn ngữ tự nhiên ().

- Tự động hóa & Lập lịch: Web extractor tốt phải chạy “tự động”. Mình chọn các công cụ hỗ trợ lập lịch trích xuất định kỳ hoặc theo dõi website ().

- Xuất dữ liệu & Tích hợp: Có xuất dễ sang Excel, Google Sheets, Airtable, Notion không? Có điểm cộng nếu tích hợp workflow mượt ().

- Khả năng mở rộng & Độ ổn định: Dù bạn trích xuất 1 trang hay hàng nghìn trang, công cụ vẫn phải “gánh” được. Mình cũng xem review người dùng về độ tin cậy.

- Phù hợp bài toán doanh nghiệp: Mình ưu tiên công cụ được sales/marketing/ecommerce/ops dùng nhiều — không chỉ dành cho developer.

Trong danh sách có cả “tân binh” chạy AI lẫn những cái tên kinh điển. Điểm chung: tất cả đều hướng tới việc giúp bạn biến web thành cơ sở dữ liệu phục vụ kinh doanh — mà không phải đau đầu.

So sánh nhanh: 12 công cụ trích xuất dữ liệu web trong một bảng

Dưới đây là ảnh chụp nhanh 12 công cụ mình sẽ nói tới, để bạn dễ hình dung chúng khác nhau thế nào:

| Tool | AI Automation | Ease of Use | Best Use Case |

|---|---|---|---|

| Thunderbit | Có – AI gợi ý trường dữ liệu và tự xử lý trang | Rất dễ (Chrome extension, không cần code) | Trích xuất nhanh lead, giá… cho người không kỹ thuật muốn có kết quả trong vài phút. |

| Octoparse | Hạn chế (dựa trên template, không có AI) | Dễ với đa số (kéo-thả trực quan) | Xây workflow trích xuất tùy biến (đăng nhập, phân trang) cho analyst muốn kiểm soát mà không cần code. |

| Browse AI | Một phần – “robot” point-and-click | Dễ (no-code, chạy cloud) | Theo dõi dữ liệu tự động (giá, listing…) theo lịch, có cảnh báo và tích hợp. |

| WebScraper.io | Không (cấu hình thủ công) | Trung bình (extension + thiết lập sitemap) | Trích xuất trực quan website nhiều tầng cho người sẵn sàng cấu hình các bước. |

| ScraperAPI | N/A (dịch vụ API, xử lý proxy qua API) | Cần code (tích hợp API) | Trích xuất dữ liệu khối lượng lớn cho team kỹ thuật — xử lý proxy & CAPTCHA cho scraping quy mô lớn. |

| Data Miner | Không | Rất dễ (extension + template 1 click) | Trích xuất nhanh theo nhu cầu từ trang (đặc biệt bảng/danh sách) ra CSV/Excel. |

| Simplescraper | Không (có vài tính năng hỗ trợ AI) | Dễ (tạo “recipe” bằng point-and-click) | Scraping no-code kèm tích hợp — phù hợp đẩy dữ liệu sang Google Sheets, Airtable hoặc API. |

| Instant Data Scraper | Có – tự nhận diện bảng dữ liệu | Rất dễ (chỉ bấm, gần như không cần setup) | Trích xuất miễn phí tức thì bảng HTML và danh sách cho mọi đối tượng (lý tưởng khi cần nhanh). |

| ScrapeStorm | Có – AI nhận diện phần tử trang | Dễ (giao diện trực quan; app đa nền tảng) | Dự án scraping lớn/khó mà không cần code, có cả crawl theo lịch. |

| Apify | Một phần – có “actor” dựng sẵn | Trung bình (web interface; có thể không cần code) | Scraping cloud mở rộng và tự động hóa bằng script dựng sẵn hoặc tùy biến. |

| ParseHub | Không (không cần script nhưng setup thủ công) | Dễ cho nhu cầu cơ bản (visual editor; app desktop) | Trích xuất site động/phức tạp (AJAX) qua giao diện no-code. |

| OutWit Hub | Không | Dễ (ứng dụng desktop GUI) | Trích xuất đơn giản, chạy offline và lưu trữ nội dung cho dự án nhỏ. |

Hầu hết công cụ đều có gói miễn phí hoặc dùng thử và các mức thuê bao theo tầng. Ở đây mình tập trung vào năng lực và tình huống sử dụng hơn là giá.

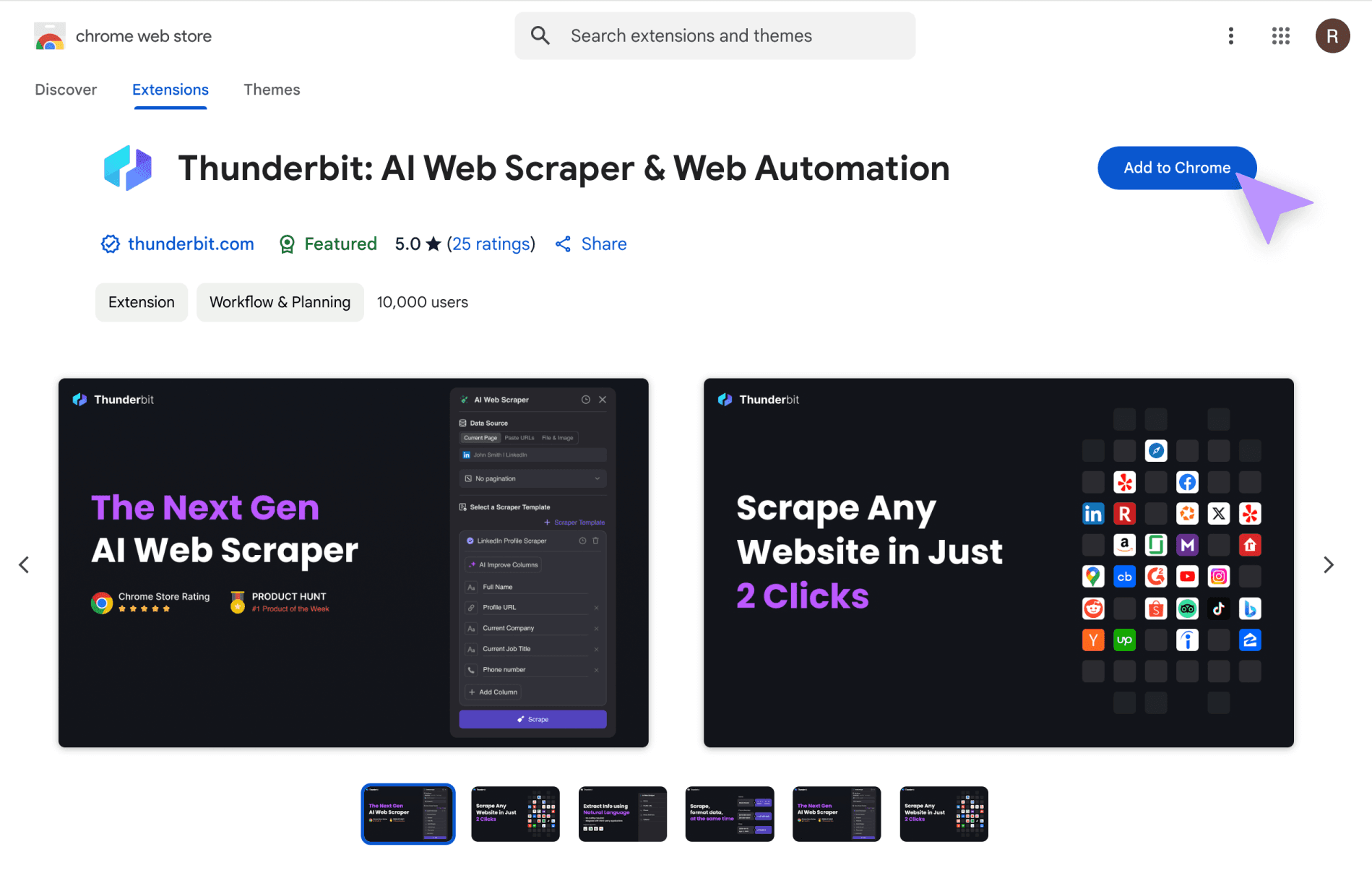

Thunderbit: Công cụ trích xuất dữ liệu web dùng AI cho mọi người

Bắt đầu với Thunderbit — đúng, “con cưng” của mình, nhưng khoan hãy lướt vội. Ngành web extracting đang chuyển từ kiểu “tự cấu hình scraper” sang “chỉ cần nói cho AI biết bạn muốn gì”. Thunderbit là công cụ đầu tiên mình từng thấy (và tham gia xây dựng) mang cảm giác như một trợ lý dữ liệu AI đúng nghĩa, chứ không chỉ là một “crawler” nữa.

Với , bạn không cần đụng XPath, CSS selector hay regex. Bạn chỉ cần mô tả bằng tiếng Anh đơn giản — ví dụ “lấy tiêu đề, tác giả và ngày đăng từ trang này” — AI của Thunderbit sẽ lo phần còn lại (). Bấm “AI Suggest Fields”, Thunderbit sẽ đọc trang, đề xuất các cột phù hợp, và còn tự xử lý subpage lẫn phân trang ().

Thunderbit không chỉ “lấy dữ liệu”. Nó còn có thể làm sạch, chuyển đổi, phân loại, thậm chí dịch dữ liệu ngay trong lúc trích xuất. Bạn cần chuẩn hóa số điện thoại, tóm tắt mô tả, hay dịch tên sản phẩm? Chỉ cần thêm một chỉ dẫn ngắn, AI sẽ xử lý. Xong xuôi, bạn có thể xuất thẳng sang Excel, Google Sheets, Airtable hoặc Notion ().

Điểm khác biệt lớn nhất của Thunderbit là không cần setup, gần như không cần học. Đây là Chrome extension nên bạn có thể dùng trong vài giây. Không plugin rườm rà, không cấu hình phức tạp, không thuật ngữ kỹ thuật. Vì vậy nó được đội sales, marketing và ops cực chuộng — những người cần kết quả nhanh (). Gói miễn phí cho phép bạn thử trọn quy trình, còn gói trả phí thì khá “dễ thở” (kiểu “rẻ hơn tiền cà phê mỗi tháng” với nhiều team).

Nếu bạn muốn cảm nhận web extracting bằng AI thực sự nó “đã” thế nào, hãy và thử ngay. Biết đâu những ngày copy-paste của bạn sẽ chính thức “nghỉ hưu”.

Octoparse: Web extractor trực quan cho workflow tùy biến

Octoparse là “cây đa cây đề” trong mảng web scraping trực quan. Đây là ứng dụng desktop với giao diện point-and-click — bạn thao tác trực tiếp trên trang web, chọn dữ liệu cần lấy, và Octoparse sẽ dựng workflow phía sau (). Bạn có thể xử lý đăng nhập, thiết lập phân trang, thậm chí tự động submit form — tất cả không cần viết code.

Điểm mạnh của Octoparse là thư viện hơn 500 template dựng sẵn cho các site phổ biến (Amazon, Twitter, LinkedIn…), nên nhiều khi chỉ cần mở template là trích xuất được ngay (). Với site phức tạp hơn, bạn có thể chuyển sang chế độ thủ công để cấu hình từng bước bằng thao tác trực quan. Octoparse hỗ trợ trích xuất nội dung tải sau khi click/scroll, có thể dùng proxy và giải CAPTCHA cho các job khó. Ngoài ra còn có tùy chọn chạy cloud để lập lịch và chạy quy mô lớn.

Đổi lại, công cụ này có độ “dốc học” nhất định, nhất là khi bạn muốn xử lý tình huống nâng cao. Nhưng với người không lập trình và analyst muốn workflow tùy biến mà không cần code, Octoparse là lựa chọn đáng tin ().

Browse AI: Web extracting tự động với robot dựng sẵn

Browse AI có cách tiếp cận khá hay ho: bạn “huấn luyện robot” bằng cách trỏ và click vào dữ liệu cần lấy, rồi nó học cách trích xuất dữ liệu đó trên các trang tương tự (). Mọi thứ chạy trên cloud và no-code, nên bạn không phải lo script hay server.

Điểm nổi bật của Browse AI là tự động hóa và giám sát. Bạn có thể đặt lịch cho robot chạy định kỳ và nhận cảnh báo khi dữ liệu thay đổi (ví dụ đối thủ giảm giá hoặc có tin tuyển dụng mới). Họ cũng có thư viện robot dựng sẵn cho các tác vụ phổ biến — thường bạn có thể bắt đầu từ mẫu có sẵn rồi chỉnh lại theo nhu cầu ().

Browse AI tích hợp với hàng nghìn ứng dụng qua Zapier và Make, và có thể xuất dữ liệu thẳng sang Google Sheets hoặc qua API/webhook (). Đây là lựa chọn rất hợp cho theo dõi liên tục và thu thập dữ liệu định kỳ, đặc biệt nếu bạn muốn cảnh báo và tích hợp “rảnh tay”.

WebScraper.io: Web page extractor chạy trên trình duyệt

WebScraper.io (thường gọi ngắn là “Web Scraper”) là extension trình duyệt cho phép bạn tạo “sitemap” — bản kế hoạch trực quan về cách điều hướng website và phần tử nào cần trích xuất (). Bạn định nghĩa selector cho dữ liệu cần lấy và các liên kết cần theo (ví dụ “bấm next để phân trang” hoặc “vào từng trang sản phẩm để lấy chi tiết”).

Có chút cần làm quen, nhưng bạn không phải viết code — chỉ chọn phần tử và thiết lập hành động trích xuất. Web Scraper hỗ trợ điều hướng nhiều tầng, phân trang và cả infinite scroll (nhưng bạn phải khai báo các bước thủ công). Vì chạy trong trình duyệt, bạn có thể trích xuất các site cần đăng nhập bằng cách tự đăng nhập trước.

WebScraper.io hợp với nhóm “citizen data analyst” — những người hiểu cấu trúc trang web và muốn một công cụ miễn phí, linh hoạt. Nếu bạn sẵn sàng tự dựng sitemap, đây là “ngựa thồ” khá lì đòn.

ScraperAPI: Web extractor dạng API cho developer và team kỹ thuật

Không phải team nào cũng muốn giao diện point-and-click — đôi khi bạn cần giải pháp backend để đẩy dữ liệu web thẳng vào ứng dụng hoặc database. ScraperAPI là web extractor theo hướng API-first: bạn đưa URL, nó trả về HTML thô hoặc dữ liệu đã trích xuất, đồng thời xử lý các phần “khó nhằn” như proxy, xoay IP theo khu vực, headless browser và CAPTCHA ().

ScraperAPI duy trì hơn 40 triệu proxy tại 50+ quốc gia và xử lý 36 tỷ request mỗi tháng (). Nó hợp nhất cho scraping tự động quy mô lớn, nơi độ ổn định và chống chặn là yếu tố sống còn. Bạn sẽ cần biết code để dùng, nhưng nếu bạn đang build data pipeline hoặc tích hợp scraping vào sản phẩm, ScraperAPI là lựa chọn rất đáng gờm.

Data Miner: Extension Chrome để trích xuất dữ liệu nhanh

Data Miner là Chrome extension dành cho người dùng doanh nghiệp và researcher cần lấy dữ liệu nhanh. Nó cho trải nghiệm point-and-click và thư viện “recipe” dựng sẵn cho các mẫu phổ biến như bảng, danh sách hoặc một số website cụ thể ().

Bạn chỉ cần cài extension, mở trang mục tiêu và bấm icon Data Miner. Chọn recipe có sẵn hoặc tự tạo bằng cách chọn phần tử trên trang. Công cụ này rất hợp cho tác vụ một lần hoặc nhu cầu dữ liệu gấp — ví dụ sales kéo danh sách lead từ danh bạ online, hoặc quản lý ecommerce “soi” giá đối thủ.

Data Miner đơn giản, nằm ngay trong trình duyệt, hợp cho trích xuất tương tác theo nhu cầu.

Simplescraper: Web extractor no-code cho kết quả nhanh

Simplescraper đúng như tên gọi. Đây là Chrome extension no-code (kèm web app) cho phép bạn chọn dữ liệu trực quan trên trang để tạo “recipe” trích xuất (). Bạn có thể theo link để trích xuất subpage, xử lý phân trang, và thậm chí biến job trích xuất thành một API endpoint chỉ với một cú click.

Điểm Simplescraper làm rất ổn là tích hợp — bạn có thể đẩy dữ liệu thẳng sang Google Sheets, Airtable hoặc các công cụ như Zapier (). Ngoài ra còn có cloud scraping và lập lịch cho job định kỳ, cùng tính năng “AI Enhance” để làm sạch/phân tích dữ liệu bằng GPT.

Nếu bạn muốn ra kết quả nhanh và dễ nối vào hệ thống, Simplescraper giống kiểu “dao đa năng” cho web scraping nhẹ.

Instant Data Scraper: Trích xuất nhanh cho bảng và danh sách

Đôi khi bạn chỉ cần dữ liệu ngay và luôn, không muốn setup gì hết. Đó là lúc Instant Data Scraper (IDS) lên sân. Đây là Chrome extension miễn phí nổi tiếng với khả năng trích xuất dữ liệu dạng bảng chỉ bằng một cú click (). Bật extension lên, IDS tự nhận diện bảng hoặc danh sách trên trang. Nó còn có thể xử lý phân trang và infinite scroll bằng cách tự động click qua các trang.

IDS miễn phí 100%, không cần đăng ký, không cần code, không phải chờ. Rất hợp cho nhu cầu trích xuất nhanh, đơn giản hoặc gấp — như sales cần danh sách lead nhanh, hoặc sinh viên lấy dữ liệu từ bảng Wikipedia. Nếu IDS nhận ra dữ liệu của bạn, bạn sẽ có kết quả trong vài giây.

ScrapeStorm: Web extractor chạy cloud có hỗ trợ AI

ScrapeStorm là công cụ web scraping dùng AI kết hợp giao diện trực quan với thuật toán AI mạnh (). Bạn nhập URL, AI của nó sẽ tự nhận diện trường dữ liệu — danh sách, bảng, nút sang trang, v.v.

ScrapeStorm hỗ trợ đa nền tảng (Windows, Mac, Linux) và có cả bản desktop lẫn cloud. Bạn có thể lập lịch, chạy nhiều job song song, và xuất dữ liệu ra Excel, CSV, JSON hoặc upload vào database (). Công cụ này được dùng nhiều trong ecommerce và nghiên cứu thị trường, thậm chí có thể parse dữ liệu từ ảnh hoặc PDF nhờ AI.

Nếu bạn cần một trợ lý thông minh cho dự án scraping lớn hoặc phức tạp, ScrapeStorm đáng để thử.

Apify: Nền tảng tự động hóa + marketplace web extractor

Apify không chỉ là scraper — đây là nền tảng web scraping và tự động hóa. Bạn có thể chạy các “actor” (script scraping hoặc tự động hóa trình duyệt). Điểm “ăn tiền” là marketplace actor dựng sẵn cho các tác vụ phổ biến (). Cần trích xuất toàn bộ review từ một site ecommerce? Khả năng cao đã có actor làm sẵn.

Với developer, Apify cho phép viết scraper bằng Node.js hoặc Python và triển khai trên cloud. Nền tảng này mở rộng tốt, tự động hóa mạnh và tích hợp qua API. Apify hợp nhất cho power user và tổ chức coi dữ liệu web là tài nguyên chiến lược — ví dụ scraping liên tục quy mô lớn hoặc nhúng scraping vào data pipeline.

ParseHub: Web page extractor trực quan cho site phức tạp

ParseHub là ứng dụng desktop (có tùy chọn cloud) nổi tiếng vì xử lý tốt website phức tạp, động. Bạn duyệt site trong giao diện giống trình duyệt, click vào điểm dữ liệu, và ParseHub sẽ dựng scraper cho bạn (). Nó hỗ trợ logic điều kiện, scraping lồng nhau, nội dung AJAX, v.v.

ParseHub thường là lựa chọn “cứu nguy” khi các công cụ khác trích xuất sai. Nó được dùng bởi researcher, analyst và chủ doanh nghiệp nhỏ cần xử lý website khó. Có độ học nhất định, nhưng nếu bạn có site phức tạp cần trích xuất mà không muốn code, ParseHub là lựa chọn rất mạnh.

OutWit Hub: Web extractor desktop cho lưu trữ nội dung

OutWit Hub hơi “cổ điển”, nhưng là ứng dụng desktop rất hợp để thu thập nhiều loại nội dung (link, ảnh, email…) và sắp xếp chúng (). Nó giống sự kết hợp giữa trình duyệt và bảng tính — bạn mở trang, OutWit Hub có thể trích xuất bảng, danh sách, ảnh…

Công cụ này đặc biệt hữu ích cho lưu trữ nội dung hoặc nghiên cứu — như trích xuất toàn bộ bài viết từ forum, hoặc tải về một bộ file. Vì là tool chạy trên máy, bạn chạy cục bộ và giữ dữ liệu riêng tư. OutWit Hub hợp cho tác vụ scraping nhỏ đến vừa khi bạn muốn giao diện desktop đơn giản và chủ động.

Nên chọn web extractor nào cho nhu cầu của bạn?

12 công cụ, vô số tình huống. Vậy nên chọn cái nào? Đây là “phao cứu sinh” mình hay dùng:

-

Cho người mới hoàn toàn hoặc tác vụ nhanh một lần:

Thử Instant Data Scraper cho bảng và danh sách cơ bản (miễn phí và cực nhanh). Data Miner cũng dễ dùng, có nhiều template hơn nếu bạn hay trích xuất các trang tương tự.

-

Cho người không kỹ thuật cần trích xuất định kỳ hoặc cần tích hợp:

Thunderbit có workflow dễ nhất nhờ cách làm dựa trên AI — hợp với người dùng doanh nghiệp cần kết quả nhanh và thường xuyên. Browse AI hợp cho theo dõi liên tục và cảnh báo. Simplescraper rất ổn nếu bạn muốn dữ liệu chảy vào Google Sheets hoặc app nội bộ qua API.

-

Cho website phức tạp hoặc workflow tùy biến mà không cần code:

Chọn công cụ trực quan như Octoparse hoặc ParseHub. Octoparse thân thiện và có nhiều template. ParseHub xử lý site động rất phức tạp và cho phép kiểm soát chi tiết. WebScraper.io cũng tốt nếu bạn sẵn sàng tự cấu hình sitemap.

-

Cho developer/data engineer cần quy mô lớn:

ScraperAPI sinh ra để nhúng web scraping vào phần mềm hoặc chạy dự án lớn. Apify hợp khi bạn cần nền tảng mở rộng tốt kèm marketplace script dựng sẵn hoặc tùy biến.

-

Cho trích xuất nhiều loại nội dung hoặc cần chạy offline:

OutWit Hub là lựa chọn chắc tay để thu thập và lưu trữ nội dung có hệ thống, nhất là khi bạn thích tool desktop để đảm bảo riêng tư hoặc kiểm soát.

Thực tế, nhiều team dùng nhiều công cụ tùy theo việc. Bạn có thể bắt đầu bằng Instant Data Scraper cho việc đơn giản, chuyển sang Thunderbit hoặc Octoparse cho dự án “nặng đô” hơn, và dùng ScraperAPI hoặc Apify khi cần công nghiệp hóa quy trình. Tin vui là đa số công cụ đều có gói miễn phí hoặc dùng thử, nên bạn cứ test rồi chốt cái hợp nhất.

Kết luận: Tương lai của web extracting cho đội ngũ kinh doanh

Công cụ trích xuất dữ liệu web đã đi một chặng đường dài. Đến 2026, chúng đã trở nên phổ biến rộng rãi. Xu hướng lớn nhất? Web scraping ngày càng dễ hơn, tự động hơn và bám sát workflow hằng ngày hơn (). Scraper chạy AI giúp “thuần hóa” cả những website động, phức tạp mà không cần kỹ năng chuyên sâu. Như một data engineer chia sẻ: “Từ khi công cụ AI web scraping xuất hiện, tôi làm việc nhanh hơn và ở quy mô lớn hơn... với AI, [làm sạch dữ liệu] tự động nằm trong workflow của tôi.”

Một thay đổi lớn khác là ranh giới giữa trích xuất, giám sát và tự động hóa ngày càng mờ đi. Các công cụ như Browse AI và Thunderbit không chỉ lấy dữ liệu mà còn giữ dữ liệu luôn cập nhật, thậm chí có thể thực hiện hành động (như điền form hoặc kích hoạt cảnh báo). Làn sóng adoption là có thật — một nền tảng lớn ghi nhận người dùng hoạt động hằng tháng tăng hơn 140% chỉ trong một năm (). Doanh nghiệp mọi quy mô đều nhận ra: tiếp cận dữ liệu web công khai (đúng đạo đức và đúng pháp lý) là chìa khóa để cạnh tranh.

Với các team kinh doanh, thông điệp chính là trao quyền. Bạn không cần chờ developer vài tuần hay ra quyết định theo cảm tính. Những công cụ trong danh sách này đưa sức mạnh dữ liệu web vào tay bạn, với giao diện và tính năng bám sát bài toán thực tế của sales, marketing, vận hành và nhiều hơn nữa. Và với tốc độ phát triển hiện tại, mình kỳ vọng sắp tới sẽ có giao diện thân thiện hơn, AI thông minh hơn và tích hợp sâu hơn với các nền tảng BI/analytics.

Chỉ cần nhớ: tôn trọng điều khoản sử dụng của website và quy tắc robots.txt, đồng thời đảm bảo tuân thủ luật bảo mật dữ liệu. Scraping có đạo đức là yếu tố quan trọng để cách làm này bền vững.

Vì vậy, dù bạn bắt đầu bằng một extension miễn phí hay triển khai “đội quân” scraping cấp doanh nghiệp, chưa bao giờ là thời điểm tốt hơn để biến thông tin trên web thành insight có thể hành động. Cuộc cách mạng web extractor đã tới — chọn một công cụ, thử ngay, và khai mở giá trị đang “nằm lộ thiên”. Tương lai dựa trên dữ liệu của bạn chỉ cách một cú click.

FAQs

1. Web extractor là gì và vì sao quan trọng với doanh nghiệp?

Web extractor là công cụ tự động thu thập dữ liệu có cấu trúc từ website. Nó quan trọng vì giúp doanh nghiệp biến thông tin online rời rạc thành insight có thể hành động — tăng năng suất, cải thiện lợi nhuận và loại bỏ việc thu thập dữ liệu thủ công.

2. Ai có thể dùng web extractor — có cần kỹ năng kỹ thuật không?

Nhiều web extractor hiện đại không yêu cầu kỹ năng kỹ thuật. Các công cụ như Thunderbit, Browse AI và Instant Data Scraper được thiết kế cho người không chuyên, với giao diện trực quan, tự động hóa bằng AI và quy trình no-code.

3. Đội sales, marketing và vận hành hưởng lợi gì từ web extractor?

Sales có thể xây danh sách lead từ danh bạ online, marketing theo dõi giá đối thủ, còn vận hành tự động hóa quy trình thu thập dữ liệu. Những công cụ này tiết kiệm thời gian, giảm lỗi và cung cấp insight mới, đáng tin cậy để ra quyết định chiến lược.

4. Nên chú ý gì khi chọn công cụ web extractor?

Các yếu tố chính gồm: độ dễ dùng, khả năng AI, tính năng tự động/lập lịch, tích hợp với Google Sheets hoặc Airtable, khả năng mở rộng, và mức độ phù hợp với bài toán của bạn (lead sales, theo dõi giá, lưu trữ nội dung…).

5. Có công cụ web extractor miễn phí hoặc chi phí thấp không?

Có. Nhiều công cụ có gói miễn phí hoặc mức giá dễ tiếp cận. Instant Data Scraper miễn phí hoàn toàn cho nhu cầu cơ bản, còn Thunderbit, Simplescraper và Data Miner có gói free khá rộng rãi và có thể nâng cấp khi cần.

Muốn tìm hiểu sâu hơn về web extracting, AI scraping, hoặc cách biến website thành lợi thế tiếp theo của team bạn? Hãy xem thêm tại để đọc các hướng dẫn, mẹo và câu chuyện thực chiến về tự động hóa dữ liệu.