Năm 2015, muốn scrape dữ liệu nghĩa là bạn phải năn nỉ một lập trình viên viết cho mình một script Python, hoặc bỏ cả cuối tuần để tự học XPath. Đến năm 2026, bạn chỉ cần gõ “lấy tất cả tên sản phẩm và giá” là AI sẽ lo phần còn lại.

Sự thay đổi đó diễn ra rất nhanh. Hiện nay có hơn đang dựa vào web scraping. Thị trường đã vượt mốc và dự kiến sẽ tăng gấp đôi vào năm 2030.

Động lực lớn nhất là gì? AI web crawler. Chúng thích nghi với thay đổi bố cục trang, hiểu nội dung trang chứ không chỉ mỗi các thẻ HTML. Và chúng phục vụ cả những người chưa từng viết một dòng code nào.

Tôi đã dành nhiều tháng để thử nghiệm 15 công cụ như vậy. Đây là những gì tôi rút ra — bao gồm cả lý do Thunderbit (vâng, công ty do tôi đồng sáng lập) đứng ở vị trí số 1.

Vì sao AI đang thay đổi cách scrape trang web: Kỷ nguyên mới của công cụ Web Scraper

Nói thẳng nhé: web scraping truyền thống vốn không được sinh ra cho người dùng doanh nghiệp thông thường. Nó xoay quanh code, selector, và cầu mong script của bạn không bị vỡ mỗi khi website đổi bố cục. Nhưng AI và LLM đã lật ngược hoàn toàn cách làm đó.

Cụ thể như sau:

- Hướng dẫn bằng ngôn ngữ tự nhiên: Thay vì vật lộn với code, bạn chỉ cần nói cho AI biết mình muốn gì. Các công cụ như hiểu hướng dẫn bằng tiếng Anh thông thường và tự thiết lập phần trích xuất cho bạn ().

- Học thích nghi: AI scraper có thể trên website, giảm đáng kể gánh nặng bảo trì.

- Xử lý nội dung động: Các trang hiện đại rất chuộng JavaScript và cuộn vô hạn. Công cụ dùng AI có thể tương tác với những thành phần này, lấy được dữ liệu mà scraper kiểu cũ sẽ bỏ sót.

- Đầu ra có cấu trúc nhờ AI parsing: Các scraper dựa trên LLM thực sự và xuất dữ liệu sạch, có cấu trúc.

- Tự động né chống bot: AI scraper có thể và dùng proxy/headless browser để tránh bị chặn IP.

- Quy trình dữ liệu tích hợp sẵn: Những công cụ tốt nhất không chỉ lấy dữ liệu — chúng đưa dữ liệu đến đúng nơi bạn cần, với khả năng xuất chỉ bằng một cú nhấp vào Google Sheets, Airtable, Notion và nhiều nơi khác ().

Kết quả là gì? Web scraping giờ đã trở thành trải nghiệm kiểu nhấp-chọn, thậm chí giống trò chuyện, mở ra cơ hội để các đội sales, marketing và vận hành — chứ không chỉ developer — khai thác trực tiếp dữ liệu web.

15 AI Web Crawler đáng để bạn chú ý trong năm 2026

Hãy cùng mổ xẻ 15 AI web crawler hàng đầu, bắt đầu với Thunderbit. Tôi sẽ nói rõ về tính năng cốt lõi, người dùng mục tiêu, mức giá và điều gì khiến mỗi công cụ nổi bật. Và đúng vậy, tôi cũng sẽ nói thật về điểm mạnh lẫn điểm yếu của từng cái.

1. Thunderbit: AI Web Scraper cho tất cả mọi người

Hiển nhiên là tôi có hơi thiên vị ở đây, nhưng Thunderbit chính là AI web scraper mà tôi ước mình đã có từ nhiều năm trước. Đây là lý do nó đứng #1 trong danh sách này:

- Trích xuất bằng ngôn ngữ tự nhiên: Bạn “chat” với Thunderbit. Chỉ cần mô tả dữ liệu bạn muốn — “scrape tất cả tên sản phẩm và giá trên trang này” — là AI sẽ làm phần còn lại (). Không code, không selector, không đau đầu.

- Thu thập cấp phụ trang & nhiều tầng: Thunderbit có thể . Ví dụ, bạn có thể scrape danh sách sản phẩm rồi mở từng sản phẩm để lấy chi tiết, tất cả chỉ trong một lần chạy.

- Đầu ra có cấu trúc ngay lập tức: AI , gợi ý các trường liên quan, chuẩn hóa định dạng, thậm chí tóm tắt hoặc phân loại văn bản.

- Hỗ trợ nhiều nguồn dữ liệu: Thunderbit không chỉ dành cho HTML — nó còn có thể trích xuất từ PDF và hình ảnh bằng OCR tích hợp sẵn cùng vision AI ().

- Tích hợp cho doanh nghiệp: Xuất chỉ bằng một cú nhấp sang Google Sheets, Airtable, Notion hoặc Excel (). Lên lịch scrape và đẩy dữ liệu thẳng vào quy trình làm việc của đội bạn.

- Mẫu dựng sẵn: Với các trang như Amazon, LinkedIn, Zillow, v.v., Thunderbit cung cấp để trích xuất dữ liệu chỉ với một cú nhấp.

- Thân thiện và dễ tiếp cận: Giao diện kiểu nhấp-chọn, có trợ lý trực quan. Người dùng thường báo rằng họ có thể bắt đầu dùng trong vài phút.

Thunderbit được hơn tin dùng, bao gồm các đội ngũ tại Accenture, Grammarly và Puma. Các đội sales dùng nó để , môi giới bất động sản tổng hợp danh sách nhà đất, còn marketer thì theo dõi đối thủ — tất cả mà không cần viết một dòng code nào.

Giá: Có (scrape tối đa 100 bước/tháng), với gói trả phí từ 14,99 USD/tháng. Ngay cả các gói chuyên nghiệp cũng khá hợp túi tiền với cá nhân và đội nhóm nhỏ.

Thunderbit là thứ gần nhất mà tôi từng thấy với ý tưởng “biến web thành một cơ sở dữ liệu” — và nó được xây cho tất cả mọi người, không chỉ kỹ sư.

2. Crawl4AI

Phù hợp với: Developer và đội kỹ thuật đang xây dựng pipeline tùy chỉnh.

Crawl4AI là một framework mã nguồn mở, viết bằng Python, được tối ưu cho tốc độ và thu thập quy mô lớn, với . Nó rất nhanh, hỗ trợ headless browser cho nội dung động, và có thể cấu trúc dữ liệu đã scrape để dễ đưa vào quy trình AI.

- Tốt nhất cho: Developer cần một engine thu thập mạnh mẽ, tùy biến cao.

- Giá: Miễn phí (giấy phép MIT). Bạn sẽ phải tự host và vận hành.

3. ScrapeGraphAI

Phù hợp với: Developer và analyst xây dựng AI agent hoặc pipeline dữ liệu phức tạp.

ScrapeGraphAI là một thư viện Python mã nguồn mở, điều khiển bằng prompt, biến website thành các “graph” dữ liệu có cấu trúc bằng LLM. Bạn có thể viết prompt như “Trích xuất tất cả tên sản phẩm, giá và đánh giá từ 5 trang đầu,” và nó sẽ dựng cho bạn một quy trình scraping ().

- Tốt nhất cho: Người có nền tảng kỹ thuật muốn scraping linh hoạt, dựa trên prompt.

- Giá: Miễn phí cho thư viện mã nguồn mở; cloud API từ 20 USD/tháng.

4. Firecrawl

Phù hợp với: Developer xây AI agent hoặc pipeline dữ liệu quy mô lớn.

Firecrawl là một nền tảng và API thu thập dữ liệu mang tính AI, biến toàn bộ website thành dữ liệu “sẵn sàng cho LLM” (). Nó xuất ra Markdown hoặc JSON, xử lý nội dung động và tích hợp với các framework như LangChain và LlamaIndex.

- Tốt nhất cho: Developer cần đưa dữ liệu web trực tiếp vào mô hình AI.

- Giá: Phần lõi mã nguồn mở miễn phí; gói cloud từ 19 USD/tháng.

5. Browse AI

Phù hợp với: Người dùng doanh nghiệp, growth hacker và analyst.

Browse AI là một nền tảng không cần code với . Bạn “huấn luyện” một robot bằng cách nhấp vào dữ liệu mình muốn, rồi AI sẽ khái quát mẫu đó cho những lần scrape sau. Nó xử lý đăng nhập, cuộn vô hạn, và có thể theo dõi website để phát hiện thay đổi.

- Tốt nhất cho: Người không rành kỹ thuật nhưng muốn tự động hóa việc thu thập và theo dõi dữ liệu.

- Giá: Gói miễn phí (50 credit/tháng); gói trả phí từ 19 USD/tháng.

6. LLM Scraper

Phù hợp với: Developer muốn AI lo phần phân tích cú pháp.

LLM Scraper là một thư viện JavaScript/TypeScript mã nguồn mở cho phép bạn rồi để LLM trích xuất dữ liệu đó từ bất kỳ trang web nào. Nó được xây trên Playwright, hỗ trợ nhiều nhà cung cấp LLM, và thậm chí có thể tạo mã có thể tái sử dụng.

- Tốt nhất cho: Developer muốn biến bất kỳ trang web nào thành dữ liệu có cấu trúc bằng LLM.

- Giá: Miễn phí (giấy phép MIT).

7. Reader (Jina Reader)

Phù hợp với: Developer xây ứng dụng LLM, chatbot hoặc công cụ tóm tắt.

Jina Reader là một API trích xuất , trả về Markdown hoặc JSON sẵn sàng cho LLM. Nó được vận hành bởi một mô hình AI tùy chỉnh và còn có thể tạo mô tả cho hình ảnh.

- Tốt nhất cho: Lấy nội dung sạch, dễ đọc để đưa vào LLM hoặc hệ thống hỏi đáp.

- Giá: API miễn phí (không cần key cho nhu cầu cơ bản).

8. Bright Data

Phù hợp với: Doanh nghiệp và người dùng chuyên nghiệp cần quy mô, tính tuân thủ và độ tin cậy.

Bright Data là một “ông lớn” trong ngành dữ liệu web, sở hữu mạng proxy khổng lồ cùng các . Nó cung cấp các scraper dựng sẵn, Web Scraper API đa dụng và nguồn cấp dữ liệu “sẵn sàng cho LLM”.

- Tốt nhất cho: Tổ chức cần dữ liệu web đáng tin cậy ở quy mô lớn.

- Giá: Tính theo mức sử dụng, thuộc phân khúc cao cấp. Có dùng thử miễn phí.

9. Octoparse

Phù hợp với: Người dùng không kỹ thuật đến bán kỹ thuật.

Octoparse là một công cụ không cần code, đã có mặt lâu năm, với và tự động phát hiện bằng AI. Nó xử lý đăng nhập, cuộn vô hạn và có thể xuất dữ liệu ở nhiều định dạng.

- Tốt nhất cho: Analyst, chủ doanh nghiệp nhỏ hoặc nhà nghiên cứu.

- Giá: Có gói miễn phí; gói trả phí từ 119 USD/tháng.

10. Apify

Phù hợp với: Developer và đội kỹ thuật cần scraping/tự động hóa tùy chỉnh.

Apify là một nền tảng cloud để chạy các script scraping (“actors”) và có . Nó có khả năng mở rộng, tích hợp với AI và hỗ trợ quản lý proxy.

- Tốt nhất cho: Developer muốn chạy script tùy chỉnh trên cloud.

- Giá: Có gói miễn phí; gói trả phí theo mức sử dụng từ 49 USD/tháng.

11. Zyte (Scrapy Cloud)

Phù hợp với: Developer và công ty cần scraping cấp doanh nghiệp.

Zyte là công ty đứng sau Scrapy, cung cấp nền tảng cloud và . Nó xử lý lập lịch, proxy và các dự án quy mô lớn.

- Tốt nhất cho: Đội dev chạy các dự án scraping dài hạn.

- Giá: Từ dùng thử miễn phí đến các gói doanh nghiệp tùy chỉnh.

12. Webscraper.io

Phù hợp với: Người mới bắt đầu, nhà báo và nhà nghiên cứu.

là một để trích xuất dữ liệu kiểu nhấp-chọn. Nó đơn giản, miễn phí khi dùng cục bộ, và có dịch vụ cloud cho những công việc lớn hơn.

- Tốt nhất cho: Các tác vụ scrape nhanh, chỉ làm một lần.

- Giá: Tiện ích miễn phí; gói cloud từ khoảng 50 USD/tháng.

13. ParseHub

Phù hợp với: Người không kỹ thuật nhưng cần mạnh hơn các công cụ cơ bản.

ParseHub là một ứng dụng desktop có quy trình làm việc trực quan để scrape nội dung động, bao gồm bản đồ và biểu mẫu. Nó có thể chạy dự án trên cloud và có API.

- Tốt nhất cho: Digital marketer, analyst và nhà báo.

- Giá: Có gói miễn phí (200 trang/lần chạy); gói trả phí từ 189 USD/tháng.

14. Diffbot

Phù hợp với: Doanh nghiệp và công ty AI cần dữ liệu web có cấu trúc ở quy mô lớn.

Diffbot dùng computer vision và NLP để từ bất kỳ trang web nào, cung cấp API cho bài viết, sản phẩm và một knowledge graph khổng lồ.

- Tốt nhất cho: Market intelligence, tài chính và dữ liệu huấn luyện AI.

- Giá: Phân khúc cao cấp, từ khoảng 299 USD/tháng.

15. DataMiner

Phù hợp với: Người không kỹ thuật, đặc biệt trong sales, marketing và báo chí.

DataMiner là một để trích xuất dữ liệu web nhanh theo kiểu nhấp-chọn. Nó có thư viện “công thức” dựng sẵn và có thể xuất trực tiếp sang Google Sheets.

- Tốt nhất cho: Các tác vụ nhanh như xuất bảng hoặc danh sách sang bảng tính.

- Giá: Gói miễn phí (500 trang/ngày); bản Pro từ khoảng 19 USD/tháng.

So sánh các công cụ AI Web Scraper hàng đầu: Công cụ nào phù hợp với bạn?

Dưới đây là bảng so sánh tổng quan để giúp bạn tìm ra lựa chọn phù hợp:

| Công cụ | Mức dùng AI/LLM | Dễ sử dụng | Đầu ra/Tích hợp | Phù hợp nhất cho | Giá |

|---|---|---|---|---|---|

| Thunderbit | Giao diện ngôn ngữ tự nhiên; AI gợi ý trường dữ liệu | Dễ nhất (chat không cần code) | Xuất sang Sheets, Airtable, Notion | Đội ngũ không rành kỹ thuật | Gói miễn phí; Pro khoảng 30 USD/tháng |

| Crawl4AI | Thu thập dữ liệu sẵn sàng cho AI; tích hợp LLM | Khó (code Python) | Thư viện/CLI; tích hợp qua code | Developer cần pipeline dữ liệu AI nhanh | Miễn phí |

| ScrapeGraphAI | Pipeline scrape bằng prompt LLM | Trung bình (cần chút code hoặc API) | API/SDK; đầu ra JSON | Developer/analyst xây AI agent | OSS miễn phí; API từ 20+ USD/tháng |

| Firecrawl | Crawl ra Markdown/JSON sẵn sàng cho LLM | Trung bình (dùng API/SDK) | SDK (Py, Node, v.v.); tích hợp LangChain | Developer tích hợp dữ liệu web trực tiếp vào AI | Miễn phí + cloud trả phí |

| Browse AI | AI hỗ trợ nhấp-chọn | Dễ (không cần code) | Hơn 7000 tích hợp ứng dụng (Zapier) | Người không rành kỹ thuật, tự động hóa giám sát web | Miễn phí 50 lượt chạy; trả phí từ 19+ USD/tháng |

| LLM Scraper | Dùng LLM để phân tích trang theo schema | Khó (code TS/JS) | Thư viện code; đầu ra JSON | Developer muốn AI lo phần parsing | Miễn phí (dùng API LLM của riêng bạn) |

| Reader (Jina) | Mô hình AI trích xuất văn bản/JSON | Dễ (gọi API đơn giản) | REST API trả về Markdown/JSON | Developer thêm tìm kiếm/nội dung web vào LLM | API miễn phí |

| Bright Data | API scraping tăng cường AI; mạng proxy lớn | Khó (API, kỹ thuật) | API/SDK; luồng dữ liệu hoặc tập dữ liệu | Doanh nghiệp quy mô lớn | Tính theo mức dùng |

| Octoparse | Tự động phát hiện danh sách bằng AI | Trung bình (ứng dụng không cần code) | CSV/Excel, API cho kết quả | Người dùng bán kỹ thuật | Miễn phí giới hạn; 59–166 USD/tháng |

| Apify | Một số tính năng AI (Actors, hướng dẫn AI) | Khó (code script) | API toàn diện; tích hợp LangChain | Developer cần scraping tùy chỉnh trên cloud | Gói miễn phí; trả theo mức sử dụng |

| Zyte (Scrapy) | Tự động trích xuất dựa trên ML; framework Scrapy | Khó (code Python) | API, giao diện Scrapy Cloud; JSON/CSV | Đội dev, dự án dài hạn | Giá tùy chỉnh |

| Webscraper.io | Không có AI (template thủ công) | Dễ (tiện ích trình duyệt) | Tải CSV, Cloud API | Người mới, scrape nhanh một lần | Tiện ích miễn phí; Cloud khoảng 50 USD/tháng |

| ParseHub | Không có LLM rõ ràng; trình dựng trực quan | Trung bình (ứng dụng không cần code) | JSON/CSV; API cho lần chạy cloud | Người không dev, scrape site phức tạp | Miễn phí 200 trang; Trả phí từ 189+ USD/tháng |

| Diffbot | AI vision/NLP cho mọi trang; knowledge graph | Dễ (chỉ gọi API) | API (Article/Sản phẩm/...) + truy vấn Knowledge Graph | Doanh nghiệp, dữ liệu web có cấu trúc | Từ khoảng 299 USD/tháng |

| DataMiner | Không dùng LLM; công thức do cộng đồng chia sẻ | Dễ nhất (giao diện trình duyệt) | Xuất Excel/CSV; Google Sheets | Người không rành kỹ thuật, scrape sang bảng tính | Miễn phí giới hạn; Pro khoảng 19 USD/tháng |

Phân loại công cụ: Từ “cỗ máy” dành cho developer đến web scraper thân thiện với doanh nghiệp

Để hiểu rõ danh sách này, hãy chia các công cụ thành vài nhóm:

1. Các cỗ máy mạnh mẽ dành cho developer và mã nguồn mở

- Ví dụ: Crawl4AI, LLM Scraper, Apify, Zyte/Scrapy, Firecrawl

- Điểm mạnh: Linh hoạt cao, mở rộng tốt, tùy biến mạnh. Rất phù hợp để xây pipeline riêng hoặc tích hợp với mô hình AI.

- Đánh đổi: Cần kỹ năng code và cấu hình nhiều hơn.

- Trường hợp sử dụng: Xây dựng pipeline dữ liệu tùy chỉnh, scrape các site phức tạp, hoặc tích hợp với hệ thống nội bộ.

2. Các agent scraping tích hợp AI

- Ví dụ: Thunderbit, ScrapeGraphAI, Firecrawl, Reader (Jina), LLM Scraper

- Điểm mạnh: Thu hẹp khoảng cách giữa việc scrape và việc hiểu dữ liệu. Giao diện ngôn ngữ tự nhiên khiến chúng dễ tiếp cận hơn.

- Đánh đổi: Một số công cụ vẫn đang phát triển; có thể chưa cho phép kiểm soát quá chi tiết.

- Trường hợp sử dụng: Lấy câu trả lời hoặc tập dữ liệu nhanh, xây dựng agent tự trị, hoặc cấp dữ liệu sống cho LLM.

3. Các scraper không cần code/ít code, thân thiện với doanh nghiệp

- Ví dụ: Thunderbit, Browse AI, Octoparse, ParseHub, , DataMiner

- Điểm mạnh: Dễ dùng, hầu như không cần code, phù hợp cho công việc kinh doanh thường xuyên.

- Đánh đổi: Có thể gặp khó với site cực kỳ phức tạp hoặc quy mô quá lớn.

- Trường hợp sử dụng: Tạo lead, theo dõi đối thủ, dự án nghiên cứu và lấy dữ liệu một lần.

4. Nền tảng và dịch vụ dữ liệu cấp doanh nghiệp

- Ví dụ: Bright Data, Diffbot, Zyte

- Điểm mạnh: Giải pháp toàn diện, dịch vụ quản lý, tuân thủ và độ tin cậy ở quy mô lớn.

- Đánh đổi: Chi phí cao hơn, cần thời gian triển khai nhiều hơn.

- Trường hợp sử dụng: Pipeline dữ liệu chạy liên tục ở quy mô lớn, market intelligence và dữ liệu huấn luyện AI.

Cách chọn AI Web Crawler phù hợp cho nhu cầu scrape trang web của bạn

Chọn đúng công cụ có thể khiến bạn thấy choáng ngợp, nên dưới đây là hướng dẫn từng bước của tôi:

- Xác định mục tiêu và nhu cầu dữ liệu: Bạn cần scrape site nào và loại dữ liệu gì? Bao lâu một lần? Số lượng bao nhiêu? Bạn sẽ dùng dữ liệu đó để làm gì?

- Đánh giá năng lực kỹ thuật của bạn: Không biết code? Hãy thử Thunderbit, Browse AI hoặc Octoparse. Có biết chút scripting? LLM Scraper hoặc DataMiner. Mạnh về dev? Crawl4AI, Apify hoặc Zyte.

- Cân nhắc tần suất và quy mô: Làm một lần? Dùng công cụ miễn phí. Lặp lại thường xuyên? Tìm tính năng lên lịch. Quy mô lớn? Dùng công cụ doanh nghiệp hoặc mã nguồn mở ở quy mô lớn.

- Ngân sách và mô hình giá: Gói miễn phí rất tốt để thử nghiệm. Chọn thuê bao hay tính theo mức dùng tùy vào nhu cầu của bạn.

- Thử nghiệm và chứng minh hiệu quả: Hãy test vài công cụ trên chính dữ liệu thật của bạn. Phần lớn đều có gói miễn phí.

- Bảo trì và hỗ trợ: Nếu website thay đổi thì ai sẽ sửa? Công cụ không cần code có AI có thể tự sửa các thay đổi nhỏ; còn mã nguồn mở thì phụ thuộc vào bạn hoặc cộng đồng.

- Ghép công cụ với tình huống thực tế: Đội sales scrape lead? Thunderbit hoặc Browse AI. Nhà nghiên cứu thu thập tweet? DataMiner hoặc . Mô hình AI cần bài báo? Jina Reader hoặc Zyte. Xây website so sánh? Apify hoặc Zyte.

- Chuẩn bị phương án dự phòng: Đôi khi một công cụ sẽ không hoạt động với một website cụ thể. Hãy có sẵn phương án thay thế.

“Đúng” không phải là công cụ hào nhoáng nhất, mà là công cụ lấy được dữ liệu bạn cần với ít ma sát nhất và trong ngân sách của bạn. Đôi khi, đó còn là sự kết hợp của nhiều công cụ.

Thunderbit so với các công cụ Web Scraper truyền thống: Điều gì khiến nó nổi bật?

Hãy đi vào chi tiết lý do Thunderbit khác biệt:

- Giao diện ngôn ngữ tự nhiên: Không code, không phải thao tác nhấp-chọn rườm rà. Chỉ cần mô tả điều bạn muốn ().

- Không cần cấu hình và có gợi ý mẫu: Thunderbit tự động phát hiện phân trang, phụ trang, và thậm chí gợi ý mẫu cho các site phổ biến ().

- Làm sạch và làm giàu dữ liệu bằng AI: Tóm tắt, phân loại, dịch và làm giàu dữ liệu ngay trong quá trình scrape ().

- Ít đau đầu bảo trì hơn: AI của Thunderbit bền bỉ trước những thay đổi nhỏ của website, giúp giảm lỗi vỡ quy trình.

- Tích hợp với công cụ doanh nghiệp: Xuất trực tiếp sang Google Sheets, Airtable, Notion — không còn phải loay hoay với CSV ().

- Nhanh chóng tạo giá trị: Từ ý tưởng đến dữ liệu chỉ trong vài phút, không phải vài ngày.

- Đường cong học tập: Chỉ cần bạn biết lướt web và mô tả thứ mình cần, bạn đã có thể dùng Thunderbit.

- Tính thích nghi: Scrape website, PDF, hình ảnh và nhiều hơn nữa — tất cả bằng cùng một công cụ.

Thunderbit không chỉ là một scraper — nó là một trợ lý dữ liệu hòa vào quy trình làm việc của bạn, dù bạn đang ở sales, marketing, ecommerce hay bất động sản.

Các thực hành tốt nhất khi scrape trang web bằng công cụ AI Web Scraper

Để tận dụng tối đa AI web scraper, đây là những mẹo hàng đầu của tôi:

- Xác định rõ nhu cầu dữ liệu: Biết rõ bạn muốn những trường nào, bao nhiêu trang và định dạng cần dùng.

- Tận dụng gợi ý từ AI: Dùng khả năng phát hiện trường và gợi ý AI của công cụ để không bỏ sót dữ liệu quan trọng ().

- Bắt đầu nhỏ và kiểm tra: Test trên một mẫu nhỏ, xem lại đầu ra và điều chỉnh khi cần.

- Xử lý nội dung động: Đảm bảo công cụ của bạn hỗ trợ nội dung động và các tương tác như phân trang, cuộn vô hạn, v.v.

- Tôn trọng chính sách của website: Kiểm tra robots.txt, tránh scrape dữ liệu nhạy cảm và tôn trọng giới hạn tốc độ.

- Tích hợp để tự động hóa: Dùng tính năng xuất dữ liệu và webhook để đưa dữ liệu scrape trực tiếp vào workflow của bạn.

- Duy trì chất lượng dữ liệu: Kiểm tra tính hợp lý của dữ liệu, hậu xử lý và theo dõi lỗi.

- Prompt ngắn gọn, rõ ràng: Khi dùng công cụ chạy bằng AI, hướng dẫn cụ thể và rõ ràng sẽ cho kết quả tốt hơn.

- Học từ cộng đồng: Tham gia forum và cộng đồng để nhận mẹo và cách xử lý sự cố.

- Luôn cập nhật: Công cụ AI thay đổi rất nhanh — hãy theo dõi các tính năng và cải tiến mới.

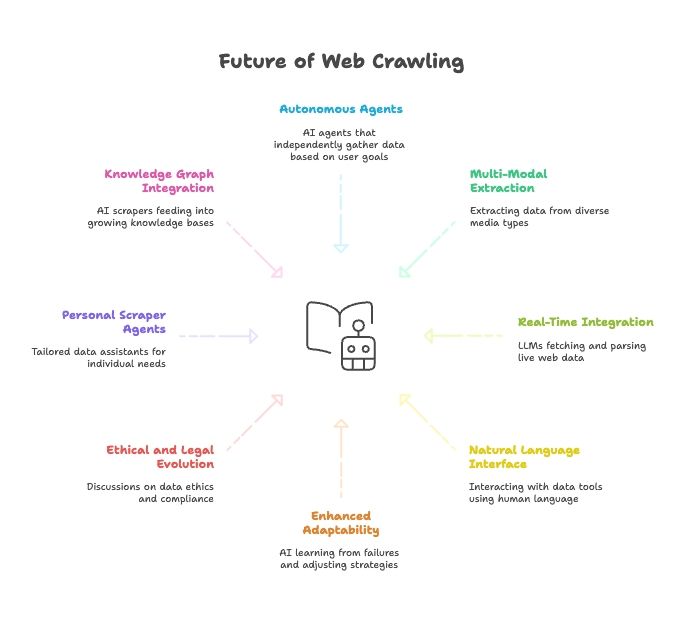

Tương lai của web scraping: AI, LLM và sự trỗi dậy của các agent Web Scraper bằng ngôn ngữ tự nhiên

Nhìn về phía trước, sự hội tụ giữa AI và web scraping chỉ đang tăng tốc:

- Agent scraper tự động hoàn toàn: Sớm thôi, bạn chỉ cần nói cho một AI agent mục tiêu cuối cùng, và nó sẽ tự tìm cách lấy dữ liệu.

- Trích xuất dữ liệu đa phương thức: Scraper sẽ lấy dữ liệu từ văn bản, hình ảnh, PDF, thậm chí cả video.

- Tích hợp thời gian thực với mô hình AI: LLM sẽ có sẵn các module để tìm nạp và phân tích dữ liệu web trực tiếp.

- Mọi thứ đều bằng ngôn ngữ tự nhiên: Chúng ta sẽ trò chuyện với công cụ dữ liệu như nói chuyện với con người, giúp việc thu thập và chuyển đổi dữ liệu dễ tiếp cận với tất cả mọi người.

- Khả năng thích nghi cao hơn: AI scraper sẽ học từ thất bại và tự động điều chỉnh chiến lược.

- Tiến hóa về đạo đức và pháp lý: Sẽ có nhiều thảo luận hơn về đạo đức dữ liệu, tuân thủ và sử dụng hợp lý.

- Agent scraper cá nhân: Hãy tưởng tượng một trợ lý dữ liệu cá nhân thu thập tin tức, tin tuyển dụng và nhiều thứ khác theo đúng nhu cầu của bạn.

- Tích hợp với knowledge graph: AI scraper sẽ liên tục đổ dữ liệu vào các cơ sở tri thức ngày càng lớn, giúp AI trở nên thông minh hơn.

Tóm lại? Tương lai của web scraping gắn chặt với tương lai của AI. Các công cụ đang ngày càng thông minh hơn, tự chủ hơn và dễ tiếp cận hơn mỗi ngày.

Kết luận: Mở khóa giá trị kinh doanh với AI Web Crawler phù hợp

Nhờ AI, web scraping đã đi từ một kỹ năng kỹ thuật ngách trở thành năng lực cốt lõi của doanh nghiệp. 15 công cụ tôi đã giới thiệu ở đây đại diện cho những gì tốt nhất mà năm 2026 có thể mang lại, từ những “cỗ máy” dành cho developer đến các trợ lý thân thiện với doanh nghiệp.

Bí mật thật sự là gì? Chọn đúng công cụ có thể tăng đáng kể giá trị bạn nhận được từ dữ liệu web. Với các đội không rành kỹ thuật, Thunderbit là cách dễ nhất để biến web thành một cơ sở dữ liệu có cấu trúc, sẵn sàng cho phân tích — không code, không phiền phức, chỉ cần kết quả.

Vì vậy, dù bạn đang thu thập lead, theo dõi đối thủ hay cung cấp dữ liệu cho mô hình AI thế hệ mới, hãy dành thời gian đánh giá nhu cầu, thử vài công cụ và xem cái nào phù hợp với bạn. Và nếu bạn muốn trải nghiệm tương lai của web scraping ngay hôm nay, . Những insight bạn cần chỉ cách bạn một prompt.

Muốn tìm hiểu thêm? Hãy xem để đọc các bài phân tích chuyên sâu, hướng dẫn và những cập nhật mới nhất về trích xuất dữ liệu bằng AI.

Đọc thêm:

Câu hỏi thường gặp

1. AI web crawler là gì và nó khác gì với web scraper truyền thống?

AI web crawler dùng xử lý ngôn ngữ tự nhiên và machine learning để hiểu, trích xuất và cấu trúc dữ liệu web. Khác với scraper truyền thống cần code thủ công và bộ chọn XPath, công cụ AI có thể xử lý nội dung động, thích nghi với thay đổi bố cục và hiểu hướng dẫn của người dùng bằng tiếng Anh thông thường.

2. Ai nên dùng các công cụ AI web scraping như Thunderbit?

Thunderbit được xây dựng cho cả người không rành kỹ thuật lẫn người có kỹ thuật. Nó rất lý tưởng cho các chuyên gia sales, marketing, vận hành, nghiên cứu và ecommerce muốn trích xuất dữ liệu có cấu trúc từ website, PDF hoặc hình ảnh — mà không cần viết code.

3. Những tính năng nào khiến Thunderbit nổi bật so với các AI web crawler khác?

Thunderbit có giao diện ngôn ngữ tự nhiên, khả năng thu thập nhiều tầng, tự động cấu trúc dữ liệu, hỗ trợ OCR và xuất dữ liệu liền mạch sang các nền tảng như Google Sheets và Airtable. Nó cũng có gợi ý trường dữ liệu bằng AI và các mẫu dựng sẵn cho những website phổ biến.

4. Có lựa chọn miễn phí nào cho AI web scraping vào năm 2026 không?

Có. Nhiều công cụ như Thunderbit, Browse AI và DataMiner cung cấp gói miễn phí với giới hạn sử dụng. Với developer, các lựa chọn mã nguồn mở như Crawl4AI và ScrapeGraphAI cung cấp đầy đủ chức năng mà không mất phí, dù cần thiết lập kỹ thuật.

5. Làm sao để chọn AI web crawler phù hợp với nhu cầu của tôi?

Hãy bắt đầu bằng việc xác định mục tiêu dữ liệu, khả năng kỹ thuật, ngân sách và yêu cầu quy mô. Nếu bạn muốn một giải pháp không cần code và dễ dùng, Thunderbit hoặc Browse AI là lựa chọn rất tốt. Với nhu cầu tùy chỉnh hoặc quy mô lớn, các công cụ như Apify hoặc Bright Data sẽ phù hợp hơn.