Trend içerikleri kaçırmamak için 200’den fazla haber kaynağını düzenli takip etmem gerekiyordu. Bunu elle yapmak mı? Bildiğin 풀타임(전업) mesai. Klasik bir scraper kullanayım desen, site tasarımı bir kez değişti mi 바로 터짐—her şey çöküyordu.

Sonra AI makale kazıyıcılarını kurcaladım. Tek tıkla pırıl pırıl veri; ne CSS seçici derdi var ne de ince ayar. Aradaki fark gerçekten 밤과 낮(geceyle gündüz) kadar.

Gazeteci, SEO uzmanı ya da araştırmacı olarak yüksek hacimde içerik çekmen gerekiyorsa, bu karşılaştırma sana ciddi anlamda deneme-yanılma süresi kazandırır. Hem geleneksel no-code kazıyıcıları hem de AI destekli olanları bizzat test ettim — gerçekten iş görenler aşağıda.

TL;DR

| Artıları | Eksileri | En Uygun Olduğu Kullanım | |

|---|---|---|---|

| AI Makale Kazıyıcı | - Birden fazla web sitesinden yüksek doğrulukla veri çekebilir - Gürültüyü otomatik ayıklar - Site yapısı değişikliklerine uyum sağlar - Dinamik içerik yüklemeyi destekler - Veri temizleme maliyeti düşüktür | - Hesaplama maliyeti daha yüksektir - İşleme süresi daha uzundur - Bazı sayfalarda manuel müdahale gerekebilir - Anti-scraping mekanizmalarını tetikleyebilir | - Karmaşık veya dinamik içerikli sitelerden veri çekme (örn. haber portalları, sosyal medya) - Büyük ölçekli veri toplama |

| Geleneksel No-code Makale Kazıyıcı | - Hızlı çalışır - Daha düşük maliyet - Sunucu ve yerel kaynak tüketimi düşüktür - Kontrol edilebilirliği yüksektir | - Site yapısı değiştikçe sık bakım ister - Aynı anda birden fazla siteyi kazıyamaz - Dinamik içeriği iyi yönetemez - Veri temizleme maliyeti yüksektir | - Basit, statik web sayfalarında hızlı ve yüksek hacimli kazıma - Kısıtlı hesaplama kaynağı / bütçe |

Makale Kazıyıcı Nedir? AI Makale Kazıyıcı Neden Önemli?

Bir , haber sitelerinden başlık, yazar, yayın tarihi, içerik, anahtar kelimeler, görseller ve videolar gibi bilgileri bulup çekebilen; ardından bunları JSON, CSV veya Excel gibi yapılandırılmış formatlarda düzenleyen bir tür aracıdır.

, içerik çekmek için sayfanın yapısına dayalı kullanır. Ama bu yaklaşımın bariz handikapları var:

- Genel geçer olmaması: Her sitenin yapısı ayrı telden çaldığı için her siteye ayrı gerekir; sayfa yapısı değişince seçiciler bozulur, sürekli 업데이트( güncelleme) ister.

- Dinamik içeriği yakalayamama: Birçok site içeriği AJAX ya da JavaScript ile 로딩(loading) eder; bunu doğrudan kazıyamaz.

- Sınırlı veri işleme: çoğu zaman sadece parçalarını toplar; sonrasında temizlik, biçimlendirme, anlamsal analiz ya da duygu analizi gibi işler için ekstra emek gerekir.

AI makale kazıyıcılar tam bu noktada devreye giriyor: .

AI makale kazıyıcılar tam bu noktada devreye giriyor: .

-

Bu teknoloji, web sayfalarını anlamak için LLM kullanır ve şunları mümkün kılar:

- Akıllı tanıma: Başlık, yazar, özet ve ana içeriği doğru şekilde ayırt eder.

- Otomatik gürültü temizleme: Navigasyon, reklam ve ilgili içerikleri ana metinden ayırarak veri kalitesini ve kazıma verimini artırır.

- Site değişikliklerine dayanıklılık: Yapı veya stil değişse bile, anlamsal anlayış ve görsel ipuçlarıyla kazımaya devam edebilir.

- Siteler arası genelleme: farklı olarak, farklı sitelerde manuel ayar yapmadan çalışabilir.

- NLP ve derin öğrenme ile entegrasyon: Çeviri, özetleme ve duygu analizi gibi işleri de tek pakette tamamlayabilir.

2026’da En İyi Makale Kazıyıcıyı Ne Belirler?

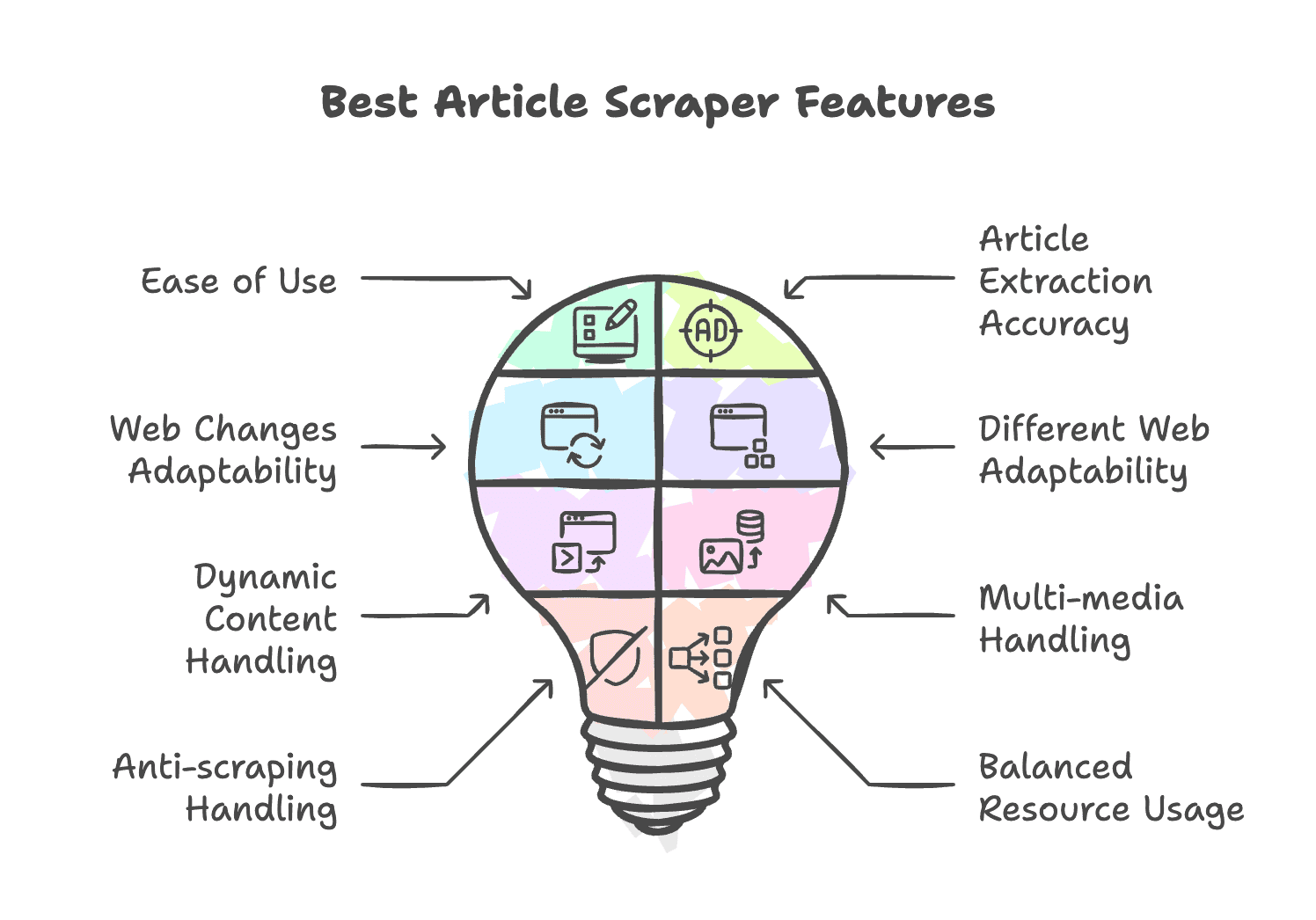

İyi bir makale kazıyıcı; performans, maliyet, kullanım kolaylığı, esneklik ve ölçeklenebilirlik arasında “딱 균형” kurar. 2026’da seçim yaparken şu kriterlere bak:

- Kullanım kolaylığı: Sezgisel arayüz, kod yazmadan kullanım.

- Makale çıkarma doğruluğu: Reklam ve menülerden arındırılmış, ilgili bilgiyi doğru yakalama.

- Site değişikliklerine uyum: Sık bakım gerektirmeden yapı/stil değişikliklerine otomatik uyum.

- Farklı site yapılarına uyum: Çeşitli web yapılarında çalışabilme.

- Dinamik içerik desteği: JavaScript veya AJAX ile yüklenen içerikleri destekleme.

- Multimedya desteği: Görsel, video ve ses öğelerini tanıma.

- Anti-scraping engellerini aşma: IP rotasyonu, CAPTCHA çözümleri ve proxy kullanımı.

- Kaynak kullanım dengesi: Aşırı bellek ve işlem gücü tüketmeme.

En İyi Makale & Haber Kazıyıcılar: Hızlı Bakış

| Araçlar | Öne Çıkan Özellikler | En Uygun Olduğu Kullanım | Fiyatlandırma |

|---|---|---|---|

| Thunderbit | AI destekli kazıyıcı; hazır şablonlar; PDF, görsel ve doküman kazıma desteği; gelişmiş veri işleme | Teknik altyapısı olmayan, birden fazla niş siteden veri çekmek isteyen kullanıcılar | 7 gün ücretsiz deneme, aylık $9’dan başlayan (yıllık plan) |

| WebScraper.io | Tarayıcı eklentisi; dinamik içerik desteği; proxy entegrasyonu yok | Karmaşık sayfalarla veya ileri özelliklerle uğraşmayan kullanıcılar | 7 gün ücretsiz deneme, aylık $40’dan başlayan (yıllık plan) |

| Browse.ai | No-code kazıyıcı ve izleme; hazır robotlar; sanal tarayıcı; farklı sayfalama yöntemleri; güçlü entegrasyon | Büyük ölçekte, karmaşık sitelerden veri çekmesi gereken kurumlar | Aylık $19 (yıllık plan) |

| Octoparse | CSS seçici tabanlı no-code; otomatik algılama ile akış üretimi; hazır makale şablonları; sanal tarayıcı; anti-anti scraping | Karmaşık sitelerden veri çekmesi gereken işletmeler | Aylık $99’dan başlayan (yıllık plan) |

| Bardeen | Kapsamlı web otomasyonu; hazır şablonlar; no-code kazıyıcı; çalışma araçlarıyla güçlü entegrasyon | Makale kazımayı mevcut iş akışlarına gömmek isteyen GTM ekipleri | 7 gün ücretsiz deneme, aylık $99’dan başlayan (yıllık plan) |

| PandaExtract | Kullanıcı dostu arayüz; otomatik algılama ve etiketleme | Karmaşık kurulum olmadan tek tıkla hızlı çıkarım isteyen kullanıcılar | $49 LTD |

İş Kullanıcıları İçin En Güçlü AI Makale Kazıyıcı

- Artıları:

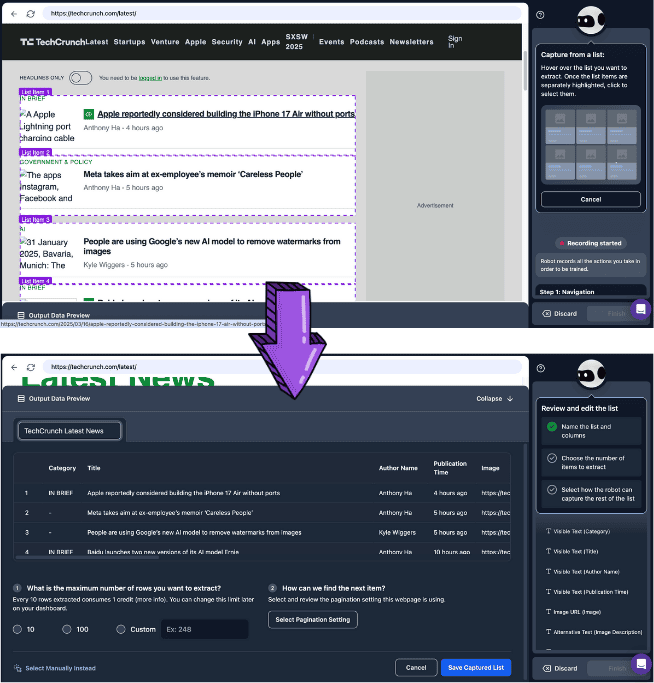

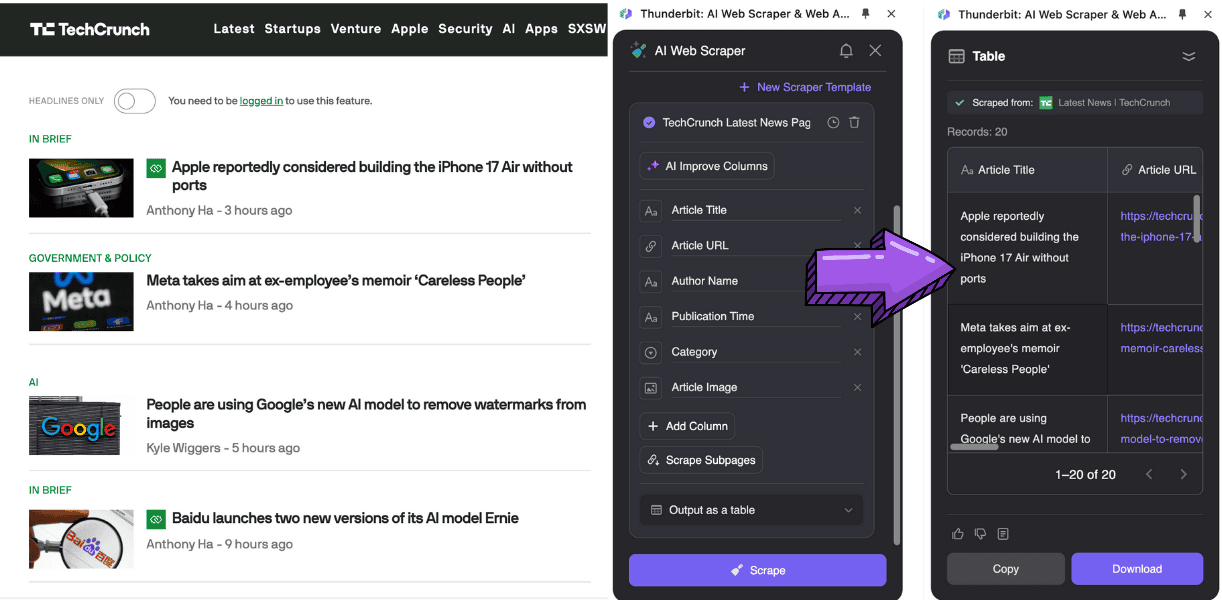

- Doğal dil ile AI’ı çağırarak web bilgisini tanır ve analiz eder; CSS seçici ihtiyacını ortadan kaldırır

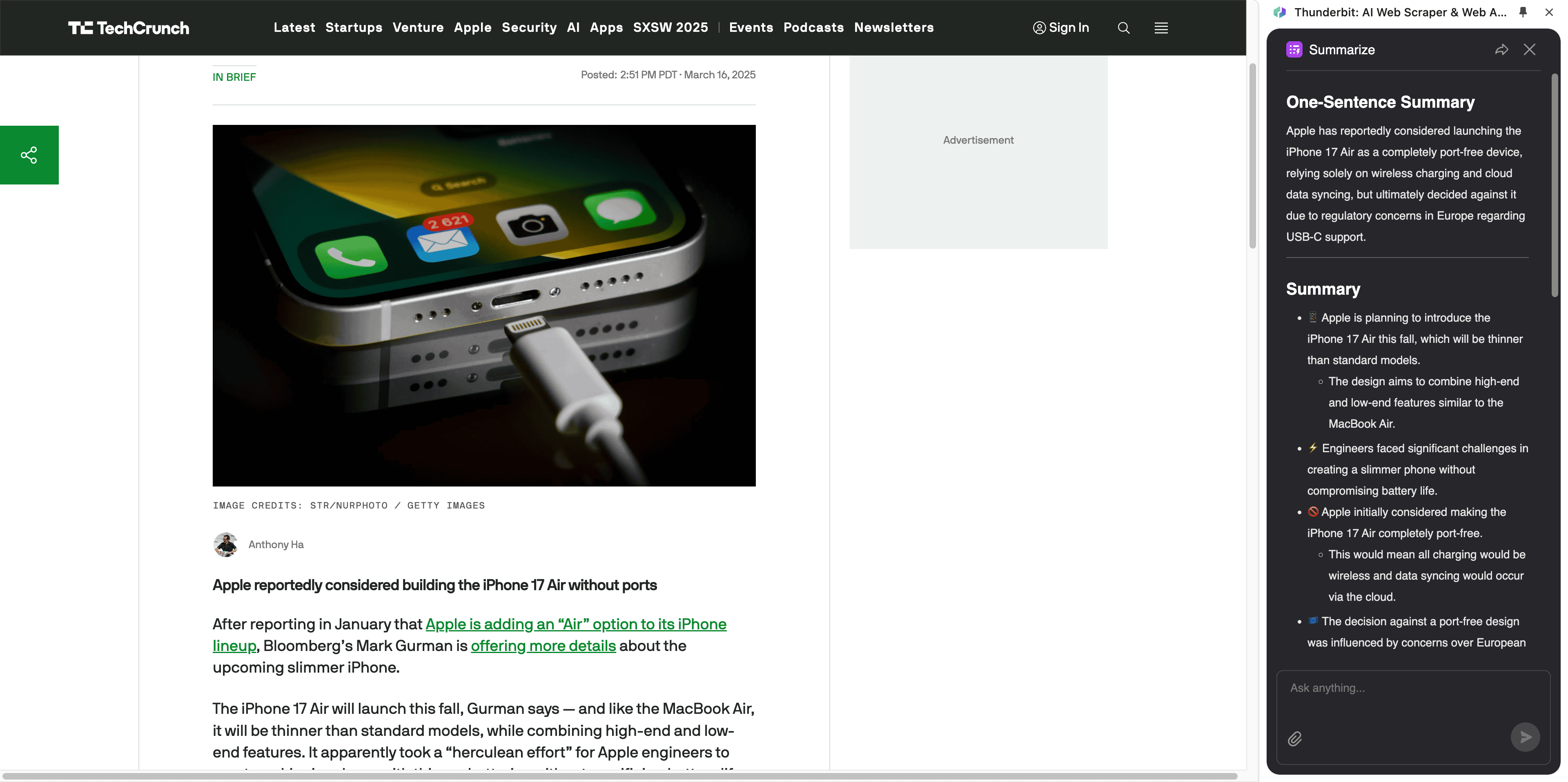

- AI destekli veri analizi: biçim dönüştürme, , sınıflandırma, çeviri ve etiketleme

- Tek tıkla liste ve içerik kazıma için

- Eksileri:

- Şu an yalnızca olarak kullanılabiliyor

- Çok büyük ölçekli veri kazıma için uygun değil

- Çok sayfalı kazımada daha yavaş olabilir; ancak arka planda çalıştırarak sonuçları hızlandırabilirsiniz

Kurumsal Kullanım İçin AI Destekli Makale Kazıyıcı

Browse.ai

- Artıları:

- No-code makale kazıyıcı ve izleme aracı

- Anti-scraping tetiklenmesini azaltmak için sanal tarayıcı kullanımını destekler

- , , ve daha fazlası için tek tıkla çalışan çok sayıda hazır robot

- ve gibi platformlarla güçlü entegrasyon

- Eksileri:

- Derin çıkarım (deep extract) için iki robot oluşturmak gerekebiliyor; süreç 복잡해질 수 있음 (karmaşıklaşabiliyor)

- Niş sitelerde CSS seçiciler yeterince hassas olmayabiliyor

- Pahalı; daha çok büyük ölçekli ve sürekli kazıma işleri için uygun

Küçük Ölçekli Veri Çıkarma İçin No-Code Kazıyıcı

PandaExtract

- Artıları:

- Kullanıcı dostu arayüzle makale listelerini ve detaylarını otomatik tanır

- Liste, detay, e-posta ve görsel çıkarabilir; küçük ölçekli yapılandırılmış veri kazıma için uygun

- Tek seferlik ödeme ile ömür boyu kullanım

- Eksileri:

- Yalnızca tarayıcı eklentisi; bulutta çalıştırılamaz

- Ücretsiz sürüm yalnızca kopyalamayı destekler; CSV/JSON vb. dışa aktarma yok

Kurumlar İçin Kurulum Gerektirmeyen (Out-of-the-Box) Makale Kazıyıcı

Octoparse

- Artıları:

- Web yapısını algılayıp kazıma akışı üreten otomatik tespit özellikli no-code makale kazıyıcı

- Kullanıma hazır çok sayıda makale kazıyıcı şablonu

- IP rotasyonu, CAPTCHA çözümleri ve proxy’lerle anti-scraping engellerini aşmak için sanal tarayıcı kullanır

- Eksileri:

- Otomatik tespit hâlâ CSS seçici mantığına dayanır; doğruluk orta karar

- İleri özellikler öğrenme ve teknik beceri gerektirebilir

- Büyük ölçekli kazımada maliyet yüksektir

GTM Ekibi İçin En Kapsamlı Otomasyon

Bardeen

- Artıları:

- LLM kullanan no-code makale kazıyıcı ile tek tık otomasyon

- , ve dahil 100+ uygulama ile entegrasyon

- Kazıma sonrası AI analizleri için güçlü web otomasyon araçları

- Veri kazımayı mevcut iş akışlarına entegre etmek için ideal

- Eksileri:

- Hazır playbook’lara fazla bağımlı; özel akışlar deneme-yanılma isteyebilir

- No-code olsa da, teknik olmayan kullanıcılar için karmaşık otomasyonları anlamak/kurmak zaman alabilir

- Alt sayfa (subpage) çıkarımı kurulumu karmaşık

- Çok pahalı

Anında Veri Çıkarmak İçin Hafif Bir Makale Kazıyıcı

Webscraper.io

- Artıları:

- Tıkla-seç arayüzlü no-code kazıyıcı

- Dinamik içerik yüklemeyi destekler

- Bulut tabanlı çalışma

- , ve ile entegrasyon

- Eksileri:

- Hazır şablon yok; özel sitemap oluşturmak gerekir

- CSS seçicilere yabancı kullanıcılar için öğrenme eğrisi var

- Sayfalama ve alt sayfa çıkarımı için kurulum karmaşık

- Bulut sürümü pahalı

Mühendisler İçin Daha İleri Seviye Çözümler

Teknik altyapısı olanlar için de var. Bu çözümler genelde şunları sunar:

- Esneklik: Özel kazıma için doğrudan API çağrıları; dinamik render ve IP rotasyonu desteği

- Ölçeklenebilirlik: Kurumsal düzeyde yüksek frekanslı ve büyük hacimli ihtiyaçlar için veri hatlarına (pipeline) entegrasyon

- Düşük bakım maliyeti: Proxy havuzu veya anti-scraping stratejilerini yönetme derdi olmadan operasyonel zaman tasarrufu

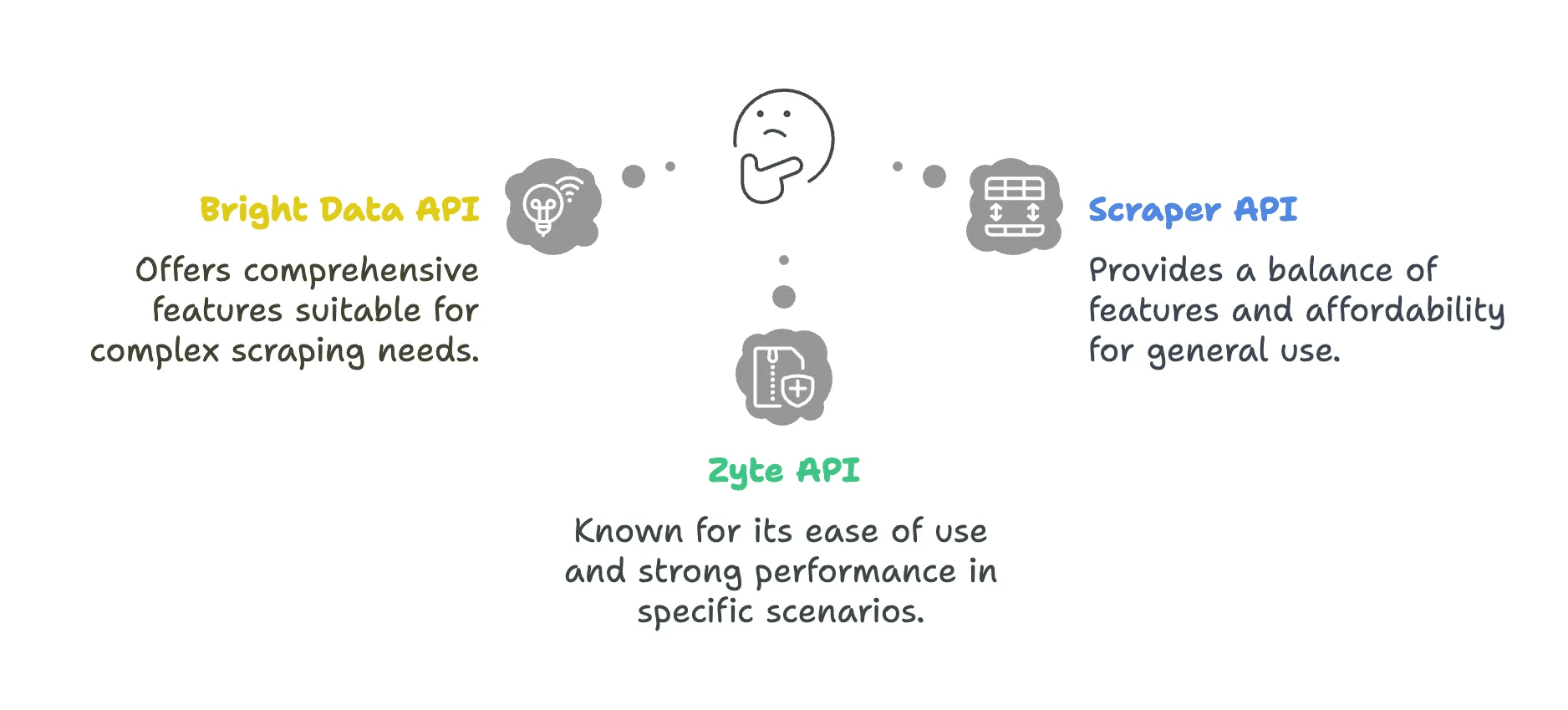

API Çözümleri: Hızlı Bakış

| API | Artıları | Eksileri |

|---|---|---|

| Bright Data API | - Geniş proxy ağı (195 ülkede 72M+ IP) - Şehir/posta kodu seviyesine kadar gelişmiş coğrafi hedefleme - IP rotasyonu için güçlü Proxy Manager | - Daha yavaş yanıt süreleri (ortalama 22.08 sn) - Küçük ekipler için uygun olmayan yüksek fiyat - Yapılandırmada daha dik öğrenme eğrisi |

| ScraperAPI | - $49’dan başlayan daha erişilebilir giriş seviyesi - Otomatik veri çıkarımı için autoparse - Test için Web UI player | - Engellenen istekler için de çoğu zaman ücret alır - JavaScript render özellikleri sınırlı - Premium parametrelerle maliyet hızla artabilir |

| Zyte API | - AI ile ayrıştırma (parsing) yetenekleri - Başarısız istekler için ücret almaz | - Daha yüksek başlangıç maliyeti (~$450/ay) - Krediler aylar arasında devretmez |

- Bright Data Web Scraper API

- Artıları:

- 195 ülkede 72M+ konut IP’si; otomatik IP rotasyonu ve konum simülasyonu desteği. Sıkı anti-scraping uygulayan siteler için ideal (örn. , )

- JavaScript ile dinamik içerik yüklemeyi ve sayfa anlık görüntüsü (snapshot) almayı destekler

- Eksileri:

- Yüksek maliyet (istek ve bant genişliği bazlı); küçük projelerde fiyat-performans düşebilir

- Artıları:

- Scraper API

- Artıları:

- 40M global proxy; veri merkezi/konut IP otomatik geçişi; Cloudflare doğrulamasını aşma; üçüncü taraf CAPTCHA çözümleriyle entegrasyon (örn. )

- Yapılandırılmış endpoint’ler ve asenkron kazıyıcılarla daha hızlı kazıma

- Eksileri:

- Dinamik sayfa render’ı ek maliyetlidir; karmaşık AJAX sitelerinde destek sınırlı olabilir

- Artıları:

- Zyte API

- Artıları:

- AI destekli otomatik web veri çıkarımı; her site için ayrı kural geliştirme/bakım ihtiyacını azaltır

- Kullandıkça öde (pay-as-you-go) esnek fiyatlandırma

- Eksileri:

- İleri özellikler (örn. oturum yönetimi, scriptlenebilir tarayıcı) öğrenme gerektirebilir

- Artıları:

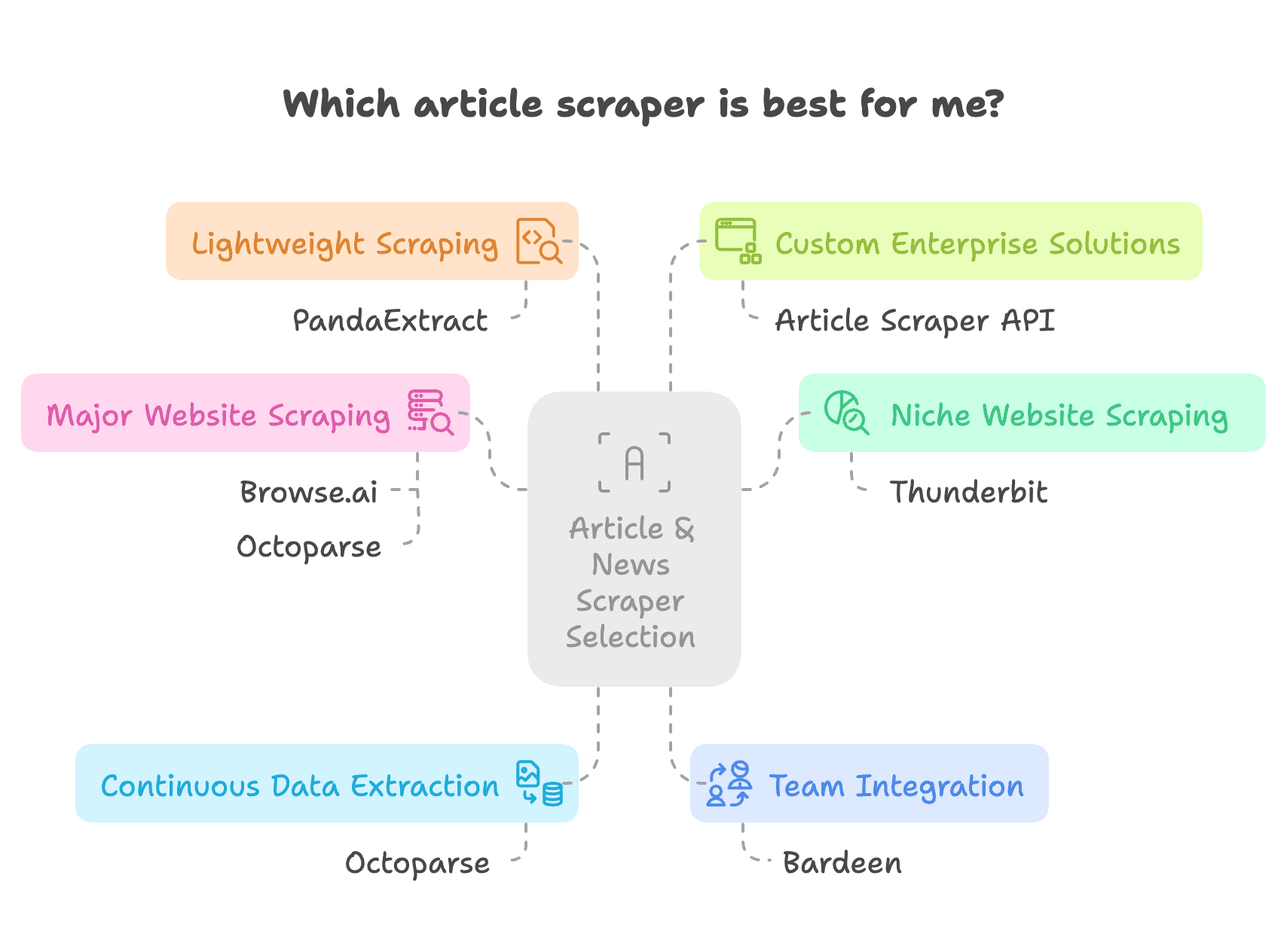

Makale & Haber Kazıyıcınızı Nasıl Seçmelisiniz?

Bir makale/haber makalesi kazıyıcı seçerken iş ihtiyacını, teknik seviyeni ve bütçeni birlikte tartmak en doğrusu.

- Her sayfa için ayrı kazıyıcı kurmadan birden fazla niş siteden veri çekmek istiyor ve bütçen de uygunsa, en iyi seçenek . yaslanmaz; web yapısını AI ile analiz eder ve kazıma sonrası AI analizlerine de alan açar. Thunderbit AI için siteler “aynı mantıkla” okunur; makaleleri yüksek doğrulukla yakalar.

- veya gibi büyük sitelerden haber/makale çekmek için güçlü anti-scraping ve hazır şablonlar sunan bir araca ihtiyaç duyarsın (Browse.ai veya Octoparse gibi). Yine de en pratik seçenek gibi bir Chrome eklentisi: Kazıma süreci kişisel gezinme ve kopyalama davranışını taklit eder; karmaşık kurulum olmadan giriş (login) bilgileriyle çalışabilir.

- Büyük ölçekte ve sürekli kazıma gerekiyorsa, zamanlama (schedule) özellikli araçlar (Octoparse gibi) daha uygun olur.

- Ekip kullanımı ve mevcut iş akışlarına sorunsuz entegrasyon için, makale kazımanın ötesinde otomasyon araçları sunan Bardeen iyi bir seçenek.

- Öğrenmeye zaman ayırmadan küçük veri çıkarımı için hafif bir çözüm arıyorsan, PandaExtract gibi tıkla-seç tarzı bir makale kazıyıcı tercih et.

- Teknik altyapın varsa veya kurumsal bir makale kazıyıcı geliştiriyorsan, bu ek olarak API araçlarını değerlendirebilir ya da kendi kazıyıcını yazabilirsin.

Sonuç

Bu yazıda makale ve haber makalesi kazıyıcıların ne olduğu ve hangi iş senaryolarında kullanıldığı ele alındı. , üzerine kurulur; özellikle ileri kullanımda web ve bilgisi gerektirebilir. Yeni nesil ise tamamen AI’ın anlamsal anlama ve görsel tanıma 능력( yetenek)lerine dayanır; site yapısı değişikliklerine uyum, siteler arası genelleme, dinamik içerik desteği ve kazıma sonrası veri temizleme/analiz tarafında göre net bir üstünlük sağlar.

Ayrıca geliştiriciler için API seçenekleriyle birlikte altı faydalı makale/haber kazıyıcı aracı listelendi; artı-eksi yönleri, uygun veri ölçekleri, web özellikleri ve hedef kullanıcılar açısından karşılaştırıldı. Makale/haber kazıma planı yaparken, performans ve maliyeti dengede tutup ihtiyacına en uygun çözümü seçmen yeterli.

SSS

1. AI makale kazıyıcı nedir, nasıl çalışır?

- CSS seçici gerektirmeden web sayfalarını AI ile analiz eder ve içerik çıkarır.

- Başlık, yazar, yayın tarihi ve ana içeriği yüksek doğrulukla tespit eder.

- Reklamları, menüleri ve alakasız öğeleri otomatik ayıklar.

- Site yapısı değişikliklerine uyum sağlar ve farklı sitelerde çalışabilir.

2. AI destekli makale kazıyıcıların geleneksel kazıyıcılara göre avantajları neler?

- Tek bir araçla birden fazla web sitesinden içerik çekebilir.

- JavaScript ve AJAX ile yüklenen sayfalar dahil dinamik içeriği yönetir.

- CSS tabanlı kazıyıcılara kıyasla daha az kurulum ve bakım gerektirir.

- Özetleme, çeviri ve duygu analizi gibi ek özellikler sunabilir.

3. Kod bilmeden Thunderbit ile AI makale kazıma yapabilir miyim?

- Evet. Thunderbit, teknik olmayan kullanıcılar için basit bir no-code arayüzle tasarlanmıştır.

- AI ile makale içeriğini otomatik algılar ve çıkarır.

- Hızlı kazıma için hazır şablonlar sunar.

- Verileri CSV, JSON ve Google Sheets gibi formatlara aktarabilirsiniz.

Daha Fazlası: