ขอพาเห็นภาพก่อน: เวลา 8:30 น. ของเช้าวันจันทร์ และคุณกำลังนั่งจ้องสเปรดชีตอยู่ พร้อมคัดลอกวางชื่อบริษัท อีเมล และเบอร์โทรจากเว็บต่าง ๆ นับสิบแห่ง คุณไม่ได้เป็นคนเดียวที่ทำแบบนี้—จริง ๆ แล้วมีพนักงานมากกว่า ไปกับการย้ายข้อมูลจากที่หนึ่งไปอีกที่หนึ่ง ผมก็เคยอยู่จุดนั้นเหมือนกัน และบอกได้เลยว่าไม่ใช่การเริ่มต้นสัปดาห์ที่สร้างแรงบันดาลใจสักเท่าไร สำหรับทีมขายยิ่งหนักกว่าเดิม: และมากกว่า 20% มองว่านี่คือปัญหา CRM ที่ หนักที่สุด ของพวกเขา

โลกนี้ขับเคลื่อนด้วยข้อมูล แต่กระบวนการเก็บข้อมูลของเรายังเหมือนติดอยู่ในยุคมืด—จนกระทั่งตอนนี้ ด้วยเครื่องมือดึงข้อมูลสมัยใหม่อย่าง web scraper และโซลูชันที่ขับเคลื่อนด้วย AI เราเริ่มหลุดจากวงจรคัดลอกวางไม่รู้จบเสียที ในคู่มือนี้ ผมจะพาคุณไปรู้จักว่า data extraction คืออะไร ทำไมมันสำคัญ และจะใช้มันเปลี่ยนงานซ้ำ ๆ หลายชั่วโมงให้เหลือแค่ไม่กี่นาทีของ insight ไม่ว่าคุณจะทำงานสายขาย อีคอมเมิร์ซ หรือปฏิบัติการ นี่คือทางลัดสู่การทำงานอย่างฉลาดขึ้น ไม่ใช่หนักขึ้น

ทำความเข้าใจการดึงข้อมูล: คืออะไร และทำไมคุณควรสนใจ?

ตัดศัพท์ยากทิ้งไปก่อน การดึงข้อมูล ก็คือการ “รวบรวมข้อมูลที่มีประโยชน์จากหลายแหล่ง แล้วจัดให้อยู่ในรายการเดียวอย่างเป็นระเบียบ” ลองนึกภาพว่าคุณกำลังเก็บแอปเปิลจากสวนหลาย ๆ แห่ง แล้วเอาลูกที่ดีที่สุดใส่ตะกร้า—นั่นแหละคือการดึงข้อมูลในแบบง่ายที่สุด

ในเชิงเทคนิค มันคือกระบวนการดึงหรือเก็บข้อมูลจากแหล่งต่าง ๆ แล้วแปลงให้อยู่ในรูปแบบที่ใช้งานต่อได้ เพื่อการวิเคราะห์ รายงาน หรือจัดเก็บ () เป้าหมายคือเอาข้อมูลที่กระจัดกระจายอยู่ตามไซโลต่าง ๆ มารวมไว้ที่เดียว เพื่อให้คุณนำไปใช้ต่อได้จริง

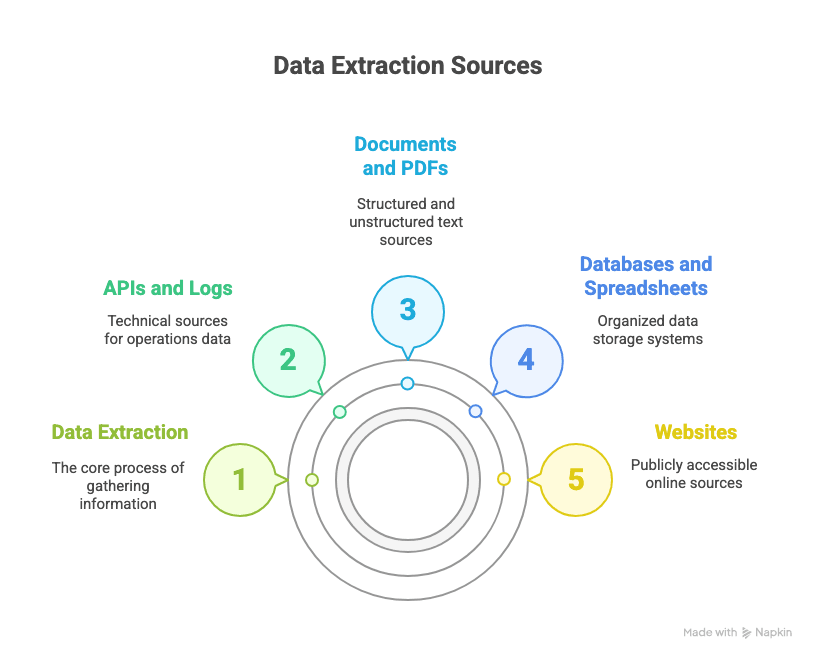

การดึงข้อมูลเกิดขึ้นจากที่ไหนบ้าง?

- เว็บไซต์: เช่น ไดเรกทอรีสาธารณะ รายการสินค้า หรือเว็บรีวิว

- ฐานข้อมูลและสเปรดชีต: CRM, ERP หรือไฟล์ Excel ที่ไม่มีวันจบ

- เอกสารและ PDF: ใบแจ้งหนี้ รายงาน หรือสัญญา

- API และ log: สำหรับคนสายเทคนิค นี่คือขุมทรัพย์ของข้อมูลด้านการปฏิบัติงาน

ไม่ว่าจะเป็นข้อมูลแบบมีโครงสร้าง (เช่น ตารางที่เป็นระเบียบในฐานข้อมูล) หรือไม่มีโครงสร้าง (เช่น โพสต์โซเชียลมีเดียที่วุ่นวายเหมือนป่า) การดึงข้อมูลคือก้าวแรกที่จะช่วยให้คุณมองเห็นความหมายของมันทั้งหมด พูดง่าย ๆ มันคือ “คัดลอกวางเวอร์ชันอัปเกรด” — เร็วกว่า แม่นยำกว่า และไม่บั่นทอนจิตใจเท่าเดิม

ทำไมการดึงข้อมูลจึงสำคัญต่อธุรกิจยุคใหม่

เอาตรง ๆ เลยนะ: เวลา = เงิน ทุกชั่วโมงที่ทีมของคุณเสียไปกับการจัดการข้อมูล คือหนึ่งชั่วโมงที่ไม่ได้ใช้ไปกับการขาย วางกลยุทธ์ หรือดูแลลูกค้า ที่จริงแล้ว ใช่แล้ว ล้านล้านด้วยตัว T เลย

แต่ประโยชน์ไม่ได้มีแค่ประหยัดเวลาเท่านั้น มันยังเปิดโอกาสใหม่ ๆ ได้อีกด้วย นี่คือสิ่งที่การดึงข้อมูลแบบอัตโนมัติมอบให้:

| กรณีใช้งาน | ใครได้ประโยชน์ | หน้าตาการใช้งานจริง |

|---|---|---|

| การหาลูกค้าเป้าหมาย | ทีมขาย | ดึงข้อมูลติดต่อจากไดเรกทอรี, LinkedIn หรือเว็บไซต์บริษัท มาเป็นลิสต์พร้อมใช้ |

| การติดตามราคาและสต็อก | ทีมอีคอมเมิร์ซ | เฝ้าดูราคาคู่แข่งหรือระดับสต็อกของสินค้าเป็นร้อย ๆ SKU โดยไม่ต้องเช็กเอง |

| การวิจัยตลาด | นักวิเคราะห์/การตลาด | รวบรวมรีวิว โพสต์โซเชียล หรือสเปกสินค้าเพื่อวิเคราะห์คู่แข่ง |

| การบริหารผู้ขาย | จัดซื้อ | ติดตามแคตตาล็อกและการอัปเดตราคาของซัพพลายเออร์แบบอัตโนมัติ |

| การเพิ่มความสมบูรณ์ของข้อมูล | ทุกคน | เติมข้อมูลเพิ่มเติม เช่น อีเมล เบอร์โทร ที่อยู่ เพื่อทำให้ CRM หรือฐานข้อมูลสมบูรณ์ขึ้น |

และอย่าลืมเรื่องความแม่นยำ: การกรอกข้อมูลด้วยมือมีอัตราความผิดพลาดราว ฟังดูน้อย แต่พอทำในสเกลใหญ่เมื่อไร ทีมขายของคุณอาจโทรผิดเบอร์ หรือแดชบอร์ดราคาของคุณอาจคลาดเคลื่อนไปหลายร้อยดอลลาร์

เครื่องมือดึงข้อมูลแบบอัตโนมัติไม่ได้แค่ช่วยประหยัดเวลา—มันยังช่วยเลี่ยงความผิดพลาดราคาแพง และทำให้ตัดสินใจได้ดีขึ้น เร็วขึ้น จึงไม่แปลกที่เกือบ

ความท้าทายในโลกจริงของการดึงข้อมูล

ถ้าการดึงข้อมูลดีขนาดนั้น ทำไมทุกคนยังไม่ทำกันหมด? คำตอบคือวิธีเก่า ๆ มัน... เอาเป็นว่าช่วยฝึกความอดทนได้ดีมาก

ปัญหาที่มักเจอในอดีต:

- คัดลอกวางด้วยมือช้าและพลาดง่าย ต่อให้เป็นพนักงานที่ละเอียดแค่ไหน พอถึงแถวที่ 50 ก็ต้องมีพลาดบ้าง และพูดกันตามตรง ไม่มีใครฝันอยากเป็นนินจาคัดลอกวางไปตลอดชีวิต

- สคริปต์พังบ่อย คนที่ถนัดเทคอาจเขียน web scraping script เอง แต่เว็บไซต์ชอบเปลี่ยนหน้าตาแสดงผล แค่ปรับเล็กน้อย สคริปต์ก็ใช้ไม่ได้แล้ว ()

- แต่ละเว็บไซต์ไม่เหมือนกัน สิ่งที่ใช้ได้กับเว็บหนึ่ง อาจใช้ไม่ได้กับอีกเว็บ บางเว็บมี pagination ซับซ้อน บางเว็บซ่อนข้อมูลไว้หลังปุ่มหรือหน้าล็อกอิน

- ด่านป้องกันบอท เว็บไซต์หลายแห่งใช้ CAPTCHA, การแบน IP และกลไกอื่น ๆ เพื่อกัน scraper ไม่ให้เข้าไป ()

- ปัญหากฎหมายและการปฏิบัติตามข้อกำหนด ไม่ใช่ทุกเว็บที่อยากให้คุณนำข้อมูลไปใช้ และกฎหมายความเป็นส่วนตัวอย่าง GDPR ก็ทำให้ต้องระมัดระวังมากขึ้น

และอาจเป็นความท้าทายที่ใหญ่ที่สุด: ช่องว่างด้านการสื่อสารระหว่างผู้ใช้ธุรกิจที่ไม่ใช่สายเทคนิคกับทีมเทคนิค ผมเคยเห็นผู้จัดการฝ่ายขายพยายามอธิบายสิ่งที่ต้องการให้ดีเวลอปเปอร์ฟัง สุดท้ายได้สคริปต์ที่ “เกือบ” ใช้ได้—จนกว่าจะมีอัปเดตเว็บไซต์ครั้งถัดไป

การดึงข้อมูลทำงานอย่างไร: จากแบบทำมือสู่ระบบอัตโนมัติ

แล้วจริง ๆ คุณดึงข้อมูลกันยังไง? ไม่ว่าคุณจะทำเองหรือใช้ AI รุ่นล่าสุด ขั้นตอนพื้นฐานน่าจะคล้ายกันอย่างน่าประหลาด:

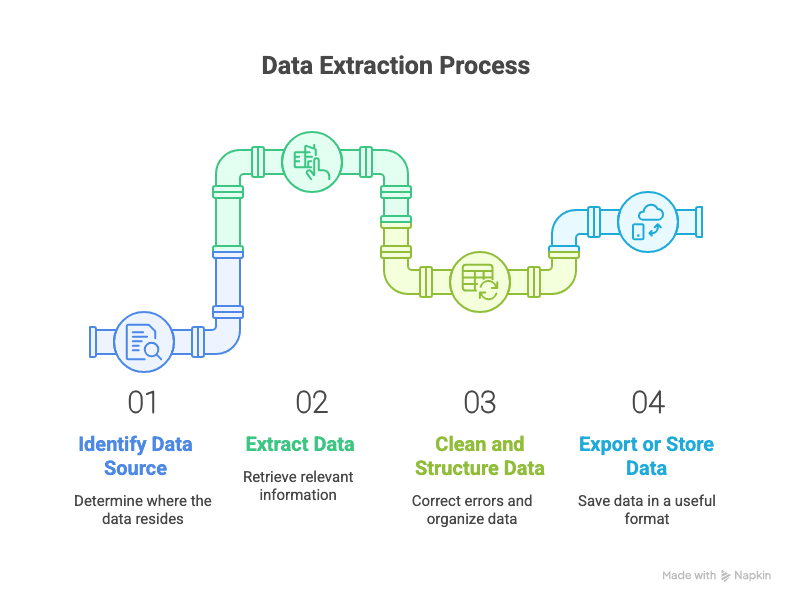

- ระบุแหล่งข้อมูล ข้อมูลอยู่ที่ไหน? (เว็บไซต์, PDF, ฐานข้อมูล ฯลฯ)

- ดึงข้อมูลออกมา (scrape) เอาส่วนที่เกี่ยวข้องออกมา ไม่ว่าจะด้วยการคัดลอก เขียนสคริปต์ หรือใช้เครื่องมือ

- ทำความสะอาดและจัดโครงสร้างข้อมูล แก้คำผิด ทำรูปแบบให้เหมือนกัน ลบรายการซ้ำ

- ส่งออกหรือจัดเก็บข้อมูล เก็บไว้ในที่ที่ใช้ต่อได้ เช่น Excel, Google Sheets, ฐานข้อมูล หรืออะไรก็ตามที่เหมาะกับงาน

มาดูวิธีหลัก ๆ แบบเทียบกัน:

| แนวทาง | ข้อดี | ข้อเสีย |

|---|---|---|

| คัดลอกวางด้วยมือ | ใครก็ทำได้ | ช้า ผิดพลาดง่าย และสเกลไม่ไหว |

| scraper ที่ใช้โค้ด | ยืดหยุ่น ทรงพลัง | ต้องเขียนโปรแกรม พังง่าย ต้องดูแลต่อเนื่อง |

| no-code/AI web scraper | เร็ว ใช้ง่าย ปรับตามการเปลี่ยนแปลงได้ | บางกรณีอาจปรับแต่งเฉพาะทางได้น้อยกว่า |

เครื่องมือยุคใหม่ โดยเฉพาะที่ใช้ AI ได้เปลี่ยนกระบวนการนี้ให้กลายเป็นสายพานอัตโนมัติ คุณแค่บอกเครื่องมือว่าต้องการอะไร ที่เหลือมันจัดการให้หมด—ไม่ต้องเขียนโค้ดเลย

สำรวจเครื่องมือดึงข้อมูล: Web Scraper, API และอื่น ๆ

มีเครื่องมือดึงข้อมูลให้เลือกเพียบ แต่โดยมากจะอยู่ในไม่กี่หมวดหลัก ๆ:

- เครื่องมือ Web Scraping: ตัวหลักสำหรับผู้ใช้ธุรกิจ ใช้ดึงข้อมูลจากเว็บไซต์ เปรียบเหมือนส่วนขยายเบราว์เซอร์หรือแอปบนคลาวด์ที่ทรงพลังขึ้นมาก

- API และการเชื่อมต่อระบบ: ถ้าเว็บไซต์มี API ให้ใช้ API เลย! เพราะสะอาด เป็นระบบ และพังยากกว่า

- เครื่องมือ Batch Processing และ ETL: ใช้ย้ายข้อมูลปริมาณมากระหว่างฐานข้อมูลหรือไฟล์ พบได้บ่อยในงาน IT และงานวิเคราะห์ข้อมูล

- RPA (Robotic Process Automation): บอทที่เลียนแบบการคลิกและพิมพ์ของมนุษย์ เหมาะกับระบบเก่า แต่บางทีก็จุกจิก

- เครื่องมือแบบแมนนวล: เช่น ฟีเจอร์นำเข้าจากเว็บของ Excel, ฟังก์ชันใน Google Sheets หรือส่วนเสริมเบราว์เซอร์ เหมาะกับงานเล็ก ๆ แต่ไม่ได้ออกแบบมาสำหรับงานขนาดใหญ่

เครื่องมือ Web Scraper: ทำให้การดึงข้อมูลง่ายขึ้นสำหรับทุกคน

web scraper คือคำตอบหลักของผู้ใช้ธุรกิจส่วนใหญ่ มันช่วยทำงานเก็บข้อมูลจากเว็บไซต์ให้อัตโนมัติ เปลี่ยนการคลิกเป็นชั่วโมง ให้เหลือผลลัพธ์ในไม่กี่นาที

web scraper แบบดั้งเดิม ต้องให้คุณคลิกเลือกทีละฟิลด์ หรือเขียนกฎว่าต้องการดึงอะไร ถ้าเว็บเปลี่ยนเมื่อไร ก็ต้องเริ่มตั้งค่าใหม่เกือบทั้งหมด

web scraper ที่ใช้ AI อย่าง Thunderbit ไปได้ไกลกว่าเดิม คุณแค่บอกว่าต้องการอะไร—“ดึงชื่อสินค้าและราคาในหน้านี้ให้หน่อย”—จากนั้น AI จะตีความและจัดการส่วนที่เหลือให้เอง ไม่ต้องมานั่งงมหา HTML หรือ XPath อีกต่อไป

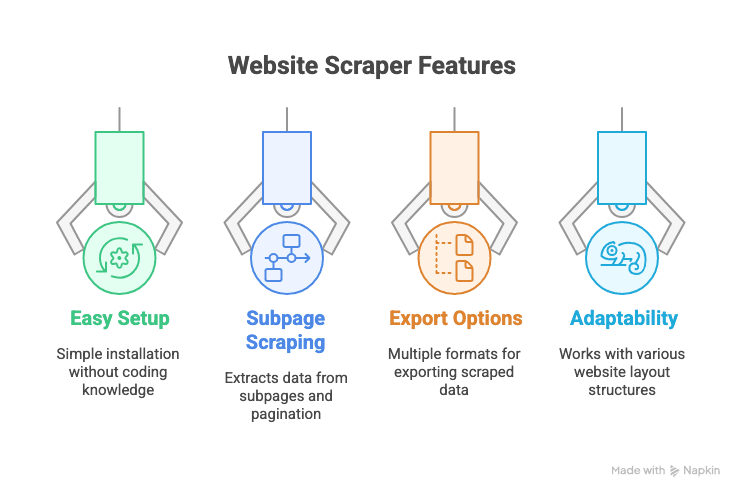

ฟีเจอร์สำคัญที่ควรมองหา:

- ตั้งค่าง่าย ไม่ต้องเขียนโค้ด

- ดึงข้อมูลจากหน้าย่อยและ pagination ได้

- ส่งออกข้อมูลได้หลายรูปแบบ (Excel, Google Sheets, Notion ฯลฯ)

- ปรับตัวเข้ากับเลย์เอาต์เว็บไซต์ที่แตกต่างกันได้

Thunderbit: การดึงข้อมูลด้วย AI สำหรับทุกคน

ในฐานะคนที่ใช้เวลาหลายปีสร้างเครื่องมือ SaaS และระบบอัตโนมัติ ผมเห็นกับตาตัวเองว่าเครื่องมือดึงข้อมูลส่วนใหญ่ยังมีข้อจำกัดตรงไหน: บางตัวเทคนิคเกินไป บางตัวแข็งเกินไป และบางตัวช้าเกินไปที่จะปรับตามความต้องการทางธุรกิจจริง

นั่นคือเหตุผลที่เราสร้าง ซึ่งเป็น AI web scraper ที่ออกแบบมาสำหรับผู้ใช้งานธุรกิจที่ไม่ใช่สายเทคนิคโดยเฉพาะ เป้าหมายของเราคือทำให้การดึงข้อมูลง่ายพอ ๆ กับการสั่งอาหารเดลิเวอรี

สิ่งที่ทำให้ Thunderbit แตกต่าง:

- AI Suggest Fields: แค่กด “AI Suggest Fields” Thunderbit จะอ่านหน้าเว็บ แนะนำคอลัมน์ที่เหมาะสมที่สุด และสร้าง prompt เฉพาะสำหรับแต่ละฟิลด์ให้อีกด้วย ไม่ต้องเดา selector ให้ปวดหัว

- Subpage Scraping: ถ้าต้องการรายละเอียดจากทุกหน้าสินค้าหรือทุกโปรไฟล์ Thunderbit สามารถไล่เข้าไปในแต่ละหน้าย่อยและเติมข้อมูลในตารางให้โดยอัตโนมัติ

- รองรับ Pagination: ไม่ว่าจะเป็นปุ่ม “Next” หรือการเลื่อนแบบ infinite scroll Thunderbit จัดการได้ ทำให้คุณได้ข้อมูลครบ ไม่ใช่แค่หน้าแรก

- ส่งออกได้ง่าย: ส่งข้อมูลตรงไปยัง Excel, Google Sheets, Notion หรือ Airtable ได้เลย หรือจะดาวน์โหลดเป็น CSV หรือ JSON ก็ได้ตามเวิร์กโฟลว์ของคุณ

- ใช้งานง่าย ไม่ต้องเขียนโค้ด: ถ้าคุณใช้เบราว์เซอร์เป็น ก็ใช้ Thunderbit ได้ ไม่ต้องมีพื้นฐานเทคนิค

- ดึงข้อมูลได้ทั้งบนคลาวด์หรือในเบราว์เซอร์: เลือกโหมดที่เหมาะกับงานของคุณ Thunderbit ทำงานบนคลาวด์เพื่อความเร็ว หรือในเบราว์เซอร์เมื่อจำเป็นต้องล็อกอิน

และใช่ เราตั้งราคาให้เข้าถึงได้ แพ็กเกจฟรีให้คุณดึงได้ถึง 6 หน้า ส่วนแพ็กเกจเสียเงินเริ่มต้นแค่ $15/เดือน สำหรับ 500 เครดิต สำหรับทีมเล็กส่วนใหญ่ แค่นี้ก็เริ่มต้นได้สบาย

สนใจไหม? ดาวน์โหลด Thunderbit Chrome Extension แล้วลองใช้ด้วยตัวเองได้เลย

Thunderbit ในการใช้งานจริง: กรณีใช้งานจากโลกจริง

มาดูแบบจับต้องได้กันเลย ทีมต่าง ๆ ใช้ Thunderbit กันอย่างไรในชีวิตประจำวัน:

Sales: หาลีดได้ในไม่กี่นาที

ลองนึกภาพว่าคุณเป็นเซลส์ที่ต้องสร้างรายชื่อลูกค้าเป้าหมายจากไดเรกทอรีอุตสาหกรรม แทนที่จะเสียเวลาคัดลอกชื่อ อีเมล และเบอร์โทรทีละรายการ คุณแค่:

- เปิดไดเรกทอรีใน Chrome

- คลิก “AI Suggest Fields” ใน Thunderbit

- ตรวจสอบคอลัมน์ที่แนะนำ (Name, Email, Phone, Company)

- กด “Scrape”

- ส่งออกผลลัพธ์ไป Google Sheets แล้วเริ่มติดต่อได้ทันที

ผู้ใช้คนหนึ่งบอกเราว่า “ผมสร้างลิสต์ลีด 200 รายชื่อได้ในไม่ถึง 10 นาที สมัยก่อนต้องใช้เวลาครึ่งวัน!”

อีคอมเมิร์ซ: ติดตามราคาคู่แข่ง

ผู้จัดการอีคอมเมิร์ซต้องคอยดูราคาคู่แข่งอยู่เสมอ ด้วย Thunderbit คุณสามารถ:

- เปิดหน้าสินค้าของคู่แข่ง

- ใช้เทมเพลตสำเร็จรูป หรือให้ AI แนะนำฟิลด์ (Product Name, Price, Availability)

- ตั้งค่าการดึงข้อมูลแบบกำหนดเวลาเพื่อตรวจราคาทุกวัน

- รับการแจ้งเตือนเมื่อราคามีการเปลี่ยนแปลง—ไม่ต้องเช็กเอง

Operations: ติดตามแคตตาล็อกของผู้ขาย

ทีมปฏิบัติการมักต้องอัปเดตแคตตาล็อกของซัพพลายเออร์ให้เป็นปัจจุบันเสมอ Thunderbit ช่วยให้คุณ:

- ดึงรายการสินค้าจากเว็บไซต์ของซัพพลายเออร์

- ส่งข้อมูลไปยัง Airtable หรือ Notion เพื่อใช้ติดตามสต็อก

- ตั้งอัปเดตเป็นระยะ เพื่อให้ทำงานกับข้อมูลล่าสุดตลอดเวลา

ฟีเจอร์สำคัญที่ควรมองหาในเครื่องมือดึงข้อมูล

เครื่องมือดึงข้อมูลไม่ได้ดีเท่ากันทุกตัว นี่คือสิ่งที่ผมแนะนำให้ดูเป็นพิเศษ:

- ใช้งานง่าย: ผู้ใช้ที่ไม่ใช่สายเทคนิคเริ่มต้นได้เร็วไหม?

- รองรับหลายแหล่งข้อมูล: เว็บไซต์, PDF, รูปภาพ, API ฯลฯ

- ส่งออกข้อมูลแบบมีโครงสร้าง: เป็นตารางสะอาด ๆ ไม่ใช่ข้อความกอง ๆ

- ระบบอัตโนมัติและการตั้งเวลา: ตั้งครั้งเดียวแล้วปล่อยให้ทำงานเอง

- เชื่อมต่อกับเครื่องมือธุรกิจ: ส่งออกไป Excel, Google Sheets, Notion, Airtable หรือ CRM ของคุณ

- ขยายสเกลได้: รองรับข้อมูลหลักพันรายการ หรือแค่หลักสิบ

- แม่นยำและเชื่อถือได้: ตรวจจับข้อผิดพลาดและปรับตัวเมื่อเว็บเปลี่ยนได้ไหม

- ดึงข้อมูลจากหน้าย่อยและ pagination: ไม่พลาดรายละเอียดที่ซ่อนอยู่

- มี AI ช่วยเหลือ: เครื่องมือควรช่วยคุณ ไม่ใช่ให้คุณไปช่วยมัน

และอย่าประเมินค่าการซัพพอร์ตกับเอกสารประกอบต่ำเกินไป—เวลามีปัญหา คุณจะอยากได้ความช่วยเหลือเร็วที่สุด

แนวปฏิบัติที่ดีสำหรับการดึงข้อมูลและการวิเคราะห์อย่างมีประสิทธิภาพ

การมีเครื่องมือที่ใช่เป็นแค่ครึ่งทาง นี่คือวิธีใช้ประโยชน์จากการดึงข้อมูลให้เต็มที่:

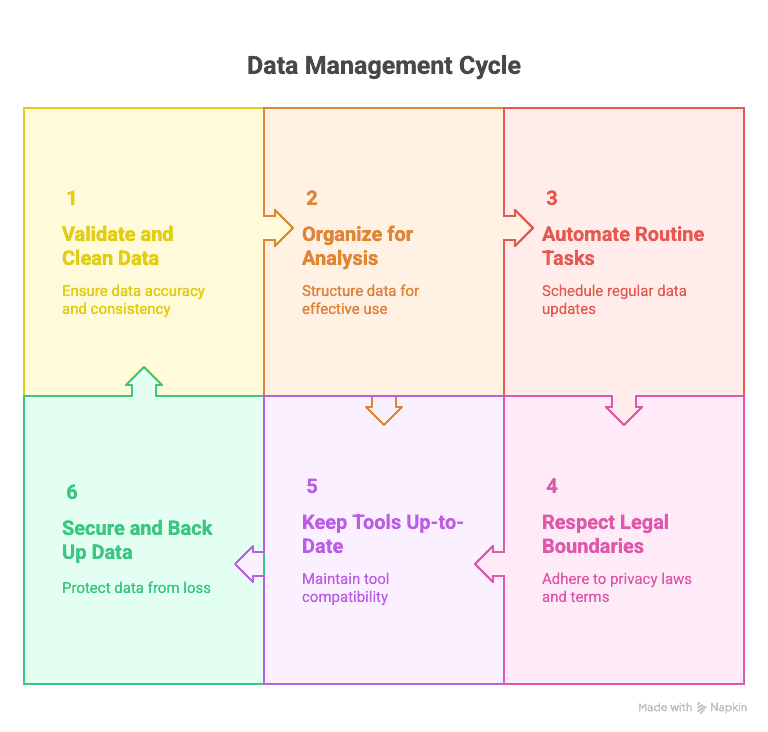

- ตรวจสอบและทำความสะอาดข้อมูล: เช็กข้อผิดพลาด รายการซ้ำ และปัญหารูปแบบเสมอ กรอกขยะเข้าไป ก็ได้ขยะกลับมา

- จัดระเบียบเพื่อการวิเคราะห์: ใช้หัวตารางที่ชัดเจนและรูปแบบที่สม่ำเสมอ คิดไว้ล่วงหน้าว่าคุณจะนำข้อมูลไปใช้ต่ออย่างไร

- ทำงานประจำให้เป็นอัตโนมัติ: ตั้งดึงข้อมูลตามรอบ เพื่อให้ข้อมูลสดใหม่เสมอ

- เคารพข้อกฎหมายและความเป็นส่วนตัว: ตรวจสอบข้อกำหนดของเว็บไซต์และกฎหมายความเป็นส่วนตัวก่อนดึงข้อมูลทุกครั้ง

- อัปเดตเครื่องมือให้ทันสมัย: เว็บไซต์เปลี่ยนตลอด ต้องมั่นใจว่าเครื่องมือของคุณตามทันได้

- เก็บรักษาและสำรองข้อมูล: อย่าให้ข้อมูลและ insight ที่คุณหามาอย่างยากลำบากหายไปเพราะฮาร์ดดิสก์พัง

เช็กลิสต์สั้น ๆ หลังดึงข้อมูลทุกครั้ง: สุ่มตรวจบางรายการ ลบข้อมูลซ้ำ นำเข้าเครื่องมือวิเคราะห์ของคุณ แล้วตั้งเตือนสำหรับการอัปเดตครั้งถัดไป

ปลดล็อกศักยภาพสูงสุดของการดึงข้อมูลเพื่อธุรกิจของคุณ

มาสรุปให้เห็นภาพรวมกัน การดึงข้อมูลไม่ใช่แค่คำฮิต แต่มันคือเครื่องมือที่ใช้งานได้จริงและเปลี่ยนเกมสำหรับทุกคนที่ทำงานกับข้อมูล ไม่ว่าคุณจะกำลังไล่ลีด ติดตามราคา หรือแค่พยายามทำความเข้าใจข้อมูลของตัวเอง เครื่องมือดึงข้อมูลที่เหมาะสมสามารถเปลี่ยนงานน่าเบื่อหลายชั่วโมงให้เหลือเพียงไม่กี่นาทีของ insight

และนี่คือมุมมองส่วนตัวของผม: อนาคตเป็นของ vertical AI agents — เครื่องมือที่โฟกัสแก้ปัญหาธุรกิจเฉพาะทางอย่างแม่นยำ ไม่ใช่แค่แชตบอทอเนกประสงค์ ทำไมถึงเป็นแบบนั้น? เพราะธุรกิจต้องการความเสถียร ความทำซ้ำได้ และผลลัพธ์ในสเกลจริง AI agents แบบทั่วไปเหมาะกับการระดมความคิดหรือถามตอบ แต่ถ้าจะทำงานซ้ำ ๆ ที่สำคัญต่อธุรกิจ คุณต้องการเครื่องมือที่สร้างมาเพื่อหน้าที่นั้นโดยตรง

นั่นคือสิ่งที่เรากำลังสร้างที่ ภารกิจของเราคือทำให้การดึงข้อมูลเข้าถึงได้สำหรับทุกคน—ไม่ต้องเขียนโค้ด ไม่ต้องปวดหัว มีแต่ผลลัพธ์ ถ้าคุณพร้อมจะทิ้งการกรอกข้อมูลด้วยมือไว้ข้างหลัง ลอง Thunderbit แล้วดูว่าคุณจะทำงานได้มากขึ้นแค่ไหน

อยากเจาะลึกต่อ? ลองดูคู่มืออื่น ๆ ของเราบน เช่น และ

ทำงานให้ฉลาดขึ้น ไม่ใช่หนักขึ้น insight มีอยู่ทุกที่—ตอนนี้คุณมีเครื่องมือไปคว้ามันมาใช้แล้ว

P.S. ถ้าคุณเริ่มฝันถึงการคัดลอกวางข้อมูลบ่อย ๆ นั่นอาจเป็นสัญญาณว่าควรเริ่มอัตโนมัติได้แล้ว หรือไม่ก็ถึงเวลาพักร้อนสักหน่อย ไม่ว่าแบบไหน Thunderbit ก็พร้อมอยู่ข้างคุณ

คำถามที่พบบ่อย

1. Thunderbit คืออะไร?

Thunderbit คือ Chrome Extension ที่ขับเคลื่อนด้วย AI ช่วยให้ทุกคนดึงข้อมูลจากเว็บไซต์ได้โดยไม่ต้องเขียนโค้ด เหมาะกับทีมขาย การตลาด อีคอมเมิร์ซ และงานปฏิบัติการ

2. ต่างจาก scraper แบบดั้งเดิมอย่างไร?

- AI ตรวจจับฟิลด์ให้อัตโนมัติ

- รองรับหน้าย่อยและ pagination

- ไม่ต้องตั้งค่าหรือเขียนโค้ด

- ส่งออกไปยัง Sheets, Excel, Notion ฯลฯ ได้

3. รองรับการล็อกอิน PDF หรือหน้าเว็บแบบไดนามิกไหม?

รองรับ

- Browser Mode: สำหรับหน้าที่ต้องล็อกอิน, PDF, และหน้าโต้ตอบได้

- Cloud Mode: ดึงข้อมูลจากเว็บสาธารณะได้รวดเร็ว

ยังรองรับการสรุปข้อความและการแปลภาษาอีกด้วย