เว็บเต็มไปด้วยข้อมูลที่มีค่า—ไม่ว่าคุณจะทำงานด้านขาย อีคอมเมิร์ซ หรือวิจัยตลาด web scraping คืออาวุธลับสำหรับการหาลูกค้าเป้าหมาย การติดตามราคา และการวิเคราะห์คู่แข่ง แต่มีข้อแม้อยู่ตรงนี้: ยิ่งธุรกิจหันมาใช้การ scraping มากขึ้น เว็บไซต์ก็ยิ่งตอบโต้หนักขึ้นเรื่อย ๆ ความจริงคือ ปัจจุบัน และ กลายเป็นเรื่องปกติไปแล้ว ถ้าคุณเคยเห็นสคริปต์ Python รันได้ลื่น ๆ อยู่ 20 นาที แล้วจู่ ๆ ก็ชนกำแพง error 403 เต็มหน้าจอ คุณคงรู้ดีว่าความหงุดหงิดมันเป็นยังไง

ผมทำงานด้าน SaaS และ automation มาหลายปี และเห็นกับตาตัวเองว่าซีลการทำ scraping จากที่ดูเหมือน “โห ง่ายจัง” กลายเป็น “ทำไมโดนบล็อกทุกที่เลย?” ได้ในพริบตา งั้นมาเน้นสิ่งที่ใช้งานได้จริงกันเลย: ผมจะพาคุณไปรู้วิธีทำ web scraping ด้วย Python แบบไม่ให้ถูกบล็อก แชร์เทคนิคและตัวอย่างโค้ดที่ดีที่สุด และบอกด้วยว่าเมื่อไหร่ควรพิจารณาทางเลือกที่ใช้ AI อย่าง ไม่ว่าคุณจะเป็นสาย Python ตัวจริง หรือแค่พยายาม scraping ให้รอด (เล่นคำหน่อย) คุณจะได้ชุดเครื่องมือสำหรับการดึงข้อมูลที่เชื่อถือได้และไม่โดนบล็อก

Web Scraping แบบไม่ให้ถูกบล็อกใน Python คืออะไร?

แก่นแท้ของ web scraping แบบไม่ให้ถูกบล็อก คือการดึงข้อมูลจากเว็บไซต์ในแบบที่ไม่ไปกระตุ้นระบบป้องกันบอทของเขา ในโลกของ Python มันไม่ได้แค่เขียนลูป requests.get() เท่านั้น แต่คือการกลมกลืนไปกับพฤติกรรมผู้ใช้จริง เลียนแบบคนจริง และก้าวนำระบบตรวจจับไปหนึ่งขั้น

ทำไมต้อง Python? ด้วยเหตุผลหลายอย่าง ทั้ง syntax ที่เข้าใจง่าย ecosystem ขนาดใหญ่ (เช่น requests, BeautifulSoup, Scrapy, Selenium) และความยืดหยุ่นตั้งแต่สคริปต์สั้น ๆ ไปจนถึง crawler แบบกระจาย แต่ความนิยมก็มาพร้อมราคา: ปัจจุบันระบบต้านบอทจำนวนมากถูกปรับมาให้จับรูปแบบการ scraping ที่มาจาก Python ได้

ดังนั้น ถ้าคุณอยาก scrape ได้อย่างเสถียร คุณต้องก้าวข้ามพื้นฐานไปอีกระดับ นั่นหมายถึงต้องเข้าใจว่าเว็บไซต์ตรวจจับบอทยังไง และคุณจะเอาชนะมันได้แบบไม่ข้ามเส้นด้านจริยธรรมหรือกฎหมายอย่างไร

ทำไมการหลีกเลี่ยงการถูกบล็อกจึงสำคัญกับโปรเจกต์ Web Scraping ด้วย Python

การถูกบล็อกไม่ใช่แค่ปัญหาทางเทคนิคเล็ก ๆ แต่มันอาจทำให้เวิร์กโฟลว์ธุรกิจทั้งระบบสะดุดได้ มาดูกันแบบชัด ๆ:

| กรณีใช้งาน | ผลกระทบเมื่อถูกบล็อก |

|---|---|

| การหาลูกค้าเป้าหมาย | รายชื่อลูกค้าไม่ครบหรือข้อมูลล้าสมัย ยอดขายหายไป |

| การติดตามราคา | พลาดการเปลี่ยนแปลงราคาคู่แข่ง ตัดสินใจตั้งราคาได้ไม่ดี |

| การรวบรวมคอนเทนต์ | ข้อมูลข่าว รีวิว หรือข้อมูลวิจัยมีช่องโหว่ |

| ข้อมูลเชิงลึกทางการตลาด | มองไม่เห็นความเคลื่อนไหวของคู่แข่งหรืออุตสาหกรรม |

| รายการอสังหาริมทรัพย์ | ข้อมูลทรัพย์สินไม่แม่นยำหรือเก่า พลาดโอกาสสำคัญ |

เมื่อ scraper ถูกบล็อก คุณไม่ได้แค่เสียข้อมูลเท่านั้น แต่ยังเสียทรัพยากร เสี่ยงปัญหาด้าน compliance และอาจตัดสินใจธุรกิจผิดจากข้อมูลที่ไม่ครบถ้วน ในโลกที่ ความน่าเชื่อถือคือทุกอย่าง

เว็บไซต์ตรวจจับและบล็อก Python Web Scraper อย่างไร

ตอนนี้เว็บไซต์ฉลาดขึ้นมากในการจับบอท นี่คือมาตรการต้านการ scraping ที่พบบ่อยที่สุดที่คุณจะเจอ (, ):

- การแบล็กลิสต์ IP: ถ้าส่งคำขอจาก IP เดียวมากเกินไป ก็โดนบล็อก

- ตรวจ User-Agent และ Header: คำขอที่ไม่มี header หรือใช้แบบทั่วไปเกินไป (เช่น

python-requests/2.25.1ค่าเริ่มต้นของ Python) จะดูโดดเด่นทันที - จำกัดอัตราการส่งคำขอ: ส่งถี่เกินไปในช่วงเวลาสั้น ๆ ก็จะถูก throttle หรือแบน

- CAPTCHA: ปริศนา “พิสูจน์ว่าคุณเป็นมนุษย์” ที่บอทแก้ไม่ได้ง่าย ๆ

- วิเคราะห์พฤติกรรม: เว็บไซต์คอยดูแพทเทิร์นแบบหุ่นยนต์ เช่น คลิกปุ่มเดิมในจังหวะเดิมตลอด

- Honeypot: ลิงก์หรือฟิลด์ที่ซ่อนอยู่ซึ่งมีไว้ล่อบอท

- Browser Fingerprinting: เก็บรายละเอียดของเบราว์เซอร์และอุปกรณ์เพื่อจับเครื่องมืออัตโนมัติ

- ติดตามคุกกี้และเซสชัน: บอทที่จัดการคุกกี้หรือเซสชันไม่ถูกต้องจะถูกจับได้

ให้นึกภาพเหมือนการตรวจความปลอดภัยสนามบิน: ถ้าคุณดูเหมือนคนทั่วไป เดินเหมือนคนทั่วไป ทุกอย่างก็ผ่านฉลุย แต่ถ้าคุณใส่เสื้อโค้ตยาวกับแว่นดำมาเต็มชุด ก็เตรียมตอบคำถามเพิ่มได้เลย

เทคนิค Python ที่จำเป็นสำหรับ Web Scraping แบบไม่ให้ถูกบล็อก

มาถึงส่วนสำคัญ: จะหลีกเลี่ยงการถูกบล็อกตอน scraping ด้วย Python ได้ยังไงบ้าง นี่คือกลยุทธ์หลักที่ scraper ทุกคนควรรู้:

หมุนเวียน Proxy และ IP Address

ทำไมถึงสำคัญ: ถ้าคำขอทั้งหมดมาจาก IP เดียว คุณจะกลายเป็นเป้าหมายของการแบน IP แบบง่าย ๆ การหมุนเวียน proxy ช่วยกระจายคำขอไปหลาย IP ทำให้บล็อกคุณได้ยากขึ้นมาก

ทำใน Python ยังไง:

1import requests

2proxies = [

3 "<http://proxy1.example.com:8000>",

4 "<http://proxy2.example.com:8000>",

5 # ...proxy เพิ่มเติม

6]

7for i, url in enumerate(urls):

8 proxy = {"http": proxies[i % len(proxies)]}

9 response = requests.get(url, proxies=proxy)

10 # ประมวลผล responseคุณสามารถใช้บริการ proxy แบบเสียเงิน (เช่น residential proxy หรือ rotating proxy) เพื่อความเสถียรมากขึ้น ()

ตั้งค่า User-Agent และ Header แบบกำหนดเอง

ทำไมถึงสำคัญ: header ค่าเริ่มต้นของ Python ตะโกนออกมาว่า “นี่คือบอท” เลย ให้เลียนแบบเบราว์เซอร์จริงด้วยการตั้ง user-agent และ header อื่น ๆ

ตัวอย่างโค้ด:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4 "Accept-Encoding": "gzip, deflate, br",

5 "Connection": "keep-alive"

6}

7response = requests.get(url, headers=headers)หมุนเวียน user-agent ด้วยจะยิ่งช่วยให้แนบเนียนขึ้น ()

สุ่มเวลาและรูปแบบการส่งคำขอ

ทำไมถึงสำคัญ: บอทเร็วและคาดเดาได้ แต่มนุษย์ช้ากว่าและสุ่มกว่า ใส่ดีเลย์และสลับรูปแบบการเข้าใช้งาน

ทิปใน Python:

1import time, random

2for url in urls:

3 response = requests.get(url)

4 time.sleep(random.uniform(2, 7)) # รอ 2–7 วินาทีถ้าใช้ Selenium คุณยังสุ่มเส้นทางการคลิกและรูปแบบการเลื่อนหน้าได้ด้วย

จัดการคุกกี้และเซสชัน

ทำไมถึงสำคัญ: หลายเว็บไซต์ต้องใช้คุกกี้หรือ session token เพื่อเข้าถึงเนื้อหา บอทที่ไม่จัดการส่วนนี้มักถูกบล็อก

วิธีทำใน Python:

1import requests

2session = requests.Session()

3response = session.get(url)

4# session จะจัดการคุกกี้ให้อัตโนมัติถ้าเป็น flow ที่ซับซ้อนกว่านั้น ให้ใช้ Selenium เพื่อดึงและนำคุกกี้กลับมาใช้ซ้ำ

จำลองพฤติกรรมมนุษย์ด้วย Headless Browser

ทำไมถึงสำคัญ: บางเว็บไซต์ใช้ JavaScript การขยับเมาส์ หรือการเลื่อนหน้าเป็นสัญญาณของผู้ใช้จริง headless browser อย่าง Selenium หรือ Playwright สามารถเลียนแบบการกระทำเหล่านี้ได้

ตัวอย่างด้วย Selenium:

1from selenium import webdriver

2from selenium.webdriver.common.action_chains import ActionChains

3import random, time

4driver = webdriver.Chrome()

5driver.get(url)

6actions = ActionChains(driver)

7actions.move_by_offset(random.randint(0, 100), random.randint(0, 100)).perform()

8time.sleep(random.uniform(2, 5))วิธีนี้ช่วยหลีกเลี่ยงการวิเคราะห์พฤติกรรมและเนื้อหาแบบไดนามิกได้ ()

กลยุทธ์ขั้นสูง: หลีกเลี่ยง CAPTCHA และ Honeypot ใน Python

CAPTCHA ถูกออกแบบมาเพื่อหยุดบอทตั้งแต่ต้นทาง แม้ไลบรารี Python บางตัวจะช่วยแก้ CAPTCHA แบบง่ายได้ แต่ scraper ระดับจริงจังส่วนใหญ่จะพึ่งบริการจากภายนอก (เช่น 2Captcha หรือ Anti-Captcha) เพื่อแก้ให้โดยมีค่าบริการ ()

ตัวอย่างการเชื่อมต่อ:

1# pseudocode สำหรับใช้ 2Captcha API

2import requests

3captcha_id = requests.post("<https://2captcha.com/in.php>", data={...}).text

4# รอผลลัพธ์ แล้วส่งกลับไปพร้อมคำขอของคุณHoneypot คือฟิลด์หรือลิงก์ที่ซ่อนอยู่ ซึ่งมีไว้ให้บอทหลงเข้าไปเท่านั้น ให้หลีกเลี่ยงการคลิกหรือส่งข้อมูลใด ๆ ที่ไม่เห็นในเบราว์เซอร์จริง ()

ออกแบบ Request Header ให้แข็งแรงด้วยไลบรารี Python

นอกจาก user-agent แล้ว คุณยังหมุนเวียนและสุ่ม header อื่น ๆ ได้ด้วย เช่น Referer, Accept, Origin เพื่อให้กลมกลืนยิ่งขึ้น

ด้วย Scrapy:

1class MySpider(scrapy.Spider):

2 custom_settings = {

3 'DEFAULT_REQUEST_HEADERS': {

4 'User-Agent': '...',

5 'Accept-Language': 'en-US,en;q=0.9',

6 # header อื่น ๆ

7 }

8 }ด้วย Selenium: ใช้ browser profile หรือส่วนขยายเพื่อกำหนด header หรือฉีดผ่าน JavaScript

อย่าลืมอัปเดตรายการ header ของคุณอยู่เสมอ—ลองคัดลอก request จริงจาก browser DevTools มาเป็นแนวทางได้

เมื่อ Python Scraping แบบดั้งเดิมไม่พอ: การมาถึงของเทคโนโลยีต้านบอท

ความจริงคือ ยิ่งการ scraping ได้รับความนิยมมากขึ้น ระบบต้านบอทก็ยิ่งพัฒนาตาม การตรวจจับด้วย AI, เกณฑ์การส่งคำขอแบบไดนามิก และ browser fingerprinting ทำให้แม้แต่สคริปต์ Python ขั้นสูงก็ยังซ่อนตัวได้ยากขึ้นกว่าเดิม ()

บางครั้งไม่ว่าคุณจะเขียนโค้ดเก่งแค่ไหน ก็จะเจอกำแพงจนได้ และนั่นคือเวลาที่ควรมองหาวิธีอื่น

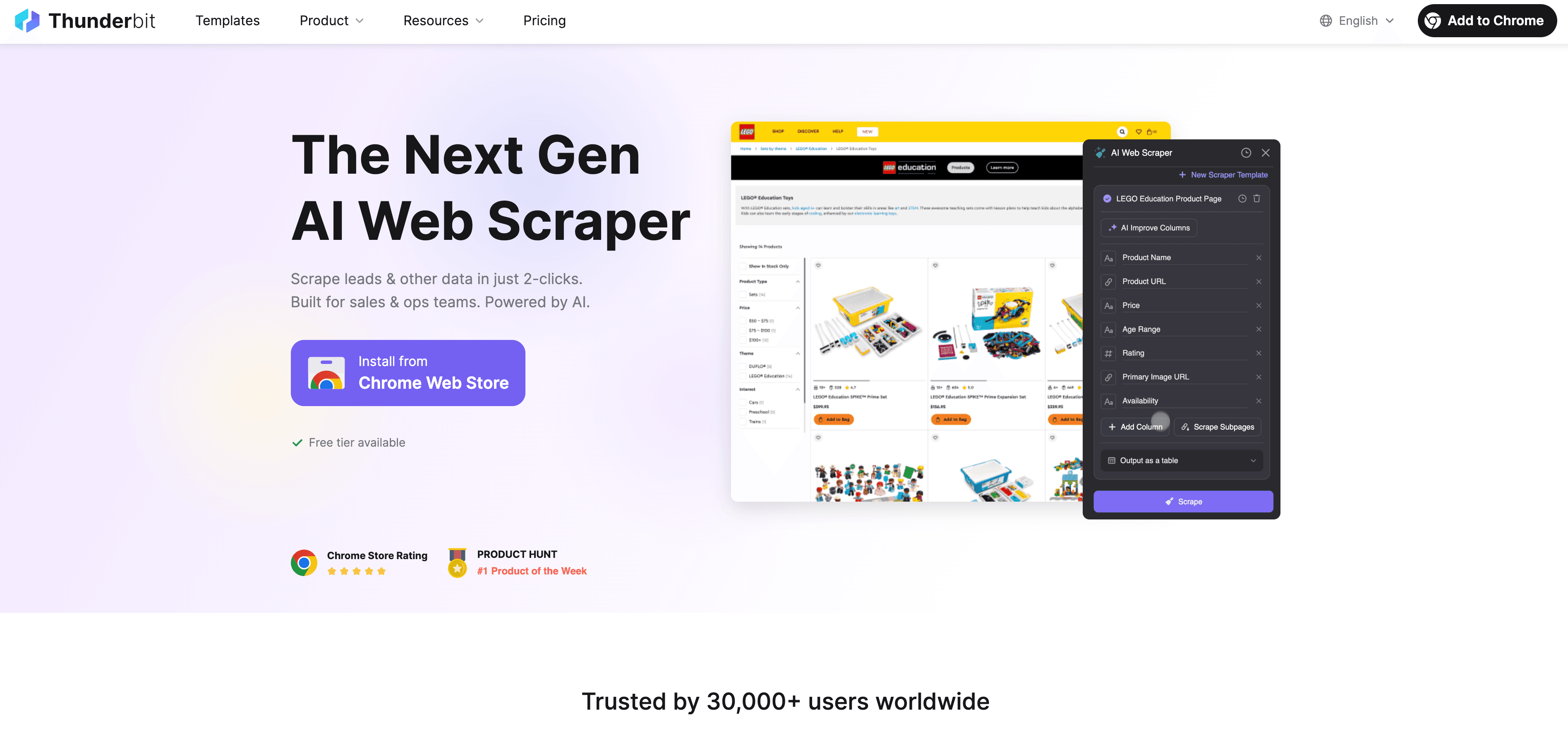

Thunderbit: ทางเลือก AI Web Scraper แทนการ Scraping ด้วย Python

เมื่อ Python ไปต่อไม่ไหว ก็เข้ามาเป็น web scraper แบบ no-code ที่ขับเคลื่อนด้วย AI และออกแบบมาสำหรับผู้ใช้ธุรกิจ—not just developers แทนที่จะต้องมานั่งปวดหัวกับ proxy, header และ CAPTCHA ตัว AI agent ของ Thunderbit จะอ่านเว็บไซต์ แนะนำฟิลด์ที่ควรดึง และจัดการทุกอย่างตั้งแต่การไล่ไปยังหน้าย่อยจนถึงการส่งออกข้อมูล

อะไรทำให้ Thunderbit แตกต่าง?

- AI แนะนำฟิลด์: คลิก “AI Suggest Fields” แล้ว Thunderbit จะสแกนหน้า แนะนำคอลัมน์ และยังสร้างคำสั่งการดึงข้อมูลให้ด้วย

- การดึงข้อมูลหน้าย่อย: Thunderbit เข้าชมแต่ละหน้าย่อยได้ เช่น รายละเอียดสินค้า หรือโปรไฟล์ LinkedIn แล้วเติมข้อมูลในตารางให้โดยอัตโนมัติ

- การ scraping แบบ Cloud หรือผ่านเบราว์เซอร์: เลือกตัวเลือกที่เร็วที่สุด—ใช้ cloud สำหรับเว็บไซต์สาธารณะ และใช้เบราว์เซอร์สำหรับหน้าที่ต้องล็อกอิน

- Scheduled Scraping: ตั้งค่าแล้วปล่อยให้ทำงาน Thunderbit ดึงข้อมูลตามกำหนดเวลาได้ ทำให้ข้อมูลของคุณสดใหม่เสมอ

- เทมเพลตพร้อมใช้ทันที: สำหรับเว็บไซต์ยอดนิยมอย่าง Amazon, Zillow, Shopify ฯลฯ Thunderbit มีเทมเพลตแบบคลิกเดียว ไม่ต้องตั้งค่า

- ส่งออกข้อมูลฟรี: ส่งออกไปยัง Excel, Google Sheets, Airtable หรือ Notion ได้ ไม่มีค่าธรรมเนียมเพิ่ม

Thunderbit ได้รับความไว้วางใจจากผู้ใช้กว่า และคุณไม่ต้องเขียนโค้ดแม้แต่บรรทัดเดียว

Thunderbit ช่วยให้ผู้ใช้หลีกเลี่ยงการถูกบล็อกและทำระบบดึงข้อมูลอัตโนมัติได้อย่างไร

AI ของ Thunderbit ไม่ได้แค่เลียนแบบพฤติกรรมมนุษย์ แต่มันปรับตัวตามแต่ละเว็บไซต์แบบเรียลไทม์ จึงลดความเสี่ยงที่จะถูกบล็อกได้ นี่คือวิธีการ:

- AI ปรับตามการเปลี่ยนแปลงของเลย์เอาต์: ไม่ต้องเจอสคริปต์พังอีกต่อไปเมื่อเว็บไซต์อัปเดตดีไซน์

- จัดการหน้าย่อยและการแบ่งหน้าอัตโนมัติ: Thunderbit ตามลิงก์และรายการแบบหลายหน้าให้เอง เหมือนผู้ใช้จริง

- Cloud scraping แบบสเกลใหญ่: ดึงข้อมูลได้ครั้งละสูงสุด 50 หน้า รวดเร็วสุด ๆ

- ไม่ต้องเขียนโค้ด ไม่ต้องดูแลเยอะ: ใช้เวลาไปกับการวิเคราะห์ แทนที่จะนั่งดีบัก

ถ้าอยากเจาะลึกมากขึ้น ดูได้ที่

เปรียบเทียบ Python Scraping กับ Thunderbit: ควรเลือกอะไร?

มาวางเทียบกันชัด ๆ:

| ฟีเจอร์ | Python Scraping | Thunderbit |

|---|---|---|

| เวลาในการตั้งค่า | ปานกลาง–สูง (สคริปต์, proxy ฯลฯ) | ต่ำ (2 คลิก ที่เหลือ AI จัดการ) |

| ทักษะเทคนิค | ต้องเขียนโค้ด | ไม่ต้องเขียนโค้ด |

| ความน่าเชื่อถือ | แปรผัน (พังง่าย) | สูง (AI ปรับตัวตามการเปลี่ยนแปลง) |

| ความเสี่ยงถูกบล็อก | ปานกลาง–สูง | ต่ำ (AI กลมกลืนกับผู้ใช้และปรับตัวได้) |

| การขยายสเกล | ต้องทำโค้ดหรือคลาวด์แบบกำหนดเอง | มี cloud/batch scraping ในตัว |

| การดูแลรักษา | บ่อย (เว็บเปลี่ยน, ถูกบล็อก) | น้อยมาก (AI ปรับอัตโนมัติ) |

| ตัวเลือกการส่งออก | ทำเอง (CSV, DB) | ส่งตรงไปยัง Sheets, Notion, Airtable, CSV |

| ค่าใช้จ่าย | ฟรี (แต่ใช้เวลามาก) | มีแพ็กเกจฟรี และแพ็กเกจเสียเงินสำหรับสเกลใหญ่ |

เมื่อไหร่ควรใช้ Python:

- คุณต้องการควบคุมเต็มรูปแบบ มี logic เฉพาะตัว หรือเชื่อมกับเวิร์กโฟลว์ Python อื่น ๆ

- คุณกำลัง scrape เว็บไซต์ที่แทบไม่มีการป้องกันบอท

เมื่อไหร่ควรใช้ Thunderbit:

- คุณต้องการความเร็ว ความเสถียร และไม่อยากตั้งค่าอะไร

- คุณกำลัง scrape เว็บไซต์ที่ซับซ้อนหรือเปลี่ยนบ่อย

- คุณไม่อยากยุ่งกับ proxy, CAPTCHA หรือโค้ด

คู่มือทีละขั้นตอน: ตั้งค่า Web Scraping แบบไม่ให้ถูกบล็อกใน Python

มาลองดูตัวอย่างใช้งานจริง: การ scrape ข้อมูลสินค้า from เว็บไซต์ตัวอย่าง พร้อมใช้แนวปฏิบัติป้องกันการถูกบล็อก

1. ติดตั้งไลบรารีที่จำเป็น

1pip install requests beautifulsoup4 fake-useragent2. เตรียมสคริปต์

1import requests

2from bs4 import BeautifulSoup

3from fake_useragent import UserAgent

4import time, random

5ua = UserAgent()

6urls = ["<https://example.com/product/1>", "<https://example.com/product/2>"] # เปลี่ยนเป็น URL ของคุณ

7for url in urls:

8 headers = {

9 "User-Agent": ua.random,

10 "Accept-Language": "en-US,en;q=0.9"

11 }

12 response = requests.get(url, headers=headers)

13 if response.status_code == 200:

14 soup = BeautifulSoup(response.text, "html.parser")

15 # ดึงข้อมูลตรงนี้

16 print(soup.title.text)

17 else:

18 print(f"ถูกบล็อกหรือเกิดข้อผิดพลาดที่ {url}: {response.status_code}")

19 time.sleep(random.uniform(2, 6)) # หน่วงเวลาแบบสุ่ม3. เพิ่มการหมุนเวียน Proxy (ไม่บังคับ)

1proxies = [

2 "<http://proxy1.example.com:8000>",

3 "<http://proxy2.example.com:8000>",

4 # proxy เพิ่มเติม

5]

6for i, url in enumerate(urls):

7 proxy = {"http": proxies[i % len(proxies)]}

8 headers = {"User-Agent": ua.random}

9 response = requests.get(url, headers=headers, proxies=proxy)

10 # ...โค้ดส่วนที่เหลือ4. จัดการคุกกี้และเซสชัน

1session = requests.Session()

2for url in urls:

3 response = session.get(url, headers=headers)

4 # ...โค้ดส่วนที่เหลือ5. ทิปสำหรับการแก้ปัญหา

- ถ้าคุณเห็น error 403/429 จำนวนมาก ให้ลดความถี่ของคำขอ หรือใช้ proxy ใหม่

- ถ้าชน CAPTCHA ให้พิจารณาใช้ Selenium หรือบริการแก้ CAPTCHA

- ตรวจสอบ

robots.txtและเงื่อนไขการให้บริการของเว็บไซต์เสมอ

สรุปและประเด็นสำคัญ

Web scraping ใน Python ทรงพลังมาก—but ความเสี่ยงที่จะถูกบล็อกก็ยังคงสูงอยู่ตลอดเมื่อเทคโนโลยีต้านบอทพัฒนาไปเรื่อย ๆ วิธีที่ดีที่สุดในการหลีกเลี่ยงการถูกบล็อกคือการผสมแนวปฏิบัติทางเทคนิคที่ดี (proxy หมุนเวียน, header ฉลาด ๆ, หน่วงเวลาแบบสุ่ม, จัดการ session และ headless browser) เข้ากับความเคารพต่อกฎของเว็บไซต์และจริยธรรม

แต่บางครั้ง ต่อให้ใช้เทคนิค Python ที่ดีที่สุดก็ยังไม่พอ และนั่นคือจุดที่เครื่องมือขับเคลื่อนด้วย AI อย่าง โดดเด่น—ให้วิธีดึงข้อมูลแบบ no-code ที่ทนต่อการบล็อกและเหมาะกับงานธุรกิจ ดึงข้อมูลที่คุณต้องการได้เร็วกว่า

อยากดูไหมว่าการ scraping ทำได้ง่ายแค่ไหน? แล้วลองใช้ด้วยตัวคุณเอง—or แวะดู ของเราเพื่ออ่านเคล็ดลับและคู่มือการ scraping เพิ่มเติม

คำถามที่พบบ่อย

1. ทำไมเว็บไซต์ถึงบล็อก Python web scraper?

เว็บไซต์บล็อก scraper เพื่อปกป้องข้อมูลของตัวเอง ป้องกันเซิร์ฟเวอร์ทำงานหนักเกินไป และหยุดบอทอัตโนมัติไม่ให้ใช้บริการในทางที่ผิด Python scripts จะสังเกตได้ง่ายถ้าใช้ header ค่าเริ่มต้น ไม่จัดการคุกกี้ หรือส่งคำขอถี่เกินไป

2. วิธีที่มีประสิทธิภาพที่สุดในการหลีกเลี่ยงการถูกบล็อกตอน scraping ด้วย Python คืออะไร?

ใช้ rotating proxy ตั้งค่า user-agent และ header ให้สมจริง สุ่มเวลาในการส่งคำขอ จัดการคุกกี้/เซสชัน และจำลองพฤติกรรมมนุษย์ด้วยเครื่องมืออย่าง Selenium หรือ Playwright

3. Thunderbit ช่วยหลีกเลี่ยงการถูกบล็อกได้อย่างไรเมื่อเทียบกับสคริปต์ Python?

Thunderbit ใช้ AI ปรับตัวตามเลย์เอาต์ของเว็บไซต์ เลียนแบบการท่องเว็บของมนุษย์ และจัดการหน้าย่อยกับการแบ่งหน้าให้อัตโนมัติ จึงลดความเสี่ยงถูกบล็อกด้วยการกลมกลืนไปกับผู้ใช้และปรับวิธีทำงานแบบเรียลไทม์ โดยไม่ต้องเขียนโค้ดหรือใช้ proxy

4. ควรใช้ Python scraping หรือเครื่องมือ AI อย่าง Thunderbit เมื่อไหร่?

ใช้ Python เมื่อคุณต้องการ logic เฉพาะตัว การเชื่อมต่อกับโค้ด Python อื่น หรือกำลัง scrape เว็บไซต์ที่ไม่ซับซ้อน ใช้ Thunderbit สำหรับงาน scraping ที่เร็ว เชื่อถือได้ และขยายสเกลได้—โดยเฉพาะเมื่อเว็บไซต์ซับซ้อน เปลี่ยนบ่อย หรือบล็อกสคริปต์อย่างหนัก

5. Web scraping ถูกกฎหมายไหม?

Web scraping ถูกกฎหมายเมื่อเป็นข้อมูลที่เปิดเผยต่อสาธารณะ แต่คุณต้องเคารพเงื่อนไขการให้บริการ นโยบายความเป็นส่วนตัว และกฎหมายที่เกี่ยวข้องของแต่ละเว็บไซต์ ห้าม scrape ข้อมูลอ่อนไหวหรือข้อมูลส่วนตัว และควรใช้อย่างมีจริยธรรมและรับผิดชอบเสมอ

พร้อมจะ scrape อย่างฉลาดกว่าเดิม ไม่ใช่ทำงานหนักกว่าเดิมแล้วหรือยัง? ลองใช้ Thunderbit แล้วปล่อยให้เรื่องการบล็อกเป็นอดีตไปเลย

เรียนรู้เพิ่มเติม:

- การ Scraping Google News ด้วย Python: คู่มือทีละขั้นตอน

- สร้างเครื่องมือติดตามราคาสำหรับ Best Buy ด้วย Python

- 14 วิธีสำหรับ Web Scraping แบบไม่ให้ถูกบล็อก

- 10 เคล็ดลับที่ดีที่สุดในการไม่ให้ถูกบล็อกตอนทำ Web Scraping