มีอะไรบางอย่างที่ “คลาสสิก” เสมอเวลาที่เราเปิดเทอร์มินัล พิมพ์คำสั่งสั้น ๆ แค่บรรทัดเดียว แล้วเห็นข้อมูลดิบจากเว็บไหลออกมาราวกับเพิ่ง “ปลดล็อก” โลกดิจิทัล สำหรับนักพัฒนาและคนสายเทคนิค นี่แหละคือไม้กายสิทธิ์—เครื่องมือบรรทัดคำสั่งหน้าตาเรียบ ๆ ที่ทำงานเงียบ ๆ อยู่บนอุปกรณ์นับพันล้าน ตั้งแต่เซิร์ฟเวอร์บนคลาวด์ไปจนถึงตู้เย็นอัจฉริยะในบ้าน และถึงแม้ปี 2026 จะมีเครื่องมือสแครปแบบ no-code กับ AI ให้เลือกเพียบ การทำเว็บสแครปด้วย curl ก็ยังเป็นตัวเลือกยอดฮิตสำหรับคนที่อยากได้ “ความเร็ว” “การควบคุม” และ “ความสามารถในการเขียนสคริปต์” แบบเต็มมือ

ผมทำงานด้านเครื่องมืออัตโนมัติมาหลายปี ช่วยหลายทีมจัดการข้อมูลจากเว็บ และจนถึงวันนี้ผมก็ยังหยิบ cURL มาใช้บ่อย ๆ เวลาอยากดึงหน้าเว็บ เช็ก/ดีบัก API หรือทำต้นแบบเวิร์กโฟลว์การสแครปแบบเร็ว ๆ ในคู่มือนี้ ผมจะพาคุณไล่ตั้งแต่พื้นฐานไปจนถึงทริกแบบมือโปรของ curl เว็บสแครป—มีตัวอย่างคำสั่งจริง เคล็ดลับใช้งาน และมุมมองแบบตรงไปตรงมาว่า cURL เด่นตรงไหน (และติดข้อจำกัดตรงไหน) และถ้าคุณเป็นสายธุรกิจที่ไม่อยากยุ่งกับ command line ผมจะพาไปรู้จัก เว็บสแครปเปอร์ที่ขับเคลื่อนด้วย AI ของเรา ที่ช่วยให้คุณไปจาก “อยากได้ข้อมูลนี้” เป็น “นี่คือสเปรดชีตของฉัน” ได้ในสองคลิก—ไม่ต้องเขียนโค้ด

ไปดูกันว่าเหตุใด cURL ยังสำคัญกับการทำเว็บสแครปในปี 2025 วิธีใช้งานให้คุ้ม และเมื่อไหร่ควรขยับไปใช้เครื่องมือที่ทรงพลังยิ่งกว่า

cURL คืออะไร? รากฐานของการทำ web-scraping-with-curl

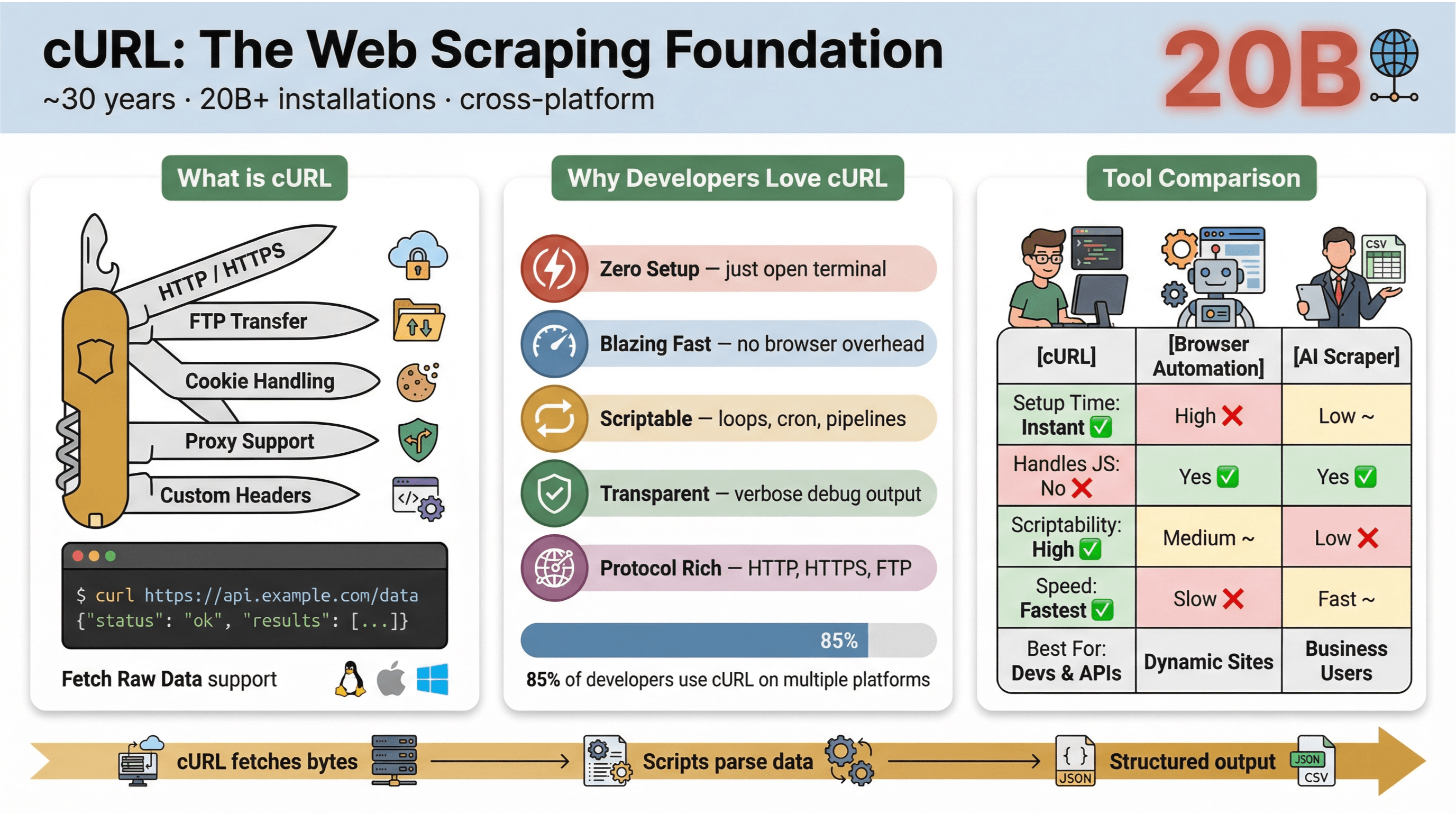

พูดแบบแก่น ๆ คือเครื่องมือและไลบรารีบนบรรทัดคำสั่งสำหรับรับ-ส่งข้อมูลผ่าน URL อยู่มานานเกือบ 30 ปี (ใช่ครับ นานขนาดนั้น) และเจอได้แทบทุกที่—ฝังในระบบปฏิบัติการ ใช้ในสคริปต์ และทำหน้าที่รับส่งข้อมูลแบบเงียบ ๆ มากกว่า ถ้าคุณเคยสั่งดึงหน้าเว็บ ทดสอบ API หรือดาวน์โหลดไฟล์แบบไว ๆ โอกาสสูงมากที่คุณเคยใช้ cURL มาแล้ว

เหตุผลที่ cURL ได้รับความนิยมในการทำเว็บสแครปมีหลายข้อ:

- เบาและใช้ได้ทุกแพลตฟอร์ม: ทำงานได้บน Linux, macOS, Windows รวมถึงอุปกรณ์ฝังตัว

- รองรับหลายโปรโตคอล: ใช้ได้กับ HTTP, HTTPS, FTP และอื่น ๆ

- เขียนสคริปต์ได้ง่าย: เหมาะกับงานอัตโนมัติ, cron job และงานเชื่อมต่อระบบ

- ไม่ต้องมีการโต้ตอบจากผู้ใช้: ออกแบบมาสำหรับงานแบบ non-interactive เหมาะกับงานแบตช์และพายป์ไลน์

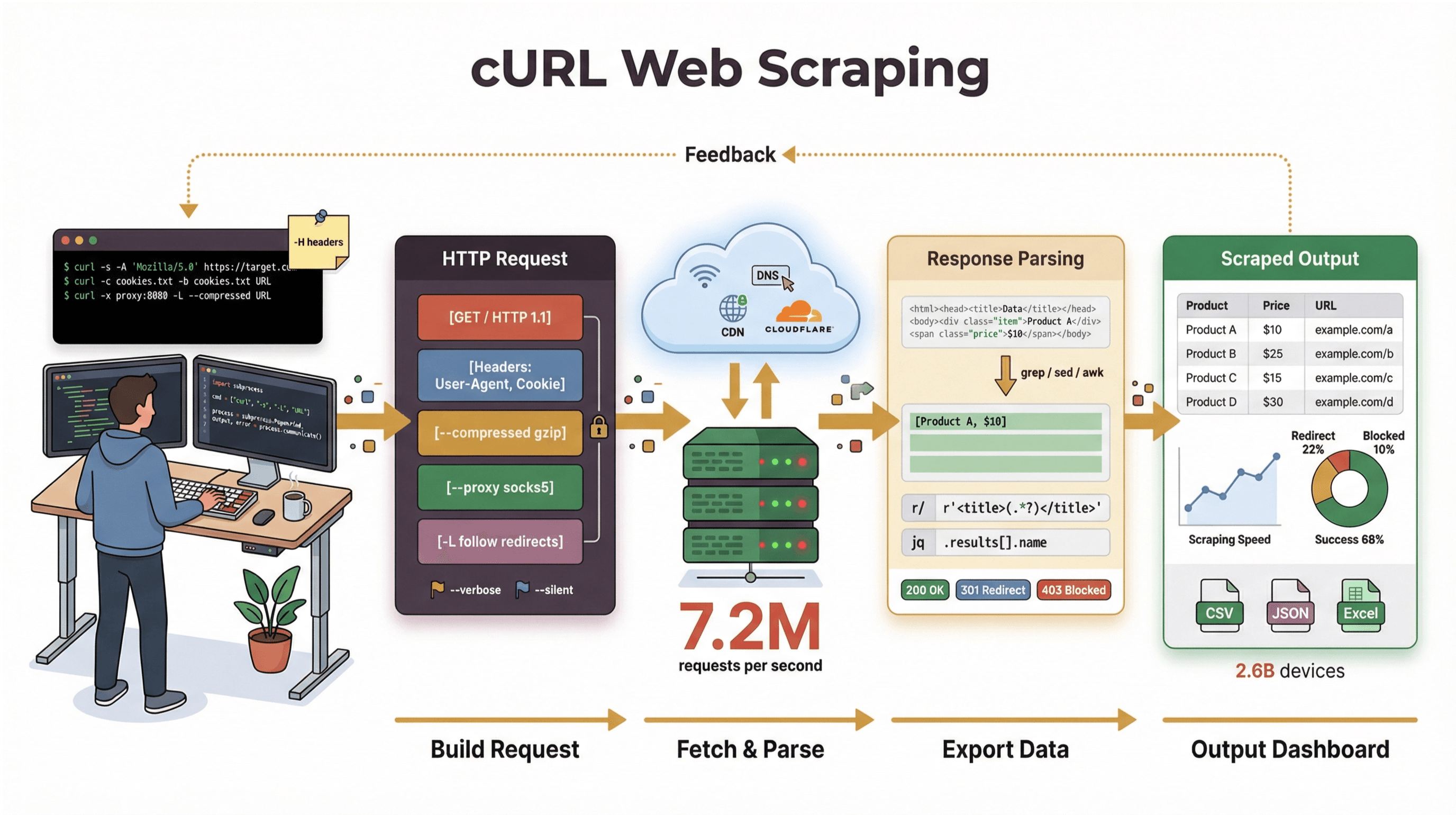

แต่ต้องพูดให้ชัด: งานหลักของ cURL คือ “ดึงข้อมูลดิบ” ไม่ว่าจะเป็น HTML, JSON, รูปภาพ ฯลฯ มันไม่ได้ช่วยแยกวิเคราะห์ (parse) เรนเดอร์ หรือจัดโครงสร้างข้อมูลให้คุณ ลองมอง cURL เป็น “กิโลเมตรแรก” ของการสแครป: มันพาคุณไปถึงข้อมูลในรูปไบต์ แต่การแปลงให้เป็นข้อมูลเชิงโครงสร้างต้องพึ่งเครื่องมืออื่น (เช่นสคริปต์ Python, grep/sed/awk หรือ AI web scraper)

อยากดูเอกสารทางการ แนะนำ

ทำไมต้องใช้ cURL สำหรับเว็บสแครป? (curl web scraping tutorial)

แล้วทำไมทั้งนักพัฒนาและผู้ใช้สายเทคนิคถึงยังวนกลับมาใช้ cURL ในงานสแครป ทั้งที่มีเครื่องมือใหม่ ๆ เยอะมาก? จุดเด่นของ cURL คือ:

- เริ่มได้ทันที: ไม่ต้องติดตั้งเพิ่ม ไม่ต้องพึ่ง dependency แค่เปิดเทอร์มินัลก็ลุยได้

- เร็ว: ดึงข้อมูลได้ทันทีโดยไม่ต้องรอเบราว์เซอร์โหลด

- เขียนสคริปต์ได้: วนลูปหลาย URL ทำอัตโนมัติ และต่อคำสั่งเป็นชุดได้ง่าย

- รองรับฟีเจอร์ครบ: จัดการคุกกี้ พร็อกซี รีไดเรกต์ เฮดเดอร์กำหนดเอง ฯลฯ

- โปร่งใส: เปิดโหมด verbose/debug เพื่อเห็นรายละเอียดการทำงานได้ชัด

จาก มีผู้ตอบมากกว่า 85% ที่ใช้งาน cURL แบบ command-line และเกือบทั้งหมดใช้ข้ามหลายแพลตฟอร์ม มันยังเป็นเหมือนมีดพกสารพัดประโยชน์สำหรับ HTTP request การดึงข้อมูลแบบเร็ว ๆ และการแก้ปัญหา

ตารางเปรียบเทียบ cURL กับวิธีสแครปแบบอื่น:

| คุณสมบัติ | cURL | ออโตเมชันเบราว์เซอร์ (เช่น Selenium) | AI Web Scraper (เช่น Thunderbit) |

|---|---|---|---|

| เวลาในการตั้งค่า | ทันที | สูง | ต่ำ |

| ความสามารถในการเขียนสคริปต์ | สูง | ปานกลาง | ต่ำ (ไม่ต้องเขียนโค้ด) |

| รองรับ JavaScript | ไม่ได้ | ได้ | ได้ (Thunderbit: ผ่านเบราว์เซอร์) |

| รองรับคุกกี้/เซสชัน | ต้องจัดการเอง | อัตโนมัติ | อัตโนมัติ |

| การจัดโครงสร้างข้อมูล | ต้องทำเอง (ค่อย parse) | ต้องทำเอง (ค่อย parse) | ใช้ AI/เทมเพลตช่วย |

| เหมาะกับงาน | นักพัฒนา, ดึงเร็ว ๆ | เว็บซับซ้อน/ไดนามิก | สายธุรกิจ, ส่งออกแบบมีโครงสร้าง |

สรุปคือ: cURL เหนือชั้นมากสำหรับการดึงข้อมูลแบบเร็วและเขียนสคริปต์ได้—โดยเฉพาะหน้าเว็บแบบ static, API หรือเวิร์กโฟลว์ง่าย ๆ แต่ถ้าต้อง parse HTML ซับซ้อน จัดการ JavaScript หรืออยากได้ข้อมูลเป็นตารางพร้อมใช้งาน คุณจะอยากใช้เครื่องมือเฉพาะทางมากกว่า

เริ่มต้นใช้งาน: ตัวอย่างคำสั่ง cURL สำหรับเว็บสแครปแบบพื้นฐาน

มาลงมือทำกัน นี่คือวิธีใช้ cURL กับงานสแครปพื้นฐานแบบทีละขั้น

ดึง HTML ดิบด้วย cURL

กรณีง่ายที่สุด: ดึง HTML ของหน้าเว็บ

1curl https://books.toscrape.com/คำสั่งนี้จะดึงหน้าแรกของ เว็บไซต์เดโมสาธารณะสำหรับฝึกสแครป คุณจะเห็น HTML ดิบในเทอร์มินัล มองหาแท็กอย่าง <title> หรือข้อความอย่าง “In stock.”

บันทึกผลลัพธ์ลงไฟล์

อยากเก็บ HTML ไว้ไป parse ทีหลัง ใช้แฟลก -o:

1curl -o page.html https://books.toscrape.com/จากนั้นคุณจะได้ไฟล์ page.html ที่มี HTML ครบทั้งหน้า เหมาะมากสำหรับนำไปวิเคราะห์หรือ parse ต่อด้วยเครื่องมืออื่น

ส่งคำขอแบบ POST ด้วย cURL

ต้องส่งฟอร์มหรือคุยกับ API ใช้แฟลก -d สำหรับ POST ตัวอย่างนี้ใช้ เว็บไซต์สำหรับทดสอบ HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"คุณจะได้ผลลัพธ์เป็น JSON ที่สะท้อนข้อมูลที่ส่งไป เหมาะสำหรับทดสอบและทำต้นแบบ

ดูเฮดเดอร์และดีบัก

บางครั้งคุณอยากดู response header หรือไล่ปัญหา request:

-

ดูเฉพาะเฮดเดอร์ (HEAD request):

1curl -I https://books.toscrape.com/ -

แสดงเฮดเดอร์พร้อมบอดี้:

1curl -i https://httpbin.org/get -

โหมด verbose/debug:

1curl -v https://books.toscrape.com/

แฟลกเหล่านี้ช่วยให้เห็นรายละเอียดเบื้องหลัง ซึ่งสำคัญมากเวลาแก้ปัญหา

ตารางสรุปคำสั่งที่ใช้บ่อย:

| งาน | ตัวอย่างคำสั่ง | หมายเหตุ |

|---|---|---|

| ดึง HTML | curl URL | แสดง HTML ในเทอร์มินัล |

| บันทึกลงไฟล์ | curl -o file.html URL | เขียนผลลัพธ์ลงไฟล์ |

| ตรวจเฮดเดอร์ | curl -I URL หรือ curl -i URL | -I ดูเฉพาะ HEAD, -i แสดงเฮดเดอร์พร้อมบอดี้ |

| POST ข้อมูลฟอร์ม | curl -d "a=1&b=2" URL | ส่งข้อมูลแบบ form-encoded |

| ดีบัก request/response | curl -v URL | แสดงรายละเอียด request/response |

ดูตัวอย่างเพิ่มเติมได้ที่

อัปเลเวล: เทคนิคเว็บสแครปขั้นสูงด้วย cURL (web-scraping-with-curl)

เมื่อคล่องพื้นฐานแล้ว cURL ยังมีฟีเจอร์ขั้นสูงสำหรับงานสแครปที่ซับซ้อนขึ้น

จัดการคุกกี้และเซสชัน

หลายเว็บไซต์ต้องใช้คุกกี้เพื่อคงสถานะล็อกอินหรือการติดตามผู้ใช้ ด้วย cURL คุณสามารถบันทึกและนำคุกกี้กลับมาใช้ซ้ำได้:

1# เก็บคุกกี้หลังล็อกอิน

2curl -c cookies.txt https://example.com/login

3# ใช้คุกกี้กับคำขอถัดไป

4curl -b cookies.txt https://example.com/accountวิธีนี้ช่วยเลียนแบบเซสชันของเบราว์เซอร์และเข้าถึงหน้าหลังล็อกอินได้ (ตราบใดที่ไม่มีด่าน JavaScript)

ปลอม User-Agent และตั้งค่าเฮดเดอร์เอง

บางเว็บแสดงเนื้อหาต่างกันตาม User-Agent หรือเฮดเดอร์ โดยค่าเริ่มต้น cURL จะบอกตัวเองว่า “curl/VERSION” ซึ่งอาจโดนบล็อกหรือได้คอนเทนต์คนละแบบ หากอยากให้เหมือนเบราว์เซอร์:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/หรือกำหนดเฮดเดอร์เอง เช่นภาษา:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/ช่วยให้ได้คอนเทนต์ใกล้เคียงกับที่ผู้ใช้จริงเห็น

ใช้พร็อกซีสำหรับเว็บสแครป

ต้องการส่งคำขอผ่านพร็อกซี (ทดสอบตามภูมิภาคหรือหลีกเลี่ยงการบล็อก IP) ใช้แฟลก -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/อย่าลืมใช้พร็อกซีอย่างรับผิดชอบและอยู่ภายใต้เงื่อนไขการใช้งานของเว็บไซต์

ทำสแครปหลายหน้าด้วยอัตโนมัติ

อยากดึงหลายหน้า เช่นรายการสินค้าที่แบ่งหน้า ใช้ลูปในเชลล์ได้เลย:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneตัวอย่างนี้ดึงหน้าที่ 2 ถึง 5 ของแคตตาล็อก Books to Scrape แล้วบันทึกแยกไฟล์ (หน้า 1 คือหน้าแรก)

ข้อจำกัดของ web-scraping-with-curl: สิ่งที่ควรรู้

แม้ผมจะชอบ cURL มาก แต่มันไม่ใช่คำตอบสำหรับทุกอย่าง จุดที่ cURL ไปไม่ถึงคือ:

- รัน JavaScript ไม่ได้: cURL จัดการหน้าเว็บที่ต้องใช้ JavaScript เพื่อเรนเดอร์คอนเทนต์หรือผ่านด่านกันบอทไม่ได้ ()

- ต้อง parse เอง: ได้แค่ HTML/JSON ดิบ ต้องเขียนโค้ดหรือใช้เครื่องมืออื่นช่วยแยกข้อมูล

- จัดการเซสชันซับซ้อนได้ยาก: ล็อกอินหลายขั้น โทเคน หรือฟอร์มหลายสเต็ปจะยุ่งขึ้นเร็วมาก

- ไม่มีการจัดข้อมูลเป็นโครงสร้างในตัว: ไม่ได้แปลงหน้าเว็บเป็นแถว/ตาราง/สเปรดชีตให้

- เสี่ยงโดนระบบกันบอทจับได้: หลายเว็บใช้การป้องกันขั้นสูง (JavaScript, fingerprinting, CAPTCHA) ที่ cURL ข้ามไม่ได้ ()

ตารางเปรียบเทียบแบบเร็ว:

| ข้อจำกัด | ใช้ cURL อย่างเดียว | เครื่องมือสแครปยุคใหม่ (เช่น Thunderbit) |

|---|---|---|

| รองรับ JavaScript | ไม่ได้ | ได้ |

| การจัดโครงสร้างข้อมูล | ต้องทำเอง | อัตโนมัติ (AI/เทมเพลต) |

| การจัดการเซสชัน | ต้องทำเอง | อัตโนมัติ |

| การหลบระบบกันบอท | จำกัด | ขั้นสูง (เบราว์เซอร์/AI) |

| ความง่ายในการใช้งาน | ต้องมีทักษะเทคนิค | ใช้ได้แม้ไม่ใช่สายเทคนิค |

สำหรับหน้าเว็บแบบ static และ API นั้น cURL ยอดเยี่ยมมาก แต่ถ้าเว็บไดนามิกหรือมีการป้องกันสูง คุณควรขยับไปใช้เครื่องมือที่เหมาะกว่า

Thunderbit vs. cURL: แนวทางเว็บสแครปที่เหมาะกับผู้ใช้ไม่สายเทคนิค

มาพูดถึง กันบ้าง—Chrome Extension เว็บสแครปเปอร์ที่ขับเคลื่อนด้วย AI ของเรา ถ้าคุณเป็นเซลส์ มาร์เก็ตติ้ง หรือทีมโอเปอเรชันที่อยากดึงข้อมูลจากเว็บไปลง Excel, Google Sheets หรือ Notion โดยไม่ต้องแตะ command line Thunderbit ถูกสร้างมาเพื่อคุณ

เปรียบเทียบ Thunderbit กับ cURL:

| คุณสมบัติ | cURL | Thunderbit |

|---|---|---|

| รูปแบบการใช้งาน | บรรทัดคำสั่ง | คลิกเลือกได้ (Chrome Extension) |

| AI แนะนำฟิลด์/คอลัมน์ | ไม่ได้ | ได้ (AI อ่านหน้าเว็บแล้วเสนอคอลัมน์) |

| จัดการการแบ่งหน้า/ซับเพจ | ต้องเขียนสคริปต์เอง | อัตโนมัติ (AI ตรวจจับและสแครป) |

| การส่งออกข้อมูล | ทำเอง (parse + บันทึก) | ส่งออกตรงไป Excel, Google Sheets, Notion, Airtable |

| หน้าเว็บที่มี JavaScript/ป้องกัน | ไม่ได้ | ได้ (สแครปผ่านเบราว์เซอร์) |

| ไม่ต้องเขียนโค้ด | ไม่ (ต้องเขียนสคริปต์) | ใช่ (ใครก็ใช้ได้) |

| แพ็กเกจฟรี | ฟรีเสมอ | ฟรีสูงสุด 6 หน้า (10 หน้าด้วย trial boost) |

กับ Thunderbit คุณแค่เปิดส่วนขยาย คลิก “AI Suggest Fields” แล้วให้ AI ช่วยคิดว่าควรดึงข้อมูลอะไร คุณสามารถสแครปตาราง รายการ รายละเอียดสินค้า และให้ระบบเข้าไปเก็บข้อมูลจากซับเพจอัตโนมัติได้ จากนั้นส่งออกไปยังเครื่องมือทำงานที่คุณใช้ประจำ—ไม่ต้อง parse เอง ไม่ต้องปวดหัว

Thunderbit มีผู้ใช้มากกว่า และได้รับความนิยมมากในทีมขาย อีคอมเมิร์ซ และอสังหาฯ ที่ต้องการข้อมูลแบบมีโครงสร้างอย่างรวดเร็ว

อยากลองใช้งาน?

ใช้ cURL ร่วมกับ Thunderbit: กลยุทธ์เว็บสแครปที่ยืดหยุ่น

ถ้าคุณเป็นผู้ใช้สายเทคนิค ไม่จำเป็นต้องเลือกแค่อย่างใดอย่างหนึ่ง หลายทีมใช้ cURL และ Thunderbit คู่กันเพื่อความยืดหยุ่นสูงสุด:

- ทำต้นแบบด้วย cURL: ใช้ cURL ทดสอบ endpoint ตรวจเฮดเดอร์ และดูรูปแบบการตอบกลับของเว็บอย่างรวดเร็ว

- ขยายงานด้วย Thunderbit: เมื่ออยากได้ข้อมูลแบบมีโครงสร้าง สแครปหลายหน้า หรือทำเวิร์กโฟลว์ที่ทำซ้ำได้ ให้สลับมาใช้ Thunderbit เพื่อดึงข้อมูลแบบคลิก ๆ และส่งออกได้ทันที

ตัวอย่างเวิร์กโฟลว์สำหรับทำวิจัยตลาด:

- ใช้ cURL ดึงตัวอย่างไม่กี่หน้าและดูโครงสร้าง HTML

- ระบุฟิลด์ที่ต้องการ (เช่นชื่อสินค้า ราคา รีวิว)

- เปิด Thunderbit คลิก “AI Suggest Fields” ให้ AI ตั้งค่าสแครปเปอร์

- สแครปทุกหน้า (รวมซับเพจหรือหน้าที่แบ่งหน้า) แล้วส่งออกไป Google Sheets

- วิเคราะห์ แชร์ และนำไปใช้งานต่อ—ไม่ต้อง parse เอง

ตารางช่วยตัดสินใจแบบเร็ว:

| สถานการณ์ | ใช้ cURL | ใช้ Thunderbit | ใช้ทั้งคู่ |

|---|---|---|---|

| ดึง API หรือหน้า static แบบเร็ว ๆ | ✅ | ||

| ต้องการข้อมูลแบบมีโครงสร้างลงสเปรดชีต | ✅ | ||

| ดีบักเฮดเดอร์/คุกกี้ | ✅ | ||

| สแครปหน้าไดนามิก/มี JavaScript หนัก | ✅ | ||

| ทำเวิร์กโฟลว์แบบ no-code ที่ทำซ้ำได้ | ✅ | ||

| ทำต้นแบบก่อน แล้วค่อยสเกล | ✅ | ✅ | เวิร์กโฟลว์แบบไฮบริด |

ปัญหาที่พบบ่อยและหลุมพรางในการสแครปด้วย cURL

ก่อนจะลุยสแครปด้วย cURL แบบจัดเต็ม มาดูความท้าทายในโลกจริงที่คุณจะเจอ:

- ระบบกันบอท: หลายเว็บใช้การป้องกันขั้นสูง (JavaScript challenge, CAPTCHA, fingerprinting) ที่ cURL ข้ามไม่ได้ ()

- คุณภาพข้อมูล: โครงสร้าง HTML เปลี่ยน ฟิลด์หาย หรือเลย์เอาต์ไม่สม่ำเสมอ ทำให้สคริปต์พังได้

- ภาระการดูแลรักษา: เว็บเปลี่ยนเมื่อไหร่ คุณต้องแก้ logic การ parse เมื่อนั้น

- ความเสี่ยงด้านกฎหมาย/คอมพลายแอนซ์: ควรตรวจเงื่อนไขการใช้งาน robots.txt และกฎหมายที่เกี่ยวข้องก่อนสแครป ข้อมูลสาธารณะไม่ได้แปลว่าเอาไปใช้ได้เสมอ (, )

- ข้อจำกัดเมื่อสเกล: cURL เหมาะกับงานเล็ก ๆ แต่ถ้าทำขนาดใหญ่ต้องจัดการพร็อกซี rate limit และ error handling เอง

ทิปสำหรับแก้ปัญหาและทำให้ถูกต้องตามข้อกำหนด:

- เริ่มจากเว็บที่อนุญาตหรือเว็บเดโม (เช่น )

- เคารพ rate limit อย่ายิงถี่เกินไป

- หลีกเลี่ยงการสแครปข้อมูลส่วนบุคคลหากไม่มีฐานทางกฎหมาย

- ถ้าเจอด่าน JavaScript หรือ CAPTCHA ให้พิจารณาใช้เครื่องมือแบบเบราว์เซอร์ เช่น Thunderbit

สรุปแบบทีละขั้น: วิธีสแครปเว็บไซต์ด้วย cURL

เช็กลิสต์แบบอ้างอิงเร็วสำหรับ web-scraping-with-curl:

- กำหนด URL เป้าหมาย: เริ่มจากหน้า static หรือ API endpoint

- ดึงหน้าเว็บ:

curl URL - บันทึกผลลัพธ์ลงไฟล์:

curl -o file.html URL - ตรวจเฮดเดอร์/ดีบัก:

curl -I URL,curl -v URL - ส่งข้อมูลแบบ POST:

curl -d "a=1&b=2" URL - จัดการคุกกี้/เซสชัน:

curl -c cookies.txt ...,curl -b cookies.txt ... - ตั้งค่าเฮดเดอร์/User-Agent:

curl -A "..." -H "..." URL - ตามรีไดเรกต์:

curl -L URL - ใช้พร็อกซี (ถ้าจำเป็น):

curl -x proxy:port URL - ทำสแครปหลายหน้าอัตโนมัติ: ใช้ลูปหรือสคริปต์เชลล์

- แยกและจัดโครงสร้างข้อมูล: ใช้เครื่องมือ/สคริปต์เพิ่มเติมตามต้องการ

- สลับไปใช้ Thunderbit เมื่ออยากได้ข้อมูลแบบมีโครงสร้าง ไม่ต้องเขียนโค้ด หรือเจอหน้าไดนามิก

บทสรุป & ประเด็นสำคัญ: เลือกเครื่องมือเว็บสแครปให้เหมาะ

การทำ web-scraping-with-curl ยังเป็นสกิลที่ทรงพลังสำหรับผู้ใช้สายเทคนิคในปี 2026—โดยเฉพาะงานดึงข้อมูลเร็ว ๆ ทำต้นแบบ และงานอัตโนมัติ ความเร็ว ความยืดหยุ่นในการเขียนสคริปต์ และการมีอยู่แทบทุกที่ ทำให้ cURL เป็นเครื่องมือพื้นฐานในกล่องเครื่องมือของนักพัฒนา แต่เมื่อเว็บมีความไดนามิกและมีการป้องกันมากขึ้น และเมื่อผู้ใช้สายธุรกิจต้องการข้อมูลแบบมีโครงสร้างโดยไม่ต้องเขียนโค้ด เครื่องมืออย่าง ก็กำลังขยายขอบเขตสิ่งที่ทำได้

สรุปประเด็นสำคัญ:

- ใช้ cURL กับหน้า static, API และการทำต้นแบบแบบเร็ว ๆ โดยเฉพาะเมื่อคุณต้องการควบคุมทุกอย่างเอง

- สลับไปใช้ Thunderbit (หรือ AI web scraper อื่น ๆ) เมื่อคุณต้องการข้อมูลแบบมีโครงสร้าง ต้องสแครปหน้าไดนามิก/มี JavaScript หนัก หรืออยากได้เวิร์กโฟลว์แบบ no-code ที่เหมาะกับงานธุรกิจ

- ใช้ทั้งคู่เพื่อความยืดหยุ่นสูงสุด: ทำต้นแบบด้วย cURL แล้วค่อยสเกลและจัดโครงสร้างด้วย Thunderbit

- สแครปอย่างรับผิดชอบเสมอ—เคารพเงื่อนไขเว็บไซต์ rate limit และขอบเขตกฎหมาย

อยากเห็นว่าการสแครปเว็บทำได้ง่ายแค่ไหน? ลองใช้ แล้วสัมผัสการดึงข้อมูลด้วย AI ด้วยตัวเอง และถ้าอยากลงลึกกว่านี้ แวะไปที่ เพื่อดูบทเรียน ทิป และอินไซต์ในวงการเพิ่มเติม คุณอาจสนใจ:

ขอให้สแครปสนุก และขอให้ข้อมูลของคุณสะอาด เป็นระเบียบ และอยู่ใกล้แค่คำสั่ง (หรือคลิก) เดียว

คำถามที่พบบ่อย (FAQs)

1. cURL จัดการหน้าเว็บที่เรนเดอร์ด้วย JavaScript ได้ไหม?

ไม่ได้ cURL ไม่สามารถรัน JavaScript ได้ มันดึง HTML ดิบตามที่เซิร์ฟเวอร์ส่งมาเท่านั้น หากหน้าเว็บต้องใช้ JavaScript เพื่อเรนเดอร์คอนเทนต์หรือผ่านด่านกันบอท cURL จะเข้าถึงข้อมูลไม่ได้ กรณีนี้ให้ใช้เครื่องมือแบบเบราว์เซอร์ เช่น

2. จะบันทึกผลลัพธ์จาก cURL ลงไฟล์โดยตรงได้อย่างไร?

ใช้แฟลก -o เช่น curl -o filename.html URL ระบบจะเขียน response body ลงไฟล์แทนการแสดงในเทอร์มินัล

3. cURL ต่างจาก Thunderbit ในงานเว็บสแครปอย่างไร?

cURL คือเครื่องมือบรรทัดคำสั่งสำหรับดึงข้อมูลเว็บแบบดิบ เหมาะกับผู้ใช้สายเทคนิคและงานอัตโนมัติ ส่วน Thunderbit คือ Chrome Extension ที่ขับเคลื่อนด้วย AI ออกแบบมาสำหรับผู้ใช้สายธุรกิจที่ต้องการดึงข้อมูลแบบมีโครงสร้างจากเว็บไซต์ใดก็ได้ รองรับหน้าไดนามิก และส่งออกไปยังเครื่องมืออย่าง Excel หรือ Google Sheets ได้ทันที—ไม่ต้องเขียนโค้ด

4. การสแครปเว็บไซต์ด้วย cURL ถูกกฎหมายไหม?

โดยทั่วไป การสแครปข้อมูลสาธารณะในสหรัฐฯ มักถือว่าถูกกฎหมายตามคำตัดสินล่าสุด แต่คุณควรตรวจเงื่อนไขการใช้งานของเว็บไซต์ robots.txt และกฎหมายที่เกี่ยวข้องเสมอ หลีกเลี่ยงการสแครปข้อมูลส่วนบุคคลหรือข้อมูลที่มีการป้องกันโดยไม่ได้รับอนุญาต และเคารพ rate limit กับแนวทางจริยธรรม (, )

5. ควรเปลี่ยนจาก cURL ไปใช้เครื่องมือขั้นสูงอย่าง Thunderbit เมื่อไหร่?

ถ้าคุณต้องสแครปหน้าไดนามิก/มี JavaScript หนัก ต้องการข้อมูลแบบมีโครงสร้างลงสเปรดชีต หรืออยากได้เวิร์กโฟลว์แบบ no-code Thunderbit จะเหมาะกว่า ใช้ cURL กับงานเทคนิคที่ต้องการความเร็วและควบคุมได้เต็มที่ ส่วน Thunderbit เหมาะกับการดึงข้อมูลที่ทำซ้ำได้และใช้งานเชิงธุรกิจ

อยากได้ทิปและบทเรียนเว็บสแครปเพิ่มเติม เข้าไปที่ หรือดูที่