โลกของผู้ช่วย AI และเฟรมเวิร์กแบบเอเจนต์กำลังเดินหน้าเร็วมาก แต่มีอยู่เรื่องหนึ่งที่ไม่เคยเปลี่ยน: ทุกคนอยากให้มันเร็วขึ้น เบาขึ้น และติดตั้งง่ายขึ้น ผมเห็นเรื่องนี้กับตัวเองมาตลอด ไม่ว่าคุณจะเป็นนักพัฒนาเดี่ยวที่กำลังลองเล่นบน Raspberry Pi หรือเป็นหัวหน้าไอทีที่ต้องคุมงบคลาวด์ ความต้องการโซลูชันแบบ “ติดตั้งให้น้อยที่สุด” มีอยู่ทุกที่ ช่วงหลังมานี้ผมได้รับคำถามเกี่ยวกับทางเลือก OpenClaw แบบเบาเยอะมากจนแทบจะนับไม่ไหว หลายคนอยากรู้ว่า มีทางใช้พลังของ OpenClaw โดยไม่ต้องเจอกับการติดตั้งที่หนัก การกินหน่วยความจำสูง หรือปวดหัวกับการดูแลระบบไหม

ถ้าคุณกำลังมองหาทางเลือก OpenClaw แบบเบา หรือสนใจการติดตั้งที่ใช้ทรัพยากรน้อย คุณมาถูกที่แล้ว ในคู่มือนี้ ผมจะอธิบายว่า “OpenClaw minimal install” จริง ๆ แล้วหมายถึงอะไร ทำไมมันถึงสำคัญ และจะประเมินตัวเลือกแบบเบาที่เหมาะกับคุณได้อย่างไร ไม่ว่าคุณจะใช้งานบนฮาร์ดแวร์เก่า ติดตั้งในสเกลใหญ่ หรือแค่ไม่อยากให้เซิร์ฟเวอร์ของคุณกลายเป็น “ซุปดีพเพนเดนซี” อีกชาม

ทางเลือก OpenClaw แบบเบาคืออะไร?

เริ่มจากพื้นฐานกันก่อน: เราหมายถึงอะไรเมื่อพูดว่า “ทางเลือก OpenClaw แบบเบา”?

OpenClaw คือเกตเวย์และเลเยอร์ออร์เคสเตรชันแบบโฮสต์เองสำหรับผู้ช่วยเชิงเอเจนต์ พูดง่าย ๆ มันคือแพลตฟอร์มที่เชื่อมอินเทอร์เฟซแชต (เช่น เว็บ เดสก์ท็อป หรือแอปแชต) เข้ากับโมเดล AI และเครื่องมือต่าง ๆ พร้อมจัดการเรื่องหน่วยความจำ สถานะ และการรันอย่างปลอดภัย () แต่จุดสำคัญคือ การติดตั้ง OpenClaw แบบมาตรฐานอาศัย Docker มีหลายบริการ และแนะนำให้มี RAM ขั้นต่ำ 2GB แค่สำหรับเกตเวย์เท่านั้น — ยังไม่รวมตอนที่คุณเริ่มรันโมเดลภาษาขนาดใหญ่

ทางเลือกแบบเบา คือเครื่องมือ เฟรมเวิร์ก หรือแพลตฟอร์มใด ๆ ที่ให้ความสามารถคล้าย ๆ “ผู้ช่วย” หรือ “เอเจนต์” เหมือน OpenClaw แต่ใช้พื้นที่ติดตั้งน้อยกว่า กินหน่วยความจำ/CPU น้อยกว่า และตั้งค่าได้ง่ายกว่า ลองนึกถึงการใช้งานแบบคอนเทนเนอร์เดียว การพึ่งพาไลบรารีน้อย และสามารถรันบนฮาร์ดแวร์ระดับกลาง ๆ หรือสภาพแวดล้อมที่ทรัพยากรจำกัดได้

ความแตกต่างหลักระหว่างการติดตั้ง OpenClaw แบบปกติกับทางเลือกแบบเบาหรือแบบมินิมอล มักอยู่ที่:

- ความซับซ้อนของการติดตั้ง: ตัวเลือกแบบเบามักใช้ Docker คอนเทนเนอร์เดียว หรือแม้แต่ไฟล์ไบนารีง่าย ๆ ขณะที่การตั้งค่าเริ่มต้นของ OpenClaw อาจต้องใช้หลายคอนเทนเนอร์และ persistent volume

- การใช้ทรัพยากร: ทางเลือกแบบมินิมอลถูกออกแบบมาให้ใช้ RAM, CPU และพื้นที่ดิสก์น้อยกว่า บางครั้งทั้งสแตกใช้ RAM แค่ 1–2GB ก็พอ

- ขอบเขตฟีเจอร์: คุณอาจต้องแลกฟีเจอร์เกตเวย์ขั้นสูงหรือ sandboxing บางส่วน เพื่อแลกกับการติดตั้งที่เบาและดูแลง่ายกว่า

สรุปสั้น ๆ ทางเลือก OpenClaw แบบเบาคือการเอาฟังก์ชันหลัก — แชต AI การเชื่อมต่อเครื่องมือ และหน่วยความจำ — มาใช้งาน โดยไม่ต้องแบกภาระส่วนเกิน

ทำไมผู้ใช้ถึงมองหาโซลูชัน OpenClaw ที่ใช้ทรัพยากรน้อย

แล้วทำไมช่วงนี้ทุกคนถึงหมกมุ่นกับการติดตั้งแบบมินิมอลและเฟรมเวิร์กแบบเบา ๆ กันนัก? จากที่ผมคุยกับผู้ใช้และทีมไอที เหตุผลต่าง ๆ ค่อนข้างเหมือนกันทั่วโลก:

- ตั้งค่าและเริ่มใช้งานได้เร็วกว่า: ไม่มีใครอยากเสียเวลาหลายชั่วโมงกับการจัดการไฟล์ Docker Compose หรือแก้ปัญหาความขัดแย้งของ dependency การติดตั้งแบบมินิมอลหมายความว่าคุณจะพร้อมใช้งานในไม่กี่นาที ไม่ใช่หลายชั่วโมง

- ใช้ทรัพยากรน้อยลง: ไม่ว่าคุณจะติดตั้งบน cloud VM, Raspberry Pi หรือแล็ปท็อปเก่า ๆ ทุก GB ของ RAM และทุก cycle ของ CPU มีความหมาย การใช้พื้นที่น้อยลงช่วยให้รันได้หลายอินสแตนซ์ ประหยัดค่า cloud หรืออย่างน้อยก็ไม่หน่วง

- ดูแลง่ายกว่า: ชิ้นส่วนน้อยลงก็แปลว่าจุดพังน้อยลง ทางเลือกแบบเบามักอัปเดต สำรอง และรักษาความปลอดภัยได้ง่ายกว่า

- เหมาะกับ edge และออฟไลน์มากกว่า: ถ้าคุณต้องรันผู้ช่วยภายในองค์กร ในห้องแล็บ หรือในสภาพแวดล้อมที่ต้องคำนึงถึงความเป็นส่วนตัว การติดตั้งแบบมินิมอลช่วยได้มาก

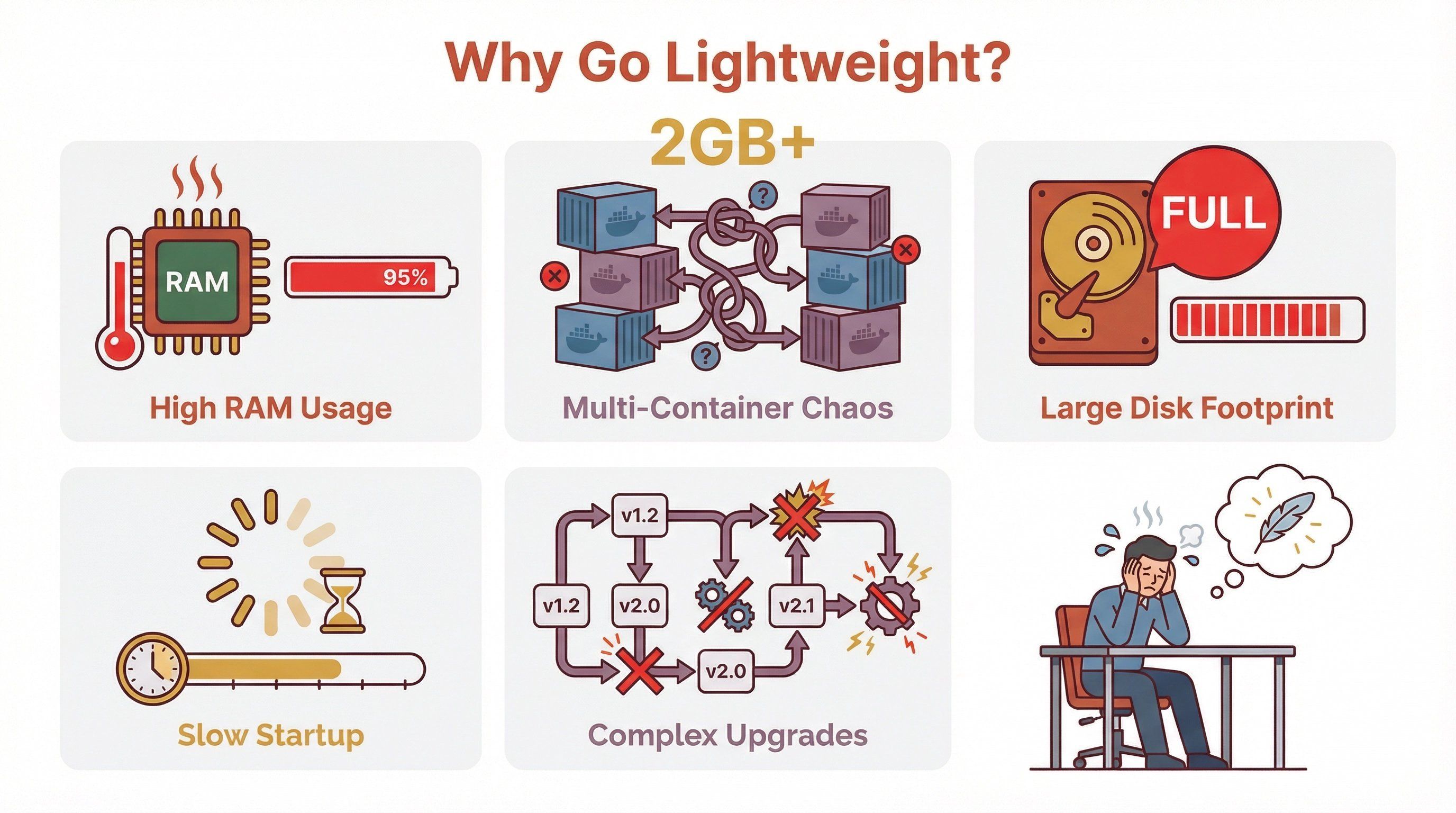

| ปัญหา | ทำไมถึงสำคัญ |

|---|---|

| ต้องการ RAM/CPU สูง | จำกัดการติดตั้งบนฮาร์ดแวร์เก่าหรือขนาดเล็ก |

| ตั้งค่าหลายคอนเทนเนอร์ | เพิ่มความซับซ้อน และต้องดูแล/รักษาความปลอดภัยมากขึ้น |

| ใช้พื้นที่ดิสก์มาก | มีปัญหากับอุปกรณ์ edge หรือพื้นที่จัดเก็บจำกัด |

| เริ่มทำงานช้า | น่าหงุดหงิดสำหรับการทดลองหรือการขยายระบบอย่างรวดเร็ว |

| อัปเกรดซับซ้อน | ยิ่งมีส่วนประกอบมาก ยิ่งปวดหัวตอนอัปเกรด |

ถ้าคุณเคยพยายามรัน OpenClaw บน cloud VM ที่มี RAM 2GB แล้วเห็นมันทำงานช้าเป็นเต่า คุณคงเข้าใจที่ผมหมายถึงดี

การติดตั้ง OpenClaw แบบมินิมอลส่งผลต่อประสิทธิภาพระบบอย่างไร

มาดูเชิงเทคนิคกันสักนิด ขนาดและความซับซ้อนของแพลตฟอร์มผู้ช่วยของคุณมีผลโดยตรงต่อประสิทธิภาพ เสถียรภาพ และความสามารถในการขยายระบบ

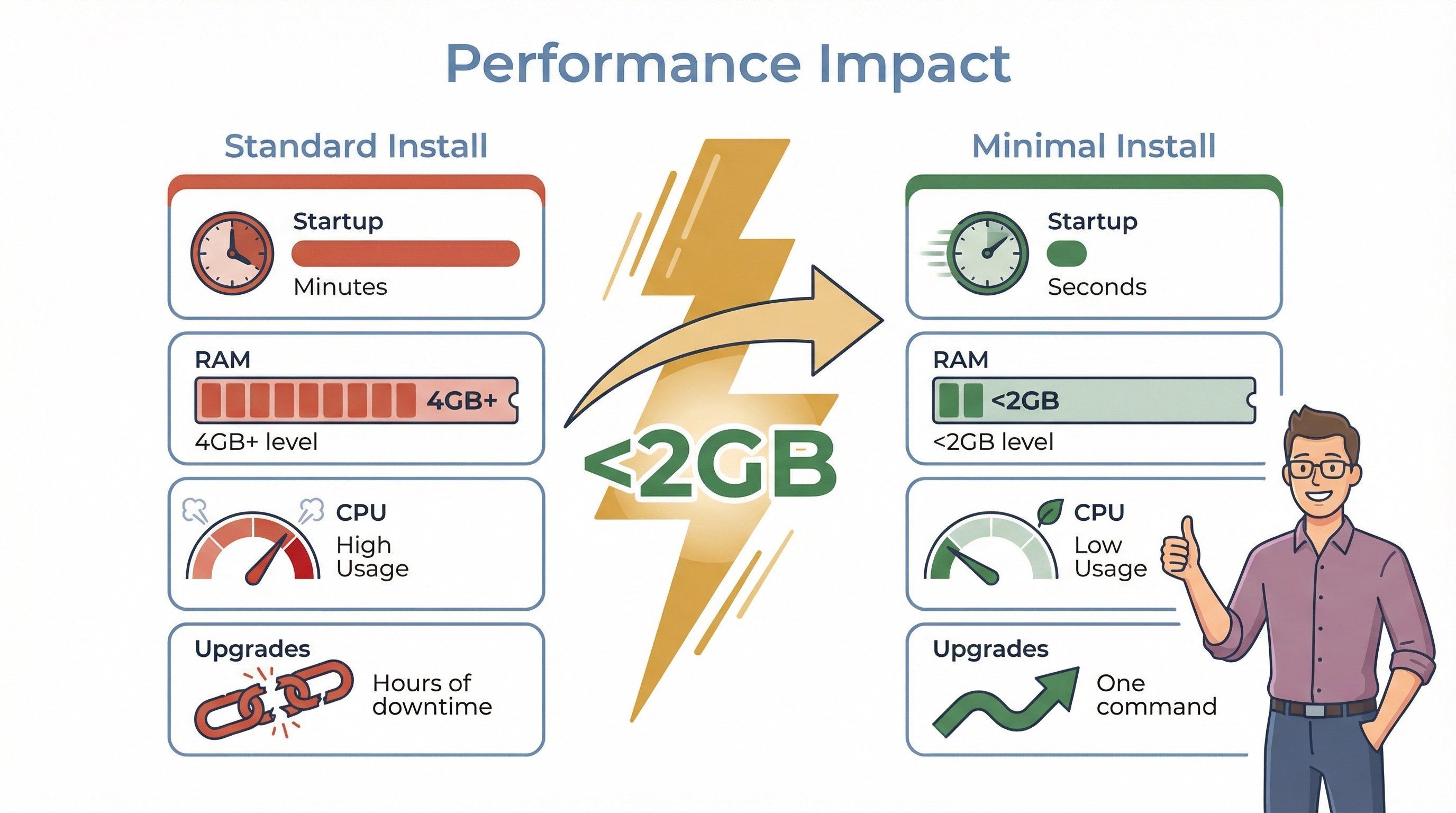

การติดตั้ง OpenClaw แบบมาตรฐาน (มี Docker, memory store และ sandboxing) สามารถใช้ RAM เกิน 2GB ได้สบาย ๆ แค่สำหรับแพลตฟอร์ม ก่อนที่คุณจะโหลดโมเดลภาษา หรือ vector database เสียอีก () ถ้าบวกกับการรัน LLM ภายในเครื่องหรือการนำเอกสารเข้าระบบ คุณอาจต้องใช้ 4GB, 8GB หรือมากกว่านั้น

ทางเลือกแบบมินิมอล ถูกออกแบบมาเพื่อ:

- เริ่มทำงานได้เร็วกว่า: การติดตั้งแบบคอนเทนเนอร์เดียวหรือไบนารีเดียวพร้อมใช้งานได้ในไม่กี่วินาที ไม่ใช่หลาย นาที

- ใช้หน่วยความจำน้อยกว่า: ถ้าโยนภาระการรัน LLM ไปยัง API ภายนอก หรือใช้โมเดลในเครื่องที่เล็กลง คุณจะคุมการใช้ RAM ให้ต่ำกว่า 2GB ได้ทั้งสแตก ()

- ลดภาระ CPU: ภาระจากการออร์เคสเตรชันที่น้อยลง หมายถึงทรัพยากรมากขึ้นสำหรับงาน AI จริง ๆ

- ลดความเสี่ยงของความขัดแย้ง: บริการน้อยลง = โอกาสชนพอร์ต dependency ไม่ตรงกัน หรือเจอปัญหาแปลก ๆ ตอนอัปเกรดน้อยลง

ตัวอย่างจากโลกจริง: แนะนำ RAM ขั้นต่ำ 2GB (แนะนำ 4GB) ขณะที่ แนะนำอย่างน้อย 4GB ส่วน สามารถรันในโหมดผู้ใช้คนเดียวด้วยคอนเทนเนอร์เดียวและใช้หน่วยความจำน้อยกว่ามาก โดยเฉพาะถ้าคุณใช้ LLM API จากระยะไกล

การปรับปรุงประสิทธิภาพที่คุณอาจเห็น:

- เวลาเริ่มต้นจากหลาย นาทีเหลือไม่กี่วินาที

- การใช้ RAM ลดลง 50% หรือมากกว่า

- การใช้ CPU ลดลงในช่วงที่ไม่มีงาน

- อัปเกรดเร็วขึ้น และ downtime น้อยลง

เกณฑ์สำคัญในการเลือกทางเลือก OpenClaw แบบเบา

ตัวเลือกที่เรียกว่า “เบา” ไม่ได้ดีเท่ากันทุกตัว นี่คือสิ่งที่ผมแนะนำให้ดูเมื่อต้องประเมินตัวเลือก:

- ขนาดการติดตั้ง: ดาวน์โหลดใหญ่แค่ไหน? ติดตั้งด้วย Docker คอนเทนเนอร์เดียวหรือไบนารีเดียวได้ไหม?

- การใช้หน่วยความจำ: แพลตฟอร์มใช้ RAM พื้นฐานเท่าไร (ยังไม่รวมการรัน LLM)?

- ความเร็วในการเริ่มต้น: จาก

docker runไปสู่ผู้ช่วยที่ใช้งานได้ ต้องใช้เวลานานแค่ไหน? - ความง่ายในการอัปเดต: ขั้นตอนอัปเกรดง่ายไหม หรือคุณต้องไล่แก้ dependency ทุกเดือน?

- ความเข้ากันได้: รองรับ LLM เครื่องมือ และอินทิเกรชันที่คุณต้องใช้หรือเปล่า?

- ชุดฟีเจอร์: ได้ฟีเจอร์หลักที่คุณต้องการจริง ๆ หรือกำลังยอมเสียของเยอะเกินไปเพื่อความมินิมอล?

- ความปลอดภัยและการแยกสภาพแวดล้อม: แพลตฟอร์มมี sandboxing หรือการแยกการรันเครื่องมือหรือไม่?

นี่คือเช็กลิสต์สั้น ๆ ที่ใช้ได้เลย:

| เกณฑ์ | ทำไมถึงสำคัญ | สิ่งที่ควรมองหา |

|---|---|---|

| ขนาดการติดตั้ง | ติดตั้งเร็ว ใช้พื้นที่น้อย | อิมเมจ <500MB, ไบนารีเดียว |

| การใช้หน่วยความจำ | รันบนฮาร์ดแวร์เล็กกว่าได้ ค่า cloud ต่ำลง | RAM พื้นฐาน <2GB |

| ความเร็วเริ่มต้น | ทดลองเร็ว Downtime น้อย | พร้อมใช้งานใน <30 วินาที |

| การอัปเดต | ดูแลง่าย เซอร์ไพรส์น้อย | อัปเกรดด้วยคำสั่งเดียว, API เสถียร |

| ความเข้ากันได้ | ไม่ล็อกกับผู้ขาย และต่อยอดได้ในอนาคต | OpenAI/Ollama API, โมเดลปลั๊กอิน |

| ฟีเจอร์ | ไม่เสียของจำเป็นเพื่อแลกกับความเบา | หน่วยความจำ, เครื่องมือ, ยืนยันตัวตน, RAG |

| ความปลอดภัย | รันเครื่องมือได้อย่างปลอดภัย ความเสี่ยงต่ำ | แยกระดับคอนเทนเนอร์หรือโปรเซส |

เคล็ดลับคือการหาจุดสมดุลระหว่าง footprint ที่เล็กกับฟีเจอร์ที่คุณต้องใช้จริง บางครั้ง “น้อยแต่มาก” ก็ใช่ แต่บางครั้ง “น้อย” ก็แปลว่า “ไม่พอ”

ทางเลือก OpenClaw แบบเบายอดนิยมสำหรับการติดตั้งแบบมินิมอล

จากสรุปวงการล่าสุดและการค้นคว้าของผมเอง นี่คือตัวเลือก OpenClaw แบบเบาที่น่าสนใจสำหรับสถานการณ์ต่าง ๆ:

1.

- เหมาะที่สุดสำหรับ: การติดตั้งสำหรับผู้ใช้คนเดียวที่ใช้ทรัพยากรน้อย

- ทำไมถึงเบา: คอนเทนเนอร์ Docker เดียว มีโหมดผู้ใช้คนเดียวแบบเลือกเปิดได้ และใช้ persistent volume สำหรับข้อมูล รวมถึงสามารถใช้ LLM API ระยะไกลเพื่อลดการใช้ RAM/CPU

- จุดเด่นเฉพาะ: ใช้งานออฟไลน์ได้ รองรับ Ollama และปลายทางที่เข้ากันได้กับ OpenAI มีคอมมูนิตี้ที่คึกคัก ()

- ข้อแลกเปลี่ยน: ไม่ได้จำลองโมเดลเกตเวย์/หลายหน้าใช้งานของ OpenClaw แบบตรงตัว การแยกเครื่องมือยังค่อนข้างพื้นฐาน

2.

- เหมาะที่สุดสำหรับ: ทีมหลายคนที่อยากได้ประสบการณ์คล้าย “โคลน ChatGPT”

- ทำไมถึงเบา: ติดตั้งด้วย Docker มีสเปกขั้นต่ำที่เผยแพร่ไว้ชัดเจน (RAM 2GB) และรันเป็นบริการเดียวได้สำหรับทีมเล็ก

- จุดเด่นเฉพาะ: ยืนยันตัวตนหลายผู้ใช้ที่ปลอดภัย รองรับผู้ให้บริการหลากหลาย และมีการเสริมความปลอดภัยล่าสุด ()

- ข้อแลกเปลี่ยน: เน้นเป็นเว็บแอปมากกว่า ไม่ใช่เกตเวย์สำหรับหลายหน้าจอแชต และบางฟีเจอร์ต้องมีบริการเสริม

3.

- เหมาะที่สุดสำหรับ: เวิร์กสเปซ AI แบบส่วนตัว ครบจบในตัว และตั้งค่าง่าย

- ทำไมถึงเบา: ติดตั้งได้ทั้งแบบ Docker หรือเดสก์ท็อป มี vector DB ในตัว และใช้งานพื้นฐานได้ด้วย RAM 2GB

- จุดเด่นเฉพาะ: รองรับหลายผู้ใช้ มีเอเจนต์ มีท่อประมวลผลเอกสาร และให้ความสำคัญกับความเป็นส่วนตัว ()

- ข้อแลกเปลี่ยน: ไม่ใช่เกตเวย์สำหรับหน้าต่างแชต และการแยกเครื่องมือขึ้นอยู่กับสถาปัตยกรรมของคุณ

4.

- เหมาะที่สุดสำหรับ: ถาม-ตอบเอกสารแบบส่วนตัว และแอปที่เข้าใจบริบท

- ทำไมถึงเบา: ใช้ Docker Compose profiles ได้ และสามารถรันด้วยทรัพยากรระดับกลางถ้าใช้ LLM API ภายนอก

- จุดเด่นเฉพาะ: เข้ากันได้กับ OpenAI API มีจุดยืนด้านความเป็นส่วนตัวที่แข็งแรง และมีตัวเลือก vector store ที่ยืดหยุ่น ()

- ข้อแลกเปลี่ยน: ไม่ใช่ตัวแทนแบบเสียบแทนทันทีสำหรับ messaging gateway ของ OpenClaw

5.

- เหมาะที่สุดสำหรับ: ตัวสร้างเวิร์กโฟลว์/เอเจนต์แบบภาพที่ติดตั้งง่าย

- ทำไมถึงเบา: ติดตั้งได้ด้วย NPM หรือ Docker ใช้ SQLite เป็นค่าเริ่มต้น และรันเป็นบริการเดียวได้

- จุดเด่นเฉพาะ: ผืนผ้าใบเวิร์กโฟลว์แบบภาพ ระบบปลั๊กอิน และทดสอบในเครื่องได้ง่าย ()

- ข้อแลกเปลี่ยน: ไม่ใช่ผู้ช่วยสำเร็จรูป คุณต้องสร้างคอนเนกเตอร์ของตัวเอง

เปรียบเทียบทางเลือก OpenClaw แบบใช้พื้นที่น้อย: ตารางฟีเจอร์

มาวางตัวเลือกเหล่านี้เทียบกันแบบเร็ว ๆ:

| แพลตฟอร์ม | เส้นทางติดตั้ง | RAM ขั้นต่ำ (ตัวแพลตฟอร์ม) | ความเร็วเริ่มต้น | หลายผู้ใช้ | รองรับแบ็กเอนด์ LLM | โมเดลเครื่องมือ/ปลั๊กอิน | ความปลอดภัย/การแยกสภาพแวดล้อม | เหมาะที่สุดสำหรับ |

|---|---|---|---|---|---|---|---|---|

| Open WebUI | Docker (คอนเทนเนอร์เดียว) | ต่ำ–กลาง | เร็ว | เลือกได้ | Ollama, เข้ากันได้กับ OpenAI | เครื่องมือ Python | พื้นฐาน | ผู้ใช้คนเดียว, ใช้ทรัพยากรน้อย |

| LibreChat | Docker (หลายบริการ) | ขั้นต่ำ 2GB (แนะนำ 4GB) | เร็ว | ใช่ | หลายผู้ให้บริการ | เอเจนต์, ปลั๊กอิน | หลายบริการ | ทีมงาน, เน้นแชต |

| AnythingLLM | Docker/เดสก์ท็อป | 2GB+ | เร็ว | ใช่ | ภายในเครื่อง + โฮสต์ | เอเจนต์, API | มี vector DB ในตัว | ส่วนตัว, ครบจบในตัว |

| PrivateGPT | Docker Compose | กลาง | เร็ว | เลือกได้ | ภายในเครื่อง + โฮสต์ | RAG API | แยก API | ถาม-ตอบเอกสารส่วนตัว |

| Flowise | NPM/Docker | ต่ำ–กลาง | เร็ว | เลือกได้ | โหนดของผู้ให้บริการ | ตัวสร้างแบบภาพ | SQLite/ฐานข้อมูล | ตัวสร้างเวิร์กโฟลว์แบบภาพ |

หมายเหตุ: การใช้ RAM อาจพุ่งขึ้นถ้าคุณรัน LLM ภายในเครื่องหรือดึงเอกสารขนาดใหญ่เข้าระบบ สำหรับการติดตั้งแบบมินิมอลจริง ๆ ควรใช้ LLM API ระยะไกลหรือโมเดลขนาดเล็ก

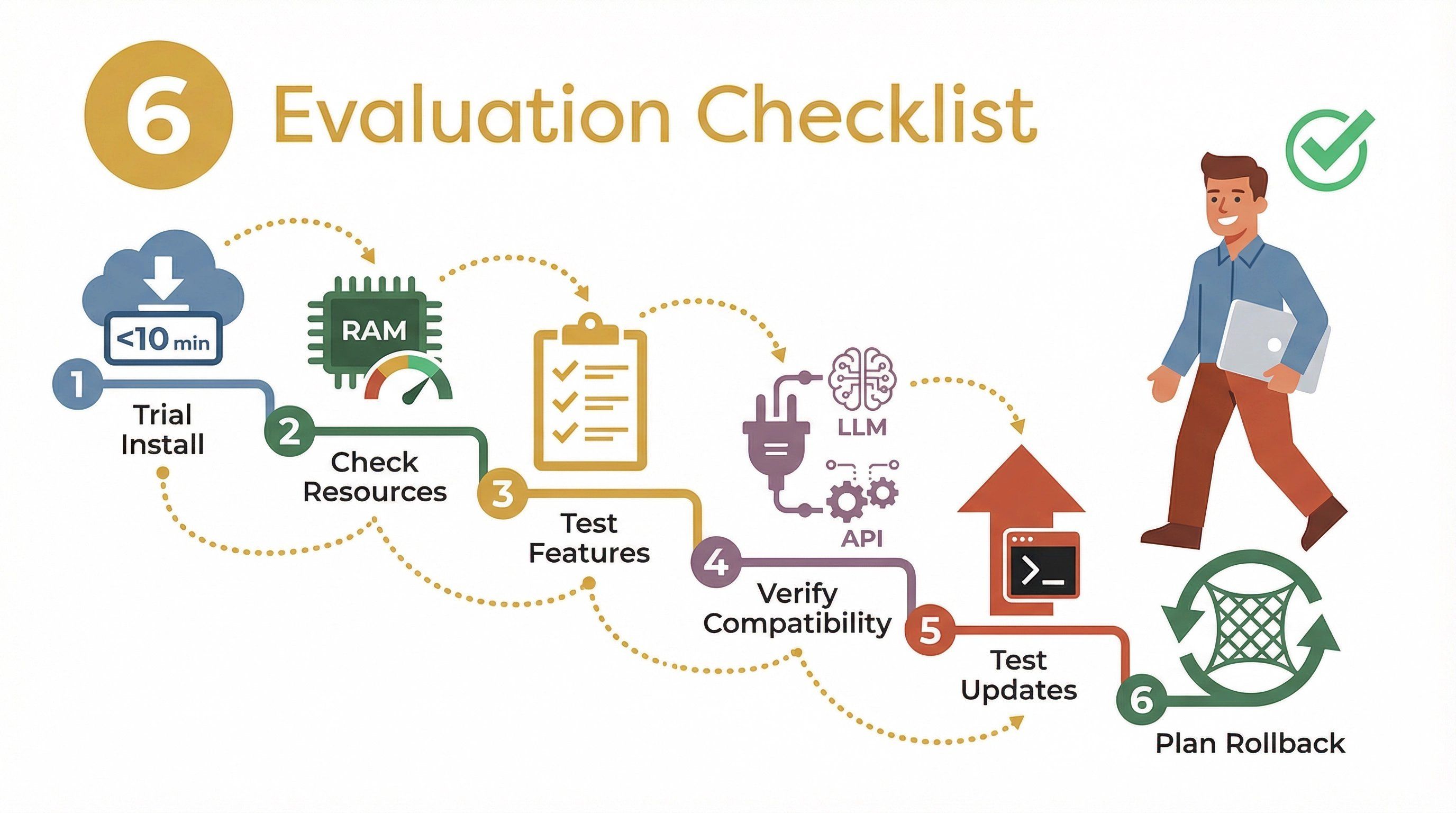

ขั้นตอนปฏิบัติในการประเมินและทดสอบโซลูชัน OpenClaw แบบติดตั้งน้อยที่สุด

พร้อมจะลองทางเลือกแบบเบาแล้วหรือยัง? นี่คือกรอบการประเมินง่าย ๆ ที่ผมใช้:

- ทดลองติดตั้ง: ติดตั้งแพลตฟอร์มใน sandbox หรือ test VM จับเวลาในช่วงติดตั้งและเริ่มต้นใช้งาน

- วัดการใช้ทรัพยากร: ใช้เครื่องมือระบบ เช่น

htopหรือdocker statsเพื่อติดตาม RAM และ CPU ระหว่าง idle และการใช้งานพื้นฐาน - รันเวิร์กโฟลว์พื้นฐาน: ทดสอบฟีเจอร์หลัก เช่น แชต การรันเครื่องมือ/ปลั๊กอิน การนำเอกสารเข้า ฯลฯ

- ตรวจสอบความเข้ากันได้: เชื่อมต่อกับ LLM ปลั๊กอิน หรือ API ภายนอกที่คุณต้องการ

- ทดสอบการอัปเดต: ลองอัปเกรดแพลตฟอร์มเพื่อดูว่ากระบวนการราบรื่นแค่ไหน

- ทดสอบในสภาพแวดล้อมแบบแยก: ถ้าเป็นไปได้ ให้รันในสภาพแวดล้อมที่ลบทิ้งได้ เพื่อจะย้อนกลับได้ง่ายหากมีปัญหา

นี่คือเช็กลิสต์สั้น ๆ:

| ขั้นตอน | สิ่งที่ควรมองหา |

|---|---|

| ติดตั้ง/เริ่มต้น | <10 นาที ไม่มี dependency ซับซ้อน |

| การใช้ทรัพยากร | RAM พื้นฐาน <2GB, CPU ต่ำตอน idle |

| ทดสอบฟีเจอร์ | ฟีเจอร์หลักของผู้ช่วยทำงานได้ตามคาด |

| ความเข้ากันได้ | เชื่อมต่อกับ LLM และเครื่องมือของคุณได้ |

| กระบวนการอัปเดต | อัปเกรดได้ด้วยคำสั่งเดียว หรืออัปเดตทับได้ |

| ย้อนกลับ | กลับไปเวอร์ชันก่อนหน้าได้ง่าย |

ข้อผิดพลาดที่พบบ่อยเมื่อต้องย้ายไปใช้ทางเลือก OpenClaw แบบเบา

การย้ายไปติดตั้งแบบมินิมอลไม่ได้ราบรื่นเสมอไป นี่คือข้อผิดพลาดที่เจอบ่อย — และวิธีหลีกเลี่ยง:

- ฟีเจอร์หายไป: แพลตฟอร์มแบบเบาบางตัวตัดฟีเจอร์เกตเวย์ขั้นสูงหรือ sandboxing ออกไป ตรวจให้ชัดว่าคุณไม่ได้เสียสิ่งสำคัญต่อเวิร์กโฟลว์

- เอกสารมีจำกัด: โปรเจ็กต์เล็ก ๆ อาจมีเอกสารน้อย เช็กฟอรั่มของคอมมูนิตี้หรือ issue ใน GitHub เพื่อขอความช่วยเหลือ

- อินทิเกรชันยาก: ไม่ใช่ปลั๊กอินหรือเครื่องมือทุกตัวจะรองรับทันที ทดสอบอินทิเกรชันที่ต้องใช้จริงตั้งแต่เนิ่น ๆ

- ข้อแลกเปลี่ยนด้านความปลอดภัย: การติดตั้งที่ง่ายขึ้นบางครั้งหมายถึงการแยกสภาพแวดล้อมน้อยลง หรือค่าเริ่มต้นด้านความปลอดภัยต่ำกว่า ควร harden การติดตั้งของคุณ (ยืนยันตัวตน, TLS, ไฟร์วอลล์)

- ปัญหาย้ายข้อมูล: การย้ายข้อมูล เช่น ประวัติแชตหรือเอกสาร จาก OpenClaw ไปยังแพลตฟอร์มใหม่อาจยุ่งยาก วางแผนช่วง migration และสำรองทุกอย่าง

คำแนะนำของผมคือ เริ่มจากโปรเจ็กต์นำร่อง ทดสอบให้รอบคอบ และให้ระบบเดิมยังทำงานต่อไปจนกว่าคุณจะมั่นใจกับระบบใหม่

สรุป: เลือกแบบที่ใช่สำหรับความต้องการติดตั้งแบบมินิมอลของคุณ

การเติบโตของทางเลือก OpenClaw แบบเบาเป็นการตอบสนองโดยตรงต่อปัญหาจริงที่เกิดจากการติดตั้งหนักและซับซ้อน ไม่ว่าคุณจะเป็นนักพัฒนาเดี่ยว ทีมเล็ก หรือหัวหน้าไอทีในองค์กร ก็มีตัวเลือกแบบมินิมอลที่ให้ฟีเจอร์ผู้ช่วยที่คุณต้องการได้ — โดยไม่ต้องแบกความอืดของระบบ

สิ่งที่ผมแนะนำคือ:

- กำหนดสิ่งที่ต้องมีให้ชัด: รู้ว่าฟีเจอร์ไหนที่คุณขาดไม่ได้ (หลายผู้ใช้, รองรับปลั๊กอิน, ความปลอดภัย)

- ใช้เกณฑ์และตารางเปรียบเทียบด้านบน เพื่อคัดตัวเลือกที่เหมาะที่สุด

- ทดลองและวัดผล: ทดสอบในสภาพแวดล้อมของคุณเอง วัดการใช้ทรัพยากร และตรวจความเข้ากันได้

- วางแผนการย้าย: อย่ารีบย้ายทั้งหมดในครั้งเดียว ค่อย ๆ ย้ายข้อมูลและเวิร์กโฟลว์ไปทีละส่วน

และอย่าลืมว่า “OpenClaw minimal install” ที่ดีที่สุด คือแบบที่เหมาะกับกรณีใช้งาน ฮาร์ดแวร์ และทักษะของทีมคุณเอง ความเบาไม่ได้แปลว่าจำกัดเสมอไป แค่ต้องโฟกัส

ถ้าคุณสนใจทำให้การดึงข้อมูลเว็บเป็นส่วนหนึ่งของเวิร์กโฟลว์ผู้ช่วยของคุณ ลองดู เว็บสแครปเปอร์ที่ขับเคลื่อนด้วย AI ของเรา ซึ่งออกแบบมาให้ตั้งค่าน้อยที่สุดแต่ได้ประสิทธิภาพสูงสุด และถ้าอยากอ่านเรื่องลึก ๆ เกี่ยวกับออโตเมชัน การสแครป และเครื่องมือ AI เพิ่มเติม แวะไปที่ ได้เลย

คำถามที่พบบ่อย

1. ทางเลือก OpenClaw แบบเบาคืออะไร?

ทางเลือก OpenClaw แบบเบาคือเครื่องมือหรือเฟรมเวิร์กที่ให้ความสามารถผู้ช่วย AI คล้าย OpenClaw แต่ใช้พื้นที่ติดตั้งน้อยกว่า ใช้ RAM/CPU น้อยกว่า และตั้งค่าง่ายกว่า เหมาะสำหรับสถานการณ์ติดตั้งแบบมินิมอลหรือสภาพแวดล้อมที่ทรัพยากรจำกัด

2. ทำไมฉันควรสนใจโซลูชัน OpenClaw ที่ใช้ทรัพยากรน้อย?

โซลูชันที่ใช้ทรัพยากรน้อยตั้งค่าได้เร็วกว่า ใช้ RAM/CPU น้อยกว่า ดูแลง่ายกว่า และสามารถรันบนฮาร์ดแวร์เก่าหรือใน edge/offline environment ได้ จึงเหมาะมากสำหรับการทดลองเร็วหรือการติดตั้งที่อ่อนไหวต่อค่าใช้จ่าย

3. ข้อแลกเปลี่ยนหลักของทางเลือกแบบเบาคืออะไร?

คุณอาจเสียฟีเจอร์ขั้นสูงบางอย่างไป เช่น เกตเวย์หลายหน้าใช้งานหรือการรันเครื่องมือแบบ sandbox และอาจต้องเพิ่มองค์ประกอบเสริมเพื่อให้เทียบเท่า OpenClaw แบบเต็ม ๆ ควรตรวจเสมอว่าฟีเจอร์ที่ต้องมีรองรับอยู่หรือไม่

4. จะประเมินได้อย่างไรว่าทางเลือกแบบเบาเหมาะกับฉันหรือไม่?

ทดสอบกระบวนการติดตั้ง วัดการใช้ทรัพยากร รันเวิร์กโฟลว์หลัก ตรวจความเข้ากันได้กับ LLM/เครื่องมือที่คุณใช้ และยืนยันว่าแพลตฟอร์มนั้นตอบโจทย์ด้านความปลอดภัยและการอัปเดตของคุณ

5. ทางเลือก OpenClaw แบบเบายอดนิยมมีอะไรบ้าง?

ตัวเลือกที่เด่น ๆ ได้แก่ , , , และ แต่ละตัวมีจุดแข็งต่างกันไปตามความต้องการติดตั้งแบบมินิมอล

ถ้าคุณพร้อมจะลดความหนักของสแตกและคืน RAM ให้ระบบ ลองเลือกหนึ่งในโซลูชันติดตั้งแบบมินิมอลเหล่านี้ดู และถ้าคุณอยากทำให้การดึงข้อมูลเว็บเป็นอัตโนมัติแบบไม่ต้องปวดหัวเรื่องการตั้งค่า ก็พร้อมช่วยเสมอ

อ่านเพิ่มเติม