พูดตรง ๆ เลยนะ: ตอนที่ฉันลองดึงทุก URL จากเว็บไซต์ขนาดใหญ่ครั้งแรก ฉันคิดว่า “มันจะยากสักแค่ไหนกัน?” ผ่านไปไม่กี่ชั่วโมง ฉันยังคงคลิกไล่ทีละหน้า คัดลอกลิงก์มาวางในสเปรดชีต และเริ่มตั้งคำถามกับการตัดสินใจในชีวิตตัวเองอยู่เลย ถ้าคุณเคยพยายามจะหาเพจทั้งหมดในเว็บไซต์—ไม่ว่าจะเพื่อทำคอนเทนต์ออดิท สร้างรายชื่อลีด หรือทำรีเสิร์ชคู่แข่ง—คุณคงรู้ดีว่ามันเหนื่อยแค่ไหน งานนี้ทั้งน่าเบื่อ เสี่ยงพลาดสูง และพูดกันตามตรงคือเสียทั้งเวลาและพลังไปเปล่า ๆ

แต่ข่าวดีก็คือ ตอนนี้คุณไม่จำเป็นต้องทำแบบเดิมที่แสนลำบากอีกแล้ว เครื่องมือที่ขับเคลื่อนด้วย AI อย่าง กำลังเปลี่ยนเกมสำหรับผู้ใช้สายธุรกิจ ทำให้การหา URL ทั้งหมดบนโดเมนทำได้ในไม่กี่นาที ไม่ใช่หลายวัน ที่จริงแล้ว บริษัทที่ใช้เครื่องมือเว็บสแครปปิงด้วย AI รายงานว่าสามารถประหยัดเวลาในการเก็บข้อมูลได้ และบางแห่งยังใช้เวลาน้อยลงถึง เมื่อเทียบกับวิธีทำมือ นี่ไม่ใช่แค่ตัวเลขสวย ๆ แต่มันคือเวลาหลายชั่วโมงหรือหลายวันที่คุณได้คืนกลับมา

งั้นมาเจาะลึกกันว่าทำไมการหาเพจทั้งหมดในเว็บไซต์ถึงยากนัก ทำไมโมเดล AI ทั่วไปอย่าง GPT หรือ Claude ถึงช่วยได้ไม่สุด และทำไมเอเจนต์ AI เฉพาะทางอย่าง Thunderbit จึงทำให้งานนี้ง่ายขึ้นมาก และใช่ ฉันจะพาคุณไปทีละขั้นตอนแบบชัด ๆ เพื่อดึงทุก URL ที่ต้องการ แม้ว่าคุณจะไม่ใช่สายโค้ดก็ตาม

ทำไมการหา URL ทั้งหมดบนโดเมนถึงยากขนาดนี้

เอาตรง ๆ เว็บไซต์ไม่ได้ถูกออกแบบมาเพื่อยื่นลิสต์ทุกหน้าให้คุณแบบเป็นระเบียบ มันสร้างมาเพื่อผู้เข้าชม ไม่ใช่เพื่อคนที่อยากหาเพจทั้งหมดในเว็บไซต์ในคราวเดียว นี่คือเหตุผลว่าทำไมงานนี้ถึงชวนปวดหัว:

- คัดลอก-วางแบบใช้แรงล้วน ๆ: ต้องคลิกทุกเมนู ทุกลิสต์ และทุกไดเรกทอรี คัดลอก URL ทีละอัน ซึ่งเสี่ยงทั้งอาการปวดข้อมือและพลาดไปครึ่งเว็บ

- เพจแบ่งหน้าและเลื่อนแบบไม่มีที่สิ้นสุด: หลายเว็บแยกคอนเทนต์ออกเป็นหลายหน้า หรือโหลดผลลัพธ์เพิ่มเมื่อคุณเลื่อนลงไป ถ้าพลาดปุ่ม “ถัดไป” หรือเลื่อนไม่สุด ก็อาจพลาดทั้งส่วนของข้อมูลไปเลย

- โครงสร้างหน้าไม่สม่ำเสมอ: บางหน้าวางลิงก์ในรูปแบบหนึ่ง แต่อีกหน้ากลับใช้เลย์เอาต์คนละแบบ การตามให้ครบทุกหน้าจึงวุ่นวายมาก

- เพจที่ซ่อนอยู่หรือเพจเดี่ยว ๆ ที่ไม่มีลิงก์: ไม่ใช่ทุกหน้าจะเชื่อมจากเมนูหลัก บางหน้าถูกซ่อนไว้ลึก ๆ และเข้าถึงได้แค่ผ่าน sitemap หรือการค้นหาภายใน

- ความผิดพลาดของมนุษย์: ยิ่งต้องคัดลอกหลายหน้า โอกาสพลาดก็ยิ่งสูง ทั้ง URL ซ้ำ พิมพ์ผิด หรือข้ามบางหน้าไปเฉย ๆ

แล้วถ้าเว็บนั้นมีเป็นร้อยหรือเป็นพันหน้า? ลืมวิธีทำมือไปได้เลย การดึงข้อมูลด้วยมือมันสเกลไม่ไหว อย่างที่ทีมข้อมูลทีมหนึ่งบอกไว้ว่า ถ้าเกินเคสเล็ก ๆ ทั่วไปไปแล้ว

แล้ว “หาเพจทั้งหมดในเว็บไซต์” หมายถึงอะไร

ก่อนจะไปดูวิธีแก้ มาทำความเข้าใจกันก่อนว่าเรากำลังตามหาอะไรกันแน่

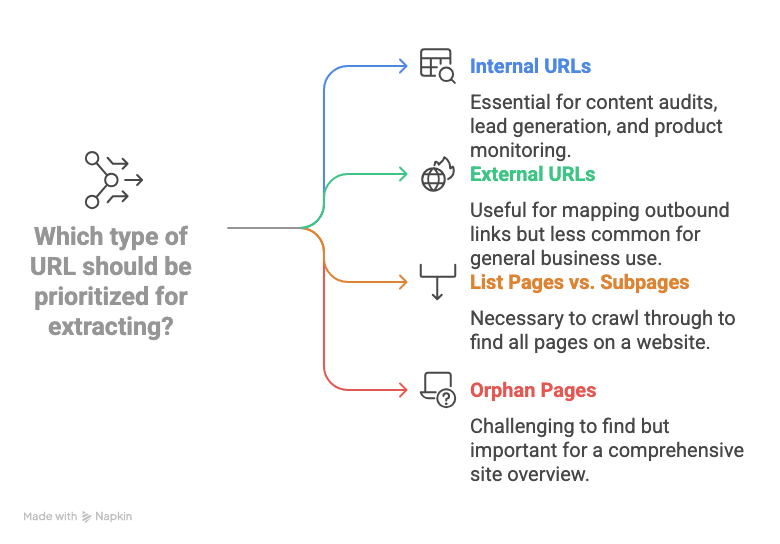

- URL ภายใน: คือ ลิงก์ที่ชี้ไปยังหน้าบนโดเมนเดียวกัน เช่น /about-us หรือ /products/widget-123 สำหรับการใช้งานธุรกิจส่วนใหญ่—คอนเทนต์ออดิท การหาลีด หรือการติดตามสินค้า—URL ภายในคือเป้าหมายหลัก

- URL ภายนอก: คือ ลิงก์ที่พาไปเว็บอื่น โดยทั่วไปคุณไม่จำเป็นต้องใช้ เว้นแต่คุณกำลังทำแผนผังลิงก์ขาออก

- หน้ารวมลิสต์กับหน้าย่อย: หลายเว็บมีหน้า “ฮับ” หรือ “ลิสต์” เช่น หน้าหมวดหมู่ บล็อกอาร์ไคฟ์ หรือไดเรกทอรี ที่ลิงก์ไปยังหน้าเนื้อหาเชิงลึก เช่น หน้าสินค้าหรือหน้าโปรไฟล์ หากต้องการหาเพจทั้งหมดในเว็บไซต์จริง ๆ คุณต้องไล่เข้าไปตามลิสต์เหล่านี้และดึงทุกหน้าย่อยที่มันเชื่อมไว้

- เพจเดี่ยวที่ไม่มีลิงก์เชื่อม: คือหน้าที่ไม่ได้ลิงก์จากจุดที่มองเห็นได้ชัด บางครั้งดึงเจอได้จาก sitemap หรือการค้นหาภายใน แต่ก็พลาดง่ายมาก

ดังนั้น เวลาเราพูดถึงการหา URL ทั้งหมดบนโดเมน เราหมายถึงการเก็บทุก URL ของหน้าภายใน ตั้งแต่หน้าแรกไปจนถึงหน้าสินค้าหรือบทความที่ลึกที่สุด ในรูปแบบที่ใช้งานต่อได้ เช่น สเปรดชีต

วิธีดั้งเดิมในการหา URL ทั้งหมดบนโดเมน

มีหลายวิธีแบบเก่า ๆ ที่พอใช้รับมือได้ แต่แต่ละวิธีก็มาพร้อมปัญหาของตัวเอง:

คัดลอก-วางด้วยมือและใช้เครื่องมือในเบราว์เซอร์

นี่คือวิธีแบบ “ลุยตรง ๆ”: คลิกทุกลิงก์ คัดลอกทุก URL วางลงในสเปรดชีต แล้วภาวนาอย่าให้พลาดอะไรไป บางคนใช้ส่วนขยายเบราว์เซอร์เพื่อดึงลิงก์ทั้งหมดจากหน้าปัจจุบัน แต่คุณก็ยังต้องทำซ้ำสำหรับทุกหน้า และยังต้องรับมือกับเพจแบ่งหน้าหรือส่วนที่ซ่อนอยู่เอง วิธีนี้พอไหวกับเว็บ 5 หน้า แต่ไม่ค่อยเหมาะกับอะไรที่ใหญ่กว่านั้น

ใช้การค้นหาในไซต์และ sitemap

- การค้นหา site: ของ Google: พิมพ์ site:yourdomain.com ลงใน Google แล้วคุณจะเห็นหน้าที่ถูกจัดทำดัชนีจำนวนหนึ่ง แต่ Google แสดงเฉพาะสิ่งที่มันอินเด็กซ์ไว้ ซึ่งมักจำกัดอยู่ราว 1,000 ผลลัพธ์เท่านั้น ทำให้คุณพลาดหน้าที่ใหม่ หน้าที่ซ่อนอยู่ หรือหน้าคุณภาพต่ำ ก็ยอมรับว่านี่ไม่ใช่คำตอบที่ครบถ้วน

- XML Sitemap: หลายเว็บมี /sitemap.xml ที่รวม URL สำคัญไว้ ยอดเยี่ยม—ถ้า sitemap อัปเดตล่าสุดและมีครบทุกหน้า แต่ไม่ใช่ทุกเว็บจะมี และบางเว็บก็แยก sitemap ออกเป็นหลายไฟล์ เพจเดี่ยวที่ไม่มีใครลิงก์ถึงก็มักไม่ถูกใส่ไว้

ครอว์เลอร์และสคริปต์สายเทคนิค

- เครื่องมือ SEO เช่น Screaming Frog: เครื่องมือพวกนี้ไล่เก็บทั้งเว็บเหมือนเสิร์ชเอนจิน แล้วแสดงรายการ URL ออกมา มันทรงพลัง แต่ต้องตั้งค่า คอนฟิก และบางครั้งต้องซื้อไลเซนส์สำหรับเว็บใหญ่ ๆ ด้วย

- สคริปต์ Python เช่น Scrapy: นักพัฒนาสามารถเขียนสคริปต์เพื่อครอว์ลและดึง URL ได้ แต่พูดตรง ๆ ถ้าคุณไม่ถนัดโค้ด วิธีนี้แทบเริ่มไม่ไหว แถมสคริปต์ยังพังได้เมื่อเลย์เอาต์ของเว็บเปลี่ยน ทำให้ต้องคอยตามแก้ตลอด

สรุปสั้น ๆ: วิธีดั้งเดิมมักจะไม่ก็ทำมือเกินไป ไม่ก็ไม่ครบ หรือไม่ก็เทคนิคเกินไปสำหรับผู้ใช้สายธุรกิจส่วนใหญ่ ไม่แปลกที่หลายคนจะยอมแพ้กลางคัน

ทำไมโมเดล AI ทั่วไปถึงยังอัตโนมัติการดึง URL ได้ไม่ครบ

คุณอาจกำลังคิดว่า “งั้นให้ ChatGPT หรือ Claude หาเพจทั้งหมดในเว็บไซต์ให้เลยไม่ได้เหรอ?” ฉันก็อยากให้มันง่ายแบบนั้นนะ แต่ความจริงคือ:

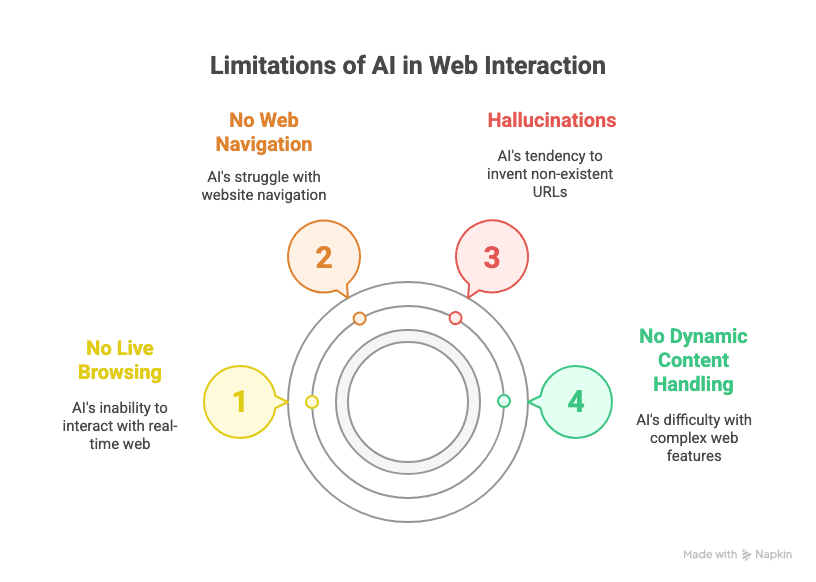

- ไม่มีการท่องเว็บแบบเรียลไทม์: โมเดล AI ทั่วไปอย่าง GPT หรือ Claude ไม่สามารถท่องเว็บจริง ๆ แบบสด ๆ ได้ พวกมันไม่ได้ “เห็น” สถานะปัจจุบันของเว็บไซต์ แต่ทำงานจากข้อมูลที่ใช้ฝึก หรือจากสิ่งที่คุณวางให้

- ไม่มีการนำทางบนเว็บ: แม้จะมีปลั๊กอินหรือเปิดโหมดท่องเว็บแล้ว LLM ก็ยังไม่รู้ว่าจะคลิก “ถัดไป” อย่างไร รับมือกับ infinite scroll อย่างไร หรือไล่ลิงก์ทุกอันบนเว็บอย่างเป็นระบบได้อย่างไร

- ฮัลลูซิเนชัน: ถ้าคุณขอให้ AI ทั่วไปหา URL ทั้งหมดบนโดเมน มันมักจะสร้างลิงก์ที่ฟังดูน่าเชื่อถือขึ้นมาเอง แต่จริง ๆ ไม่มีอยู่จริง (ฉันเคยเห็นมันแต่ง /about-us ให้เว็บที่ไม่เคยมีหน้านั้นเลย)

- จัดการคอนเทนต์ไดนามิกไม่ได้: เว็บที่โหลดคอนเทนต์ด้วย JavaScript ต้องล็อกอิน หรือมีการนำทางซับซ้อน มักเกินขอบเขตของ LLM ทั่วไป

อย่างที่ บอกไว้ว่า “ถ้าคุณต้องการสแครปเป็นร้อยหรือเป็นพันหน้า… ChatGPT อย่างเดียวไม่พอ” คุณต้องใช้เครื่องมือที่สร้างมาเพื่อภารกิจนี้โดยเฉพาะ

เอเจนต์ AI แบบเฉพาะทางคืออนาคต และทำไมเรื่องนี้จึงสำคัญ

ตรงนี้แหละที่ประสบการณ์ของฉันในสาย SaaS และระบบอัตโนมัติเข้ามาเกี่ยวข้อง: เอเจนต์ AI แบบเฉพาะทาง—เครื่องมือ AI ที่สร้างมาสำหรับโดเมนใดโดเมนหนึ่ง เช่น การดึงข้อมูลเว็บ—คือทางเดียวที่จะได้ผลลัพธ์ที่เชื่อถือได้และขยายสเกลได้สำหรับงานธุรกิจ ทำไมถึงเป็นแบบนั้น?

- LLM แบบใช้งานทั่วไปเหมาะกับงานเขียนหรือการค้นหา แต่มีแนวโน้มจะ “ฮัลลูซิเนต” และรับมือเวิร์กโฟลว์หลายขั้นตอนที่ต้องทำซ้ำได้ไม่ดีพอสำหรับความเสถียรที่ธุรกิจต้องการ

- เครื่องมือ SaaS ระดับองค์กรต้องทำงานอัตโนมัติในงานที่ซ้ำ ๆ และมีโครงสร้างจำนวนมาก ซึ่งเป็นจุดที่เอเจนต์ AI แบบเฉพาะทางโดดเด่น—มันถูกสร้างมาเพื่อทำอย่างเดียว และทำให้ดี โดยมีข้อผิดพลาดน้อยที่สุด

- มีตัวอย่างชัดเจนในหลายอุตสาหกรรม: Thunderbit สำหรับการดึงข้อมูลเว็บ, Devin AI สำหรับพัฒนาซอฟต์แวร์, Alta สำหรับอัตโนมัติฝ่ายขาย, IL VISTA ของ Infinity Learn สำหรับการศึกษา, Rippling สำหรับงาน HR, Harvey สำหรับงานกฎหมาย… รายการยังต่อได้อีกยาว

สรุปง่าย ๆ: ถ้าคุณอยากหาเพจทั้งหมดในเว็บไซต์อย่างแม่นยำ คุณต้องใช้เอเจนต์ AI แบบเฉพาะทางที่สร้างมาสำหรับงานนี้—not แชตบอทอเนกประสงค์

รู้จัก Thunderbit: การดึง URL ด้วย AI สำหรับทุกคน

นี่คือจุดที่ เข้ามาช่วย ในฐานะส่วนขยาย Chrome สำหรับ AI web scraper, Thunderbit ถูกออกแบบมาสำหรับผู้ใช้สายธุรกิจ—ไม่ต้องเขียนโค้ด ไม่ต้องตั้งค่าทางเทคนิค แค่ได้ผลลัพธ์ นี่คือสิ่งที่ทำให้มันต่าง:

- อินเทอร์เฟซภาษาธรรมชาติ: แค่บอกว่าต้องการอะไร (“ลิสต์ URL ของทุกหน้าในเว็บนี้”) แล้ว AI ของ Thunderbit จะหาวิธีดึงข้อมูลให้

- AI Suggest Fields: Thunderbit จะสแกนหน้าและแนะนำชื่อคอลัมน์ให้อัตโนมัติ (เช่น “Page URL”)—ไม่ต้องยุ่งกับ CSS selector หรือ XPath

- รองรับการแบ่งหน้าและการเลื่อนแบบไม่มีที่สิ้นสุด: Thunderbit สามารถคลิก “ถัดไป” หรือเลื่อนลงให้อัตโนมัติ เพื่อไม่ให้พลาดหน้าไหนไป

- นำทางไปยังหน้าย่อย: ถ้าต้องการเจาะลึก Thunderbit ก็สามารถตามลิงก์ไปยังหน้าย่อยและดึงข้อมูลจากตรงนั้นได้เช่นกัน

- ส่งออกแบบมีโครงสร้าง: ส่งออกผลลัพธ์ไปยัง Google Sheets, Excel, Notion, Airtable หรือ CSV ได้โดยตรง ฟรีและคลิกเดียว

- ไม่ต้องเขียนโค้ด: ถ้าคุณเข้าเว็บเป็น คุณก็ใช้ Thunderbit ได้ ง่ายแค่นั้น

และเพราะ Thunderbit เป็นเอเจนต์ AI แบบเฉพาะทาง มันจึงถูกสร้างมาเพื่อความเสถียรและทำซ้ำได้ เหมาะมากสำหรับผู้ใช้ธุรกิจที่ต้องการทำงานเดิมซ้ำ ๆ โดยอัตโนมัติ

ทีละขั้นตอน: วิธีหา URL ทั้งหมดบนโดเมนด้วย Thunderbit

พร้อมดูวิธีทำแล้วใช่ไหม? นี่คือวิธีแบบไม่ต้องเป็นสายเทคนิคเพื่อดึงทุก URL ที่คุณต้องการ

1. ติดตั้งส่วนขยาย Chrome ของ Thunderbit

เริ่มจากขั้นแรก: ใช้ได้กับ Chrome, Edge, Brave และเบราว์เซอร์ที่ใช้ Chromium อื่น ๆ ปักหมุดไว้ที่แถบเครื่องมือเพื่อเรียกใช้ง่าย ๆ

2. เปิดหน้าลิสต์หรือไดเรกทอรีเป้าหมายของคุณ

ไปยังเว็บไซต์ที่คุณต้องการดึง URL จาก อาจเป็นหน้าแรก, sitemap, ไดเรกทอรี หรือหน้าใดก็ตามที่เป็นลิสต์และลิงก์ไปยังหน้าที่คุณสนใจ

3. เปิด Thunderbit และตั้งค่าฟิลด์ของคุณ

คลิกไอคอน Thunderbit เพื่อเปิดส่วนขยาย เริ่มต้นด้วยเทมเพลตสแครปเปอร์ใหม่ ตรงนี้แหละคือจุดที่เวทมนตร์เกิดขึ้น:

- คลิก “AI Suggest Fields” AI ของ Thunderbit จะสแกนหน้าและแนะนำคอลัมน์—มองหาชื่อที่เป็น “Page URL”, “Link” หรืออะไรที่คล้ายกัน

- ถ้าคุณไม่เห็นฟิลด์ที่ต้องการตรง ๆ ก็แค่เพิ่มคอลัมน์ชื่อ “Page URL” (หรือชื่อที่เหมาะกับงานของคุณ) AI ของ Thunderbit ถูกฝึกมาให้เข้าใจคำเหล่านี้และจะจับคู่กับข้อมูลที่ถูกต้องให้

4. เปิดการแบ่งหน้าหรือการเลื่อนอัตโนมัติ (ถ้าจำเป็น)

ถ้าหน้าเป้าหมายของคุณมีหลายหน้า (เช่น “หน้า 1, 2, 3…” หรือปุ่ม “โหลดเพิ่ม”) ให้เปิด pagination ใน Thunderbit:

- สลับเป็นโหมด “Click Pagination” สำหรับเว็บที่มีปุ่ม “ถัดไป” หรือโหมด “Infinite Scroll” สำหรับเว็บที่โหลดข้อมูลเพิ่มเมื่อคุณเลื่อน

- Thunderbit จะให้คุณเลือกปุ่ม “ถัดไป” หรือบริเวณที่ต้องเลื่อน—แค่คลิก แล้ว AI จะจัดการที่เหลือให้

5. เริ่มสแครปและตรวจผลลัพธ์

กดปุ่ม “Scrape” Thunderbit จะไล่ครอว์ลทุกหน้าและเก็บทุก URL ที่พบ คุณจะเห็นผลลัพธ์แสดงเป็นตารางภายในส่วนขยายเลย สำหรับเว็บใหญ่ ๆ อาจใช้เวลาสักสองสามนาที แต่ก็ยังเร็วกว่าใช้มือทำมาก

6. ส่งออกรายการ URL ของคุณ

เมื่อสแครปเสร็จแล้ว คลิก Export คุณสามารถส่งข้อมูลตรงไปยัง:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

การส่งออกฟรีและคงรูปแบบทั้งหมดไว้ ไม่ต้องปวดหัวกับการคัดลอก-วางอีกต่อไป

เปรียบเทียบ Thunderbit กับโซลูชันดึง URL แบบอื่น

| วิธีการ | ใช้งานง่ายแค่ไหน | ความแม่นยำและความครอบคลุม | ขยายสเกลได้แค่ไหน | ตัวเลือกการส่งออก |

|---|---|---|---|---|

| คัดลอก-วางด้วยมือ | ทรมาน | ต่ำ (พลาดง่าย) | ไม่มี | ทำมือ (Excel ฯลฯ) |

| เครื่องมือดึงลิงก์ในเบราว์เซอร์ | โอเคสำหรับ 1 หน้า | ปานกลาง | แย่ | ทำมือ |

การค้นหา Google site: | ง่าย | ปานกลาง (ไม่ครบ) | จำกัดราว 1,000 ผลลัพธ์ | ทำมือ |

| XML Sitemap | ง่าย (ถ้ามี) | ดี (ถ้าอัปเดตล่าสุด) | ดี | ทำมือ/สคริปต์ |

| เครื่องมือ SEO (เช่น Screaming Frog) | ต้องใช้เทคนิค | สูง | สูง (แบบเสียเงิน) | CSV, Excel |

| สคริปต์ Python (Scrapy ฯลฯ) | ต้องใช้เทคนิคมาก | สูง | สูง | ปรับแต่งเอง |

| Thunderbit | ง่ายมาก | สูงมาก | สูง | Google Sheets, CSV ฯลฯ |

Thunderbit มอบ ความแม่นยำและสเกลระดับครอว์เลอร์มืออาชีพ พร้อม ความง่ายเหมือนใช้ส่วนขยายเบราว์เซอร์ ไม่ต้องเขียนโค้ด ไม่ต้องตั้งค่า แค่ได้ผลลัพธ์

โบนัส: ดึงได้มากกว่าแค่ URL ด้วย Thunderbit

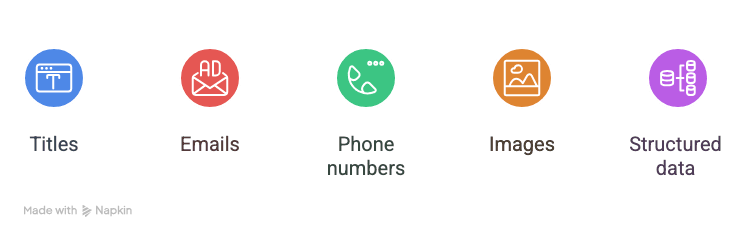

และนี่คือส่วนที่น่าสนใจจริง ๆ Thunderbit ไม่ได้มีไว้แค่ดึง URL—you can extract:

- ชื่อเรื่อง

- อีเมล

- เบอร์โทรศัพท์

- รูปภาพ

- ข้อมูลแบบมีโครงสร้างใด ๆ บนหน้า

ตัวอย่างเช่น ถ้าคุณกำลังสร้างรายชื่อลีด คุณสามารถให้ Thunderbit ดึง URL โปรไฟล์ ชื่อ อีเมล และเบอร์โทรศัพท์จากแต่ละรายการในไดเรกทอรีได้ในรอบเดียว ถ้าคุณกำลังออดิทสินค้า คุณก็สามารถดึง URL สินค้า ชื่อ ราคา และสถานะสต็อกได้ Thunderbit ยังรองรับ ด้วย ดังนั้นมันสามารถคลิกเข้าไปในแต่ละลิงก์และดึงรายละเอียดจากตรงนั้นได้

และใช่เลย ตัวดึงอีเมลและเบอร์โทรศัพท์ของ Thunderbit ใช้ได้ฟรีทั้งหมด ซึ่งเป็นเรื่องใหญ่มากสำหรับทีมขายและการตลาด

ข้อสรุปสำคัญ: วิธีหาเพจทั้งหมดในเว็บไซต์ด้วย AI

สรุปกันอีกที:

- การดึง URL ทั้งหมดจากโดเมนนั้นยากมากถ้าใช้วิธีทำมือหรือใช้เครื่องมือทั่วไป

- โมเดล AI ทั่วไปอย่าง GPT ไม่สามารถรับมือกับการนำทางเว็บ การแบ่งหน้า หรือคอนเทนต์ไดนามิกได้ครบ

- เอเจนต์ AI แบบเฉพาะทางอย่าง Thunderbit ถูกสร้างมาเพื่อการดึงข้อมูลเว็บโดยตรง—เสถียร ทำซ้ำได้ และใช้งานง่ายสำหรับผู้ใช้ธุรกิจ

- Thunderbit ทำให้เรื่องนี้ง่ายมาก: ติดตั้งส่วนขยาย ใช้ AI ช่วยแนะนำฟิลด์ เปิดการแบ่งหน้า สแครป แล้วส่งออก ไม่ต้องเขียนโค้ด ไม่ต้องวุ่นวาย

- คุณดึงได้มากกว่าแค่ URL: ทั้งชื่อเรื่อง อีเมล เบอร์โทรศัพท์ และอื่น ๆ อีกมากมาย—เหมาะกับการหาลีด การออดิท หรือการรีเสิร์ช

ถ้าคุณเบื่อกับการคัดลอกลิงก์ทีละอันหรือสู้กับครอว์เลอร์สายเทคนิคอยู่ มีแพ็กเกจฟรีให้เริ่มต้น คุณจะได้เห็นด้วยตัวเองว่ามันช่วยประหยัดเวลาและลดความปวดหัวได้แค่ไหน

และถ้าคุณอยากรู้ว่า Thunderbit ช่วยเรื่องอื่นได้อีกอย่างไร—เช่น , หรือ —ลองดู เพื่ออ่านคู่มือและทิปเพิ่มเติม

พร้อมจะเอาเวลาของคุณคืนจากการเก็บข้อมูลด้วยมือแล้วหรือยัง? อนาคตของการดึงข้อมูลเว็บคือเอเจนต์ AI แบบเฉพาะทาง—and Thunderbit กำลังเป็นผู้นำทาง ลองใช้ดู แล้วให้โปรเจกต์ออดิท รายชื่อลีด หรือการรีเสิร์ชครั้งถัดไปของคุณเป็นงานที่ง่ายที่สุดเท่าที่เคยทำมา

อ่านเพิ่มเติม

ป.ล. ถ้าวันหนึ่งคุณเกิดอยากคัดลอก URL 1,000 อันด้วยมือขึ้นมา ให้จำไว้ว่า ตอนนี้มี AI สำหรับเรื่องนี้แล้ว ข้อมือของคุณ—and เจ้านายของคุณ—จะขอบคุณแน่นอน