CRM ของคุณจะเทพได้แค่ไหน สุดท้ายก็ขึ้นอยู่กับ “ข้อมูล” ที่คุณป้อนเข้าไป—and ข้อมูลที่โคตรดีส่วนใหญ่มักซ่อนอยู่บนเว็บสาธารณะ ไม่ได้อยู่ในฐานข้อมูลบุคคลที่สามราคาแรงๆ

เครื่องมือ web extractor ช่วยเปลี่ยนข้อมูลบนเว็บที่กระจัดกระจายให้กลายเป็นสเปรดชีตที่เป็นระเบียบ เครื่องมือที่ดีทำได้ในไม่กี่นาที แถมไม่ต้องเขียนโค้ดให้ปวดหัว

ฉันใช้เครื่องมือพวกนี้กับงานจริงมาหลายแบบ—ตั้งแต่ทำลิสต์ลีด ติดตามราคาคู่แข่ง ไปจนถึงดึงแคตตาล็อกสินค้า เลยคัดมาให้ 12 ตัวที่ “เอาอยู่จริง” และจัดอันดับตามความสามารถในการทำงานธุรกิจแบบใช้งานได้ในชีวิตจริง

ทำไม Web Extractor ถึงเป็นของจำเป็นสำหรับธุรกิจ

พูดกันแบบไม่อ้อมค้อม: เว็บคือฐานข้อมูลที่ใหญ่ที่สุดในโลก (และก็รกที่สุดด้วย) และในปี 2026 บริษัทที่เปลี่ยนความรกนั้นให้เป็นอินไซต์ได้ จะเป็นฝ่ายวิ่งนำ จากสถิติด้านการวิเคราะห์ล่าสุด บริษัทที่ขับเคลื่อนด้วยข้อมูลมี ประสิทธิภาพสูงกว่า 5% และทำกำไรได้มากกว่า 6% เมื่อเทียบกับคู่แข่ง นี่ไม่ใช่ตัวเลขจิ๋วๆ แต่มันคือความได้เปรียบแบบจับต้องได้จริง ()

เครื่องมือ web extractor (บางทีก็เรียก web page extractor หรือโซลูชันสำหรับ web extracting) คือ “ซอสลับ” ที่ช่วยให้ทีมขาย การดึงข้อมูลจากเว็บ จากไดเรกทอรีสาธารณะ โซเชียลมีเดีย และเว็บไซต์บริษัท เพื่อสร้างรายชื่อผู้มุ่งหวังแบบเจาะจง—ไม่ต้องไปซื้อชีตลีดที่ล้าสมัย หรือภาวนาให้เด็กฝึกงานไม่ลาออกกลางทางตอนก็อปปี้-วาง () ฝั่งการตลาดและอีคอมเมิร์ซก็ใช้ web extractor เพื่อ ติดตามราคาคู่แข่ง เฝ้าดูสต็อก และเทียบสินค้าแบบเรียลไทม์—อย่าง John Lewis ยังบอกเลยว่า web scraping ช่วยให้ยอดขายเพิ่มขึ้น 4% จากการตั้งราคาที่ฉลาดขึ้น ()

แต่เรื่องมันไม่ได้มีแค่ตัวเลข Web extractor ยัง ประหยัดเวลาแบบมหาศาล (มีผู้ใช้รายหนึ่งบอกว่าประหยัดได้ “หลายร้อยชั่วโมง” จากการทำให้การเก็บข้อมูลเป็นอัตโนมัติ) และลดความผิดพลาดจากคน () ทีมปฏิบัติการสามารถตั้งสคริปต์ให้เก็บข้อมูลต่อเนื่อง งานที่เคยให้เด็กฝึกงานทำเป็นสัปดาห์ก็ทำได้อัตโนมัติ—คืนเวลาที่เคยเสียไปกับการก็อปปี้-วางซ้ำๆ () และพอมี extractor ที่ขับเคลื่อนด้วย AI แม้แต่คนที่ไม่ใช่สายเทคนิคก็สามารถ แปลงเว็บไซต์ให้เป็นข้อมูลแบบมีโครงสร้าง เพื่อเอาไปวิเคราะห์ต่อได้ ()

สรุปสั้นๆ: ถ้าปี 2026 แล้วยังไม่ใช้ web extractor คุณอาจกำลังปล่อยอินไซต์ (และเงิน) หล่นหายไปบนโต๊ะเฉยๆ

เราเลือก 12 Web Extractor อันดับต้นๆ อย่างไร

เครื่องมือสำหรับ web extracting มีเยอะมาก แล้วจะเลือกตัวที่ใช่ยังไง? ฉันลองมาหลายสิบตัว แต่มีแค่ 12 ตัวที่ผ่านเกณฑ์สำหรับลิสต์นี้ โดยดูจาก:

- ใช้งานง่าย: คนไม่เขียนโค้ดเริ่มได้เร็วไหม? ฉันให้ความสำคัญกับเครื่องมือแบบ no-code/low-code ที่หน้าตาเข้าใจง่าย ().

- ความสามารถด้าน AI: เครื่องมือยุคใหม่ที่ใช้ AI ช่วยให้การดึงข้อมูลง่ายขึ้น เช่น ตรวจจับฟิลด์อัตโนมัติ จัดการการนำทางเว็บ หรือให้พิมพ์ความต้องการเป็นภาษาอังกฤษธรรมดาได้ ().

- อัตโนมัติและตั้งเวลา: ตัวที่ดีควรทำงานแบบออโต้ไพลอต รองรับการตั้งเวลารันซ้ำหรือเฝ้าดูเว็บเป็นระยะ ().

- ส่งออกและเชื่อมต่อระบบ: ส่งออกไป Excel, Google Sheets, Airtable หรือ Notion ได้ง่ายไหม? ถ้ามีอินทิเกรชันกับเวิร์กโฟลว์ยิ่งดี ().

- สเกลและความเสถียร: ดึงข้อมูลหน้าเดียวหรือเป็นพันหน้าได้ไหม และเชื่อถือได้แค่ไหน (ดูรีวิวผู้ใช้ประกอบ)

- เหมาะกับงานธุรกิจ: เน้นเครื่องมือที่ทีมขาย การตลาด อีคอมเมิร์ซ และปฏิบัติการนิยมใช้ ไม่ใช่เฉพาะสายเดฟ

บางตัวเป็นหน้าใหม่สาย AI บางตัวเป็นคลาสสิกของวงการ แต่ทั้งหมดถูกออกแบบมาเพื่อช่วยให้คุณ เปลี่ยนเว็บให้เป็นฐานข้อมูลธุรกิจของตัวเอง—แบบไม่ปวดหัว

เปรียบเทียบเร็วๆ: เครื่องมือ Web Extractor แบบภาพรวม

นี่คือภาพรวมของ 12 เครื่องมือ web extractor ที่จะพูดถึง เพื่อให้เห็นว่าแต่ละตัวเด่นด้านไหน:

| Tool | AI Automation | Ease of Use | Best Use Case |

|---|---|---|---|

| Thunderbit | มี – AI แนะนำฟิลด์และจัดการหน้าให้อัตโนมัติ | ง่ายมาก (ส่วนขยาย Chrome, ไม่ต้องเขียนโค้ด) | ดึงข้อมูลลีด ราคา ฯลฯ ได้เร็ว เหมาะกับคนไม่สายเทคนิคที่อยากได้ผลในไม่กี่นาที |

| Octoparse | จำกัด (เน้นเทมเพลต, ไม่ใช่ AI) | ง่ายสำหรับคนส่วนใหญ่ (ลาก-วางแบบภาพ) | เวิร์กโฟลว์ดึงข้อมูลแบบปรับแต่งได้ (ล็อกอิน, เปลี่ยนหน้า) สำหรับนักวิเคราะห์ที่อยากคุมขั้นตอนโดยไม่เขียนโค้ด |

| Browse AI | บางส่วน – สร้าง “หุ่นยนต์” แบบชี้แล้วคลิก | ง่าย (no-code, ทำงานบนคลาวด์) | เฝ้าดูข้อมูลอัตโนมัติ (ราคา รายการ ฯลฯ) ตามตาราง พร้อมแจ้งเตือนและอินทิเกรชัน |

| WebScraper.io | ไม่มี (ตั้งค่าด้วยมือ) | ปานกลาง (ส่วนขยายเบราว์เซอร์ ตั้งค่า sitemap) | ดึงข้อมูลเว็บหลายชั้นแบบภาพ เหมาะกับคนที่ยอมตั้งค่าขั้นตอนเอง |

| ScraperAPI | N/A (บริการ API จัดการพร็อกซีผ่าน API) | ต้องเขียนโค้ด (เชื่อมต่อ API) | ดึงข้อมูลปริมาณมากสำหรับทีมเทคนิค—จัดการพร็อกซีและ CAPTCHA สำหรับงานสเกลใหญ่ |

| Data Miner | ไม่มี | ง่ายมาก (ส่วนขยายเบราว์เซอร์ มีเทมเพลตคลิกเดียว) | ดึงข้อมูลแบบครั้งคราวจากหน้าเว็บ (โดยเฉพาะตาราง/ลิสต์) ออกเป็น CSV/Excel ได้ทันที |

| Simplescraper | ไม่มี (มีบางฟีเจอร์ช่วยด้วย AI) | ง่าย (สร้างสูตรแบบชี้แล้วคลิก) | ดึงข้อมูลแบบ no-code พร้อมอินทิเกรชัน—เหมาะกับการส่งข้อมูลไป Google Sheets, Airtable หรือ API |

| Instant Data Scraper | มี – ตรวจจับตารางข้อมูลอัตโนมัติ | ง่ายมาก (คลิกแล้วได้เลย ไม่ต้องตั้งค่า) | ดึงข้อมูลตาราง/ลิสต์แบบทันทีและฟรี เหมาะกับงานด่วน/เก็บข้อมูลเร็ว |

| ScrapeStorm | มี – AI ระบุองค์ประกอบบนหน้าเว็บ | ง่าย (อินเทอร์เฟซแบบภาพ; แอปหลายแพลตฟอร์ม) | งานดึงข้อมูลขนาดใหญ่หรือซับซ้อนโดยไม่เขียนโค้ด รวมถึงตั้งเวลาคลานข้อมูล |

| Apify | มีบางส่วน – มี “actor” สำเร็จรูป | ปานกลาง (เว็บอินเทอร์เฟซ; จะเขียนโค้ดก็ได้) | ดึงข้อมูลบนคลาวด์แบบสเกลได้และทำออโตเมชัน ผ่านสคริปต์สำเร็จรูปหรือทำเอง |

| ParseHub | ไม่มี (ไม่ต้องเขียนสคริปต์แต่ตั้งค่าด้วยมือ) | ง่ายสำหรับงานพื้นฐาน (ตัวแก้ไขแบบภาพ; แอปเดสก์ท็อป) | ดึงข้อมูลเว็บไดนามิก/ซับซ้อน (AJAX) ผ่านอินเทอร์เฟซแบบ no-code |

| OutWit Hub | ไม่มี | ง่าย (แอปเดสก์ท็อปแบบ GUI) | ดึงข้อมูลแบบง่ายๆ ออฟไลน์ และเก็บถาวรคอนเทนต์สำหรับโปรเจกต์ขนาดเล็ก |

เครื่องมือส่วนใหญ่มีแพ็กเกจฟรีหรือทดลองใช้ และมีราคาแบบขั้นบันได ที่นี่จะโฟกัสความสามารถและกรณีใช้งานมากกว่าราคา.

Thunderbit: Web Extractor พลัง AI ที่ใครๆ ก็ใช้ได้

เริ่มกันที่ Thunderbit—ใช่ ฉันมีส่วนร่วมกับตัวนี้ แต่ขอปูพื้นก่อนว่าโลกของ web extracting กำลังเปลี่ยนจาก “ตั้งค่า scraper เอง” ไปเป็น “บอก AI ว่าอยากได้อะไร” Thunderbit คือหนึ่งในเครื่องมือแรกๆ ที่ฉันเห็น (และช่วยสร้าง) ที่ให้ฟีลเหมือน ผู้ช่วยข้อมูลด้วย AI มากกว่าจะเป็นแค่ “crawler” อีกตัว

ใช้ คุณไม่ต้องไปยุ่งกับ XPath, CSS selector หรือ regex แค่บอกสิ่งที่ต้องการเป็นภาษาอังกฤษธรรมดา เช่น “ดึงหัวข้อ ผู้เขียน และวันที่จากหน้านี้” แล้ว AI จะจัดการให้ทั้งหมด () กด “AI Suggest Fields” แล้ว Thunderbit จะอ่านหน้าเว็บ แนะนำคอลัมน์ให้ และยังจัดการ subpage กับ pagination ให้อัตโนมัติด้วย ()

และมันไม่ได้จบแค่ “ดึงข้อมูล” Thunderbit ยัง ทำความสะอาด แปลงรูปแบบ จัดหมวดหมู่ และแม้แต่แปลฟิลด์ระหว่างดึงข้อมูลได้ อยากทำให้เบอร์โทรเป็นมาตรฐาน สรุปคำอธิบาย หรือแปลชื่อสินค้า? ใส่คำสั่งสั้นๆ แล้ว AI จัดให้ จากนั้นส่งออกไป Excel, Google Sheets, Airtable หรือ Notion ได้ทันที ()

สิ่งที่ทำให้ Thunderbit ต่างจริงๆ คือ แทบไม่ต้องตั้งค่า และแทบไม่ต้องเรียนรู้ เพราะเป็นส่วนขยาย Chrome เปิดใช้ได้ในไม่กี่วินาที ไม่ต้องลงปลั๊กอินเพิ่ม ไม่ต้องคอนฟิก ไม่ต้องศัพท์เทคนิค เลยกลายเป็นตัวโปรดของ ทีมขาย การตลาด และปฏิบัติการที่ต้องการผลลัพธ์ไว () แพ็กเกจฟรีให้ลองเวิร์กโฟลว์ได้ครบ และแพ็กเกจจ่ายก็ราคาเป็นมิตร (ประมาณ “ถูกกว่าค่ากาแฟรายเดือน” สำหรับหลายทีม)

ถ้าอยากลองประสบการณ์ web extracting แบบ AI แนะนำให้ไป แล้วลองเล่นดู วันแห่งการก็อปปี้-วางของคุณอาจได้ปิดฉากตรงนี้

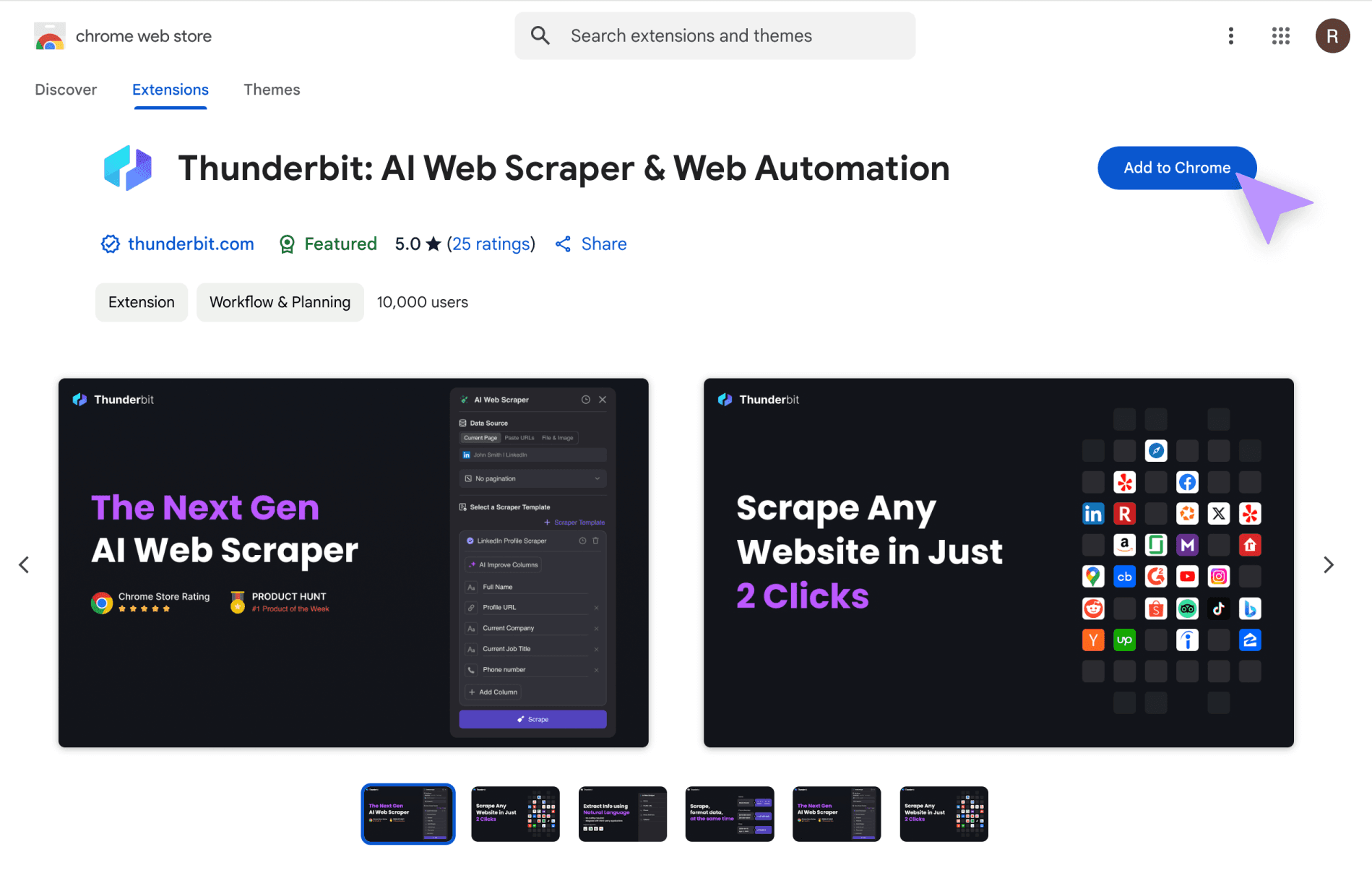

Octoparse: Web Extractor แบบภาพสำหรับเวิร์กโฟลว์ที่ปรับแต่งได้

Octoparse คือรุ่นคลาสสิกของสาย visual web scraping เป็นแอปเดสก์ท็อปที่มี อินเทอร์เฟซแบบชี้แล้วคลิก—คุณโต้ตอบกับหน้าเว็บ เลือกข้อมูลที่ต้องการ แล้ว Octoparse จะสร้างเวิร์กโฟลว์ให้เบื้องหลัง () รองรับล็อกอิน ตั้งค่า pagination และทำออโตเมชันการส่งฟอร์มได้ โดยไม่ต้องเขียนโค้ด

จุดแข็งของ Octoparse คือ คลังเทมเพลตสำเร็จรูปกว่า 500 แบบ สำหรับเว็บยอดนิยม (Amazon, Twitter, LinkedIn ฯลฯ) หลายครั้งแค่โหลดเทมเพลตก็เริ่มดึงข้อมูลได้เลย () ถ้าเว็บซับซ้อนก็สลับไปโหมด manual แล้วตั้งค่าทีละขั้นแบบภาพ รองรับคอนเทนต์ที่โหลดหลังคลิก/เลื่อน และทำงานร่วมกับพร็อกซี/แก้ CAPTCHA ได้ มีตัวเลือกคลาวด์สำหรับตั้งเวลาและรันงานสเกลใหญ่ด้วย

ข้อแลกเปลี่ยนคือมีช่วงเรียนรู้ โดยเฉพาะงานขั้นสูง แต่สำหรับคนไม่เขียนโปรแกรมและนักวิเคราะห์ข้อมูลที่อยากได้ เวิร์กโฟลว์แบบปรับแต่งได้โดยไม่ต้องโค้ด Octoparse เป็นตัวเลือกที่ไว้ใจได้ ()

Browse AI: ดึงข้อมูลอัตโนมัติด้วยหุ่นยนต์สำเร็จรูป

Browse AI มาในแนวสนุกๆ: คุณ ฝึก “หุ่นยนต์” ด้วยการชี้แล้วคลิกข้อมูลที่ต้องการ แล้วมันจะเรียนรู้เพื่อดึงข้อมูลจากหน้าที่คล้ายกัน () ทำงานบนคลาวด์และเป็น no-code ไม่ต้องดูแลสคริปต์หรือเซิร์ฟเวอร์

สิ่งที่ทำให้ Browse AI เด่นคือ การทำอัตโนมัติและการมอนิเตอร์ คุณตั้งเวลาให้หุ่นยนต์รันเป็นประจำ และรับแจ้งเตือนเมื่อข้อมูลเปลี่ยน (เช่น คู่แข่งลดราคา หรือมีประกาศงานใหม่) อีกทั้งมีคลังหุ่นยนต์สำเร็จรูปสำหรับงานยอดนิยม เริ่มจากของพร้อมใช้แล้วค่อยปรับก็ได้ ()

Browse AI เชื่อมต่อกับแอปจำนวนมากผ่าน Zapier และ Make และส่งออกไป Google Sheets หรือผ่าน API/webhooks ได้ () เหมาะมากสำหรับ การเฝ้าดูข้อมูลต่อเนื่องและการเก็บข้อมูลซ้ำตามรอบ โดยเฉพาะถ้าต้องการแจ้งเตือนและอินทิเกรชันแบบไม่ต้องเฝ้า

WebScraper.io: Web Page Extractor บนเบราว์เซอร์

WebScraper.io (หลายคนเรียกสั้นๆ ว่า “Web Scraper”) เป็น ส่วนขยายเบราว์เซอร์ ที่ให้คุณสร้าง “sitemap”—แผนแบบภาพว่าต้องเดินเว็บยังไงและจะดึงองค์ประกอบไหน () คุณกำหนด selector สำหรับข้อมูล และกำหนดลิงก์ที่ต้องตามไป (เช่น “กด next เพื่อเปลี่ยนหน้า” หรือ “เข้าไปแต่ละหน้าสินค้าเพื่อดึงรายละเอียด”)

มีช่วงเรียนรู้เล็กน้อย แต่ไม่ต้องเขียนโค้ด—แค่เลือกองค์ประกอบและตั้ง action รองรับ การนำทางหลายชั้น pagination และ infinite scroll (แต่ต้องกำหนดขั้นตอนเอง) เพราะรันในเบราว์เซอร์ คุณเลยดึงข้อมูลเว็บหลังล็อกอินได้โดยล็อกอินเอง

WebScraper.io เหมาะกับ นักวิเคราะห์ข้อมูลสายใช้งานทั่วไป (citizen data analysts) ที่พอจับโครงสร้างหน้าเว็บได้ และอยากได้เครื่องมือฟรีที่ยืดหยุ่น เป็นม้าทำงานที่ไว้ใจได้ ถ้าคุณโอเคกับการตั้ง sitemap เอง

ScraperAPI: Web Extractor แบบ API สำหรับนักพัฒนาและทีมเทคนิค

ไม่ใช่ทุกทีมจะอยากใช้แบบชี้แล้วคลิก—บางทีคุณต้องการโซลูชันฝั่งแบ็กเอนด์เพื่อส่งข้อมูลเว็บเข้าระบบหรือฐานข้อมูลโดยตรง ScraperAPI คือ web extractor แบบ API-first: คุณส่ง URL เข้าไป แล้วมันส่งกลับ HTML ดิบหรือข้อมูลที่ดึงแล้ว พร้อมจัดการเรื่องยากๆ เช่น พร็อกซี การหมุน IP ตามภูมิภาค headless browser และ CAPTCHA ให้ ()

ScraperAPI มีพร็อกซีกว่า 40 ล้าน จาก 50+ ประเทศ และประมวลผล 36 พันล้านคำขอต่อเดือน () เหมาะกับ งานดึงข้อมูลอัตโนมัติขนาดใหญ่ ที่ต้องการความเสถียรและการกันบล็อก คุณต้องเขียนโค้ดพอสมควร แต่ถ้ากำลังทำ data pipeline หรือฝังการดึงข้อมูลเข้าโปรดักต์ ScraperAPI คือหนึ่งในตัวเลือกชั้นนำ

Data Miner: ส่วนขยาย Chrome สำหรับดึงข้อมูลหน้าเว็บแบบรวดเร็ว

Data Miner เป็น ส่วนขยาย Chrome ที่ทำมาเพื่อผู้ใช้ธุรกิจและนักวิจัยที่ต้องการดึงข้อมูลเร็วๆ ฟีลคือ ชี้แล้วคลิก และมีคลัง “สูตร” (recipes) สำเร็จรูป สำหรับแพตเทิร์นยอดนิยม เช่น ตาราง ลิสต์ หรือเว็บเฉพาะบางแห่ง ()

ติดตั้งส่วนขยาย เข้าเว็บเป้าหมาย แล้วกดไอคอน Data Miner เลือกสูตรหรือสร้างเองด้วยการเลือกองค์ประกอบบนหน้า เหมาะกับ งานครั้งคราวหรือความต้องการข้อมูลแบบด่วน เช่น เซลส์ดึงรายชื่อจากไดเรกทอรี หรือผู้จัดการอีคอมเมิร์ซคัดลอกราคาคู่แข่ง

Data Miner ใช้ง่าย อยู่ในเบราว์เซอร์ และเหมาะกับ การดึงข้อมูลแบบโต้ตอบตามต้องการ

Simplescraper: Web Extractor แบบ No-Code ที่ได้ผลทันใจ

Simplescraper สมชื่อ เป็น ส่วนขยาย Chrome แบบ no-code (และมีเว็บแอป) ที่ให้คุณเลือกข้อมูลบนหน้าเว็บแบบภาพเพื่อสร้าง “recipe” สำหรับดึงข้อมูล () รองรับการตามลิงก์ไปดึง subpage จัดการ pagination และยังเปลี่ยนงานดึงข้อมูลให้เป็น API endpoint ได้ในคลิกเดียว

จุดเด่นคือ ตัวเลือกการเชื่อมต่อระบบ—ส่งข้อมูลไป Google Sheets, Airtable หรือเครื่องมืออย่าง Zapier ได้โดยตรง () มี cloud scraping และตั้งเวลาสำหรับงานซ้ำๆ และฟีเจอร์ “AI Enhance” ที่ช่วยทำความสะอาด/วิเคราะห์ข้อมูลด้วย GPT

ถ้าต้องการ ผลลัพธ์เร็วและอินทิเกรชันง่าย Simplescraper คือแนวมีดพกสวิสสำหรับงานดึงข้อมูลเบาๆ แต่ครบเครื่อง

Instant Data Scraper: ดึงข้อมูลตาราง/ลิสต์แบบเร็วสุด

บางครั้งคุณต้องการข้อมูล เดี๋ยวนี้ แบบไม่อยากตั้งค่าอะไรเลย นี่แหละบทบาทของ Instant Data Scraper (IDS) เป็น ส่วนขยาย Chrome ฟรี ที่ดังเรื่อง ดึงข้อมูลตารางได้ในคลิกเดียว () เปิดส่วนขยายแล้ว IDS จะตรวจจับตารางหรือลิสต์บนหน้าเว็บอัตโนมัติ และยังจัดการ pagination กับ infinite scroll ด้วยการไล่คลิกให้เอง

IDS คือ ฟรี 100% ไม่ต้องสมัคร ไม่ต้องโค้ด ไม่ต้องรอ เหมาะกับ งานด่วนหรือใช้งานทั่วไป เช่น เซลส์ดึงรายชื่อเร็วๆ หรือผู้เรียนดึงข้อมูลจากตาราง Wikipedia ถ้ามันเจอข้อมูลของคุณ คุณจะได้ไฟล์ในไม่กี่วินาที

ScrapeStorm: Web Extractor บนคลาวด์พร้อมผู้ช่วย AI

ScrapeStorm เป็น เครื่องมือ web scraping ที่ขับเคลื่อนด้วย AI ผสานอินเทอร์เฟซแบบภาพกับอัลกอริทึม AI ที่ทรงพลัง () คุณใส่ URL แล้ว AI จะ ระบุฟิลด์ข้อมูลอัตโนมัติ—ทั้งลิสต์ ตาราง ปุ่มหน้าถัดไป และอื่นๆ

รองรับ หลายแพลตฟอร์ม (Windows, Mac, Linux) และมีทั้งแบบเดสก์ท็อปและคลาวด์ ตั้งเวลางาน รันหลายงานพร้อมกัน และส่งออกเป็น Excel, CSV, JSON หรืออัปโหลดเข้าฐานข้อมูลได้ () เป็นที่นิยมในงาน อีคอมเมิร์ซและวิจัยตลาด และยังใช้ AI แยกข้อมูลจากรูปภาพหรือ PDF ได้ด้วย

ถ้าต้องการ ผู้ช่วยฉลาดๆ สำหรับโปรเจกต์สเกลใหญ่หรือซับซ้อน ScrapeStorm น่าลอง

Apify: แพลตฟอร์มออโตเมชันและมาร์เก็ตเพลสสำหรับ Web Extractor

Apify ไม่ได้เป็นแค่ scraper แต่เป็น แพลตฟอร์ม web scraping และ automation คุณสามารถรัน “actors” ซึ่งเป็นสคริปต์สำหรับดึงข้อมูลหรือทำ browser automation จุดเด่นคือ มาร์เก็ตเพลสของ actors สำเร็จรูป สำหรับงานยอดนิยม () อยากดึงรีวิวทั้งหมดจากเว็บอีคอมเมิร์ซ? ส่วนใหญ่จะมี actor ให้หยิบไปใช้ได้เลย

สำหรับนักพัฒนา Apify ให้เขียน scraper เองด้วย Node.js หรือ Python แล้วดีพลอยบนคลาวด์ได้ เป็น สเกลได้ ทำอัตโนมัติได้ และเชื่อมต่อผ่าน API เหมาะกับ ผู้ใช้ขั้นสูงและองค์กรที่มองข้อมูลเว็บเป็นทรัพยากรหลัก เช่น งานดึงข้อมูลต่อเนื่องขนาดใหญ่ หรือฝังเข้า data pipeline

ParseHub: Web Page Extractor แบบภาพสำหรับเว็บซับซ้อน

ParseHub เป็น แอปเดสก์ท็อป (มีตัวเลือกคลาวด์) ที่เด่นเรื่องจัดการ เว็บไซต์ไดนามิกและซับซ้อน คุณท่องเว็บในอินเทอร์เฟซคล้ายเบราว์เซอร์ คลิกจุดข้อมูล แล้ว ParseHub จะสร้าง scraper ให้ () รองรับ เงื่อนไข (conditional logic), nested scraping, คอนเทนต์ AJAX และอื่นๆ

ParseHub มักเป็นตัวเลือกเวลาที่เครื่องมืออื่นดึงเว็บนั้นไม่สำเร็จ เหมาะกับนักวิจัย นักวิเคราะห์ และเจ้าของธุรกิจขนาดเล็กที่ต้องรับมือเว็บยากๆ มีช่วงเรียนรู้ แต่ถ้าคุณเจอ เว็บซับซ้อนและไม่อยากเขียนโค้ด ParseHub คือหนึ่งในตัวเลือกที่ดีที่สุด

OutWit Hub: Web Extractor บนเดสก์ท็อปสำหรับเก็บถาวรคอนเทนต์

OutWit Hub อาจดูคลาสสิกหน่อย แต่เป็น แอปเดสก์ท็อป ที่เหมาะกับ การดึงคอนเทนต์หลายประเภท (ลิงก์ รูปภาพ อีเมล ฯลฯ) แล้วจัดระเบียบ () มันเหมือนเอาเบราว์เซอร์มารวมกับสเปรดชีต—เข้าเว็บแล้วดึงตาราง ลิสต์ รูปภาพ และอื่นๆ ได้

เหมาะมากสำหรับ งานเก็บถาวรคอนเทนต์หรือทำรีเสิร์ช เช่น ดึงโพสต์ทั้งหมดจากฟอรั่ม หรือดาวน์โหลดไฟล์เป็นชุด และเพราะเป็นเครื่องมือเดสก์ท็อป คุณรันบนเครื่องตัวเอง ทำให้ ควบคุมและเก็บข้อมูลเป็นส่วนตัวได้มากขึ้น เหมาะกับ งานขนาดเล็กถึงกลาง ที่ต้องการอินเทอร์เฟซตรงไปตรงมา

แล้ว Web Extractor ตัวไหนเหมาะกับคุณ?

12 เครื่องมือ กับเคสใช้งานนับไม่ถ้วน แล้วควรเลือกตัวไหน? นี่คือโพยแบบเร็วๆ:

-

สำหรับมือใหม่สุดๆ หรือดึงข้อมูลครั้งคราวแบบด่วน:

ลอง Instant Data Scraper สำหรับตารางและลิสต์พื้นฐาน (ฟรีและเร็ว) หรือ Data Miner ถ้าคุณดึงหน้าแนวเดิมบ่อยๆ และอยากได้เทมเพลตมากขึ้น

-

สำหรับคนไม่สายเทคนิคที่ต้องดึงข้อมูลต่อเนื่องหรืออยากเชื่อมระบบ:

Thunderbit เวิร์กโฟลว์ง่ายที่สุดด้วยแนวทาง AI เหมาะกับทีมธุรกิจที่ต้องการผลเร็วและใช้บ่อย Browse AI เหมาะกับการมอนิเตอร์และแจ้งเตือนต่อเนื่อง Simplescraper เหมาะถ้าต้องการให้ข้อมูลไหลเข้า Google Sheets หรือแอปภายในผ่าน API

-

สำหรับเว็บซับซ้อนหรือเวิร์กโฟลว์เฉพาะทางโดยไม่เขียนโค้ด:

เลือกสาย visual อย่าง Octoparse หรือ ParseHub Octoparse ใช้ง่ายและมีเทมเพลตเยอะ ParseHub รับมือเว็บไดนามิกยากๆ ได้ดีและคุมรายละเอียดได้มาก WebScraper.io ก็เหมาะถ้าคุณยอมตั้ง sitemap เอง

-

สำหรับนักพัฒนา/วิศวกรข้อมูลที่ต้องการสเกล:

ScraperAPI เหมาะกับการฝัง web scraping เข้าโปรแกรมหรือทำโปรเจกต์สเกลใหญ่ Apify เหมาะเมื่อคุณต้องการแพลตฟอร์มที่สเกลได้ พร้อมมาร์เก็ตเพลสของสคริปต์สำเร็จรูปหรือทำเอง

-

สำหรับงานดึงคอนเทนต์เยอะๆ หรืออยากใช้ออฟไลน์:

OutWit Hub เหมาะกับการเก็บและจัดระเบียบคอนเทนต์อย่างเป็นระบบ โดยเฉพาะถ้าคุณชอบเครื่องมือเดสก์ท็อปเพื่อความเป็นส่วนตัวหรือการควบคุม

ความจริงคือหลายทีมใช้ มากกว่าหนึ่งเครื่องมือ ตามลักษณะงาน คุณอาจเริ่มจาก Instant Data Scraper สำหรับงานง่ายๆ แล้วค่อยขยับไป Thunderbit หรือ Octoparse สำหรับงานที่จริงจังขึ้น และใช้ ScraperAPI หรือ Apify เมื่ออยากทำให้เป็นระบบระดับอุตสาหกรรม ข่าวดีคือส่วนใหญ่มีแพ็กเกจฟรีหรือทดลองใช้ คุณเลยลองก่อนแล้วค่อยเลือกสิ่งที่เหมาะได้

บทสรุป: อนาคตของการดึงข้อมูลจากเว็บสำหรับทีมธุรกิจ

เครื่องมือ web extractor พัฒนามาไกลมาก และในปี 2026 มันกลายเป็นของใช้กระแสหลัก เทรนด์ใหญ่คือ การดึงข้อมูลจากเว็บกำลังง่ายขึ้น อัตโนมัติมากขึ้น และเชื่อมเข้ากับงานประจำวันมากขึ้น () scraper ที่ขับเคลื่อนด้วย AI ทำให้แม้แต่เว็บไดนามิกซับซ้อนก็จัดการได้โดยไม่ต้องมีทักษะเฉพาะทาง อย่างที่วิศวกรข้อมูลคนหนึ่งบอกไว้ว่า “พอเครื่องมือ AI web scraping เข้ามา ฉันทำงานได้เร็วขึ้นและสเกลได้มากขึ้น... และด้วย AI การทำความสะอาดข้อมูลก็ถูกรวมอยู่ในเวิร์กโฟลว์โดยอัตโนมัติ”

อีกการเปลี่ยนแปลงสำคัญคือ เส้นแบ่งระหว่างการดึงข้อมูล การมอนิเตอร์ และออโตเมชันเริ่มเลือน เครื่องมืออย่าง Browse AI และ Thunderbit ไม่ได้แค่ดึงข้อมูล แต่ยังอัปเดตให้ทันสมัย และทำแอ็กชันได้ (เช่น กรอกฟอร์มหรือส่งแจ้งเตือน) การใช้งานเพิ่มขึ้นจริง—แพลตฟอร์มใหญ่รายหนึ่งเห็น ผู้ใช้แอ็กทีฟรายเดือนเพิ่มขึ้นกว่า 140% ภายในปีเดียว () บริษัททุกขนาดเริ่มเห็นตรงกันว่า การเข้าถึงข้อมูลเว็บสาธารณะ (อย่างถูกต้องตามจริยธรรมและกฎหมาย) คือกุญแจสำคัญในการแข่งขัน

สำหรับทีมธุรกิจ สิ่งที่ได้คือ พลังในการตัดสินใจ คุณไม่ต้องรอเดฟเป็นสัปดาห์ หรือพึ่งความรู้สึก เครื่องมือในลิสต์นี้ทำให้ข้อมูลเว็บอยู่ในมือคุณ ด้วยอินเทอร์เฟซและฟีเจอร์ที่ออกแบบมาเพื่อเคสจริงของทีมขาย การตลาด ปฏิบัติการ และอื่นๆ และด้วยทิศทางที่กำลังไป ฉันคาดว่าจะเห็น UI ที่เป็นมิตรขึ้น AI ที่ฉลาดขึ้น และการเชื่อมต่อกับแพลตฟอร์ม BI/Analytics ที่ลึกขึ้นในอนาคตอันใกล้

อย่าลืม: เคารพเงื่อนไขการใช้งานของเว็บไซต์และกฎ robots.txt และตรวจสอบให้สอดคล้องกับกฎหมายคุ้มครองข้อมูลส่วนบุคคล การดึงข้อมูลอย่างมีจริยธรรมสำคัญต่อความยั่งยืนของแนวทางนี้

ดังนั้นไม่ว่าคุณจะเริ่มจากส่วนขยายฟรี หรือดีพลอยระบบดึงข้อมูลระดับองค์กร ตอนนี้คือช่วงเวลาที่ดีที่สุดในการเปลี่ยนข้อมูลบนเว็บให้เป็นอินไซต์ที่ลงมือทำได้ การปฏิวัติ web extractor มาถึงแล้ว—เลือกเครื่องมือ ลองใช้ แล้วปลดล็อกคุณค่าที่ซ่อนอยู่ตรงหน้า อนาคตแบบ data-driven ของคุณอยู่ห่างแค่คลิกเดียว

คำถามที่พบบ่อย (FAQs)

1. Web extractor คืออะไร และทำไมธุรกิจถึงควรใช้?

Web extractor คือเครื่องมือที่ช่วยรวบรวมข้อมูลแบบมีโครงสร้างจากเว็บไซต์โดยอัตโนมัติ สำคัญเพราะช่วยให้ธุรกิจเปลี่ยนข้อมูลออนไลน์ที่กระจัดกระจายให้เป็นอินไซต์ที่นำไปใช้ได้จริง เพิ่มประสิทธิภาพ เพิ่มกำไร และลดงานเก็บข้อมูลด้วยมือ

2. ใครใช้ web extractor ได้บ้าง—ต้องมีทักษะเทคนิคไหม?

หลายเครื่องมือยุคใหม่ไม่ต้องมีทักษะเทคนิค เช่น Thunderbit, Browse AI และ Instant Data Scraper ที่ออกแบบมาให้คนทั่วไปใช้ได้ ด้วยอินเทอร์เฟซเข้าใจง่าย ออโตเมชันด้วย AI และเวิร์กโฟลว์แบบ no-code

3. ทีมขาย การตลาด และปฏิบัติการได้ประโยชน์อย่างไรจาก web extractor?

ทีมขายสร้างลิสต์ลีดจากไดเรกทอรีออนไลน์ ทีมการตลาดติดตามราคาคู่แข่ง ทีมปฏิบัติการทำให้กระบวนการเก็บข้อมูลเป็นอัตโนมัติ เครื่องมือเหล่านี้ช่วยประหยัดเวลา ลดข้อผิดพลาด และให้ข้อมูลใหม่ที่เชื่อถือได้เพื่อการตัดสินใจเชิงกลยุทธ์

4. ควรดูอะไรเมื่อเลือกเครื่องมือ web extractor?

ปัจจัยหลักคือความง่ายในการใช้งาน ความสามารถด้าน AI ฟีเจอร์อัตโนมัติ/ตั้งเวลา การเชื่อมต่อกับเครื่องมืออย่าง Google Sheets หรือ Airtable ความสามารถในการสเกล และความเหมาะกับเคสธุรกิจของคุณ (เช่น ลีดขาย เฝ้าราคา เก็บถาวรคอนเทนต์)

5. มี web extractor ฟรีหรือราคาประหยัดไหม?

มี หลายเครื่องมือมีแพ็กเกจฟรีหรือราคาไม่สูง Instant Data Scraper ฟรีทั้งหมดสำหรับงานพื้นฐาน ส่วน Thunderbit, Simplescraper และ Data Miner มีแพ็กเกจฟรีที่ให้ใช้งานได้เยอะ และอัปเกรดได้เมื่อจำเป็น

อยากรู้เพิ่มเกี่ยวกับการดึงข้อมูลจากเว็บ, AI scraping หรือวิธีเปลี่ยนเว็บไซต์ให้เป็นข้อได้เปรียบของทีมคุณ? เข้าไปดูบทความเพิ่มเติมได้ที่ มีทั้งคู่มือ ทิปส์ และเรื่องเล่าจากงานจริงด้าน data automation.