ตอนนี้ทราฟฟิกบนอินเทอร์เน็ตเกือบครึ่งหนึ่งมาจากบอท และส่วนใหญ่ก็เอาไว้สแครปลิงก์ ข้อมูล และ URL แบบยิงเป็นชุด ๆ ถ้าคุณยังนั่งทำมืออยู่ บอกเลยว่ากำลังโดนคนอื่นทิ้งห่างไปเรื่อย ๆ

ผมเลยลองเทสต์เครื่องมือดึงลิงก์ 12 ตัว ตั้งแต่ Chrome extension ที่มี AI ช่วย ไปจนถึงไลบรารี Python เพื่อดูว่าเครื่องมือไหน “ของจริง” เวลาต้องดึง URL หลายพันรายการให้เสร็จไว ๆ

นี่คือสิ่งที่ผมเจอ

ทำไมเครื่องมือดึงลิงก์ถึงสำคัญ

พูดกันแบบไม่อ้อมค้อม: เว็บมันแน่นไปด้วยข้อมูลมหาศาล และธุรกิจกำลังแข่งกันเปลี่ยนความรกนั้นให้กลายเป็นอินไซต์ที่เอาไปใช้ต่อได้จริง และ เลยกลายเป็นของจำเป็นระดับ “ไม่มีไม่ได้” สำหรับทีมที่อยาก:

- สร้างลีด: ทีมเซลส์ดึงลิงก์โปรไฟล์บริษัทจากไดเรกทอรีหรือ LinkedIn ได้ในไม่กี่นาที แล้วเอา URL ไปต่อยอดดึงข้อมูลติดต่อ ลดการคลิกวนไปวนมาแบบไม่จบไม่สิ้น

- รวมคอนเทนต์และดัน SEO: นักการตลาดเก็บ URL บทความทั้งหมดจากบล็อก ติดตามแบ็กลิงก์คู่แข่ง หรือเช็กโครงสร้างเว็บเพื่อหาลิงก์เสียได้ง่ายขึ้น

- จับตาคู่แข่งและทำรีเสิร์ชตลาด: ทีมโอเปอเรชันรวบรวมลิงก์สินค้าใหม่ หน้าราคา หรือข่าวประชาสัมพันธ์แบบอัตโนมัติ—ตามเกมคู่แข่งได้แบบไม่ต้องเหนื่อย

- ทำงานอัตโนมัติและประหยัดเวลา: เครื่องมือสแครปลิงก์ยุคนี้รองรับ URL จำนวนมาก ไต่ไปหน้าลูก และส่งออกข้อมูลเป็นไฟล์/ระบบที่เป็นระเบียบ (CSV, Excel, Google Sheets, Notion ฯลฯ) จบปัญหาก๊อปปี้-วางยาว ๆ หรือมานั่งจัดไฟล์ข้อความเละ ๆ

เมื่อ การทำแบบแมนนวลแทบเป็นไปไม่ได้ เครื่องมือดึงลิงก์ที่ดีมันเหมือนผู้ช่วยพลังสูงที่ไม่เหนื่อย ไม่หลุดลิงก์ และไม่เคยขอพักไปซื้อกาแฟ

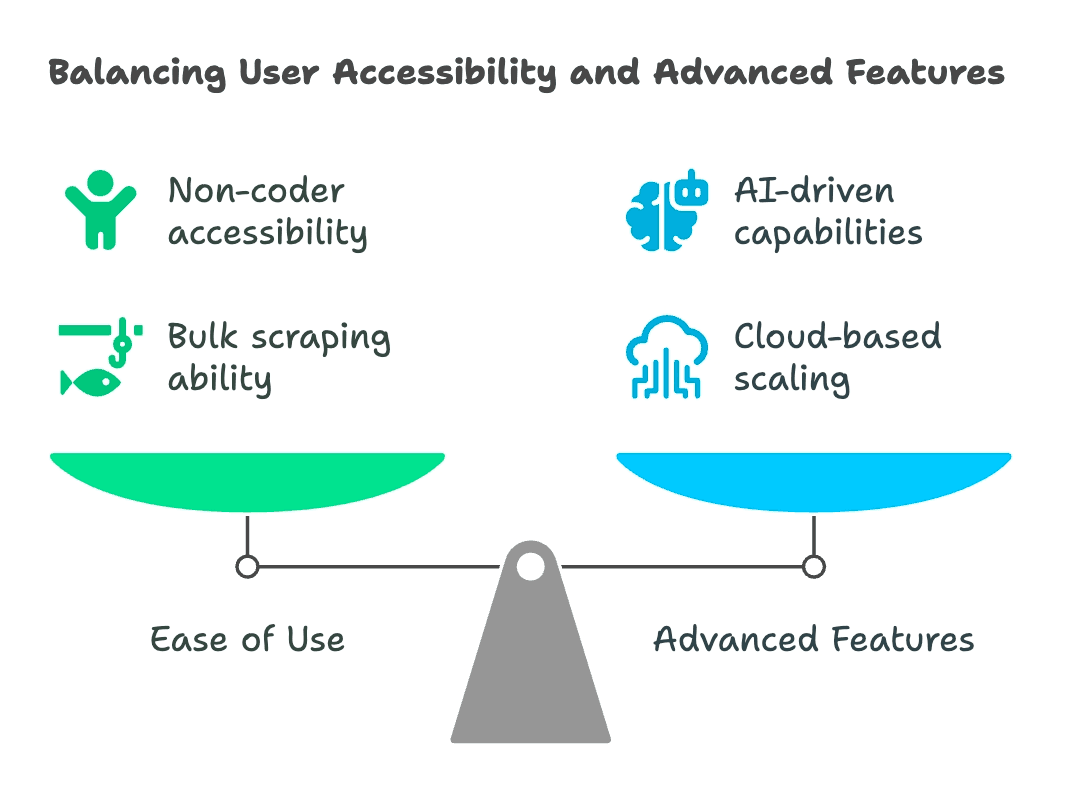

เราเลือกเครื่องมือดึงลิงก์ที่ดีที่สุดอย่างไร

เครื่องมือมีเยอะจนเลือกยาก เหมือนสปีดเดตในงานคอนเฟอเรนซ์สายเทค—ทุกตัวบอกว่าตัวเอง “ใช่” แต่มีไม่กี่ตัวที่เอาอยู่จริง นี่คือเกณฑ์ที่ผมใช้คัด 12 อันดับ:

- ใช้งานง่าย: คนไม่เขียนโค้ดใช้ได้ไหม โดยไม่ต้องมีดีกรี regex? เครื่องมือแบบ no-code/low-code ได้แต้มเพิ่ม

- สแครปแบบจำนวนมาก & หลายชั้น: รับมือ URL หลายร้อยพร้อมกันได้ไหม ไต่หน้าลูกและตามลิงก์ต่ออัตโนมัติได้หรือเปล่า

- การส่งออก & การเชื่อมต่อ: ส่งออกไป CSV, Excel, Google Sheets, Notion, Airtable หรือผ่าน API ได้ไหม ยิ่งลดงานมือยิ่งดี

- กลุ่มผู้ใช้ & ความยืดหยุ่น: เหมาะกับผู้ใช้ธุรกิจ นักวิเคราะห์ หรือเดเวลอปเปอร์? บางตัวทำมาเพื่อทุกคน บางตัวเฉพาะทาง

- ฟีเจอร์ขั้นสูง: การรู้จำด้วย AI, ตั้งเวลา, สเกลบนคลาวด์, ทำความสะอาดข้อมูล, เทมเพลตสำหรับเว็บยอดนิยม

- ราคา & การสเกล: มีฟรี แพ็กเกจตามการใช้งาน หรือระดับองค์กร? ผมดูความคุ้มค่าที่ได้จริง

ผมรวมตั้งแต่ส่วนขยายเบราว์เซอร์ไปจนถึงแพลตฟอร์มระดับองค์กร ไม่ว่าคุณจะเป็นผู้ก่อตั้งเดี่ยว ๆ หรือทีมข้อมูลของ Fortune 500 ก็มีตัวที่เหมาะ

Thunderbit: เครื่องมือดึงลิงก์ที่ฉลาดที่สุดสำหรับผู้ใช้ธุรกิจ

เริ่มจากตัวท็อปก่อนเลย คือคำแนะนำอันดับหนึ่งของผมสำหรับงานดึงลิงก์ ไม่ใช่แค่เพราะผมมีส่วนร่วมในการสร้างมัน แต่เพราะมัน “ตอบโจทย์จริง” Thunderbit คือ ที่ทำมาเพื่อผู้ใช้ธุรกิจที่อยากได้ผลลัพธ์ไว ๆ แบบชัดเจน

Thunderbit เด่นตรงไหน? ฟีลเหมือนมีอินเทิร์น AI ที่คุยรู้เรื่อง คุณแค่พิมพ์ภาษาคนบอกสิ่งที่ต้องการ (เช่น “ดึงลิงก์สินค้าและราคาทั้งหมดจากหน้านี้”) แล้ว AI ของ Thunderbit จะจัดการที่เหลือให้เอง ไม่ต้องมานั่งจูน selector หรือเขียนสคริปต์ให้ปวดหัว

และยังไม่หมดแค่นั้น:

- รองรับ URL จำนวนมาก: วาง URL เดียวหรือเป็นลิสต์หลายร้อยรายการ—Thunderbit จัดให้จบในรอบเดียว

- ไต่หน้าลูก (Subpage): ต้องดึงลิงก์จากหน้ารวม แล้วเข้าไปแต่ละหน้ารายละเอียดเพื่อเก็บ URL เพิ่ม? ระบบสแครปหลายชั้นของ Thunderbit ช่วยได้

- ส่งออกแบบเป็นโครงสร้าง: หลังดึงลิงก์แล้ว คุณเปลี่ยนชื่อฟิลด์ จัดหมวดหมู่ และส่งออกตรงไป Google Sheets, Notion, Airtable, Excel หรือ CSV ได้ทันที ลดงานตามแก้ทีหลัง

Thunderbit ได้รับความไว้วางใจจากผู้ใช้กว่า 30,000 คนทั่วโลก ตั้งแต่ทีมขาย เอเจนต์อสังหาฯ ไปจนถึงร้านอีคอมเมิร์ซขนาดเล็ก และมี (สแครปได้สูงสุด 6 หน้า หรือ 10 หน้าหากเปิดบูสต์ช่วงทดลอง) ให้ลองแบบไม่ต้องเสี่ยง

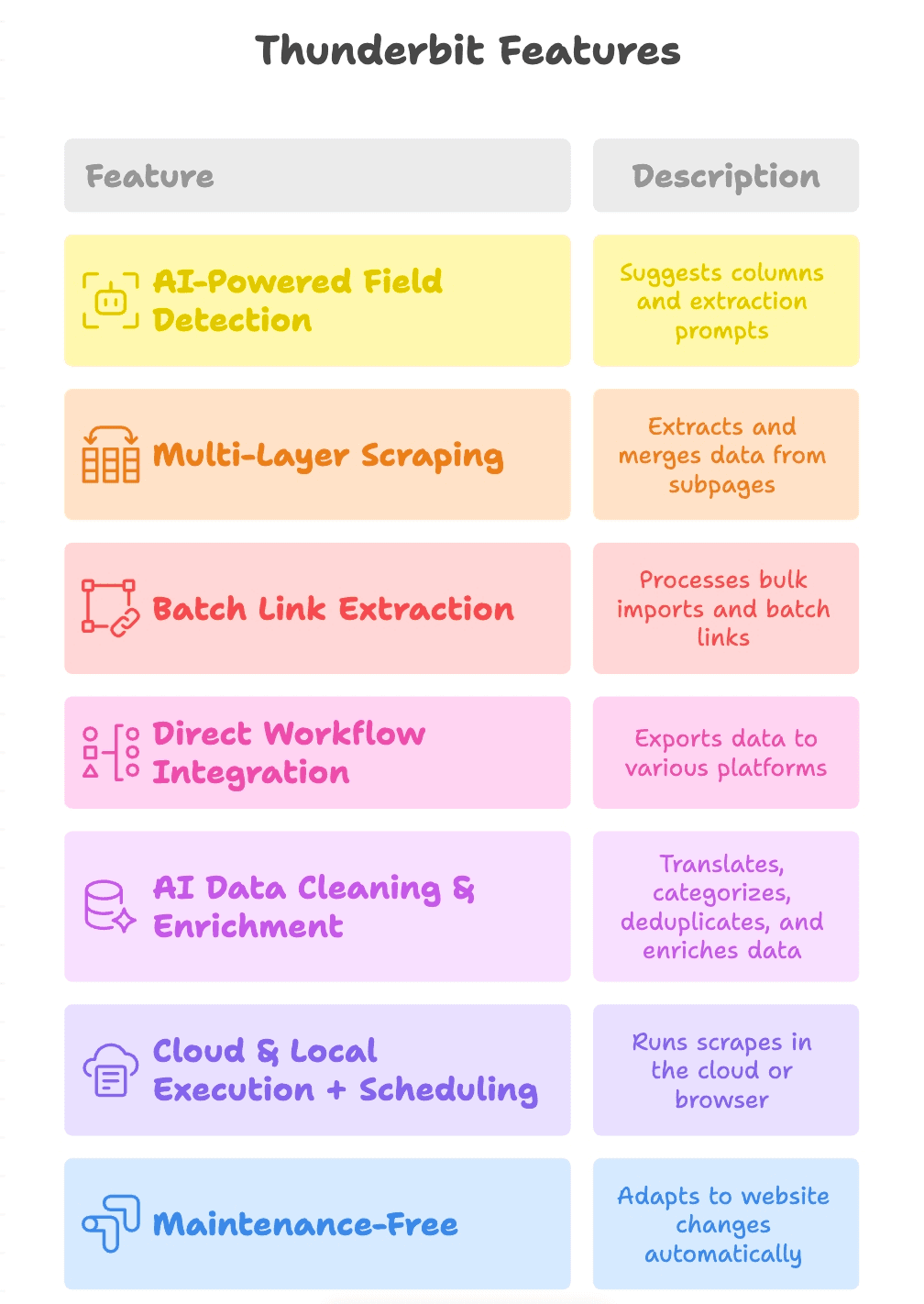

ฟีเจอร์เด่นของ Thunderbit

มาดูสิ่งที่ทำให้ Thunderbit ต่างจากคนอื่นแบบเห็นภาพ:

- ตรวจจับฟิลด์ด้วย AI: แค่กด “AI Suggest Fields” Thunderbit จะอ่านหน้าเว็บ แล้วเสนอคอลัมน์ (เช่น “ลิงก์สินค้า”, “PDF URL”, “อีเมลติดต่อ”) พร้อมสร้างพรอมป์สำหรับดึงข้อมูลให้แต่ละฟิลด์

- สแครปหลายชั้น (Multi-Layer): ตามลิงก์จากหน้าหลักไปหน้าลูก (เช่น หน้ารายละเอียดสินค้า หรือหน้าดาวน์โหลด PDF) ดึงลิงก์เพิ่ม แล้วรวมเป็นตารางเดียว

- ดึงลิงก์แบบแบตช์: จะสแครปหน้าเดียวหรือเป็นพันหน้า ก็รองรับการนำเข้าแบบจำนวนมากและดึงลิงก์เป็นชุดได้สบาย

- เชื่อมเวิร์กโฟลว์โดยตรง: ส่งออกไป Google Sheets, Notion, Airtable หรือดาวน์โหลดเป็น CSV/Excel ได้ทันที ข้อมูลไปอยู่ในที่ที่ทีมต้องใช้

- ทำความสะอาด/เสริมข้อมูลด้วย AI: แปลภาษา จัดหมวด ตัดข้อมูลซ้ำ และเสริมข้อมูลระหว่างสแครปได้ ทำให้ผลลัพธ์พร้อมใช้งาน ไม่ใช่แค่กองข้อมูลดิบ

- รันบนคลาวด์หรือในเครื่อง + ตั้งเวลา: รันบนคลาวด์เพื่อความเร็ว หรือรันในเบราว์เซอร์สำหรับเว็บที่ต้องล็อกอิน ตั้งงานให้รันซ้ำเพื่อให้ข้อมูลอัปเดตตลอด

- แทบไม่ต้องดูแล: AI ของ Thunderbit ปรับตัวตามเว็บที่เปลี่ยน ลดเวลาซ่อมสแครปเปอร์พัง ๆ แล้วไปโฟกัสที่ผลลัพธ์แทน

Octoparse: เครื่องมือสแครปลิงก์แบบ No-Code สำหรับทุกคน

คือรุ่นคลาสสิกสาย no-code เป็นแอปเดสก์ท็อป (Windows/Mac) ที่ทำงานแบบคลิกเลือกบนหน้าจอ คุณเปิดเว็บ คลิกลิงก์ที่อยากได้ แล้ว Octoparse จะจัดการต่อให้

- เหมาะกับมือใหม่: ไม่ต้องเขียนโค้ด คลิก-ดึง-จบ

- รองรับเพจจิเนชันและคอนเทนต์ไดนามิก: กด “ถัดไป” เลื่อนหน้า และล็อกอินเว็บได้

- สแครปบนคลาวด์และตั้งเวลา: แพ็กเกจเสียเงินรันงานบนคลาวด์และตั้งงานซ้ำได้

- ตัวเลือกการส่งออก: ดาวน์โหลดเป็น CSV, Excel, JSON หรือส่งเข้าฐานข้อมูล

แพ็กเกจฟรีถือว่าให้เยอะสำหรับงานเล็ก (สูงสุด 10 งาน และ 50,000 แถว/เดือน) แต่ถ้าใช้งานหนัก ๆ มักต้องอัปเกรด (เริ่มประมาณ $75/เดือน)

Apify: เครื่องมือดึง URL ที่ยืดหยุ่นสำหรับเวิร์กโฟลว์เฉพาะทาง

ฟีลเหมือนมีดพกสวิสของงานสแครปเว็บ มีมาร์เก็ตเพลส “actors” (เครื่องมือสแครปสำเร็จรูป) และยังเขียนสคริปต์เองได้ด้วย JavaScript หรือ Python

- มีทั้งสำเร็จรูปและปรับแต่งได้: ใช้ actor ของชุมชนสำหรับงานทั่วไป หรือสร้างของตัวเองสำหรับเวิร์กโฟลว์เฉพาะ

- สแครปจำนวนมากและตั้งเวลา: จัดคิว URL รันขนาน และตั้งงานสแครปซ้ำได้

- เน้น API เป็นหลัก: ส่งออกเป็น JSON, CSV, Excel หรือ Google Sheets และต่อเข้าดาต้าพายป์ไลน์ได้

- จ่ายตามการใช้งาน: มีเครดิตฟรีรายเดือน จากนั้นคิดตามการใช้จริง

เหมาะกับทีมที่มีพื้นฐานเทคนิคระดับกลางและเดเวลอปเปอร์ที่อยากได้ความยืดหยุ่นกับสเกล

Bright Data URL Scraper: สแครปลิงก์ระดับองค์กร

ทำมาเพื่อองค์กรที่ต้องสแครปแบบงานใหญ่จริงจัง Data Collector ของเขามี URL Scraper แบบพรีเซ็ตสำหรับงานปริมาณสูง

- รองรับสเกลมหาศาล: สแครปได้ตั้งแต่หลักพันถึงหลักล้านหน้า พร้อมโครงสร้างพร็อกซีที่แข็งแรงเพื่อลดการโดนบล็อก

- เทมเพลตสำเร็จรูป: มีสแครปเปอร์พร้อมใช้สำหรับอีคอมเมิร์ซ โซเชียล อสังหาฯ และอื่น ๆ

- ฟีเจอร์ระดับองค์กร: เครื่องมือด้านคอมพลายแอนซ์ ซัพพอร์ตผู้เชี่ยวชาญ และระบบกันบล็อกขั้นสูง

- ราคา: เริ่มราว ๆ $350 สำหรับ 100,000 page loads—ชัดเจนว่าโฟกัสลูกค้าองค์กร

ถ้าคุณเป็นสตาร์ทอัปอาจเกินจำเป็น แต่ถ้าเป็นงานสำคัญและปริมาณสูง Bright Data คือสายพลัง

WebHarvy: เครื่องมือดึงลิงก์แบบภาพ ใช้ง่ายด้วยการคลิก

เป็นแอปเดสก์ท็อป (Windows) ที่ให้คุณดึงลิงก์ได้ด้วยการคลิกบนเบราว์เซอร์ในตัว

- ง่ายมาก: คลิกลิงก์หนึ่งครั้ง WebHarvy จะไฮไลต์องค์ประกอบที่คล้ายกันเพื่อดึงพร้อมกัน

- รองรับ Regular Expression: มีแพตเทิร์นสำเร็จรูปสำหรับงานทั่วไป ไม่ต้องเขียนโค้ด

- ส่งออกเป็น Excel, CSV, JSON, XML, SQL: เหมาะกับผู้ใช้ธุรกิจที่อยากได้ไฟล์คุ้นเคย

- ไลเซนส์ซื้อครั้งเดียว: จ่ายครั้งเดียว ใช้ได้ยาว ๆ

เหมาะกับธุรกิจเล็ก นักวิจัย หรือใครที่อยากได้วิธีดึงลิงก์แบบไว ๆ ไม่ซับซ้อน

Web Scraper (ส่วนขยาย Chrome): สแครปลิงก์เร็ว ๆ ในเบราว์เซอร์

เป็นเครื่องมือฟรีแบบโอเพนซอร์สที่เปลี่ยนเบราว์เซอร์ให้กลายเป็นสแครปเปอร์

- กำหนด Sitemap: บอกเส้นทางการไต่หน้าและสิ่งที่ต้องดึง

- รองรับเพจจิเนชันและการครอลหลายชั้น: ไต่หมวดหมู่ หมวดย่อย และหน้ารายละเอียด

- ส่งออกเป็น CSV/XLSX: ดาวน์โหลดข้อมูลจากเบราว์เซอร์ได้เลย

- เทมเพลตจากชุมชน: มี sitemap แชร์ไว้เยอะสำหรับเว็บยอดนิยม

เหมาะกับงานครั้งคราว งานด่วน หรือทีมเล็ก/นักเรียนที่งบจำกัด

ScraperAPI: สแครปลิงก์แบบสเกลสำหรับเดเวลอปเปอร์

เหมาะกับเดเวลอปเปอร์ที่ต้องดึงหน้าเว็บจำนวนมาก แต่ไม่อยากปวดหัวเรื่องพร็อกซี การโดนบล็อก หรือ CAPTCHA

- ขับเคลื่อนด้วย API: ส่ง URL เข้าไป แล้วได้ HTML หรือข้อมูลที่สแครปกลับมา

- รองรับสเกลและระบบกันบอท: มีหมุนพร็อกซี เรนเดอร์ JS และแก้ CAPTCHA ในตัว

- ต่อเข้ากับโค้ดของคุณได้: ใช้กับ Python, Node.js หรือภาษาอื่น ๆ ได้

- ราคา: มีฟรี (~1000 API calls) แล้วค่อยจ่ายตามแพ็กเกจ

เหมาะกับการทำครอลเลอร์เฉพาะทาง หรือเมื่อคุณต้องการความเสถียรและความเร็วระดับสเกล

ParseHub: สแครปลิงก์แบบภาพ พร้อมการเลือกขั้นสูง

เป็นแอปเดสก์ท็อป (Windows, Mac, Linux) ที่ให้สร้างโปรเจกต์สแครปแบบภาพ

- การเลือกและการนำทางขั้นสูง: คลิก วนลูป และตั้งเงื่อนไขเพื่อดึงลิงก์—แม้เป็นองค์ประกอบไดนามิกหรือซ่อนอยู่

- รองรับหน้าแบบซ้อนกัน: ไต่หมวดหมู่ → หน้ารายละเอียด → ดึงลิงก์เพิ่ม

- ส่งออกเป็น CSV, Excel, JSON: แพ็กเกจเสียเงินมีรันบนคลาวด์และ API

- แพ็กเกจฟรี: 5 โปรเจกต์ สูงสุด 200 หน้า/รัน

เป็นตัวโปรดของนักการตลาดและนักวิจัยที่อยากได้พลังโดยไม่ต้องเขียนโค้ด

Scrapy: เครื่องมือดึงลิงก์ Python สำหรับเดเวลอปเปอร์

คือมาตรฐานทองคำสำหรับเดเวลอปเปอร์ Python ที่อยากคุมทุกอย่างเอง

- สายโค้ดล้วน: สร้าง spider เองเพื่อครอลและดึงลิงก์ได้ทุกสเกล

- รองรับการครอลแบบกระจาย: เร็ว ทำงานแบบอะซิงก์ และปรับแต่งได้สูง

- ส่งออกเป็น CSV, JSON, XML หรือฐานข้อมูล: คุณกำหนดรูปแบบผลลัพธ์เอง

- โอเพนซอร์สและฟรี: แต่ต้องจัดการสภาพแวดล้อมเอง

ถ้าคุณถนัด Python, Scrapy คือสุดทางของความทรงพลัง

Diffbot: สแครปลิงก์ด้วย AI เพื่อข้อมูลแบบมีโครงสร้าง

คือ “สมอง AI” ของงานสแครปเว็บ วิเคราะห์หน้าเว็บแล้วคืนข้อมูลแบบมีโครงสร้าง—including ลิงก์—แทบไม่ต้องตั้งค่าเอง

- รู้จำคอนเทนต์อัตโนมัติ: ป้อน URL แล้วได้ข้อมูลแบบมีโครงสร้าง (บทความ สินค้า ลิงก์ ฯลฯ)

- Crawlbot & Knowledge Graph: ครอลทั้งเว็บไซต์ หรือค้นจากดัชนีเว็บขนาดใหญ่ของเขา

- ขับเคลื่อนด้วย API: ต่อเข้ากับเครื่องมือ BI หรือดาต้าพายป์ไลน์ได้

- ราคาสำหรับองค์กร: เริ่มราว ๆ $299/เดือน แต่คุณได้คุณภาพตามราคา

เหมาะกับองค์กรที่อยากได้ข้อมูลสะอาดเป็นโครงสร้าง โดยไม่ต้องคอยดูแลสแครปเปอร์เอง

Cheerio: สแครปลิงก์แบบเบาสำหรับ Node.js

คือ HTML parser สำหรับ Node.js ที่เร็ว และไวยากรณ์คล้าย jQuery

- เร็วมาก: พาร์ส HTML ได้ระดับมิลลิวินาที

- ไวยากรณ์คุ้นเคย: ถ้าคุณรู้ jQuery ก็หยิบ Cheerio มาใช้ได้ทันที

- เหมาะกับหน้าแบบสแตติก: ไม่เรนเดอร์ JS แต่เหมาะมากกับคอนเทนต์ที่เรนเดอร์ฝั่งเซิร์ฟเวอร์

- โอเพนซอร์สและฟรี: มักใช้คู่กับ axios หรือ fetch เพื่อยิงรีเควสต์

เหมาะกับเดเวลอปเปอร์ที่อยากเขียนสคริปต์เอง เน้นเร็วและเรียบง่าย

Puppeteer: ออโตเมชันเบราว์เซอร์สำหรับงานสแครปลิงก์ขั้นสูง

คือไลบรารี Node.js สำหรับคุม Chrome แบบ headless

- ออโตเมชันเบราว์เซอร์เต็มรูปแบบ: โหลดหน้า คลิก เลื่อน และโต้ตอบเหมือนผู้ใช้จริง

- รองรับคอนเทนต์ไดนามิกและล็อกอิน: เหมาะกับเว็บที่ใช้ JavaScript หนัก ๆ หรือเวิร์กโฟลว์ซับซ้อน

- ควบคุมละเอียด: รอ element แคปหน้าจอ ดัก network request

- โอเพนซอร์สและฟรี: แต่กินทรัพยากรและช้ากว่าเครื่องมือเบา ๆ

ใช้ Puppeteer เมื่อคุณต้องดึงลิงก์จากเว็บที่ไม่เป็นมิตรกับสแครปเปอร์ทั่วไป

เปรียบเทียบแบบเร็ว: เครื่องมือดึงลิงก์ไหนเหมาะกับคุณ?

นี่คือสรุปเปรียบเทียบทั้ง 12 เครื่องมือ:

| เครื่องมือ | เหมาะกับ | รองรับจำนวนมาก & หน้าลูก | ตัวเลือกการส่งออกข้อมูล | ราคา |

|---|---|---|---|---|

| Thunderbit | คนไม่เขียนโค้ด, ผู้ใช้ธุรกิจ | ใช่ (AI, หลายชั้น) | Excel, CSV, Sheets, Notion, Airtable | ทดลองฟรี, เริ่ม ~ $9/เดือน |

| Octoparse | ผู้ใช้ no-code, นักวิเคราะห์ | ใช่ | CSV, Excel, JSON, ที่เก็บบนคลาวด์ | มีฟรี, ~ $75/เดือน |

| Apify | ทีมกึ่งเทคนิค, เดเวลอปเปอร์ | ใช่ | CSV, JSON, Sheets ผ่าน API | เครดิตฟรี, คิดตามการใช้ |

| Bright Data | องค์กร | ใช่ (ปริมาณสูง) | CSV, JSON, NDJSON ผ่าน API | ~ $350/100k หน้า |

| WebHarvy | คนไม่เขียนโค้ด, เดสก์ท็อป | ใช่ | Excel, CSV, JSON, XML, SQL | ไลเซนส์แบบเสียเงิน |

| Web Scraper Extension | ทุกคน, งานด่วน/ฟรี | ใช่ | CSV, XLSX | ฟรี, โอเพนซอร์ส |

| ScraperAPI | เดเวลอปเปอร์, ผู้ใช้ API | ใช่ | JSON (HTML ผ่าน API) | ฟรี 1k req, มีแพ็กเกจ |

| ParseHub | คนไม่เขียนโค้ด, ขั้นสูง | ใช่ | CSV, Excel, JSON, API | ฟรี 5 โปรเจกต์, มีแพ็กเกจ |

| Scrapy | เดเวลอปเปอร์, Python | ใช่ | CSV, JSON, XML, DB | ฟรี, โอเพนซอร์ส |

| Diffbot | องค์กร, AI | ใช่ (ครอลด้วย AI) | JSON (ข้อมูลโครงสร้างผ่าน API) | ~ $299/เดือน+ |

| Cheerio | เดเวลอปเปอร์, Node.js | ใช่ (โค้ดเอง) | ปรับเอง (JSON ฯลฯ) | ฟรี, โอเพนซอร์ส |

| Puppeteer | เดเวลอปเปอร์, เว็บซับซ้อน | ใช่ (ออโตเมชันเต็มรูปแบบ) | ปรับเอง (ผลลัพธ์จากสคริปต์) | ฟรี, โอเพนซอร์ส |

เลือกเครื่องมือสแครปลิงก์ให้เหมาะกับธุรกิจของคุณ

แล้วควรเลือกยังไง? นี่คือโพยสั้น ๆ ของผม:

- ไม่ถนัดโค้ด? เริ่มที่ Thunderbit, Octoparse, ParseHub, WebHarvy หรือ Web Scraper extension

- ต้องการเวิร์กโฟลว์เฉพาะทาง? Apify, ScraperAPI หรือ Cheerio เหมาะกับเดเวลอปเปอร์

- ต้องการสเกลระดับองค์กร? Bright Data หรือ Diffbot ทำมาเพื่อคุณ

- เป็นเดเวลอปเปอร์ Python หรือ Node.js? Scrapy (Python) หรือ Cheerio/Puppeteer (Node.js) ให้คุณคุมได้หมด

- อยากส่งออกตรงไป Sheets/Notion? Thunderbit คือคำตอบที่ชัดที่สุด

เลือกให้ตรงกับความถนัดด้านเทคนิค ปริมาณข้อมูล และความต้องการเชื่อมต่อระบบ ส่วนใหญ่มีให้ลองฟรี อย่ากลัวที่จะลองเทสต์ก่อน

คุณค่าที่ Thunderbit ให้กับงานดึงลิงก์ในปี 2026

กลับมาที่เหตุผลที่ Thunderbit ต่างจริง ๆ:

- ง่ายด้วยพลัง AI: บอกสิ่งที่ต้องการด้วยภาษาคน แล้ว AI จัดการให้

- สแครปหลายชั้น: ดึงลิงก์จากหน้าหลัก ตามไปหน้าลูก แล้วเก็บ URL เพิ่ม—จบในโฟลว์เดียว

- นำเข้า URL จำนวนมาก & ประมวลผลเป็นชุด: วาง URL หลายร้อยรายการ ดึงลิงก์แบบ bulk และส่งออกเป็นข้อมูลมีโครงสร้างได้ทันที

- เชื่อมเวิร์กโฟลว์: ส่งออกตรงไป Google Sheets, Notion, Airtable หรือดาวน์โหลดเป็น CSV/Excel

- แทบไม่ต้องบำรุงรักษา: AI ปรับตามเว็บที่เปลี่ยน ทำให้ไม่ต้องคอยซ่อมสแครปเปอร์พัง ๆ ตลอดเวลา

Thunderbit ช่วยปิดช่องว่างระหว่าง “แค่สแครปข้อมูล” กับ “ได้ข้อมูลที่เอาไปทำงานต่อได้จริง” เป็นเครื่องมือที่ผมอยากมีตั้งแต่หลายปีก่อน ตอนที่ต้องจมกับงานข้อมูลแบบแมนนวล

สรุป: สแครปลิงก์ให้ฉลาดขึ้น และยกระดับเวิร์กโฟลว์ของคุณ

ข้อมูลบนเว็บคือเชื้อเพลิงของการเติบโตทางธุรกิจ—และเครื่องมือดึงลิงก์ที่ใช่ก็คือเครื่องยนต์ของคุณ ไม่ว่าคุณจะทำลิสต์ลีด จับตาคู่แข่ง หรือทำรีเสิร์ชให้เป็นอัตโนมัติ ในลิสต์นี้มีเครื่องมือที่เหมาะกับทั้งความต้องการและสกิลของคุณ

ถ้าอยากเห็นว่าการดึงลิงก์ยุคใหม่มันไปได้ไกลแค่ไหน ลอง ดู ผมว่าเดี๋ยวคุณจะเซอร์ไพรส์ว่าทำได้เยอะขนาดไหนในไม่กี่คลิก และถ้า Thunderbit ยังไม่ใช่คำตอบที่ลงตัว ก็ลองเครื่องมืออื่น ๆ ในลิสต์นี้ได้เลย—นี่แหละช่วงเวลาที่เหมาะสุดในการทำงานน่าเบื่อให้เป็นออโต แล้วเอาเวลาไปโฟกัสสิ่งที่สำคัญจริง ๆ

ขอให้สแครปกันแบบลื่น ๆ—และขอให้ลิงก์ของคุณสะอาด เป็นระเบียบ พร้อมใช้งานตลอด ถ้าอยากลงลึกเรื่อง web scraping เพิ่มเติม แวะอ่าน ได้เลย มีคู่มือกับทิปส์อีกเพียบ

คำถามที่พบบ่อย (FAQs)

1. ทำไมเครื่องมือดึงลิงก์ถึงจำเป็น?

เมื่อทราฟฟิกอินเทอร์เน็ตเกือบครึ่งมาจากบอท และธุรกิจต่างเร่งสแครปข้อมูลกันจริงจัง เครื่องมือดึงลิงก์จึงสำคัญในการเปลี่ยนความวุ่นวายบนเว็บให้เป็นอินไซต์ที่เอาไปใช้ได้ ช่วยทำงานอัตโนมัติ เช่น สร้างลีด รวมคอนเทนต์ ตรวจ SEO และติดตามคู่แข่ง ประหยัดทั้งเวลาและแรงแบบเห็นได้ชัด

2. อะไรทำให้ Thunderbit เด่นกว่าเครื่องมือดึงลิงก์อื่น ๆ?

Thunderbit ใช้ AI ทำให้การสแครปง่ายมาก—แค่บอกเป้าหมายด้วยภาษาคน ระบบก็จัดการให้ รองรับการใส่ URL จำนวนมาก สแครปหลายชั้น ตรวจจับฟิลด์อัจฉริยะ และส่งออกไป Google Sheets/Notion ได้ลื่น เหมาะกับคนไม่เขียนโค้ดและผู้ใช้ธุรกิจที่อยากได้ผลลัพธ์แรง ๆ โดยไม่ต้องลงเทคนิคเยอะ

3. มีเครื่องมือดึงลิงก์ที่เหมาะกับเดเวลอปเปอร์และเวิร์กโฟลว์เฉพาะทางไหม?

มี เช่น Apify, ScraperAPI, Cheerio, Puppeteer และ Scrapy ที่ทำมาเพื่อเดเวลอปเปอร์ รองรับการเขียนสคริปต์ การเชื่อมต่อผ่าน API และความยืดหยุ่นสำหรับงานซับซ้อน งานสเกลใหญ่ และออโตเมชันขั้นสูง

4. เครื่องมือไหนเหมาะกับคนที่ไม่มีประสบการณ์เขียนโค้ด?

Thunderbit, Octoparse, ParseHub, WebHarvy และ Web Scraper Chrome extension เป็นตัวเลือกยอดนิยมสำหรับคนไม่ถนัดเทคนิค เพราะมีอินเทอร์เฟซแบบภาพ เทมเพลตสำเร็จรูป และฟีเจอร์ที่ขับเคลื่อนด้วย AI ทำให้การดึงลิงก์เข้าถึงได้สำหรับทุกคน

5. ควรเลือกเครื่องมือดึงลิงก์ให้เหมาะกับตัวเองอย่างไร?

ให้ดูจากทักษะด้านเทคนิค ปริมาณข้อมูล และรูปแบบการส่งออกที่ต้องการ ถ้าไม่เขียนโค้ดให้เริ่มจาก Thunderbit หรือ Octoparse ส่วนเดเวลอปเปอร์อาจชอบ Scrapy หรือ Puppeteer องค์กรที่ต้องการสเกลใหญ่ควรดู Bright Data หรือ Diffbot และแนะนำให้เริ่มจากการทดลองฟรีเพื่อเช็กว่าอะไรเหมาะสุดกับงานของคุณจริง ๆ