ไตรมาสที่แล้ว ทีมโอเปอเรชันของเราต้องนั่งก็อปปี้-วางข้อมูลคู่แข่งลงสเปรดชีตกันแบบยาว ๆ รวมแล้วกินเวลา 40 ชั่วโมงต่อสัปดาห์ แต่ไตรมาสนี้เหลือแค่ 20 นาทีเอง

อะไรทำให้มันต่างกันได้ขนาดนั้น? คำตอบคือ “เครื่องมือ web scraping อัตโนมัติ” ที่เมื่อก่อนเหมือนเป็นของเล่นเฉพาะนักพัฒนาเท่านั้น แต่ตอนนี้คนเซลส์หรือมาร์เก็ตติ้งทั่วไปก็เซ็ตอัปได้สบาย ๆ ระหว่างพักเที่ยง

ฉันทำงานสาย SaaS กับเครื่องมือออโตเมชันมาหลายปี (และใช่ ฉันเป็นผู้ร่วมก่อตั้ง ) เครื่องมือรุ่นปี 2026 นี่ถือว่าโหดที่สุดเท่าที่เคยเห็นมา—เกิดมาเพื่อ AI โดยตรง ปรับตัวเองได้เวลาเว็บเปลี่ยน และที่สำคัญคือ “ใช้งานได้จริง” สำหรับคนที่ไม่ใช่สายเทคนิค

ด้านล่างคือ 10 เครื่องมือที่ฉันทดลองใช้เอง พร้อมเทียบตามเคสใช้งานและระดับทักษะ

ทำไมเครื่องมือ Web Scraping อัตโนมัติถึงสำคัญสำหรับทีมธุรกิจ

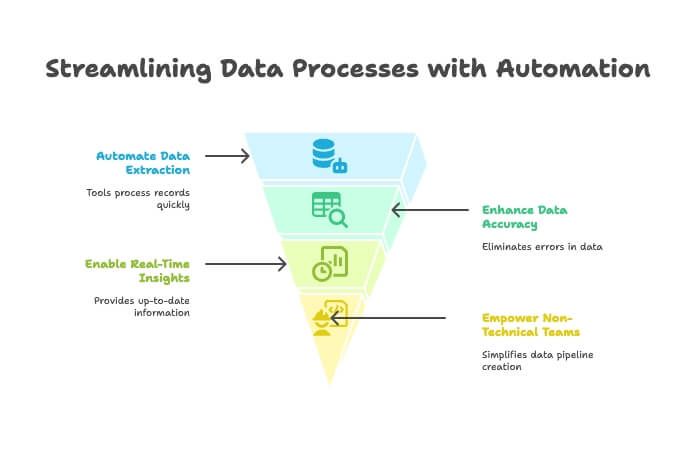

พูดกันแบบไม่อ้อมค้อม ยุคที่ต้องคัดลอก-วางข้อมูลจากเว็บด้วยมือมันจบไปแล้ว (เว้นแต่คุณจะอินกับงานซ้ำ ๆ จนปวดข้อมือและหมดไฟ) วันนี้เครื่องมือ web scraping อัตโนมัติกลายเป็นของจำเป็นสำหรับธุรกิจแทบทุกขนาดไปแล้ว ยิ่งไปกว่านั้นคือ และการทำ web scraping / data scraping คือชิ้นส่วนสำคัญของกลยุทธ์นั้นแบบเลี่ยงไม่ได้

เหตุผลที่เครื่องมือเหล่านี้ “คุ้ม” มาก ๆ:

- ประหยัดเวลา ลดงานมือ: สครัปเปอร์อัตโนมัติประมวลผลข้อมูลเป็นพันเรคคอร์ดได้ในไม่กี่นาที ทำให้ทีมเอาเวลาไปโฟกัสงานที่มีมูลค่าสูงกว่าได้ ผู้ใช้รายหนึ่งบอกว่าประหยัดเวลาได้ “หลายร้อยชั่วโมง” จากการทำให้การเก็บข้อมูลเป็นอัตโนมัติ ().

- ข้อมูลแม่นยำขึ้น: ไม่ต้องกลัวพิมพ์ผิดหรือหลุดรายการ การดึงข้อมูลอัตโนมัติช่วยให้ข้อมูลสะอาดและเชื่อถือได้มากกว่า

- ตัดสินใจได้เร็วขึ้น: มีฟีดข้อมูลแบบเรียลไทม์ไว้เฝ้าดูคู่แข่ง ติดตามราคา หรือสร้างลิสต์ลีดได้ทันที ไม่ต้องรอรายงานรายเดือนจากเด็กฝึกงาน

- ทีมที่ไม่ใช่สายเทคนิคก็ทำได้: ด้วยเครื่องมือแบบ no-code และ AI ต่อให้คนที่คิดว่า “XPath” เป็นท่าโยคะ ก็สร้าง data pipeline จากเว็บได้แล้ว ().

ไม่น่าแปลกใจเลยที่ และเกือบ 80% บอกว่าองค์กรของตนทำงานได้ไม่เต็มประสิทธิภาพถ้าขาดข้อมูลนี้ ในปี 2026 ถ้าคุณยังไม่ทำให้การเก็บข้อมูลเป็นอัตโนมัติ ก็เหมือนปล่อยเงิน—และอินไซต์—หล่นหายไปต่อหน้าต่อตา

เราเลือกเครื่องมือ Web Scraping อัตโนมัติที่ดีที่สุดอย่างไร

ในเมื่อซอฟต์แวร์สาย web scraping ถูกคาดการณ์ว่าจะ การเลือกเครื่องมือให้เหมาะก็เหมือนเดินเข้าร้านรองเท้าที่มีให้เลือกเป็นหมื่นคู่ นี่คือเกณฑ์ที่ฉันใช้คัดมา:

- ใช้งานง่าย: คนที่ไม่ใช่นักพัฒนาจะเริ่มได้เร็วแค่ไหน? ต้องเรียนรู้อะไรเยอะไหม?

- ความสามารถด้าน AI: มี AI ช่วยเดาฟิลด์อัตโนมัติ จัดการเว็บไดนามิก หรือให้พิมพ์ความต้องการเป็นภาษาคนได้หรือเปล่า?

- การส่งออกและการเชื่อมต่อ: เอาข้อมูลไปลง Excel, Google Sheets, Airtable, Notion หรือ CRM ได้ง่ายแค่ไหน?

- ราคา: มีทดลองใช้ฟรีไหม? แพ็กเกจเสียเงินเหมาะกับคนเดี่ยว/ทีมเล็ก หรือเน้นองค์กรเท่านั้น?

- สเกล: ทำงานเล็ก ๆ ครั้งเดียวได้ และทำงานใหญ่แบบตั้งเวลาได้ด้วยไหม?

- กลุ่มผู้ใช้เป้าหมาย: ทำมาเพื่อทีมธุรกิจ นักพัฒนา หรือทั้งสองแบบ?

- จุดเด่นเฉพาะ: อะไรทำให้เครื่องมือนี้ต่างจากคนอื่น?

ฉันใส่เครื่องมือครบทุกระดับ ตั้งแต่ “ขอแค่สเปรดชีต” ไปจนถึง “อยากครอว์ลทั้งอินเทอร์เน็ต” ไปดูรายการกัน

1. Thunderbit: เครื่องมือ Web Scraper ที่ขับเคลื่อนด้วย AI สำหรับทุกคน

ขอเริ่มจากเครื่องมือที่ฉันรู้จักดีที่สุด—เพราะทีมฉันสร้างมันขึ้นมาเพื่อแก้ปัญหาที่ทีมธุรกิจเจอกันมานาน ไม่ใช่สครัปเปอร์แนว “ลากวาง” หรือ “เขียน selector เอง” แบบเดิม ๆ แต่มันคือผู้ช่วยข้อมูลที่ใช้ AI ให้คุณแค่บอกสิ่งที่ต้องการ แล้วระบบไปจัดการงานหนักให้ทั้งหมด—ไม่ต้องเขียนโค้ด ไม่ต้องยุ่งกับ XPath และไม่ต้องปวดหัว

ทำไม Thunderbit ถึงขึ้นอันดับหนึ่ง

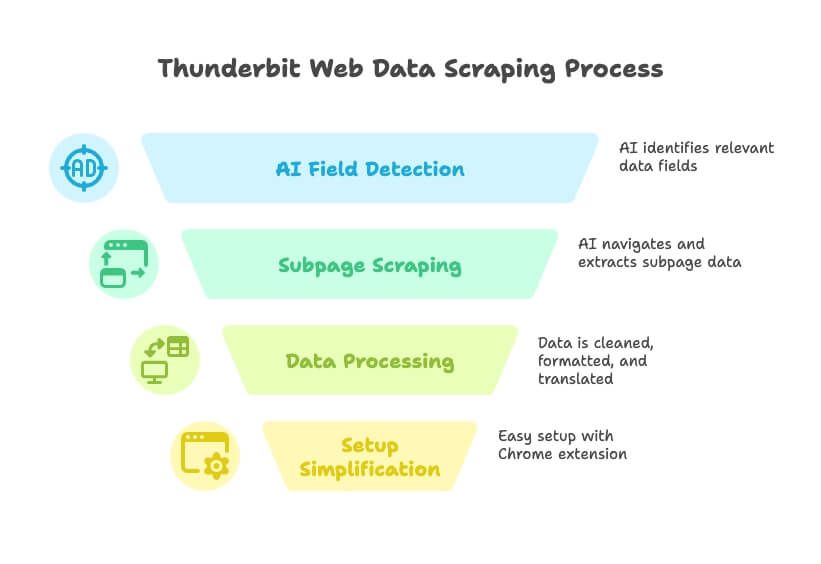

Thunderbit ใกล้เคียงที่สุดกับแนวคิด “เปลี่ยนเว็บไหนก็ได้ให้กลายเป็นฐานข้อมูล” วิธีทำงานคือ:

- สั่งงานด้วยภาษาธรรมชาติ: แค่บอกว่าอยากได้อะไร (เช่น “ขอชื่อบริษัท อีเมล และเบอร์โทรจากไดเรกทอรีนี้”) AI จะหาและจับฟิลด์ที่เกี่ยวข้องให้เอง

- AI Suggest Fields: คลิกครั้งเดียว Thunderbit อ่านหน้าเว็บแล้วเสนอคอลัมน์ที่ควรดึง ลดการเดาและลองผิดลองถูก

- ดึงข้อมูลจากซับเพจ/หลายชั้น: ถ้าต้องเข้าไปหน้ารายละเอียดของแต่ละรายการ Thunderbit คลิกต่อให้ ดึงข้อมูลเพิ่ม แล้วต่อท้ายกลับมาในตาราง

- ทำความสะอาด แปล และจัดหมวดหมู่ข้อมูล: ไม่ได้แค่ดึงดิบ ๆ แต่ช่วยจัดรูปแบบ แปลภาษา และจำแนกประเภทข้อมูลระหว่างดึงได้

- เริ่มใช้งานเร็ว ไม่จุกจิก: ติดตั้ง กด “AI Suggest Fields” แล้วเริ่มดึงข้อมูลได้ภายในไม่ถึงนาที

- ทดลองใช้ฟรีและราคาเข้าถึงง่าย: มีฟรีแบบใจกว้าง (ดึงได้ฟรีสูงสุด 6 หน้า) และแพ็กเกจเริ่มต้นเพียง $9/เดือน ถูกกว่าค่ากาแฟที่ฉันกินในหนึ่งสัปดาห์เสียอีก

Thunderbit ทำมาเพื่อทีมเซลส์ มาร์เก็ตติ้ง และโอเปอเรชันที่ต้องการข้อมูลแบบเร็ว ๆ ไม่ต้องเขียนโค้ด ไม่ต้องลงปลั๊กอินเพิ่ม ไม่ต้องเทรนทีม เหมือนมีเด็กฝึกงานด้านข้อมูลที่ทำงานไว ฟังคำสั่ง และไม่บ่น

ฟีเจอร์เด่นของ Thunderbit

- การดึงข้อมูลด้วย AI: AI เข้าใจโครงสร้างหน้าเว็บ ปรับตัวเมื่อเลย์เอาต์เปลี่ยน และจัดการ pagination กับซับเพจได้อัตโนมัติ ().

- ส่งออกข้อมูลทันที: ส่งไป Excel, Google Sheets, Airtable, Notion หรือดาวน์โหลดเป็น CSV/JSON ได้เลย

- รันบนคลาวด์หรือในเครื่อง: จะรันบนคลาวด์เพื่อความเร็ว/สเกล หรือรันในเบราว์เซอร์เพื่อใช้ล็อกอิน/เซสชันของคุณก็ได้

- Scheduled Scraping: ตั้งงานให้ดึงซ้ำตามรอบเพื่อให้ข้อมูลอัปเดตเสมอ เหมาะกับการติดตามราคา หรืออัปเดตลีดเป็นประจำ

- แทบไม่ต้องดูแล: AI ของ Thunderbit ปรับตามการเปลี่ยนแปลงของเว็บ ทำให้เสียเวลาซ่อมสคริปต์น้อยลง ().

เหมาะกับใคร? คนที่อยากไปจาก “ต้องการข้อมูลนี้” ไปเป็น “นี่คือสเปรดชีตของคุณ” ภายในไม่กี่นาที—โดยเฉพาะผู้ใช้ที่ไม่ใช่สายเทคนิค ด้วย และเรตติ้ง 4.9★ Thunderbit กำลังกลายเป็นตัวเลือกหลักของทีมธุรกิจที่อยากได้ผลลัพธ์ ไม่อยากได้ปัญหา

อยากเห็นการใช้งานจริง? ไปดูได้ที่ หรืออ่านเพิ่มจาก

2. Clay: ผสานการเพิ่มคุณค่าข้อมูล (Enrichment) กับ Web Scraping แบบอัตโนมัติ

Clay เหมือนมีดพกสวิสสำหรับทีม Growth ไม่ได้เป็นแค่ตัวดึงข้อมูลจากเว็บ แต่เป็นสเปรดชีตสายออโตเมชันที่เชื่อมต่อแหล่งข้อมูลสดกว่า 50 แห่ง (เช่น Apollo, LinkedIn, Crunchbase) และมี AI ในตัวเพื่อ enrich ลีด เขียนอีเมล outreach และให้คะแนนโอกาสขาย

- ออโตเมชันเวิร์กโฟลว์: 1 แถว = 1 ลีด, 1 คอลัมน์ = ดึงข้อมูลหรือสั่งแอ็กชันได้ อยากสครัปชื่อบริษัท เติมโปรไฟล์ LinkedIn แล้วส่งอีเมลเฉพาะบุคคล? ทำได้ใน Clay

- ผสาน AI: ใช้ GPT-4 ช่วยเขียนประโยคเปิดบทสนทนา สรุปประวัติ และอื่น ๆ

- การเชื่อมต่อ: ต่อกับ HubSpot, Salesforce, Gmail, Slack และอีกมาก

- ราคา: เริ่มราว ๆ $99/เดือนสำหรับแพ็กเกจโปร มีทดลองใช้ฟรีสำหรับใช้งานเบา ๆ

เหมาะกับ: เซลส์สาย outbound, growth hacker และมาร์เก็ตเตอร์ที่อยากสร้าง lead pipeline แบบปรับแต่งเอง รวมการสครัป + enrichment + outreach ไว้ที่เดียว พลังเยอะ แต่ถ้าเพิ่งเริ่มใช้เครื่องมือออโตเมชันอาจต้องใช้เวลาปรับตัว ().

3. Bardeen: เครื่องมือ Web Scraper บนเบราว์เซอร์เพื่อออโตเมชันเวิร์กโฟลว์

Bardeen เหมือนมีหุ่นยนต์ในเบราว์เซอร์ที่ทั้งดึงข้อมูลและทำงานซ้ำ ๆ บนเว็บให้คุณได้ ผ่าน Chrome extension

- ออโตเมชันแบบ no-code: มี “Playbooks” มากกว่า 500 แบบ สำหรับสครัปข้อมูล กรอกฟอร์ม ย้ายข้อมูลข้ามแอป ฯลฯ

- AI Command Builder: พิมพ์งานที่ต้องการเป็นภาษาคน แล้ว Bardeen สร้างเวิร์กโฟลว์ให้

- การเชื่อมต่อ: ใช้กับ Notion, Trello, Slack, Salesforce และอีก 100+ แอป

- ราคา: ฟรีสำหรับใช้งานเบา ๆ (100 เครดิต/เดือน) แพ็กเกจทีมเริ่มที่ $99/เดือน

เหมาะกับ: ผู้ใช้สาย power user และทีม go-to-market ที่อยากทำให้การสครัปและแอ็กชันต่อเนื่องในหลายแอปเป็นอัตโนมัติ ยืดหยุ่นมาก แต่ผู้เริ่มต้นอาจรู้สึกว่าต้องเรียนรู้พอสมควร ().

4. Bright Data: เครื่องมือ Web Scraping อัตโนมัติระดับองค์กร

Bright Data (เดิมชื่อ Luminati) คือเครื่องจักรหนักของวงการ web scraping—มีเครือข่ายพร็อกซีทั่วโลก API ขั้นสูง และความสามารถในการครอว์ลได้เป็นพันหน้า/วัน

- สเกลระดับองค์กร: มี IP มากกว่า 100 ล้าน, Web Scraper IDE และ Web Unlocker สำหรับหลบระบบกันบอท

- ปรับแต่งได้สูง: สร้างงานดึงข้อมูลที่ซับซ้อนและขนาดใหญ่ได้อย่างเสถียร

- ราคา: Web Scraper IDE เริ่มที่ $499/เดือน และมีแพ็กเกจเล็กแบบ “micro” ให้เลือก

เหมาะกับ: องค์กรใหญ่ ผู้รวมข้อมูล (data aggregator) และผู้ใช้ขั้นสูงที่ต้องการโซลูชันที่ทนและสเกลได้จริง ถ้าคุณต้องครอว์ลวันละหลายพันหน้าและต้องหลบการบล็อก IP Bright Data ถูกสร้างมาเพื่อสิ่งนี้ ().

5. Octoparse: เครื่องมือ Web Scraper แบบภาพสำหรับผู้ใช้ระดับกลาง

Octoparse เป็นเครื่องมือ no-code ยอดนิยมที่มีหน้าตาแบบคลิกเลือก (point-and-click) เหมาะกับคนที่อยากได้พลังโดยไม่ต้องเขียนโปรแกรม

- UI แบบลากวาง: คลิกองค์ประกอบเพื่อกำหนดว่าจะดึงอะไร จัดการล็อกอิน pagination และอื่น ๆ ได้

- เทมเพลต: มีเทมเพลตสำเร็จรูป 500+ สำหรับเว็บยอดนิยม (Amazon, Twitter ฯลฯ)

- Cloud Scraping: รันงานบนเซิร์ฟเวอร์ของ Octoparse ตั้งเวลา และใช้การหมุน IP ได้

- ราคา: มีแพ็กเกจฟรีแบบจำกัด แพ็กเกจเสียเงินเริ่มที่ $119/เดือน

เหมาะกับ: คนไม่เขียนโค้ดและนักวิเคราะห์ข้อมูลที่อยากได้สครัปเปอร์ที่ทำงานได้จริงโดยไม่ต้องเขียนโปรแกรม เหมาะกับติดตามราคา รายการสินค้า และงานรีเสิร์ช ().

6. : แพลตฟอร์มดึงข้อมูลสำหรับธุรกิจ

เป็นหนึ่งในรุ่นบุกเบิกของวงการ web scraping และพัฒนามาเป็นแพลตฟอร์มดึงข้อมูลแบบครบเครื่อง

- ดึงข้อมูลแบบคลิกเลือก: รองรับล็อกอิน ดรอปดาวน์ และองค์ประกอบแบบอินเทอร์แอคทีฟ

- ทำงานบนคลาวด์: ประมวลผล URL จำนวนมากพร้อมกัน ตั้งเวลา และเข้าถึงผ่าน API

- โฟกัสองค์กร: ใช้กับงานติดตามราคา รีเสิร์ชตลาด และสร้างชุดข้อมูลสำหรับแมชชีนเลิร์นนิง

- ราคา: Starter $199/เดือน, Standard $599/เดือน, Advanced $1,099/เดือน

เหมาะกับ: องค์กรระดับกลางถึงใหญ่และทีมข้อมูลที่ต้องการโซลูชันที่เสถียรและมีการดูแล เหมาะกับงานใหญ่ ๆ มากกว่างานเล่น ๆ แต่ถ้าเป็นงานระดับธุรกิจถือว่าแรงมาก ().

7. Parsehub: เครื่องมือ Web Scraper ที่ยืดหยุ่นพร้อมตัวแก้ไขแบบภาพ

Parsehub เป็นแอปเดสก์ท็อป (Windows, Mac, Linux) ที่ให้คุณสร้างสครัปเปอร์ด้วยการคลิกไล่ไปตามหน้าเว็บ

- เวิร์กโฟลว์แบบภาพ: เลือกองค์ประกอบ ตั้งกฎการดึงข้อมูล และจัดการล็อกอิน ดรอปดาวน์ และ infinite scroll

- ฟีเจอร์คลาวด์: รันบนคลาวด์ ตั้งเวลา และใช้ API ได้

- ราคา: มีฟรีสำหรับงานเล็ก แพ็กเกจเสียเงินเริ่มที่ $149/เดือน

เหมาะกับ: นักวิจัย ธุรกิจขนาดเล็ก หรือบุคคลทั่วไปที่อยากควบคุมได้มากกว่า extension แต่ยังไม่อยากเขียนโค้ดเอง ().

8. Common Crawl: ข้อมูลเว็บแบบเปิดสำหรับ AI และงานวิจัย

Common Crawl ไม่ใช่ “เครื่องมือ” แบบทั่วไป แต่มันคือชุดข้อมูลขนาดมหึมาจากการครอว์ลเว็บแบบเปิด อัปเดตรายเดือน

- สเกล: ข้อมูลเว็บราว ~400 TB ครอบคลุมหน้าเว็บนับพันล้านหน้า

- ฟรีและเปิด: ไม่ต้องรันครอว์เลอร์เอง

- ต้องมีทักษะเทคนิค: ต้องใช้เครื่องมือ big data และทักษะวิศวกรรมเพื่อกรองและพาร์สข้อมูล

เหมาะกับ: นักวิทยาศาสตร์ข้อมูลและวิศวกรที่สร้างโมเดล AI หรือทำวิจัยระดับใหญ่ ถ้าต้องการข้อความเว็บทั่วไปหรืออาร์ไคฟ์ระยะยาว นี่คือเหมืองทอง ().

9. Crawly: เครื่องมือ Web Scraping อัตโนมัติขนาดเบาสำหรับสตาร์ทอัป

Crawly (โดย Diffbot) คือครอว์เลอร์บนคลาวด์ที่ขับเคลื่อนด้วย AI สามารถเก็บข้อมูลจากเว็บไซต์นับล้านและคืนผลลัพธ์แบบมีโครงสร้าง—ไม่ต้องเขียนกฎพาร์ส

- การดึงข้อมูลด้วย AI: ใช้ machine vision และ NLP เพื่อระบุและดึงคอนเทนต์

- เข้าถึงผ่าน API: คิวรีข้อมูลที่เก็บไว้และเชื่อมต่อกับ analytics หรือฐานข้อมูลได้

- ราคา: ระดับองค์กร ต้องติดต่อเพื่อขอราคา

เหมาะกับ: สตาร์ทอัปและทีมที่มีทักษะเทคนิคพอสมควร ที่ต้องการดึงข้อมูลเว็บขนาดใหญ่แบบฉลาด โดยไม่ต้องสร้างสครัปเปอร์เอง ().

10. Apify: เครื่องมือ Web Scraper ที่เป็นมิตรกับนักพัฒนา พร้อม Marketplace

Apify เป็นแพลตฟอร์มคลาวด์ที่ให้คุณสร้างสครัปเปอร์เอง (“Actors”) หรือเลือกใช้สครัปเปอร์สำเร็จรูปจากชุมชน

- ยืดหยุ่นสำหรับนักพัฒนา: รองรับการสครัปด้วย JavaScript/Python, headless Chrome, จัดการพร็อกซี และตั้งเวลา

- Marketplace: มีคลังสครัปเปอร์สำเร็จรูปจำนวนมากสำหรับเว็บยอดนิยม

- ราคา: มีฟรีพร้อมเครดิต $5/เดือน แพ็กเกจเสียเงินเริ่มที่ $49/เดือน

เหมาะกับ: นักพัฒนาและนักวิเคราะห์สายเทคนิคที่ต้องการควบคุมเต็มรูปแบบและสเกลได้ดี แม้คนไม่เขียนโค้ดก็ใช้ Actors สำเร็จรูปสำหรับงานทั่วไปได้ ().

ตารางเปรียบเทียบเครื่องมือ Web Scraping อัตโนมัติ

| Tool | Ease of Use | AI Features | Pricing (Starting) | Target User | Unique Strengths |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | ภาษาธรรมชาติ, AI Suggest Fields, ดึงข้อมูลซับเพจ | $9/mo | ผู้ใช้ธุรกิจที่ไม่ใช่สายเทคนิค | เซ็ตอัป 2 คลิก, ไม่ต้องเขียนโค้ด, ส่งออกทันที, มีทดลองใช้ฟรี |

| Clay | ★★★★☆ | enrichment ด้วย AI, GPT-4 | $99/mo | ทีม Growth/เซลส์โอเปอเรชัน | สเปรดชีตออโตเมชัน, enrichment, outreach |

| Bardeen | ★★★★☆ | ตัวสร้างคำสั่งด้วย AI | $99/mo | Power users, ทีม GTM | RPA บนเบราว์เซอร์, 500+ playbooks, อินทิเกรชันลึก |

| Bright Data | ★★☆☆☆ | หมุนพร็อกซี, AI กันบอท | $499/mo | องค์กร, นักพัฒนา | สเกล, เสถียร, พร็อกซีทั่วโลก |

| Octoparse | ★★★★☆ | ตรวจจับด้วย AI แบบภาพ | $119/mo | นักวิเคราะห์, คนไม่เขียนโค้ด | ลากวาง, เทมเพลต, cloud scraping |

| Import.io | ★★★☆☆ | ตัวดึงข้อมูลแบบอินเทอร์แอคทีฟ | $199/mo | องค์กร, ทีมข้อมูล | ทำงานพร้อมกันจำนวนมาก, ตั้งเวลา, API, ซัพพอร์ต |

| Parsehub | ★★★★☆ | เวิร์กโฟลว์แบบภาพ | $149/mo | นักวิจัย, SMBs | แอปเดสก์ท็อป, จัดการเว็บไดนามิกได้ |

| Common Crawl | ★☆☆☆☆ | N/A (เป็นชุดข้อมูลเท่านั้น) | Free | นักวิทยาศาสตร์ข้อมูล, วิศวกร | ชุดข้อมูลเปิดขนาดมหึมา, อาร์ไคฟ์ระดับเว็บ |

| Crawly | ★★☆☆☆ | ดึงข้อมูลด้วย AI | Custom/Enterprise | สตาร์ทอัป, ทีมเทคนิค | AI-powered, ไม่ต้องเขียนกฎพาร์ส, ใช้ API ได้ |

| Apify | ★★★★☆ | Marketplace ของ Actors | $49/mo | นักพัฒนา, นักวิเคราะห์สายเทคนิค | สร้างเอง/ใช้จากตลาด, ออโตเมชันบนคลาวด์, ยืดหยุ่น |

เลือกเครื่องมือ Web Scraper ให้เหมาะกับงานของคุณอย่างไร

การเลือกเครื่องมือ web scraping อัตโนมัติที่ “ใช่ที่สุด” มันขึ้นอยู่กับขนาดทีม สกิลเทคนิค และเป้าหมายธุรกิจของคุณเป็นหลัก นี่คือไกด์แบบเร็วของฉัน:

- สำหรับผู้ใช้ที่ไม่ใช่สายเทคนิค (เซลส์/มาร์เก็ตติ้ง/โอเปอเรชัน): เลือก ได้เลย ทำมาเพื่อคุณ—ไม่ต้องเขียนโค้ด ไม่ต้องเซ็ตอัปให้ยุ่งยาก เน้นผลลัพธ์ เหมาะกับทำลีด ติดตามราคา และโปรเจกต์ข้อมูลแบบเร่งด่วน

- สำหรับทีมที่คลั่งออโตเมชัน: Clay และ Bardeen เด่นมากถ้าคุณอยากผสานการสครัปเข้ากับ enrichment, outreach หรือเวิร์กโฟลว์ออโตเมชัน

- สำหรับองค์กรและนักพัฒนา: Bright Data, และ Apify เหมาะกับงานใหญ่ ปรับแต่งสูง และต้องการสเกล

- สำหรับนักวิจัยและนักวิเคราะห์: Octoparse และ Parsehub ให้หน้าตาแบบภาพและฟีเจอร์แรง โดยไม่ต้องเขียนโค้ด

- สำหรับโปรเจกต์ AI และ Data Science: Common Crawl และ Crawly ให้ทั้งชุดข้อมูลขนาดใหญ่และการดึงข้อมูลด้วย AI สำหรับคนที่อยากสร้าง/เทรนโมเดล

ลองถามตัวเองว่า: คุณอยากเริ่มภายในไม่กี่นาที หรือคุณต้องการโซลูชันแบบองค์กรที่ปรับแต่งได้ลึก? ถ้ายังไม่แน่ใจ เริ่มจากทดลองใช้ฟรีก่อน—เครื่องมือส่วนใหญ่มีให้ลอง

คุณค่าที่แตกต่างของ Thunderbit: ผู้ช่วย AI สำหรับข้อมูลธุรกิจ

เมื่อเทียบกับเครื่องมือทั้งหมด Thunderbit เด่นตรงที่เป็น “ผู้ช่วย AI” สำหรับการสครัปและแปลงข้อมูลแบบจริงจัง ไม่ใช่แค่ดึงข้อมูล แต่ช่วยเปลี่ยนเว็บที่รก ๆ ให้กลายเป็นอินไซต์ที่เป็นระเบียบ โดยแทบไม่ต้องมีด่านเทคนิคมากั้น

- อินเทอร์เฟซภาษาธรรมชาติ: บอกความต้องการเป็นภาษาคน แล้ว Thunderbit จัดการให้

- ออโตเมชันครบทั้งกระบวนการ: ตั้งแต่ดึงข้อมูล ทำความสะอาด แปล จนส่งออก Thunderbit ครบจบในตัว

- เหมาะกับการทดลองเร็ว: อยากเช็กตลาดใหม่ สร้างลิสต์ลีด หรือเฝ้าดูคู่แข่ง? Thunderbit คือจุดเริ่มที่เร็วและคุ้มที่สุด

มันเหมือนมีนักวิเคราะห์ข้อมูลอยู่ในเบราว์เซอร์—ที่ไม่เคยขอขึ้นเงินเดือนและไม่ลาพักร้อน

สรุป: เริ่มให้ฉลาดขึ้นด้วยเครื่องมือ Web Scraping อัตโนมัติที่ใช่

โลกของการสครัปในปี 2026 เปลี่ยนไปจนแทบจำไม่ได้จากสองปีก่อน สครัปเปอร์ AI ที่ซ่อมตัวเองได้ pipeline ที่เกิดมาเพื่อ LLM และเครื่องมือ no-code ที่ใช้งานได้จริง ทำให้เกมเปลี่ยนไปหมด ไม่ว่าคุณจะเป็นผู้ก่อตั้งเดี่ยว ทีมเซลส์ขนาดเล็กที่คล่องตัว หรือ data scientist ในองค์กรใหญ่ ก็มีเครื่องมือในลิสต์นี้ที่เหมาะกับคุณ กุญแจคือเลือกแพลตฟอร์มให้เข้ากับเวิร์กโฟลว์และทักษะของทีม เพื่อหยุดเสียเวลากับโค้ด แล้วเริ่มปลดล็อกอินไซต์

ถ้าคุณพร้อมเลิกก็อปปี้-วางแบบเดิม ๆ และอยากเริ่มแบบฉลาดขึ้น แล้วจะเห็นว่า web scraping ง่ายได้แค่ไหน หรือจะเลือกตัวเลือกอื่นด้านบนตามเป้าหมายของคุณก็ได้ ไม่ว่าจะทางไหน อนาคตของธุรกิจที่ขับเคลื่อนด้วยข้อมูลจะเป็นของคนที่ทำงานแบบอัตโนมัติ

อยากเรียนรู้เพิ่ม? ไปที่ มีบทความเชิงลึก ทิวทอเรียล และทิปส์สำหรับดึงประโยชน์สูงสุดจากข้อมูลเว็บของคุณ ขอให้สครัปสนุก—และขอให้ข้อมูลสะอาด สครัปเปอร์ไม่พัง (แต่ถ้าพัง ก็ให้ AI จัดการ)

FAQs

1. ทำไมเครื่องมือ Web Scraping อัตโนมัติถึงสำคัญสำหรับผู้ใช้ธุรกิจในปี 2026?

เครื่องมือ web scraping อัตโนมัติช่วยทำให้การเก็บข้อมูลเป็นระบบ ประหยัดเวลา และลดงานมือ เพิ่มความแม่นยำของข้อมูล สนับสนุนการตัดสินใจแบบเรียลไทม์ และทำให้ทีมที่ไม่ใช่สายเทคนิคสามารถดึงและใช้ข้อมูลจากเว็บได้โดยไม่ต้องเขียนโค้ด ปัจจุบันเครื่องมือเหล่านี้สำคัญมากสำหรับงานเซลส์ มาร์เก็ตติ้ง และโอเปอเรชัน

2. อะไรทำให้ Thunderbit แตกต่างจากเครื่องมือ Web Scraping อื่น ๆ?

Thunderbit ใช้ AI ให้ผู้ใช้บอกสิ่งที่ต้องการเป็นภาษาอังกฤษแบบธรรมดา ระบบจะตรวจจับฟิลด์อัตโนมัติ จัดการซับเพจและ pagination และส่งออกผลลัพธ์ไปยังแพลตฟอร์มอย่าง Excel และ Airtable ได้ทันที ออกแบบมาเพื่อผู้ใช้ที่ไม่ใช่สายเทคนิค และมีฟีเจอร์อย่างการทำความสะอาดข้อมูลและ Scheduled Scraping ในราคาที่เข้าถึงง่าย

3. เครื่องมือไหนเหมาะที่สุดสำหรับโปรเจกต์สครัปขนาดใหญ่ระดับองค์กร?

Bright Data และ เหมาะกับงานระดับองค์กร เพราะมีฟีเจอร์อย่างการหมุนพร็อกซี มาตรการกันบอท การประมวลผลพร้อมกันจำนวนมาก และการเข้าถึงผ่าน API เหมาะสำหรับองค์กรที่ต้องประมวลผลหน้าเว็บจำนวนมากอย่างเสถียรและสเกลได้

4. มีเครื่องมือที่รวมการสครัปเข้ากับออโตเมชันและ outreach ไหม?

มี เช่น Clay และ Bardeen ที่ไม่ได้แค่ดึงข้อมูล แต่ยังเชื่อมเข้ากับเวิร์กโฟลว์ได้ Clay ช่วย enrich ลีดและทำ outreach อัตโนมัติ ส่วน Bardeen ช่วยทำงานบนเบราว์เซอร์และเวิร์กโฟลว์ต่าง ๆ ด้วย playbooks ที่ขับเคลื่อนด้วย AI

5. ตัวเลือกที่ดีที่สุดสำหรับผู้ใช้ที่ไม่มีพื้นฐานเทคนิคคืออะไร?

Thunderbit เด่นที่สุดสำหรับผู้ใช้ที่ไม่ใช่สายเทคนิค ด้วยอินเทอร์เฟซภาษาธรรมชาติ การตั้งค่าด้วย AI และความง่ายในการใช้งาน ไม่ต้องเขียนโค้ดหรือเซ็ตอัปซับซ้อน เหมาะกับผู้ใช้ธุรกิจที่ต้องการข้อมูลเร็วและเชื่อถือได้โดยไม่ต้องเจอความยุ่งยากทางเทคนิค