Em 2025, dados extraídos da web deixaram de ser apenas um diferencial e viraram o combustível das estratégias de qualquer negócio. De grandes players do e-commerce que monitoram preços dos concorrentes em tempo real até times de vendas que abastecem seus funis com leads fresquinhos, as empresas tratam dados públicos da web como se fossem ouro digital. E não é exagero: quase , e mais de . Apesar do Python estar em alta, — principalmente em ambientes corporativos, onde confiabilidade e integração são fundamentais.

Com anos de experiência em SaaS e automação, já vi de perto como o raspador web em Java pode revolucionar operações de negócios. Mas também já presenciei equipes empacadas em códigos complexos ou sofrendo com sites dinâmicos e bloqueios anti-bot. Por isso, preparei este guia prático e direto ao ponto para você dominar a raspagem web em Java em 2025, com um olhar especial para integração com ferramentas modernas de IA como o . Seja você dev, gestor de operações ou alguém de negócios que só quer os dados sem dor de cabeça, este guia é pra você.

Com anos de experiência em SaaS e automação, já vi de perto como o raspador web em Java pode revolucionar operações de negócios. Mas também já presenciei equipes empacadas em códigos complexos ou sofrendo com sites dinâmicos e bloqueios anti-bot. Por isso, preparei este guia prático e direto ao ponto para você dominar a raspagem web em Java em 2025, com um olhar especial para integração com ferramentas modernas de IA como o . Seja você dev, gestor de operações ou alguém de negócios que só quer os dados sem dor de cabeça, este guia é pra você.

O que é Raspagem Web em Java? Explicando de um Jeito Fácil

Vamos simplificar: raspagem web em Java é usar código Java para extrair informações automaticamente de sites. Imagine um estagiário virtual super-rápido, capaz de ler milhares de páginas e copiar exatamente os dados que você precisa para uma planilha — só que esse estagiário nunca cansa, não erra e trabalha na velocidade da sua internet.

O processo, na prática, é assim:

- Faz uma requisição ao site (como se estivesse acessando pelo navegador).

- Baixa o HTML da página (o código bruto).

- Interpreta esse HTML em uma estrutura que o programa entende.

- Extrai os dados que você quer (nomes de produtos, preços, e-mails, etc).

- Salva os resultados em um formato útil — CSV, Excel, banco de dados ou até Google Sheets.

Não precisa ser programador avançado pra entender o básico. Com as ferramentas certas e um pouco de orientação, até quem é de negócios consegue automatizar a coleta de dados e transformar páginas bagunçadas em insights valiosos.

Por que a Raspagem Web em Java é Essencial para Empresas em 2025

Raspagem web não é só passatempo de dev — virou necessidade estratégica. Veja como empresas estão usando Java para sair na frente e colher resultados de verdade:

| Caso de Uso da Raspagem Web | Benefícios para o Negócio (ROI) | Setores de Exemplo |

|---|---|---|

| Monitoramento de Preços de Concorrentes | Inteligência de preços em tempo real; aumento de vendas de 20%+ ao reagir rapidamente ao mercado | E-commerce, Varejo |

| Geração de Leads & Inteligência de Vendas | Listas de prospects atualizadas automaticamente; redução de 70% no tempo de pesquisa manual | Vendas B2B, Marketing, Recrutamento |

| Pesquisa de Mercado & Análise de Tendências | Detecção antecipada de tendências; aumento de 5–15% na receita e 10–20% mais ROI em marketing | Produtos de Consumo, Agências de Marketing |

| Dados Financeiros & de Investimento | Dados alternativos para trading; mercado de US$ 5 bilhões para “alt-data” extraída da web | Finanças, Hedge Funds, Fintech |

| Automação & Monitoramento de Processos | Coleta rotineira de dados automatizada; economia de 73% nos custos e 85% mais agilidade na entrega | Imobiliário, Supply Chain, Governo |

()

Por que Java? Porque ele nasceu pra escala, confiabilidade e integração. Muitos pipelines de dados corporativos já rodam em Java, então adicionar um raspador web é natural. Fora que o multithreading e o tratamento de erros do Java fazem dele a escolha ideal pra grandes volumes — pense em milhares de páginas por dia, não só algumas.

Como Funciona a Raspagem Web em Java? Princípios e Pontos Fortes

Vamos destrinchar como um raspador web típico em Java trabalha:

- Requisições HTTP: Java usa bibliotecas como JSoup ou Apache HttpClient pra buscar páginas. Dá pra configurar headers, usar proxies e simular navegadores reais pra evitar bloqueios.

- Interpretação de HTML: Com JSoup, o HTML vira uma árvore (DOM), facilitando encontrar os dados com seletores CSS.

- Extração de Dados: Você define as regras (tipo “pegue todos os

<span class='price'>”) pra capturar o que interessa. - Armazenamento dos Dados: Salve tudo em CSV, Excel, JSON ou banco de dados.

O que Torna o Java Especial para Raspagem Web?

- Multithreading: Java consegue buscar e processar várias páginas ao mesmo tempo, acelerando raspagens em larga escala. O GIL do Python limita isso, mas as threads do Java são rápidas e eficientes.

- Performance: Por ser compilado, Java aguenta tarefas pesadas e uso intenso de memória numa boa.

- Integração Corporativa: Raspadores em Java se conectam fácil a sistemas já existentes — CRMs, ERPs, bancos de dados — sem gambiarra.

- Tratamento de Erros: O sistema de tipos e exceções do Java deixa os raspadores mais robustos e fáceis de manter em projetos longos.

Se você precisa de um pipeline de dados confiável e escalável, Java é difícil de bater.

Principais Bibliotecas e Frameworks de Raspagem Web em Java: O Que Usar?

Existem várias bibliotecas Java pra raspagem web, mas três se destacam: JSoup, HtmlUnit e Selenium. Veja o comparativo:

| Biblioteca | Suporta JavaScript? | Facilidade de Uso | Performance | Melhor Para |

|---|---|---|---|---|

| JSoup | ❌ (Não) | Muito fácil | Alta | Páginas estáticas, tarefas rápidas, leve |

| HtmlUnit | ⚠️ Parcial | Moderada | Média | JS simples, formulários, raspagem headless |

| Selenium | ✅ Sim (Completo) | Moderada/Difícil | Menor (por página) | Sites JS pesados, páginas interativas/dinâmicas |

()

JSoup: O Queridinho para HTML Simples

é minha escolha número um pra maioria das tarefas. É leve, fácil de usar e perfeito pra páginas estáticas onde os dados estão no HTML.

Exemplo:

1Document doc = Jsoup.connect("https://www.scrapingcourse.com/ecommerce/").get();

2String bannerTitle = doc.select("div.site-title").text();

3System.out.println("Banner: " + bannerTitle);Simples assim. Se você precisa raspar posts de blog, listas de produtos ou diretórios sem JavaScript, JSoup resolve.

HtmlUnit: Simulando Navegador para Tarefas Mais Complexas

é um navegador headless em Java. Ele lida com algum JavaScript, preenche formulários e clica em botões — tudo sem abrir janela de verdade.

Quando usar: Se precisa logar em um site ou lidar com conteúdo dinâmico básico, mas não quer a complexidade do Selenium.

Exemplo:

1WebClient webClient = new WebClient();

2HtmlPage page = webClient.getPage("https://example.com/login");

3// ... preenche o formulário e envia ...Selenium: Para Páginas Interativas e Cheias de JavaScript

é o mais robusto. Ele controla um navegador real (Chrome, Firefox), então consegue lidar com qualquer site — inclusive os totalmente em JavaScript.

Quando usar: Pra raspar web apps modernos, sites com scroll infinito ou qualquer página que exija interação como um usuário.

Exemplo:

1WebDriver driver = new ChromeDriver();

2driver.get("https://www.scrapingcourse.com/ecommerce/");

3List<WebElement> products = driver.findElements(By.cssSelector("li.product"));

4// ... extrai os dados ...

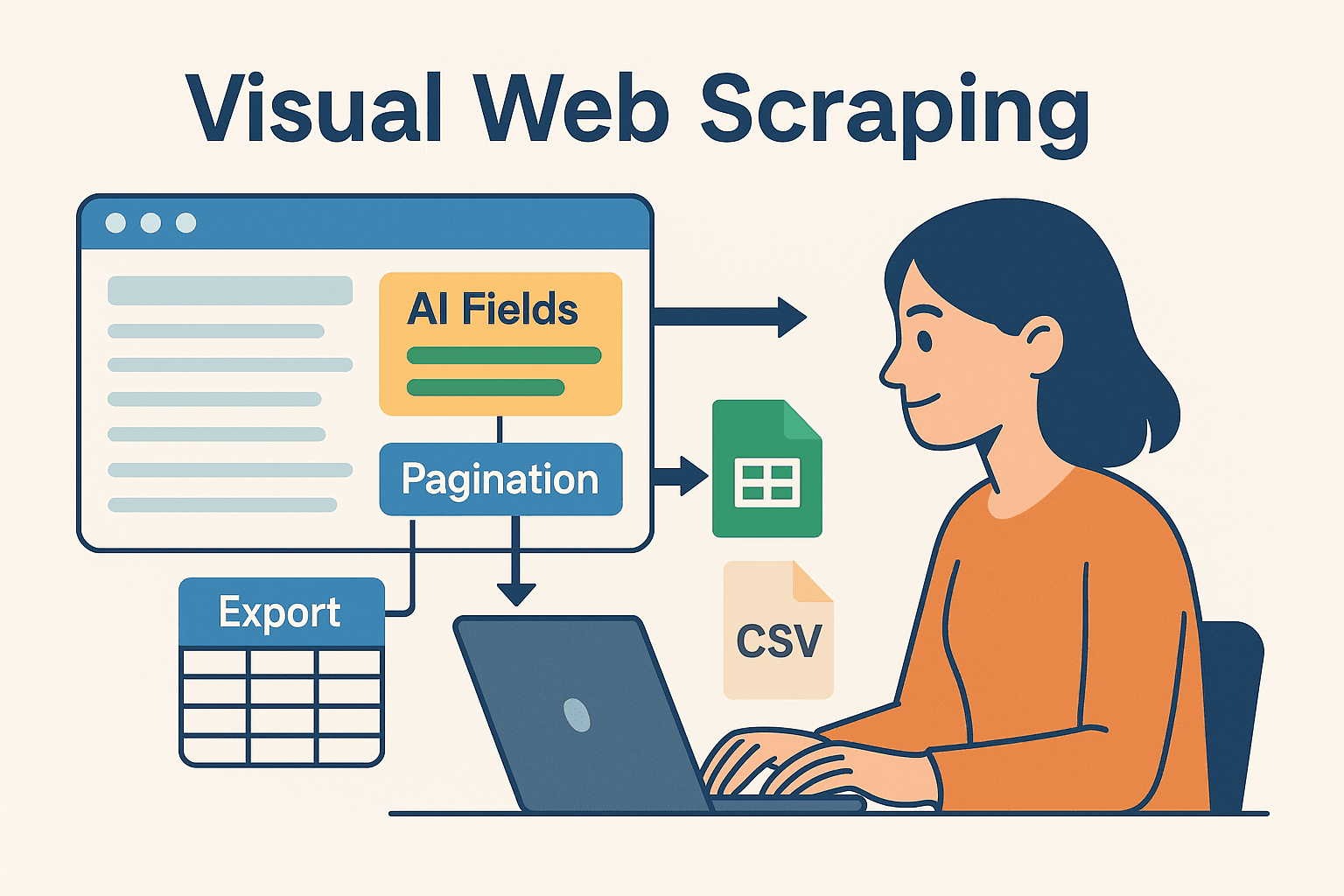

5driver.quit();Potencialize a Raspagem Web em Java com Thunderbit: Automação Visual + Código

Agora a coisa fica ainda mais interessante — principalmente pra equipes e usuários de negócios que não querem viver no código. O é um raspador web IA, sem código, que permite definir tarefas visualmente (direto no navegador) e exportar os dados pra Excel, Google Sheets, Airtable ou Notion.

Por que Usar Thunderbit com Java?

- Campos Sugeridos por IA: O “AI Suggest Fields” do Thunderbit lê a página e recomenda exatamente o que extrair — sem precisar fuçar no HTML ou criar seletores.

- Raspagem de Subpáginas: Precisa de mais detalhes? O Thunderbit pode visitar subpáginas automaticamente (tipo páginas de produto) e enriquecer seu dataset.

- Modelos Prontos: Pra sites populares (Amazon, Zillow, LinkedIn), o Thunderbit já tem templates prontos — é só clicar.

- Exportação Fácil: Depois de raspar, exporte os dados em segundos — prontos pra seu código Java processar, analisar ou integrar.

Thunderbit economiza tempo na prototipagem, lida com sites complexos e permite que não-programadores consigam os dados que precisam. Pra devs, é uma ótima forma de automatizar as partes repetitivas ou frágeis da raspagem, focando no que realmente importa.

Combinando Thunderbit e Java em Projetos Avançados

Veja um fluxo de trabalho eficiente:

- Prototipe com Thunderbit: Use a extensão do Chrome pra configurar a raspagem visualmente. Deixe a IA sugerir campos, paginar e exportar pra Google Sheets ou CSV.

- Processe em Java: Escreva código Java pra ler os dados exportados (Sheets, CSV ou Airtable) e fazer pós-processamento, análises ou integração com sistemas corporativos.

- Automatize e Agende: Use o agendador do Thunderbit pra manter os dados atualizados e faça seu pipeline Java buscar os arquivos mais recentes automaticamente.

Essa abordagem híbrida junta o melhor dos dois mundos: a velocidade e flexibilidade da raspagem IA sem código, com o poder e confiabilidade do Java pra processar depois.

Essa abordagem híbrida junta o melhor dos dois mundos: a velocidade e flexibilidade da raspagem IA sem código, com o poder e confiabilidade do Java pra processar depois.

Passo a Passo: Criando Seu Primeiro Raspador Web em Java

Vamos pra prática. Veja como montar um raspador web simples em Java do zero.

Preparando o Ambiente Java

- Instale o Java (JDK): Use Java 17 ou 21 pra garantir compatibilidade.

- Configure o Maven: Ele gerencia as dependências do projeto.

- Escolha uma IDE: IntelliJ IDEA, Eclipse ou VSCode são ótimas opções.

- Adicione o JSoup ao seu

pom.xml:1<dependency> 2 <groupId>org.jsoup</groupId> 3 <artifactId>jsoup</artifactId> 4 <version>1.16.1</version> 5</dependency>

Escrevendo e Rodando o Raspador

Vamos raspar nomes e preços de produtos de um site de e-commerce de demonstração.

1import org.jsoup.Jsoup;

2import org.jsoup.nodes.Document;

3import org.jsoup.select.Elements;

4import org.jsoup.nodes.Element;

5public class ProductScraper {

6 public static void main(String[] args) {

7 String url = "https://www.scrapingcourse.com/ecommerce/";

8 try {

9 Document doc = Jsoup.connect(url)

10 .userAgent("Mozilla/5.0")

11 .get();

12 Elements productElements = doc.select("li.product");

13 for (Element productEl : productElements) {

14 String name = productEl.selectFirst("h2").text();

15 String price = productEl.selectFirst("span.price").text();

16 System.out.println(name + " -> " + price);

17 }

18 } catch (Exception e) {

19 e.printStackTrace();

20 }

21 }

22}Dica: Sempre defina um user-agent pra simular um navegador real. Alguns sites bloqueiam o user-agent padrão do Java.

Exportando e Usando os Dados

- Exportação CSV: Use

FileWriterou uma biblioteca como OpenCSV pra gravar os resultados em um arquivo CSV. - Exportação para Excel: Utilize Apache POI pra arquivos .xls/.xlsx.

- Integração com Banco de Dados: Use JDBC pra inserir dados direto no banco.

- Google Sheets: Exporte do Thunderbit e leia com a API do Google Sheets pra Java.

Como Superar os Principais Desafios da Raspagem Web em Java

Raspagem web não é só alegria. Veja os problemas mais comuns — e como driblar cada um:

- Bloqueio de IP & Limite de Requisições: Diminua a velocidade dos acessos (

Thread.sleep()), use proxies rotativos e varie os intervalos. Pra grandes volumes, use serviços de proxy. - CAPTCHAs & Detecção de Bots: Use Selenium pra simular comportamento humano ou serviços anti-bot. Às vezes, a raspagem em nuvem do Thunderbit resolve esses obstáculos.

- Conteúdo Dinâmico: Se o JSoup retorna vazio, provavelmente os dados são carregados via JavaScript. Use Selenium ou HtmlUnit, ou tente identificar a API do site.

- Mudanças na Estrutura do Site: Escreva código flexível com seletores adaptáveis. Monitore seus raspadores e esteja pronto pra atualizar. O Thunderbit, com IA, se adapta rápido — só rodar de novo o “AI Suggest Fields”.

- Gerenciamento de Sessão: Pra raspar páginas autenticadas, gerencie cookies e sessões com cuidado. Selenium e Thunderbit (quando logado no Chrome) lidam bem com páginas protegidas.

Dicas Avançadas pra Turbinar a Raspagem Web em Java

Quer ir além? Olha só algumas estratégias de quem já joga no modo avançado:

- Multithreading: Use o

ExecutorServicedo Java pra raspar várias páginas em paralelo. Só não exagere pra não ser bloqueado! - Agendamento: Use o Quartz Scheduler em Java ou deixe o Thunderbit agendar na nuvem com linguagem natural (“toda segunda às 9h”).

- Escalabilidade em Nuvem: Pra grandes volumes, rode navegadores headless na nuvem ou distribua tarefas entre várias máquinas.

- Fluxos Híbridos: Use Thunderbit pra sites complexos e código Java pro resto. Una os resultados no seu data warehouse.

- Monitoramento & Logs: Use frameworks de logging do Java pra acompanhar a saúde dos raspadores, capturar erros e acionar alertas.

Conclusão & Principais Aprendizados

Dados da web são o novo ouro, e Java segue como uma das melhores ferramentas pra extrair esse valor — principalmente pra equipes que precisam de confiabilidade, escala e integração. O fluxo básico é simples: buscar, interpretar, extrair e exportar. Com bibliotecas como JSoup, HtmlUnit e Selenium, você cobre desde diretórios simples até sites dinâmicos e pesados em JavaScript.

Mas não precisa fazer tudo na unha. Ferramentas como o trazem IA e automação visual pro processo, permitindo prototipar, adaptar e escalar projetos de raspagem mais rápido do que nunca. Meu conselho? Misture código e no-code sem medo. Use Thunderbit pra configuração rápida e manutenção, e deixe o Java cuidar do processamento pesado.

Quer ver como o Thunderbit pode turbinar seu fluxo? e raspe seu primeiro site em minutos. E se quiser se aprofundar, confira o pra tutoriais, dicas e novidades sobre automação de raspagem web.

Boas raspagens — que seus dados estejam sempre organizados, atualizados e prontos pra uso.

Perguntas Frequentes

1. Java ainda é relevante pra raspagem web em 2025?

Sem dúvida. Apesar do Python ser popular pra scripts rápidos, Java segue como referência pra projetos robustos, de grande escala e longa duração — especialmente onde integração e multithreading fazem diferença.

2. Quando usar JSoup, HtmlUnit ou Selenium?

Use JSoup pra páginas estáticas, HtmlUnit pra conteúdo dinâmico simples ou formulários, e Selenium pra sites interativos ou pesados em JavaScript. Escolha conforme a complexidade do site.

3. Como evitar bloqueios durante a raspagem?

Diminua a frequência dos acessos, use proxies rotativos, defina user-agents realistas e simule comportamento humano. Pra sites mais chatos, experimente a raspagem em nuvem do Thunderbit ou APIs anti-bot.

4. Thunderbit e Java funcionam juntos?

Sim! Use o Thunderbit pra definir e agendar raspagens visualmente, exporte os dados e processe ou integre com seu código Java. É uma combinação poderosa pra usuários de negócios e devs.

5. Qual a forma mais rápida de começar com raspagem web em Java?

Configure o Java e o Maven, adicione o JSoup e teste em um site simples. Pra tarefas mais complexas ou prototipagem rápida, instale o e deixe a IA fazer o trabalho pesado — depois, integre os resultados ao seu fluxo Java.

Quer mais dicas, exemplos de código ou truques de automação? Explore o ou se inscreva no nosso pra tutoriais práticos e novidades sobre raspagem web. Saiba Mais