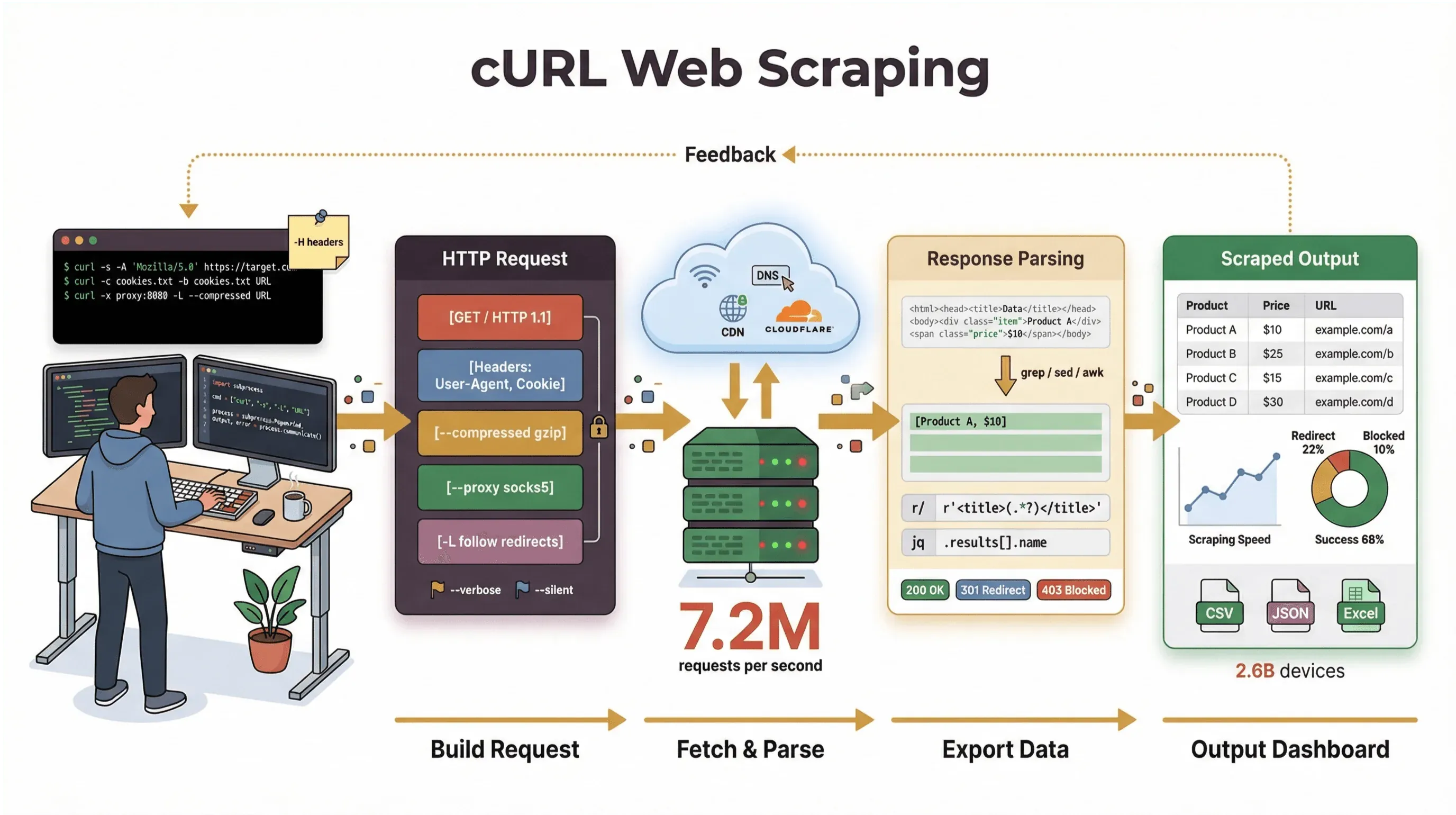

Há algo de intemporal em abrir o terminal, escrever um único comando e ver dados brutos da web aparecerem ali, como se tivesse acabado de abrir a Matrix. Para developers e utilizadores avançados mais técnicos, é essa varinha mágica — uma ferramenta discreta de linha de comando que, sem dar nas vistas, corre em milhares de milhões de dispositivos, de servidores na cloud a frigoríficos inteligentes. E, mesmo em 2026, com todas as ferramentas de scraping sem código e com IA que existem por aí, o web-scraping-with-curl continua a ser uma aposta certeira para quem quer velocidade, controlo e automação por script.

Passei anos a construir ferramentas de automação e a ajudar equipas a trabalhar com dados da web, e continuo a recorrer ao cURL quando preciso de capturar uma página, depurar uma API ou prototipar um fluxo de scraping. Neste guia, vou conduzir você por um tutorial de web scraping com curl que cobre desde o básico até truques mais avançados — com exemplos reais de comandos, dicas práticas e uma visão honesta de onde o cURL brilha e onde começa a mostrar limites. E, se for mais do tipo utilizador de negócios e preferir não mexer na linha de comando, vou mostrar como o , o nosso raspador web com IA, pode levar você de “preciso destes dados” a “aqui está a minha folha de cálculo” em dois cliques — sem precisar de programar.

Passei anos a construir ferramentas de automação e a ajudar equipas a trabalhar com dados da web, e continuo a recorrer ao cURL quando preciso de capturar uma página, depurar uma API ou prototipar um fluxo de scraping. Neste guia, vou conduzir você por um tutorial de web scraping com curl que cobre desde o básico até truques mais avançados — com exemplos reais de comandos, dicas práticas e uma visão honesta de onde o cURL brilha e onde começa a mostrar limites. E, se for mais do tipo utilizador de negócios e preferir não mexer na linha de comando, vou mostrar como o , o nosso raspador web com IA, pode levar você de “preciso destes dados” a “aqui está a minha folha de cálculo” em dois cliques — sem precisar de programar.

Vamos lá ver por que motivo o cURL continua relevante para web scraping em 2026, como usá-lo de forma eficiente e quando vale a pena recorrer a algo ainda mais poderoso.

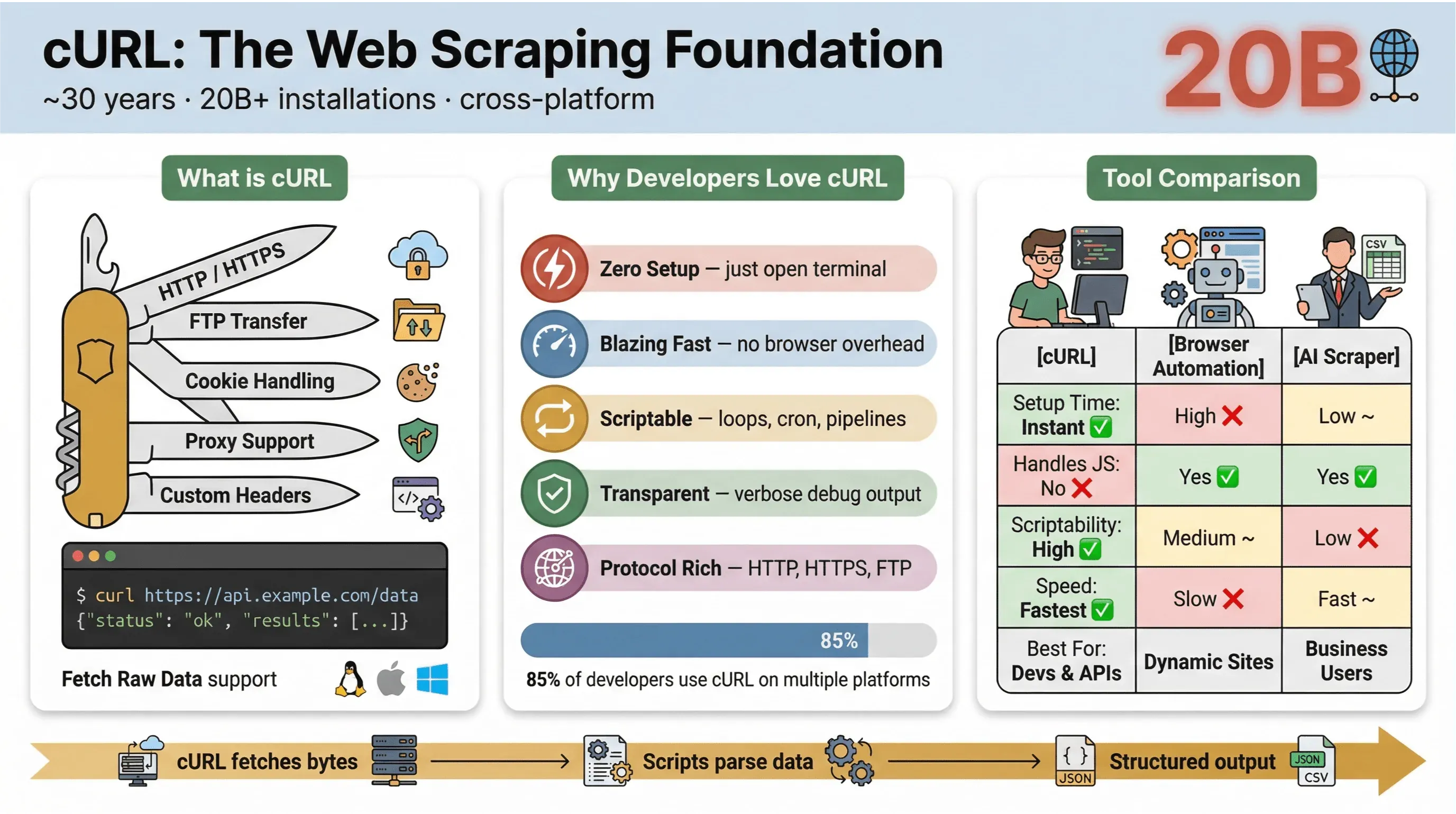

O que é o cURL? A base do web scraping com cURL

Na sua essência, é uma ferramenta de linha de comando e uma biblioteca para transferir dados através de URLs. Existe há quase 30 anos (sim, mesmo) e está em todo o lado — integrada em sistemas operativos, a alimentar scripts e a tratar, discretamente, de transferências de dados em mais de . Se alguma vez executou um comando rápido para ir buscar uma página, testar uma API ou descarregar um ficheiro, é muito provável que tenha usado o cURL.

Eis o que torna o cURL tão popular para web scraping:

Eis o que torna o cURL tão popular para web scraping:

- Leve e multiplataforma: corre em Linux, macOS, Windows e até em dispositivos embebidos.

- Suporte para protocolos: lida com HTTP, HTTPS, FTP e muito mais.

- Automatizável por script: perfeito para automação, cron jobs e código de integração.

- Não exige interação do utilizador: foi pensado para uso não interativo — ótimo para tarefas em lote e pipelines.

Mas convém deixar uma coisa clara: a função principal do cURL é obter dados brutos — HTML, JSON, imagens, enfim, tudo. Ele não faz parsing, renderização nem estrutura estes dados por si. Pense no cURL como a “primeira etapa” do web scraping: entrega os bytes, mas ainda vai precisar de outras ferramentas (como scripts em Python, grep/sed/awk ou um raspador web com IA) para transformar isso em informação estruturada.

Se quiser ver a documentação oficial, consulte o .

Por que usar cURL para Web Scraping? (tutorial de web scraping com curl)

Então por que é que developers e utilizadores técnicos continuam a voltar ao cURL para web scraping, mesmo com tantas ferramentas novas? Eis o que faz o cURL destacar-se:

- Configuração mínima: sem instalações, sem dependências — basta abrir o terminal e começar.

- Velocidade: obtenha dados instantaneamente, sem esperar que o navegador carregue.

- Automação por script: iterar sobre URLs, automatizar pedidos e encadear comandos com facilidade.

- Suporte para protocolos e funcionalidades: cookies, proxies, redirecionamentos, cabeçalhos personalizados e muito mais.

- Transparência: veja exatamente o que está a acontecer com saída verbosa/de depuração.

Na , 85,7% dos respondentes disseram usar a ferramenta de linha de comando cURL e 96,2% indicaram utilizá-la no Linux — de longe, a plataforma mais usada para cURL.

--- Continua a ser o canivete suíço para pedidos HTTP, recolhas rápidas de dados e troubleshooting.

Aqui está uma comparação rápida entre cURL e outros métodos de scraping:

| Funcionalidade | cURL | Automação de navegador (ex.: Selenium) | Raspador Web com IA (ex.: Thunderbit) |

|---|---|---|---|

| Tempo de configuração | Instantâneo | Alto | Baixo |

| Automatizável por script | Alto | Médio | Baixo (sem necessidade de código) |

| Lida com JavaScript | Não | Sim | Sim (Thunderbit: via navegador) |

| Suporte a cookies/sessão | Manual | Automático | Automático |

| Estruturação dos dados | Manual (fazer parsing depois) | Manual (fazer parsing depois) | Baseado em IA/modelos |

| Melhor para | Devs, recolhas rápidas | Sites complexos e dinâmicos | Utilizadores de negócios, exportação estruturada |

Em resumo: o cURL é imbatível para recolhas rápidas e automatizáveis — especialmente em páginas estáticas, APIs ou quando quer automatizar fluxos simples. Mas, assim que precisar de interpretar HTML complexo, lidar com JavaScript ou exportar dados estruturados, vai querer uma ferramenta mais especializada.

Como começar: exemplos básicos de comandos de web scraping com cURL

Vamos pôr as mãos na massa. Veja como usar o cURL para tarefas básicas de web scraping, passo a passo.

Capturar HTML bruto com cURL

O caso de uso mais simples: obter o HTML de uma página.

1curl https://books.toscrape.com/Este comando vai buscar a página inicial do , um site público de demonstração para web scraping. Vai ver a saída HTML bruta no terminal — procure tags como <title> ou trechos como “In stock”.

Guardar a saída num ficheiro

Quer guardar esse HTML para analisar mais tarde? Use a flag -o:

1curl -o page.html https://books.toscrape.com/Agora terá um ficheiro page.html com o conteúdo HTML completo. Isto é perfeito para análises posteriores ou para fazer parsing com outras ferramentas.

Enviar pedidos POST com cURL

Precisa de enviar um formulário ou interagir com uma API? Use a flag -d para pedidos POST. Aqui vai um exemplo usando , um site criado para testes HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Vai receber uma resposta JSON a refletir os dados enviados — ótimo para testes e prototipagem.

Inspecionar cabeçalhos e depurar

Às vezes, quer ver os cabeçalhos da resposta ou depurar o pedido:

-

Apenas cabeçalhos (pedido HEAD):

1curl -I https://books.toscrape.com/ -

Incluir cabeçalhos juntamente com o corpo:

1curl -i https://httpbin.org/get -

Saída verbosa/de depuração:

1curl -v https://books.toscrape.com/

Estas flags ajudam-no a perceber o que está a acontecer nos bastidores — algo essencial para troubleshooting.

Aqui está uma tabela de referência rápida para estes comandos:

| Tarefa | Exemplo de comando | Observações |

|---|---|---|

| Obter HTML | curl URL | Mostra o HTML no terminal |

| Guardar num ficheiro | curl -o ficheiro.html URL | Grava a saída num ficheiro |

| Inspecionar cabeçalhos | curl -I URL ou curl -i URL | -I apenas HEAD, -i inclui cabeçalhos com o corpo |

| Enviar dados de formulário | curl -d "a=1&b=2" URL | Envia dados codificados como formulário |

| Depurar pedido/resposta | curl -v URL | Mostra informação detalhada do pedido/resposta |

Para mais exemplos, consulte a .

Subir de nível: web scraping avançado com cURL (web scraping com cURL)

Depois de se sentir à vontade com o básico, o cURL abre-lhe um universo de funcionalidades avançadas para tarefas de scraping mais complexas.

Lidar com cookies e sessões

Muitos sites exigem cookies para manter sessões de login ou rastrear utilizadores. Com o cURL, pode guardar e reutilizar cookies entre pedidos:

1# Guardar cookies após o login

2curl -c cookies.txt https://example.com/login

3# Usar cookies nos pedidos seguintes

4curl -b cookies.txt https://example.com/accountIsto permite simular sessões de navegador e aceder a páginas atrás de login (desde que não exista um desafio em JavaScript).

Falsificar User-Agent e cabeçalhos personalizados

Alguns sites mostram conteúdo diferente com base no seu User-Agent ou noutros cabeçalhos. Por defeito, o cURL identifica-se como “curl/VERSION”, o que pode ativar bloqueios ou conteúdo alternativo. Para simular um navegador:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Também pode definir cabeçalhos personalizados, como preferências de idioma:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Isto ajuda a obter o mesmo conteúdo que um navegador real veria.

Usar proxies para web scraping

Precisa de encaminhar os seus pedidos através de um proxy (para testes geográficos ou para evitar bloqueios de IP)? Use a flag -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Só se certifique de usar proxies de forma responsável e dentro dos termos de serviço do site.

Automatizar scraping de várias páginas

Quer raspar várias páginas — como listas de produtos paginadas? Use um loop simples no shell:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-$\{p\}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-$\{p\}.html"

4 sleep 1

5doneIsto vai captar as páginas 2 a 5 do catálogo do Books to Scrape e guardar cada uma num ficheiro separado. (A página 1 é a página inicial.)

Limitações do web scraping com cURL: o que precisa de saber

Por muito que eu goste do cURL, ele não faz milagres. Veja onde fica aquém:

- Não executa JavaScript: o cURL não lida com páginas que dependem de JavaScript para renderizar conteúdo ou ultrapassar desafios anti-bot ().

- É preciso fazer parsing manualmente: recebe HTML ou JSON bruto, mas terá de interpretar isso por conta própria — muitas vezes com scripts ou ferramentas adicionais.

- Gestão limitada de sessão: lidar com logins complexos, tokens ou formulários em várias etapas pode tornar-se rapidamente confuso.

- Sem estruturação nativa de dados: o cURL não transforma páginas web em linhas, tabelas ou folhas de cálculo.

- Suscetível à deteção anti-bot: muitos sites usam hoje defesas avançadas contra bots (JavaScript, fingerprinting, CAPTCHAs) que o cURL simplesmente não consegue contornar ().

Aqui está uma tabela comparativa rápida:

| Limitação | Apenas cURL | Ferramentas modernas de scraping (ex.: Thunderbit) |

|---|---|---|

| Suporte a JavaScript | Não | Sim |

| Estruturação dos dados | Manual | Automática (IA/modelo) |

| Gestão de sessão | Manual | Automática |

| Contorno de anti-bot | Limitado | Avançado (baseado em navegador/IA) |

| Facilidade de uso | Técnico | Sem necessidade de conhecimentos técnicos |

Para páginas estáticas e APIs, o cURL é fantástico. Para qualquer coisa mais dinâmica ou protegida, vai querer subir um degrau na cadeia de ferramentas.

Thunderbit vs. cURL: a melhor abordagem de web scraping para utilizadores sem perfil técnico

Agora, vamos falar do , a nossa extensão Chrome de raspador web com IA. Se é vendedor, profissional de marketing ou de operações e só quer levar dados de um site para Excel, Google Sheets ou Notion — sem tocar no terminal — o Thunderbit foi feito para si.

Veja como o Thunderbit se compara ao cURL:

| Funcionalidade | cURL | Thunderbit |

|---|---|---|

| Interface | Linha de comando | Clicar e selecionar (extensão Chrome) |

| Sugestão de campos por IA | Não | Sim (a IA lê a página e sugere colunas) |

| Lida com paginação/subpáginas | Script manual | Automático (a IA deteta e extrai) |

| Exportação de dados | Manual (fazer parsing + guardar) | Direto para Excel, Google Sheets, Notion, Airtable |

| Páginas com JavaScript/protegidas | Não | Sim (scraping via navegador) |

| Sem necessidade de código | Não (exige scripts) | Sim (qualquer pessoa consegue usar) |

| Plano gratuito | Sempre grátis | Grátis para até 6 páginas (10 com impulso de teste) |

Com o Thunderbit, basta abrir a extensão, clicar em “AI Suggest Fields” e deixar a IA descobrir que dados extrair. É possível raspar tabelas, listas, detalhes de produtos e até visitar subpáginas automaticamente. Depois, exporte os dados diretamente para as suas ferramentas de negócio favoritas — sem parsing, sem dor de cabeça.

O Thunderbit já tem a confiança de mais de e é especialmente popular entre equipas de vendas, e-commerce e imobiliário que precisam de dados estruturados rapidamente.

Quer testar? .

Combinar cURL e Thunderbit: estratégias flexíveis de web scraping

Se for um utilizador técnico, não precisa de escolher só uma ferramenta. Na prática, muitas equipas usam cURL e Thunderbit em conjunto para ganhar a máxima flexibilidade:

- Prototipe com cURL: use o cURL para testar endpoints rapidamente, inspecionar cabeçalhos e perceber como um site responde.

- Escalar com Thunderbit: quando precisar de dados estruturados, scraping de várias páginas ou de um fluxo repetível, mude para o Thunderbit para extração com um clique e exportação direta.

Aqui está um exemplo de fluxo de trabalho para pesquisa de mercado:

- Use o cURL para ir buscar algumas páginas e inspecionar a estrutura do HTML.

- Identifique os campos de dados que quer (por exemplo: nomes de produtos, preços, avaliações).

- Abra o Thunderbit, clique em “AI Suggest Fields” e deixe a IA configurar o raspador.

- Raspe todas as páginas (incluindo subpáginas ou listas paginadas) e exporte para o Google Sheets.

- Analise, partilhe e aja sobre os dados — sem precisar de fazer parsing manual.

Aqui vai uma tabela rápida de decisão:

| Cenário | Usar cURL | Usar Thunderbit | Usar ambos |

|---|---|---|---|

| Captura rápida de API ou página estática | ✅ | ||

| Precisa de dados estruturados em folha de cálculo | ✅ | ||

| Depuração de cabeçalhos/cookies | ✅ | ||

| Scraping de páginas dinâmicas/pesadas em JS | ✅ | ||

| Construir um fluxo repetível, sem código | ✅ | ||

| Prototipar e depois escalar | ✅ | ✅ | Fluxo híbrido |

Desafios comuns e armadilhas no web scraping com cURL

Antes de sair a usar o cURL sem travões, vale a pena falar dos desafios reais que vai encontrar:

- Sistemas anti-bot: muitos sites usam hoje defesas avançadas (desafios em JavaScript, CAPTCHAs, fingerprinting) que o cURL não consegue contornar ().

- Problemas de qualidade de dados: mudanças no HTML, campos em falta ou layouts inconsistentes podem rebentar com os seus scripts.

- Custo de manutenção: sempre que um site muda, terá de atualizar a sua lógica de parsing.

- Riscos legais e de conformidade: verifique sempre os termos de serviço do site, o robots.txt e as leis aplicáveis antes de fazer scraping. Só porque os dados são públicos não significa que o seu uso seja livre (, ).

- Limites de escala: o cURL é ótimo para tarefas pequenas, mas, para scraping em grande escala, vai precisar de gerir proxies, limites de taxa e tratamento de erros.

Dicas para depurar e manter a conformidade:

- Comece sempre por sites com permissão ou de demonstração (como o ).

- Respeite os limites de taxa — não sobrecarregue endpoints.

- Evite raspar dados pessoais, a menos que tenha uma base legal para isso.

- Se encontrar barreiras de JavaScript ou CAPTCHA, considere mudar para uma ferramenta baseada em navegador, como o Thunderbit.

Resumo passo a passo: como fazer scraping de websites com cURL

Aqui está a sua checklist de consulta rápida para web scraping com cURL:

- Identifique o(s) seu(s) URL(s) de destino: comece com uma página estática ou endpoint de API.

- Obtenha a página:

curl URL - Guarde a saída num ficheiro:

curl -o file.html URL - Inspecione cabeçalhos/depure:

curl -I URL,curl -v URL - Envie dados via POST:

curl -d "a=1&b=2" URL - Gira cookies/sessões:

curl -c cookies.txt ...,curl -b cookies.txt ... - Defina cabeçalhos/User-Agent personalizados:

curl -A "..." -H "..." URL - Siga redirecionamentos:

curl -L URL - Use proxies (se necessário):

curl -x proxy:port URL - Automatize o scraping de várias páginas: use loops de shell ou scripts.

- Analise e estruture os dados: use ferramentas/scripts adicionais conforme necessário.

- Mude para o Thunderbit para scraping estruturado, sem código, ou para páginas dinâmicas.

Conclusão e principais aprendizagens: escolher a ferramenta certa de web scraping

O web scraping com cURL continua a ser uma competência poderosa para utilizadores técnicos em 2026 — especialmente para recolhas rápidas, prototipagem e automação. A velocidade, a capacidade de automação por script e a omnipresença do cURL fazem dele uma peça básica na caixa de ferramentas de qualquer developer. Mas, à medida que a web se torna mais dinâmica e protegida, e que os utilizadores de negócios exigem dados estruturados sem código, ferramentas como estão a redefinir o que é possível.

Principais aprendizagens:

- Use cURL para páginas estáticas, APIs e protótipos rápidos — especialmente quando quiser controlo total.

- Mude para o Thunderbit (ou outros raspadores web com IA semelhantes) quando precisar de dados estruturados, lidar com páginas dinâmicas/pesadas em JavaScript ou quiser um fluxo de trabalho sem código e orientado para negócios.

- Combine os dois para ter a máxima flexibilidade: faça o protótipo com cURL, escale e estruture com Thunderbit.

- Faça sempre scraping de forma responsável — respeite os termos do site, os limites de taxa e os limites legais.

Curioso para ver como o web scraping pode ser simples? e veja na prática a extração de dados com IA. E, se quiser aprofundar, consulte o para mais tutoriais, dicas e insights do setor. Também pode gostar de:

Boas recolhas — e que os seus dados estejam sempre limpos, estruturados e a apenas um comando (ou clique) de distância.

FAQs

1. O cURL consegue lidar com páginas renderizadas em JavaScript?

Não, o cURL não executa JavaScript. Ele obtém o HTML bruto entregue pelo servidor. Se uma página precisar de JavaScript para renderizar conteúdo ou resolver desafios anti-bot, o cURL não conseguirá aceder aos dados. Nesses casos, use ferramentas baseadas em navegador, como o .

2. Como guardo a saída do cURL diretamente num ficheiro?

Use a flag -o: curl -o nome-do-ficheiro.html URL. Isto grava o corpo da resposta num ficheiro, em vez de o mostrar no terminal.

3. Qual é a diferença entre cURL e Thunderbit para web scraping?

cURL é uma ferramenta de linha de comando para obter dados brutos da web — ótima para utilizadores técnicos e automação. Thunderbit é uma extensão Chrome com IA, criada para utilizadores de negócios que querem extrair dados estruturados de qualquer site, lidar com páginas dinâmicas e exportar diretamente para ferramentas como Excel ou Google Sheets — sem precisar de programar.

4. É legal fazer scraping de websites com cURL?

Em geral, a extração de dados públicos é legal nos EUA, com base em decisões judiciais recentes, mas verifique sempre os termos de serviço do site, o robots.txt e as leis aplicáveis. Evite raspar dados pessoais ou protegidos sem permissão e respeite os limites de taxa e as diretrizes éticas (, ).

5. Quando devo trocar o cURL por uma ferramenta mais avançada, como o Thunderbit?

Se precisa de raspar páginas dinâmicas/pesadas em JavaScript, quer dados estruturados numa folha de cálculo ou prefere um fluxo sem código, o Thunderbit é a melhor escolha. Use cURL para tarefas rápidas e técnicas; use Thunderbit para extração de dados repetível e orientada para negócios.

Para mais dicas e tutoriais sobre web scraping, visite o ou consulte o nosso .