A web está a crescer a um ritmo que, sinceramente, é difícil de acompanhar — até 2026, quase , e uma fatia enorme disso vem de empresas que fazem scraping de dados para alimentar vendas, operações e análise competitiva. Tenho visto de perto como o web scraping deixou de ser um “diferencial” para equipas de tecnologia e passou a ser uma necessidade absoluta para toda a gente, desde equipas comerciais até mediadores imobiliários. Mas há um detalhe: nem todas as empresas de web scraping são iguais, e escolher a certa pode ser a diferença entre um fluxo de trabalho automatizado e sem fricção ou uma semana de dores de cabeça a copiar e colar.

Por isso, arregaçei as mangas e mergulhei a fundo nas principais empresas de web scraping para 2026. Quer seja um utilizador não técnico que só quer dados em dois cliques, quer seja um programador à procura de controlo total, esta lista reúne o melhor do melhor — além de análises honestas sobre onde cada uma se destaca (e onde não se destaca). Vamos a isso.

Por que as empresas precisam das melhores empresas de web scraping

Se alguma vez tentou montar uma lista de leads, monitorizar preços da concorrência ou recolher dados de produtos de dezenas (ou milhares) de páginas, sabe bem o quão desgastante é a recolha manual de dados. É lenta, está sujeita a erros e — sejamos honestos — ninguém lhe chama diversão. É por isso que , com empresas a usar a técnica para tudo, desde e monitorização de preços até pesquisa de mercado e análise de sentimento.

A verdadeira magia? Automação. As empresas modernas de web scraping permitem-lhe:

- Automatizar pesquisas repetitivas (adeus, maratonas de copiar e colar)

- Escalar para milhares de páginas sem esforço adicional

- Integrar dados diretamente nas suas ferramentas favoritas (Excel, Google Sheets, Notion, CRMs)

- Ganhar vantagem sobre a concorrência com dados mais atualizados e completos — mais depressa

Mas, com tantas opções, como escolher? É aqui que este guia entra.

Como avaliámos as principais empresas de web scraping

Nem todo o scraper foi feito para o mesmo utilizador — ou para a mesma tarefa. Foi assim que avaliei o mercado:

- Facilidade de uso: alguém sem programação consegue resultados rapidamente? A interface é intuitiva?

- Automação e recursos: lida com paginação, subpáginas, agendamento e conteúdo dinâmico?

- Escalabilidade: aguenta projetos grandes ou é melhor para trabalhos mais pequenos?

- Integração: quão fácil é exportar ou ligar os dados a outras ferramentas?

- Preço: existe plano grátis? É acessível para PME e escalável para empresas?

- Suporte e comunidade: há tutoriais, modelos prontos e ajuda real quando precisa?

Também tive em conta o que torna cada empresa única — porque, por vezes, a ferramenta “melhor” é a que se encaixa no seu fluxo de trabalho, e não apenas a que tem mais funcionalidades.

Certo, vamos à lista.

1. Thunderbit

é o web scraper com IA que mais me entusiasma para 2026 — e não só porque ajudei a construí-lo! O Thunderbit foi criado para utilizadores de negócio que querem dados, não dores de cabeça. A extensão para Chrome permite extrair qualquer site com prompts em linguagem natural e sugestões de campos com IA. Sem código, sem modelos, sem stress.

é o web scraper com IA que mais me entusiasma para 2026 — e não só porque ajudei a construí-lo! O Thunderbit foi criado para utilizadores de negócio que querem dados, não dores de cabeça. A extensão para Chrome permite extrair qualquer site com prompts em linguagem natural e sugestões de campos com IA. Sem código, sem modelos, sem stress.

Porque é que o Thunderbit se destaca:

- Extração em 2 cliques: basta clicar em “AI Suggest Fields” e “Scrape” — a IA do Thunderbit trata do resto.

- Suporte a subpáginas e paginação: extraia listas com facilidade e depois deixe a IA visitar cada subpágina para obter mais detalhes.

- Modelos instantâneos: para sites populares (Amazon, Zillow, Shopify etc.), use modelos prontos para extração num clique.

- Exportação gratuita de dados: exporte para Excel, Google Sheets, Notion ou Airtable — sem bloqueios para aceder aos seus próprios dados.

- Enriquecimento de dados com IA: rotule, categorize e traduza os dados enquanto faz a extração.

- Extração agendada e na nuvem: configure tarefas recorrentes ou execute extrações na nuvem para ganhar velocidade.

- Plano totalmente grátis: extraia até 6 páginas de graça, ou 10 com um impulso de teste. Os planos pagos começam em US$ 15/mês.

O Thunderbit é usado por mais de , desde equipas comerciais até operações de e-commerce. Se quer a experiência de web scraping mais fácil e intuitiva em 2026, o Thunderbit é difícil de bater.

Quer ver como funciona? e experimente por si.

2. Scrapy

é o framework Python open source mais usado por programadores que querem controlo total. É poderoso, flexível e já foi testado em cenários reais para tudo, desde rastrear sites pequenos até extrair milhões de páginas.

é o framework Python open source mais usado por programadores que querem controlo total. É poderoso, flexível e já foi testado em cenários reais para tudo, desde rastrear sites pequenos até extrair milhões de páginas.

Ideal para: equipas técnicas, engenheiros de dados e qualquer pessoa confortável com Python.

Principais recursos:

- Criação de regras personalizadas: construa spiders para lidar com qualquer estrutura de site.

- Escalável e rápido: suporta scraping em grande escala com tratamento robusto de erros.

- Integra-se ao ecossistema Python: ligue a Pandas, Jupyter e muito mais.

- Gratuito e open source: sem custos de licença e com uma comunidade enorme.

Atenção: o Scrapy tem uma curva de aprendizagem. Se não programa, talvez valha a pena olhar para outras opções. Mas, para programadores, é uma máquina ().

3. ParseHub

é uma aplicação de desktop que torna o web scraping visual e acessível. A sua interface point-and-click permite criar scrapers sem escrever código.

é uma aplicação de desktop que torna o web scraping visual e acessível. A sua interface point-and-click permite criar scrapers sem escrever código.

Ideal para: PME, investigadores e pessoas sem programação que querem flexibilidade.

Principais recursos:

- Fluxo de trabalho visual: clique para selecionar dados e crie lógica para paginação e subpáginas.

- Agendamento na nuvem: execute extrações em horários definidos, mesmo com o computador desligado.

- Opções de exportação: descarregue em CSV, Excel ou JSON.

- Plano grátis: 5 projetos, até 200 páginas por execução; planos pagos a partir de US$ 39/mês.

O ParseHub é especialmente popular para extrair listas, avaliações e dados de e-commerce ().

4. Octoparse

é uma plataforma de web scraping sem código, com arrastar e largar, focada em automação em escala. É ótima para equipas que querem configurar tarefas complexas sem escrever scripts.

é uma plataforma de web scraping sem código, com arrastar e largar, focada em automação em escala. É ótima para equipas que querem configurar tarefas complexas sem escrever scripts.

Ideal para: equipas de marketing, pesquisa e operações.

Principais recursos:

- Fluxo de arrastar e largar: monte scrapers visualmente e lide com conteúdo dinâmico e rolagem infinita.

- Scraping e agendamento na nuvem: execute tarefas na nuvem e agende rotinas recorrentes.

- Rotação de IP e anti-bloqueio: funcionalidades integradas para extrair sites mais difíceis.

- Exportação para Excel, Sheets e bases de dados: integração fácil com o seu fluxo de trabalho.

- Plano grátis: até 10.000 registos/mês; planos pagos a partir de US$ 75/mês.

O Octoparse é especialmente valorizado pela rapidez e pela capacidade de lidar com projetos em grande escala ().

5. DataMiner

é uma extensão do Chrome que leva o web scraping para o seu navegador. É perfeita para extrações rápidas, baseadas em modelos, de tabelas, listas e sites simples.

é uma extensão do Chrome que leva o web scraping para o seu navegador. É perfeita para extrações rápidas, baseadas em modelos, de tabelas, listas e sites simples.

Ideal para: utilizadores do dia a dia, equipas de operações de vendas e qualquer pessoa que viva no Chrome.

Principais recursos:

- Marketplace de modelos: mais de 60.000 receitas prontas para sites populares.

- Extração point-and-click: selecione dados visualmente, sem precisar de código.

- Exportação para Excel/Google Sheets: exporte com um clique.

- Plano grátis: 500 páginas/mês; planos pagos a partir de US$ 19/mês.

O DataMiner é o favorito para trabalhos rápidos e para utilizadores sem perfil técnico ().

6. Import.io

é uma plataforma empresarial focada em transformar conteúdo da web em dados estruturados para analytics e business intelligence.

é uma plataforma empresarial focada em transformar conteúdo da web em dados estruturados para analytics e business intelligence.

Ideal para: empresas com grandes necessidades de dados e requisitos de integração.

Principais recursos:

- Modelo de serviço gerido: a equipa da Import.io pode criar e manter scrapers por si.

- Interface visual: crie fluxos de extração sem código.

- Acesso via API: integre os dados extraídos diretamente nas suas apps e dashboards.

- Conformidade e segurança: controlos de nível empresarial, mascaramento de dados pessoais e muito mais.

Preço: orçamento personalizado, geralmente a partir de US$ 299/mês ().

7. Apify

é uma plataforma de automação amigável para programadores, com um marketplace enorme de “Actors” prontos (bots de scraping) e possibilidade de criar fluxos personalizados.

é uma plataforma de automação amigável para programadores, com um marketplace enorme de “Actors” prontos (bots de scraping) e possibilidade de criar fluxos personalizados.

Ideal para: programadores, agências e equipas que querem flexibilidade.

Principais recursos:

- Marketplace de Actors: scrapers prontos para sites populares ou crie o seu próprio.

- Infraestrutura na nuvem: execute extrações em escala, agende tarefas e integre com APIs.

- Integração com GitHub: automatize fluxos de trabalho e CI/CD.

- Pagamento conforme o uso: créditos grátis e depois cobrança por utilização; planos pagos a partir de US$ 39/mês.

O Apify é ideal tanto para projetos simples como complexos ().

8. Diffbot

usa IA e grafos de conhecimento para transformar conteúdo não estruturado da web em dados estruturados e legíveis por máquina. Pense nele como o “cérebro” do web scraping.

usa IA e grafos de conhecimento para transformar conteúdo não estruturado da web em dados estruturados e legíveis por máquina. Pense nele como o “cérebro” do web scraping.

Ideal para: empresas, investigadores e qualquer pessoa que precise de extração automatizada em grande escala.

Principais recursos:

- Extração orientada por IA: reconhece automaticamente artigos, produtos, organizações e muito mais.

- Grafo de conhecimento: aceda, via API, ao maior grafo de dados da web do mundo.

- Enriquecimento de dados: adicione entidades relacionadas, notícias e contexto.

- API-first: integre com ferramentas de BI e pipelines de dados.

Preço: começa em US$ 299/mês ().

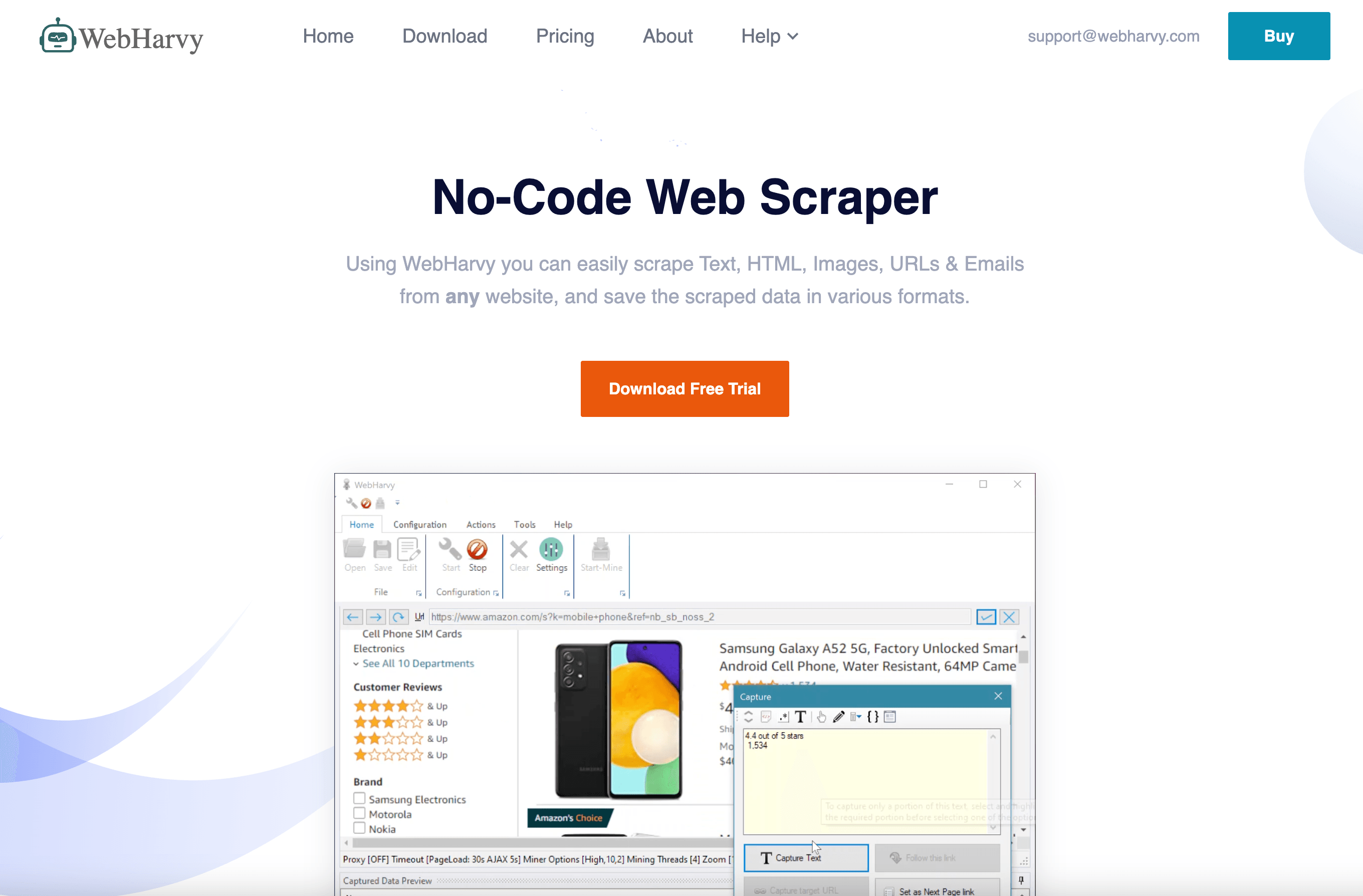

9. WebHarvy

é um scraper de desktop para Windows com interface visual de point-and-click. É ótimo para quem quer evitar código e prefere uma aplicação de desktop.

é um scraper de desktop para Windows com interface visual de point-and-click. É ótimo para quem quer evitar código e prefere uma aplicação de desktop.

Ideal para: utilizadores de Windows, investigadores e PME.

Principais recursos:

- Seleção visual: clique nos dados para definir campos — sem necessidade de código.

- Lida com imagens e navegação entre páginas: extraia texto, imagens e siga paginações.

- Exportação para Excel, XML e bases de dados: opções de saída flexíveis.

- Licença única: pague uma vez e use para sempre ().

O WebHarvy é especialmente popular para extrair dados de sites de e-commerce e classificados ().

10. Mozenda

é uma plataforma baseada na nuvem criada para extração e automação de dados em escala empresarial.

é uma plataforma baseada na nuvem criada para extração e automação de dados em escala empresarial.

Ideal para: grandes organizações e setores com muita exigência regulatória.

Principais recursos:

- Automação na nuvem: agende, monitorize e faça a gestão de tarefas de scraping de forma centralizada.

- Transformação de dados: limpe, enriqueça e exporte os dados em vários formatos.

- Colaboração em equipa: suporte multiutilizador e gestão de fluxos de trabalho.

- Suporte empresarial: conformidade, fiabilidade e ajuda dedicada ().

Preço: cerca de US$ 99/mês; preços empresariais disponíveis.

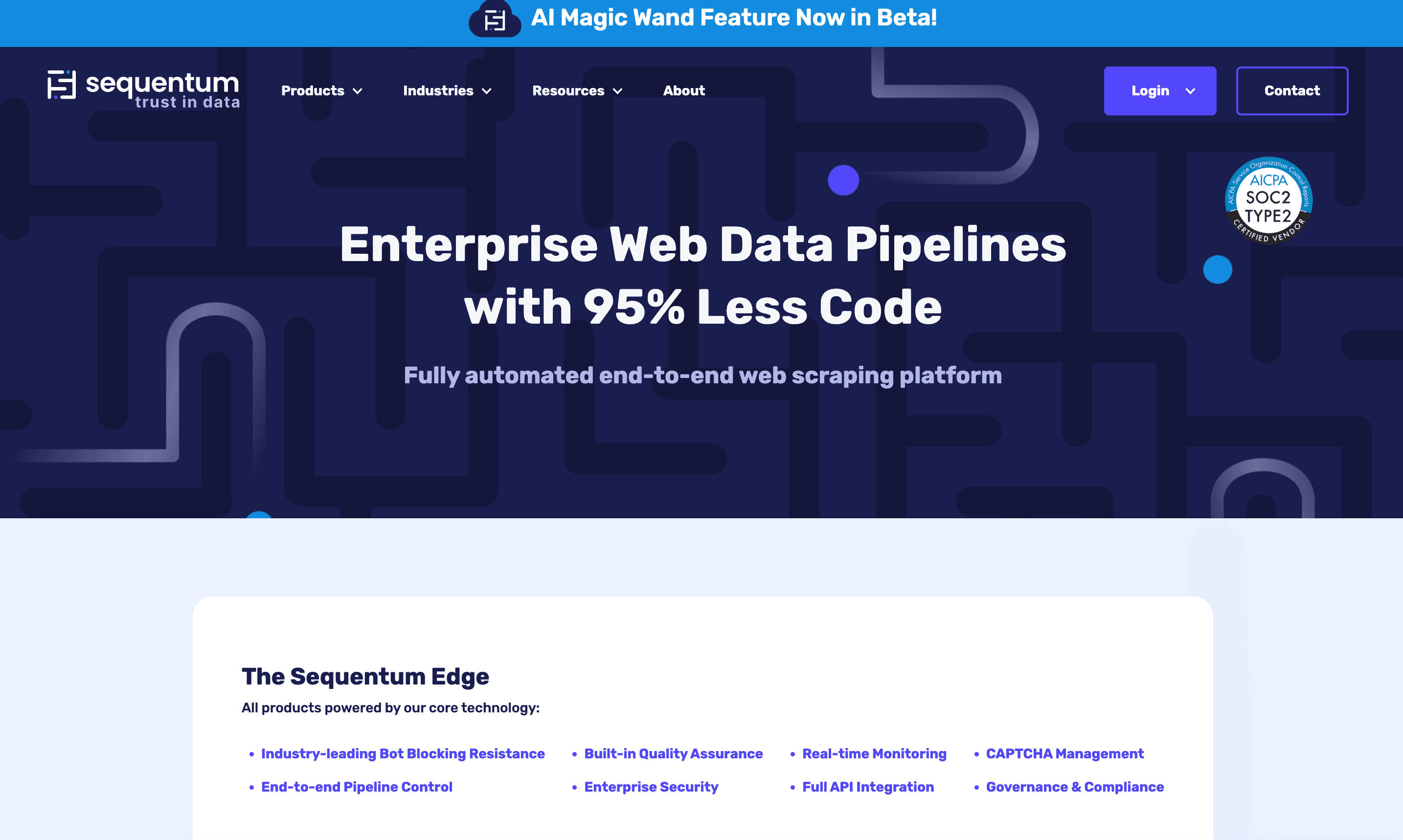

11. Sequentum

é um scraper avançado de desktop/web para profissionais de dados e agências.

é um scraper avançado de desktop/web para profissionais de dados e agências.

Ideal para: profissionais de dados, agências e qualquer pessoa que precise de automação profunda.

Principais recursos:

- Scripting avançado: automatize lógicas complexas de extração.

- Relatórios e monitorização: acompanhe tarefas, receba alertas e faça a gestão de projetos grandes.

- Integração: exporte para bases de dados, APIs ou armazenamento na nuvem.

- Sem plano grátis: apenas licenças pagas ().

O Sequentum foi feito para extração personalizável em alto volume.

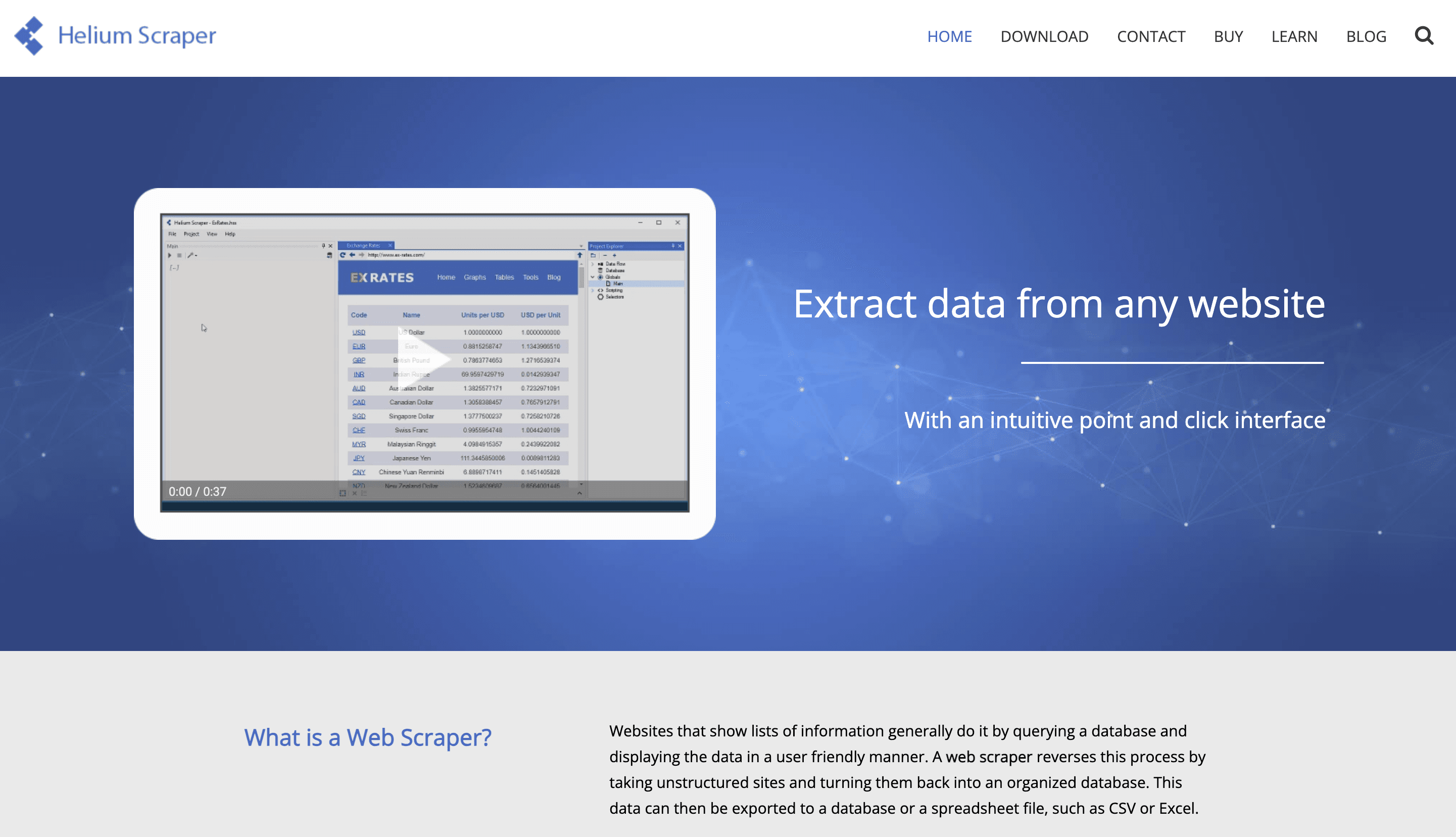

12. Helium Scraper

é uma ferramenta de desktop com construtor visual de fluxos de trabalho, ideal para extrair dados de sites complexos e dinâmicos.

é uma ferramenta de desktop com construtor visual de fluxos de trabalho, ideal para extrair dados de sites complexos e dinâmicos.

Ideal para: utilizadores avançados, analistas e qualquer pessoa que queira flexibilidade sem código.

Principais recursos:

- Fluxo visual: interface de arrastar e largar para construir a lógica de extração.

- Lida com conteúdo dinâmico: funciona com sites muito dependentes de JavaScript.

- Transformação de dados: limpe e organize os dados antes de exportar.

- Opções de exportação: Excel, CSV, bases de dados e muito mais.

- Pagamento único: cerca de US$ 199 por uma licença vitalícia ().

O Helium Scraper é especialmente bom para sites fora do padrão e fluxos de trabalho personalizados.

Comparando as principais empresas de web scraping: recursos em resumo

Aqui fica um resumo lado a lado para ajudar você a escolher a opção certa:

| Empresa | Ideal para | Facilidade de uso | Automação e IA | Escalabilidade | Opções de exportação | Plano grátis / Preço |

|---|---|---|---|---|---|---|

| Thunderbit | Não programadores, PMEs | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, Sheets, Notion | Grátis (6 páginas), US$ 15/mês+ |

| Scrapy | Desenvolvedores | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Python, CSV, BD | Grátis, open source |

| ParseHub | PMEs, pesquisadores | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | CSV, Excel, JSON | Grátis (5 projetos), US$ 39+ |

| Octoparse | Operações, marketing | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, BD, API | Grátis (10 mil linhas), US$ 75+ |

| DataMiner | Utilizadores do Chrome | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, Sheets | Grátis (500 páginas), US$ 19+ |

| Import.io | Empresas | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, BD, Nuvem | Personalizado, US$ 299+/mês |

| Apify | Devs, agências | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, BD, Sheets | Créditos grátis, US$ 39+/mês |

| Diffbot | Pesquisa, analytics | ⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, Grafo de conhecimento | US$ 299+/mês |

| WebHarvy | Utilizadores do Windows | ⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, XML, BD | Pagamento único, US$ 139+ |

| Mozenda | Empresas | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Excel, API, Nuvem | US$ 99+/mês, empresarial |

| Content Grabber | Profissionais de dados, agências | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | BD, API, Nuvem | Apenas licença paga |

| Helium Scraper | Utilizadores avançados, analistas | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | Excel, CSV, BD | Pagamento único, US$ 199 |

Escolhas rápidas:

- Para não programadores: Thunderbit, DataMiner, ParseHub, WebHarvy

- Para programadores: Scrapy, Apify, Content Grabber

- Para empresas: Import.io, Diffbot, Mozenda

- Para fluxos visuais e flexíveis: Thunderbit, Octoparse, Helium Scraper

Conclusão: escolher o parceiro certo de web scraping para o seu negócio

Em 2026, web scraping não é só para equipas de tecnologia — é uma capacidade central de negócio para qualquer pessoa que precise de dados para tomar melhores decisões mais depressa. A empresa de web scraping certa pode poupar horas, aumentar o seu ROI e revelar insights que os seus concorrentes talvez deixem passar.

O meu conselho:

- Combine a ferramenta com a sua equipa: utilizadores sem perfil técnico vão gostar do Thunderbit ou do DataMiner. Programadores devem ver o Scrapy ou o Apify. Empresas, olhem para Import.io ou Diffbot.

- Pense em escala e integração: vai precisar de extrair milhares de páginas? Quer os dados no Sheets, no Notion ou no seu CRM?

- Comece com um teste grátis: a maioria das ferramentas oferece plano gratuito — teste num projeto real antes de se comprometer.

- Não tenha medo de combinar ferramentas: às vezes, o melhor fluxo de trabalho junta várias delas.

E, se estiver pronto para ver como o web scraping pode ser fácil, . As suas folhas de cálculo (e a sua sanidade) vão agradecer.

Para análises mais profundas, dicas e tutoriais, confira o .

Perguntas frequentes

1. O que é web scraping e por que é importante para empresas em 2026?

Web scraping é o processo automatizado de extrair dados de sites. É crucial para empresas porque permite recolha rápida e em grande escala para geração de leads, monitorização de preços, pesquisa de mercado e muito mais — poupando tempo e melhorando a tomada de decisão.

2. Qual empresa de web scraping é melhor para utilizadores sem conhecimentos técnicos?

Thunderbit e DataMiner são as melhores opções para quem não programa, graças às interfaces visuais e orientadas por IA. Ambos permitem extrair dados em poucos cliques, sem precisar de codificar.

3. Que funcionalidades devo procurar numa empresa de web scraping?

Procure facilidade de uso, automação (paginação, subpáginas, agendamento), escalabilidade, opções de exportação (Excel, Sheets, APIs) e apoio ao cliente forte. Escolha uma ferramenta que combine com as suas competências técnicas e necessidades de negócio.

4. Existem soluções gratuitas de web scraping?

Sim! Thunderbit, DataMiner, ParseHub e Octoparse oferecem planos gratuitos. O Scrapy é open source e gratuito para programadores. Os planos grátis são ótimos para projetos pequenos ou para testar antes de escalar.

5. Como manter conformidade e ética ao extrair dados?

Respeite sempre os termos de serviço e as políticas de privacidade dos sites. Extraia apenas dados publicamente disponíveis, evite sobrecarregar os sites e tenha em conta regras de privacidade de dados como o GDPR. Muitas das principais empresas de web scraping oferecem funcionalidades de conformidade e guias de boas práticas.

Pronto para começar a extrair dados de forma mais inteligente? ou explore mais guias no .

Saiba mais