Se você está avaliando ferramentas de web scraping em 2026, provavelmente não quer uma aula de filosofia. Você quer uma lista curta em que possa confiar, um jeito rápido de separar ferramentas voltadas para usuários de negócio de stacks pesadas para engenharia e evidências suficientes para não comprar a opção errada. É exatamente isso que esta página oferece.

Sou Shuai Guan, cofundador e CEO da . Trabalho todos os dias com scraping com IA e automação de navegador, então me importo menos com rankings genéricos e mais com aderência: quais ferramentas ajudam uma equipe de vendas ou operações a avançar ainda nesta semana, quais fazem mais sentido dentro de um fluxo de trabalho de desenvolvedor e quais só brilham quando escala e infraestrutura anti-bot viram o problema principal.

Resposta rápida

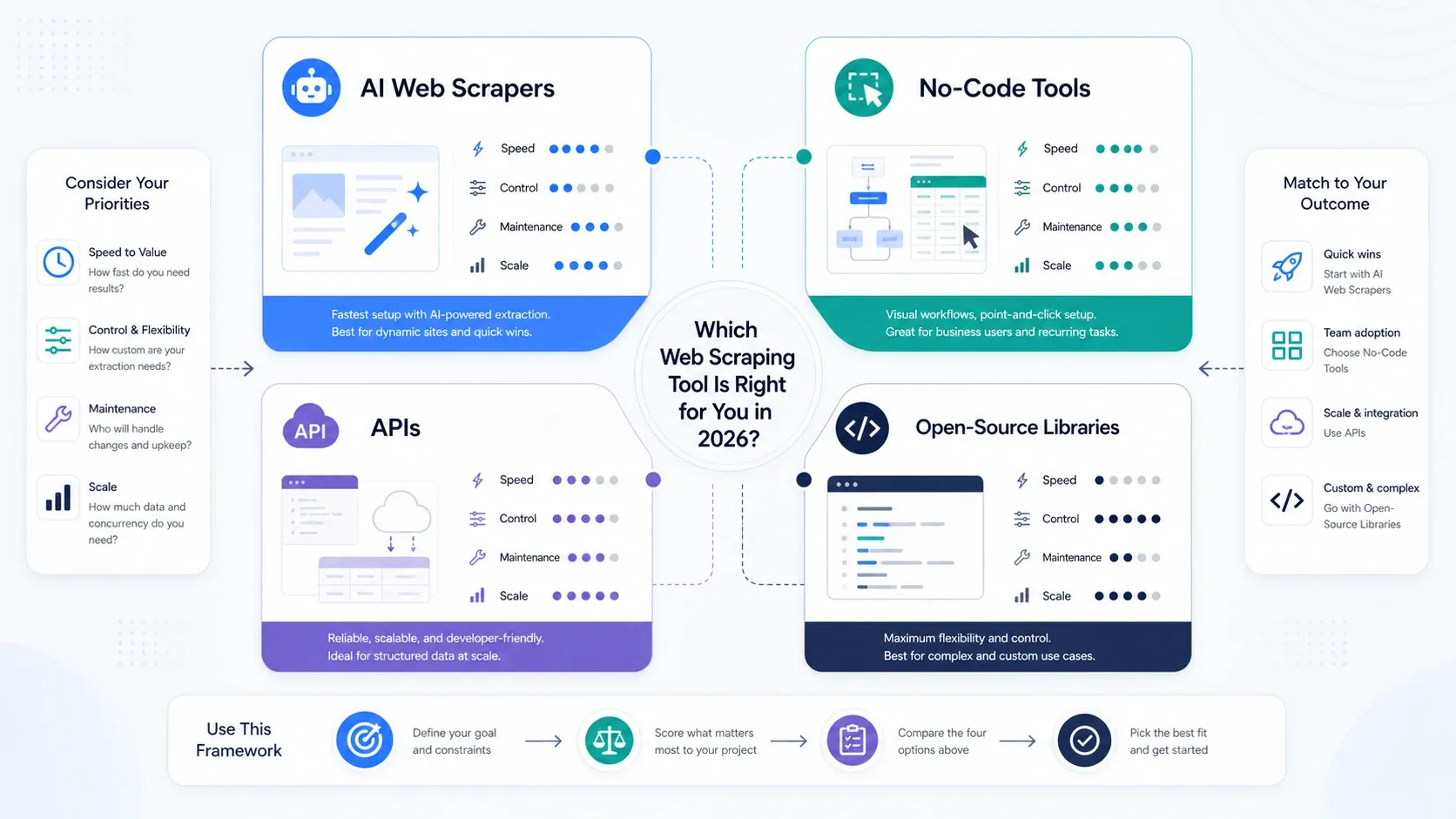

Se você só quer a lógica de decisão, vá por aqui:

- Escolha um Raspador Web IA se quiser o caminho mais rápido do site para a planilha, com o mínimo de configuração.

- Escolha um raspador sem código se precisar de mais controle das tarefas, agendamento ou execuções na nuvem sem escrever código.

- Escolha uma plataforma de API se sua equipe precisa de renderização, rotação de proxies, tratamento anti-bot ou integração com um produto interno.

- Escolha uma biblioteca de código aberto se quiser controle total e puder assumir manutenção, seletores, infraestrutura e falhas.

Este artigo reúne as 20 ferramentas, mas a lógica de recomendação é de propósito simples: comece com a ferramenta mais leve que consiga lidar com seu fluxo de trabalho de forma confiável e só desça na stack quando manutenção, bloqueios ou escala obrigarem.

Tabela rápida de comparação: as melhores ferramentas de web scraping em 2026

Os preços e modelos de plano abaixo foram conferidos nas páginas oficiais de produto ou preços em 7 de maio de 2026. Quando os fornecedores usam cobrança por uso ou orçamento corporativo personalizado, descrevo o modelo de preço em vez de fingir que existe um valor de tabela universalmente confiável.

| Ferramenta | Tipo | Melhor para | Por que entrou na lista de 2026 | Modelo de preço (verificado em mai. 2026) |

|---|---|---|---|---|

| Thunderbit | Raspador Web IA | Vendas, operações, ecommerce, imóveis | O caminho mais rápido para quem não programa; sugestão de campos por IA, subpáginas, exportações, fluxo no navegador + nuvem | Plano gratuito, planos pagos, preços corporativos personalizados |

| Browse AI | Raspador Web IA | Usuários de negócio monitorando sites | Robôs sem código robustos, monitoramento e saídas no estilo planilha/API | Plano gratuito, planos pagos, nível premium gerenciado |

| Bardeen | Automação com IA + scraping | Operações de receita e fluxos no navegador | Melhor quando o scraping é só uma etapa dentro de uma automação maior | Plano gratuito e planos pagos |

| Diffbot | Plataforma de extração com IA | Empresas e equipes de dados | Melhor opção quando você quer extração por IA e fluxos de dados estruturados em grande escala | Preço no estilo enterprise |

| Instant Data Scraper | Raspador leve para navegador | Usuários casuais e capturas rápidas de tabelas | Continua sendo uma das formas mais simples de levar uma lista ou tabela visível para CSV rapidamente | Gratuito |

| Octoparse | Raspador sem código | Analistas e equipes de operações com tarefas recorrentes maiores | Construtor visual maduro com extração na nuvem, anti-bloqueio e modelos | Plano gratuito, pago a partir de US$ 69/mês, enterprise personalizado |

| ParseHub | Raspador low-code | Analistas que precisam de lógica e controle no desktop | Lógica de projeto flexível e navegação aninhada, com curva de aprendizado mais alta do que ferramentas novas focadas em IA | Plano gratuito e planos pagos |

| Web Scraper | Raspador sem código | Iniciantes e jobs leves na nuvem | Bom ponto de entrada se você gosta de scraping baseado em sitemap e configuração primeiro no navegador | Extensão gratuita, planos pagos na nuvem |

| Data Miner | Raspador para navegador | Pesquisadores e operadores de growth | Ainda útil para extração rápida baseada em receitas dentro do navegador | Plano gratuito e planos pagos |

| Apify | Plataforma de API + Actors | Equipes técnicas e operadores híbridos | Ecossistema excelente de Actors com runtime personalizado quando você cresce além das extensões de navegador | Plano gratuito, plano inicial a partir de US$ 29/mês + uso, níveis pagos maiores |

| ScrapingBee | API de scraping | Desenvolvedores extraindo sites pesados em JS | Boa opção quando você quer renderização e gestão de proxy sem construir a camada de navegador sozinho | Teste gratuito e planos pagos |

| ScraperAPI | API de scraping | Desenvolvedores escalando requisições rápido | API direta, créditos de teste, produtos estruturados e terceirização mais simples da infraestrutura | Teste de 7 dias com 5.000 créditos, pago a partir de US$ 49/mês |

| Bright Data | API corporativa + plataforma de proxies | Programas de alto volume e alta exigência de compliance | Stack de coleta de dados mais ampla quando desbloqueio, proxy e aquisição gerenciada importam mais que simplicidade | Preço por uso e por produto |

| Oxylabs | API corporativa + plataforma de proxies | Equipes comprando scraping como infraestrutura | Forte para coleta em larga escala, especialmente em preço, SEO e pesquisa de mercado | A API Web Scraper começa em US$ 49/mês; preços de proxies variam |

| Zyte | API + stack anti-bot | Equipes de desenvolvedores e dados | Boa opção se você quer extração API-first com fortes recursos de navegador, rotação e anti-detecção | Teste com US$ 5 de crédito grátis, compromissos por uso |

| Selenium | Automação de navegador open-source | Automação estilo QA e fluxos de interação difíceis | Continua útil quando a fidelidade da interação com o usuário importa mais do que a vazão do scraper | Gratuito e open-source |

| BeautifulSoup4 | Parser open-source | Iniciantes e parsing leve | Melhor como parser em uma stack simples, não como uma plataforma completa de scraping | Gratuito e open-source |

| Scrapy | Framework de crawling open-source | Crawlers personalizados de produção | Melhor equilíbrio entre poder e maturidade se você quiser assumir o pipeline internamente | Gratuito e open-source |

| Puppeteer | Automação de navegador open-source | Scraping orientado a Node e scripts de navegador | Ótimo se sua equipe já está confortável no ecossistema Chrome/Node | Gratuito e open-source |

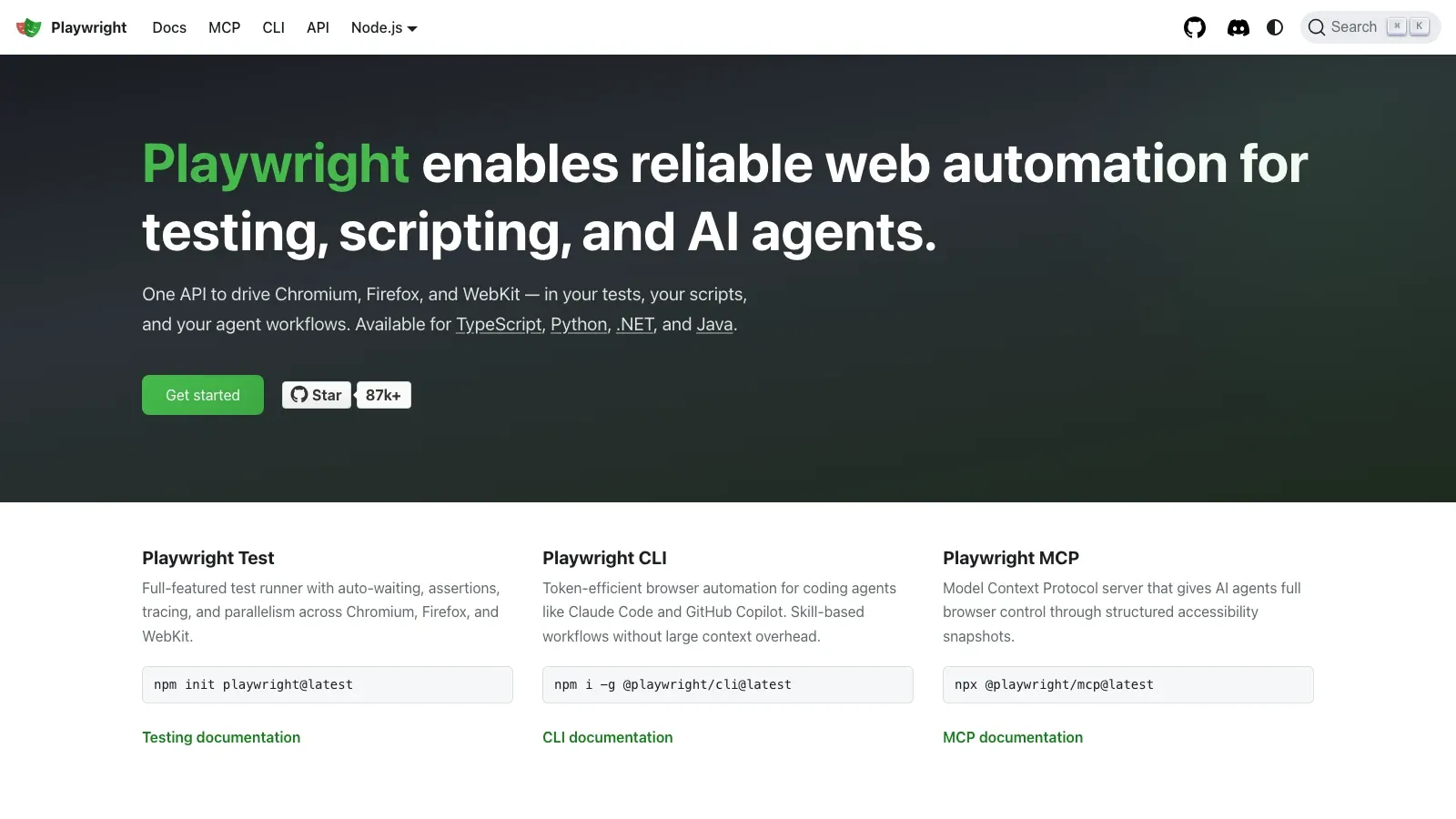

| Playwright | Automação de navegador open-source | Automação moderna multi-navegador | Muitas vezes a escolha mais limpa para automação moderna de navegador, com ótima ergonomia para desenvolvedores | Gratuito e open-source |

Como avaliei essas ferramentas

Usei quatro filtros:

- Tempo até a primeira extração bem-sucedida

Se um operador sem perfil técnico não consegue obter dados úteis rapidamente, isso importa. - Esforço de manutenção

Configurar rápido não significa nada se o fluxo quebra toda vez que um site muda. - Limite de escala

Algumas ferramentas são ideais para 50 páginas por semana e péssimas para 5 milhões de requisições por mês. - Aderência ao fluxo de trabalho

A melhor ferramenta para uma equipe de operações de receita raramente é a melhor para uma equipe de plataforma de dados.

O resultado não é um ranking universal. É uma página de decisão para escolher primeiro a classe certa de ferramenta e, depois, o produto certo dentro dessa classe.

Que tipo de ferramenta de web scraping você realmente precisa?

- Escolha Raspadores Web IA se seu objetivo principal é velocidade operacional.

- Escolha ferramentas sem código se você precisa de mais paginação, agendamento e controle repetível de tarefas.

- Escolha APIs e plataformas de scraping se renderização, rotação e capacidade de desbloqueio agora são o gargalo.

- Escolha bibliotecas de código aberto se sua equipe valoriza mais controle do que conveniência e consegue dar suporte à stack internamente.

Se sua equipe ainda está decidindo se o scraping deve ficar com operações ou engenharia, comece primeiro com uma ferramenta de IA ou sem código. Você vai aprender o que importa mais rápido executando trabalhos reais do que superprojetando a stack desde o início.

Melhores Raspadores Web IA para equipes de negócio

Estas são as ferramentas que eu olharia primeiro se o resultado desejado for dados prontos para planilha com o mínimo possível de configuração.

1. Thunderbit

A Thunderbit é a opção mais fácil aqui se sua equipe quer extrair dados estruturados sem aprender seletores, scripts de navegador ou infraestrutura de scraping. O fluxo é baseado em sugestão de campos por IA, enriquecimento de subpáginas e exportação direta para as ferramentas que usuários de negócio já usam.

- Melhor para: vendas, operações, ecommerce, imóveis e outras equipes que trabalham intensamente no navegador.

- Por que se destaca: reduz o tempo de configuração melhor do que qualquer outra opção desta lista para quem não programa.

- Atenção: se você precisa de lógica avançada de crawler ou controle técnico altamente especializado, eventualmente vai descer na stack.

- Modelo de preço: plano gratuito, planos pagos self-service e preços corporativos.

2. Browse AI

A Browse AI continua sendo uma ótima opção para usuários de negócio que querem configuração por clique e monitoramento recorrente. Seu modelo de robôs é especialmente útil quando scraping e detecção de mudanças são igualmente importantes.

- Melhor para: monitorar páginas de preços, páginas de concorrentes e extração repetível de listas.

- Por que se destaca: onboarding polido, robôs prontos e um caminho claro do site para a planilha ou saída no estilo API.

- Atenção: trabalhos complexos e de alto volume podem ficar caros ou operacionalmente incômodos mais rápido do que stacks API-first.

- Modelo de preço: plano gratuito, planos pagos, nível premium/gerenciado.

3. Bardeen

A Bardeen fica mais atraente quando o scraping é só uma etapa dentro de um fluxo maior de automação no navegador. Se você está levando dados para CRMs, planilhas ou fluxos outbound, o lado de automação pesa mais do que a profundidade bruta de scraping.

- Melhor para: operações de receita, fluxos de leads e automação de tarefas nativa do navegador.

- Por que se destaca: uma história de automação de fluxo mais forte do que ferramentas focadas apenas em extração.

- Atenção: não é a opção mais limpa quando o scraping em si é complexo e crítico para a operação.

- Modelo de preço: plano gratuito e planos pagos.

4. Diffbot

A Diffbot está aqui para equipes que precisam de extração por IA em escala enterprise, não para quem busca o caminho mais barato ou simples. Faz mais sentido quando qualidade de dados estruturados e ingestão em grande escala importam mais do que controle manual.

- Melhor para: equipes de dados corporativas, inteligência de conteúdo e programas grandes de extração.

- Por que se destaca: extração com estilo de visão computacional e forte orientação para saídas estruturadas.

- Atenção: exagerada para equipes pequenas e pouco prática se o caso de uso for leve.

- Modelo de preço: planos no estilo enterprise e processo comercial personalizado.

5. Instant Data Scraper

A Instant Data Scraper ainda merece lugar porque há muitas situações em que você só precisa da tabela, diretório ou lista visível agora. Não é uma plataforma, mas muitas vezes basta.

- Melhor para: extração pontual, listas rápidas de leads, diretórios simples e tabelas visíveis.

- Por que se destaca: quase zero atrito nas páginas certas.

- Atenção: automação limitada, pouca profundidade e baixa aderência a fluxos avançados.

- Modelo de preço: gratuito.

Melhores ferramentas de web scraping sem código para tarefas repetíveis

Quando o trabalho passa de um scraping ocasional, construtores visuais e execução na nuvem começam a importar.

6. Octoparse

A Octoparse continua sendo uma das plataformas sem código mais fortes se você precisa de execuções na nuvem, cobertura de modelos e gerenciamento de tarefas mais sofisticado do que uma extensão de navegador consegue oferecer.

- Melhor para: analistas, equipes de preços e operadores rodando trabalhos recorrentes de coleta.

- Por que se destaca: construtor de tarefas maduro, extração na nuvem, recursos anti-bloqueio e um grande ecossistema de modelos.

- Atenção: é mais poderosa do que ferramentas de navegador focadas em IA, mas isso também significa mais esforço de configuração.

- Modelo de preço: plano gratuito, pago a partir de US$ 69/mês, enterprise personalizado.

7. ParseHub

A ParseHub ainda é relevante para usuários que querem mais controle do que um raspador com IA, mas não querem construir uma base de código. Ela recompensa paciência, não velocidade.

- Melhor para: analistas e operadores tecnicamente curiosos que toleram uma curva de aprendizado mais íngreme.

- Por que se destaca: lógica de navegação flexível e mais controle do que ferramentas leves de navegador.

- Atenção: a experiência do produto parece mais pesada do que a de concorrentes mais novos, especialmente para equipes de negócio que se movem rápido.

- Modelo de preço: plano gratuito e planos pagos.

8. Web Scraper

A Web Scraper ainda é um ponto de entrada razoável se você gosta do modelo de sitemap e quer algo que comece no navegador e depois cresça para agendamento na nuvem.

- Melhor para: iniciantes, projetos hobby e trabalhos menores e repetíveis.

- Por que se destaca: fluxo de sitemap acessível e adoção fácil primeiro no navegador.

- Atenção: fica limitante quando você precisa de uma lógica de extração mais adaptativa.

- Modelo de preço: extensão gratuita do navegador e planos pagos na nuvem.

9. Data Miner

A Data Miner é melhor entendida como um utilitário rápido de extração, e não como uma plataforma completa de scraping. Ainda assim, merece um lugar porque o trabalho orientado por receitas é útil em muitas tarefas de pesquisa e prospecção.

- Melhor para: pesquisadores, equipes de growth e exportação rápida pela lateral do navegador.

- Por que se destaca: modelo de receitas, baixo atrito e exportação fácil no navegador.

- Atenção: não é a ferramenta certa para scraping em nível de plataforma.

- Modelo de preço: plano gratuito e planos pagos.

Melhores plataformas de API quando escala e bloqueio viram o problema real

Esta é a camada em que as equipes de engenharia param de pensar “como faço para raspar esta página?” e passam a pensar “como tornar isso confiável em volume?”.

10. Apify

A Apify é a plataforma mais flexível deste grupo se você quer tanto um marketplace de scrapers reutilizáveis quanto um lugar para rodar seu próprio código. Ela conecta descoberta sem código e execução para desenvolvedores melhor do que a maioria das concorrentes.

- Melhor para: equipes híbridas, scraping liderado por desenvolvedores e fluxos de automação reutilizáveis.

- Por que se destaca: ecossistema de Actors + runtime personalizado dá uma amplitude incomum.

- Atenção: quando você parte para código próprio, volta ao mundo da engenharia e a vantagem de simplicidade diminui.

- Modelo de preço: plano gratuito, plano inicial a partir de US$ 29/mês + uso, níveis maiores e enterprise.

11. ScrapingBee

A ScrapingBee é uma boa escolha quando sua necessidade real é “me entregue uma página renderizada e assuma a infraestrutura chata para mim”. Funciona bem para alvos pesados em JS.

- Melhor para: desenvolvedores extraindo sites dinâmicos com pouca disposição para lidar com infraestrutura.

- Por que se destaca: API simples para renderização, proxies e automação de navegador.

- Atenção: é um serviço de infraestrutura, então você ainda é responsável por parsing, lógica de retry e qualidade do que sai depois.

- Modelo de preço: teste e planos pagos.

12. ScraperAPI

A ScraperAPI ainda é uma das maneiras mais fáceis de terceirizar a gestão de proxies e a taxa de sucesso das requisições quando você quer escalar rápido.

- Melhor para: desenvolvedores que precisam sair de protótipo para volume rapidamente.

- Por que se destaca: API direta, créditos de teste, produtos estruturados e faixas de escala.

- Atenção: como todo produto API-first, não elimina a necessidade de julgamento de engenharia sobre parsing e validação de dados.

- Modelo de preço: teste de 7 dias com 5.000 créditos, pago a partir de US$ 49/mês.

13. Bright Data

A Bright Data é a opção pesada quando capacidade de desbloqueio, inventário de proxies e aquisição gerenciada importam mais do que simplicidade.

- Melhor para: programas enterprise, coleta em grande escala sensível a compliance e aquisição de dados gerenciada.

- Por que se destaca: amplitude de produtos de proxy, scraper, navegador e datasets.

- Atenção: cara e fácil de comprar além do necessário se seu fluxo principal ainda for relativamente simples.

- Modelo de preço: cobrança por uso e por produto em APIs, proxies e serviços gerenciados.

14. Oxylabs

A Oxylabs continua sendo uma escolha forte para equipes que compram scraping como infraestrutura, e não como ferramenta de navegador. Ela é especialmente relevante quando confiabilidade e maturidade de aquisição importam.

- Melhor para: coleta enterprise, monitoramento de preços, monitoramento de SEO e pesquisa de mercado.

- Por que se destaca: história de infraestrutura robusta, profundidade de proxies e um processo de compra mais claramente enterprise.

- Atenção: não é ideal se sua equipe quer um fluxo casual self-service.

- Modelo de preço: a API Web Scraper começa em US$ 49/mês; outros produtos variam por unidade e uso.

15. Zyte

A Zyte ainda merece consideração séria de equipes de desenvolvedores e dados que querem anti-detecção, ações de navegador, renderização de JS e IPs rotativos atrás de uma única proposta API-first.

- Melhor para: equipes técnicas construindo sistemas repetíveis de extração.

- Por que se destaca: ações de navegador, renderização de JS, rotação de IPs e postura anti-bot em uma só stack.

- Atenção: melhor para equipes com responsabilidade de engenharia do que para operadores sem perfil técnico.

- Modelo de preço: teste com US$ 5 de crédito grátis e compromissos mensais por uso.

Melhores bibliotecas open-source para desenvolvedores que querem controle total

Se você quer assumir a stack de scraper ponta a ponta, estes são os blocos de construção mais úteis em 2026.

16. Selenium

O Selenium ainda é útil quando você precisa de fidelidade de interação no estilo QA, fluxos de automação de navegador legados ou controle muito explícito de jornadas do usuário.

- Melhor para: automação com muita interação, sobreposição com QA e sites em que o comportamento do navegador importa mais do que a vazão do crawl.

- Por que se destaca: ecossistema maduro e amplo suporte a navegadores.

- Atenção: mais pesado e mais lento do que ferramentas de navegador mais novas para muitos trabalhos de scraping.

- Modelo de preço: gratuito e open-source.

17. BeautifulSoup4

BeautifulSoup não é uma plataforma completa de scraping, mas continua sendo uma das formas mais fáceis de fazer parsing de HTML bagunçado em fluxos leves.

- Melhor para: iniciantes, scripts rápidos e tarefas centradas em parsing.

- Por que se destaca: API simples e baixa carga cognitiva.

- Atenção: combine com ferramentas de requisição, navegador ou crawler; sozinho, é apenas um parser.

- Modelo de preço: gratuito e open-source.

18. Scrapy

O Scrapy ainda é a melhor resposta quando você precisa de um verdadeiro framework de crawler, e não de meia dúzia de scripts.

- Melhor para: crawlers personalizados de produção e pipelines de dados sob responsabilidade interna.

- Por que se destaca: alto desempenho, pipelines, middlewares e extensibilidade de longo prazo.

- Atenção: existe overhead real de engenharia, e alvos pesados em JS muitas vezes exigem ferramentas complementares.

- Modelo de preço: gratuito e open-source.

19. Puppeteer

Puppeteer continua sendo uma boa escolha para equipes centradas em Node que querem controle direto sobre Chromium e scripts de navegador.

- Melhor para: scraping em Node, capturas de tela e tarefas de automação de navegador.

- Por que se destaca: controle direto e poderoso do comportamento do Chromium.

- Atenção: ecossistema de navegadores mais restrito do que o Playwright e ainda bastante consumidor de recursos em escala.

- Modelo de preço: gratuito e open-source.

20. Playwright

Playwright é minha recomendação padrão para automação moderna de navegador se sua equipe escreve código e quer uma abstração mais nova do que o Selenium.

- Melhor para: automação moderna de navegador, sites pesados em JS e equipes que valorizam ergonomia para desenvolvedores.

- Por que se destaca: modelo forte multi-navegador, comportamento de espera confiável e APIs limpas.

- Atenção: você ainda é responsável pela infraestrutura do navegador, concorrência, mudanças de seletor e validação de dados.

- Modelo de preço: gratuito e open-source.

Minha lista curta por tipo de equipe

- Equipes de vendas e operações: comece com a Thunderbit e depois veja Browse AI se monitoramento importar mais do que enriquecimento de subpáginas.

- Analistas e equipes de pesquisa: Octoparse primeiro, se trabalhos recorrentes forem maiores do que ferramentas de extensão de navegador conseguem lidar com conforto.

- Equipes GTM com muita automação: Bardeen se o scraping for apenas uma etapa de um fluxo mais amplo.

- Equipes de desenvolvimento criando ferramentas internas: Apify, Zyte, ScraperAPI ou Playwright, dependendo de quanto da stack você quer assumir.

- Programas enterprise de dados: Bright Data, Oxylabs, Diffbot e Zyte são as conversas sérias sobre infraestrutura.

Quando descer na stack

Use esta regra:

- Continue com ferramentas de IA até encontrar limites de repetibilidade ou casos extremos.

- Mude para ferramentas sem código quando agendamento, paginação, anti-bloqueio ou execuções na nuvem importarem mais do que a simplicidade de um clique.

- Mude para APIs quando taxa de desbloqueio, renderização de JS e concorrência virarem os verdadeiros gargalos.

- Mude para bibliotecas open-source quando o custo da abstração do fornecedor se tornar maior do que o custo de assumir toda a stack.

A maioria das equipes desce na stack cedo demais. Esse é um dos erros mais comuns que vejo.

Conclusão final

Para a maioria das equipes sem perfil técnico, a resposta certa em 2026 não é “o scraper mais poderoso”. É a ferramenta que leva dados precisos para o próximo fluxo de trabalho com a menor manutenção possível. É por isso que ferramentas AI-first continuam vencendo para operadores, enquanto APIs e stacks open-source seguem sendo a melhor opção para equipes técnicas com requisitos claros de escala.

Se você quer o caminho mais curto da página até uma saída estruturada, comece com a Thunderbit. Se você já sabe que seu trabalho exige infraestrutura pesada, vá direto para as camadas de API e de desenvolvedor. Só não confunda complexidade com sofisticação.

FAQs

1. Qual é a melhor ferramenta de web scraping para usuários sem perfil técnico em 2026?

Para a maioria dos usuários sem perfil técnico, ferramentas AI-first como Thunderbit e Browse AI oferecem o caminho mais rápido para dados úteis porque reduzem o trabalho com seletores, o atrito de configuração e o esforço de manutenção.

2. O que devo escolher se meus sites usam muito JavaScript ou bloqueiam requisições com agressividade?

Avance para ScrapingBee, ScraperAPI, Zyte, Bright Data, Oxylabs, Playwright ou Selenium, dependendo se você quer um serviço gerenciado ou controle direto de engenharia.

3. Ferramentas sem código ainda são relevantes agora que os Raspadores Web IA estão melhores?

Sim. Ferramentas sem código como Octoparse e ParseHub ainda importam quando você precisa de mais controle explícito sobre a lógica da tarefa, a execução na nuvem e o gerenciamento de trabalhos repetíveis.

4. Quais ferramentas fazem mais sentido para equipes de engenharia?

Apify, Zyte, ScraperAPI, Scrapy, Playwright, Puppeteer e Selenium são as escolhas mais naturais quando os desenvolvedores são donos do fluxo.

5. Como fazer uma lista curta rapidamente em vez de pesquisar demais?

Primeiro escolha o tipo de ferramenta, não o fornecedor. Decida se você precisa de simplicidade de IA, controle sem código, infraestrutura via API ou propriedade open-source. Depois compare os produtos dentro dessa camada.

Leituras relacionadas