A web está transbordando de dados, mas há um problema: recolhê-los manualmente é tão divertido quanto ver tinta secar — e igualmente improdutivo. Em 2025, as empresas estão a afogar-se em mais conteúdo da web do que nunca, com a entrada diária média de dados web das companhias a saltar de 1,2 TB em 2020 para 8 TB em 2025 (). Seja em vendas, marketing, ecommerce ou operações, a necessidade de dados web rápidos, estruturados e precisos não é apenas um “diferencial” — é uma necessidade operacional. E sejamos honestos: ninguém tem tempo para maratonas intermináveis de copiar e colar.

É por isso que as ferramentas de raspagem da web explodiram em popularidade. Estas ferramentas — que vão de extensões de Chrome com IA a plataformas empresariais — permitem automatizar todo o processo, transformando páginas confusas em folhas de cálculo limpas, bases de dados ou painéis em tempo real. Passei anos em SaaS e automação, e posso dizer: a ferramenta certa não só poupa tempo, como pode transformar a forma como a sua equipa trabalha. Então, vamos mergulhar nas 18 melhores ferramentas de rastreamento de conteúdo para fazer raspagem da web com eficiência em 2025, com foco no que torna cada uma única, como se encaixam em diferentes necessidades de negócio e como escolher a melhor opção para o seu fluxo de trabalho.

Por que as empresas precisam das melhores ferramentas de rastreamento de conteúdo

Se alguma vez tentou montar uma lista de leads, monitorizar preços da concorrência ou acompanhar o sentimento do mercado manualmente, sabe o quão depressa a recolha de dados se torna um pesadelo. É lenta, propensa a erros e, quando termina, os dados já podem estar desatualizados. É por isso que mais de 70% das empresas adotaram a extração automatizada da web até 2025, reduzindo o esforço manual em cerca de 60% ().

As ferramentas de rastreamento de conteúdo automatizam a extração de dados estruturados de sites, tornando possível:

- Inserir novos leads no seu CRM (sem mais copiar e colar de diretórios)

- Monitorizar preços e níveis de stock dos concorrentes em tempo real

- Agregar avaliações, notícias e menções nas redes sociais para insights de marketing

- Criar conjuntos de dados personalizados para pesquisa ou analytics

- Agendar recolhas recorrentes de dados para relatórios contínuos

E o ROI é real: empresas que usam raspagem da web relataram uma poupança coletiva de mais de US$ 500 milhões entre 2020 e 2025, com ganhos de eficiência operacional de 20% a 40% (). Em resumo? As ferramentas de rastreamento de conteúdo libertam a sua equipa para se focar em estratégia, e não em tarefas maçadoras.

Como selecionamos as melhores ferramentas de rastreamento de conteúdo

Nem todos os raspadores web são iguais. Ao montar esta lista, analisei as ferramentas do ponto de vista de utilizadores reais de negócio — equipas de vendas, marketing, operações e pesquisa que precisam de resultados, não de dores de cabeça. Eis o que mais importou:

- Facilidade de uso: Utilizadores sem perfil técnico conseguem começar depressa? Há interface de apontar e clicar ou assistência por IA?

- Automação e recursos: A ferramenta lida com paginação, subpáginas, agendamento e conteúdo dinâmico? Pode correr na nuvem para ganhar velocidade e escala?

- Saída e integração de dados: É possível exportar para Excel, CSV, Google Sheets, Airtable, Notion ou ligar via API?

- Escalabilidade: Serve para tarefas pontuais ou para projetos contínuos e em grande escala?

- Personalização: Dá para ajustar a lógica de extração, adicionar campos personalizados ou lidar com sites complicados?

- Conformidade e privacidade: A ferramenta ajuda a manter você dentro das regras de GDPR, CCPA e dos termos do site?

- Suporte e comunidade: Há documentação, suporte ou comunidade de utilizadores para ajudar na resolução de problemas?

- Custo: Existe plano gratuito ou teste? O preço encaixa na sua escala e no seu orçamento?

E, claro, dei um destaque especial para a Thunderbit — a ferramenta que a minha equipa e eu criámos — porque acredito mesmo que ela é a forma mais fácil para utilizadores de negócio começarem com raspagem da web com IA.

As 18 melhores ferramentas de rastreamento de conteúdo para raspagem da web eficiente

Vamos destrinçar o que há de melhor, da simplicidade com IA às potências para programadores e tudo o que existe no meio.

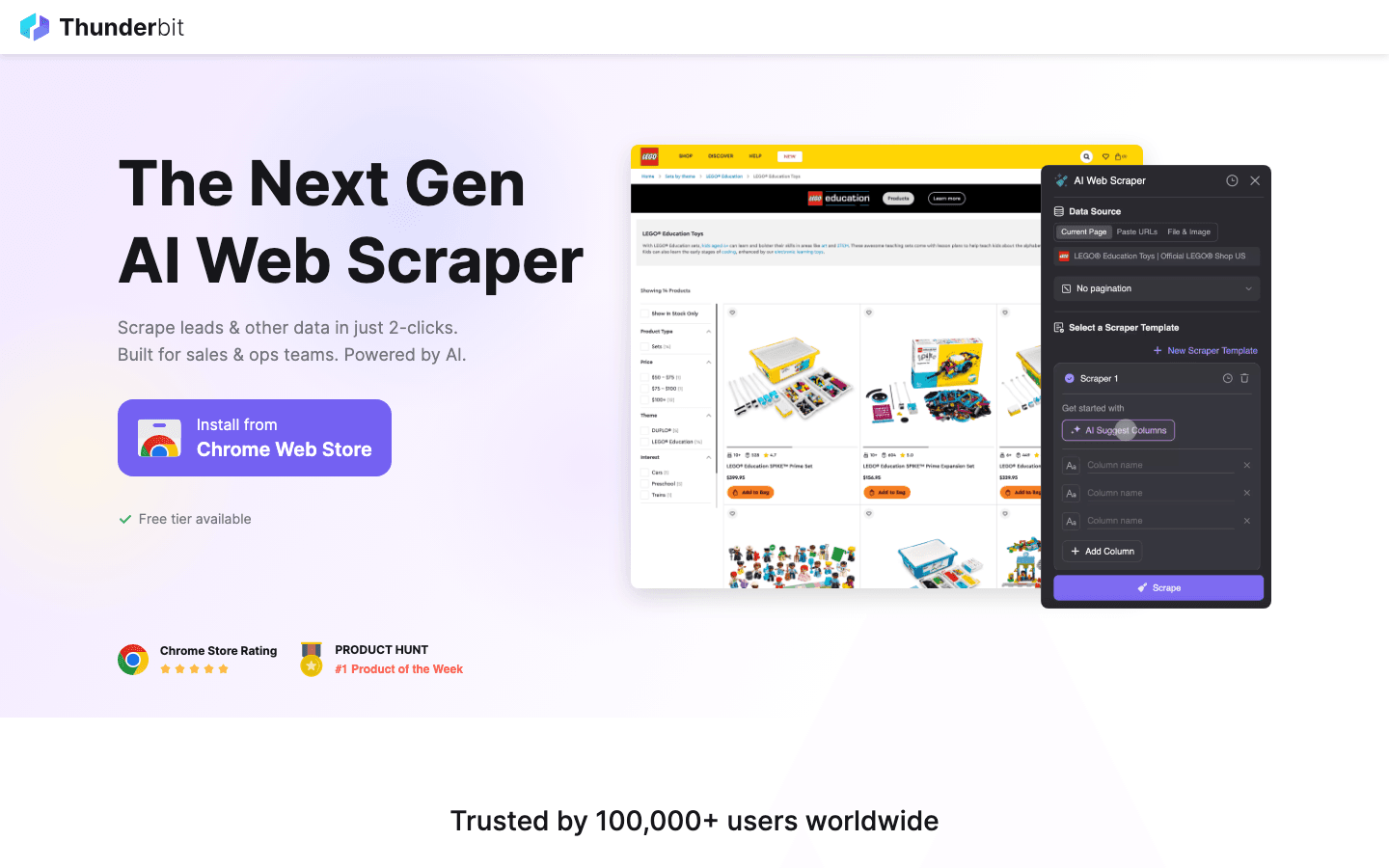

1. Thunderbit

é uma extensão de Chrome de raspador web ia criada para utilizadores de negócio que querem resultados — e depressa. O seu recurso mais marcante é o AI Suggest Fields: basta abrir uma página, clicar em “AI Suggest”, e a IA da Thunderbit lê a página, recomenda os campos a extrair e configura o raspador por si. Sem código, sem mexer em seletores — é só clicar, extrair e exportar.

é uma extensão de Chrome de raspador web ia criada para utilizadores de negócio que querem resultados — e depressa. O seu recurso mais marcante é o AI Suggest Fields: basta abrir uma página, clicar em “AI Suggest”, e a IA da Thunderbit lê a página, recomenda os campos a extrair e configura o raspador por si. Sem código, sem mexer em seletores — é só clicar, extrair e exportar.

- Raspagem de subpáginas: A Thunderbit pode visitar automaticamente cada subpágina (como detalhes de produtos ou perfis) e enriquecer o seu conjunto de dados, ideal para geração de leads ou pesquisa de ecommerce.

- Paginação e modelos: Lida com listas de várias páginas e oferece modelos instantâneos para sites como Amazon, Zillow e Instagram.

- Exportação gratuita de dados: Exporte para Excel, Google Sheets, Airtable, Notion, CSV ou JSON — sem paywall.

- Preenchimento automático com IA: Automatize o preenchimento de formulários online com IA, indo além da raspagem e entrando na automação de fluxos de trabalho.

- Raspagem na nuvem e no navegador: Escolha a raspagem rápida na nuvem para sites públicos ou o modo navegador para sessões com login.

- Preço: Grátis para até 6 páginas (ou 10 no teste), com planos pagos a partir de apenas US$ 15/mês.

A Thunderbit é perfeita para equipas de vendas, marketing e operações que querem automatizar a recolha de dados sem dores técnicas. É a ferramenta que eu gostaria de ter tido há anos — agora, qualquer pessoa pode montar uma lista de leads ou monitorizar concorrentes em minutos.

2. Scrapy

é a potência open source para programadores. É um framework baseado em Python que permite escrever spiders personalizados para rastrear e extrair dados em escala. O Scrapy foi feito para velocidade e flexibilidade, com suporte a rastreamento assíncrono, pipelines personalizados, rotação de proxies e integração com bases de dados ou APIs.

é a potência open source para programadores. É um framework baseado em Python que permite escrever spiders personalizados para rastrear e extrair dados em escala. O Scrapy foi feito para velocidade e flexibilidade, com suporte a rastreamento assíncrono, pipelines personalizados, rotação de proxies e integração com bases de dados ou APIs.

- Ideal para: Programadores e engenheiros de dados que constroem projetos grandes, complexos ou recorrentes de raspagem.

- Pontos fortes: Controlo total, extensibilidade, comunidade enorme e fiabilidade testada em produção.

- Pontos fracos: Curva de aprendizagem alta para quem não programa; sem interface visual.

Se domina Python e quer criar rastreadores robustos e escaláveis, o Scrapy é o padrão de ouro.

3. Octoparse

é um raspador web sem código, baseado na nuvem, com interface visual de arrastar e soltar. Pode apontar e clicar para selecionar dados, configurar paginação e até usar deteção de padrões assistida por IA para acelerar a configuração.

é um raspador web sem código, baseado na nuvem, com interface visual de arrastar e soltar. Pode apontar e clicar para selecionar dados, configurar paginação e até usar deteção de padrões assistida por IA para acelerar a configuração.

- Modelos prontos: Extraia dados de sites populares como Amazon, Twitter e Google Maps em minutos.

- Raspagem na nuvem e agendamento: Execute tarefas nos servidores da Octoparse, agende rotinas recorrentes e lide com projetos em grande escala.

- Opções de exportação: CSV, Excel, JSON, integração via API.

- Preço: Plano gratuito com limites; planos pagos a partir de cerca de US$ 75/mês.

O Octoparse é ideal para analistas de negócio e não programadores que querem raspagem poderosa sem escrever código.

4. ParseHub

é um raspador web visual que se destaca ao lidar com conteúdo dinâmico e estruturas complexas de sites. A sua interface de apontar e clicar permite criar fluxos com lógica condicional, loops e navegação em vários níveis.

é um raspador web visual que se destaca ao lidar com conteúdo dinâmico e estruturas complexas de sites. A sua interface de apontar e clicar permite criar fluxos com lógica condicional, loops e navegação em vários níveis.

- Conteúdo dinâmico: Lida com menus suspensos, rolagem infinita e elementos interativos.

- Execuções na nuvem e locais: Corra projetos na nuvem (pago) ou localmente para tarefas menores.

- Exportação: CSV, Excel, JSON, API.

- Preço: Plano gratuito generoso; planos pagos a partir de US$ 49/mês.

O ParseHub é ótimo para quem não programa, mas precisa de flexibilidade e potência para sites difíceis.

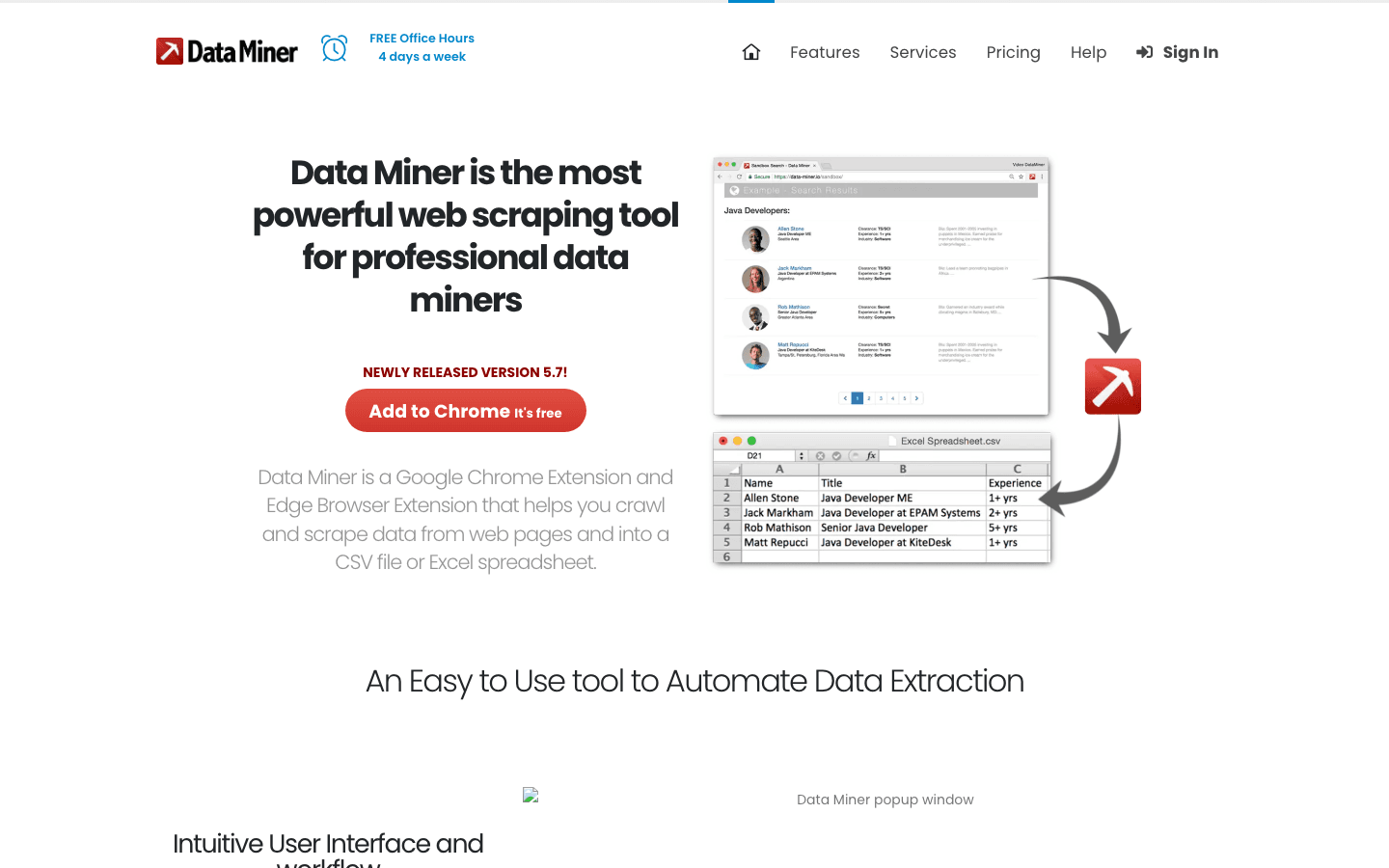

5. Data Miner

é uma extensão para Chrome/Edge voltada para raspagem rápida baseada em modelos. Com mais de 50 mil receitas públicas de extração para mais de 15 mil sites, muitas vezes consegue extrair uma página com um clique.

é uma extensão para Chrome/Edge voltada para raspagem rápida baseada em modelos. Com mais de 50 mil receitas públicas de extração para mais de 15 mil sites, muitas vezes consegue extrair uma página com um clique.

- Integração com Google Sheets: Envie os dados extraídos diretamente para o Sheets.

- Receitas personalizadas: Crie a sua própria lógica de extração com apontar e clicar ou XPath.

- Paginação e automação: Lida com raspagem de várias páginas e execuções agendadas.

- Preço: Plano gratuito; planos pagos a partir de US$ 19/mês.

Perfeito para analistas e profissionais de marketing que precisam de recolhas rápidas de pequeno a médio porte diretamente no navegador.

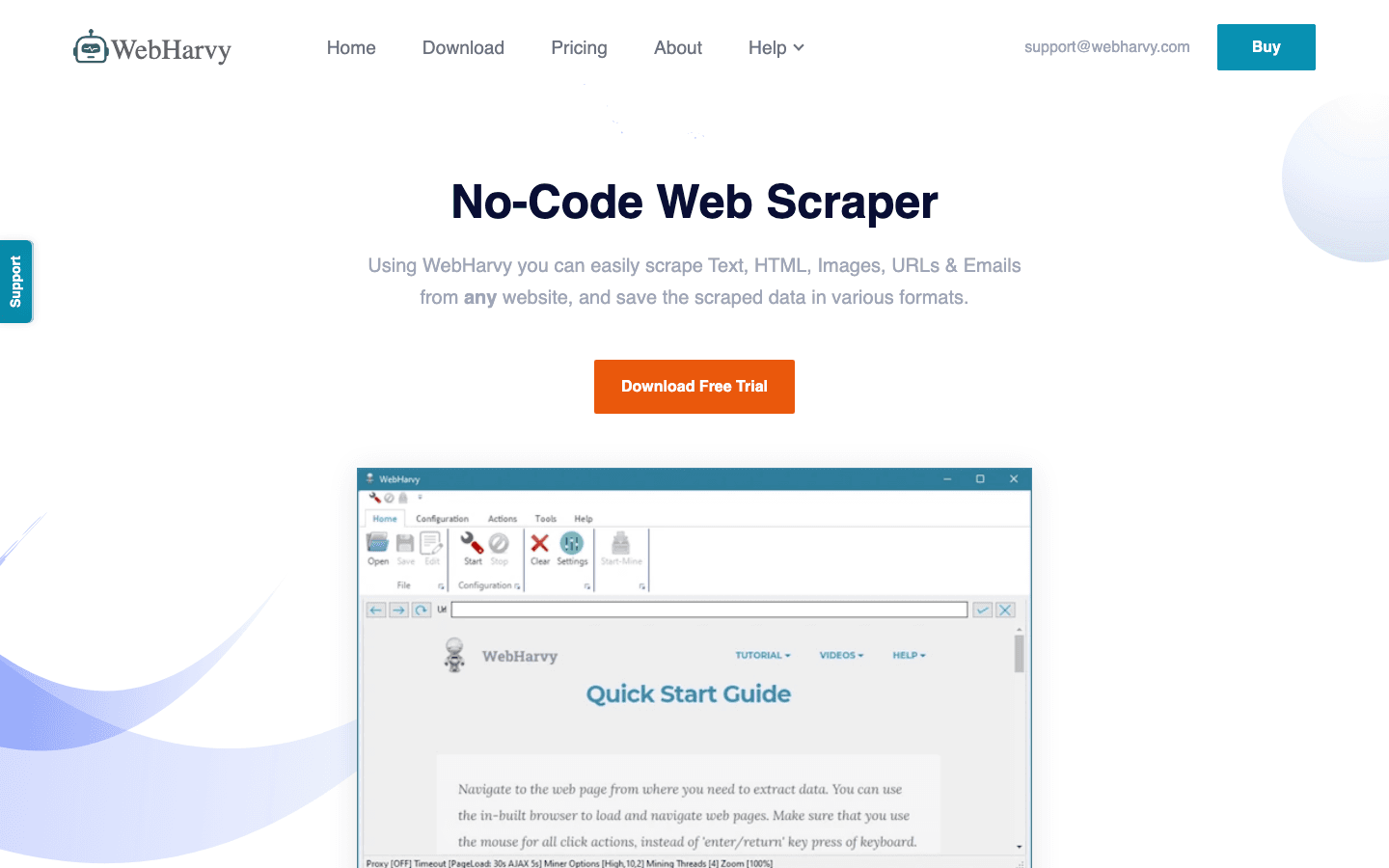

6. WebHarvy

é uma aplicação desktop para Windows com interface de apontar e clicar e deteção automática de padrões. Basta clicar num elemento, e o WebHarvy destaca todos os itens semelhantes para extração.

é uma aplicação desktop para Windows com interface de apontar e clicar e deteção automática de padrões. Basta clicar num elemento, e o WebHarvy destaca todos os itens semelhantes para extração.

- Suporta imagens, texto e paginação: Extraia fotos de produtos, e-mails, URLs e muito mais.

- Agendamento no desktop: Programe raspagens no seu PC.

- Licença única: Cerca de US$ 199 por computador.

Excelente para pequenas empresas que querem uma ferramenta simples, sem subscrição, para raspagens periódicas.

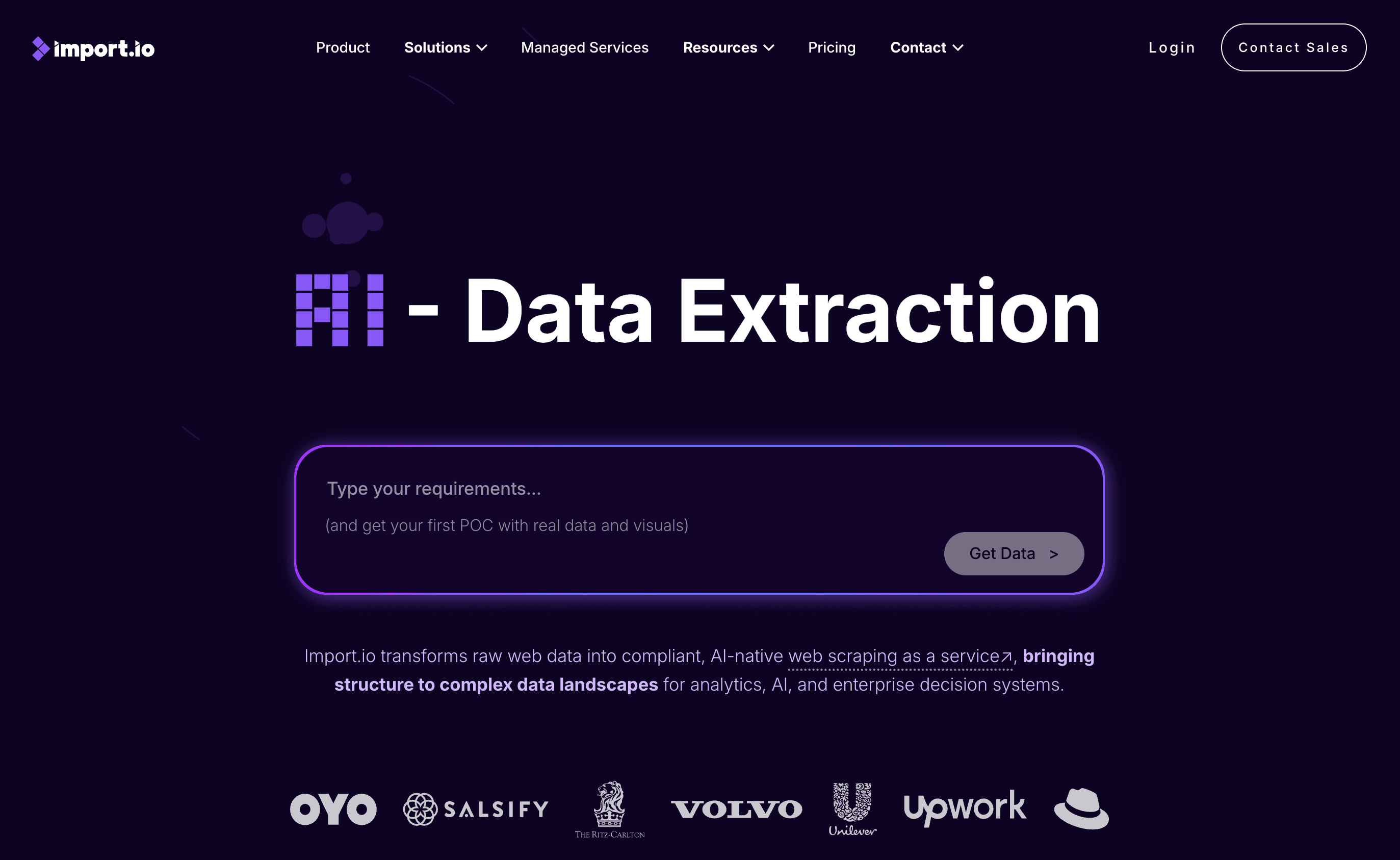

7. Import.io

é uma plataforma empresarial baseada na nuvem para extração de dados em grande escala. Oferece limpeza de dados com IA, monitorização em tempo real e recursos robustos de conformidade.

é uma plataforma empresarial baseada na nuvem para extração de dados em grande escala. Oferece limpeza de dados com IA, monitorização em tempo real e recursos robustos de conformidade.

- Integrações via API: Entregue dados diretamente para bases de dados, painéis de BI ou aplicações.

- Conformidade: Desenvolvida com GDPR e CCPA em mente.

- Preço: Contratos empresariais; faixa mais alta.

Ideal para grandes organizações que precisam de pipelines de dados web fiáveis, conformes e escaláveis.

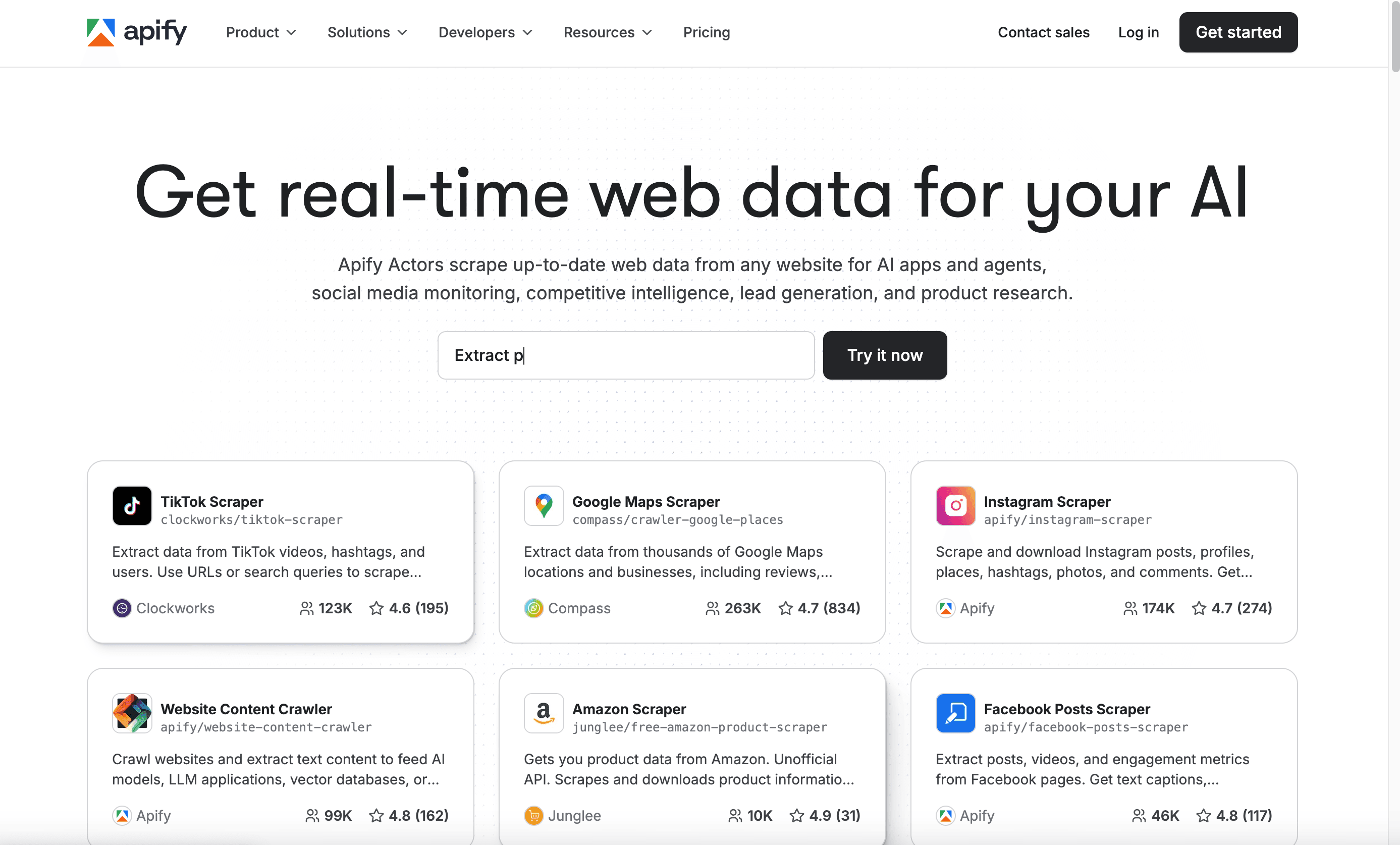

8. Apify

é uma plataforma de automação em nuvem e marketplace de “actors” para raspagem da web (bots). Use actors prontos para sites comuns ou crie os seus em JavaScript ou Python.

é uma plataforma de automação em nuvem e marketplace de “actors” para raspagem da web (bots). Use actors prontos para sites comuns ou crie os seus em JavaScript ou Python.

- Marketplace: Centenas de raspadores prontos para sites como LinkedIn, Amazon e muito mais.

- Agendamento e API: Execute, agende e integre actors via API.

- Preço: Plano gratuito; uso pago a partir de US$ 49/mês.

Ideal para programadores e equipas com perfil técnico que querem automação, flexibilidade e soluções impulsionadas pela comunidade.

9. Visual Web Ripper

é uma ferramenta desktop para extração avançada e em massa de dados. O seu construtor de fluxos permite criar rastreios em vários níveis e automatizar projetos de grande escala.

é uma ferramenta desktop para extração avançada e em massa de dados. O seu construtor de fluxos permite criar rastreios em vários níveis e automatizar projetos de grande escala.

- Agendamento e automação: Execute projetos em intervalos definidos.

- Integração com base de dados: Exporte diretamente para SQL, Excel, CSV, XML ou JSON.

- Licença única: Cerca de US$ 349.

Melhor para equipas de TI ou utilizadores avançados que precisam de extrair grandes volumes de dados internamente.

10. Dexi.io

é uma plataforma baseada na nuvem para projetos colaborativos de dados da web. Oferece automação de fluxos de trabalho, agendamento e recursos de gestão de equipas.

é uma plataforma baseada na nuvem para projetos colaborativos de dados da web. Oferece automação de fluxos de trabalho, agendamento e recursos de gestão de equipas.

- Automação de fluxo de trabalho: Crie e partilhe pipelines de dados entre equipas.

- API e exportação: Integre com bases de dados, armazenamento na nuvem ou ferramentas de BI.

- Preço: Personalizado; voltado para equipas e empresas.

Ótima para organizações que gerem projetos de dados contínuos e colaborativos.

11. Content Grabber

é uma ferramenta de raspagem de nível profissional para agências e empresas. Oferece automação avançada, tratamento de erros e até opções de white-label.

é uma ferramenta de raspagem de nível profissional para agências e empresas. Oferece automação avançada, tratamento de erros e até opções de white-label.

- Scripting e personalização: Use C# ou VB.NET para ter controlo profundo.

- Recuperação de erros e logs: Criado para ser fiável em tarefas grandes.

- Preço empresarial: Faixa mais alta; teste gratuito disponível.

Melhor para agências ou empresas que constroem soluções personalizadas e repetíveis de raspagem para clientes.

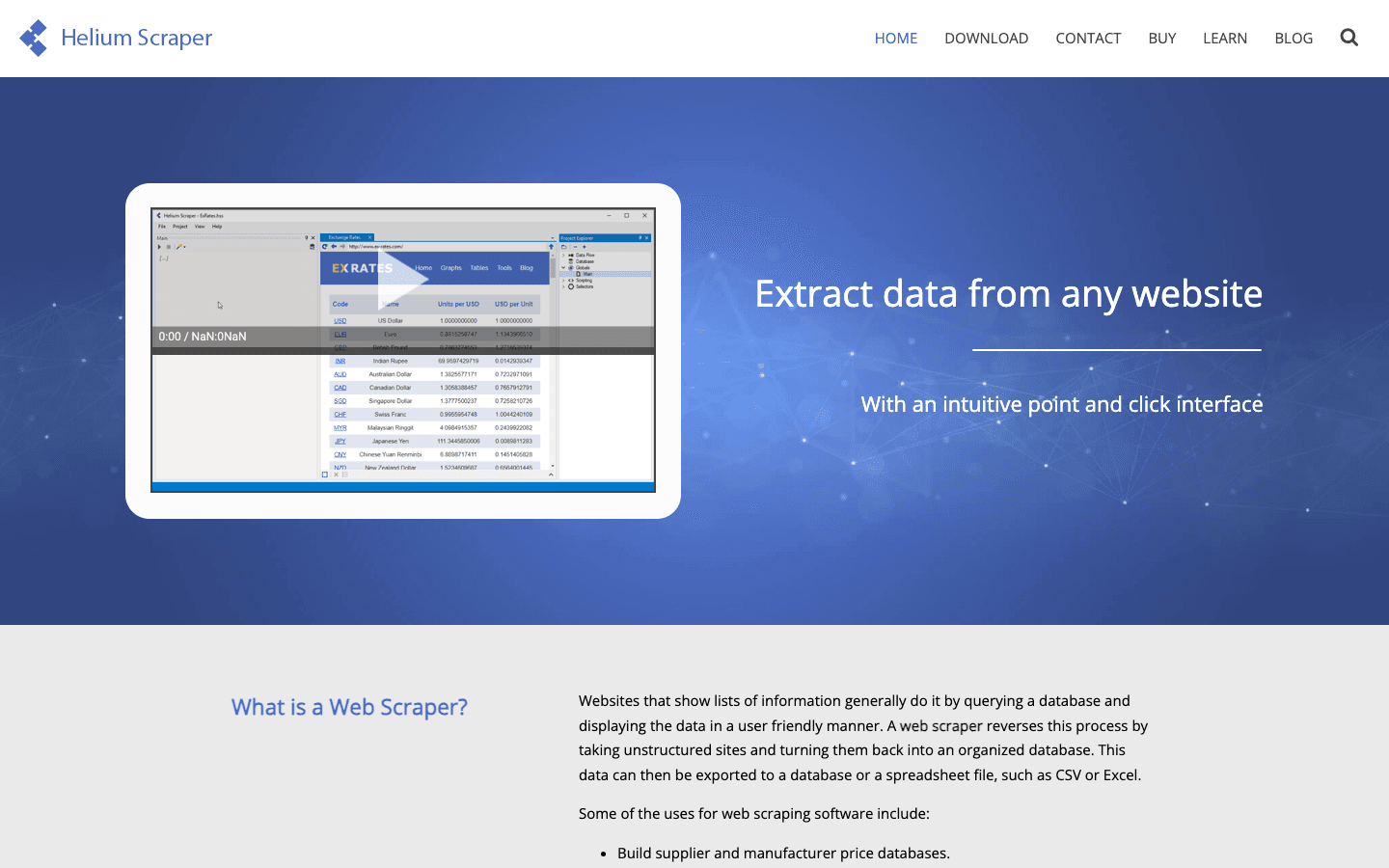

12. Helium Scraper

é uma ferramenta desktop que combina extração visual com flexibilidade de scripting. Use apontar e clicar para a maioria das tarefas ou avance para JavaScript personalizado para lógica mais avançada.

é uma ferramenta desktop que combina extração visual com flexibilidade de scripting. Use apontar e clicar para a maioria das tarefas ou avance para JavaScript personalizado para lógica mais avançada.

- Lida com conteúdo dinâmico: Extraia sites com forte uso de AJAX.

- Limpeza e transformação de dados: Scripting nativo para fluxos personalizados.

- Licença única: Cerca de US$ 99.

Perfeito para utilizadores avançados que querem flexibilidade sem subscrição.

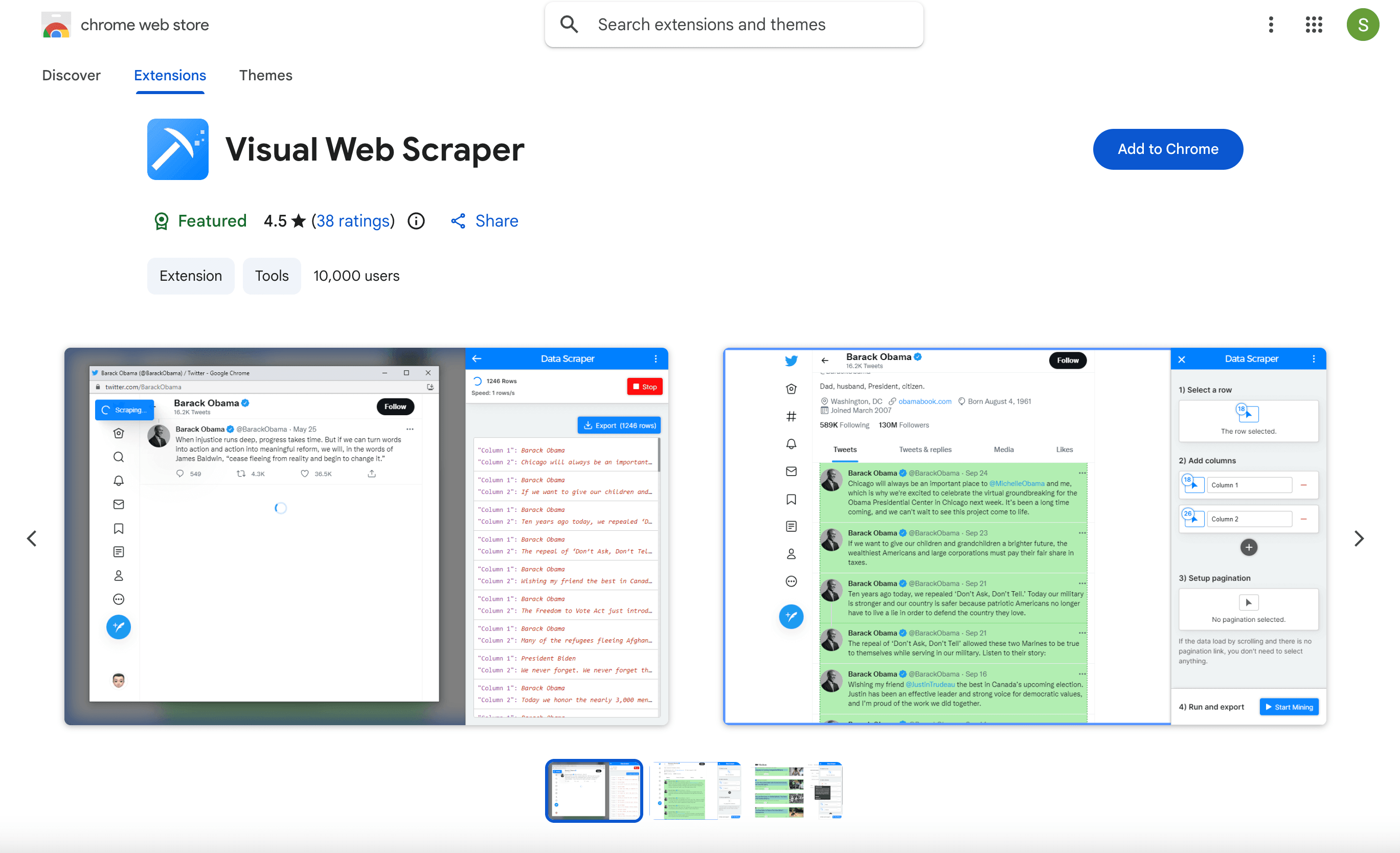

13. Web Scraper

é uma extensão gratuita para Chrome que apresenta muita gente à raspagem da web. Defina um sitemap, clique para selecionar elementos e exporte para CSV ou JSON.

é uma extensão gratuita para Chrome que apresenta muita gente à raspagem da web. Defina um sitemap, clique para selecionar elementos e exporte para CSV ou JSON.

- Rastreamento em vários níveis: Siga links, lide com paginação e extraia dados aninhados.

- Grátis para uso local: Há versão paga na nuvem para agendamento e escala.

Ideal para principiantes, estudantes ou qualquer pessoa que precise de uma solução rápida e gratuita para tarefas pequenas.

14. Mozenda

é uma plataforma empresarial na nuvem com foco em conformidade, escalabilidade e serviços geridos. A sua interface de apontar e clicar permite criar “agents” para extração de dados.

é uma plataforma empresarial na nuvem com foco em conformidade, escalabilidade e serviços geridos. A sua interface de apontar e clicar permite criar “agents” para extração de dados.

- Serviços geridos: A equipa da Mozenda pode criar e manter raspadores para si.

- Conformidade e suporte: Forte foco em GDPR, CCPA e necessidades empresariais.

- Preço: A partir de cerca de US$ 500/mês.

Melhor para grandes organizações que querem uma solução completa e escalável de dados web com suporte forte.

15. SimpleIndex

é uma ferramenta de automação para extração de dados de documentos e da web, com foco em OCR e indexação.

é uma ferramenta de automação para extração de dados de documentos e da web, com foco em OCR e indexação.

- OCR para screen scraping: Extraia dados de documentos digitalizados, PDFs ou até formulários web exibidos no ecrã.

- Integração: Saída para bases de dados e sistemas de gestão documental.

- Licença única: Algumas centenas de dólares por estação de trabalho.

Ótimo para organizações que combinam fluxos de trabalho de documentos e dados web.

16. Spinn3r

é uma plataforma de rastreamento de conteúdo em tempo real para blogs, notícias e redes sociais. A sua Firehose API entrega um fluxo contínuo de novo conteúdo de milhões de fontes.

é uma plataforma de rastreamento de conteúdo em tempo real para blogs, notícias e redes sociais. A sua Firehose API entrega um fluxo contínuo de novo conteúdo de milhões de fontes.

- Filtragem de spam e processamento de linguagem: Feeds de dados limpos e estruturados.

- Acesso via API: Integre diretamente nos seus sistemas.

- Preço por assinatura: Baseado no uso.

Melhor para monitorização de media, agregação de notícias ou equipas de pesquisa que precisam de fluxos de conteúdo em tempo real.

17. FMiner

é um construtor visual de fluxos para rastreamentos web complexos. A sua interface de arrastar e soltar permite criar rotinas de raspagem em vários níveis e com condições.

é um construtor visual de fluxos para rastreamentos web complexos. A sua interface de arrastar e soltar permite criar rotinas de raspagem em vários níveis e com condições.

- Scripting em Python: Insira código personalizado para lógica avançada.

- Multiplataforma: Disponível para Windows e Mac.

- Licença única: A partir de cerca de US$ 168.

Perfeito para analistas ou cientistas de dados que querem mapear fluxos de trabalho sofisticados visualmente.

18. G2 Webscraper

(referindo-se às ferramentas mais bem avaliadas no G2) é elogiado pela simplicidade e eficiência. Os utilizadores adoram ferramentas gratuitas, fáceis e que poupam muito tempo — como a extensão Web Scraper Chrome ou o Data Miner.

(referindo-se às ferramentas mais bem avaliadas no G2) é elogiado pela simplicidade e eficiência. Os utilizadores adoram ferramentas gratuitas, fáceis e que poupam muito tempo — como a extensão Web Scraper Chrome ou o Data Miner.

- Avaliações fortes de utilizadores: Classificações altas de facilidade de uso e fiabilidade.

- Configuração rápida: Curva de aprendizagem mínima para tarefas básicas e intermédias.

Se quer uma ferramenta que “simplesmente funciona” para raspagem direta, os favoritos dos utilizadores no G2 são uma aposta segura.

Tabela comparativa: as melhores ferramentas de rastreamento de conteúdo num relance

| Ferramenta | Facilidade de uso | Automação e recursos | Formatos de exportação | Conformidade e privacidade | Preço | Melhor para |

|---|---|---|---|---|---|---|

| Thunderbit | ⭐⭐⭐⭐⭐ | Campos por IA, subpáginas, nuvem | Excel, CSV, Sheets, Notion, Airtable, JSON | Orientado pelo utilizador | Grátis, a partir de US$ 15/mês | Não programadores, vendas, operações |

| Scrapy | ⭐ | Código completo, assíncrono, plugins | CSV, JSON, base de dados | Gerido pelo utilizador | Grátis, open source | Programadores, grandes projetos |

| Octoparse | ⭐⭐⭐⭐ | Visual, modelos, nuvem | CSV, Excel, JSON, API | Orientado pelo utilizador | Grátis, a partir de US$ 75/mês | Analistas, ecommerce, não programadores |

| ParseHub | ⭐⭐⭐⭐ | Visual, dinâmico, nuvem | CSV, Excel, JSON, API | Orientado pelo utilizador | Grátis, a partir de US$ 49/mês | Não programadores, sites complexos |

| Data Miner | ⭐⭐⭐⭐⭐ | Modelos, navegador, Sheets | CSV, Excel, Sheets | Orientado pelo utilizador | Grátis, a partir de US$ 19/mês | Tarefas rápidas no navegador |

| WebHarvy | ⭐⭐⭐⭐⭐ | Visual, deteção de padrões | Excel, CSV, XML, JSON | Orientado pelo utilizador | US$ 199 pagamento único | Utilizadores Windows, pequenas empresas |

| Import.io | ⭐⭐⭐⭐ | IA, nuvem, monitorização | CSV, API, base de dados | GDPR, CCPA | Empresarial | Grandes empresas, conformidade |

| Apify | ⭐⭐⭐ | Nuvem, marketplace, API | JSON, API, Sheets | Gerido pelo utilizador | Grátis, a partir de US$ 49/mês | Devs, automação, integrações |

| Visual Web Ripper | ⭐⭐⭐ | Fluxo de trabalho, agendamento | CSV, Excel, base de dados | Orientado pelo utilizador | US$ 349 pagamento único | Equipas de TI, grandes volumes |

| Dexi.io | ⭐⭐⭐ | Nuvem, equipa, fluxo | CSV, API, base de dados, armazenamento | Orientado pelo utilizador | Personalizado | Equipas, projetos contínuos |

| Content Grabber | ⭐⭐⭐ | Scripting, automação | CSV, XML, base de dados | Orientado pelo utilizador | Empresarial | Agências, soluções personalizadas |

| Helium Scraper | ⭐⭐⭐ | Visual + scripting | CSV, base de dados | Orientado pelo utilizador | US$ 99 pagamento único | Utilizadores avançados, lógica personalizada |

| Web Scraper | ⭐⭐⭐⭐⭐ | Sitemap, navegador | CSV, JSON | Orientado pelo utilizador | Grátis (local) | Iniciantes, tarefas pequenas |

| Mozenda | ⭐⭐⭐ | Nuvem, gerido, conformidade | CSV, API, base de dados | GDPR, CCPA | US$ 500+/mês | Empresarial, serviço gerido |

| SimpleIndex | ⭐⭐⭐ | OCR, web, documentos | Base de dados, DMS | Orientado pelo utilizador | US$ 500 pagamento único | Documentos + dados web |

| Spinn3r | ⭐⭐ | Tempo real, API | JSON, API | Orientado pelo utilizador | Assinatura | Media, notícias, pesquisa |

| FMiner | ⭐⭐⭐ | Fluxo visual, Python | CSV, base de dados | Orientado pelo utilizador | US$ 168 pagamento único | Fluxos complexos e visuais |

| G2 Webscraper | ⭐⭐⭐⭐⭐ | Simples, navegador | CSV, JSON | Orientado pelo utilizador | Grátis/varia | Simplicidade, ganhos rápidos |

Como escolher a ferramenta certa de rastreamento de conteúdo para o seu negócio

Escolher a ferramenta certa é uma questão de alinhar as suas necessidades com os pontos fortes da solução. Aqui vai o meu checklist rápido:

- Defina o seu caso de uso: Pontual ou contínuo? Pequena ou grande escala? Dados públicos ou com login?

- Combine com o nível técnico: Quem não programa deve começar com Thunderbit, Octoparse, ParseHub ou WebHarvy. Programadores podem optar por Scrapy ou Apify.

- Verifique as necessidades de exportação: Precisa de Excel, Sheets ou integração via API? Garanta que a ferramenta oferece isso.

- Considere a conformidade: Se atua num setor regulado ou extrai dados pessoais, priorize ferramentas com recursos de conformidade (Import.io, Mozenda).

- Comece pequeno: Use planos gratuitos ou testes para experimentar com dados reais antes de se comprometer.

- Pense no futuro: As suas necessidades vão crescer? Escolha uma ferramenta com a qual consiga escalar.

E lembre-se: às vezes, a ferramenta mais simples é a melhor opção. Não complique demasiado se só precisa de uma folha de cálculo rápida.

Privacidade e conformidade de dados: o que observar

A raspagem da web abre um mundo de possibilidades — mas também de responsabilidades. Veja como continuar do lado certo da lei e das boas práticas:

- Respeite o robots.txt e as políticas do site: Verifique sempre se o site permite raspagem e siga as orientações.

- Evite extrair dados pessoais, a menos que tenha um motivo legítimo e consentimento: GDPR e CCPA são assunto sério.

- Não sobrecarregue servidores: Use limitação de taxa, atrasos e agendamento nativos para evitar bloqueios (e para ser um bom cidadão da internet).

- Use ferramentas com recursos de conformidade se atua num setor sensível: Import.io e Mozenda foram criadas a pensar em GDPR/CCPA.

- Documente as suas ações: Mantenha registos do que extraiu e porquê, especialmente em casos de uso empresariais ou regulados.

Raspagem ética é raspagem sustentável — e isso mantém o seu negócio longe de problemas.

Conclusão: capacite a sua equipa com a ferramenta certa de rastreamento de conteúdo

A web é a maior e mais desorganizada base de dados do seu negócio — e, com a ferramenta certa de rastreamento de conteúdo, finalmente pode pô-la a trabalhar para si. Seja para montar listas de leads, acompanhar concorrentes ou alimentar painéis em tempo real, estas 18 ferramentas cobrem todos os cenários, níveis técnicos e orçamentos.

Se quer o caminho mais rápido para resultados, é a minha principal recomendação para utilizadores de negócio: com IA, sem código e pronta para transformar qualquer site num conjunto de dados estruturado em minutos. Mas, independentemente da sua necessidade, comece com um teste gratuito, experimente e descubra o que melhor se encaixa no seu fluxo de trabalho.

Pronto para deixar para trás a rotina de copiar e colar? Baixe a e veja como os dados da web podem ser simples. E, se quiser aprofundar-se em raspagem da web, confira o para mais guias, dicas e tutoriais.

Perguntas frequentes

1. O que é uma ferramenta de rastreamento de conteúdo e em que difere de um raspador web comum?

Uma ferramenta de rastreamento de conteúdo é um tipo de raspador web concebido para automatizar a extração de dados estruturados de sites. Embora todos os raspadores web coletem dados, as ferramentas de rastreamento de conteúdo costumam oferecer recursos como agendamento, navegação por subpáginas, deteção de campos por IA e integração com fluxos de trabalho de negócio — o que as torna mais potentes e fáceis de usar para equipas empresariais.

2. Qual ferramenta de rastreamento de conteúdo é melhor para utilizadores sem conhecimentos técnicos?

Thunderbit, Octoparse, ParseHub, Data Miner e WebHarvy são excelentes para quem não programa. A Thunderbit destaca-se pela simplicidade com IA e pela exportação instantânea para Excel, Sheets, Airtable ou Notion.

3. Como garantir que a minha raspagem da web é legal e está em conformidade?

Respeite sempre os termos do site, o robots.txt e leis de privacidade como GDPR e CCPA. Evite extrair dados pessoais a menos que haja motivo legítimo e consentimento. Em setores sensíveis, escolha ferramentas com recursos nativos de conformidade (por exemplo, Import.io, Mozenda).

4. Estas ferramentas conseguem lidar com sites dinâmicos com JavaScript ou rolagem infinita?

Sim — ferramentas como Thunderbit, Octoparse, ParseHub, Apify e FMiner conseguem lidar com conteúdo dinâmico, rolagem infinita e navegação em vários níveis. Algumas podem exigir configuração extra ou execução na nuvem para sites complexos.

5. O que devo considerar ao escolher uma ferramenta de rastreamento de conteúdo para a minha empresa?

Considere as competências técnicas da sua equipa, a escala das suas necessidades de dados, os requisitos de exportação/integração, as preocupações com conformidade e o orçamento. Comece com um plano gratuito ou teste e experimente a ferramenta no seu caso de uso real antes de se comprometer.

Boa raspagem — e que os seus dados estejam sempre frescos, estruturados e prontos para agir.

Saiba mais