O mundo dos assistentes de IA e dos frameworks agênticos está evoluindo muito rápido, mas uma coisa não mudou: toda a gente quer soluções mais rápidas, mais leves e fáceis de instalar. Vejo isso na prática todos os dias — tanto faz se é um developer a trabalhar sozinho num Raspberry Pi ou um responsável de TI a tentar controlar custos na cloud; a procura por soluções de “instalação minimalista” está por todo o lado. Nos últimos tempos, tenho recebido mais perguntas sobre alternativas leves ao OpenClaw do que consigo contar. As pessoas querem saber: existe forma de ter o poder do OpenClaw sem a instalação pesada, o consumo de memória ou as dores operacionais?

Se está à procura de uma alternativa leve ao OpenClaw ou se dá valor a instalações de baixa ocupação de recursos, está em boa companhia. Neste guia, vou explicar o que realmente significa “instalação minimalista do OpenClaw”, porque é importante e como avaliar as melhores opções leves para as suas necessidades — seja para correr em hardware antigo, implementar em escala ou simplesmente evitar mais uma “sopa de dependências” no servidor.

O que é uma alternativa leve ao OpenClaw?

Comecemos pelo básico: o que queremos dizer com uma “alternativa leve ao OpenClaw”?

OpenClaw é uma camada de gateway e orquestração alojada pelo próprio utilizador para assistentes agênticos. Em termos simples, é uma plataforma que liga interfaces de chat (como web, desktop ou aplicações de mensagens) a modelos de IA e ferramentas, gerindo aspetos como memória, estado e execução segura (). Mas há um senão: a instalação padrão do OpenClaw assenta em Docker, com vários serviços e um mínimo recomendado de 2 GB de RAM só para o gateway — antes mesmo de começar a executar grandes modelos de linguagem.

Uma alternativa leve é qualquer ferramenta, framework ou plataforma que ofereça capacidades parecidas de “assistente” ou “agente” com o OpenClaw, mas com uma instalação mais pequena, menor uso de memória/CPU e um processo de configuração mais simples. Pense em implementações num único contentor, dependências mínimas e capacidade de correr em hardware modesto ou em ambientes com recursos limitados.

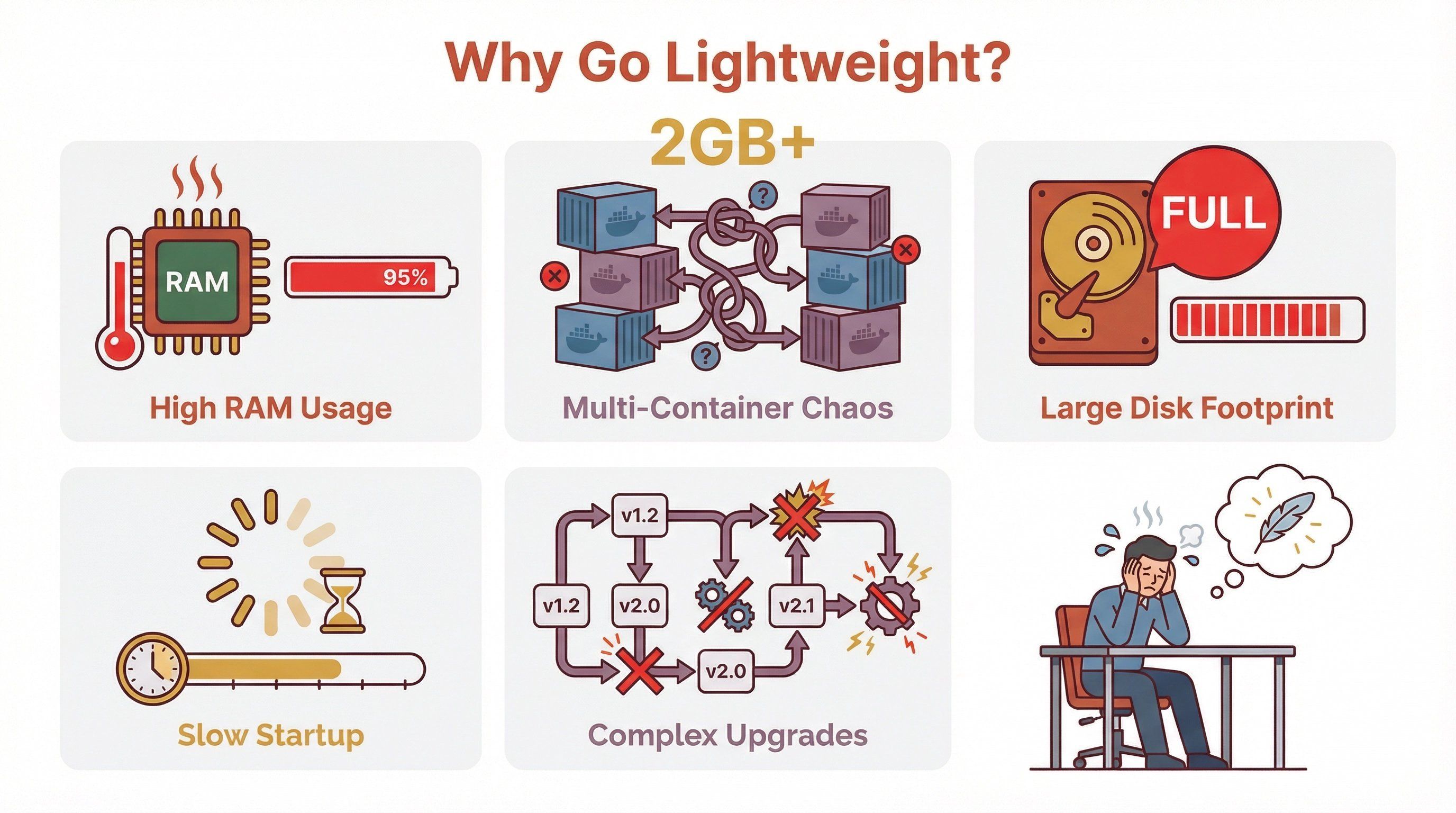

As principais diferenças entre as instalações padrão do OpenClaw e as alternativas leves/minimalistas costumam resumir-se a:

- Complexidade de instalação: as opções leves normalmente usam um único contentor Docker ou até um binário simples, enquanto a configuração padrão do OpenClaw pode exigir vários contentores e volumes persistentes.

- Consumo de recursos: alternativas minimalistas são desenhadas para correr com menos RAM, CPU e espaço em disco — às vezes com apenas 1–2 GB de RAM para toda a stack.

- Âmbito das funcionalidades: pode abdicar de algumas funções avançadas de gateway ou sandbox em troca de uma instalação mais simples e fácil de gerir.

Em resumo, uma alternativa leve ao OpenClaw procura entregar os benefícios essenciais — chat com IA, integração com ferramentas e memória — sem o excesso.

Por que motivo os utilizadores procuram soluções com baixa ocupação de recursos no OpenClaw

Então, por que é que toda a gente ficou subitamente obcecada com instalações minimalistas e frameworks leves? Pelas conversas que tenho com utilizadores e equipas de TI, os motivos são bastante universais:

- Configuração e onboarding mais rápidos: ninguém quer passar horas a lidar com ficheiros do Docker Compose ou a resolver conflitos de dependências. Uma instalação minimalista significa pôr tudo a funcionar em minutos, não em horas.

- Menor uso de recursos: seja numa VM na cloud, num Raspberry Pi ou num portátil antigo, cada gigabyte de RAM e cada ciclo de CPU contam. Uma pegada mais pequena significa correr mais instâncias, poupar na fatura da cloud ou simplesmente evitar lentidão.

- Manutenção mais fácil: menos peças móveis significam menos coisas para avariar. As alternativas leves costumam ser mais simples de atualizar, fazer backup e proteger.

- Melhor adaptação a cenários edge e offline: se precisa de correr um assistente on-premises, num laboratório ou num ambiente sensível à privacidade, as instalações minimalistas fazem toda a diferença.

| Ponto de dor | Porque é importante |

|---|---|

| Elevadas exigências de RAM/CPU | Limita a implementação em hardware antigo ou mais pequeno |

| Configuração com vários contentores | Aumenta a complexidade e o que precisa de ser mantido e protegido |

| Grande ocupação de disco | Problemático para dispositivos edge ou armazenamento limitado |

| Arranque lento | Frustrante para prototipagem rápida ou escala |

| Atualizações complexas | Mais componentes = mais dores de cabeça nas atualizações |

Se já tentou correr o OpenClaw numa VM de 2 GB na cloud e viu tudo arrastar-se, sabe exatamente do que estou a falar.

Como a instalação minimalista do OpenClaw afeta o desempenho do sistema

Vamos entrar um pouco no lado técnico. O tamanho e a complexidade da sua plataforma de assistente afetam diretamente o desempenho, a estabilidade e a escalabilidade do sistema.

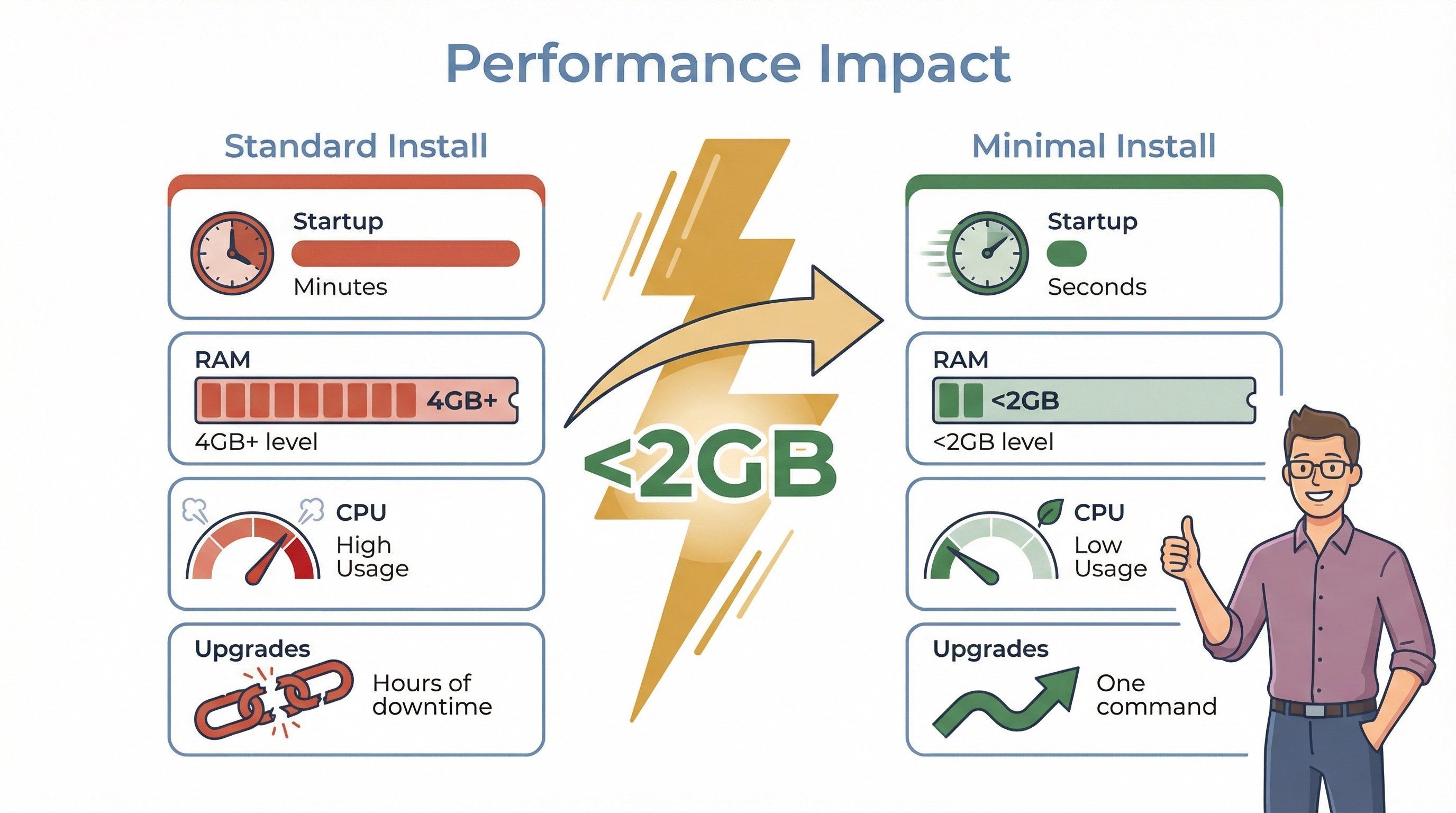

As instalações padrão do OpenClaw (com Docker, armazenamento de memória e sandbox) podem facilmente consumir mais de 2 GB de RAM só para a plataforma, antes mesmo de carregar um modelo de linguagem ou uma base de dados vetorial (). Some-se a isto inferência local de LLM ou ingestão de documentos, e já estamos a falar de 4 GB, 8 GB ou mais.

As alternativas de instalação minimalista são desenhadas para:

- Arrancar mais depressa: instalações num único contentor ou em binário podem ficar prontas em segundos, e não em minutos.

- Usar menos memória: ao descarregar a inferência do LLM para APIs externas ou usar modelos locais mais pequenos, dá para manter o uso de RAM abaixo de 2 GB para toda a stack ().

- Reduzir a carga de CPU: menos overhead de orquestração significa mais recursos para as tarefas reais de IA.

- Diminuir o risco de conflitos: menos serviços = menos choques de portas, incompatibilidades de dependências ou surpresas nas atualizações.

Aqui vai um exemplo real: o recomenda um mínimo de 2 GB de RAM (4 GB de preferência), enquanto o sugere pelo menos 4 GB. Em contraste, o pode correr em modo de utilizador único com um único contentor e uma pegada de memória muito menor — especialmente se usar APIs remotas de LLM.

Melhorias de desempenho que pode observar:

- Tempo de arranque reduzido de minutos para segundos

- Uso de RAM reduzido em 50% ou mais

- Menor uso de CPU durante períodos de inatividade

- Atualizações mais rápidas e menos tempo em baixo

Critérios-chave para escolher uma alternativa leve ao OpenClaw

Nem toda a alternativa “leve” é igual. Aqui está o que recomendo observar ao avaliar as suas opções:

- Tamanho da instalação: qual é o tamanho do download? Dá para implementar com um único contentor Docker ou binário?

- Uso de memória: qual é o uso base de RAM da plataforma (sem contar com a inferência do LLM)?

- Velocidade de arranque: quanto tempo demora a ir de um

docker runa um assistente funcional? - Facilidade de atualização: o processo de upgrade é simples ou vai andar a caçar dragões de dependências todos os meses?

- Compatibilidade: oferece suporte aos LLMs, ferramentas e integrações de que precisa?

- Conjunto de funcionalidades: está a receber as funcionalidades centrais de assistente de que precisa ou está a sacrificar demasiado em nome do minimalismo?

- Segurança e isolamento: a plataforma oferece sandbox ou isolamento para a execução de ferramentas?

Aqui fica uma lista rápida de verificação que pode usar:

| Critério | Porque é importante | O que observar |

|---|---|---|

| Tamanho da instalação | Implementação rápida, menos armazenamento necessário | Imagem <500 MB, binário único |

| Uso de memória | Correr em hardware mais modesto, menor custo na cloud | Base <2 GB de RAM |

| Velocidade de arranque | Prototipagem rápida, menos indisponibilidade | Pronto em menos de 30 segundos |

| Atualizações | Menos manutenção, menos surpresas | Upgrade num comando, API estável |

| Compatibilidade | Evitar dependência de fornecedor, preparar o futuro | API OpenAI/Ollama, modelo de plugins |

| Recursos | Não perder o essencial em nome do minimalismo | Memória, ferramentas, autenticação, RAG |

| Segurança | Execução segura de ferramentas, menos risco | Isolamento por contentor ou processo |

O segredo é equilibrar baixa ocupação de recursos com os recursos de que realmente precisa. Às vezes, “menos é mais”; outras vezes, “menos” significa “demasiado pouco”.

Alternativas leves populares ao OpenClaw para instalação minimalista

Com base em resumos recentes do setor e na minha própria pesquisa, aqui estão algumas das melhores alternativas leves ao OpenClaw para diferentes cenários:

1.

- Melhor para: instalações com um único utilizador e poucos recursos

- Porque é leve: um único contentor Docker, modo opcional de utilizador único, volume persistente para dados, pode usar APIs remotas de LLM para consumo mínimo de RAM/CPU

- Pontos fortes exclusivos: funciona offline, oferece suporte a Ollama e endpoints compatíveis com OpenAI, comunidade ativa ()

- Compromissos: não replica nativamente o modelo de gateway/múltiplas superfícies do OpenClaw; o isolamento de ferramentas é básico

2.

- Melhor para: equipas com vários utilizadores que querem uma experiência familiar de “clone do ChatGPT”

- Porque é leve: implementação em Docker, requisitos mínimos publicados (2 GB de RAM), pode correr como um único serviço para equipas pequenas

- Pontos fortes exclusivos: autenticação segura para vários utilizadores, amplo suporte a fornecedores, reforços recentes de segurança ()

- Compromissos: mais centrado numa aplicação web; não é um gateway para muitas superfícies de chat; algumas funcionalidades exigem serviços extra

3.

- Melhor para: espaço de trabalho privado de IA tudo-em-um com configuração mínima

- Porque é leve: instalação via Docker ou desktop, base vetorial incorporada, pode correr com 2 GB de RAM para uso básico

- Pontos fortes exclusivos: suporte multiutilizador, agentes, fluxos de documentos, foco na privacidade ()

- Compromissos: não é um gateway de superfícies de chat; o isolamento de ferramentas depende da sua arquitetura

4.

- Melhor para: perguntas e respostas privadas sobre documentos e apps com contexto

- Porque é leve: perfis do Docker Compose, pode correr com recursos moderados se usar APIs externas de LLM

- Pontos fortes exclusivos: compatibilidade com a API da OpenAI, forte postura de privacidade, opções flexíveis de armazenamento vetorial ()

- Compromissos: não é um substituto direto do gateway de mensagens do OpenClaw

5.

- Melhor para: construtor visual de fluxos de trabalho/agentes com instalação minimalista

- Porque é leve: instalação via NPM ou Docker, SQLite por padrão, pode correr como um único serviço

- Pontos fortes exclusivos: interface visual de construção de fluxos, ecossistema de plugins, fácil de testar localmente ()

- Compromissos: não é um assistente pronto; vai precisar de criar os seus próprios conectores

Comparando alternativas de baixa ocupação de recursos do OpenClaw: tabela de funcionalidades

Vamos colocar estas opções lado a lado para uma comparação rápida:

| Plataforma | Forma de instalação | RAM mínima (plataforma) | Velocidade de arranque | Multiutilizador | Suporte ao backend de LLM | Modelo de ferramentas/plugins | Segurança/isolamento | Melhor para |

|---|---|---|---|---|---|---|---|---|

| Open WebUI | Docker (único) | Baixa–média | Rápida | Opcional | Ollama, compatível com OpenAI | Ferramentas em Python | Básico | Utilizador único, minimalista |

| LibreChat | Docker (multi) | 2 GB mín. (4 GB rec.) | Rápida | Sim | Muitos fornecedores | Agentes, plugins | Multi-serviço | Equipas, foco em chat |

| AnythingLLM | Docker/Desktop | 2 GB+ | Rápida | Sim | Local + alojado | Agentes, API | Base vetorial incorporada | Privado, tudo-em-um |

| PrivateGPT | Docker Compose | Média | Rápida | Opcional | Local + alojado | API RAG | Isolamento via API | Q&A privado sobre documentos |

| Flowise | NPM/Docker | Baixa–média | Rápida | Opcional | Nós de fornecedores | Construtor visual | SQLite/BD | Construtor visual de fluxos |

Nota: o uso de RAM pode aumentar se executar LLMs locais ou ingerir documentos grandes. Para instalações verdadeiramente minimalistas, use APIs remotas de LLM ou modelos pequenos.

Passos práticos para avaliar e testar soluções de instalação minimalista do OpenClaw

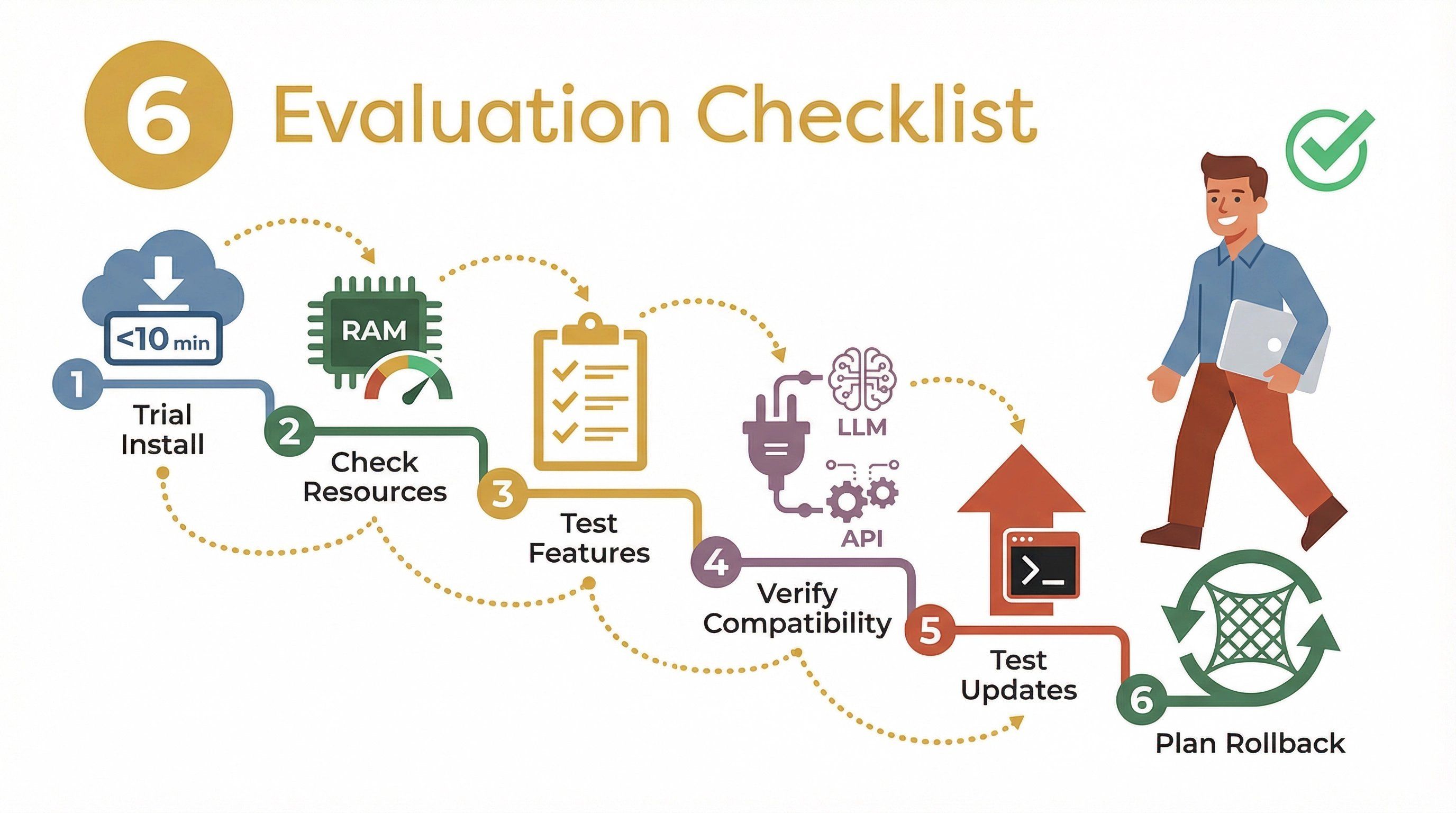

Pronto para experimentar uma alternativa leve? Aqui está uma estrutura simples de avaliação que uso:

- Instalação de teste: implemente a plataforma num ambiente sandbox ou numa VM de teste. Cronometre o processo de instalação e arranque.

- Meça o uso de recursos: use ferramentas do sistema (como

htopoudocker stats) para monitorizar RAM e CPU em repouso e em uso básico. - Execute fluxos básicos: teste as funcionalidades centrais — chat, execução de ferramentas/plugins, ingestão de documentos, etc.

- Verifique a compatibilidade: ligue aos LLMs, plugins ou APIs externas da sua preferência.

- Teste as atualizações: tente atualizar a plataforma para perceber quão suave é o processo.

- Teste em sandbox: se possível, corra num ambiente descartável para poder recuar facilmente se algo correr mal.

Aqui fica uma lista rápida:

| Etapa | O que observar |

|---|---|

| Instalação/Início | Menos de 10 minutos, sem dependências complexas |

| Uso de recursos | Base <2 GB de RAM, baixo uso de CPU em repouso |

| Teste de recursos | As funcionalidades centrais do assistente funcionam como esperado |

| Compatibilidade | Liga aos seus LLMs e ferramentas |

| Processo de atualização | Upgrade num comando ou no local |

| Reversão | Fácil voltar à versão anterior |

Armadilhas comuns ao mudar para alternativas leves ao OpenClaw

Migrar para uma instalação minimalista nem sempre corre sobre rodas. Aqui estão algumas armadilhas comuns — e como evitá-las:

- Funcionalidades em falta: algumas plataformas leves deixam de fora funções avançadas de gateway ou sandbox. Certifique-se de que não perde nada crítico para o seu fluxo de trabalho.

- Documentação limitada: projetos mais pequenos podem ter documentação escassa. Consulte os fóruns da comunidade ou as issues no GitHub para obter ajuda.

- Desafios de integração: nem todos os plugins ou ferramentas são suportados de forma nativa. Teste cedo as integrações indispensáveis.

- Compromissos de segurança: instalações mais simples às vezes significam menos isolamento ou padrões de segurança mais fracos. Reforce a implementação (autenticação, TLS, firewalls).

- Dores na migração: mover dados (como histórico de chat ou documentos) do OpenClaw para uma nova plataforma pode ser complicado. Planeie uma janela de migração e faça backup de tudo.

O meu conselho? Comece com um projeto-piloto, teste a fundo e mantenha a configuração antiga a correr até ter confiança na nova.

Conclusão: escolhendo a opção certa para as suas necessidades de instalação minimalista

A ascensão das alternativas leves ao OpenClaw é uma resposta direta aos problemas reais de instalações pesadas e complexas. Seja você um developer a trabalhar sozinho, uma equipa pequena ou um responsável de TI numa empresa, existe uma opção minimalista que pode oferecer as funcionalidades de assistente de que precisa — sem o excesso.

O que eu recomendaria:

- Defina o que é indispensável: saiba quais as funcionalidades de que não pode abdicar (multiutilizador, suporte a plugins, segurança).

- Use os critérios e tabelas de comparação acima para selecionar as alternativas que fazem mais sentido.

- Teste em piloto e meça: experimente no seu próprio ambiente, meça o uso de recursos e verifique a compatibilidade.

- Planeie a migração: não tenha pressa — transfira dados e fluxos de trabalho gradualmente.

E lembre-se: a melhor instalação minimalista do OpenClaw é aquela que se encaixa no seu caso de uso, no seu hardware e nas competências da sua equipa. Leve não precisa de significar limitado — apenas mais focado.

Se tem interesse em automatizar a extração de dados da web como parte do seu fluxo de trabalho de assistente, conheça o , o nosso raspador web com IA pensado para configuração mínima e máxima produtividade. E, para mais conteúdos aprofundados sobre automação, scraping e ferramentas de IA, visite o .

Perguntas frequentes

1. O que é uma alternativa leve ao OpenClaw?

Uma alternativa leve ao OpenClaw é uma ferramenta ou framework que oferece capacidades parecidas de assistente de IA com o OpenClaw, mas com uma instalação menor, menor uso de memória/CPU e configuração mais simples — ideal para cenários de instalação minimalista ou ambientes com poucos recursos.

2. Por que me deveria importar com soluções de baixa ocupação de recursos do OpenClaw?

As soluções de baixa ocupação de recursos são mais rápidas de configurar, usam menos RAM/CPU, são mais fáceis de manter e podem correr em hardware antigo ou em ambientes edge/offline — o que as torna perfeitas para prototipagem rápida ou implementações sensíveis ao custo.

3. Quais são as principais desvantagens das alternativas leves?

Pode perder algumas funcionalidades avançadas (como gateways para múltiplas superfícies ou execução de ferramentas em sandbox) e talvez precise de acrescentar componentes extra para ter paridade total com o OpenClaw. Verifique sempre se as funcionalidades indispensáveis são suportadas.

4. Como avaliar se uma alternativa leve é adequada para mim?

Teste o processo de instalação, meça o uso de recursos, execute os seus fluxos de trabalho centrais, verifique a compatibilidade com os LLMs/ferramentas que prefere e confirme se a plataforma cumpre os seus requisitos de segurança e atualização.

5. Quais são as alternativas leves ao OpenClaw mais populares?

Algumas das principais opções incluem , , , e . Cada uma tem os seus próprios pontos fortes para diferentes necessidades de instalação minimalista.

Se está pronto para tornar a sua stack mais leve e recuperar a sua RAM, experimente uma destas soluções de instalação minimalista. E, se quiser automatizar a extração de dados da web sem dores de cabeça na configuração, o está sempre aqui para ajudar.

Saiba mais