A raspagem de dados na web já não é mais um “superpoder” restrito a poucos nerds de TI — virou uma habilidade indispensável para quem trabalha com vendas, operações ou pesquisa de mercado. O volume de dados online só cresce: de 2019 a 2023, a produção global de dados quase . Não à toa, já enxergam os dados como o “coração” das decisões estratégicas. O problema? dizem que lidar com dados não estruturados (tipo HTML bagunçado) é um baita desafio. Já vi muita equipe perdendo horas no famoso “Ctrl+C, Ctrl+V” de site pra planilha — e, olha, não tem nada mais improdutivo.

É aí que entra o BeautifulSoup do Python. Neste passo a passo, vou te mostrar como usar o BeautifulSoup para web scraping, com um exemplo real de Python que você pode adaptar para o seu dia a dia. E, como sou fã de produtividade, também vou te ensinar a juntar o BeautifulSoup com o , nosso web 스크래퍼 com IA, pra acelerar seu fluxo de trabalho e garantir dados limpos e organizados — mesmo que você não seja expert em programação.

O que é BeautifulSoup e por que usar para Web Scraping?

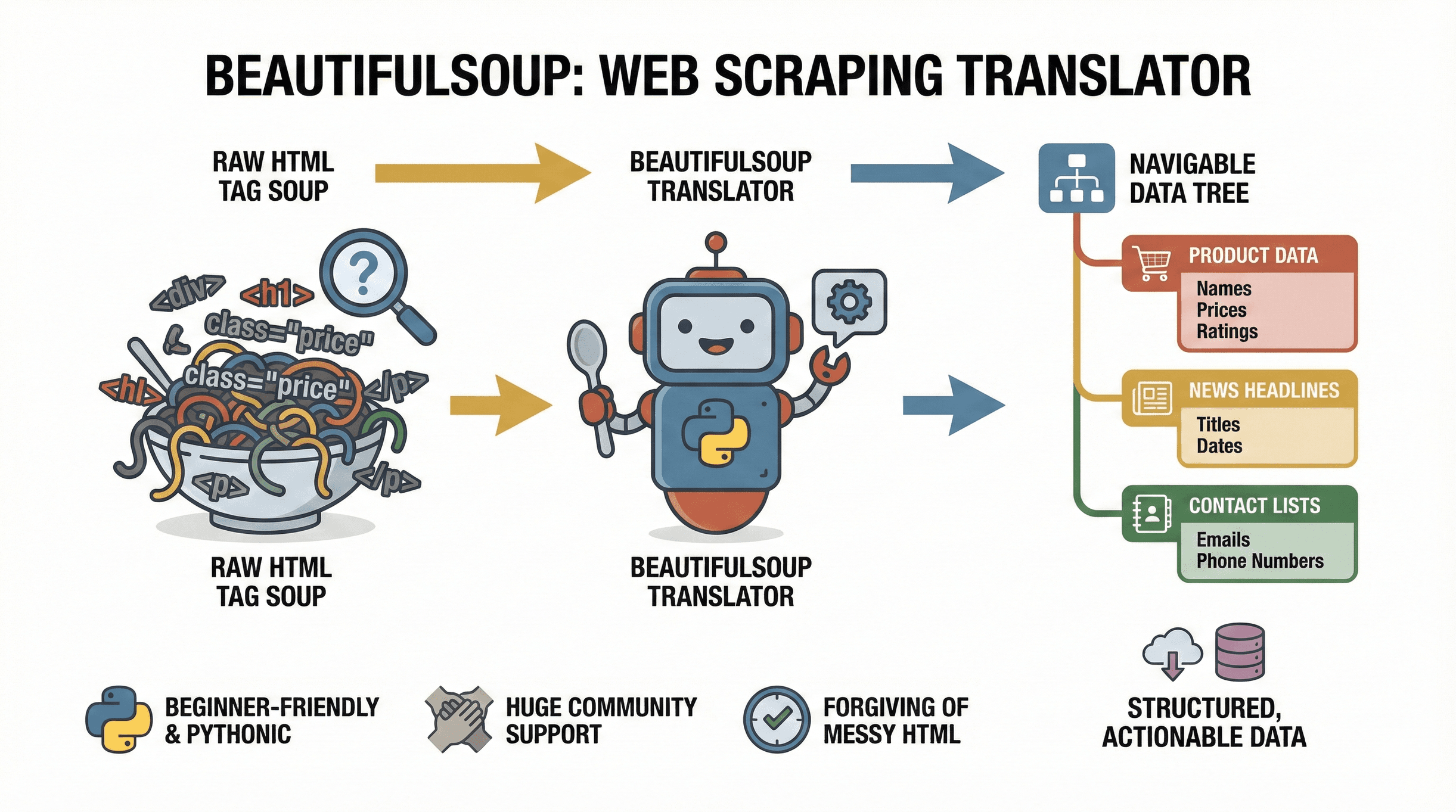

Vamos do começo. é uma biblioteca Python que facilita a vida na hora de analisar documentos HTML e XML. Imagina um tradutor: ele pega aquela “sopa de tags” de uma página web e transforma em algo navegável, permitindo que você encontre, extraia e manipule os dados que precisa. Seja pra coletar preços em e-commerces, juntar manchetes de notícias ou extrair listas de empresas, o BeautifulSoup é o caminho pra transformar páginas web em dados organizados e úteis.

Vamos do começo. é uma biblioteca Python que facilita a vida na hora de analisar documentos HTML e XML. Imagina um tradutor: ele pega aquela “sopa de tags” de uma página web e transforma em algo navegável, permitindo que você encontre, extraia e manipule os dados que precisa. Seja pra coletar preços em e-commerces, juntar manchetes de notícias ou extrair listas de empresas, o BeautifulSoup é o caminho pra transformar páginas web em dados organizados e úteis.

Por que tanta gente usa? Primeiro, porque é muito fácil de aprender, até pra quem está começando. O BeautifulSoup lida bem com HTML todo torto (e a internet está cheia disso), e a sintaxe em Python é super amigável — dá pra raspar dados com poucas linhas de código. Fora isso, tem uma comunidade gigante e muito material de apoio — se travar, é só dar um Google.

Alguns usos clássicos do BeautifulSoup:

- Extrair nomes, preços e avaliações de produtos em lojas online

- Coletar manchetes, autores e datas em sites de notícias

- Analisar tabelas ou diretórios (tipo listas de empresas ou contatos)

- Capturar e-mails ou telefones em sites de anúncios

- Monitorar atualizações (mudanças de preço, novas vagas, etc.)

Se o dado que você quer está em HTML estático, o BeautifulSoup é seu melhor amigo no web scraping.

Os Diferenciais do BeautifulSoup para Web Scraping

Existem várias bibliotecas Python pra raspar dados — então, por que escolher o BeautifulSoup? Olha só os pontos fortes:

- Simplicidade: Leve, fácil de aprender, sem precisar de frameworks complicados. Perfeito pra tarefas rápidas ou pra quem está começando.

- Tolerância: Aguenta HTML quebrado ou malfeito, que é o que mais tem por aí.

- Flexibilidade: Não te obriga a seguir uma arquitetura rígida. Basta passar o HTML e extrair o que quiser.

- Integração: Funciona de boa com outras libs Python, tipo

requests(pra buscar páginas),csv(pra salvar dados) epandas(pra análise).

Como ele se compara com outras ferramentas?

| Ferramenta | Melhor Para | Vantagens | Desvantagens |

|---|---|---|---|

| BeautifulSoup | Análise de HTML estático, iniciantes | Simples, configuração rápida, tolerante, flexível | Não indicado para sites com muito JavaScript |

| Scrapy | Projetos em larga escala, tarefas assíncronas | Poderoso, escalável, navegação integrada | Curva de aprendizado maior, mais configuração |

| Selenium | Conteúdo dinâmico/JavaScript | Interage com JS, preenche formulários, clica em botões | Mais lento, pesado, consome mais recursos |

Se você está começando ou quer analisar páginas estáticas rapidinho, o BeautifulSoup é o “canivete suíço” do web scraping (). Pra sites mais complexos ou dinâmicos, vale combinar com Selenium ou Scrapy — mas o BeautifulSoup é o melhor ponto de partida.

Como Configurar o Ambiente Python para BeautifulSoup

Bora colocar a mão na massa? Veja como preparar o ambiente:

-

Instale o Python: Baixe a versão mais recente em .

-

Crie um ambiente virtual (opcional, mas vale a pena):

1python -m venv venv 2source venv/bin/activate # No Windows: venv\Scripts\activate -

Instale o BeautifulSoup e dependências:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: Biblioteca principalrequests: Pra buscar páginas weblxmlouhtml5lib: Analisadores HTML mais rápidos e confiáveis

-

Dicas pra resolver pepinos:

- Se der erro de “pip não encontrado”, tente

pip3oupy -m pip. - No Mac/Linux, talvez precise usar

sudopra permissões. - No Windows, confira se o Python está no PATH.

- Se der erro de “pip não encontrado”, tente

Pra testar se está tudo certo, rode este código:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Se aparecer <title>Example Domain</title>, tá tudo funcionando ().

Exemplo Prático: Python Beautiful Soup na Prática

Vamos pra um exemplo real. Suponha que você queira extrair as últimas manchetes de um site de notícias. Olha como é simples:

1. Buscar a Página Web

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Analisar o HTML

1soup = BeautifulSoup(html, "html.parser")3. Inspecionar a Estrutura HTML

Abra as Ferramentas do Desenvolvedor do navegador (botão direito → Inspecionar) e procure as tags das manchetes. Em muitos sites de notícias, elas estão em <h3> com classes específicas.

Por exemplo:

1<h3 class="gs-c-promo-heading__title">Título da Manchete</h3>4. Extrair os Dados

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Isso vai imprimir todas as manchetes da página.

5. Salvar os Dados em CSV

Vamos guardar as manchetes pra analisar depois:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Agora você tem um CSV pronto pra jogar no Excel ou Google Sheets.

Entendendo a Estrutura HTML para Extração de Dados

Antes de programar, sempre inspecione o HTML da página. Veja como:

- Abra as Ferramentas do Desenvolvedor: Botão direito e “Inspecionar”.

- Encontre os Dados: Passe o mouse nos elementos pra ver quais tags têm as infos que você quer (manchetes, preços, autores, etc.).

- Anote as Tags e Classes: Procure identificadores únicos como

class="product-title"ouid="main-content". - Teste seus Seletores: Use

.find(),.find_all()ou.select()do BeautifulSoup pra acessar esses elementos.

Dica: Use soup.prettify() pra imprimir o HTML bonitinho no console Python.

Extraindo e Estruturando Dados com BeautifulSoup

Suponha que você queira extrair títulos e autores de um blog:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Agora você tem uma lista de dicionários — perfeito pra exportar pra CSV ou analisar depois.

Pra extrair links, imagens ou outros atributos:

1for link in soup.find_all("a"):

2 print(link.get("href"))Ou imagens:

1for img in soup.find_all("img"):

2 print(img.get("src"))Salvando Dados Extraídos: Do Python para Excel ou CSV

Depois de organizar seus dados, exportar é fácil. Veja como fazer com o módulo csv:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Ou, se preferir usar pandas:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Sempre use codificação UTF-8 pra evitar dor de cabeça com acentos e caracteres especiais, principalmente em dados internacionais.

Estudo de Caso: Raspando Dados de Notícias com BeautifulSoup

Vamos ver um exemplo prático: extrair títulos, autores e datas de publicação de artigos em um site de notícias.

Suponha que você queira raspar dados do :

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Esse script pega os artigos mais recentes, extrai título, data e autor, e salva tudo em um CSV. Dá pra usar esses dados pra monitorar concorrentes, analisar tendências ou pesquisar conteúdo — conforme a necessidade do seu negócio.

Otimizando o Fluxo de Trabalho: Combinando BeautifulSoup com Thunderbit

Agora, bora deixar seu processo de raspagem ainda mais ágil. O é uma extensão Chrome de 웹 스크래퍼 com IA que facilita a extração de dados. Com o Thunderbit, você pode:

- Usar o “IA Sugerir Campos”: O Thunderbit lê a página e já sugere automaticamente quais campos extrair — sem precisar caçar HTML ou ajustar seletores.

- Raspar Subpáginas: O Thunderbit segue links pra subpáginas (tipo páginas de produtos ou artigos) e enriquece seu dataset com mais detalhes.

- Exportar Instantaneamente: Jogue seus dados direto no Excel, Google Sheets, Airtable ou Notion com um clique.

- Lidar com Paginação: O Thunderbit raspa dados em várias páginas (até com rolagem infinita).

- Agendar Raspagens: Programe tarefas recorrentes pra manter seus dados sempre atualizados.

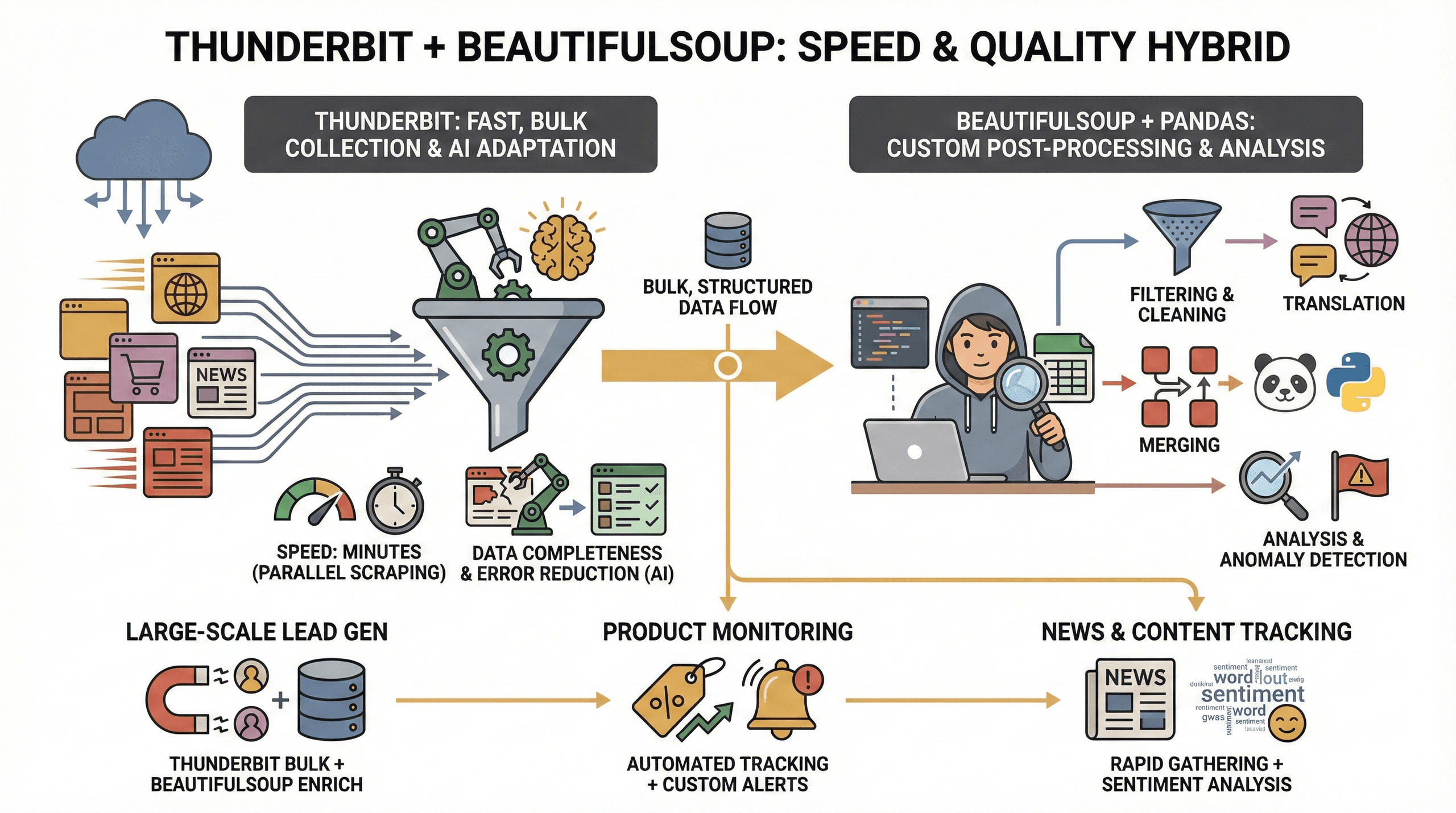

Veja um fluxo de trabalho híbrido que recomendo:

- Comece com o Thunderbit: Abra o site desejado, clique no ícone do Thunderbit e deixe o “IA Sugerir Campos” identificar as colunas certas (tipo título, autor, data).

- Exporte os Dados: Baixe os resultados em CSV ou mande pro Google Sheets.

- Use o BeautifulSoup para Processamento Personalizado: Se quiser análises mais profundas (limpeza de texto, deduplicação, cruzamento de fontes), carregue o CSV exportado no Python e use BeautifulSoup ou pandas pra pós-processar.

Essa combinação te dá o melhor dos dois mundos: a velocidade e inteligência do Thunderbit pra identificar campos, e a flexibilidade do BeautifulSoup pra lógica personalizada.

Velocidade e Qualidade dos Dados: Por que Usar Thunderbit e BeautifulSoup Juntos?

Por que juntar as duas ferramentas? Olha só os ganhos:

Por que juntar as duas ferramentas? Olha só os ganhos:

- Rapidez: O Thunderbit raspa dezenas de páginas ao mesmo tempo (até 50 em paralelo no modo cloud), entregando dados em minutos.

- Completude dos Dados: A IA do Thunderbit se adapta a mudanças de layout e extrai dados estruturados até de sites mais chatos, reduzindo perdas de informação.

- Menos Erros: Chega de script quebrando por causa de mudança em classe — a IA do Thunderbit reavalia a página a cada execução.

- Pós-processamento Personalizado: Pra necessidades avançadas (filtragem, tradução, fusão de bases), BeautifulSoup e pandas dão controle total.

Esse combo é especialmente útil pra:

- Geração de leads em larga escala: Use o Thunderbit pra coletar o grosso dos dados e o BeautifulSoup pra limpar e enriquecer.

- Monitoramento de produtos: O Thunderbit faz a raspagem repetitiva, enquanto o BeautifulSoup permite analisar tendências ou identificar anomalias.

- Acompanhamento de notícias e conteúdo: Junte artigos rapidinho com o Thunderbit e use Python pra análise de sentimento ou extração de palavras-chave.

Solucionando Problemas Comuns no Web Scraping com BeautifulSoup

Raspar dados nem sempre é moleza — veja alguns perrengues comuns e como resolver:

- Conteúdo Dinâmico: Se o site carrega dados via JavaScript (rolagem infinita, AJAX), o BeautifulSoup sozinho não enxerga. Use Selenium ou o modo navegador do Thunderbit nesses casos.

- Bloqueios Anti-bot: Alguns sites bloqueiam requisições automáticas. Tente definir um User-Agent personalizado, adicionar intervalos entre as requisições ou usar o modo cloud do Thunderbit pra driblar bloqueios simples.

- Mudanças na Estrutura HTML: Se seu script parar de funcionar, provavelmente o HTML do site mudou. Inspecione a página de novo e ajuste seus seletores. A IA do Thunderbit pode ajudar, adaptando-se automaticamente.

- Dados Ausentes: Sempre cheque se os elementos existem antes de usar

.get_text(). Use.get()em vez de[]pra atributos e evitar erros. - Problemas de Codificação: Salve arquivos com UTF-8 pra lidar com caracteres especiais.

E lembre: respeite sempre o robots.txt e os termos de uso do site. Raspe dados de forma ética — ninguém curte robô inconveniente.

Conclusão & Principais Aprendizados

Fazer web scraping com BeautifulSoup é uma das skills mais valiosas no mundo dos dados hoje. Resumindo o que rolou neste tutorial:

- BeautifulSoup é o ponto de partida ideal pra analisar HTML estático e extrair dados estruturados com Python.

- A configuração é simples — só instalar Python, pip e algumas libs.

- Inspecionar o HTML é fundamental pra achar os dados certos.

- Exportar pra CSV/Excel deixa seus dados prontos pra análise de negócio.

- Combinar com Thunderbit traz detecção de campos via IA, raspagem mais rápida e exportação fácil — perfeito pra profissionais e pra quem não programa.

- Fluxos híbridos (Thunderbit pra extração em massa, BeautifulSoup pra processamento personalizado) garantem velocidade, qualidade e flexibilidade.

Quer dar um up no seu web scraping? Teste as duas ferramentas: comece com um script simples de BeautifulSoup e veja como o pode turbinar seu trabalho. Pra mais tutoriais práticos, acesse o .

Boas raspagens — e que seus dados estejam sempre limpos, organizados e prontos pra uso.

Perguntas Frequentes

1. O que é o BeautifulSoup e para que serve?

BeautifulSoup é uma biblioteca Python pra analisar documentos HTML e XML. Ela ajuda a extrair dados de páginas web e transformar em formatos organizados, como listas ou tabelas — ideal pra projetos de raspagem de dados.

2. Como o BeautifulSoup se compara ao Selenium e Scrapy?

O BeautifulSoup é leve e fácil pra páginas HTML estáticas. O Selenium é melhor pra sites dinâmicos e cheios de JavaScript, enquanto o Scrapy é um framework completo pra raspagem em larga escala e tarefas assíncronas. O BeautifulSoup é a melhor escolha pra quem está começando e pra tarefas rápidas.

3. Posso usar BeautifulSoup e Thunderbit juntos?

Com certeza. O Thunderbit identifica e extrai rapidinho campos de páginas web usando IA, e você pode usar o BeautifulSoup pra pós-processamento personalizado ou análises mais profundas dos dados exportados.

4. Quais são os desafios comuns ao raspar dados com BeautifulSoup?

Os principais desafios são lidar com conteúdo dinâmico, bloqueios anti-bot e mudanças na estrutura HTML. Usar os recursos de IA ou o modo navegador do Thunderbit pode ajudar a superar muitos desses obstáculos.

5. Como exportar dados raspados com BeautifulSoup para Excel ou CSV?

Você pode usar o módulo csv do Python ou a biblioteca pandas pra gravar os dados extraídos em arquivos CSV ou Excel. Sempre use codificação UTF-8 pra garantir compatibilidade com planilhas e evitar problemas com caracteres especiais.

Quer testar na prática? Baixe a e comece a raspar dados de forma inteligente hoje mesmo. Pra mais dicas e tutoriais, visite o .

Saiba mais