Imagine a cena: é segunda-feira de manhã, está a tomar o café, e a sua caixa de entrada já está a disparar alertas. Mais uma ferramenta com IA virou manchete por expor dados sensíveis. O seu CEO quer respostas. A equipa jurídica está em alerta máximo. E os clientes? Estão a fazer perguntas incómodas sobre como é que os seus dados estão a ser usados por todos aqueles sistemas “inteligentes” que lançou no trimestre passado. Bem-vindo a 2026, quando a privacidade de dados em IA não é só um problema técnico — é uma questão para a administração, para a reputação da marca e para a carreira, para o bem ou para o mal.

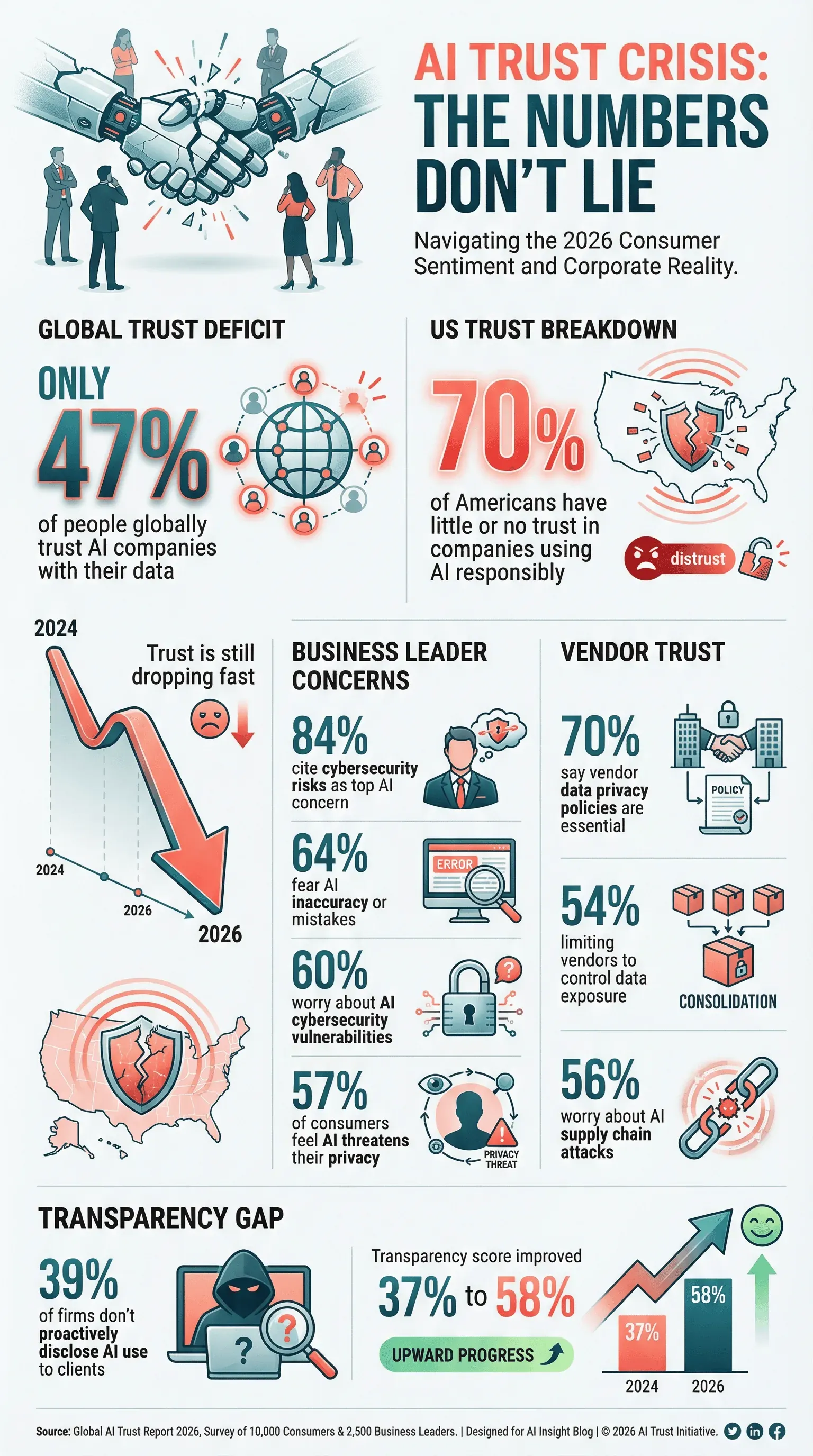

A verdade é que a IA já está entranhada no dia a dia das empresas, de vendas e marketing a imobiliário e e-commerce. Mas, à medida que a adoção dispara, os riscos também aumentam. Só no último ano, os incidentes de privacidade relacionados com IA cresceram uns impressionantes 56%, e apenas 47% das pessoas no mundo confiam que as empresas de IA protejam os seus dados pessoais — um número que continua a cair rapidamente (, ). Como alguém que passou anos a construir plataformas de SaaS e automação — e agora, como cofundador da — posso dizer: perceber as estatísticas mais recentes de privacidade de dados em IA não é só uma questão de compliance; é a diferença entre prosperar e mal sobreviver nesta nova era digital.

O panorama da privacidade de dados em IA em 2026: factos rápidos

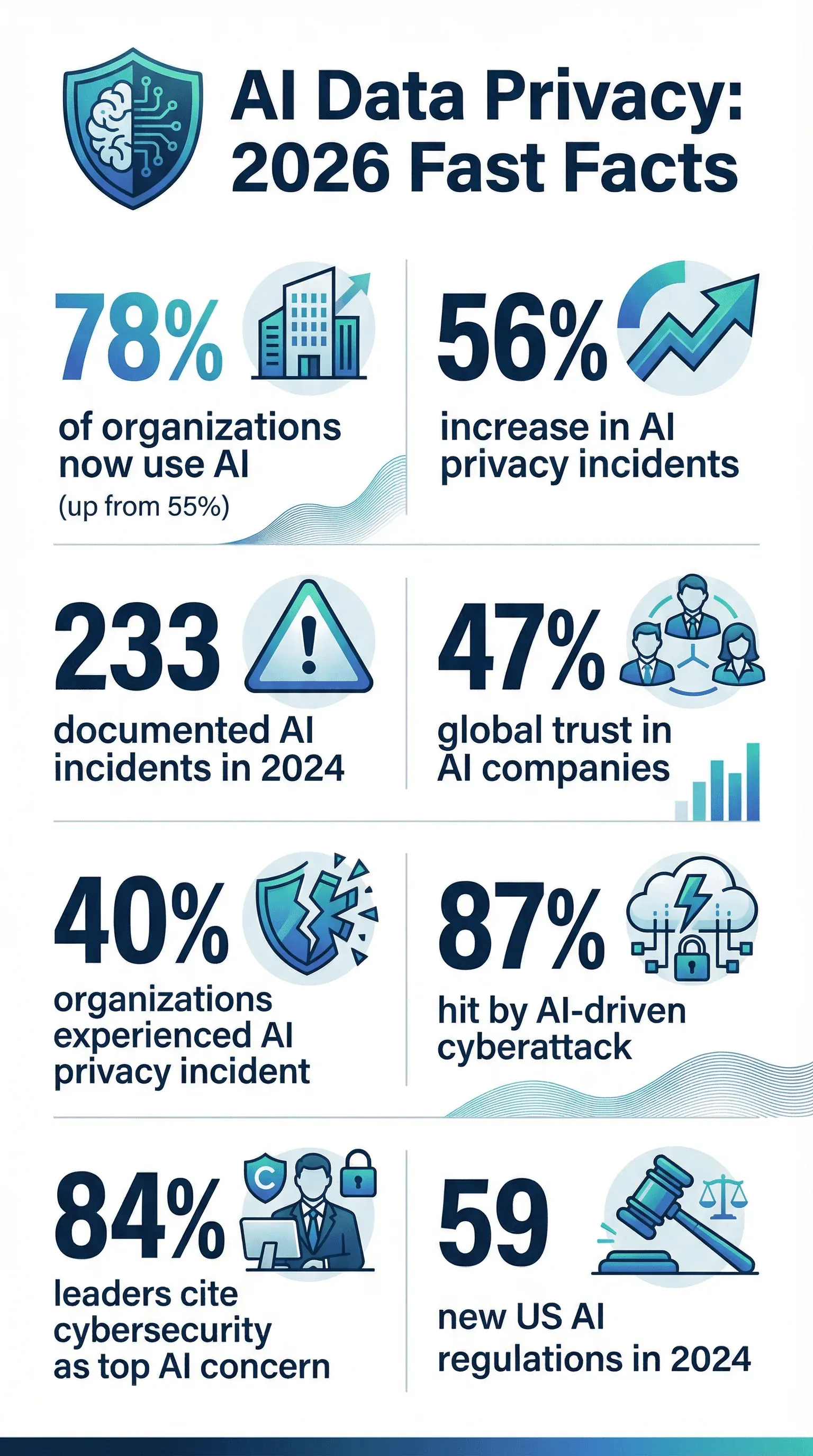

Vamos diretos ao assunto. Se quer os números de destaque para partilhar na próxima reunião com a administração ou no pitch a clientes, aqui estão as estatísticas de privacidade de dados em IA mais impactantes de 2026:

- A IA está em todo o lado: 78% das organizações relataram usar IA em 2024, face a 55% apenas um ano antes ().

- Os incidentes estão a disparar: Os incidentes de IA documentados chegaram a 362 em 2025, face a 233 em 2024 — um aumento de 55% homólogo ().

- As violações são comuns: 40% das organizações já sofreram um incidente de privacidade relacionado com IA (), e 21% sofreram um ciberataque no último ano ().

- A confiança é baixa: Apenas 47% das pessoas no mundo confiam nas empresas de IA com os seus dados, e, nos EUA, 70% têm pouca ou nenhuma confiança de que as empresas usem IA de forma responsável ().

- A IA é o principal investimento em cibersegurança: A pesquisa Global Digital Trust Insights 2026 da PwC, com 3.887 executivos, mostrou que o investimento em IA (36%) é a maior prioridade cibernética para os próximos 12 meses, à frente da segurança na cloud (34%), segurança de rede (28%) e proteção de dados (26%); 60% das organizações também estão a aumentar o investimento global em cibersegurança em resposta à volatilidade geopolítica ().

- O escrutínio sobre fornecedores é intenso: 70% das organizações dizem que as políticas de privacidade de dados de um fornecedor são essenciais ao avaliar parceiros de IA e tecnologia ().

- As ameaças de IA preocupam os executivos: 84% dos líderes empresariais citam riscos de cibersegurança como a sua principal preocupação com a adoção de IA ().

- A regulação está a acelerar: As agências federais dos EUA emitiram 59 regulações relacionadas com IA em 2024, mais do dobro do número de 2023 ().

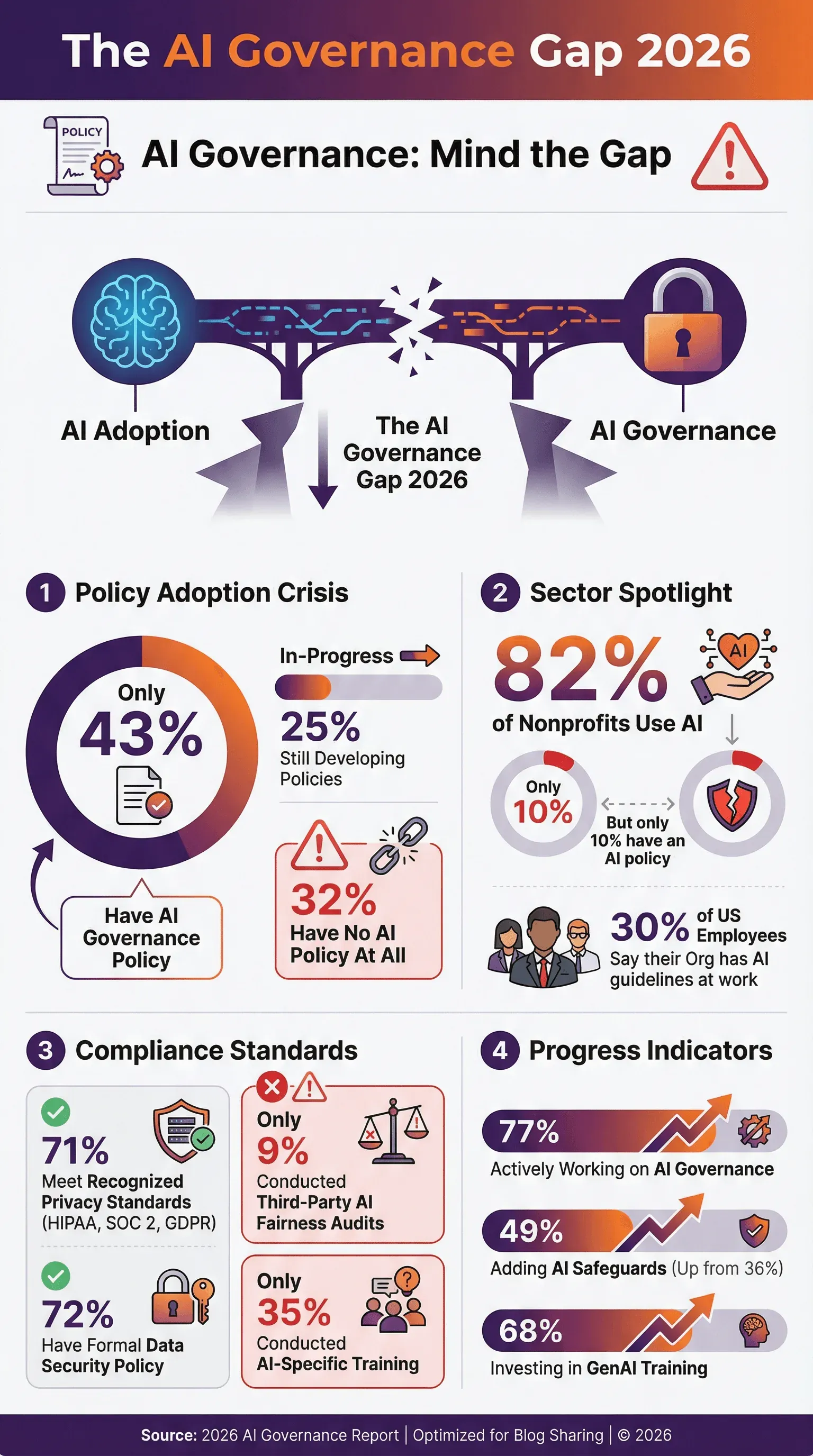

- As políticas formais ainda estão atrasadas: Apenas 43% das empresas têm uma política de governança de IA em vigor, embora 77% estejam a trabalhar ativamente nisso (, ).

- Os ciberataques movidos por IA são o novo normal: 87% das organizações sofreram um ciberataque impulsionado por IA no último ano ().

Estes números não são apenas curiosidades — são um alerta para qualquer pessoa responsável por dados, compliance ou transformação digital.

Porque é que a privacidade de dados em IA importa mais do que nunca

A IA não é só mais uma atualização de TI — é uma mudança de paradigma na forma como as organizações recolhem, processam e usam dados. Ao contrário do software tradicional, os sistemas de IA aprendem frequentemente com conjuntos de dados enormes e caóticos, que podem incluir de tudo, desde e-mails de clientes a registos médicos. E aqui está o problema: os modelos de IA podem “memorizar” e devolver informações de formas que ninguém previu, expondo por vezes dados privados que nunca deveriam ter vindo a público ().

A escala é assustadora. Um único modelo de IA pode processar milhões de registos ou recolher dados de toda a web — às vezes sem consentimento explícito. Isso significa que o risco de proteger esses dados nunca foi tão elevado. E, como a IA toma decisões em segundos (pense na aprovação de empréstimos ou na triagem de candidatos), qualquer viés ou erro pode ser amplificado a uma velocidade brutal, levando a violações de privacidade e até a questões de direitos civis.

Se está a pensar: “Bom, temos uma política de privacidade, portanto estamos protegidos”, pense outra vez. A realidade é que a IA introduz novos riscos — como envenenamento de dados, inversão de modelo e ataques adversariais — para os quais os controlos tradicionais simplesmente não foram feitos. E o dano reputacional depois de uma falha de privacidade em IA? É brutal. Os clientes vão-se embora, os reguladores aplicam multas e a sua marca pode demorar anos a recuperar. Em 2026, privacidade de dados em IA não é só compliance — é sobrevivência.

Estatísticas de privacidade de dados em IA: adoção, preocupações e compliance

A adoção de IA está quase omnipresente

Sejamos honestos: a IA já não é “tecnologia emergente”. É mainstream. Em 2024, 78% das organizações usavam IA, contra apenas 55% no ano anterior (). Em alguns setores, como o jurídico e o financeiro, a adoção é ainda maior — 42% dos escritórios de advogados usavam ferramentas de IA em 2025, quase o dobro do ano anterior (). Esta explosão de utilização significa que mais dados estão a ser recolhidos, analisados e, por vezes, expostos.

As preocupações com privacidade estão a aumentar

Com grande poder vem grande responsabilidade — e muita ansiedade. 57% dos consumidores no mundo sentem agora que a IA representa uma ameaça significativa à sua privacidade (). Nos EUA, um inquérito da Pew Research de março de 2026 mostrou que 47% dos adultos não confiam muito ou nada no país para regular bem a IA, e que metade dos adultos nos EUA diz que o aumento do uso de IA na vida diária os preocupa mais do que entusiasma (contra apenas 10% que dizem estar mais entusiasmados) ().

Com grande poder vem grande responsabilidade — e muita ansiedade. 57% dos consumidores no mundo sentem agora que a IA representa uma ameaça significativa à sua privacidade (). Nos EUA, um inquérito da Pew Research de março de 2026 mostrou que 47% dos adultos não confiam muito ou nada no país para regular bem a IA, e que metade dos adultos nos EUA diz que o aumento do uso de IA na vida diária os preocupa mais do que entusiasma (contra apenas 10% que dizem estar mais entusiasmados) ().

Até os líderes empresariais estão preocupados: 64% temem a imprecisão da IA ou o seu potencial de erro, e 60% apontam especificamente vulnerabilidades de cibersegurança relacionadas com IA como preocupações importantes ().

Compliance: um alvo em movimento

As organizações estão a correr para acompanhar regulações como GDPR, CCPA, HIPAA e SOC 2 — mas a IA muitas vezes introduz novas complexidades. 71% das organizações dizem cumprir padrões reconhecidos de privacidade de dados (), e 72% têm uma política formal de segurança de dados. Mas aqui está a reviravolta: menos de metade tem uma política dedicada de governança ou ética em IA. Apenas 43% das organizações têm uma política de governança de IA em vigor, e outras 25% ainda estão a desenvolvê-la (, ). O resto? Está a navegar às cegas.

Adoção de políticas de privacidade de dados em IA

As políticas formais de privacidade de dados em IA estão rapidamente a deixar de ser “bom ter” para passarem a “essencial”. Mas os números mostram que ainda existe uma lacuna:

- Apenas 43% das empresas têm uma política de governança de IA, com outras 25% em curso ().

- Nos EUA, só 30% dos funcionários dizem que a sua organização tem diretrizes ou políticas para o uso de IA no trabalho ().

- Entre as organizações sem fins lucrativos, 82% usam IA, mas apenas 10% têm uma política de IA ().

- A boa notícia? 77% das organizações estão a trabalhar ativamente em medidas de governança de IA, e, entre os grandes utilizadores de IA, esse número sobe para quase 90% ().

Os primeiros a adotar estão a atualizar políticas para incluir cláusulas sobre usos proibidos de IA, exigências de revisão humana e compromissos com equidade e transparência. Se a sua organização ainda não iniciou esse processo, agora é a altura — antes que uma violação ou uma nova lei o obrigue a agir.

Auditorias e certificações de privacidade de dados em IA

Políticas são ótimas, mas são as auditorias e certificações que provam que faz mesmo aquilo que diz.

- 71% das empresas relatam conformidade com padrões reconhecidos, como HIPAA, SOC 2 ou GDPR ().

- 51% exigem que os fornecedores sejam compatíveis com HIPAA para dados de saúde, e 45% exigem encriptação de ponta a ponta ().

- Apenas 9% das organizações realizaram auditorias de terceiros focadas na equidade ou no viés da sua IA — mas esse número deverá crescer à medida que a regulação acompanha o ritmo ().

Certificações como SOC 2, ISO 27001 e HITRUST estão a tornar-se diferenciais competitivos. Se é fornecedor, espere que os clientes peçam provas. Se é comprador, garanta que os seus parceiros estão à altura.

Cibersegurança em IA: ameaças, incidentes e resposta

Vamos falar do elefante na sala dos servidores: a IA não é apenas um alvo de ciberataques — também é uma ferramenta para os atacantes. E os números são, francamente, um pouco assustadores.

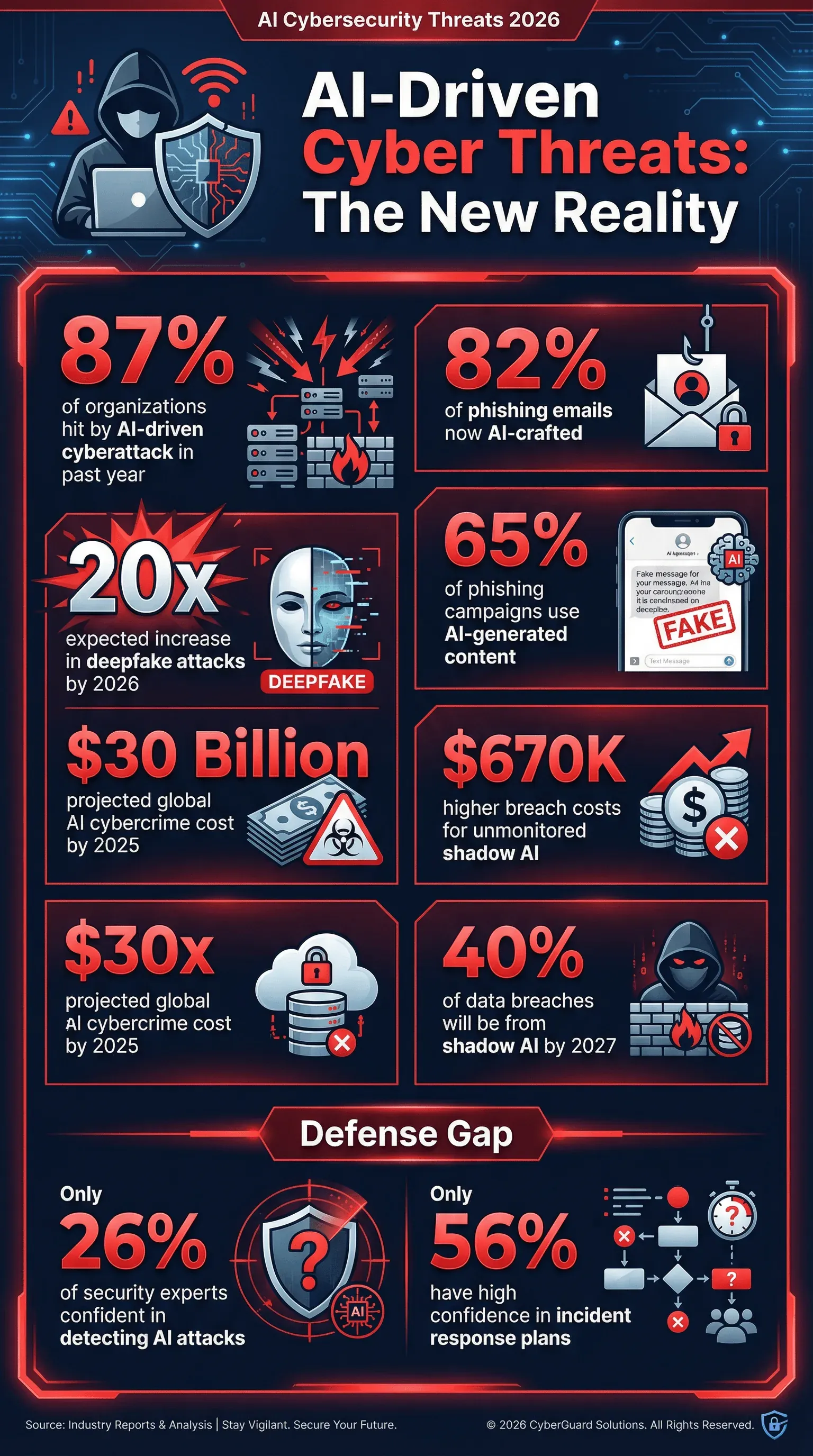

- 87% das organizações sofreram um ciberataque impulsionado por IA no último ano ().

- 65% das campanhas de phishing usam agora conteúdo gerado por IA para imitar comunicações confiáveis ().

- 82% dos e-mails de phishing são estimados como tendo sido produzidos com ajuda de IA ().

- Ataques de deepfake deverão aumentar 20x até 2026 ().

- Shadow AI (uso não autorizado de IA por colaboradores) é um risco crescente — a Gartner prevê que 40% das violações de dados serão atribuídas ao uso indevido de IA ou de sistemas de “shadow AI” até 2027 ().

E aqui vai uma estatística que tira o sono aos CISOs: apenas 26% dos especialistas em segurança dizem ter elevada confiança na capacidade de detetar ataques movidos por IA (). É como jogar às escondidas com um mágico de classe mundial.

Ciberataques movidos por IA: o que os números mostram

- 87% das organizações enfrentaram um ataque com uso de IA nos últimos 12 meses ().

- O phishing está mais inteligente: no final de 2025, mais de 82% dos e-mails de phishing eram produzidos por IA ().

- Os deepfakes estão a explodir: os ataques de áudio/vídeo deepfake deverão aumentar 20x até 2026.

- Shadow AI é arriscado: até 2027, 40% das violações de dados ocorrerão por uso indevido de IA ou “shadow AI” ().

- Shadow AI aumenta o custo das violações: as violações envolvendo shadow AI tiveram uma média de US$ 4,63 milhões, cerca de US$ 670 mil a mais do que a média global, com incidentes de shadow AI a expor desproporcionalmente PII de clientes (65% vs. média global de 53%) ().

- Custo global: projeta-se que o cibercrime alimentado por IA atinja US$ 30 bilhões até 2025 ().

- Os controlos de acesso estão em falta: entre as organizações que sofreram uma violação relacionada com IA, 97% relataram não ter controlos de acesso adequados para IA, e 63% não tinham uma política de governança de IA ou ainda a estavam a redigir ().

Se não está a fazer simulações de phishing com e-mails gerados por IA ou a testar as suas defesas contra deepfakes, está a jogar às cegas.

Investimento organizacional em cibersegurança de IA

A boa notícia? As organizações estão a investir mais do que nunca em cibersegurança de IA:

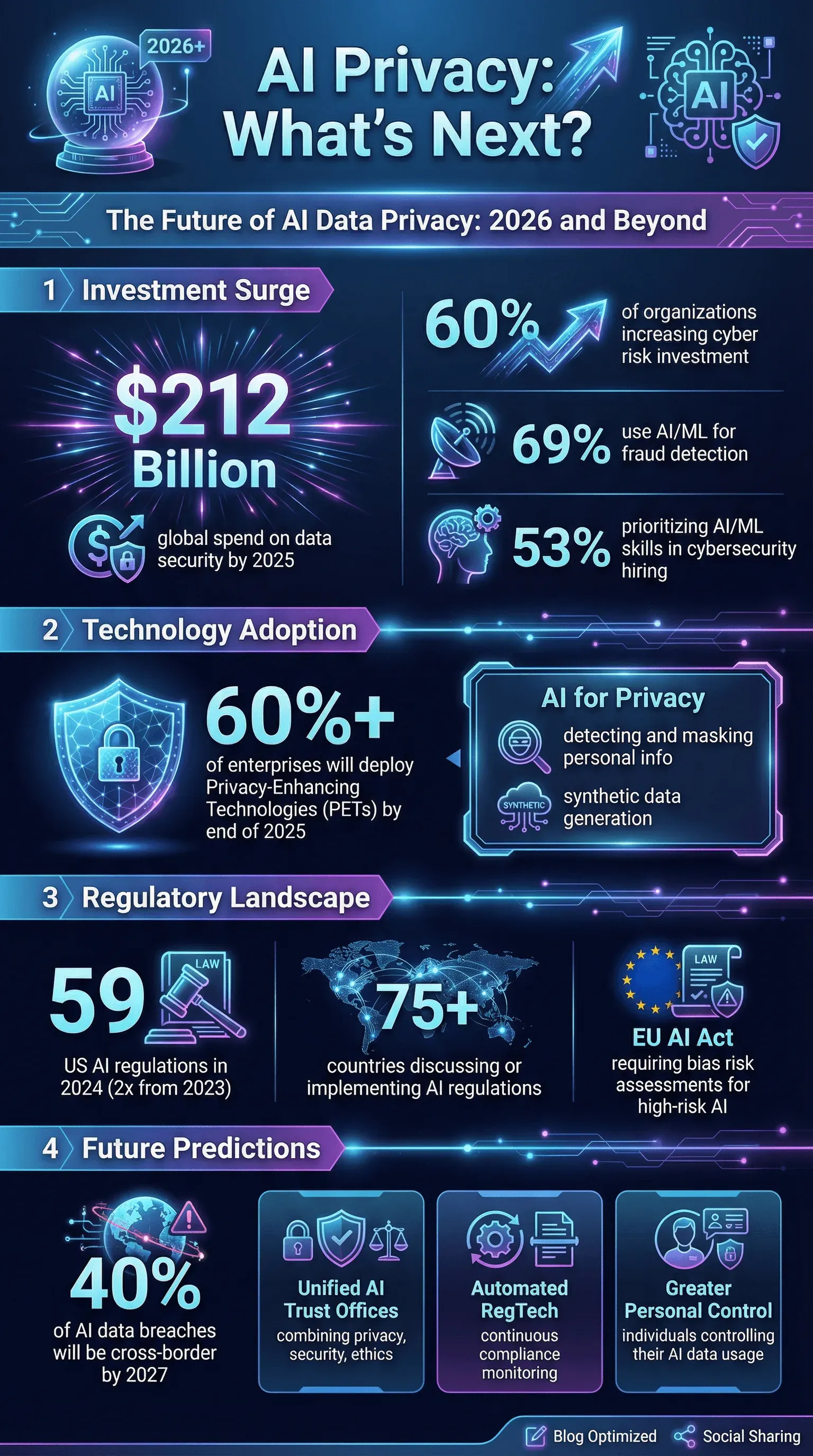

- 60% das organizações estão a aumentar o investimento na mitigação do risco cibernético, com a IA como um dos motores ().

- 69% usam IA ou machine learning para deteção e prevenção de fraude ().

- 53% estão a priorizar competências em IA e ML na contratação para cibersegurança ().

- O gasto global com segurança de dados e gestão de riscos deverá chegar a US$ 212 bilhões até 2025 ().

Mas ainda existe uma lacuna: a percentagem de organizações que classificam a sua resposta a incidentes de IA como “excelente” caiu de 28% em 2024 para 18% em 2025, mesmo com a adoção a acelerar (). O índice de 56% de confiança citado por algumas pesquisas de 2024 sobrestima a preparação real.

Governança de dados em IA: formação, supervisão e mitigação de viés

Pode ter toda a tecnologia do mundo, mas se as suas pessoas e processos não estiverem em dia, o risco continua.

- Apenas 35% das organizações deram formação específica em IA às suas equipas sobre privacidade, segurança ou ética ().

- 68% das empresas investem em formação em IA generativa para colaboradores ().

- 30% dependem da supervisão humana como medida de controlo para salvaguardas de IA ().

- Apenas 9% usam auditorias independentes para equidade em IA ().

- 49% estão em processo de adicionar salvaguardas de governança de IA, face a 36% no ano anterior.

O viés também é uma grande questão de privacidade. Sistemas de IA que tratam dados pessoais de forma diferente com base na raça, género ou outros atributos podem levar a danos desiguais à privacidade e até a problemas legais. 46% dos executivos dizem que viabilizar uma IA responsável — incluindo equidade — é um dos principais objetivos dos seus investimentos em IA (). Mas medir e mitigar o viés continua a ser um trabalho em curso para a maioria das organizações.

Viés e equidade em IA: implicações para a privacidade

- Os incidentes relacionados com IA que envolvem viés ou problemas de segurança estão a aumentar fortemente todos os anos ().

- Redução de 25% na disparidade de género nas recomendações para candidatos a vagas foi relatada por algumas empresas após esforços de mitigação de viés.

- A pressão regulatória está a aumentar: o GDPR da UE e o futuro AI Act vão exigir avaliações de risco de viés para sistemas de IA de “alto risco”.

Se não está a testar a sua IA quanto a viés, não está apenas a arriscar má reputação — está a arriscar processos e perda de negócios.

Riscos de fornecedores e ecossistema: consolidação e exposição a terceiros

Nenhuma empresa é uma ilha. A maioria depende de uma rede de fornecedores, provedores de cloud e parceiros — todos eles podem introduzir risco de privacidade.

- 54% das empresas estão a reduzir o número de fornecedores para controlar custos e minimizar a exposição de dados ().

- 70% das empresas consideram as políticas de privacidade de dados essenciais ao avaliar fornecedores de tecnologia.

- 56% temem ataques à cadeia de abastecimento impulsionados por IA ().

A tendência? Consolidar fornecedores, exigir controlos de privacidade mais fortes e tratar os parceiros como extensões do seu próprio perímetro de segurança.

Pressões regulatórias e dos clientes: transparência e divulgação na privacidade de dados em IA

Reguladores e clientes estão a apertar o cerco. Em 2024, os EUA registaram 59 ações regulatórias relacionadas com IA, mais do dobro do ano anterior. Globalmente, pelo menos 75 países já discutiram ou implementaram regulações de IA ().

- A transparência é o novo normal: os clientes esperam divulgações sobre o uso de IA, mas 39% das empresas admitem que não informam proativamente os clientes sobre o uso de IA ().

- Preparação para auditorias é obrigatória: esteja pronto para mostrar provas de conformidade — HIPAA, SOC 2, listas de ferramentas de IA e controlos de tratamento de dados.

- A transparência entre os developers de foundation models está, na verdade, a cair. O Foundation Model Transparency Index de Stanford desceu de uma média de 58 pontos em 2024 para 40 em 2025 numa escala de 100, com a maioria dos laboratórios de fronteira a divulgar menos sobre dados de treino, computação e risco do que no ano anterior ().

Se não estiver pronto para uma auditoria ou para um questionário difícil de cliente, não estará pronto para 2026.

O futuro da privacidade de dados em IA: previsões e tendências emergentes

Olhando para a frente, aqui está o que vejo no horizonte — e o que os especialistas estão a dizer:

- Privacidade como vantagem competitiva: as empresas que conseguirem provar que a sua IA é segura, preserva a privacidade e é ética vão conquistar clientes ().

- Governança unificada: espere ver áreas de “AI Trust” que juntem privacidade, segurança e ética sob o mesmo guarda-chuva.

- Tecnologias de Aprimoramento da Privacidade (PETs): mais de 60% das empresas planeiam implementar PETs até ao fim de 2025 ().

- Compliance automatizado: o RegTech para IA vai tornar-se essencial, com ferramentas que monitorizam continuamente os sistemas de IA em busca de problemas de conformidade.

- Desafios de dados transfronteiriços: até 2027, 40% das violações de dados relacionadas com IA virão do uso indevido de dados entre fronteiras ().

- Maior controlo pessoal: espere ferramentas que permitam às pessoas controlar como os seus dados são usados em IA.

- IA para privacidade: a IA será usada para detetar e mascarar informação pessoal, gerar dados sintéticos e muito mais.

- Resposta a incidentes e resiliência: as organizações vão passar da mera prevenção para a resiliência, incluindo a compra de seguro para incidentes relacionados com IA e exercícios de recuperação após envenenamento de dados ou corrupção de modelos.

Como alguém obcecado por automação e IA — e, sim, com uma dose saudável de paranoia sobre privacidade de dados — diria que os vencedores da próxima década serão aqueles que tratarem privacidade e segurança como funcionalidades centrais, e não como algo secundário.

Principais conclusões: o que as estatísticas de privacidade de dados em IA de 2026 significam para a sua organização

Vamos fechar com alguns passos práticos, porque ninguém quer ser o exemplo de alerta na manchete do próximo ano:

- Torne a privacidade de dados em IA parte central da sua estratégia. Não adicione depois — incorpore desde o início.

- Faça avaliações abrangentes de risco de IA. Conheça os seus sistemas de IA, fluxos de dados e pontos de risco.

- Invista em formação e governança específicas para IA. Não deixe a sua equipa ser o elo mais fraco.

- Fortaleça as defesas técnicas a pensar em IA. Use IA para combater IA — implemente ferramentas avançadas de monitorização e deteção.

- Aposte mais na gestão de fornecedores. Consolide, investigue com rigor e exija provas de conformidade.

- Adote a transparência. Informe clientes e utilizadores quando e como usa IA — antes que outra pessoa o faça.

- Implemente tecnologias de aprimoramento da privacidade. Anonimize, encripte e minimize os dados sempre que possível.

- Prepare-se para o pior. Tenha um plano de resposta a incidentes de IA e teste-o regularmente.

- Mantenha-se atualizado com leis e padrões em evolução. O panorama regulatório muda depressa — não seja apanhado desprevenido.

- Faça da confiança a sua estrela-guia. Em 2026 e além, a confiança é o seu ativo mais valioso.

Fontes citáveis e leituras complementares

Quer aprofundar ou precisa de estatísticas para a próxima apresentação? Aqui estão alguns dos melhores recursos que usei nesta recolha:

- )

Para mais insights sobre IA, automação e privacidade de dados, veja o ou aprofunde-se nos nossos guias sobre e .