A internet está cheia de informações e, se você trabalha com negócios, tecnologia ou só é curioso mesmo, aposto que já quis coletar dados de um site em grande escala—sem perder horas copiando e colando tudo na mão. Olha só: até 2025, quase metade do tráfego online vai ser gerado por bots que rastreiam e extraem dados da web, e mais de 70% das empresas digitais dependem de dados públicos para inteligência de mercado e operações (). Mesmo com tanta demanda por dados, extrair essas informações ainda é um baita desafio—principalmente com sites modernos e dinâmicos feitos em JavaScript.

É aí que o JavaScript entra com tudo. Como é a linguagem nativa da web, o JavaScript é perfeito para lidar com páginas dinâmicas e interativas que deixam qualquer raspador tradicional no chinelo. Seja você dev querendo automatizar pesquisas, alguém de vendas montando listas de leads ou só um explorador digital, este guia vai te mostrar o essencial para criar um raspador web em JavaScript—do básico ao avançado, incluindo como automatizar tudo com IA usando o .

Fundamentos do Raspador JavaScript: O Que é Web Scraping com JavaScript?

Vamos do começo. Web scraping é o processo de coletar informações automaticamente de sites. Imagina ter um assistente super-rápido que visita centenas de páginas, copia os dados que você precisa e organiza tudo numa planilha—sem nunca reclamar de dor nas mãos.

Um raspador JavaScript nada mais é do que um raspador web feito usando JavaScript. Você pode rodar raspadores JavaScript de dois jeitos principais:

- No navegador: Rodando scripts direto no console do navegador ou usando extensões para capturar dados da página que está vendo.

- No servidor (Node.js): Usando JavaScript fora do navegador (graças ao Node.js) para buscar páginas, analisar o conteúdo e extrair dados de forma programática.

Por que isso é importante para negócios? O web scraping impulsiona desde geração de leads (extraindo contatos de diretórios), monitoramento de preços (acompanhando concorrentes), até pesquisa de mercado (coletando avaliações, notícias ou tendências). Só no e-commerce, 48% dos usuários de web scraping estão nesse segmento (). Se você consegue ver no navegador, um raspador JavaScript provavelmente consegue capturar.

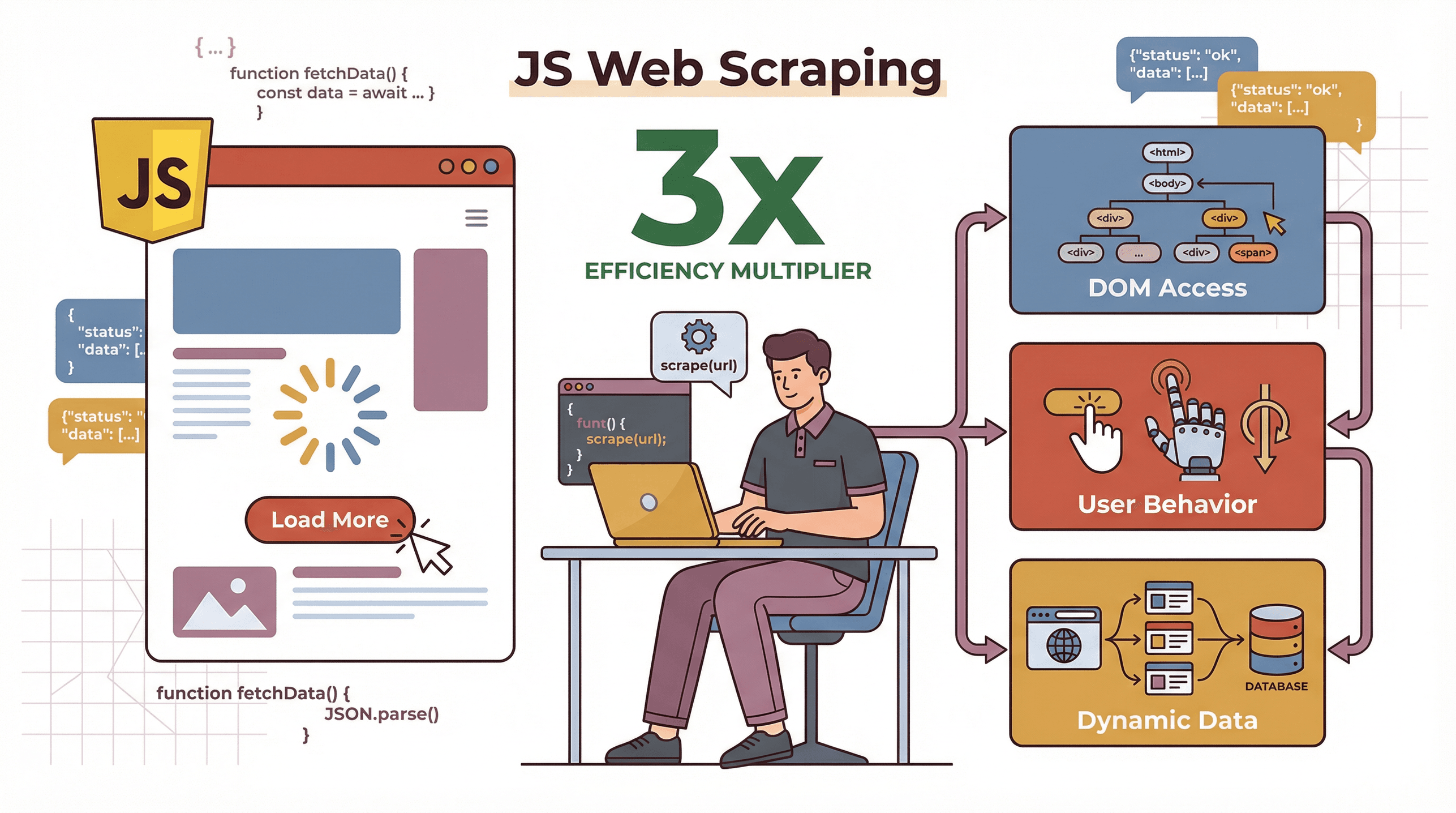

Por Que Usar JavaScript para Web Scraping? Vantagens em Sites Modernos

Mas afinal, por que escolher JavaScript para scraping, se Python é tão popular entre cientistas de dados? O segredo é que os sites modernos são movidos a JavaScript. Eles carregam conteúdo dinamicamente, buscam dados depois que a página carrega e muitas vezes exigem interações do usuário (tipo clicar em “Carregar mais” ou rolar a tela). Com raspadores JavaScript, você pode:

Mas afinal, por que escolher JavaScript para scraping, se Python é tão popular entre cientistas de dados? O segredo é que os sites modernos são movidos a JavaScript. Eles carregam conteúdo dinamicamente, buscam dados depois que a página carrega e muitas vezes exigem interações do usuário (tipo clicar em “Carregar mais” ou rolar a tela). Com raspadores JavaScript, você pode:

- Lidar com conteúdo dinâmico: Como o JavaScript roda no navegador, ele consegue acessar e interagir com conteúdos que só aparecem depois que os scripts rodam.

- Simular o comportamento do usuário: Ferramentas como Puppeteer permitem automatizar cliques, rolagens e até logins, como se fosse uma pessoa navegando.

- Trabalhar direto com o DOM: O JavaScript acessa e manipula a estrutura da página fácil, fácil, facilitando a extração dos dados que você quer.

Como o JavaScript se compara a outras linguagens? Dá uma olhada nesse resumo:

| Fator | JavaScript (Node.js) | Python | PHP |

|---|---|---|---|

| Conteúdo Dinâmico | Excelente—roda nativamente no navegador, ótimo para sites pesados em JS | Precisa de ferramentas extras (Selenium/Playwright) | Limitado |

| Velocidade/Concorrência | Alta—modelo assíncrono, busca várias páginas em paralelo | Boa, mas precisa de asyncio/Scrapy para concorrência | Mais lento, menos comum |

| Facilidade de Uso | Moderada—desenvolvedores web se sentem em casa, async pode confundir iniciantes | Mais fácil para iniciantes, muitos tutoriais | Básico, menos flexível |

| Automação de Navegador | Primeira classe (Puppeteer, Playwright) | Boa (Selenium, Playwright) | Raro |

| Melhor Para | Sites dinâmicos, interativos ou SPA; fluxos de trabalho web | Análise de dados, sites estáticos, scripts rápidos | Sites estáticos simples |

Se o site alvo é um single-page app ou carrega dados ao rolar ou clicar, JavaScript costuma ser a melhor escolha ().

Montando Seu Primeiro Raspador JavaScript: Ferramentas e Ambiente

Bora colocar a mão na massa? Veja como criar um ambiente básico para scraping em JavaScript—sem complicação.

-

Instale o Node.js

Baixe e instale o Node.js em . Assim, você pode rodar JavaScript fora do navegador. -

Inicie um Projeto

Abra o terminal e rode:1mkdir meu-raspador 2cd meu-raspador 3npm init -y -

Instale Bibliotecas Essenciais

Você vai precisar de:- ou

node-fetchpara requisições HTTP - para analisar HTML (tipo um jQuery para o servidor)

1npm install axios cheerio - ou

-

Inspecione o Site Alvo

Abra o DevTools do Chrome (botão direito > Inspecionar) e procure os elementos HTML que têm os dados. Anote classes, IDs ou tags importantes.

Veja um script inicial simples:

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("Título da página:", pageTitle);

9 } catch (err) {

10 console.error("Falha ao raspar:", err);

11 }

12}

13scrapePage('https://example.com');Rode com node scrape.js e veja o título da página no console. Prático e rápido!

Construindo um Raspador Web JavaScript Básico: Passo a Passo

Vamos criar algo mais útil. Suponha que você queira extrair títulos e preços de livros do , um site clássico para testes.

Passo 1: Inspecione a Página

Cada livro está dentro de <article class="product_pod">. O título está em <h3><a title="Book Title"></a></h3>, e o preço em <p class="price_color">.

Passo 2: Escreva o Raspador

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();Esse script busca a página, analisa o HTML, percorre cada livro e extrai título e preço. O resultado? Um array organizado de objetos de livros:

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]Passo 3: Expandindo para Paginação

Quer raspar várias páginas? Procure o link “Next” e faça um loop, atualizando a URL a cada vez. Com um pouco mais de código, você pode extrair o site inteiro.

Indo Além: Lidando com Conteúdo Dinâmico e Interações com JavaScript

Agora vem a parte divertida (e às vezes desafiadora): conteúdo dinâmico. Muitos sites modernos não mostram todos os dados no HTML inicial. Eles carregam informações via JavaScript depois que a página abre ou exigem cliques e rolagens para mostrar mais.

Cheerio e Axios não enxergam esse conteúdo—eles só pegam o HTML bruto. Para raspar sites dinâmicos, você precisa de um navegador headless como o .

Usando Puppeteer para Web Crawling Avançado em JavaScript

O Puppeteer permite controlar o Chrome (ou Chromium) via código. Com ele, você pode:

- Abrir páginas

- Esperar elementos carregarem

- Clicar em botões, preencher formulários, rolar a página

- Extrair conteúdo depois que todos os scripts rodaram

Veja um exemplo simples com Puppeteer:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();Você pode até automatizar logins, clicar em “Carregar mais” ou lidar com rolagem infinita, rolando a página e esperando o novo conteúdo aparecer ().

Thunderbit: Tornando o Scraping em JavaScript Mais Simples e Inteligente

Vamos ser sinceros: criar raspadores do zero é poderoso, mas toma tempo, exige conhecimento técnico e manutenção constante. Por isso sou fã do , nossa extensão de Chrome com IA que transforma o web scraping em poucos cliques.

O Thunderbit foi feito para quem é de negócios—não precisa saber programar. Olha como é fácil:

- Sugestão de Campos por IA: Com um clique, a IA do Thunderbit analisa a página e sugere as melhores colunas para extrair (tipo “Nome do Produto”, “Preço”, “E-mail” etc.).

- Raspagem em 2 Cliques: Revise os campos sugeridos, clique em “Raspar” e o Thunderbit coleta todos os dados—incluindo paginação e subpáginas automaticamente.

- Paginação e Subpáginas: Precisa de mais detalhes? O Thunderbit pode seguir links para subpáginas (como detalhes de produtos ou perfis) e juntar tudo na sua tabela.

- Modo Nuvem ou Navegador: Raspe direto no navegador (ótimo para páginas logadas) ou use a nuvem do Thunderbit para velocidade (até 50 páginas de uma vez).

- Exportação Estruturada e Gratuita: Exporte para Excel, Google Sheets, Airtable, Notion, CSV ou JSON—sempre grátis, independente do volume.

Thunderbit na Prática: Da Extração à Exportação de Dados

Imagina que você quer extrair contatos de um diretório de empresas:

- Instale o Thunderbit ().

- Abra a página do diretório.

- Clique em “Sugestão de Campos por IA.” O Thunderbit sugere colunas como “Nome”, “Telefone”, “Empresa”.

- Clique em “Raspar.” O Thunderbit coleta todos os dados, mesmo em várias páginas.

- Exporte para Sheets ou Excel. Pronto.

O que antes levava horas (ou exigia um dev) agora é feito em minutos. E como o Thunderbit usa IA, ele se adapta a mudanças no layout do site—chega de script quebrando a cada atualização ().

Veja como o scraping tradicional em JavaScript se compara ao Thunderbit:

| Critério | JS Manual | JS Avançado (Puppeteer) | Raspador Web IA Thunderbit |

|---|---|---|---|

| Habilidade Necessária | Programação | Programação avançada | Nenhuma (apontar e clicar) |

| Conteúdo Dinâmico | Limitado | Excelente | Integrado |

| Tempo de Configuração | Horas por site | Horas a dias | Segundos a minutos |

| Manutenção | Alta | Alta | Baixa (IA se adapta) |

| Opções de Exportação | Código personalizado | Código personalizado | 1 clique para Excel/Sheets/etc. |

| Custo | Grátis (demorado) | Grátis (hardware, tempo) | Plano gratuito, depois R$15/mês+ |

Técnicas Avançadas: Scraping Complexo com Bibliotecas JavaScript

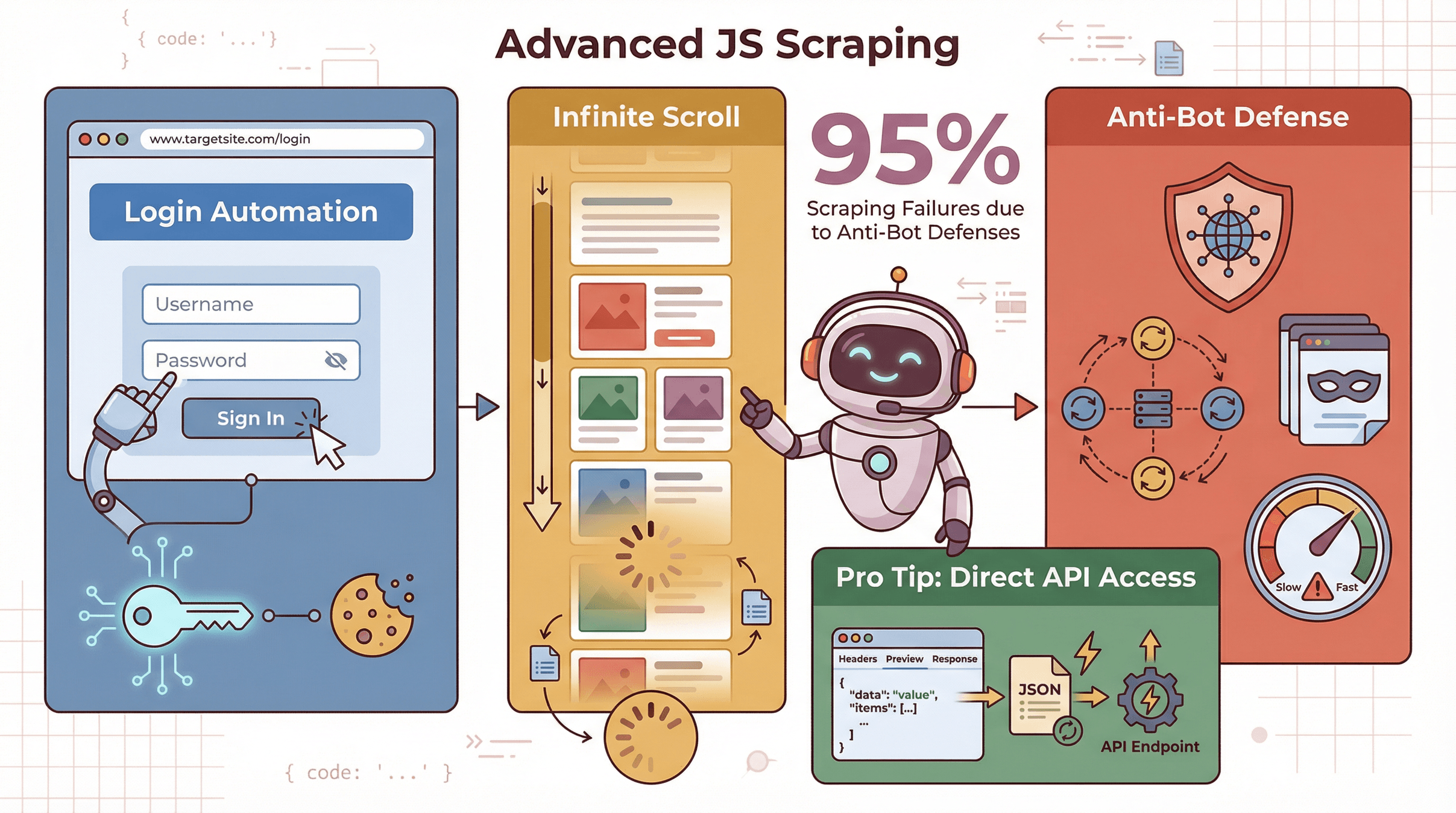

Às vezes, é preciso ir além—extraindo dados atrás de logins, lidando com rolagem infinita ou contornando bloqueios anti-scraping.

Às vezes, é preciso ir além—extraindo dados atrás de logins, lidando com rolagem infinita ou contornando bloqueios anti-scraping.

- Logins/Sessões: Com Puppeteer, você pode automatizar o login preenchendo formulários e clicando em botões, depois raspar dados como usuário autenticado.

- Rolagem Infinita: Role a página programaticamente, espere o novo conteúdo carregar e repita até extrair tudo ().

- Defesas Anti-Scraping: Use proxies, alterne user agents e controle a frequência dos acessos para evitar bloqueios. Mais de 95% das falhas em scraping são causadas por defesas anti-bot ().

Dica de quem já apanhou: Às vezes, dá pra ignorar o navegador achando endpoints de API escondidos do site (olhe a aba Network no DevTools). Se conseguir buscar dados em JSON direto, seu raspador vai voar.

Otimizando e Mantendo Seu Crawler JavaScript

Fazer um raspador é só metade do caminho—manter ele funcionando é o verdadeiro desafio.

- Processamento Assíncrono: Use async/await e busque páginas em paralelo (mas sem sobrecarregar o servidor).

- Processamento em Lotes: Divida os dados em partes para evitar problemas de memória.

- Tratamento de Erros: Capture falhas, tente de novo e registre problemas para depurar depois.

- Paginação: Detecte links ou botões “Próximo” e percorra todas as páginas.

- Seletores Resilientes: Prefira IDs ou classes únicas; evite seletores frágeis que quebram com mudanças no layout.

- Monitoramento: Configure alertas caso o raspador comece a retornar dados vazios ou erros.

Dica de ouro: Scraping não é “configurou e esqueceu”. Planeje revisões e monitoramento frequentes ().

Comparando Soluções de Scraping em JavaScript: Tradicional vs. Thunderbit

Veja um comparativo rápido para quem quer resultado prático:

| Abordagem | Tempo até o Resultado | Habilidade Necessária | Lida com Conteúdo Dinâmico | Manutenção | Opções de Exportação | Escalabilidade |

|---|---|---|---|---|---|---|

| JS Manual (Cheerio) | Lento | Programação | Não | Alta | Você mesmo implementa | Bom para estáticos |

| JS Avançado (Puppeteer) | Moderado | Programação+ | Sim | Alta | Você mesmo implementa | Mais lento por página |

| Thunderbit | Rápido | Nenhuma | Sim (IA) | Baixa | 1 clique para Sheets/CSV | Nuvem ou navegador |

Para a maioria dos profissionais, o Thunderbit é o caminho mais rápido do “preciso desses dados” até “aqui está minha planilha”.

Conclusão & Principais Dicas

Montar um raspador web em JavaScript é um superpoder no mundo dos dados de hoje. Olha o que eu aprendi (e recomendo):

- Comece simples: Use Cheerio e Axios para sites estáticos.

- Avance quando precisar: Use Puppeteer para sites dinâmicos, interativos ou que exigem login.

- Ganhe tempo com IA: Para a maioria das necessidades, o permite extrair dados sem programar e em poucos minutos.

- Planeje a manutenção: Sites mudam—seus raspadores precisam estar prontos para se adaptar.

- Sempre raspe de forma ética: Respeite as regras dos sites, não sobrecarregue servidores e use os dados com responsabilidade.

Quer experimentar scraping sem dor de cabeça? e veja como é fácil. E se quiser se aprofundar, dá uma olhada no para mais tutoriais, dicas e exemplos reais.

Boas raspagens—e que seus seletores sejam sempre únicos!

Perguntas Frequentes

1. O que é um raspador web em JavaScript?

Um raspador web em JavaScript é um programa (ou script) feito em JavaScript que extrai dados automaticamente de sites. Pode rodar no navegador ou no servidor (com Node.js) e é especialmente eficiente em sites dinâmicos e pesados em JavaScript.

2. Por que escolher JavaScript em vez de Python para web scraping?

JavaScript é a linguagem da web, ideal para raspar sites que carregam conteúdo dinamicamente ou exigem interações do usuário. Python é ótimo para sites estáticos e análise de dados, mas precisa de ferramentas extras para lidar com conteúdo dinâmico.

3. Quais ferramentas preciso para criar um raspador JavaScript?

Para sites estáticos: Node.js, Axios (ou fetch) e Cheerio. Para sites dinâmicos: adicione Puppeteer ou Playwright para automação de navegador. Para scraping sem código, experimente o .

4. Como o Thunderbit simplifica o web scraping?

O Thunderbit usa IA para detectar e extrair dados automaticamente de qualquer site. Basta clicar em “Sugestão de Campos por IA”, depois em “Raspar” e exportar os dados—sem precisar programar ou ajustar seletores.

5. Web scraping é legal e ético?

Web scraping é legal quando feito de forma responsável—extraia só dados públicos, respeite as regras do site e não sobrecarregue servidores. Evite raspar dados pessoais sem consentimento e use as informações de forma ética.

Quer ver scraping em JavaScript na prática? Confira o para tutoriais ou explore mais no .

Saiba Mais