Deixa eu te contar: poucas coisas no universo digital dão tanta satisfação quanto ver uma lista toda certinha e completa de todas as páginas de um site — é tipo achar todos os pares de meia depois de lavar roupa. Mas se você já tentou juntar todas as páginas de um site para uma auditoria de conteúdo, migração ou só pra descobrir o que está escondido no “porão digital”, sabe que não é tão fácil quanto parece. Já vi equipes gastando horas (ou até dias) juntando listas de sitemaps, fazendo buscas no Google e exportando do CMS, só pra perceber que ainda ficaram faltando páginas escondidas ou dinâmicas. E nem me fale da vez que tentei ajudar um amigo a exportar todas as URLs do WordPress dele — foi muito café e um leve desespero existencial.

A boa notícia? Você não precisa mais brincar de esconde-esconde digital com o seu próprio site. Neste guia, vou mostrar todos os principais jeitos de encontrar URLs de sites — dos métodos clássicos aos mais modernos — incluindo como ferramentas com IA, como o , podem deixar esse processo muito mais rápido, completo e, arrisco dizer, até divertido. Seja você do marketing, desenvolvimento ou só a pessoa “escalada pra pegar todas as URLs”, aqui tem passos práticos, exemplos reais e comparativos sinceros pra escolher o melhor caminho pra sua equipe.

Por Que Você Pode Precisar Listar Todas as Páginas de um Site: Casos Reais

Antes de falar do “como”, bora entender o “por quê”. Por que tanta gente precisa encontrar todas as URLs de um site? Não é só coisa de SEO — marketing, vendas, TI e operações também precisam disso direto. Olha só alguns dos cenários mais comuns:

- Auditorias de Conteúdo e Estratégia de SEO: Auditoria de conteúdo já virou rotina, com . Uma lista completa de URLs é a base pra avaliar desempenho, atualizar conteúdos antigos e melhorar o ranqueamento. .

- Redesign e Migração de Sites: ), e toda migração exige mapear as URLs atuais pra evitar links quebrados e perda de SEO.

- Compliance e Manutenção: Equipes de operações precisam achar páginas órfãs ou desatualizadas — às vezes microsites antigos de campanhas que ainda estão no ar, prontos pra causar aquele constrangimento.

- Análise de Concorrentes: Times de vendas e marketing extraem páginas de concorrentes pra listar produtos, preços ou posts de blog, buscando oportunidades e leads.

- Geração de Leads e Prospecção: Equipes comerciais precisam compilar listas de localizadores de lojas, diretórios de parceiros ou páginas de membros pra contato.

- Inventário de Conteúdo: Profissionais de conteúdo mantêm listas de posts, landing pages, PDFs e mais pra evitar duplicidade e extrair o máximo valor.

Aqui vai uma tabela resumindo os cenários:

| Cenário | Quem Precisa | Por Que a Lista Completa é Importante |

|---|---|---|

| Auditoria de SEO / Conteúdo | Especialistas em SEO, Marketing de Conteúdo | Avaliar todo o conteúdo; páginas faltando = análise incompleta, oportunidades perdidas |

| Migração/Redesign de Site | Desenvolvedores, SEO, TI, Marketing | Mapear URLs antigas e novas, criar redirecionamentos, evitar links quebrados e perda de SEO |

| Análise de Concorrentes | Marketing, Vendas | Ver todas as páginas do concorrente; páginas ocultas podem revelar oportunidades |

| Geração de Leads | Equipes de Vendas | Reunir páginas de contato/recursos para prospecção; garante que nenhum lead seja perdido |

| Inventário de Conteúdo | Marketing de Conteúdo | Manter repositório atualizado, identificar lacunas, evitar duplicidade e revisar páginas antigas |

E o impacto de páginas escondidas ou faltando? É real. Imagina planejar um redesign e esquecer uma landing page escondida que ainda converte, ou fazer uma auditoria e perder 5% das páginas porque não estão indexadas. Isso pode significar perda de receita, penalidades de SEO e até dor de cabeça com a imagem da empresa.

Maneiras Tradicionais de Encontrar URLs de um Site: Métodos Explicados

Vamos ao que interessa: como as pessoas realmente conseguem todas as páginas de um site? Existem alguns métodos clássicos — alguns rápidos, outros mais completos (e trabalhosos). Olha só como funcionam:

Busca no Google e Operadores de Pesquisa

Como funciona:

Abra o Google e digite site:seudominio.com. O Google mostra todas as páginas indexadas desse domínio. Dá pra refinar com palavras-chave ou subdiretórios (tipo site:seudominio.com/blog).

O que você consegue:

Uma lista das páginas que o Google conhece do seu site.

Limitações:

- Mostra só o que está indexado, não tudo que existe

- Normalmente para depois de algumas centenas de resultados, mesmo em sites grandes

- Não mostra páginas novas, ocultas ou propositalmente não indexadas

Quando usar:

Ótimo pra uma visão rápida ou sites pequenos, mas não pra auditorias completas.

Conferindo robots.txt e Sitemap.xml

Como funciona:

Acesse seudominio.com/robots.txt e procure linhas “Sitemap:”. Abra o sitemap (geralmente seudominio.com/sitemap.xml ou /sitemap_index.xml). Sitemaps listam URLs que o dono do site quer indexar.

O que você consegue:

Uma lista das principais páginas — normalmente todos os posts, produtos, etc. .

Limitações:

- Sitemaps só incluem páginas que o dono quer indexar — órfãs ou ocultas geralmente ficam de fora

- Sitemaps podem estar desatualizados se não forem atualizados

- Alguns sites têm vários sitemaps; pode ser preciso procurar

Quando usar:

Perfeito se você é dono do site ou quer ver rapidamente as principais páginas de um concorrente. Mas lembre: você vê só o que o dono quer mostrar.

Ferramentas de SEO Spider e Crawlers

Como funciona:

Ferramentas como Screaming Frog, Sitebulb ou DeepCrawl simulam um robô de busca. Você coloca a URL do site e a ferramenta segue todos os links internos, montando uma lista das páginas encontradas.

O que você consegue:

Potencialmente todas as páginas linkadas no site, além de dados como status e metatags.

Limitações:

- Páginas órfãs (sem links) ficam de fora, a não ser que você adicione manualmente

- Páginas dinâmicas ou geradas por JavaScript podem ser ignoradas se a ferramenta não suportar navegação "headless"

- Sites grandes podem demorar muito pra serem rastreados e consumir muita memória

- Exige configuração técnica e conhecimento

Quando usar:

Ideal pra profissionais de SEO ou desenvolvedores em auditorias profundas. Não é tão amigável pra quem não é técnico.

Google Search Console e Analytics

Como funciona:

Se você tem acesso ao site, o Google Search Console (GSC) e o Analytics permitem exportar listas de URLs.

- GSC: Relatórios de Cobertura e Desempenho mostram URLs indexadas e excluídas (até 1.000 por exportação, mais via API).

- Analytics: Mostra todas as páginas que receberam tráfego em determinado período (GA4 permite até 100.000 linhas por exportação).

Limitações:

- GSC e Analytics só mostram páginas que o Google conhece ou que receberam tráfego

- Limite de exportação (1.000 linhas no GSC, 100k no GA4)

- Exige propriedade/verificação do site; não serve pra análise de concorrentes

- Páginas sem tráfego ou não indexadas não aparecem

Quando usar:

Ótimo pro seu próprio site, especialmente antes de migração ou auditoria. Não serve pra concorrentes.

Dashboards do CMS

Como funciona:

Se seu site usa WordPress, Shopify ou outro CMS, normalmente dá pra exportar uma lista de páginas e posts direto do painel (às vezes com plugin).

O que você consegue:

Uma lista de todos os conteúdos — páginas, posts, produtos, etc.

Limitações:

- Exige acesso de administrador

- Pode não incluir páginas dinâmicas ou fora do CMS

- Se o site usa vários sistemas (blog, loja, docs), vai precisar juntar as exportações

Quando usar:

Melhor pra donos de site fazendo inventário ou backup. Não ajuda pra análise de concorrentes.

Limitações dos Métodos Tradicionais para Listar Páginas de um Site

Vamos ser sinceros: nenhum desses métodos é perfeito. Olha só os principais pontos fracos:

- Complexidade Técnica: Muitos métodos exigem conhecimento técnico ou ferramentas especializadas. Pra quem não é da área, isso pode ser um baita obstáculo. Uma auditoria manual pode levar .

- Cobertura Incompleta: Cada método pode deixar páginas de fora — o Google não mostra páginas não indexadas ou novas, sitemaps ignoram órfãs, crawlers não acham páginas sem links, exportações do CMS deixam de fora o que não está no sistema.

- Trabalho Manual e Tempo: Muitas vezes é preciso juntar dados de várias fontes, deduplicar e limpar — um processo chato e sujeito a erros. Tem gente que até compartilha “gambiarras” como copiar e colar do sitemap no Excel ou usar scripts de linha de comando.

- Manutenção e Atualização: As listas ficam desatualizadas rápido. Métodos tradicionais exigem repetir o processo sempre que o site muda.

- Acesso e Permissões: Alguns métodos exigem acesso de admin ou propriedade do site — não servem pra análise de concorrentes.

- Excesso de Dados: Ferramentas de SEO podem gerar dados demais quando tudo que você quer é uma lista simples de URLs.

Resumindo, o processo tradicional é tipo “tentar fazer um bolo enquanto a receita muda e o forno às vezes te tranca do lado de fora”. (Sim, já ouvi essa analogia de um estrategista de conteúdo — e concordo.)

Conheça o Thunderbit: A Maneira com IA de Encontrar URLs de Sites

Agora vem a parte boa. E se você pudesse simplesmente pedir pra um assistente “vasculhar o site e listar todas as páginas pra mim” — e ele realmente fizesse isso, sem código ou complicação? É exatamente isso que o faz.

Thunderbit é uma extensão Chrome de raspagem de dados com IA, feita pra quem não é técnico (mas poderosa pra profissionais). Ele usa IA pra “ler” sites, estruturar os dados e exportar todas as URLs — incluindo páginas ocultas, dinâmicas e subpáginas. Não precisa programar nem mexer em configurações complicadas. Só abrir o site, clicar em “AI Suggest Fields” e deixar o Thunderbit fazer o trabalho pesado.

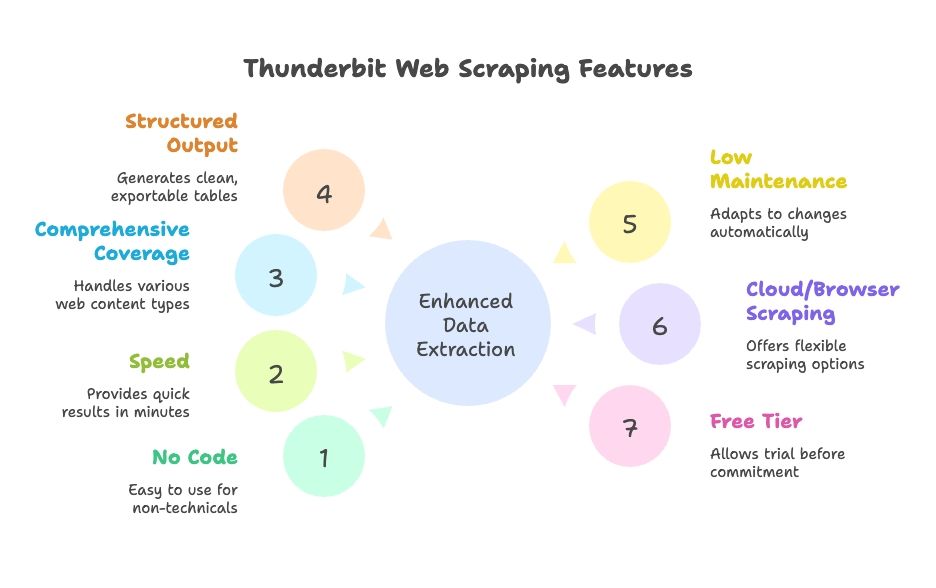

Por que o Thunderbit se destaca:

- Sem código ou configuração: Interface em linguagem natural, guiada por IA. Qualquer pessoa da equipe pode usar.

- Rapidez: Resultados em minutos, não horas.

- Cobertura completa: Lida com conteúdo dinâmico, paginação, rolagem infinita e subpáginas.

- Saída estruturada: Tabelas limpas, prontas pra exportar pra Google Sheets, Excel, Airtable, Notion, CSV ou JSON.

- Baixa manutenção: A IA se adapta automaticamente às mudanças do site; menos ajustes necessários.

- Raspagem na nuvem ou navegador: Escolha o que funciona melhor pro seu fluxo de trabalho.

- Plano gratuito disponível: Teste antes de decidir.

Como o Thunderbit Facilita a Extração de Páginas de um Site

Veja como o Thunderbit funciona na prática. Vou mostrar como sair do “preciso de uma lista de todas as páginas do meu site” pra “aqui está a planilha, chefe” em poucos cliques.

Passo 1: Instale e Abra o Thunderbit

Baixe a e fixe no navegador. Acesse o site que deseja extrair (ex: sua homepage) e clique no ícone do Thunderbit pra abrir a interface.

Dica: O Thunderbit oferece créditos gratuitos pra novos usuários, então você pode testar sem precisar de cartão de crédito.

Passo 2: Escolha a Fonte de Dados

O Thunderbit, por padrão, extrai a página atual, mas você também pode inserir uma lista de URLs (como um sitemap ou páginas de categoria) se quiser começar de uma seção específica.

- Pra maioria dos sites, comece pela homepage ou página do sitemap.

- Pra e-commerces, pode ser melhor começar por uma categoria ou listagem de produtos.

Passo 3: Use o “AI Suggest Fields” para Detectar URLs

Aqui começa a mágica da IA. Clique em “AI Suggest Fields” (ou “AI Suggest Columns”). A IA do Thunderbit analisa a página, reconhece padrões e sugere colunas como “Título da Página” e “URL da Página” pra todos os links encontrados. Você pode ajustar essas colunas como quiser.

- Na homepage, você pode pegar navegação, rodapé e links em destaque.

- No sitemap, terá uma lista limpa de URLs.

- Dá pra adicionar/remover colunas ou refinar o que deseja extrair.

A IA do Thunderbit faz o trabalho pesado — não precisa criar XPaths ou seletores CSS. É como ter um estagiário robô que realmente entende o que você quer.

Passo 4: Ative a Extração de Subpáginas

A maioria dos sites não lista todas as páginas na homepage. É aí que entra a Extração de Subpáginas do Thunderbit. Marque a coluna de URL como link de “seguir” e o Thunderbit vai clicar em cada link encontrado, extraindo mais URLs dessas páginas. Você pode até configurar modelos aninhados pra extração em vários níveis.

- Pra listas paginadas ou botões “carregar mais”, ative Paginação & Rolagem pro Thunderbit continuar até encontrar tudo.

- Pra sites com subdomínios ou seções (tipo um blog em ), o Thunderbit pode seguir esses links também, se você indicar.

Passo 5: Execute a Extração

Clique em “Scrape” e veja o Thunderbit em ação. Ele preenche uma tabela com as URLs (e outros campos escolhidos) em tempo real. Pra sites grandes, você pode deixar rodando em segundo plano e voltar quando terminar.

Passo 6: Revise e Exporte

Ao finalizar, revise os resultados — o Thunderbit permite ordenar, filtrar e remover duplicatas direto no app. Depois, exporte os dados com um clique pra Google Sheets, Excel, CSV, Airtable, Notion ou JSON. Chega de copiar e colar ou formatar manualmente.

O processo todo? Pra sites pequenos ou médios, você consegue uma lista completa de URLs em menos de 10 minutos. Pra sites grandes, ainda é muito mais rápido (e menos estressante) do que juntar dados de várias fontes.

Descobrindo Páginas Ocultas e Dinâmicas com o Thunderbit

Um dos meus recursos favoritos do Thunderbit é como ele encontra páginas que ferramentas tradicionais costumam ignorar:

- Conteúdo Gerado por JavaScript: Como o Thunderbit roda em um navegador real, ele captura páginas que carregam dinamicamente (tipo listas de empregos com rolagem infinita ou produtos).

- Páginas Órfãs ou Sem Links: Se você tiver uma pista (como um sitemap ou função de busca), o Thunderbit pode usá-la pra encontrar páginas não linkadas em lugar nenhum.

- Subdomínios ou Seções: O Thunderbit pode seguir links entre subdomínios, se necessário, dando uma visão completa do seu site.

- Interação como Usuário: Precisa preencher um campo de busca ou clicar em um filtro pra revelar páginas ocultas? O AI Autofill do Thunderbit faz isso também.

Exemplo real: Uma equipe de marketing precisava encontrar todas as landing pages antigas — muitas não estavam linkadas, mas ainda existiam. Ao extrair resultados do Google com o Thunderbit e inserir padrões conhecidos de URLs, descobriram dezenas de páginas esquecidas, evitando confusão (e dores de cabeça).

Comparando Thunderbit e Métodos Tradicionais: Velocidade, Facilidade e Cobertura

Vamos comparar o Thunderbit com os métodos tradicionais:

| Aspecto | Busca Google “site:” | Sitemap XML | SEO Crawler (Screaming Frog) | Google Search Console | Exportação do CMS | Thunderbit AI Scraper |

|---|---|---|---|---|---|---|

| Velocidade | Muito rápido, mas limitado | Instantâneo se disponível | Varia (minutos a horas) | Rápido para sites pequenos | Instantâneo para sites pequenos | Rápido, configuração em minutos, extração automatizada |

| Facilidade de Uso | Muito fácil | Fácil | Moderado (exige configuração) | Moderado | Fácil (se admin) | Muito fácil, sem código |

| Cobertura | Baixa (só indexado) | Alta para páginas principais | Alta para páginas linkadas | Alta para indexadas, exportação limitada | Média (só conteúdo) | Muito alta, cobre dinâmico e subpáginas |

| Saída & Integração | Copiar e colar manual | XML (precisa tratar) | CSV com muitos dados extras | CSV/Excel, até 1.000 linhas | CSV/XML, pode precisar limpeza | Tabela limpa, exportação 1-clique para Sheets, Excel, etc. |

| Manutenção | Repetir manualmente | Precisa atualizar | Novo rastreamento a cada mudança | Exportação periódica | Exportar após mudanças | Baixa — IA se adapta, pode agendar extração |

O Thunderbit se destaca em facilidade, abrangência e integração. Métodos tradicionais têm seus pontos fortes, mas exigem mais esforço pra juntar resultados e manter tudo atualizado. A IA do Thunderbit se adapta às mudanças do site, então você não precisa ficar ajustando configurações ou repetindo exportações manuais.

Qual Abordagem Escolher: Quem Deve Usar Cada Método?

Então, qual método é melhor pra você? Eis minha opinião, baseada em anos ajudando equipes a organizar dados de sites:

- Profissionais de SEO / Desenvolvedores: Se precisa de dados técnicos (metatags, links quebrados, etc.) ou audita sites enormes, um crawler ou script pode ser útil. Mas mesmo assim, o Thunderbit gera rapidamente uma lista de URLs pra alimentar outras ferramentas.

- Marketing, Conteúdo, Gerentes de Projeto: O Thunderbit é um salva-vidas. Chega de esperar o TI rodar scripts ou juntar exportações. Pra inventário de conteúdo, análise de concorrentes ou auditoria rápida, o Thunderbit permite autonomia.

- Vendas / Geração de Leads: O Thunderbit facilita extrair listas de lojas, eventos ou diretórios de membros de qualquer site — sem código.

- Sites Pequenos / Tarefas Rápidas: Pra sites minúsculos, uma checagem manual ou sitemap pode bastar. Mas o Thunderbit é tão rápido de configurar que vale a pena pra não deixar nada passar.

- Orçamento: Métodos tradicionais são baratos (exceto pelo seu tempo). O Thunderbit tem plano gratuito e opções acessíveis pra empresas. Lembre: seu tempo vale dinheiro!

- Necessidades Muito Específicas: Se precisa de dados muito customizados ou lógica complexa, talvez precise programar. Mas a IA do Thunderbit cobre a maioria dos casos com configuração mínima.

Dicas pra decidir:

- Se você tem menos de 1.000 páginas, tente exportar pelo Google Search Console — mas confira se está completo.

- Se não tem acesso ao site ou precisa de dados de concorrentes, Thunderbit ou um crawler são ideais.

- Se valoriza seu tempo e quer uma solução escalável, Thunderbit é imbatível.

- Pra colaboração em equipe, a exportação direta do Thunderbit pra Google Sheets é um diferencial.

Muitas empresas usam abordagem híbrida: Thunderbit pra tarefas rápidas e equipes não técnicas, ferramentas tradicionais pra auditorias profundas.

Principais Lições: Como Listar Páginas de um Site para Qualquer Necessidade

Resumindo:

- Ter uma lista completa das páginas do seu site é fundamental pra SEO, estratégia de conteúdo, migrações e pesquisa de vendas. Evita surpresas, links quebrados e oportunidades perdidas. A maioria dos profissionais de marketing já faz auditorias de conteúdo pelo menos uma vez ao ano ().

- Existem métodos tradicionais, mas todos têm lacunas. Nenhum garante uma lista completa e atualizada. Geralmente exigem conhecimento técnico e combinar várias saídas.

- A raspagem com IA (Thunderbit) é a solução moderna. O Thunderbit usa IA pra fazer o “trabalho pesado” e clicar, tornando a extração de dados acessível a todos. Ele lida com conteúdo dinâmico, subpáginas e exporta dados prontos pra uso — economizando tempo e reduzindo erros. Em comparativos, o Thunderbit faz em minutos o que antes levava horas, com curva de aprendizado mínima ().

- Escolha o método conforme sua necessidade e equipe. Use todas as ferramentas pra sites enormes, mas pra maioria dos negócios, só o Thunderbit já resolve.

- Mantenha atualizado. Auditorias regulares ajudam a identificar problemas cedo e manter o site eficiente. O agendamento do Thunderbit facilita isso, enquanto processos manuais acabam sendo deixados de lado pelo esforço.

Pra fechar: Chega de desculpas pra não saber o que tem no seu site (ou no do concorrente). Com a abordagem certa, você consegue uma lista completa de todas as páginas e usa esse conhecimento pra melhorar SEO, experiência do usuário e estratégia de negócios. Trabalhe de forma inteligente — deixa a IA fazer o trabalho pesado e garanta que nenhuma página fique pra trás.

Próximos Passos

Se você quer parar de temer a tarefa de “me traga todas as URLs”, e teste no seu site ou no de um concorrente. Você vai se surpreender com o tempo (e sanidade) que vai economizar. E se quiser se aprofundar em raspagem de dados, confira outros guias no , como ou .

Perguntas Frequentes

1. Por que eu precisaria de uma lista de todas as páginas de um site?

Equipes de SEO, marketing, vendas e TI frequentemente precisam de listas completas de URLs pra tarefas como auditorias de conteúdo, migrações de site, geração de leads e análise de concorrentes. Ter uma lista precisa evita links quebrados, garante que conteúdos não sejam duplicados ou esquecidos e revela oportunidades escondidas.

2. Quais são as formas tradicionais de encontrar todas as URLs de um site?

Os métodos mais comuns incluem usar a busca site: do Google, checar arquivos sitemap.xml e robots.txt, rastrear com ferramentas de SEO como Screaming Frog, exportar dados de CMSs como WordPress e puxar páginas indexadas ou com tráfego do Google Search Console e Analytics. Mas cada método tem limitações de cobertura e usabilidade.

3. Quais as limitações dos métodos tradicionais pra encontrar URLs?

Esses métodos geralmente deixam de fora páginas dinâmicas, órfãs ou não indexadas. Podem exigir conhecimento técnico, levar horas pra combinar e limpar dados e não escalam bem pra sites grandes ou auditorias recorrentes. Também podem exigir acesso de admin, o que nem sempre é possível.

4. Como o Thunderbit simplifica o processo de encontrar todas as páginas de um site?

O Thunderbit é um 웹 스크래퍼 com IA que escaneia sites como um humano — clicando em subpáginas, lidando com JavaScript e estruturando dados automaticamente. Não exige programação, funciona via extensão Chrome e exporta listas limpas de URLs pra Google Sheets, Excel, CSV e mais em poucos minutos.

5. Quem deve usar Thunderbit e quem deve usar ferramentas tradicionais?

O Thunderbit é ideal pra profissionais de marketing, conteúdo, vendas e usuários não técnicos que querem listas rápidas e completas sem complicação. Ferramentas tradicionais são melhores pra auditorias técnicas profundas que exigem metadados ou scripts customizados. Muitas equipes usam ambos — Thunderbit pela agilidade e facilidade, e métodos tradicionais pra análises detalhadas.