Vou ser sincero: da primeira vez que tentei extrair todas as URLs de um site grande, pensei: “O quão difícil pode ser?” Algumas horas depois, ainda estava a clicar páginas sem fim, a copiar e colar links numa folha de cálculo e a questionar as minhas escolhas de vida. Se já tentou encontrar todas as páginas de um site — seja para uma auditoria de conteúdo, uma lista de leads ou uma pesquisa competitiva — sabe bem o quão penoso isso é. Dá trabalho, é fácil errar e, sinceramente, é uma enorme perda de tempo e de talento.

Mas aqui vem a boa notícia: já não precisa de fazer isso da forma difícil. Ferramentas com IA, como a , estão a mudar o jogo para utilizadores de negócios, tornando possível encontrar todas as URLs de um domínio em minutos, e não em dias. De facto, empresas que usam ferramentas de raspagem web orientadas por IA relatam em tarefas de recolha de dados, e algumas chegam a reduzir em até em comparação com métodos manuais. Isto não é só uma estatística — são horas (ou dias) da sua vida de volta.

Então, vamos perceber por que encontrar todas as páginas de um site é tão complicado, por que modelos genéricos de IA como GPT ou Claude não conseguem realmente ajudar e como agentes de IA especializados — como a Thunderbit — tornam este processo muito mais simples. E sim, vou mostrar-lhe exatamente os passos para extrair todas as URLs de que precisa, mesmo sem saber programar.

Por que Encontrar Todas as URLs de um Domínio é Tão Difícil

Vamos ser realistas: os sites não foram feitos para entregar uma lista organizada com todas as páginas que contêm. Foram construídos para visitantes, não para quem tenta encontrar todas as páginas de um site de uma só vez. Eis por que esta tarefa é tão complicada:

- A loucura do copiar e colar manual: clicar em cada menu, lista e diretório, copiando URLs uma a uma, é meio caminho andado para tendinites — e para deixar metade das páginas de fora.

- Paginação e scroll infinito: muitos sites dividem o conteúdo em várias páginas ou carregam mais resultados à medida que faz scroll. Se perder um botão “Próximo” ou não fizer scroll o suficiente, pode deixar secções inteiras de fora.

- Estruturas de página inconsistentes: algumas páginas listam links num formato, outras usam outro layout. Acompanhar tudo isto é um pesadelo.

- Páginas ocultas ou órfãs: nem todas as páginas estão ligadas na navegação principal. Algumas ficam escondidas em camadas profundas, acessíveis apenas por sitemaps ou pela pesquisa interna.

- Erro humano: quanto mais páginas tiver de copiar, maior a probabilidade de falhar — URLs duplicados, typos ou simplesmente saltar algo.

E se estiver a trabalhar num site com centenas ou milhares de páginas? Esqueça. A extração manual simplesmente não escala. Como disse uma equipa de dados, para qualquer coisa além de casos triviais, .

O que Significa “Encontrar Todas as Páginas de um Site”?

Antes de falarmos de soluções, convém deixar claro o que estamos realmente a procurar.

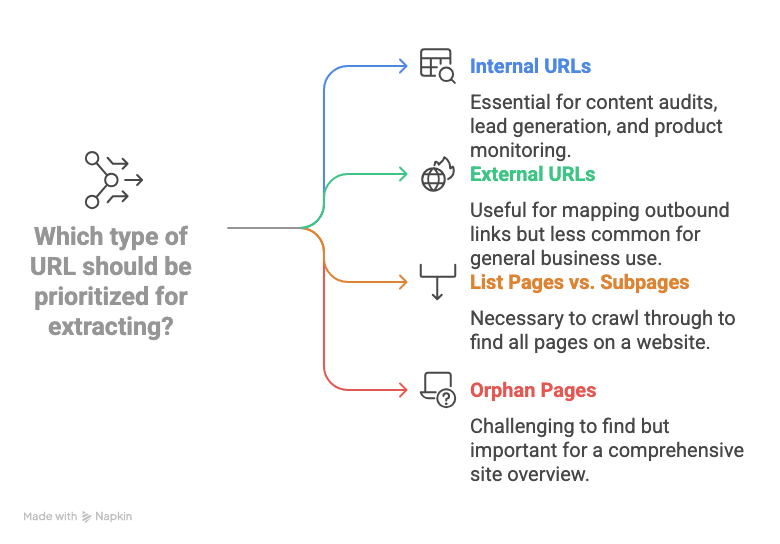

- URLs internas: são links que apontam para páginas no mesmo domínio (como /about-us ou /products/widget-123). Para a maioria dos casos de uso empresarial — auditoria de conteúdo, geração de leads, monitorização de produtos — as URLs internas são o principal alvo.

- URLs externas: links que levam a outros sites. Normalmente, não precisa deles, a não ser que esteja a mapear links de saída.

- Páginas de lista vs. subpáginas: muitos sites têm páginas “hub” ou de lista (pense em páginas de categoria, arquivos de blog, diretórios) que apontam para páginas de detalhe (como páginas de produto ou perfis). Para realmente encontrar todas as páginas de um site, precisa de percorrer essas listas e captar cada subpágina ligada.

- Páginas órfãs: são páginas sem links evidentes a apontar para elas. Às vezes, é possível encontrá-las através de sitemaps ou da pesquisa interna, mas são fáceis de perder.

Portanto, quando falamos em encontrar todas as URLs de um domínio, queremos dizer: obter cada URL de página interna, da homepage até ao produto ou artigo mais profundo, de preferência num formato que possa usar — como uma folha de cálculo.

Métodos Tradicionais para Encontrar Todas as URLs de um Domínio

Há algumas formas mais antigas de fazer isto, mas cada uma traz os seus próprios problemas:

Copiar e Colar Manualmente e Ferramentas do Navegador

Esta é a abordagem “força bruta”: clicar em cada link, copiar cada URL, colá-la numa folha de cálculo e torcer para não deixar nada escapar. Algumas pessoas usam extensões do navegador para capturar todos os links da página atual, mas continua a ter de repetir o processo em cada página, e fica por sua conta lidar com a paginação ou com secções ocultas. Serve para um site de cinco páginas — e pouco mais do que isso.

Usar a Pesquisa no Site e Sitemaps

- Pesquisa site: do Google: escreva site:seu-dominio.com no Google, e vai ver várias páginas indexadas. Mas o Google mostra apenas o que indexou (muitas vezes limitado a cerca de 1.000 resultados), por isso vai perder páginas novas, ocultas ou de baixa qualidade. A admite que isto não é uma solução completa.

- Sitemaps XML: muitos sites têm um /sitemap.xml que lista URLs importantes. Ótimo — se o sitemap estiver atualizado e incluir todas as páginas. Mas nem todos os sites têm um, e alguns dividem o sitemap em vários ficheiros. As páginas órfãs muitas vezes ficam de fora.

Crawlers e Scripts Técnicos

- Ferramentas de SEO (como Screaming Frog): fazem a varredura do site como um motor de busca e geram uma lista de URLs. São poderosas, mas exigem configuração, afinações e, por vezes, uma licença paga para sites grandes.

- Scripts em Python (como Scrapy): os programadores podem escrever scripts para rastrear e extrair URLs. Mas sejamos honestos: se não se sente à vontade com código, isso logo elimina esta opção. Além disso, os scripts partem quando o layout do site muda, por isso está sempre a correr atrás do prejuízo.

Resumindo: os métodos tradicionais são demasiado manuais, demasiado incompletos ou demasiado técnicos para a maioria dos utilizadores de negócios. Não é por acaso que tanta gente desiste a meio do caminho.

Por que Modelos Genéricos de IA Não Conseguem Automatizar Totalmente a Extração de URLs

Talvez esteja a pensar: “Não posso simplesmente pedir ao ChatGPT ou ao Claude para encontrar todas as páginas de um site por mim?” Bem que fosse assim tão simples. Na prática, funciona assim:

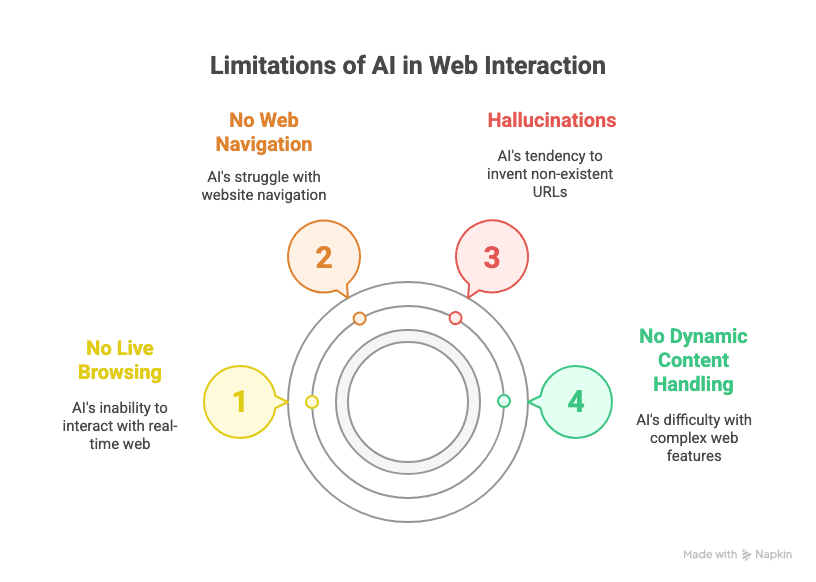

- Sem navegação em tempo real: modelos de IA de uso geral, como GPT ou Claude, não conseguem navegar na web em tempo real. Não “veem” o estado atual de um site — trabalham apenas com os dados de treino ou com aquilo que colar para eles.

- Sem navegação web: mesmo com plugins ou navegação ativada, os LLMs não sabem clicar em “Próximo”, lidar com scroll infinito ou seguir metodicamente cada link de um site.

- Alucinações: peça a uma IA genérica todas as URLs de um domínio, e ela muitas vezes inventará links que parecem plausíveis, mas que não existem mesmo. (Já a vi inventar páginas /about-us para sites que nunca tiveram uma.)

- Sem tratamento de conteúdo dinâmico: sites que carregam conteúdo com JavaScript, exigem login ou usam navegação complexa estão fora do alcance dos LLMs gerais.

Como diz o : “Se quiser extrair páginas às centenas ou aos milhares… o ChatGPT sozinho fica aquém.” Precisa de uma ferramenta criada especificamente para esta tarefa.

Agentes de IA Verticais São o Futuro (e por que isso Importa)

Aqui entra a minha experiência em SaaS e automação: agentes de IA verticais — ferramentas de IA criadas para um domínio específico, como extração de dados da web — são a única forma de obter resultados fiáveis e escaláveis em tarefas de negócio. Porquê?

- Os LLMs de uso geral são ótimos para escrever ou pesquisar, mas estão sujeitos a “alucinações” e não conseguem lidar com fluxos de trabalho repetíveis, em várias etapas, com a estabilidade que as empresas precisam.

- As ferramentas SaaS empresariais precisam de automatizar muitas tarefas repetitivas e estruturadas. É aí que os agentes de IA verticais brilham — foram feitos para fazer uma coisa muito bem, com o mínimo de erros.

- Há exemplos em vários setores: Thunderbit para extração de dados da web, Devin AI para desenvolvimento de software, Alta para automação de vendas, IL VISTA da Infinity Learn para educação, Rippling para RH, Harvey para a área jurídica… e a lista continua.

Em resumo: se quer encontrar todas as páginas de um site de forma fiável, precisa de um agente de IA vertical feito para isso — não de um chatbot genérico.

Conheça a Thunderbit: Extração de URLs com IA para Todos

É aqui que a entra. Como uma extensão Chrome de raspagem web com IA, a Thunderbit foi criada para utilizadores de negócios — sem código, sem configuração técnica, só resultados. Veja o que a distingue:

- Interface em linguagem natural: basta descrever o que quer (“Liste todas as URLs das páginas deste site”) e a IA da Thunderbit descobre como extrair isso.

- Sugestão de campos por IA: a Thunderbit analisa a página e sugere automaticamente nomes de colunas (como “URL da Página”) — sem ter de mexer em seletores CSS ou XPath.

- Lida com paginação e scroll infinito: a Thunderbit pode clicar em “Próximo” ou fazer scroll automaticamente para baixo, para não perder nenhuma página.

- Navegação em subpáginas: precisa de ir mais fundo? A Thunderbit também pode seguir links para subpáginas e recolher dados delas.

- Exportação estruturada: exporte os seus resultados diretamente para Google Sheets, Excel, Notion, Airtable ou CSV — de graça e com um clique.

- Sem necessidade de código: se consegue navegar num site, consegue usar a Thunderbit. É simples assim.

E, como a Thunderbit é um agente de IA vertical, foi construída para estabilidade e repetibilidade — perfeita para utilizadores de negócios que precisam de automatizar as mesmas tarefas vezes sem conta.

Passo a Passo: Como Encontrar Todas as URLs de um Domínio com a Thunderbit

Pronto para ver como funciona? Aqui vai um passo a passo, sem tecnicismos, para extrair todas as URLs de que precisa.

1. Instale a Extensão Chrome da Thunderbit

Antes de mais: . Funciona no Chrome, Edge, Brave e noutros navegadores Chromium. Fixe-a na barra de ferramentas para lhe aceder facilmente.

2. Abra a Página de Lista ou Diretório de Destino

Aceda ao site de onde quer extrair URLs. Pode ser a homepage, um sitemap, um diretório ou qualquer página de lista que aponte para as páginas que lhe interessam.

3. Abra a Thunderbit e Configure os Seus Campos

Clique no ícone da Thunderbit para abrir a extensão. Inicie um novo modelo de raspagem. É aqui que a magia acontece:

- Clique em “Sugerir campos com IA”. A IA da Thunderbit vai analisar a página e sugerir colunas — procure uma chamada “URL da Página”, “Link” ou algo semelhante.

- Se não vir exatamente o campo que quer, basta adicionar uma coluna chamada “URL da Página” (ou o que fizer sentido). A IA da Thunderbit foi treinada para reconhecer estes termos e mapeá-los para os dados certos.

4. Ative a Paginação ou o Scroll, se Necessário

Se a página de destino tiver várias páginas (como “Página 1, 2, 3…” ou um botão “Carregar mais”), ative a paginação na Thunderbit:

- Mude para o modo “Clicar na Paginação” em sites com botões “Próximo” ou para “Scroll Infinito” em sites que carregam mais conteúdo à medida que faz scroll.

- A Thunderbit vai pedir-lhe para selecionar o botão “Próximo” ou a área de scroll — basta clicar, e a IA trata do resto.

5. Inicie a Raspagem e Reveja os Resultados

Clique no botão “Raspar”. A Thunderbit vai rastrear todas as páginas, recolhendo cada URL que encontrar. Vai ver os resultados a aparecer numa tabela dentro da extensão. Em sites grandes, isto pode demorar alguns minutos, mas continua a ser muito mais rápido do que fazer tudo manualmente.

6. Exporte a Sua Lista de URLs

Quando a raspagem terminar, clique em Exportar. Pode enviar os seus dados diretamente para:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

As exportações são gratuitas e mantêm toda a formatação. Nada de dores de cabeça com copiar e colar.

Comparando a Thunderbit com Outras Soluções para Extração de URLs

| Método | Facilidade de uso | Precisão e cobertura | Escalabilidade | Opções de exportação |

|---|---|---|---|---|

| Copiar e colar manualmente | Doloroso | Baixa (fácil de perder) | Nenhuma | Manual (Excel etc.) |

| Extratores de links do navegador | Serve para 1 página | Média | Fraca | Manual |

Pesquisa site: do Google | Fácil | Média (não é completa) | Limitada a ~1.000 | Manual |

| Sitemap XML | Fácil (se existir) | Boa (se estiver atualizado) | Boa | Manual/Script |

| Ferramentas de SEO (Screaming Frog) | Técnica | Alta | Alta (paga) | CSV, Excel |

| Scripts em Python (Scrapy etc.) | Muito técnica | Alta | Alta | Personalizada |

| Thunderbit | Muito fácil | Muito alta | Alta | Google Sheets, CSV etc. |

A Thunderbit oferece a precisão e a escala de um crawler profissional com a facilidade de uso de uma extensão do navegador. Sem código, sem configuração, só resultados.

Bónus: Extrair Mais do que Apenas URLs com a Thunderbit

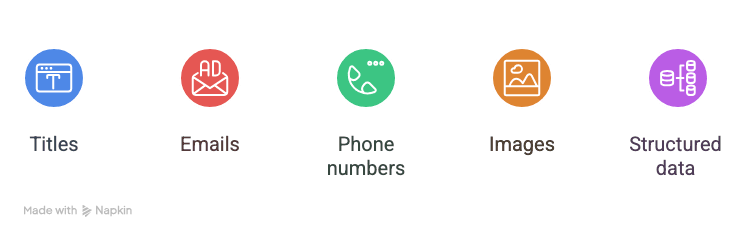

Aqui é que as coisas ficam realmente interessantes. A Thunderbit não serve só para URLs — também pode extrair:

- Títulos

- E-mails

- Números de telefone

- Imagens

- Quaisquer dados estruturados na página

Por exemplo, se estiver a montar uma lista de leads, pode fazer a Thunderbit captar a URL do perfil, o nome, o e-mail e o número de telefone de cada item de um diretório — tudo numa única passagem. Se estiver a auditar produtos, pode extrair a URL do produto, o nome, o preço e o estado de stock. A Thunderbit ainda oferece suporte à , por isso pode entrar em cada link e extrair os detalhes de lá.

E sim, os extratores de e-mail e telefone da Thunderbit são totalmente gratuitos. Isso faz uma enorme diferença para equipas de vendas e marketing.

Principais Aprendizados: Como Encontrar Todas as Páginas de um Site com IA

Vamos recapitular:

- Extrair todas as URLs de um domínio é difícil com ferramentas manuais ou genéricas.

- Modelos genéricos de IA, como o GPT, não lidam com navegação web, paginação ou conteúdo dinâmico.

- Agentes de IA verticais, como a Thunderbit, são feitos à medida para extração de dados da web — estáveis, repetíveis e fáceis para utilizadores de negócios.

- A Thunderbit simplifica tudo: instale a extensão, use a IA para sugerir campos, ative a paginação, faça a raspagem e exporte. Sem código, sem complicações.

- Pode extrair mais do que URLs: títulos, e-mails, números de telefone e muito mais — perfeito para geração de leads, auditorias ou pesquisa.

Se está cansado de copiar e colar links ou de lutar com crawlers técnicos, . Há um plano gratuito, por isso pode ver por si mesmo quanto tempo — e sanidade — vai poupar.

E, se tiver curiosidade sobre outras formas de a Thunderbit ajudar — como , ou — confira o para mais guias e dicas.

Pronto para recuperar o seu tempo da recolha manual de dados? O futuro da extração de dados da web são os agentes de IA verticais — e a Thunderbit está a liderar esse caminho. Experimente e faça com que a sua próxima auditoria, lista de leads ou projeto de pesquisa seja o mais fácil de todos.

Leia mais

P.S.: Se algum dia lhe der vontade de copiar e colar 1.000 URLs à mão, lembre-se: agora existe uma IA para isso. Os seus pulsos — e o seu chefe — vão agradecer.