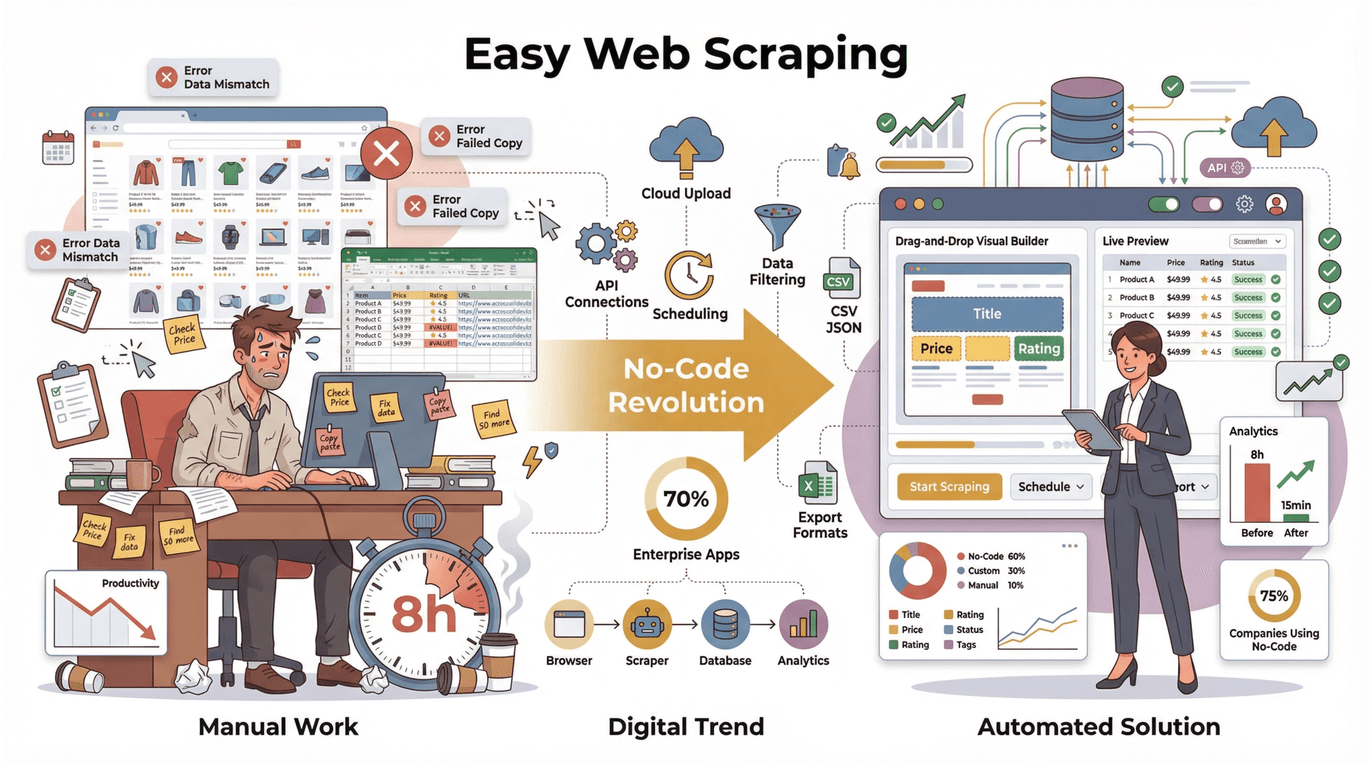

Se você já tentou copiar e colar centenas de listagens de produtos ou leads de vendas de um site para uma planilha, sabe bem a sensação: fica entre “estou economizando tempo” e “por que isso é tão sofrido?”. A verdade é que os dados da web são o novo petróleo para equipas de vendas, ecommerce e pesquisa — mas a maioria das pessoas não quer virar programador só para os obter. A boa notícia? A revolução no-code finalmente chegou ao web scraping. Na verdade, , e . Isso significa que os dias do “copiar e colar cansativo” estão contados.

Mas aqui está o ponto: com tantos raspadores web por aí, como escolher um que seja realmente fácil para iniciantes? Passei anos a criar e testar estas ferramentas (e sim, tenho um certo viés a favor do Thunderbit, porque ele é o meu bebé), mas também sou obcecado por tornar o web scraping tão simples como pedir comida numa app. Por isso, reuni este guia prático e direto ao ponto com os 10 raspadores web mais fáceis de usar em 2025 — com prós, contras e dicas honestas para cada ferramenta.

O que faz um raspador web ser o mais fácil de usar?

Vamos ser diretos: “fácil” significa coisas diferentes para pessoas diferentes. Para utilizadores de negócios, os raspadores web mais fáceis de usar têm algumas coisas em comum:

- Sem necessidade de código ou HTML: Não deveria ser preciso saber o que é um seletor, nem por que XPath parece um vilão de Star Wars.

- Interface visual e intuitiva: Arrastar e largar, clicar e apontar ou até prompts em linguagem natural — para poder simplesmente dizer o que quer.

- Configuração mínima e curva de aprendizagem baixa: Deve conseguir resultados em minutos, não em horas (ou dias).

- Automação e fiabilidade: A ferramenta deve lidar com tarefas difíceis como paginação, subpáginas e conteúdo dinâmico sem ter de se preocupar com os detalhes.

- Exportação com um clique: Os dados devem ficar prontos para Excel, Google Sheets, Airtable, Notion ou qualquer outra ferramenta que a equipa use.

- Suporte e documentação: Bons tutoriais, suporte rápido e uma comunidade prestável fazem uma enorme diferença.

- Preços flexíveis: Planos gratuitos ou testes para trabalhos menores, com upgrades pagos se precisar de mais.

Ao classificar estas ferramentas, foquei-me em quão depressa um utilizador sem perfil técnico conseguiria passar de “preciso destes dados” para “já estão na minha planilha” — sobretudo em cenários comuns de negócio, como extração de produtos, geração de leads e monitorização de preços.

Como avaliamos os raspadores web mais fáceis de usar

Não me limitei a ler páginas de marketing — analisei avaliações de utilizadores, fiz testes práticos e comparei os recursos de cada ferramenta. O que mais importou foi isto:

- Onboarding para iniciantes: Com que rapidez um novo utilizador consegue começar? Há modelos, assistentes ou ajuda por IA?

- Tarefas do mundo real: Consegue extrair uma lista de produtos, recolher emails de um diretório ou monitorizar preços — sem uma curva de aprendizagem íngreme?

- Automação: Lida com paginação, subpáginas e agendamento? Ou é preciso estar sempre a supervisionar?

- Exportação de dados: É fácil tirar os dados da ferramenta, limpá-los e deixá-los prontos para uso?

- Suporte e preço: Há plano grátis, suporte responsivo e caminhos claros de upgrade?

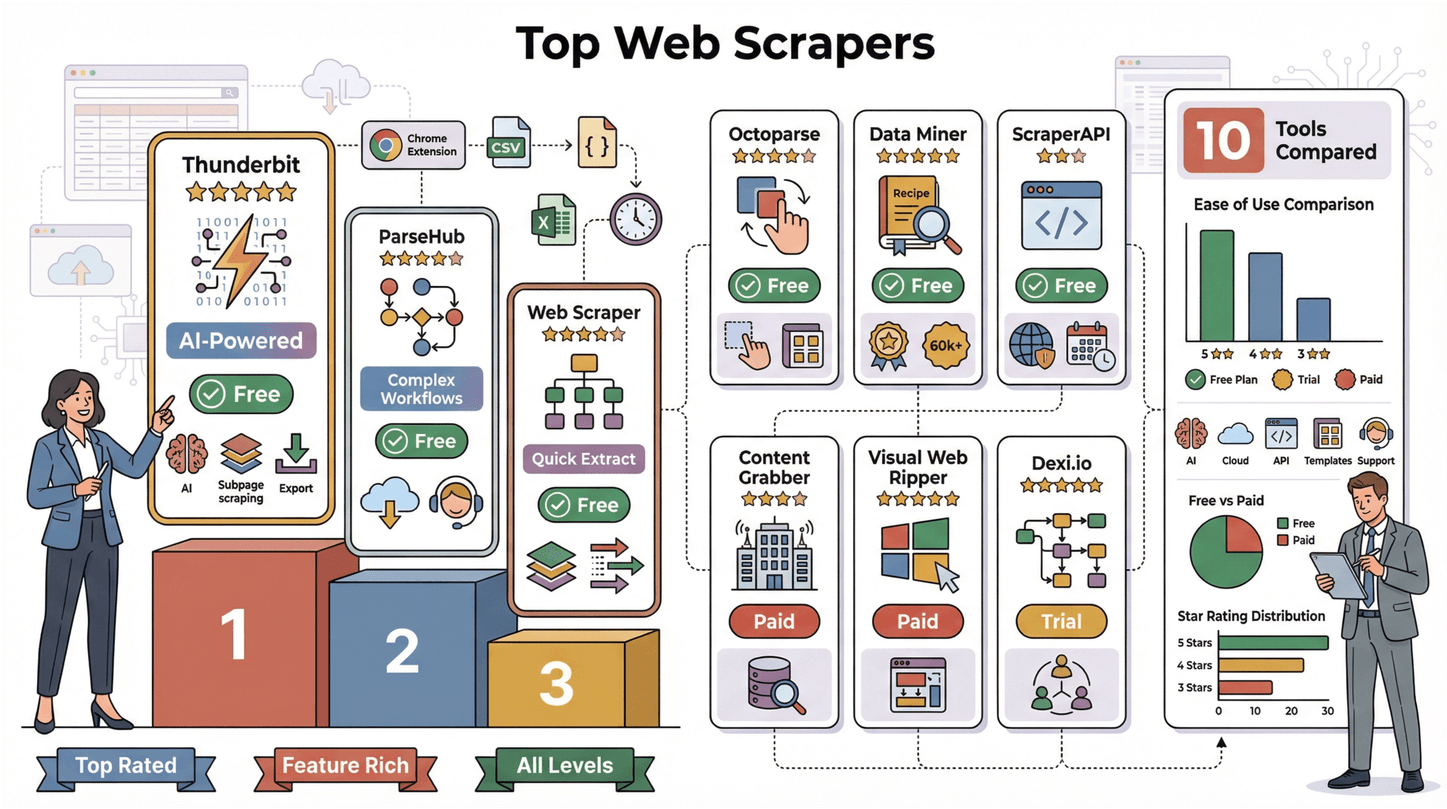

Agora, vamos mergulhar nos 10 raspadores web mais fáceis de usar — classificados e analisados para iniciantes a sério.

Os 10 raspadores web mais fáceis de usar

- para o web scraping com IA mais fácil, em 2 cliques

- para fluxos visuais de clicar e apontar

- para scraping gratuito e flexível baseado em sitemap

- para automação com arrastar e largar e baseada em modelos

- para scraping do dia a dia baseado em receitas

- para scraping via API plug-and-play (para equipas técnicas)

- para extração na nuvem e amigável para negócios

- para scraping em escala empresarial e altamente personalizável

- para utilizadores de Windows que querem scraping offline baseado em modelos

- para automação de fluxos de trabalho e colaboração em equipa via navegador

1. Thunderbit

é a minha principal escolha para o raspador web mais fácil de usar em 2025 — e não só porque ajudei a construí-lo. O Thunderbit existe para fazer o web scraping parecer um assistente com IA dentro do seu navegador. Veja por que ele se destaca:

- Fluxo de trabalho com IA em 2 cliques: Abra qualquer página, clique em “Sugerir Campos com IA” e a IA do Thunderbit lê a página, sugere quais dados extrair (como nomes de produtos, preços, emails) e monta a sua tabela. Clique em “Extrair” e pronto. Sem mexer em seletores, sem código, sem stress.

- Prompts em linguagem natural: Pode descrever o que quer em português simples. A IA do Thunderbit faz o resto — até em páginas complexas, confusas ou não estruturadas.

- Extração de subpáginas: Precisa de mais detalhes? O Thunderbit pode visitar automaticamente cada subpágina (como páginas de produto ou perfis do LinkedIn) e enriquecer a sua tabela sem configuração extra.

- Extraia qualquer coisa: Funciona em qualquer site, PDF ou imagem — mesmo que os dados estejam escondidos num documento ou fotografia.

- Exportação instantânea: Exporte os seus resultados para Excel, Google Sheets, Airtable ou Notion com um clique. Sem paywall para exportação — até no plano gratuito.

- Extensão gratuita para Chrome: Instale pela , e já pode começar.

- Extração gratuita de email, telefone e imagem: Extraia contactos e imagens de qualquer página, PDF ou ficheiro de imagem — sem configuração extra.

Casos de uso: Equipas de vendas usam o Thunderbit para extrair leads, equipas de ecommerce monitorizam preços da concorrência e profissionais do mercado imobiliário recolhem dados de imóveis. Já vi utilizadores passarem de “preciso de 200 listagens de produtos” para “aqui está a minha planilha” em 10 minutos.

Feedback dos utilizadores: O Thunderbit tem e mais de 100 mil utilizadores. As pessoas dizem que “parece ter um estagiário a fazer o copiar e colar por si”. Até tarefas complexas, como extrair várias páginas e sublinks, são resolvidas automaticamente.

Preço: O plano gratuito permite extrair 6 páginas (ou 10 com teste). Os planos pagos começam em US$ 15/mês para 500 linhas, e todos os recursos já estão incluídos até no plano básico.

Por que é o nº 1: O Thunderbit é a única ferramenta que combina sugestão real de campos por IA, prompts em linguagem natural e extração de subpáginas num fluxo de 2 cliques. É a coisa mais próxima de “diga apenas ao computador o que quer” — e funciona para qualquer pessoa, não só para técnicos.

2. ParseHub

é uma aplicação de desktop bastante conhecida (Windows, Mac, Linux) com um construtor visual de fluxos de trabalho. É popular entre iniciantes e equipas pequenas que querem extrair sites mais complexos sem programar.

- Visual de clicar e apontar: Crie projetos de scraping clicando nos elementos de uma página. O ParseHub tenta “adivinhar e selecionar automaticamente elementos de dados semelhantes”, tornando a configuração mais fácil.

- Lida com fluxos complexos: Suporta cliques em menus suspensos, botões de “Carregar mais” e extração de conteúdo atrás de login.

- Pré-visualização e exportação em tempo real: Veja os seus dados enquanto são extraídos e depois exporte para CSV, Excel ou JSON.

- Agendamento e execuções na nuvem: Os planos pagos permitem agendar extrações e executá-las na nuvem.

Experiência para iniciantes: Extrações básicas são fáceis, mas fluxos avançados (como dados aninhados ou lógica condicional) exigem uma pequena curva de aprendizagem. Os tutoriais e as sessões de formação ao vivo do ParseHub ajudam bastante.

Preço: O plano gratuito permite até 5 projetos (200 páginas por execução). Os planos pagos começam em US$ 99/mês para mais páginas e agendamento.

Melhor para: Iniciantes que querem extrair sites complexos e estão dispostos a investir um pouco de tempo para aprender a usar a ferramenta.

3. Web Scraper (webscraper.io)

é uma extensão gratuita do Chrome que usa uma abordagem visual baseada em “sitemap”. É flexível e poderosa, mas exige um pouco mais de configuração do que ferramentas baseadas em IA.

- Construtor visual de sitemap: Defina como navegar e o que extrair adicionando seletores e ações no Chrome DevTools.

- Lida com navegação em vários níveis: Extraia categorias, subcategorias e páginas de detalhes configurando relações entre pai e filho.

- Suporta conteúdo dinâmico: Pode rolar a página, clicar e esperar por elementos AJAX.

- Gratuito e de código aberto: 100% gratuito para scraping no navegador; serviço em nuvem opcional para agendamento e escala.

Experiência para iniciantes: Há uma curva de aprendizagem — especialmente para quem não é técnico. Configurar sitemaps pode parecer técnico, mas há muitos tutoriais e projetos de exemplo.

Preço: Gratuito para uso no navegador; os planos em nuvem começam em US$ 50/mês.

Melhor para: Iniciantes com perfil técnico ou analistas que querem uma ferramenta gratuita e flexível e estão dispostos a aprender a lógica de sitemap.

4. Octoparse

é um raspador web com arrastar e largar, com versões para desktop e nuvem. É conhecido pela interface amigável e pela automação poderosa.

- Designer com arrastar e largar: Clique nos elementos para extrair dados, monte fluxos visualmente e lide com paginação automaticamente.

- Modelos prontos: Modelos para Amazon, Twitter, Facebook e muito mais — basta inserir uma URL e começar.

- Automação em nuvem: Execute extrações na nuvem, agende tarefas e use rotação de IP para evitar bloqueios.

- Exportação para CSV, Excel, JSON ou API: Opções flexíveis de saída para utilizadores de negócios.

Experiência para iniciantes: Muito acessível para tarefas básicas — utilizadores relatam atingir “proficiência básica em 2–3 horas”. Recursos avançados (como login ou rolagem infinita) podem exigir mais aprendizagem.

Preço: O plano gratuito permite até 10 mil registos por exportação e 2 tarefas locais simultâneas. Os planos pagos começam em US$ 89/mês para páginas ilimitadas e execuções na nuvem.

Melhor para: Iniciantes e analistas que querem equilíbrio entre simplicidade e poder, especialmente para scraping recorrente ou agendado.

5. Data Miner

é uma extensão para Chrome/Edge que usa um sistema de “receitas” para scraping. É ótima para tarefas do dia a dia e tem uma enorme biblioteca de regras prontas de extração.

- Mais de 60 mil receitas prontas: Encontre uma receita para o seu site-alvo e execute com um clique.

- Criador de receitas com clicar e apontar: Crie as suas próprias regras de extração selecionando elementos visualmente.

- Lida com paginação e preenchimento de formulários: As receitas podem avançar por páginas ou preencher formulários de pesquisa.

- Exporta para CSV, Excel ou Google Sheets: Integração direta para pipelines de dados rápidos.

Experiência para iniciantes: Muito fácil se já existir uma receita para o seu site. Criar receitas personalizadas é amigável para iniciantes, embora a interface possa parecer um pouco carregada.

Preço: Gratuito para 500 páginas/mês. Os planos pagos começam em US$ 19/mês para mais páginas e recursos.

Melhor para: Profissionais de marketing, vendas e pesquisa que querem resultados rápidos — especialmente quando já existe uma receita pronta.

6. ScraperAPI

não é uma ferramenta de clicar e apontar, mas vale a pena mencioná-la para equipas com algum conhecimento técnico. É um serviço de API que cuida de todas as partes difíceis do scraping (proxies, CAPTCHAs, renderização de JavaScript).

- API plug-and-play: Basta chamar a API com a URL de destino, e o ScraperAPI devolve o HTML ou JSON.

- Rotação automática de proxy e resolução de CAPTCHA: Chega de bloqueios de IP ou dores de cabeça com anti-bot.

- Geo-targeting e endpoints de dados estruturados: Extraia dados de diferentes países ou obtenha dados estruturados de sites comuns.

Experiência para iniciantes: É mais fácil para desenvolvedores ou equipas com alguma habilidade em scripts. Pode ser usado com Google Sheets, Zapier ou plataformas low-code para quem não programa.

Preço: Plano gratuito com 5 mil chamadas de API/mês. Os planos pagos começam em US$ 49/mês para 100 mil requisições.

Melhor para: Equipas com conhecimentos leves de programação que querem um backend fiável e escalável para scraping.

7. Import.io

é uma plataforma baseada na nuvem com um extrator visual. Foi criada para utilizadores de negócios que querem transformar páginas da web em dados estruturados — sem instalar nada no desktop.

- Treinamento com clicar e apontar: Destaque pontos de dados numa página, e o Import.io generaliza o padrão por si.

- Agendamento na nuvem: Execute extratores em horários programados e crie APIs ou webhooks para entrega dos dados.

- Limpeza e transformação de dados: Ferramentas integradas para limpar e formatar os seus dados antes da exportação.

Experiência para iniciantes: Muito acessível para extrações básicas. A plataforma oferece teste gratuito, mas o uso contínuo é voltado para clientes enterprise.

Preço: Teste gratuito disponível; os planos pagos começam em cerca de US$ 299/mês (orçamentos personalizados para empresas).

Melhor para: Equipas de negócios que precisam de uma solução robusta e gerida para projetos recorrentes de dados da web.

8. Content Grabber

é uma ferramenta de desktop criada para automação de negócios e scraping em grande escala.

- Editor visual: Desenhe sequências de extração clicando pelos sites — sem necessidade de código na maioria das tarefas.

- Automação e agendamento: Execute vários agentes em paralelo, agende extrações e integre diretamente com bases de dados ou APIs.

- Recursos empresariais: Tratamento de erros, notificações e um console central de gestão.

Experiência para iniciantes: Curva de aprendizagem acentuada, a menos que tenha algum background técnico. É melhor para equipas de TI ou operações prontas para investir numa solução paga.

Preço: Sem versão gratuita; as licenças custam milhares de dólares.

Melhor para: Empresas e equipas de dados que precisam de scraping altamente personalizável e em grande escala.

9. Visual Web Ripper

é um clássico raspador desktop para Windows com interface de clicar e apontar.

- Designer de modelos e projetos: Crie raspadores selecionando dados visualmente — lida com listagens, páginas de detalhes e paginação.

- Agendamento e automação: Execute projetos em horários programados e exporte para CSV, XML, SQL e muito mais.

- Licença única: Pague uma vez e use para sempre.

Experiência para iniciantes: Relativamente fácil para projetos típicos, especialmente se já está habituado a software do Windows. A interface é um pouco antiga, mas lógica.

Preço: Sem plano gratuito; licença única em torno de US$ 349 por utilizador.

Melhor para: PMEs e utilizadores avançados no Windows que querem um raspador fiável e offline.

10. Dexi.io

(antigo CloudScrape) é uma plataforma baseada na nuvem com editor visual no navegador e automação de fluxos de trabalho.

- Designer de robôs com arrastar e largar: Crie bots de scraping no navegador com blocos e seleções de clicar e apontar.

- Automação de fluxos de trabalho: Encadeie robôs, agende execuções e integre com Slack, Sheets ou APIs.

- Colaboração em equipa: Gestão de utilizadores, controlo de versão e armazenamento em nuvem para resultados.

Experiência para iniciantes: Tarefas básicas são fáceis, mas fluxos avançados (loops, condicionais) exigem alguma aprendizagem. Há documentação e suporte disponíveis.

Preço: Teste gratuito; planos empresariais normalmente começam em algumas centenas de dólares por mês.

Melhor para: Equipas de operações e dados que precisam de scraping escalável, repetível e automatizado.

Raspadores web mais fáceis de usar: tabela comparativa rápida

| Nome da ferramenta | Avaliação de facilidade de uso | Caso de uso ideal | Disponibilidade de plano grátis | Recursos notáveis |

|---|---|---|---|---|

| Thunderbit | ⭐⭐⭐⭐⭐ | Web scraping não estruturado | Sim | Sugestão de campos por IA, extração de subpáginas, exportação instantânea, extensão gratuita do Chrome |

| ParseHub | ⭐⭐⭐⭐ | Fluxos de automação complexos | Sim | Fluxo visual, execuções na nuvem, suporte ao vivo |

| Web Scraper | ⭐⭐⭐⭐ | Extração rápida e flexível | Sim | Sitemap visual, scraping em vários níveis |

| Octoparse | ⭐⭐⭐⭐ | Scraping frequente e complexo | Sim | Arrastar e largar, modelos, agendamento na nuvem |

| Data Miner | ⭐⭐⭐⭐ | Tarefas do dia a dia, receitas | Sim | Mais de 60 mil receitas, scraping em lote, exportação para Sheets |

| ScraperAPI | ⭐⭐⭐ | Baseado em API, equipas técnicas | Sim | Rotação de proxy, bypass de CAPTCHA, saída em JSON |

| Import.io | ⭐⭐⭐⭐ | Nuvem, equipas de negócios | Teste gratuito | Treinamento visual, agendamento, limpeza de dados |

| Content Grabber | ⭐⭐⭐ | Enterprise, automação | Não | Script visual, integração direta com base de dados/API |

| Visual Web Ripper | ⭐⭐⭐⭐ | Windows, dados estruturados | Não | Modelos de clicar e apontar, licença única |

| Dexi.io | ⭐⭐⭐⭐ | Automação de fluxos, equipas | Teste gratuito | Arrastar e largar, agendamento na nuvem, integrações |

Como escolher o raspador web mais fácil para a sua necessidade

Aqui vai o meu guia rápido para escolher a ferramenta certa:

- Iniciante absoluto, quer resultados instantâneos? Comece com Thunderbit ou Data Miner (especialmente se já existir uma receita para o seu site).

- Precisa extrair sites complexos ou dinâmicos? Experimente Octoparse ou ParseHub — ambos lidam com fluxos avançados através de uma interface visual.

- Tem algum conforto com configuração técnica leve? O Web Scraper é gratuito e poderoso, mas espere uma curva de aprendizagem.

- Precisa automatizar trabalhos recorrentes ou trabalhar em equipa? Dexi.io, Import.io ou Content Grabber foram criados para automação de negócios.

- Tem um programador por perto? O ScraperAPI é um backend plug-and-play para fluxos personalizados.

Comece sempre com um plano gratuito ou teste. Tente extrair uma amostra dos dados que quer e veja qual ferramenta “encaixa” melhor para si. Às vezes, a melhor opção é aquela que parece mais natural para o seu fluxo de trabalho.

Conclusão: comece a extrair dados de forma mais inteligente, não mais difícil

O web scraping em 2025 não é só para programadores — é para qualquer pessoa que precise de dados da web com rapidez. As ferramentas desta lista mostram que é possível passar de “preciso destes dados” para “já estão na minha planilha” em minutos, não em meses. Seja você um representante de vendas, um gestor de ecommerce ou apenas alguém cansado de copiar e colar, existe um raspador web amigável para iniciantes à sua espera.

Se quiser ver como é um scraping moderno com IA, . E, se o Thunderbit não for a opção perfeita, teste algumas outras ferramentas desta lista — nunca houve momento melhor para automatizar o trabalho chato e concentrar-se no que realmente importa.

Boas extrações — e que os seus dados estejam sempre limpos, estruturados e prontos para agir. Para mais dicas e análises aprofundadas, confira o .

Perguntas frequentes

1. O que torna um raspador web “fácil de usar” para iniciantes?

Os raspadores web mais fáceis de usar não exigem programação, têm uma interface visual intuitiva, configuração mínima e lidam com automação (como paginação e subpáginas) por si. Devem permitir exportar os dados com um clique e oferecer bom suporte e documentação.

2. O Thunderbit é mesmo o raspador web mais fácil para utilizadores sem perfil técnico?

Sim — a sugestão de campos com IA e o fluxo de 2 cliques do Thunderbit tornam-no de uma forma única muito simples. Basta descrever o que quer, clicar em “Extrair” e receber dados estruturados — sem programação nem configuração manual.

3. Posso usar estes raspadores web gratuitamente?

A maioria das ferramentas desta lista oferece plano gratuito ou teste. Thunderbit, ParseHub, Web Scraper, Octoparse e Data Miner têm níveis gratuitos, embora talvez precise de fazer upgrade para tarefas maiores ou mais frequentes.

4. Qual raspador web é melhor para extração recorrente ou automatizada?

Para trabalhos recorrentes, procure ferramentas com agendamento e automação na nuvem — como Thunderbit (extração agendada), Octoparse, Dexi.io ou Import.io. Elas permitem executar extrações em horários programados e entregar os dados automaticamente.

5. Como sei qual raspador web é o certo para o meu negócio?

Combine o seu caso de uso (por exemplo, geração de leads, monitorização de preços) e o seu nível de conforto técnico com os recursos da ferramenta. Comece com um teste gratuito, faça um teste numa tarefa real e veja qual ferramenta parece mais natural. Se ficar bloqueado, procure ferramentas com forte suporte e bons tutoriais.

Pronto para começar? ou explore outras opções desta lista — e junte-se à revolução de dados no-code.

Saiba mais