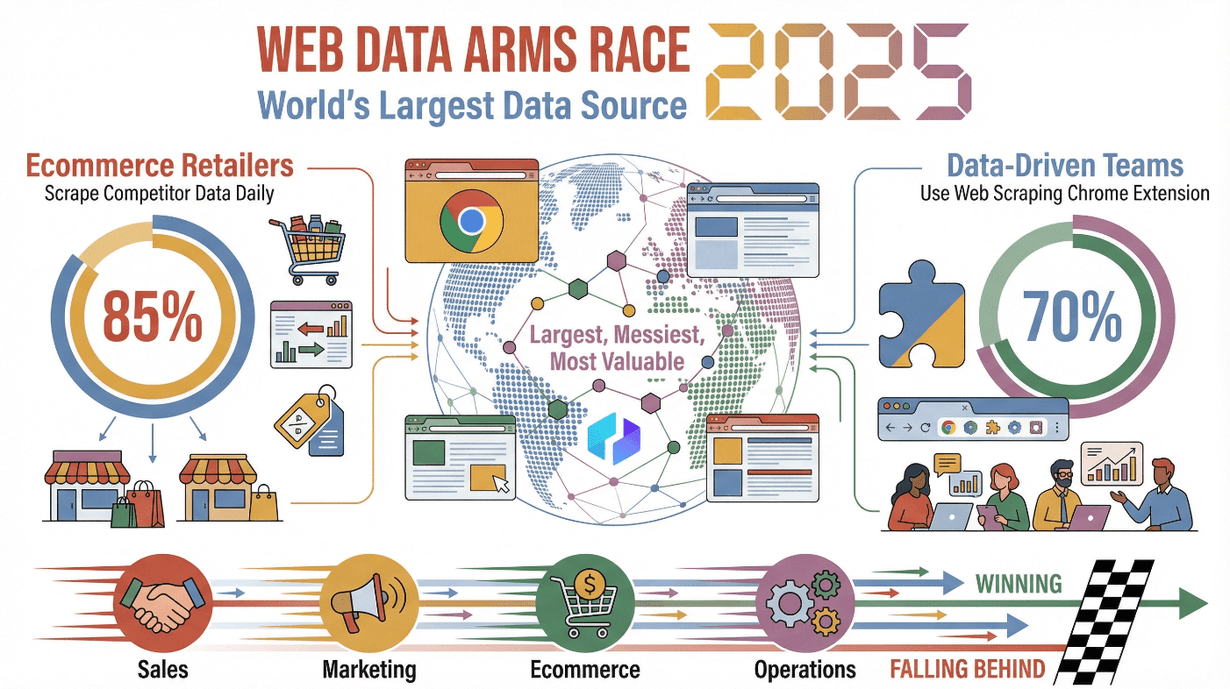

A internet já deixou de ser só aquele lugar de vídeos engraçados de gatos e memes para virar a maior, mais bagunçada e valiosa fonte de dados do planeta. Em 2025, as empresas estão numa verdadeira corrida por dados: , e mais de . Seja em vendas, marketing, ecommerce ou operações, ter acesso rápido aos dados certos, no formato ideal, pode ser o que separa quem lidera de quem fica para trás.

Só que tem um porém: os sites não facilitam a vida de quem quer extrair dados. Eles são desorganizados, mudam o tempo todo e são feitos para pessoas, não para planilhas. É aí que entram as ferramentas de web scraping, que transformam esse caos em tabelas organizadas e prontas para uso. Com anos de experiência em SaaS e automação, já vi de perto como escolher a ferramenta certa economiza horas, aumenta a precisão e ainda revela oportunidades que ninguém tinha visto.

Só que tem um porém: os sites não facilitam a vida de quem quer extrair dados. Eles são desorganizados, mudam o tempo todo e são feitos para pessoas, não para planilhas. É aí que entram as ferramentas de web scraping, que transformam esse caos em tabelas organizadas e prontas para uso. Com anos de experiência em SaaS e automação, já vi de perto como escolher a ferramenta certa economiza horas, aumenta a precisão e ainda revela oportunidades que ninguém tinha visto.

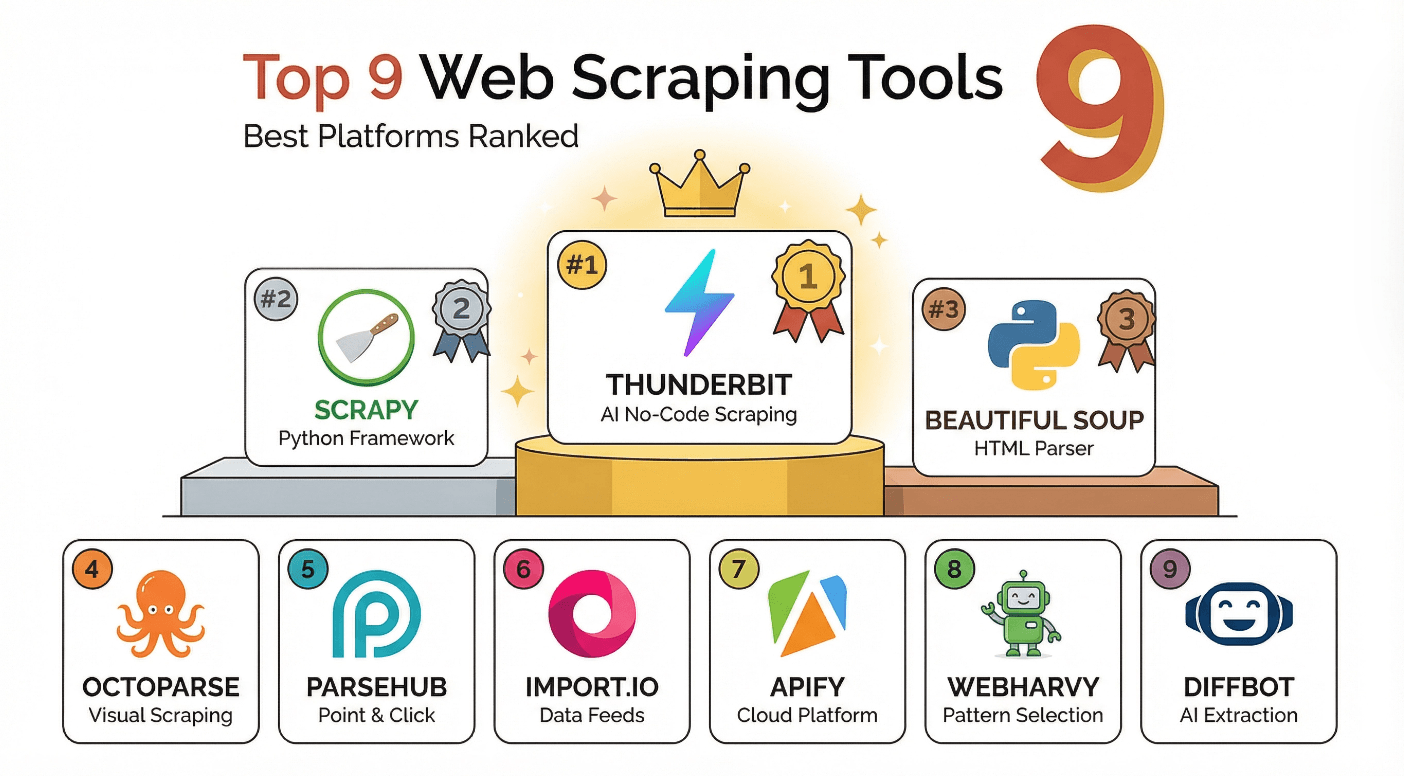

Mas afinal, quais ferramentas de web scraping realmente valem a pena em 2025? Separei as nove melhores opções—de extensões de Chrome com IA para negócios até frameworks open-source para quem é dev. Bora conferir.

Por Que Ferramentas de Web Scraping São Indispensáveis para Empresas Modernas

Ferramentas de web scraping são o segredo por trás de vendas mais inteligentes, marketing mais estratégico e operações ágeis. Olha só por que elas são essenciais:

- Geração de Leads: Times de vendas coletam dados de diretórios, LinkedIn e sites de avaliações para montar listas segmentadas.

- Análise de Concorrência: Equipes de marketing e ecommerce monitoram preços, lançamentos e anúncios dos concorrentes—muitas vezes em tempo real.

- Pesquisa de Mercado: Pesquisadores e analistas reúnem avaliações, notícias e opiniões para sacar tendências antes dos outros.

- Monitoramento de Preços: Lojas e marcas acompanham preços e estoques em centenas de sites para não ficarem para trás ().

- Agregação de Conteúdo: Equipes de operações extraem dados de sites de empregos, imóveis ou catálogos de fornecedores para agilizar processos.

Dá uma olhada nesse resumo de como as ferramentas de web scraping impulsionam resultados nos negócios:

| Caso de Uso | Dificuldade Manual | Solução com Web Scraping |

|---|---|---|

| Geração de Leads | Copiar e colar de vários sites | Extração automatizada, exportação em massa |

| Monitoramento de Preços | Checagens manuais diárias | Raspagem agendada, alertas instantâneos |

| Pesquisa de Mercado | Ler centenas de avaliações | Dados estruturados e agregados |

| Agregação de Conteúdo | Unir dados de múltiplos sites | Exportação unificada para Excel/Sheets |

| Análise de Concorrência | Dados lentos e incompletos | Insights abrangentes em tempo real |

O resultado é real: empresas que usam ferramentas modernas de scraping , e .

Como Escolhi as Melhores Ferramentas de Web Scraping

Nem toda ferramenta de web scraping é igual. Algumas são feitas para quem não programa e quer resultado rápido; outras são para devs que querem projetos sob medida e em grande escala. Veja os critérios que usei para montar essa lista:

- Facilidade de Uso: Dá para usar sem ser técnico? A interface é tranquila?

- Escalabilidade: Aguenta centenas ou milhões de páginas? Permite agendar e automatizar tarefas?

- Opções de Exportação: Dá para exportar para Excel, Google Sheets, Airtable, Notion ou via API?

- Suporte & Comunidade: Tem documentação boa, tutoriais e suporte que resolve?

- Preço & Custo-Benefício: Tem plano grátis? Os valores são justos e transparentes?

- Diferenciais: Extração com IA, raspagem de subpáginas, integração com API ou fluxos visuais.

Também relacionei cada ferramenta ao cenário de negócio ideal—assim você acha a opção certa para sua necessidade e nível técnico.

1. Thunderbit

é minha principal dica para quem quer web scraping com IA sem dor de cabeça. Como extensão do Chrome, o Thunderbit foi feito para equipes de vendas, marketing, ecommerce e operações que precisam de dados organizados e certeiros—e rápido.

O que faz o Thunderbit ser diferente? Simplicidade e potência:

- Sugestão de Campos com IA: Clicou em “Sugerir Campos com IA”, o Thunderbit lê a página, sugere colunas (Nome, Preço, Email) e até cria prompts de extração para cada campo.

- Raspagem de Subpáginas: Quer mais detalhes? A IA do Thunderbit visita subpáginas (tipo páginas de produtos ou perfis) e completa sua tabela—sem configuração.

- Exportação Instantânea: Jogue seus dados direto para Excel, Google Sheets, Airtable ou Notion. Exportação sempre gratuita.

- Raspagem Agendada: Automatize tarefas recorrentes (como checagem diária de preços) com agendamento em linguagem natural.

- Extratores Gratuitos de Email, Telefone e Imagens: Pegue contatos ou imagens de qualquer site com um clique.

- AI Autofill: Deixe a IA preencher formulários online para você—perfeito para fluxos de trabalho e tarefas repetitivas.

O Thunderbit já é usado por mais de , e o permite raspar até 6 páginas (ou 10 com bônus de teste). Os planos pagos começam em só US$ 15/mês para 500 créditos—ótimo para equipes de qualquer tamanho.

Quer ver o Thunderbit funcionando? Dá uma olhada no ou no para tutoriais e dicas.

2. Scrapy

é o framework open-source queridinho dos devs que querem controle total nos projetos de web scraping. Feito em Python, o Scrapy permite criar spiders personalizadas para coletar, extrair e processar dados em grande escala.

Por que os devs curtem o Scrapy?

- Framework Robusto: Suporta raspagem complexa, pipelines customizados e integração com APIs.

- Escalável: Perfeito para projetos grandes, várias requisições ao mesmo tempo e raspagem de muitas páginas simultaneamente ().

- Extensível: Dá para adicionar middlewares para proxies, user agents ou renderização de JavaScript (com Splash).

- Comunidade Ativa: Muitos tutoriais, plugins e suporte para casos avançados.

O Scrapy é ideal para equipes que manjam de Python e precisam raspar em larga escala, integrar com pipelines de dados ou criar fluxos robustos e repetíveis. É gratuito e open-source—mas exige configuração e manutenção.

3. Beautiful Soup

é uma biblioteca Python super querida por quem está começando, pela facilidade e eficiência para analisar HTML e XML. Se você precisa extrair dados rapidinho de páginas estáticas, o Beautiful Soup é uma ótima pedida.

Por que usar o Beautiful Soup?

- Fácil para Iniciantes: Aprendizado simples, com muitos tutoriais ().

- Análise Flexível: Lida bem com HTML bagunçado ou com erros.

- Ótimo para Projetos Pequenos: Perfeito para scripts pontuais, extração rápida ou aprendizado de web scraping.

Limitações? O Beautiful Soup não foi feito para grandes volumes ou sites dinâmicos, e não processa JavaScript. Para isso, combine com requests ou Selenium—ou evolua para o Scrapy.

4. Octoparse

é uma ferramenta de web scraping sem código, pensada para todo mundo—de quem toca o negócio sozinho até grandes equipes. A interface de apontar e clicar facilita a extração até de sites dinâmicos e complexos.

Por que o Octoparse faz sucesso:

- Sem Programação: Construtor visual de fluxos, seletores drag-and-drop e templates prontos.

- Modos Local e Nuvem: Execute raspagens no seu PC ou na nuvem para tarefas maiores e mais rápidas.

- Lida com Paginação e Conteúdo Dinâmico: Raspe páginas “Carregar mais”, rolagem infinita e sites AJAX.

- Opções de Exportação: Baixe como CSV, Excel, JSON, HTML ou exporte para bancos de dados ().

O plano gratuito do Octoparse cobre tarefas pequenas, enquanto os pagos começam em torno de US$ 75/mês para uso pesado. É queridinho para pesquisa de mercado, análise de concorrência e para quem quer resultado sem programar.

5. ParseHub

é uma ferramenta visual de scraping que manda bem em sites dinâmicos e cheios de JavaScript. O construtor de fluxos permite clicar, repetir ações e extrair dados até de páginas mais complicadas.

Destaques do ParseHub:

- Seleção Visual de Dados: Clique para selecionar elementos, percorra listas e acesse subpáginas.

- Suporte a Conteúdo Dinâmico: Raspe dados carregados por JavaScript, menus suspensos e automatize cliques.

- Exportação Flexível: Baixe como CSV, Excel, JSON ou integre com Dropbox/Amazon S3 ().

- Plano Gratuito: Até 5 projetos e 200 páginas por execução; planos pagos liberam mais recursos.

O ParseHub é ideal para quem já tem alguma experiência e quer flexibilidade sem precisar programar. Muito usado para ecommerce, vagas de emprego e imóveis.

6. Import.io

foi criado para extração e visualização de dados em nível corporativo. Focado em grandes projetos, oferece interface intuitiva, suporte robusto e análises avançadas.

Por que o Import.io se destaca?

- Extração por Clique: Sem código—só selecionar os dados que você quer.

- Visualização de Dados: Ferramentas integradas para analisar, criar gráficos e compartilhar resultados.

- Recursos Corporativos: Compliance, serviços gerenciados e suporte a grandes volumes.

- Exportação & Integração: Baixe como CSV, Excel ou integre com Google Sheets e ferramentas de BI ().

Os preços são personalizados para empresas, sendo ideal para organizações com grandes demandas de dados e orçamento compatível.

7. Apify

é uma plataforma para automação web escalável e extração de dados personalizada. É a favorita dos devs para criar, rodar e compartilhar “atores” de scraping (scripts prontos ou personalizados).

Por que o Apify é uma ótima escolha:

- Marketplace de Atores: Acesse mais de 200 scrapers prontos para sites populares ou crie o seu em JavaScript/Python.

- API-First: Integre os dados extraídos direto nos seus fluxos ou aplicativos.

- Execução em Nuvem: Rode tarefas em escala, agende execuções recorrentes e gerencie tudo em um painel ().

- Preços Flexíveis: Plano gratuito para tarefas pequenas; pague conforme o uso para projetos maiores.

O Apify é perfeito para equipes técnicas que querem automatizar, escalar e integrar dados web aos processos do negócio.

8. WebHarvy

é uma ferramenta de web scraping visual que detecta automaticamente padrões de dados nas páginas. Feita para quem não programa e quer resultado sem aprender XPath ou seletores CSS.

Principais recursos do WebHarvy:

- Detecção Automática de Padrões: Clique em um campo e o WebHarvy encontra elementos parecidos ().

- Suporte a AJAX/JavaScript: Lida com conteúdo dinâmico, extração de imagens e busca por palavras-chave.

- Opções de Exportação: Baixe como Excel, CSV, XML, JSON ou SQL.

- Licença Vitalícia: Pague uma vez e use para sempre (com um ano de atualizações/suporte).

O WebHarvy é muito usado por pequenas empresas, pesquisadores e empreendedores que preferem uma abordagem visual e não precisam de automação avançada.

9. Diffbot

é referência em extração de dados web com IA. Usando machine learning e visão computacional, transforma qualquer página pública em dados estruturados—sem configuração manual.

O que faz o Diffbot ser único?

- Extração com IA: Identifica e extrai automaticamente entidades, relações e fatos das páginas ().

- Knowledge Graph: Acesse um banco de dados gigante e atualizado de pessoas, empresas, produtos e mais.

- Acesso via API: Integre dados estruturados nos seus apps, pesquisas ou análises ().

- Pronto para Empresas: Usado por Microsoft, Adobe, Hubspot e outros gigantes.

Os preços começam em US$ 299/mês para startups, com opções de pagamento por chamada de API (). É ideal para pesquisa, ciência de dados corporativa e quem precisa de precisão com IA em grande escala.

Tabela Comparativa das Ferramentas de Web Scraping

Veja um comparativo lado a lado das nove ferramentas:

| Ferramenta | Melhor Para | Sem Código | Com IA | Para Devs/API | Raspagem de Subpáginas | Opções de Exportação | Preço Inicial |

|---|---|---|---|---|---|---|---|

| Thunderbit | Usuários de negócios | Sim | Sim | Não | Sim | Excel, CSV, Sheets, Notion, Airtable | Grátis (6 páginas), $15/mês |

| Scrapy | Desenvolvedores | Não | Não | Sim | Sim (custom) | CSV, JSON, XML, BD | Grátis, open-source |

| Beautiful Soup | Iniciantes, devs | Não | Não | Sim | Não | Customizado (via Python) | Grátis, open-source |

| Octoparse | Não programadores, equipes | Sim | Não | Parcialmente | Sim | CSV, Excel, JSON, BD | Grátis, $75/mês |

| ParseHub | Visual, sites dinâmicos | Sim | Não | Parcialmente | Sim | CSV, Excel, JSON, S3, Dropbox | Grátis, $189/ano |

| Import.io | Empresas, analytics | Sim | Não | Sim | Sim | CSV, Excel, Sheets, BI tools | Personalizado, enterprise |

| Apify | Devs, automação | Não | Não | Sim | Sim | CSV, JSON, Sheets, API | Grátis, pay-as-you-go |

| WebHarvy | Não programadores, PMEs | Sim | Não | Não | Sim | Excel, CSV, XML, JSON, SQL | $139/ano (licença única) |

| Diffbot | IA, pesquisa, empresas | Não | Sim | Sim | Sim (IA) | JSON, Knowledge Graph API | $299/mês |

Como Escolher a Ferramenta de Web Scraping Ideal para Você

Qual ferramenta escolher? Olha esse guia rápido:

- Para quem não programa/usuários de negócios: Thunderbit, Octoparse, ParseHub, WebHarvy

- Para desenvolvedores/automação: Scrapy, Beautiful Soup, Apify

- Para empresas/IA: Import.io, Diffbot

- Para sites dinâmicos ou cheios de JavaScript: ParseHub, Octoparse, Apify

- Para exportação instantânea e organizada: Thunderbit, Import.io

Minha dica: comece pelo seu objetivo de negócio e nível técnico. Se quer scraping com IA, sem complicação e exportação instantânea, é imbatível. Se busca controle total ou criar spiders personalizadas, Scrapy ou Apify são ótimos. Para grandes volumes ou extração com IA, Import.io e Diffbot são os mais robustos.

A maioria das ferramentas tem teste ou plano grátis—então testa e vê qual encaixa melhor no seu dia a dia.

Perguntas Frequentes

1. O que é uma ferramenta de web scraping e por que eu preciso de uma?

Uma ferramenta de web scraping é um software que extrai dados de sites e transforma em formatos organizados, como planilhas ou bancos de dados. Empresas usam para geração de leads, monitoramento de preços, pesquisa de mercado e muito mais—economizando tempo e aumentando a precisão em relação ao trabalho manual.

2. Web scraping é permitido?

Web scraping é permitido quando você coleta dados públicos e respeita os termos de uso dos sites. Evite sempre raspar informações pessoais ou sensíveis sem consentimento e fique de olho nas leis locais.

3. Qual a melhor ferramenta de web scraping para quem não programa?

Thunderbit, Octoparse, ParseHub e WebHarvy são ótimas para quem não tem conhecimento técnico. O Thunderbit se destaca pela sugestão de campos com IA e exportação instantânea para Excel, Google Sheets, Notion ou Airtable.

4. Dá para raspar sites dinâmicos ou cheios de JavaScript?

Sim! Ferramentas como ParseHub, Octoparse e Apify foram feitas para lidar com conteúdo dinâmico, AJAX e páginas “Carregar mais”. A IA do Thunderbit também se adapta a muitos layouts modernos.

5. Como escolher a ferramenta de web scraping certa para meu negócio?

Considere seu nível técnico, volume de dados, necessidades de exportação e orçamento. Quem não programa pode começar com Thunderbit ou Octoparse; devs podem preferir Scrapy ou Apify; empresas com grandes demandas podem optar por Import.io ou Diffbot. A maioria oferece testes gratuitos—experimente e veja o que funciona melhor.

Pronto para transformar a web em vantagem competitiva? ou confira o para mais dicas e guias. Boas raspagens!

Saiba Mais