Seu CRM só vale o que vale a qualidade dos dados que entra nele. E, convenhamos, os melhores dados estão em sites públicos — não em bases de terceiros caras e, muitas vezes, meio “meh”.

Um extrator web pega aquele caos de informação online e transforma tudo em planilhas organizadinhas. Os melhores fazem isso em minutos, sem código e sem dor de cabeça.

Eu já usei essas ferramentas em projetos reais — montando listas de leads, acompanhando preços de concorrentes, extraindo catálogos de produtos. A seguir, estão 12 que realmente aguentaram o tranco, ranqueadas pelo desempenho em tarefas de negócios do mundo real.

Por que Extratores Web são uma Necessidade para Empresas

Vamos falar a real: a web é o maior (e mais bagunçado) banco de dados do planeta. E, em 2026, quem consegue transformar essa bagunça em insight é quem sai na frente. Segundo , organizações orientadas por dados são 5% mais produtivas e 6% mais lucrativas do que seus pares. Isso não é “detalhezinho” — é vantagem competitiva na veia.

Ferramentas de extração na web (também chamadas de extrator de página web ou soluções de extração de página web) são o “pulo do gato” aqui. Elas deixam times de vendas rasparem diretórios públicos, redes sociais e sites de empresas para criar listas de prospecção segmentadas — sem precisar comprar listas desatualizadas ou depender do estagiário sobreviver ao copia-e-cola infinito (). Já marketing e e-commerce usam extrator web para acompanhar preços da concorrência, monitorar estoque e comparar produtos em tempo real — a John Lewis, por exemplo, atribui ao web scraping um aumento de 4% nas vendas só por precificação mais inteligente ().

Mas não é só sobre números. Extratores web economizam um tempo absurdo (um usuário relatou ter poupado “centenas de horas” ao automatizar a coleta de dados) e reduzem erro humano (). Times de operações hoje configuram raspadores para coletar dados continuamente — algo que levaria semanas para estagiários — liberando horas antes queimadas em tarefas repetitivas de copiar e colar (). E com extratores guiados por IA, até quem não é técnico consegue transformar sites em dados estruturados para análise ().

Resumindo: se você não usa um extrator web em 2026, provavelmente está deixando insights (e dinheiro) na mesa.

Como Escolhemos os 12 Melhores Extratores Web

Com tanta ferramenta de extração na web por aí, como escolher a certa? Eu avaliei dezenas de opções, mas só 12 entraram nesta lista. Estes foram os critérios principais:

- Facilidade de uso: alguém sem perfil técnico consegue começar rápido, sem escrever código? Priorizei ferramentas no-code ou low-code com interface intuitiva ().

- Recursos de IA: ferramentas de nova geração que usam IA para simplificar a extração — como detectar campos automaticamente, lidar com navegação do site ou permitir que você descreva o que precisa em linguagem natural ().

- Automação e agendamento: os melhores extratores web rodam no piloto automático. Escolhi ferramentas que permitem agendar extrações recorrentes ou monitorar sites ().

- Exportação e integrações: dá para exportar facilmente para Excel, Google Sheets, Airtable ou Notion? Pontos extras para integrações com fluxos de trabalho ().

- Escalabilidade e confiabilidade: seja para raspar uma página ou milhares, essas ferramentas dão conta. Também considerei avaliações de usuários sobre estabilidade.

- Casos de uso voltados a negócios: dei preferência a ferramentas populares entre vendas, marketing, e-commerce e operações — não apenas para desenvolvedores.

Algumas opções aqui são novidades com IA; outras são “das antigas” e bem consolidadas. Todas foram feitas para ajudar você a transformar a web no seu próprio banco de dados de negócios — sem estresse.

Comparativo Rápido: Ferramentas de Extração Web em um Relance

Aqui vai um panorama das 12 ferramentas que vou abordar, para você bater o olho e entender como elas se comparam:

| Ferramenta | Automação com IA | Facilidade de uso | Melhor caso de uso |

|---|---|---|---|

| Thunderbit | Sim – a IA sugere campos e navega pelas páginas automaticamente | Muito fácil (extensão do Chrome, sem código) | Extração rápida de leads, preços etc. por usuários não técnicos que querem resultado em minutos. |

| Octoparse | Limitada (baseada em templates, sem IA) | Fácil para a maioria (interface visual de arrastar e soltar) | Fluxos de extração personalizados (com login, paginação) para analistas que querem controle sem programar. |

| Browse AI | Parcial – “robôs” de apontar e clicar | Fácil (no-code, na nuvem) | Monitoramento automatizado de dados (preços, anúncios etc.) com agendamento, alertas e integrações. |

| WebScraper.io | Não (configuração manual) | Moderada (extensão com configuração de sitemap) | Extração visual em sites com múltiplos níveis para quem aceita configurar etapas. |

| ScraperAPI | N/A (serviço via API, gerencia proxies pela API) | Exige código (integração via API) | Extração em alto volume para times técnicos — proxies e CAPTCHAs resolvidos para raspagens em escala. |

| Data Miner | Não | Muito fácil (extensão com templates de um clique) | Extrações pontuais e rápidas (especialmente tabelas/listas) direto para CSV/Excel. |

| Simplescraper | Não (alguns recursos com apoio de IA) | Fácil (criador de “receitas” por apontar e clicar) | Raspagem no-code com integrações — ótimo para enviar dados ao Google Sheets, Airtable ou API. |

| Instant Data Scraper | Sim – detecta tabelas automaticamente | Muito fácil (clicou, foi; sem configuração) | Extração instantânea e gratuita de tabelas e listas HTML para qualquer pessoa (ideal para capturas rápidas). |

| ScrapeStorm | Sim – a IA identifica elementos da página | Fácil (interface visual; app multiplataforma) | Projetos grandes ou complexos sem código, incluindo rastreamentos agendados. |

| Apify | Alguns – “actors” prontos disponíveis | Moderada (interface web; código opcional) | Raspagem e automação escaláveis na nuvem com scripts prontos ou personalizados. |

| ParseHub | Não (sem scripts, mas com configuração manual) | Fácil no básico (editor visual; app desktop) | Extração de sites dinâmicos/complexos (conteúdo AJAX) via interface no-code. |

| OutWit Hub | Não | Fácil (aplicativo desktop com GUI) | Extração simples offline e arquivamento de conteúdo para projetos menores. |

A maioria oferece plano gratuito ou teste e assinaturas em camadas. O foco aqui é capacidade e caso de uso, não preço.

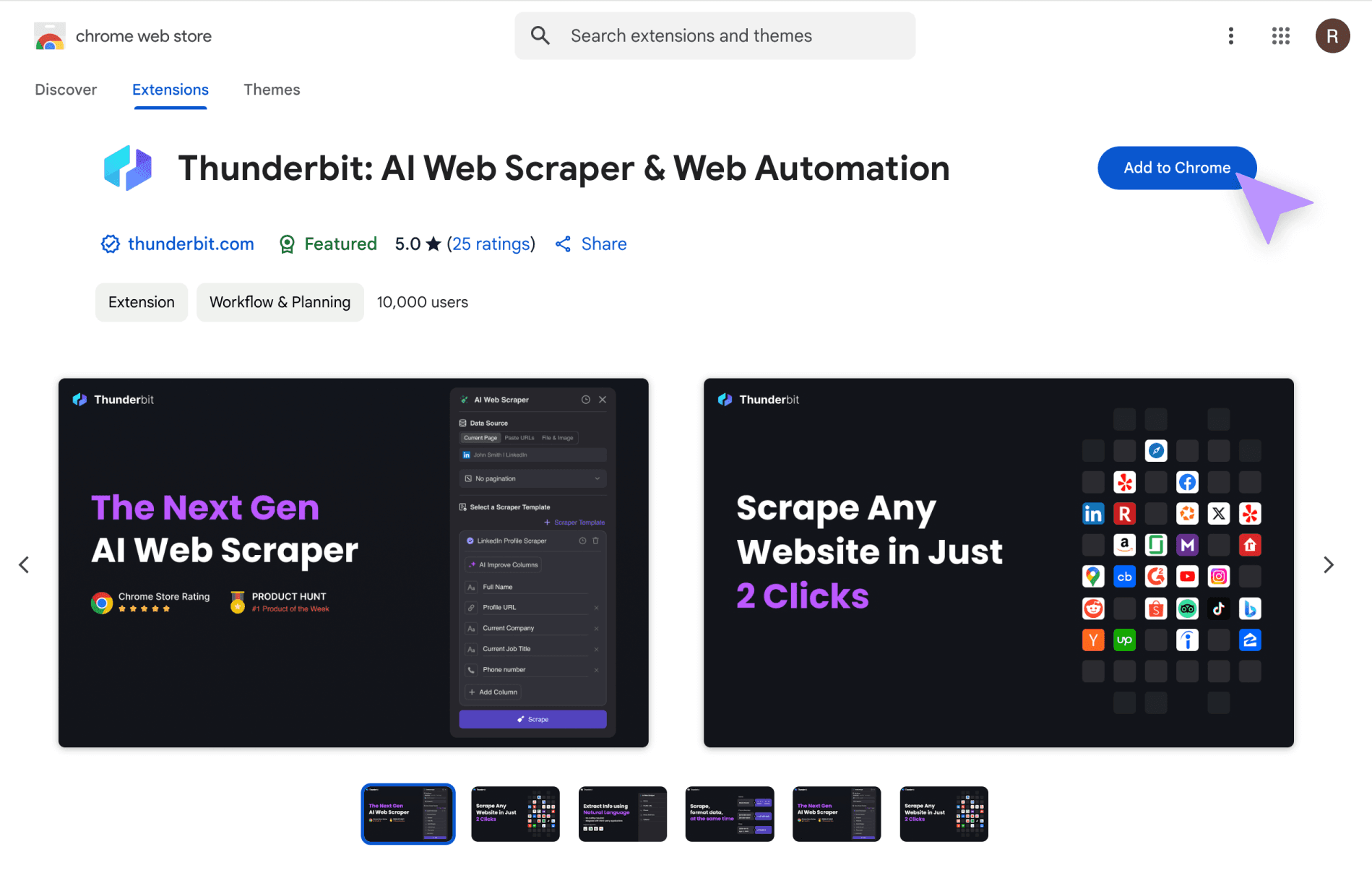

Thunderbit: o Extrator Web com IA para Todo Mundo

Vamos começar pelo Thunderbit — sim, é “meu bebê”, mas segura aí e me ouve. O mercado de extração na web está virando de “configure seu próprio scraper” para “fala pra IA o que você quer”. O Thunderbit é a primeira ferramenta que eu vi (e ajudei a construir) que realmente parece um assistente de dados com IA, e não só mais um “crawler” qualquer.

Com o , você não precisa se meter com XPath, seletores CSS ou expressões regulares. É só descrever o que você quer em linguagem natural — tipo “pegue o título, autor e data desta página” — e a IA faz o resto (). Você clica em “AI Suggest Fields” e o Thunderbit lê a página, recomenda colunas e ainda lida com subpáginas e paginação automaticamente ().

E não é só “capturar dados”. O Thunderbit consegue limpar, transformar, categorizar e até traduzir campos enquanto extrai. Precisa padronizar telefones, resumir descrições ou traduzir nomes de produtos? Você coloca uma instrução rápida e a IA resolve. No fim, dá para exportar direto para Excel, Google Sheets, Airtable ou Notion ().

O que realmente separa o Thunderbit do resto é zero configuração e uma curva de aprendizado praticamente inexistente. É uma extensão do Chrome, então você começa em segundos. Sem plugins, sem ajustes chatos, sem “tecniquês”. Por isso virou queridinho de times de vendas, marketing e operações que precisam de resultado — pra ontem (). O plano gratuito deixa você testar o fluxo completo, e os planos pagos são acessíveis (para a maioria dos times, “menos que o café do mês”).

Se você quer sentir na prática como é a extração de página web com IA, e teste. Seus dias de copiar e colar podem estar com os dias contados.

Octoparse: Extrator Web Visual para Fluxos Personalizados

O Octoparse é figurinha carimbada no mundo da raspagem visual. É um app desktop com interface de apontar e clicar — você interage com a página, seleciona os dados e o Octoparse monta o fluxo por trás (). Dá para lidar com login, configurar paginação e até automatizar envio de formulários, tudo sem escrever uma linha de código.

Um ponto forte é a biblioteca com mais de 500 templates prontos para sites populares (Amazon, Twitter, LinkedIn etc.), então muitas vezes é só carregar um modelo e sair extraindo (). Para sites mais chatinhos, você pode ir para o modo manual e configurar cada etapa visualmente. O Octoparse suporta conteúdo que aparece depois de cliques ou rolagem, e pode usar proxies e resolver CAPTCHAs em tarefas mais pesadas. Também existe opção em nuvem para agendar e rodar extrações em escala.

O “porém”? Tem uma curva de aprendizado, principalmente nos cenários avançados. Ainda assim, para não programadores e analistas que querem um fluxo de extração sob medida sem código, o Octoparse é uma escolha bem sólida ().

Browse AI: Extração Web Automatizada com Robôs Prontos

O Browse AI vai por um caminho bem prático: você “treina um robô” apontando e clicando nos dados que quer, e ele aprende a extrair em páginas parecidas (). É tudo no-code e na nuvem, então você não precisa se preocupar com scripts ou servidores.

O que faz o Browse AI se destacar é automação e monitoramento. Você agenda os robôs para rodarem regularmente e recebe alertas quando algo muda (por exemplo, quando um concorrente baixa o preço ou aparece uma vaga nova). Eles também têm uma biblioteca de robôs prontos para tarefas comuns — muitas vezes você começa com algo pronto e só dá aquela ajustada fina ().

O Browse AI integra com milhares de apps via Zapier e Make e exporta direto para Google Sheets ou via API/webhooks (). É uma ótima opção para monitoramento contínuo e coleta recorrente, especialmente se você quer alertas e integrações sem esforço.

WebScraper.io: Extrator de Páginas Web no Navegador

O WebScraper.io (muitas vezes chamado só de “Web Scraper”) é uma extensão de navegador que permite criar “sitemaps” — planos visuais de como navegar no site e quais elementos extrair (). Você define seletores para os dados e os links a seguir (como “clicar em próxima página” ou “visitar cada produto para detalhes”).

Tem uma curva de aprendizado, mas continua sendo sem código — você seleciona elementos e define ações de extração. O Web Scraper suporta navegação em múltiplos níveis, paginação e até rolagem infinita (desde que você configure as etapas manualmente). Como roda no navegador, dá para raspar sites com login fazendo login você mesmo.

O WebScraper.io é ideal para “analistas de dados cidadãos” que sacam a estrutura das páginas e querem uma ferramenta gratuita e flexível. É um “tratorzinho” confiável se você topar montar seus próprios sitemaps.

ScraperAPI: Extrator Web via API para Desenvolvedores e Times

Nem todo time quer interface de apontar e clicar — às vezes você precisa de uma solução de backend para mandar dados direto para apps ou bancos. O ScraperAPI é um extrator web focado em API: você passa uma URL e ele devolve o HTML bruto ou dados extraídos, cuidando do que dá trabalho — proxies, rotação geográfica de IP, navegadores headless e CAPTCHAs ().

O ScraperAPI mantém um pool com mais de 40 milhões de proxies em mais de 50 países e processa 36 bilhões de requisições por mês (). É ideal para raspagem automatizada em grande escala, quando confiabilidade e anti-bloqueio são essenciais. Você vai precisar programar para usar, mas para pipelines de dados ou integração no produto, é uma escolha de primeira.

Data Miner: Extensão do Chrome para Extração Rápida de Páginas

O Data Miner é uma extensão do Chrome feita para usuários de negócios e pesquisadores que precisam capturar dados rapidinho. Ele oferece uma experiência de raspagem por apontar e clicar e uma biblioteca de “receitas” prontas para padrões comuns como tabelas, listas ou sites específicos ().

É só instalar, abrir a página alvo e clicar no ícone do Data Miner. Você escolhe uma receita ou cria a sua selecionando elementos na página. É ótimo para tarefas pontuais ou necessidades rápidas — tipo um vendedor puxando leads de um diretório online ou um gestor de e-commerce copiando preços da concorrência.

O Data Miner é simples, fica dentro do navegador e funciona muito bem para raspagem interativa sob demanda.

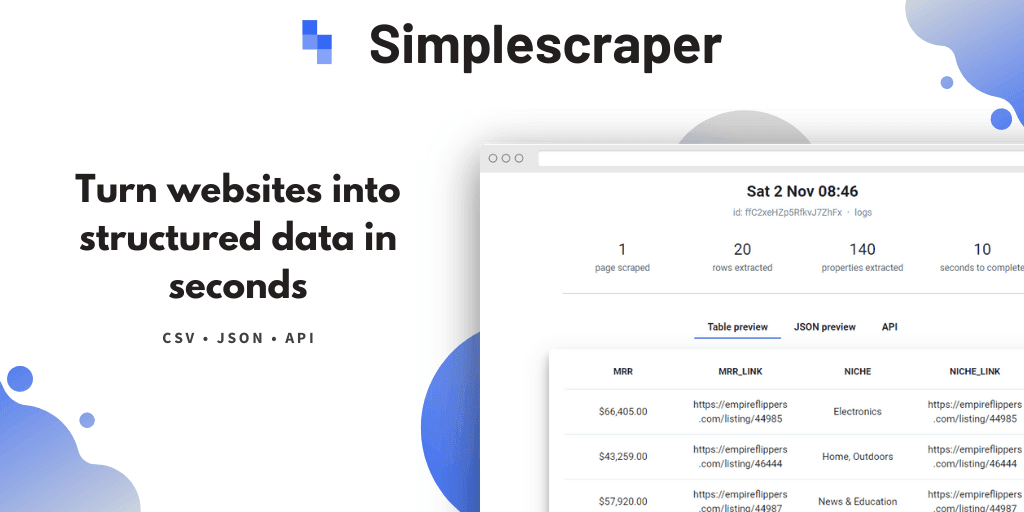

Simplescraper: Extrator Web No-Code para Resultados Imediatos

O Simplescraper faz jus ao nome. É uma extensão no-code do Chrome (e também app web) que permite selecionar dados visualmente e criar uma “receita” de extração (). Você pode seguir links para raspar subpáginas, lidar com paginação e até transformar a extração em um endpoint de API com um clique.

Onde ele brilha mesmo é nas integrações — dá para mandar dados direto para Google Sheets, Airtable ou ferramentas como Zapier (). Também tem raspagem em nuvem e agendamento para tarefas recorrentes, além do recurso “AI Enhance” para limpar ou analisar dados com GPT.

Se você quer resultado rápido e integrações fáceis, o Simplescraper é um canivete suíço para raspagem leve.

Instant Data Scraper: Extração Rápida para Tabelas e Listas

Às vezes você só quer os dados agora, sem configurar nada. Aí entra o Instant Data Scraper (IDS). É uma extensão gratuita do Chrome famosa por raspar dados tabulares com um clique (). Você ativa a extensão e o IDS detecta automaticamente tabelas ou listas na página. Ele também lida com paginação e rolagem infinita, avançando pelas páginas automaticamente.

O IDS é 100% gratuito, sem cadastro, sem código, sem enrolação. Perfeito para necessidades casuais ou urgentes — como um vendedor pegando uma lista rápida de leads ou um estudante extraindo tabelas da Wikipedia. Se ele achar seus dados, você resolve em segundos.

ScrapeStorm: Extrator Web na Nuvem com Ajuda de IA

O ScrapeStorm é uma ferramenta de web scraping com IA que mistura interface visual com algoritmos avançados (). Você informa uma URL e a IA identifica automaticamente os campos — listas, tabelas, botões de próxima página e por aí vai.

Ele suporta uso multiplataforma (Windows, Mac, Linux) e oferece raspagem tanto no desktop quanto na nuvem. Dá para agendar tarefas, rodar vários jobs em paralelo e exportar em Excel, CSV, JSON ou até enviar para um banco de dados (). É bastante usado em e-commerce e pesquisa de mercado, e ainda consegue extrair dados de imagens ou PDFs com IA.

Se você precisa de um assistente esperto para projetos grandes ou complexos, vale colocar o ScrapeStorm no radar.

Apify: Marketplace de Extratores e Plataforma de Automação

O Apify não é só um scraper — é uma plataforma de raspagem e automação. Você roda “actors”, que são scripts para scraping ou automação de navegador. O diferencial é o marketplace de actors prontos para tarefas comuns (). Precisa extrair todas as avaliações de um e-commerce? Provavelmente já existe um actor para isso.

Para desenvolvedores, o Apify permite criar scrapers em Node.js ou Python e publicar na nuvem. É escalável, automatizável e integra via API. Funciona melhor para usuários avançados e organizações que tratam dados da web como ativo estratégico — raspagem contínua em escala ou integração em pipelines.

ParseHub: Extrator Visual para Sites Complexos

O ParseHub é um app desktop (com opções em nuvem) conhecido por encarar bem sites complexos e dinâmicos. Você navega como se estivesse num navegador, clica nos dados e o ParseHub monta o scraper (). Ele suporta lógica condicional, extração aninhada, conteúdo AJAX e mais.

Muitas vezes ele vira a escolha quando outras ferramentas travam. É usado por pesquisadores, analistas e pequenos empresários que precisam enfrentar sites “cascudos”. Tem curva de aprendizado, mas se você tem um site complexo para raspar e não quer programar, o ParseHub é uma ótima pedida.

OutWit Hub: Extrator Web Desktop para Arquivamento de Conteúdo

O OutWit Hub é mais “old school”, mas é um aplicativo desktop excelente para capturar vários tipos de conteúdo (links, imagens, e-mails etc.) e organizar tudo (). Ele funciona como um navegador misturado com planilha: você abre a página e o OutWit Hub extrai tabelas, listas, imagens e muito mais.

Ele é especialmente útil para arquivamento de conteúdo ou pesquisa — tipo raspar todos os posts de um fórum ou baixar uma coleção de arquivos. Por ser desktop, você roda localmente e mantém os dados mais privados. É indicado para tarefas pequenas e médias quando você quer uma interface direta e controle local.

Qual Extrator Web é Melhor para o Seu Caso?

Doze ferramentas, mil cenários. Qual escolher? Aqui vai meu “atalho”:

-

Para iniciantes totais ou tarefas pontuais rápidas:

Teste o Instant Data Scraper para tabelas e listas simples (é gratuito e imediato). O Data Miner também é bem amigável e tem mais templates se você costuma raspar páginas parecidas.

-

Para usuários não técnicos que precisam de raspagem recorrente ou integrações:

O Thunderbit oferece o fluxo mais simples com abordagem guiada por IA — perfeito para quem quer resultado rápido e com frequência. O Browse AI é ótimo para monitoramento contínuo e alertas. O Simplescraper é excelente se você quer que os dados raspados alimentem o Google Sheets ou um app interno via API.

-

Para sites complexos ou fluxos personalizados sem programar:

Vá de raspador visual como Octoparse ou ParseHub. O Octoparse é amigável e tem muitos templates. O ParseHub lida com sites dinâmicos bem complexos e dá controle fino. O WebScraper.io também é ótimo se você topar configurar seus próprios sitemaps.

-

Para desenvolvedores ou engenheiros de dados que precisam de escala:

O ScraperAPI é feito sob medida para embutir scraping no seu software ou tocar projetos grandes. O Apify é ideal quando você precisa de uma plataforma escalável com marketplace de scripts prontos ou personalizados.

-

Para extração de conteúdo pesado ou uso offline:

O OutWit Hub é uma boa escolha para coletar e arquivar conteúdo de forma sistemática, especialmente se você prefere uma ferramenta desktop por privacidade ou controle.

Na prática, muitos times usam mais de uma ferramenta dependendo do trabalho. Você pode começar com o Instant Data Scraper para algo simples, migrar para Thunderbit ou Octoparse em projetos mais elaborados e usar ScraperAPI ou Apify quando precisar “industrializar” o processo. A boa notícia: a maioria tem plano gratuito ou teste, então dá para experimentar e ver o que encaixa melhor.

Conclusão: o Futuro da Extração Web para Times de Negócios

Ferramentas de extração na web evoluíram demais. Em 2026, viraram padrão. A grande tendência? Web scraping está ficando mais simples, mais automatizado e mais integrado ao dia a dia (). Com raspadores guiados por IA, até sites complexos e dinâmicos ficam “domáveis” sem habilidades especializadas. Como disse um engenheiro de dados: “Quando as ferramentas de web scraping com IA chegaram ao mercado, passei a concluir tarefas muito mais rápido e em maior escala... com IA, a [limpeza de dados] já entra automaticamente no meu fluxo.”

Outra mudança forte é a linha cada vez mais fina entre raspagem, monitoramento e automação. Ferramentas como Browse AI e Thunderbit não só extraem dados, como mantêm tudo atualizado e podem até executar ações (como preencher formulários ou disparar alertas). A adoção está acelerando — uma grande plataforma viu os usuários ativos mensais crescerem mais de 140% em um ano (). Empresas de todos os tamanhos estão percebendo que acessar dados públicos da web (de forma ética e legal) é essencial para competir.

Para times de negócios, o recado é autonomia. Você não precisa esperar semanas por um desenvolvedor nem decidir “no feeling”. As ferramentas desta lista colocam o poder dos dados da web nas suas mãos, com interfaces e recursos pensados para casos reais em vendas, marketing, operações e além. E, do jeito que as coisas estão evoluindo, eu espero ver interfaces ainda mais amigáveis, IA mais inteligente e integrações mais profundas com plataformas de BI e analytics em breve.

Só não esquece: respeite os termos de uso dos sites e as regras do robots.txt, e garanta conformidade com leis de privacidade. Scraping ético é o que mantém tudo isso sustentável.

Então, seja começando com uma extensão gratuita ou implantando uma operação de scraping em nível corporativo, nunca foi tão fácil transformar informação pública da web em insight acionável. A revolução dos extratores web já chegou — escolhe uma ferramenta, testa e destrava o valor que está à vista de todo mundo. Seu futuro orientado por dados está a um clique.

Perguntas frequentes (FAQs)

1. O que é um extrator web e por que ele é importante para empresas?

Um extrator web é uma ferramenta que coleta automaticamente dados estruturados a partir de sites. Ele é importante porque ajuda empresas a transformar informações online desorganizadas em insights acionáveis — aumentando produtividade, melhorando lucratividade e eliminando coleta manual.

2. Quem pode usar extratores web — preciso ter conhecimentos técnicos?

Não. Muitos extratores modernos foram feitos para quem não é técnico. Ferramentas como Thunderbit, Browse AI e Instant Data Scraper oferecem interfaces intuitivas, automação com IA e fluxos no-code.

3. Como times de vendas, marketing e operações se beneficiam de extratores web?

Vendas pode montar listas de leads a partir de diretórios online; marketing pode acompanhar preços da concorrência; operações pode automatizar processos de coleta. Essas ferramentas economizam tempo, reduzem erros e entregam insights atualizados para decisões estratégicas.

4. O que devo considerar ao escolher uma ferramenta de extrator web?

Considere facilidade de uso, recursos de IA, automação/agendamento, integrações com Google Sheets ou Airtable, escalabilidade e aderência ao seu caso (leads, monitoramento de preços, arquivamento de conteúdo etc.).

5. Existem ferramentas de extrator web gratuitas ou de baixo custo?

Sim. Muitos extratores têm plano gratuito ou preços acessíveis. O Instant Data Scraper é totalmente gratuito para necessidades básicas. Já Thunderbit, Simplescraper e Data Miner oferecem planos gratuitos generosos e upgrades quando necessário.

Quer se aprofundar em extração na web, scraping com IA ou em como transformar sites na próxima grande vantagem do seu time? Visite o para mais guias, dicas e histórias reais da linha de frente da automação de dados.