A web está crescendo mais rápido do que o consumo de café em uma madrugada de provas — e olha que isso é dizer muito. Em 2026, extrair dados da internet deixou de ser coisa só de nerd de dados e virou necessidade básica para inteligência de negócios, IA e automação. Seja para monitorar tendências, alimentar aquele LLM maroto ou ficar de olho nos preços dos concorrentes, nunca se precisou tanto de dados organizados e em tempo real. E quem reina nesse universo? O Python, claro. Com uma comunidade gigante e sintaxe que até quem não é programador entende, Python segue como a escolha número um para quem quer usar um bom raspador web, seja em scripts simples ou em robôs que varrem a internet inteira.

Mas aqui vai o pulo do gato: escolher os pacotes python para raspagem web certos pode ser o divisor de águas entre um projeto que voa e outro que só dá dor de cabeça. Já vi muita gente perder dias tentando driblar bloqueio anti-bot com a ferramenta errada, ou gastando horas limpando HTML bagunçado quando uma biblioteca mais esperta resolveria em minutos. Por isso, depois de anos mexendo com SaaS, automação e IA (e de criar o para facilitar a vida de quem raspa dados), montei uma lista com as 12 melhores bibliotecas python para web scraping em 2026 — cada uma com seus pontos fortes, jeitão próprio e casos de uso ideais. Bora descobrir qual delas é a parceira perfeita para sua próxima missão de dados.

Por que Escolher Bem os Pacotes Python para Raspagem Web

Vamos falar a real: cada projeto de raspagem web é de um jeito. Tem hora que você só quer pegar uns preços de uma página parada. Em outras, o site é tão cheio de JavaScript que parece que está te desafiando. O pacote certo pode te poupar horas (ou dias), evitar erros bobos e ainda te livrar de bloqueios anti-bot ou HTML todo torto.

O Python faz tanto sucesso na raspagem web que não é à toa. Bibliotecas como requests e urllib3 somam mais de , e praticamente toda ferramenta de raspador web prioriza Python. Mas, com grande poder, vem grande responsabilidade: escolha errado e seu projeto fica mais lento que internet discada. Acerte na escolha e você tem dados limpos antes do café esfriar.

Como Selecionamos os Melhores Pacotes Python para Raspagem Web

Nada de sorteio ou palpite. Avaliei cada pacote pensando em:

- Performance & Concorrência: Aguenta buscar centenas ou milhares de páginas rapidinho?

- Facilidade de Uso: Dá para quem está começando ou só para ninja do Python?

- Poder de Parsing HTML: Lida bem com HTML todo torto, suporta XPath/CSS selectors e facilita extrair dados?

- Suporte a Conteúdo Dinâmico: Dá conta de site cheio de JavaScript ou só serve para página estática?

- Comunidade & Documentação: Tem galera ativa e docs decentes, ou você vai ficar perdido no Stack Overflow?

- Melhor Caso de Uso: Serve para script rápido, robô parrudo ou algo no meio do caminho?

Também levei em conta feedback da galera, benchmarks recentes e minha própria experiência (nem sempre sem dor de cabeça). Agora, confere os destaques.

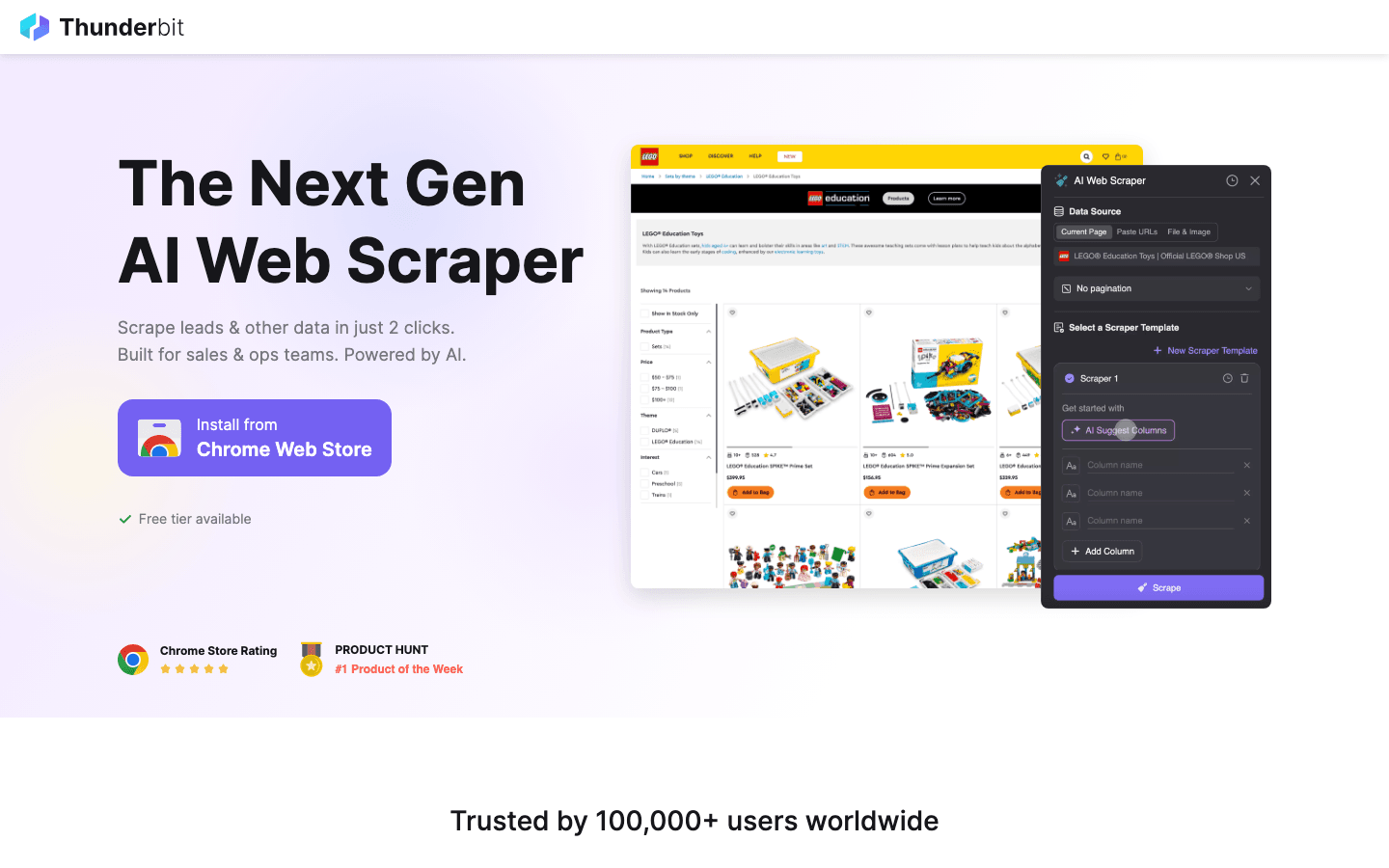

1. Thunderbit

não é uma biblioteca Python tradicional — é uma extensão Chrome com IA que está mudando o jogo da raspagem web, principalmente para quem usa Python e quer velocidade, precisão e aquele toque de inteligência artificial. O diferencial? Você pode dar instruções em português mesmo para a IA sobre o que quer extrair, e ela faz tudo: sugere campos, navega em subpáginas, faz paginação e ainda exporta para Excel, Google Sheets, Notion ou Airtable.

não é uma biblioteca Python tradicional — é uma extensão Chrome com IA que está mudando o jogo da raspagem web, principalmente para quem usa Python e quer velocidade, precisão e aquele toque de inteligência artificial. O diferencial? Você pode dar instruções em português mesmo para a IA sobre o que quer extrair, e ela faz tudo: sugere campos, navega em subpáginas, faz paginação e ainda exporta para Excel, Google Sheets, Notion ou Airtable.

Thunderbit é perfeito para extrair dados complexos e desorganizados — tipo diretórios bagunçados, listas de produtos ou sites onde o HTML parece arte moderna. O recurso AI Suggest Fields lê a página e já sugere as melhores colunas, enquanto o Subpage Scraping turbina seu dataset visitando automaticamente páginas de detalhes. E se você já cansou de bloqueio anti-bot, as opções de raspagem via navegador ou nuvem do Thunderbit resolvem fácil.

A galera do Python curte o Thunderbit para prototipar rápido, gerar leads e pesquisar mercado. Dá para usar os dados exportados direto no seu pipeline Python ou até automatizar tudo via API. Não é uma biblioteca de código, mas está virando o queridinho de quem quer gastar menos tempo programando e mais tempo analisando.

Principais recursos:

- Sugestão de campos e extração de dados com IA

- Lida com subpáginas, paginação e até PDFs/imagens

- Exporta para CSV, Excel, Google Sheets, Notion, Airtable

- Não precisa programar — ótimo para quem não é técnico e para quem quer agilidade

- Tem plano grátis; opções pagas escalam conforme a necessidade

Indicado para: Geração de leads, pesquisa de mercado, prototipagem rápida e raspagem de dados complexos ou bagunçados.

2. Beautiful Soup

é o clássico do parsing HTML em Python. Se você está começando ou só precisa extrair dados de páginas estáticas, é a escolha certeira. O Beautiful Soup brilha ao navegar e interpretar HTML todo bagunçado (“tag soup”), sendo um verdadeiro salva-vidas para sites fora do padrão.

é o clássico do parsing HTML em Python. Se você está começando ou só precisa extrair dados de páginas estáticas, é a escolha certeira. O Beautiful Soup brilha ao navegar e interpretar HTML todo bagunçado (“tag soup”), sendo um verdadeiro salva-vidas para sites fora do padrão.

A API é super amigável — comandos como .find(), .select() e .text — e funciona redondo com o requests para buscar páginas. Dá para escolher diferentes parsers (tipo lxml para velocidade ou html5lib para compatibilidade máxima). A documentação é ótima e a comunidade, gigante.

Principais recursos:

- API intuitiva e “pythônica” para navegar em HTML/XML

- Lida bem com HTML inconsistente ou quebrado

- Suporte a vários parsers para velocidade ou compatibilidade

- Comunidade enorme e muitos tutoriais

Indicado para: Scripts rápidos, raspagem de páginas estáticas e iniciantes que querem aprender sem sofrimento.

3. Scrapy

é o peso-pesado para raspagem web automatizada em larga escala. Se você precisa coletar centenas ou milhares de páginas, gerenciar pipelines ou agendar tarefas recorrentes, Scrapy é o framework ideal. Baseado no motor Twisted, é super rápido, suporta crawling assíncrono, pipelines para limpeza de dados e exportação nativa para JSON, CSV ou bancos de dados.

é o peso-pesado para raspagem web automatizada em larga escala. Se você precisa coletar centenas ou milhares de páginas, gerenciar pipelines ou agendar tarefas recorrentes, Scrapy é o framework ideal. Baseado no motor Twisted, é super rápido, suporta crawling assíncrono, pipelines para limpeza de dados e exportação nativa para JSON, CSV ou bancos de dados.

Scrapy é extensível, com plugins para proxies, cache e até renderização limitada de JavaScript (via Splash ou integração com Selenium). A curva de aprendizado é mais íngreme que a do Beautiful Soup, mas se você leva a sério a coleta de dados em escala, Scrapy é o caminho natural.

Principais recursos:

- Crawling assíncrono e de alta performance

- Pipelines integrados para limpeza e armazenamento de dados

- Exportação para vários formatos (JSON, CSV, DB)

- Comunidade ativa e ecossistema de plugins

Indicado para: Projetos recorrentes e de grande escala, pipelines de dados e quem busca velocidade e confiabilidade.

4. Selenium

é a escolha de quem precisa raspar sites dinâmicos ou interativos. Ele automatiza navegadores de verdade (Chrome, Firefox, etc.), permitindo simular cliques, rolagem e envio de formulários. Se os dados só aparecem depois do JavaScript rodar, Selenium resolve — não importa o quão enrolado seja o site.

é a escolha de quem precisa raspar sites dinâmicos ou interativos. Ele automatiza navegadores de verdade (Chrome, Firefox, etc.), permitindo simular cliques, rolagem e envio de formulários. Se os dados só aparecem depois do JavaScript rodar, Selenium resolve — não importa o quão enrolado seja o site.

O lado ruim? Selenium é mais lento e pesado, já que abre um navegador completo para cada raspagem. Não espere processar milhares de páginas por minuto. Mas para situações em que nada mais resolve, Selenium é indispensável.

Principais recursos:

- Automação completa de navegadores (Chrome, Firefox, Edge, etc.)

- Lida com conteúdo renderizado por JavaScript e elementos interativos

- Suporte a modo headless para raspagem mais rápida e sem interface

- Comunidade madura e documentação extensa

Indicado para: Raspagem de sites dinâmicos, automação de login, CAPTCHAs e interações complexas.

5. PyQuery

traz a sintaxe do jQuery para o Python, deixando o parsing HTML super familiar para quem já mexeu com jQuery no JavaScript. Ele usa o parser rápido

traz a sintaxe do jQuery para o Python, deixando o parsing HTML super familiar para quem já mexeu com jQuery no JavaScript. Ele usa o parser rápido lxml e permite usar seletores CSS tipo $('div.classname') para encontrar elementos.

PyQuery é ótimo para prototipar rápido e para quem quer código enxuto e fácil de ler. É mais rápido que o Beautiful Soup para consultas complexas e integra fácil com ferramentas assíncronas ou Selenium para fluxos mais avançados.

Principais recursos:

- Sintaxe e seletores jQuery no Python

- Parsing rápido com backend lxml

- Ideal para quem vem do JavaScript

- Suporte a encadeamento e consultas concisas

Indicado para: Prototipagem, fãs de jQuery e quem quer escrever menos código para parsing HTML.

6. LXML

é o velocista do parsing HTML e XML em Python. Baseado nas bibliotecas C

é o velocista do parsing HTML e XML em Python. Baseado nas bibliotecas C libxml2 e libxslt, é famoso pela performance e suporte avançado a XPath e seletores CSS. Se você lida com documentos grandes ou precisa de consultas complexas, lxml é a melhor escolha.

Pode ser usado direto ou como backend do Beautiful Soup ou PyQuery. A API é um pouco mais avançada, mas a velocidade e flexibilidade compensam em projetos robustos.

Principais recursos:

- Parsing mais rápido disponível em Python

- Suporte completo a XPath e seletores CSS

- Lida com documentos grandes e complexos com eficiência

- Pode ser usado sozinho ou como parser para outras bibliotecas

Indicado para: Parsing de alta performance, raspagem em larga escala e projetos que exigem consultas avançadas.

7. Requests

é o padrão para fazer requisições HTTP em Python. Sua API limpa e intuitiva faz buscar páginas web ser tão fácil quanto

é o padrão para fazer requisições HTTP em Python. Sua API limpa e intuitiva faz buscar páginas web ser tão fácil quanto requests.get(url). Ele cuida de cookies, sessões e até decodifica JSON de boa.

Apesar de ser síncrono (cada requisição espera a anterior terminar), é perfeito para scripts rápidos e raspagem pequena. Combine com Beautiful Soup ou lxml para o combo clássico de scraping.

Principais recursos:

- API simples e “pythônica” para requisições HTTP

- Gerencia cookies, sessões e redirecionamentos

- Integração perfeita com bibliotecas de parsing

- Comunidade e documentação gigantes

Indicado para: Scripts simples, raspagem de páginas estáticas e iniciantes que querem começar sem complicação.

8. MechanicalSoup

é uma biblioteca leve que automatiza interações simples de navegador — tipo preencher formulários ou navegar por fluxos de login — sem precisar abrir um navegador completo. Ela usa

é uma biblioteca leve que automatiza interações simples de navegador — tipo preencher formulários ou navegar por fluxos de login — sem precisar abrir um navegador completo. Ela usa requests e Beautiful Soup, sendo muito mais rápida e leve que o Selenium para sites que não dependem tanto de JavaScript.

Se você precisa fazer login, enviar formulários ou navegar por algumas páginas (e o site não é muito dinâmico), MechanicalSoup é uma ótima solução intermediária.

Principais recursos:

- Automatiza preenchimento de formulários e navegação

- Baseada em Requests e Beautiful Soup

- Leve e rápida (sem overhead de navegador)

- Fácil de usar para interatividade moderada

Indicado para: Sites que exigem login ou envio de formulários, automação simples e quem quer evitar o peso do Selenium.

9. Aiohttp

é a potência assíncrona para requisições web em alta velocidade e concorrência. Se você precisa raspar centenas de páginas rapidinho, aiohttp permite disparar várias requisições em paralelo, reduzindo muito o tempo total. Em um teste, raspar 50 páginas levou só 3 segundos com aiohttp, contra 16 segundos usando requests síncrono ().

é a potência assíncrona para requisições web em alta velocidade e concorrência. Se você precisa raspar centenas de páginas rapidinho, aiohttp permite disparar várias requisições em paralelo, reduzindo muito o tempo total. Em um teste, raspar 50 páginas levou só 3 segundos com aiohttp, contra 16 segundos usando requests síncrono ().

Aiohttp exige código com async def e uso de await, mas o ganho de velocidade compensa em projetos grandes.

Principais recursos:

- Framework assíncrono para cliente/servidor HTTP

- Suporte a sessões, cookies e HTTP/2

- Acelera requisições concorrentes

- Integração com bibliotecas de parsing assíncronas

Indicado para: Raspagem em alta velocidade, coleta de APIs e quem já manja de programação assíncrona.

10. Twisted

é o motor de rede orientado a eventos que está por trás do Scrapy. Não é uma biblioteca de scraping em si, mas usuários avançados podem usar Twisted direto para criar crawlers personalizados, lidar com protocolos além do HTTP ou implementar spiders hiperconcorrentes.

é o motor de rede orientado a eventos que está por trás do Scrapy. Não é uma biblioteca de scraping em si, mas usuários avançados podem usar Twisted direto para criar crawlers personalizados, lidar com protocolos além do HTTP ou implementar spiders hiperconcorrentes.

Twisted é poderoso, mas tem uma curva de aprendizado puxada. É para cenários bem customizados ou para quem quer construir frameworks do zero.

Principais recursos:

- Rede orientada a eventos para HTTP, WebSockets, SSH e mais

- Suporte a SSL, concorrência e protocolos customizados

- Base do motor assíncrono do Scrapy

- Altamente flexível para casos avançados

Indicado para: Protocolos customizados, construção de frameworks de scraping e usuários avançados que querem controle total.

11. Grab

é um kit completo para scraping que junta requisições HTTP, parsing, automação, rotação de proxies e resolução de CAPTCHAs. Lembra o Scrapy, mas tenta ser mais fácil de aprender e usar, com suporte nativo a proxies, cache e spiders assíncronos.

é um kit completo para scraping que junta requisições HTTP, parsing, automação, rotação de proxies e resolução de CAPTCHAs. Lembra o Scrapy, mas tenta ser mais fácil de aprender e usar, com suporte nativo a proxies, cache e spiders assíncronos.

O destaque do Grab é o sistema Grab:Spider, que consegue fazer milhares de requisições em paralelo usando multicurl. Se você quer uma solução tudo-em-um com menos configuração que o Scrapy, vale dar uma olhada.

Principais recursos:

- Suporte nativo a proxies, rotação de user-agent e cache

- Sistema de spiders assíncronos para alta concorrência

- Parsing com XPath e arquitetura modular

- Usado em produção para raspagem em larga escala

Indicado para: Projetos completos de scraping, tarefas intensivas em proxies e quem quer poder sem a complexidade do Scrapy.

12. Urllib3

é o motor HTTP de baixo nível que alimenta muitos clientes Python, incluindo o Requests. Oferece pool de conexões, segurança para threads, tentativas automáticas e controle detalhado das conexões HTTP. Embora a maioria use indiretamente, urllib3 é ideal quando você precisa de máxima performance ou está criando bibliotecas de mais alto nível.

é o motor HTTP de baixo nível que alimenta muitos clientes Python, incluindo o Requests. Oferece pool de conexões, segurança para threads, tentativas automáticas e controle detalhado das conexões HTTP. Embora a maioria use indiretamente, urllib3 é ideal quando você precisa de máxima performance ou está criando bibliotecas de mais alto nível.

Não é tão amigável para iniciantes quanto o Requests, mas é testado e altamente confiável.

Principais recursos:

- Pool de conexões e segurança para threads

- Controle detalhado das conexões HTTP

- Base para várias outras bibliotecas

- Alta performance para requisições repetidas

Indicado para: Clientes HTTP customizados, crawlers multi-thread e desenvolvedores que constroem sobre a stack HTTP do Python.

Tabela Comparativa: Pacotes Python para Raspagem Web em Resumo

| Pacote | Facilidade de Uso | Performance | Conteúdo Dinâmico | Poder de Parsing | Comunidade/Docs | Indicado para |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/IA) | Rápido (nuvem/local) | Sim (via IA) | Campos automáticos, subpáginas | Crescente (tendência IA) | Geração de leads, pesquisa de mercado, no-code |

| Beautiful Soup | ★★★★★ (fácil) | Média | Não | HTML/XML, tolerante | Enorme | Páginas estáticas, iniciantes |

| Scrapy | ★★☆☆☆ (íngreme) | ★★★★★ (muito alta) | Só com plugins | CSS/XPath, pipelines | Grande, ativa | Raspagem recorrente e em larga escala |

| Selenium | ★★☆☆☆ (média) | ★☆☆☆☆ (lenta) | Sim (completo) | DOM completo, JS | Madura | Sites JS, interativos |

| PyQuery | ★★★★☆ (jQuery) | Rápida (lxml) | Não* | Seletores jQuery | Moderada | Prototipagem, devs jQuery |

| LXML | ★★★☆☆ (avançado) | ★★★★★ (mais rápida) | Não | XPath/CSS, XML | Moderada | Docs grandes, queries avançadas |

| Requests | ★★★★★ (muito fácil) | ★★☆☆☆ (síncrona) | Não | HTTP, JSON | Massiva | Scripts simples, páginas estáticas |

| MechanicalSoup | ★★★★☆ (fácil) | ★★☆☆☆ (síncrona) | Não | Formulários, navegação | Pequena | Login, automação de formulários |

| Aiohttp | ★★☆☆☆ (assíncrona) | ★★★★★ (concorrente) | Não | HTTP assíncrono | Grande (async) | Raspagem rápida e concorrente |

| Twisted | ★☆☆☆☆ (complexo) | ★★★★★ (customizado) | Não | Redes, protocolos | Nicho | Frameworks customizados, usuários avançados |

| Grab | ★★★☆☆ (modular) | ★★★★☆ (assíncrona) | Não | Proxies, XPath | Pequena | Tudo-em-um, proxies/CAPTCHA |

| Urllib3 | ★★★★☆ (baixo nível) | ★★★★☆ (pool) | Não | HTTP, pool | Massiva | Clientes customizados, crawlers multi-thread |

*PyQuery pode ser combinado com Selenium para sites dinâmicos.

Como Escolher o Pacote Python Ideal para Sua Raspagem Web

E aí, qual pacote escolher? Olha só esse guia rápido:

- Páginas estáticas, tarefas pequenas ou iniciantes: Vai de Requests + Beautiful Soup.

- Raspagem recorrente, em larga escala ou produção: Scrapy ou Grab (para solução tudo-em-um).

- Sites dinâmicos ou interativos: Selenium (ou Thunderbit se quiser IA e zero código).

- Raspagem rápida e concorrente: Aiohttp (se você já manja de async).

- Automação de formulários ou login: MechanicalSoup (para sites simples), Selenium (para JS pesado).

- Parsing avançado ou documentos grandes: LXML ou PyQuery.

- Redes customizadas ou protocolos: Twisted.

- Prototipagem rápida, geração de leads ou dados bagunçados: Thunderbit.

E não tenha medo de misturar ferramentas — muita gente usa várias juntas para tirar o máximo. Por exemplo, você pode usar Selenium para renderizar a página e depois passar o HTML para Beautiful Soup ou PyQuery.

Conclusão: Potencialize sua Raspagem Web com as Ferramentas Certas em Python

A raspagem web em 2026 está mais poderosa — e mais essencial — do que nunca. Com os pacotes certos de Python, você transforma o caos da internet em dados limpos e valiosos para seu negócio, pesquisa ou próxima grande ideia. Seja você um dev experiente ou esteja só começando, tem uma ferramenta nessa lista que é a sua cara.

Quer ver como é raspar com IA e sem código? . E se quiser mais dicas, tutoriais e novidades, confere o para ficar por dentro do universo de raspador web, automação e fluxos orientados a dados.

Boas raspagens — que seus seletores sempre acertem o alvo, seus proxies nunca te deixem na mão e seus dados sejam tão limpos quanto seu código.

Perguntas Frequentes

1. Qual o melhor pacote Python para raspagem web para iniciantes?

Para a maioria de quem está começando, a dupla e é o caminho mais fácil. APIs intuitivas, muitos tutoriais e resolvem a maioria das tarefas em páginas estáticas.

2. Como raspar sites pesados em JavaScript com Python?

Use o para automatizar um navegador de verdade, ou experimente o para raspagem com IA e sem código, que encara conteúdo dinâmico numa boa. Para grandes volumes, Scrapy pode ser combinado com Splash ou Selenium.

3. Qual pacote é melhor para raspagem em larga escala e alta velocidade?

foi feito para crawling assíncrono em grande escala. Se você quer ainda mais velocidade e já domina async, é ótimo para requisições concorrentes.

4. Posso combinar esses pacotes no meu fluxo de trabalho?

Com certeza! Muita gente usa Requests ou Selenium para buscar páginas e depois faz parsing com Beautiful Soup, lxml ou PyQuery. Os dados exportados pelo Thunderbit podem ser usados em scripts Python para análises avançadas.

5. Thunderbit é uma biblioteca Python ou uma ferramenta independente?

Thunderbit é uma extensão Chrome e plataforma com IA, não uma biblioteca Python tradicional. Mas os resultados (CSV, Excel, Sheets, Notion, Airtable) integram fácil com pipelines Python, sendo um ótimo complemento para devs.

Quer ficar por dentro do mundo do raspador web? Se inscreve no e acompanha o para mais guias, comparativos e dicas de automação.

Saiba Mais