Na semana passada, um colega me enviou um contrato de fornecedor com 47 páginas e pediu para eu “colocar as tabelas de preços numa planilha”. Olhei para o PDF por uns três segundos antes de fechá-lo e abrir um PDF scraper. Esse impulso não veio de preguiça — veio de anos a ver pessoas perderem tardes inteiras a lutar para tirar dados de ficheiros que nunca foram feitos para os entregar facilmente.

Os números explicam bem essa frustração. Um estudo da Airbase de 2024 com descobriu que 38% das equipas passam mais de um quarto do tempo total em tarefas manuais. O relatório de automação de contas a pagar da SAP Concur acrescenta que em sistemas ERP ou contabilísticos ainda são feitos à mão.

Os PDFs estão em todo o lado — notas fiscais, contratos, demonstrações financeiras, recibos digitalizados — e ainda há trabalho a mais de copiar e colar. Em 2026, os PDF scrapers vão de bibliotecas Python gratuitas a ferramentas no-code com IA, e escolher a errada pode custar dias em vez de os poupar. Testei 12 dos melhores PDF scrapers em extração de tabelas, OCR, preço e facilidade de utilização para você encontrar a opção certa em minutos.

O que é um PDF Scraper (e por que isso importa)?

Um PDF scraper é um software que extrai automaticamente texto, tabelas, campos e dados estruturados de ficheiros PDF. Se já tentou copiar uma tabela de um PDF para o Excel e viu as colunas virarem uma única linha confusa, já percebeu o problema.

PDF scrapers e web scrapers são frequentemente confundidos, por isso vale a pena fazer uma distinção rápida. Um web scraper lê HTML, que pelo menos tem algumas marcas estruturais — títulos, tabelas, divs. Um PDF scraper parte de um formato de descrição visual da página. A própria documentação da Adobe deixa isso claro: o de forma consistente entre dispositivos, não para expor uma estrutura tabular ou semântica limpa. Por isso, copiar e colar destrói linhas, colunas e a ordem de leitura.

Onde é que a extração de PDFs realmente poupa tempo?

- Processamento de notas fiscais: extrair nome do fornecedor, ID da nota, totais, impostos e itens

- Relatórios financeiros: extrair tabelas de relatórios anuais, demonstrações e divulgações

- Registos digitalizados: recuperar contactos ou dados de transações de PDFs que são apenas imagem

- Migrações de arquivos antigos: converter acervos antigos em registos pesquisáveis e estruturados

O impacto nos negócios vai além de um único fluxo. A Gartner ainda estima que dados maus custem às organizações . E, em fevereiro de 2025, a Gartner disse que não têm, ou não sabem se têm, as práticas certas de gestão de dados para IA. Até 2026, a Gartner afirma que as organizações abandonarão 60% dos projetos de IA que não forem sustentados por dados prontos para IA. Se os PDFs ainda concentram boa parte dos dados brutos, a qualidade da extração de documentos está agora diretamente ligada à prontidão para IA.

A pesquisa da Adobe de 2025 com profissionais de finanças mostrou que e 64% os assinam com frequência. A PDF Association também observa que o PDF foi classificado como o nos dados do CommonCrawl. Os PDFs não vão a lado nenhum.

Como avaliamos os melhores PDF Scrapers

Antes de entrar nas ferramentas, este é o framework que usei. Os oito critérios abaixo ligam-se diretamente aos problemas que vejo com mais frequência em fóruns, issues do GitHub e avaliações de produto:

| Critério | O que mede | Por que importa para o utilizador |

|---|---|---|

| Tipos de PDF compatíveis | Texto nativo, digitalizado/só imagem, misto | Muitas ferramentas falham antes mesmo de a extração começar |

| Precisão na extração de tabelas | Tabelas simples, sem bordas, multi-página, células mescladas | A reclamação nº 1 sobre extração de PDF |

| Capacidade de OCR | Integrado, complemento ou nenhum | PDFs digitalizados são inutilizáveis sem OCR |

| Formatos de saída/exportação | Excel, CSV, JSON, Sheets, Notion, APIs | O dado é inútil se não sair da ferramenta de forma limpa |

| Dificuldade de configuração | No-code, low-code ou baseado em código | As equipas precisam de níveis muito diferentes de controlo |

| Preço / plano gratuito | Preço público, teste, ponto de entrada realista | Os modelos de cobrança variam muito |

| Automação / integrações | Zapier, API, agendamento, webhooks | Exportações manuais não escalam |

| Melhor caso de uso | Em que a ferramenta realmente é boa | A maioria das ferramentas não é boa para tudo — é específica de um fluxo |

Para manter a leitura clara, as 12 ferramentas dividem-se em três categorias: PDF scrapers no-code com IA, parsers de documentos baseados em templates ou SaaS, e bibliotecas / APIs / ferramentas open source para developers.

Os 12 melhores PDF Scrapers em resumo

Aqui está a comparação principal para você olhar de relance, ver o seu perfil e saltar para a secção certa:

| Ferramenta | Tipo | Extração de tabelas | OCR integrado | No-code | Plano gratuito | Ideal para |

|---|---|---|---|---|---|---|

| Thunderbit | PDF scraper no-code com IA | ✅ Com IA | ✅ Sim | ✅ Sim | ✅ Créditos gratuitos | Utilizadores de negócios, layouts variados |

| Tabula | Desktop open source | ✅ Boa (PDFs com texto) | ❌ Não | ✅ Interface gráfica | ✅ Totalmente gratuito | PDFs de texto simples com muitas tabelas |

| Parseur | SaaS híbrido | ⚠️ Template + IA | ✅ Sim | ✅ Sim | ⚠️ Limitado | Processamento recorrente de notas fiscais/e-mails |

| Nanonets | SaaS de IDP com IA | ✅ Forte | ✅ Sim | ✅ Low-code | ⚠️ Teste com créditos | Automação de documentos em alto volume |

| Adobe Acrobat | Suite de produtividade PDF | ⚠️ Básico | ✅ Sim | ✅ Sim | ❌ Exportação paga | Conversões ocasionais de PDF para Excel |

| PyMuPDF | Biblioteca Python | ⚠️ Parse manual | ❌ Não (Tesseract opcional) | ❌ Requer código | ✅ Totalmente gratuito | Developers, PDFs pesados em texto |

| Camelot | Biblioteca Python para tabelas | ✅ Forte (lattice + stream) | ❌ Não | ❌ Requer código | ✅ Totalmente gratuito | Developers, tabelas complexas |

| Docparser | SaaS com templates | ⚠️ Baseado em template | ✅ Sim | ✅ Sim | ⚠️ Teste | Documentos recorrentes + fluxos com Zapier |

| pdfplumber | Biblioteca Python | ✅ Boa (granular) | ❌ Não | ❌ Requer código | ✅ Totalmente gratuito | Developers, controlo fino |

| AWS Textract | API em nuvem | ✅ Forte | ✅ Sim | ❌ Requer API | ⚠️ Plano gratuito limitado | Pipelines em escala empresarial |

| Docling | Python open source | ✅ Boa | ✅ Via integração | ❌ Requer código | ✅ Totalmente gratuito | Pipelines LLM/RAG |

| Parsio | SaaS híbrido | ⚠️ Assistida por IA | ✅ Sim | ✅ Sim | ⚠️ Limitado | Tipos de documento recorrentes |

Quer zero configuração? Comece nas linhas de no-code ou SaaS. Precisa de controlo máximo? Vá direto para as linhas de developer. Trabalhando com PDFs digitalizados? Elimine qualquer opção em que OCR = Não.

1. Thunderbit

é o PDF scraper que eu recomendaria a qualquer pessoa que diga “só preciso tirar os dados deste PDF” e não queira ouvir falar de Python, templates ou chaves de API. É um agente de dados web com IA — uma extensão do Chrome — que lê PDFs, imagens e sites e depois gera dados estruturados. Sem templates, sem código.

é o PDF scraper que eu recomendaria a qualquer pessoa que diga “só preciso tirar os dados deste PDF” e não queira ouvir falar de Python, templates ou chaves de API. É um agente de dados web com IA — uma extensão do Chrome — que lê PDFs, imagens e sites e depois gera dados estruturados. Sem templates, sem código.

Construímos o Thunderbit para lidar com o cenário que derruba a maioria das ferramentas: você recebe PDFs de cinco fornecedores diferentes, cada um com um layout um pouco distinto, e precisa dos mesmos campos em todos eles. A IA lê cada documento de raiz, sugere nomes de colunas e tipos de dados através do recurso “AI Suggest Fields” e extrai os dados para uma tabela estruturada. O OCR integrado trata PDFs digitalizados e imagens de forma nativa, com suporte a .

Principais recursos:

- AI Suggest Fields deteta automaticamente colunas e tipos de dados em qualquer layout de PDF — sem configuração manual

- OCR integrado para PDFs digitalizados e imagens

- Exporta para Excel, Google Sheets, Airtable, Notion, CSV e JSON — tudo grátis

- Rotulagem e reformatação com IA: a IA pode traduzir, categorizar ou reestruturar os dados extraídos durante a extração, e não só depois

- Extração de tabelas lê o layout visualmente (como um humano), adaptando-se a formatos sem bordas, irregulares e de vários fornecedores

Como extrair um PDF com o Thunderbit:

- Instale a

- Abra ou envie o seu PDF no navegador

- Clique em “AI Suggest Fields” — a IA lê o documento e sugere nomes de colunas e tipos

- Clique em “Scrape” — os dados são extraídos para uma tabela estruturada

- Exporte para Google Sheets, Excel, Airtable, Notion, CSV ou JSON

Preços: plano gratuito com créditos (cerca de 6 páginas grátis, 10 com teste). Plano Starter a cerca de US$ 15/mês ou cerca de US$ 9/mês na cobrança anual. Os créditos são baseados em linhas (1 crédito = 1 linha de saída). Veja para detalhes.

Ideal para: Utilizadores não técnicos que lidam com layouts variados de PDF (notas fiscais de vários fornecedores, relatórios em formatos mistos) e querem resultado em 2 cliques.

Prós: A configuração mais fácil desta lista; OCR integrado; exportação direta para Sheets, Notion, Airtable e Excel; funciona em layouts variados sem templates.

Contras: A cobrança por créditos leva um minuto a converter em custo por página; menos avaliações de terceiros do que fornecedores SaaS maiores.

2. Tabula

é a resposta clássica e gratuita para extração de tabelas em PDFs baseados em texto, e também já deixa claro que, neste ponto, é um projeto legado. O repositório informa que é mantido por voluntários, e é num futuro próximo. O lançamento mais recente da versão desktop continua a ser 1.2.1, de 2018, enquanto o tabula-java teve o último release .

é a resposta clássica e gratuita para extração de tabelas em PDFs baseados em texto, e também já deixa claro que, neste ponto, é um projeto legado. O repositório informa que é mantido por voluntários, e é num futuro próximo. O lançamento mais recente da versão desktop continua a ser 1.2.1, de 2018, enquanto o tabula-java teve o último release .

Principais recursos:

- Interface gráfica point-and-click para selecionar regiões de tabela

- Corre localmente — os dados nunca saem da sua máquina

- Sem conta, sem assinatura, sem registo

Preços: totalmente gratuito, para sempre. Open source.

Ideal para: Pessoas com PDFs simples, baseados em texto, com tabelas bem delimitadas e que querem uma solução local e gratuita.

Prós: Gratuito; local; muito simples para tabelas básicas.

Contras: Sem OCR (PDFs digitalizados estão fora de questão); fraco em tabelas sem borda; sem automação ou API; sem opção na nuvem; na prática, sem manutenção.

3. Parseur

é o híbrido mais forte entre as ferramentas SaaS porque combina parsing com IA, parsing por template e . Isso torna-o mais flexível do que um parser zonal puro, mas ainda mais estruturado do que um scraper de IA totalmente genérico.

é o híbrido mais forte entre as ferramentas SaaS porque combina parsing com IA, parsing por template e . Isso torna-o mais flexível do que um parser zonal puro, mas ainda mais estruturado do que um scraper de IA totalmente genérico.

Principais recursos:

- OCR integrado com suporte a (mais de 160 em modo experimental)

- Integrações com Zapier, Make, Power Automate, API, webhooks, Google Sheets

- Boa opção para notas fiscais, avisos de envio, confirmações de pedido e tipos de documento recorrentes

Preços: plano gratuito de cerca de 20 páginas/mês. Piso pago self-service mais baixo em torno de . O custo normalizado no plano mais baixo fica em cerca de US$ 390 por 1.000 páginas, embora as taxas efetivas caiam com volumes maiores.

Ideal para: Equipas que recebem repetidamente os mesmos tipos de documentos e querem automação sem código.

Prós: OCR integrado; stack forte de automação; lida bem com layouts recorrentes.

Contras: Cada layout novo ou alterado pode exigir trabalho de template ou fallback de IA; estruturas de tabelas complexas continuam mais difíceis.

4. Nanonets

aproxima-se mais de uma plataforma de processamento inteligente de documentos (IDP) do que de um simples PDF scraper — o que é ao mesmo tempo a sua força e a sua complexidade. A empresa , passando para créditos pré-pagos em vez de um plano simples por página.

aproxima-se mais de uma plataforma de processamento inteligente de documentos (IDP) do que de um simples PDF scraper — o que é ao mesmo tempo a sua força e a sua complexidade. A empresa , passando para créditos pré-pagos em vez de um plano simples por página.

Principais recursos:

- Extração de tabelas e deteção de campos com IA

- OCR integrado com suporte a

- Automação de fluxos com etapas de aprovação

- Pilha ampla de integrações empresariais

Preços: créditos no registo. Cobrança por utilização. Uma estimativa aproximada com base na fica em torno de US$ 300 a US$ 380 por 1.000 páginas para um fluxo simples de extração.

Ideal para: Equipas médias e grandes que processam milhares de documentos por mês (automação de contas a pagar, logística, sinistros de seguros).

Prós: Extração com IA forte; integrações empresariais; automação de fluxos.

Contras: O preço é mais difícil de prever; curva de aprendizagem para fluxos avançados; plano gratuito limitado.

5. Adobe Acrobat

é a ferramenta PDF de referência que quase toda a gente reconhece. É forte em OCR e conversão, mas não é exatamente um scraper no mesmo sentido das outras opções desta lista.

é a ferramenta PDF de referência que quase toda a gente reconhece. É forte em OCR e conversão, mas não é exatamente um scraper no mesmo sentido das outras opções desta lista.

Principais recursos:

- OCR integrado no Pro

- Exporta para Word, Excel, PowerPoint, HTML, TXT e formatos de imagem

- Amplo suporte a OCR em vários idiomas

Preços: Acrobat Standard a ; Acrobat Pro a US$ 19,99/mês. O Reader é gratuito, mas os recursos de exportação exigem plano pago.

Ideal para: Utilizadores que ocasionalmente precisam converter um PDF para Word ou Excel e já têm assinatura da Adobe.

Prós: Muito fiável; OCR integrado; muita gente já usa.

Contras: A extração de tabelas é básica em layouts complexos; sem automação ou API para processamento em lote; não foi projetado como um “scraper”.

6. PyMuPDF

(também conhecido como “fitz”) continua a ser a biblioteca Python de extração de PDF mais rápida para uso geral neste comparativo. A versão atual é , e os continuam a mostrar que é significativamente mais rápido do que muitas outras bibliotecas Python de PDF.

(também conhecido como “fitz”) continua a ser a biblioteca Python de extração de PDF mais rápida para uso geral neste comparativo. A versão atual é , e os continuam a mostrar que é significativamente mais rápido do que muitas outras bibliotecas Python de PDF.

Principais recursos:

- Extração de texto bruto extremamente rápida

- Extração de imagens e acesso a metadados

- OCR opcional via Tesseract (embora a documentação observe que o OCR é do que a extração padrão)

- Deteção de tabelas com

find_tables()

Preços: totalmente gratuito, open source.

Ideal para: Developers que criam pipelines e trabalham principalmente com PDFs nativos, pesados em texto.

Prós: Muito rápido; leve; comunidade ativa; ótima extração de texto.

Contras: Sem OCR integrado; a extração de tabelas exige lógica manual de parsing; requer código.

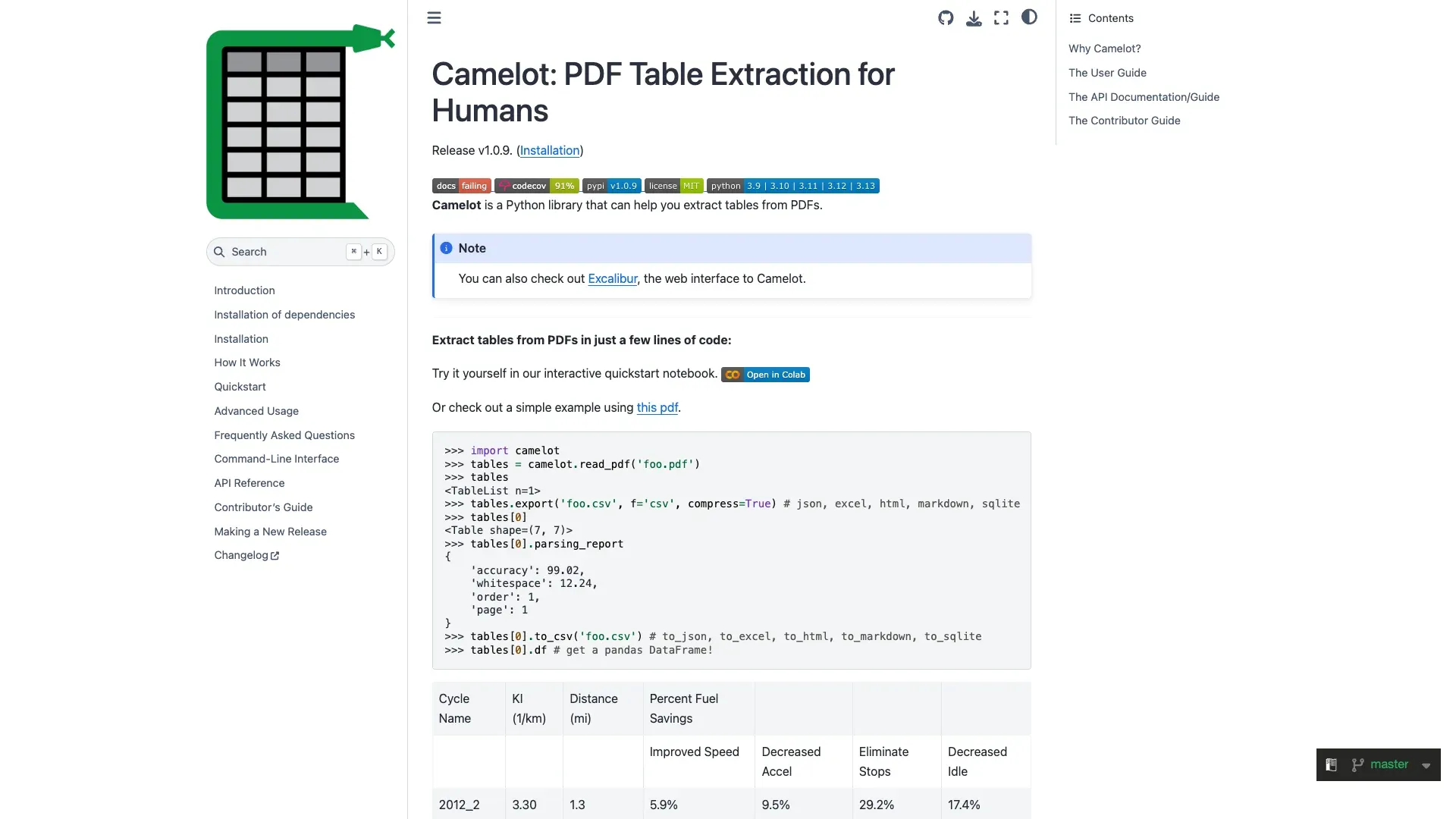

7. Camelot

continua a ser uma das ferramentas Python de extração de tabelas mais reconhecidas porque é focada em tabelas, e não em documentos em geral. O repositório atual é mantido, com .

continua a ser uma das ferramentas Python de extração de tabelas mais reconhecidas porque é focada em tabelas, e não em documentos em geral. O repositório atual é mantido, com .

Principais recursos:

- Dois modos de extração:

latticepara tabelas com borda,streampara tabelas sem borda / baseadas em espaço em branco - Métricas de precisão no — um dos recursos mais úteis do Camelot para fluxos de automação

- Saída para pandas DataFrames, CSV, JSON e Excel

Preços: totalmente gratuito, open source.

Ideal para: Developers que precisam de extração precisa de tabelas em PDFs estruturados e baseados em texto.

Prós: Excelente precisão em tabelas; dois modos de extração; pontuação de precisão.

Contras: Sem OCR; apenas PDFs baseados em texto; requer código; pode ser lento em documentos grandes.

8. Docparser

é a ferramenta SaaS mais claramente baseada em regras desta seleção. Usa OCR zonal, palavras-chave âncora e regras de parsing de layout fixo, em vez de tentar comportar-se como um leitor genérico de layouts com IA.

é a ferramenta SaaS mais claramente baseada em regras desta seleção. Usa OCR zonal, palavras-chave âncora e regras de parsing de layout fixo, em vez de tentar comportar-se como um leitor genérico de layouts com IA.

Principais recursos:

- OCR integrado

- Integra com Zapier, Workato, Power Automate, Google Sheets, Salesforce e REST API

- Boa para encaminhar dados extraídos para fluxos de trabalho de negócios

Preços: ; Professional a US$ 74/mês; Business a US$ 159/mês. Teste grátis de 14 dias. Cobrança por documento, por isso o custo normalizado por 1.000 páginas depende do tamanho do documento — em torno de US$ 78 a US$ 390 no plano Starter.

Ideal para: Equipas que precisam automatizar fluxos recorrentes de documentos com integração forte a ferramentas como Zapier ou Salesforce.

Prós: OCR integrado; integrações fortes de fluxo de trabalho; bom para layouts estáveis.

Contras: Baseado em template — cada novo layout exige configuração; a extração de tabelas depende da definição de zonas; é mais forte na primeira página.

9. pdfplumber

continua a ser a biblioteca de developer mais granular deste conjunto. A versão atual é , e o repositório informa que está em desenvolvimento ativo.

continua a ser a biblioteca de developer mais granular deste conjunto. A versão atual é , e o repositório informa que está em desenvolvimento ativo.

Principais recursos:

- Controlo detalhado sobre objetos de caracteres, linhas, retângulos e estratégias de localização de tabelas

- Filtros baseados em recorte e depuração visual

- Gera dados como listas/dicionários Python para manipulação fácil

Preços: totalmente gratuito, open source.

Ideal para: Developers Python que precisam de lógica de extração de tabelas granular e personalizável.

Prós: Controlo de baixo nível excelente; boa precisão em tabelas complexas; desenvolvimento ativo.

Contras: Sem OCR; curva de aprendizagem mais íngreme que a do Camelot; requer código.

10. AWS Textract

é a API mais nativa de ambiente empresarial desta lista. Foi feita para escala, diversidade de documentos e uso programático, e não para conveniência visual.

é a API mais nativa de ambiente empresarial desta lista. Foi feita para escala, diversidade de documentos e uso programático, e não para conveniência visual.

Principais recursos:

- Extração de tabelas e formulários com IA

- OCR integrado com suporte a escrita à mão (o mais próximo desta lista, embora ainda imperfeito)

- Escalabilidade de nível empresarial

- Integração limpa com o ecossistema AWS

Preços: . Plano gratuito: 1.000 páginas/mês por 3 meses. Depois disso: OCR apenas texto por US$ 1,50/1.000 páginas; tabelas por US$ 15/1.000 páginas; formulários + tabelas por US$ 65/1.000 páginas; documentos de despesas por US$ 10/1.000 páginas.

Ideal para: Equipas empresariais que processam mais de 10.000 documentos por mês através de um pipeline com API.

Prós: Extração precisa de formulários e tabelas; OCR integrado; escalabilidade empresarial.

Contras: Apenas API; sem interface visual; os custos sobem depressa nos modos avançados; dependência do ecossistema AWS.

11. Docling

é a ferramenta open source mais virada para o futuro aqui, porque foi feita diretamente para pipelines de documento para LLM. A versão atual é , e o projeto está a evoluir depressa.

é a ferramenta open source mais virada para o futuro aqui, porque foi feita diretamente para pipelines de documento para LLM. A versão atual é , e o projeto está a evoluir depressa.

Principais recursos:

- Exporta para Markdown, HTML, WebVTT, DocTags e JSON sem perda

- OCR com

- Feito para LangChain, LlamaIndex, CrewAI, Haystack e ecossistemas semelhantes

- Forte crescimento da comunidade

Preços: totalmente gratuito, open source.

Ideal para: Developers que constroem aplicações LLM/RAG e precisam converter PDFs em Markdown estruturado e pronto para IA.

Prós: Saída em Markdown limpa; OCR via integração; feito para fluxos modernos de IA; desenvolvimento ativo.

Contras: Requer código; focado sobretudo em developers; interface gráfica e opções de exportação menos polidas do que as de ferramentas SaaS.

12. Parsio

é um parser SaaS híbrido que combina templates, OCR, parsing com IA e parsing com GPT. Em espírito, fica entre Parseur e Docparser: mais flexível do que zonas puras, mas ainda otimizado para receção recorrente de documentos.

é um parser SaaS híbrido que combina templates, OCR, parsing com IA e parsing com GPT. Em espírito, fica entre Parseur e Docparser: mais flexível do que zonas puras, mas ainda otimizado para receção recorrente de documentos.

Principais recursos:

- OCR integrado

- Deteção de campos assistida por IA

- Integrações com Google Sheets, webhooks, API, Zapier, Make, n8n e Pabbly

Preços: . Starter a US$ 41/mês por 1.000 créditos; Growth a US$ 124/mês; Business a US$ 249/mês. Um documento ou página de PDF processado pode custar 1, 2 ou 5 créditos, dependendo do modo do parser, por isso a estimativa normalizada no plano Starter fica em torno de US$ 41 a US$ 205 por 1.000 páginas.

Ideal para: Equipas pequenas e médias que processam tipos recorrentes de documentos (notas fiscais, recibos) e querem uma solução SaaS no-code com IA leve.

Prós: OCR integrado; ampla cobertura de tipos de documento; stack ampla de automação.

Contras: A profundidade de avaliações de terceiros é limitada; os preços ficam menos transparentes entre os modos de parser; não é tão claramente diferenciado quanto Parseur ou Nanonets.

Comparativo de extração de tabelas: como os melhores PDF Scrapers lidam com tabelas do mundo real

A extração de tabelas é, de longe, o problema mais discutido entre utilizadores de PDF scraper — e com razão. Benchmarks recentes como (1.651 páginas em 10 tipos de documento) e trabalhos académicos sobre confirmam que “extração de tabelas” não é uma tarefa única e uniforme. É um espectro.

Tabelas simples (bordas claras, uma página)

A maioria das ferramentas lida bem com isto. Tabula, Camelot, pdfplumber, Thunderbit e AWS Textract têm bom desempenho aqui. Se os seus PDFs tiverem apenas tabelas simples com bordas, praticamente qualquer ferramenta desta lista funciona.

Tabelas sem borda e com espaços em branco

É aqui que a diferença fica clara. Sem linhas delimitadoras, parsers baseados em regras têm dificuldade em detectar os limites das colunas. O modo stream do Camelot e o ajuste fino de parâmetros do pdfplumber são fortes para developers que conseguem calibrar configurações. Ferramentas com IA como Thunderbit, Nanonets e AWS Textract interpretam o layout visualmente, o que tende a funcionar melhor para não developers que lidam com formatos inconsistentes.

Tabelas que atravessam várias páginas

Um caso de falha muito comum. Ferramentas baseadas em template e extratores simples muitas vezes tratam cada página como uma tabela separada, a menos que o fluxo reconecte isso explicitamente. Ferramentas com IA têm vantagem aqui porque conseguem interpretar continuidade de forma semântica, e não só geométrica — embora nenhuma deva ser tratada como perfeita nesta classe de problema.

Células mescladas e cabeçalhos aninhados

O cenário mais difícil. O relata intervalos de F1 de 74,2 a 96,1, dependendo do método e do cenário. Ferramentas com IA (Thunderbit, Nanonets, AWS Textract) tendem a superar parsers baseados em regras aqui porque interpretam o layout semanticamente, em vez de depender das linhas delimitadoras.

OCR em comparação: quais PDF Scrapers lidam com documentos digitalizados?

OCR é a linha divisória entre ferramentas que conseguem lidar com PDFs reais de negócios e ferramentas que só lidam com documentos ideais, gerados por máquina. Aqui está a matriz:

| Ferramenta | OCR nativo | Suporte a PDF digitalizado | OCR multilingue | Suporte a escrita à mão |

|---|---|---|---|---|

| Thunderbit | ✅ Integrado | ✅ Sim | ✅ 34 idiomas | ⚠️ Limitado |

| Adobe Acrobat | ✅ Integrado | ✅ Sim | ✅ Forte | ⚠️ Limitado |

| AWS Textract | ✅ Integrado | ✅ Sim | ✅ Vários idiomas principais | ✅ O mais próximo, mas imperfeito |

| Nanonets | ✅ Integrado | ✅ Sim | ✅ Mais de 40 idiomas | ⚠️ Limitado |

| Parseur | ✅ Integrado | ✅ Sim | ✅ Mais de 60 idiomas | ❌ Não |

| Parsio | ✅ Integrado | ✅ Sim | ✅ Multilingue | ⚠️ Limitado |

| Docparser | ✅ Integrado | ✅ Sim | ✅ Sim | ⚠️ Limitado |

| Docling | ✅ Via integração | ✅ Sim | Depende do motor | ⚠️ Limitado |

| Tabula | ❌ Nenhum | ❌ Não | N/A | N/A |

| PyMuPDF | ❌ (Tesseract opcional) | ❌ Requer complemento | Depende do motor | Depende do motor |

| Camelot | ❌ Nenhum | ❌ Não | N/A | N/A |

| pdfplumber | ❌ Nenhum | ❌ Não | N/A | N/A |

Nenhuma ferramenta lida de forma fiável com escrita à mão em todos os casos em 2026. O AWS Textract é a API empresarial mais próxima, mas a escrita à mão continua a ser um recurso “use com cautela”. Se os seus PDFs são digitalizados, mas digitados, qualquer ferramenta com OCR integrado serve bem. Se forem manuscritos, mantenha expectativas realistas.

Com IA, com regras ou com templates: três gerações de PDF scraping

A maneira mais fácil de entender o mercado de PDF scraper em 2026 é como três gerações:

Geração 1: Baseada em regras (Tabula, Camelot, pdfplumber)

Funciona melhor em PDFs estruturados, baseados em texto e com layout consistente. São poderosas nas mãos de developers, mas frágeis quando o layout varia. Se os seus documentos forem previsíveis, continuam excelentes — e gratuitas.

Geração 2: Baseada em templates (Parseur, Docparser, Parsio)

Os utilizadores definem zonas ou campos por tipo de documento. Ótimo para formatos recorrentes, como notas fiscais do mesmo fornecedor. O detalhe: cada novo layout ou desvio de layout exige configuração ou manutenção.

Geração 3: Com IA/LLM (Thunderbit, Nanonets, AWS Textract, Docling para pipelines LLM)

A IA lê o documento semanticamente, adapta-se a novos layouts sem templates e consegue rotular e transformar os dados ao mesmo tempo. É para isto que o mercado está a caminhar. A e a apontam para extração baseada em LLMs e agentes como o próximo padrão.

Para utilizadores não técnicos, isto importa na prática: se os seus PDFs vêm de muitas fontes diferentes (fornecedores, parceiros, clientes), ferramentas baseadas em templates tornam-se um custo de manutenção. Ferramentas com IA lidam com a variedade prontas a usar. Esse é o nicho para o qual o Thunderbit foi criado — utilizadores de negócios com PDFs diversos e zero interesse em escrever Python ou manter templates de extração.

Desdobramento de preços: quanto os melhores PDF Scrapers realmente custam

Esta é a comparação que ninguém mais publica, e é a que os utilizadores mais perguntam. Aqui vai a visão honesta:

| Ferramenta | Plano gratuito | Preço inicial pago | Custo estimado por 1.000 páginas | Open source? |

|---|---|---|---|---|

| Thunderbit | ✅ Créditos gratuitos | ~US$ 15/mês (US$ 9/mês no anual) | ~US$ 18–US$ 30 | Não |

| Tabula | ✅ Ilimitado | Grátis para sempre | US$ 0 | Sim |

| Camelot | ✅ Ilimitado | Grátis para sempre | US$ 0 | Sim |

| PyMuPDF | ✅ Ilimitado | Grátis para sempre | US$ 0 | Sim |

| pdfplumber | ✅ Ilimitado | Grátis para sempre | US$ 0 | Sim |

| Docling | ✅ Ilimitado | Grátis para sempre | US$ 0 | Sim |

| Parseur | ⚠️ ~20 páginas/mês | ~US$ 39/mês | ~US$ 390 (menor plano) | Não |

| Nanonets | ⚠️ Créditos no registo | Cobrança por utilização | ~US$ 300–US$ 380 | Não |

| Docparser | ⚠️ Teste de 14 dias | US$ 39/mês | ~US$ 78–US$ 390 | Não |

| Parsio | ⚠️ 30 créditos | US$ 41/mês | ~US$ 41–US$ 205 | Não |

| Adobe Acrobat | ❌ (exportação é paga) | US$ 19,99/mês no Pro | Não cobrado por página | Não |

| AWS Textract | ⚠️ 1.000 páginas/mês (3 meses) | Pague por uso | US$ 1,50–US$ 65 | Não |

A diferença entre custos escondidos importa mais do que o preço de tabela. Ferramentas Python open source são gratuitas em dinheiro, mas custam tempo de desenvolvimento para configurar, manter e depurar. Ferramentas SaaS baseadas em templates são simples quando há pouca variação, mas ficam caras quando o layout muda. Ferramentas no-code com IA, como o Thunderbit, cobram créditos por linha, mas reduzem drasticamente o tempo de configuração. APIs em nuvem como AWS Textract são as mais baratas em escala — mas só quando você já tem engenharia instalada.

Quando penso em “custo real”, incluo o salário de quem está a fazer o trabalho. Uma hora do tempo de um analista de dados a configurar templates ou a escrever Python não é gratuita, mesmo que o software seja.

Qual PDF Scraper você deve escolher?

Aqui vai um guia rápido de decisão:

| A sua situação | Ferramenta(s) recomendada(s) |

|---|---|

| Sem perfil técnico, layouts variados de PDF, quer resultado rápido | Thunderbit, Nanonets |

| Notas fiscais/recibos recorrentes no mesmo formato | Parseur, Docparser, Parsio |

| Developer montando um pipeline de dados | PyMuPDF, Camelot, pdfplumber |

| Empresa, 10.000+ documentos/mês, precisa de API | AWS Textract, Nanonets |

| Construindo aplicação LLM/RAG | Docling |

| Conversão ocasional de PDF para Excel, já usa Adobe | Adobe Acrobat |

| Gratuito, local, focado em tabelas, sem código | Tabula |

Se você é um utilizador de negócios que só quer tirar dados dos PDFs sem escrever código nem montar templates, comece com o Thunderbit. Ele lê cada PDF de raiz com IA e exporta para as ferramentas que você já usa. Se os seus documentos se repetem em layouts reconhecíveis, Parseur ou Docparser são opções melhores. E, se quer controlo de engenharia, a stack open source ainda é o piso de custo.

Conclusão

O PDF scraping em 2026 já não é um problema único com uma resposta única. A ferramenta certa depende de você ser developer, analista de negócios ou equipa empresarial — e de os seus PDFs serem ficheiros de texto organizados ou imagens digitalizadas caóticas vindas de uma dúzia de fornecedores.

Se quiser ver como é a extração de PDF com IA na prática, teste o . Acho que vai ficar surpreendido com o quanto dá para tirar de um PDF em poucos cliques. E, se o Thunderbit não for a opção perfeita, experimente outras desta lista. Nunca houve momento melhor para deixar de copiar e colar PDFs e começar a usar de facto os dados que eles contêm.

Para mais conteúdo sobre extração de dados e automação, consulte os nossos guias sobre , , e . Também pode assistir a tutoriais passo a passo no .

Perguntas frequentes

1. Qual é o melhor PDF scraper gratuito?

Para quem não é developer, o Tabula é a ferramenta GUI totalmente gratuita mais simples para tabelas de PDF baseadas em texto. Para developers, Camelot, pdfplumber, PyMuPDF e Docling são todas boas opções gratuitas. Para uma opção no-code com plano gratuito, o Thunderbit é o melhor ponto de partida.

2. PDF scrapers conseguem lidar com documentos digitalizados?

Só ferramentas com OCR integrado conseguem lidar diretamente com PDFs digitalizados. Isso inclui Thunderbit, Adobe Acrobat, AWS Textract, Nanonets, Parseur, Docparser, Parsio e Docling (com motores de OCR integrados). Tabula, Camelot e pdfplumber não lidam com PDFs digitalizados sozinhos — precisam de ser combinados com OCR externo, como o Tesseract.

3. Quão precisa é a extração de tabelas de PDFs?

Depende muito da complexidade da tabela. A maioria das ferramentas lida bem com tabelas simples com bordas. Tabelas sem borda, células mescladas e tabelas de várias páginas são bem mais difíceis. Ferramentas com IA como Thunderbit, Nanonets e AWS Textract tendem a superar parsers baseados em regras em layouts variados, enquanto ferramentas baseadas em regras ainda podem ser excelentes em PDFs estáveis, baseados em texto.

4. Preciso saber programar para extrair PDFs?

Não. Ferramentas como Thunderbit, Parseur, Docparser, Parsio, Nanonets e Adobe Acrobat podem ser usadas sem programar. O Tabula também tem interface gráfica. Bibliotecas Python como PyMuPDF, Camelot, pdfplumber e Docling exigem código.

5. Posso exportar dados de PDF diretamente para Excel ou Google Sheets?

A maioria das ferramentas suporta exportação para CSV ou Excel, no mínimo. O Thunderbit também exporta diretamente para Google Sheets, Airtable e Notion gratuitamente. Parseur, Docparser e Parsio suportam exportações para fluxos de trabalho de negócios através de integrações como Zapier, webhooks e APIs.

Saiba mais