Quase metade de todo o tráfego da internet hoje já vem de bots. A maioria deles está extraindo links, dados e URLs em escala. Se você ainda faz isso manualmente, está ficando para trás.

Testei 12 ferramentas de extração de links — de extensões do Chrome com IA a bibliotecas em Python — para ver quais realmente entregam quando você precisa extrair milhares de URLs rapidamente.

Foi isso que encontrei.

Por que os extratores de links importam

Vamos ser francos: a web está cheia de dados, e as empresas estão correndo para transformar esse caos em insights acionáveis. e já são essenciais para equipes que querem:

- Gerar leads: equipes de vendas conseguem extrair links de perfis de empresas em diretórios ou no LinkedIn em minutos e depois alimentar esses URLs em ferramentas para obter informações de contato. Chega de cliques intermináveis.

- Agregação de conteúdo e SEO: profissionais de marketing podem reunir todos os URLs de artigos de um blog, monitorar backlinks de concorrentes ou auditar a estrutura do site em busca de links quebrados.

- Monitorar concorrentes e fazer pesquisa de mercado: equipes de operações podem reunir automaticamente links de novos produtos, páginas de preços ou comunicados de imprensa, acompanhando a concorrência sem esforço.

- Automatizar fluxos de trabalho e poupar tempo: os raspadores de links modernos lidam com URLs em lote, navegam por subpáginas e exportam dados em formatos estruturados (CSV, Excel, Google Sheets, Notion, e por aí vai). Isso significa fim das maratonas de copiar e colar e da limpeza de ficheiros de texto confusos.

Tendo em conta que , fazer isso à mão está fora de questão. O extrator de links certo é como ter um assistente turbinado que nunca cansa, nunca deixa passar um link e nunca pede pausa para o café.

Como escolhemos os melhores extratores de links

Com tantas ferramentas no mercado, escolher o extrator de links certo pode parecer um speed-dating numa conferência de tecnologia — toda a gente promete ser “o ideal”, mas poucos realmente entregam. Foi assim que afinei a lista até chegar aos 12 melhores:

- Facilidade de uso: quem não programa consegue usar sem precisar de um PhD em regex? Soluções no-code e low-code ganharam pontos extra.

- Extração em lote e em vários níveis: consegue lidar com centenas de URLs de uma vez? Rastreia subpáginas e segue links automaticamente?

- Exportação e integração: exporta para CSV, Excel, Google Sheets, Notion, Airtable ou via API? Quanto menos trabalho manual, melhor.

- Tipo de utilizador e flexibilidade: é para utilizadores de negócio, analistas ou programadores? Algumas ferramentas são feitas para todos; outras são mais nichadas.

- Funcionalidades avançadas: reconhecimento orientado por IA, agendamento, escala na nuvem, limpeza de dados e modelos para sites comuns.

- Preço e escalabilidade: planos gratuitos, pagamento por uso ou enterprise? Avaliei o que você recebe pelo investimento.

Incluí de tudo, de extensões de navegador a plataformas corporativas. Portanto, seja você um fundador a solo ou uma equipa de dados da Fortune 500, vai encontrar uma opção adequada.

Thunderbit: o extrator de links mais inteligente para usuários de negócios

Vamos começar pelo topo. é a minha principal recomendação para extração de links, e não só porque ajudei a construí-lo. O Thunderbit é uma feita para utilizadores de negócio que querem resultados rápidos.

O que faz o Thunderbit destacar-se? É como ter um estagiário de IA que presta mesmo atenção. Você pode descrever em linguagem natural o que quer (“Capture todos os links e preços dos produtos desta página”), e a IA do Thunderbit faz o resto. Sem mexer em seletores nem escrever scripts.

Mas não fica por aí:

- Suporte a URLs em lote: cole um único URL ou uma lista com centenas — o Thunderbit processa tudo de uma vez.

- Navegação em subpáginas: precisa extrair links de uma página de lista e depois visitar cada página de detalhe para obter mais URLs? A lógica de extração multinível do Thunderbit resolve isso.

- Exportação estruturada: depois que os links forem extraídos, você pode renomear campos, categorizá-los e exportar diretamente para Google Sheets, Notion, Airtable, Excel ou CSV. Adeus, dores de cabeça com pós-processamento.

O Thunderbit tem a confiança de mais de 30.000 usuários no mundo todo, de equipas de vendas a corretores imobiliários e lojas independentes de e-commerce. E sim, há um (extrai até 6 páginas, ou 10 com um impulso de teste), para que você possa experimentar sem risco.

Recursos que fazem o Thunderbit destacar-se

Vamos ver o que realmente diferencia o Thunderbit:

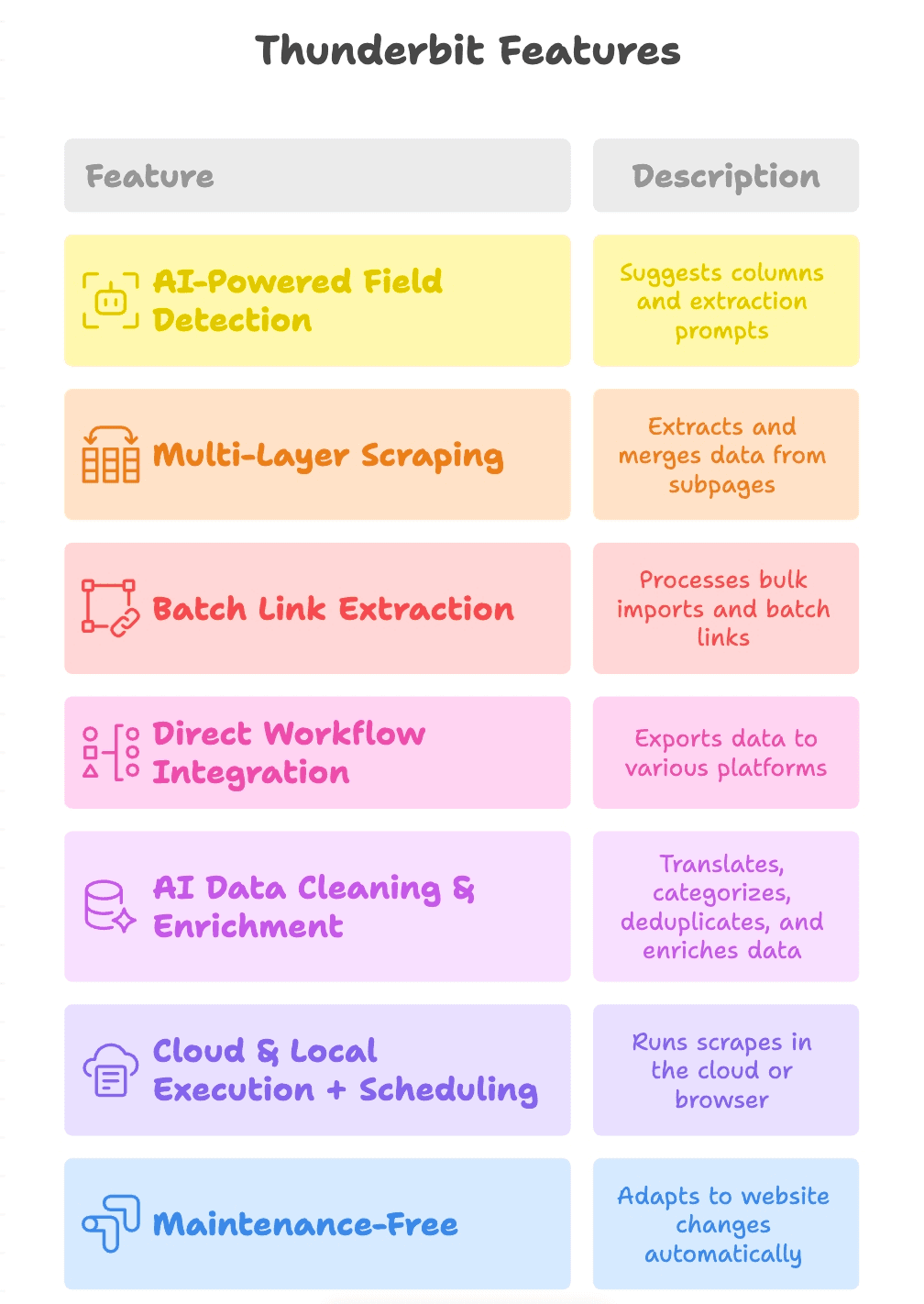

- Detecção de campos com IA: basta clicar em “Sugerir Campos com IA”, e o Thunderbit lê a página, sugere colunas (como “Link do Produto”, “URL do PDF”, “Email de Contato”) e até cria prompts de extração para cada campo.

- Extração multinível: o Thunderbit pode seguir links da página principal para subpáginas (como páginas de detalhes de produto ou downloads em PDF), extrair mais links e juntar tudo numa única tabela.

- Extração em lote de links: seja uma página ou mil, o Thunderbit lida com importações em massa e extração em lote com facilidade.

- Integração direta com o fluxo de trabalho: exporte resultados para Google Sheets, Notion, Airtable ou descarregue em CSV/Excel. Os seus dados chegam exatamente onde a sua equipa precisa.

- Limpeza e enriquecimento de dados com IA: o Thunderbit pode traduzir, categorizar, deduplicar e até enriquecer os seus dados enquanto faz a extração — assim, a saída já fica pronta para uso, e não apenas um despejo bruto.

- Execução na nuvem e local + agendamento: rode extrações na nuvem para ganhar velocidade ou no navegador para sites que exigem login. Programe tarefas recorrentes para manter os seus dados atualizados.

- Sem manutenção: a IA do Thunderbit adapta-se às mudanças do site, então você passa menos tempo a corrigir raspadores quebrados e mais tempo a obter resultados.

Octoparse: raspador de links sem código para todos

é um clássico no mundo da extração sem código. É uma aplicação de desktop (Windows/Mac) com interface visual, de apontar e clicar. Você carrega uma página, clica nos links que quer e o Octoparse faz o resto.

- Ótimo para iniciantes: não precisa programar. É só clicar, extrair e pronto.

- Lida com paginação e conteúdo dinâmico: o Octoparse pode clicar em botões “Próximo”, rolar a página e até fazer login em sites.

- Extração na nuvem e agendamento: os planos pagos permitem correr tarefas na nuvem e agendar execuções recorrentes.

- Opções de exportação: descarregue dados como CSV, Excel, JSON ou envie para bases de dados.

O plano gratuito é generoso para trabalhos pequenos (até 10 tarefas e 50.000 linhas/mês), mas utilizadores mais intensivos vão precisar de um plano pago (a partir de cerca de US$ 75/mês).

Apify: extrator de URL flexível para fluxos personalizados

é o canivete suíço da raspagem web. Ele oferece um marketplace de “actors” prontos (ferramentas de scraping), além da possibilidade de escrever os seus próprios scripts em JavaScript ou Python.

- Pronto a usar e personalizável: use actors da comunidade para tarefas comuns ou crie os seus para fluxos personalizados.

- Extração em lote e agendada: enfileire URLs, execute jobs em paralelo e programe extrações recorrentes.

- API-first: exporte para JSON, CSV, Excel ou Google Sheets e integre no seu pipeline de dados.

- Pagamento por uso: créditos gratuitos todos os meses e, depois, cobrança conforme o uso.

O Apify é ideal para equipas semi-técnicas e desenvolvedores que querem flexibilidade e escalabilidade.

Bright Data URL Scraper: extração de links com padrão enterprise

foi criado para empresas que precisam extrair em grande escala. O Data Collector oferece um URL Scraper predefinido para trabalhos de alto volume.

- Lida com escala massiva: extraia milhares ou milhões de páginas, com uma infraestrutura robusta de proxies para evitar bloqueios.

- Modelos prontos: raspadores prontos para e-commerce, redes sociais, imóveis e muito mais.

- Funcionalidades enterprise: ferramentas de conformidade, suporte especializado e proteção anti-bloqueio avançada.

- Preço: começa em cerca de US$ 350 para 100.000 carregamentos de página — claramente virado para grandes empresas.

Se você é uma startup, isto pode ser demais. Mas, para extração de alto volume e crítica para o negócio, o Bright Data é uma potência.

WebHarvy: extrator visual de links com simplicidade de apontar e clicar

é uma aplicação de desktop (Windows) que permite extrair links simplesmente clicando neles no navegador integrado.

- Super simples: clique num link e o WebHarvy destaca todos os elementos semelhantes para extração.

- Suporte a expressões regulares: padrões embutidos para tarefas comuns, sem necessidade de código.

- Exporta para Excel, CSV, JSON, XML e SQL: ótimo para utilizadores de negócio que querem os dados em formatos familiares.

- Licença única: pague uma vez e use para sempre.

Perfeito para pequenas empresas, pesquisadores ou qualquer pessoa que queira uma forma rápida e descomplicada de obter links sem programar.

Web Scraper (extensão do Chrome): extração rápida de links no navegador

A é uma ferramenta gratuita e open source que transforma o navegador num raspador.

- Defina sitemaps: diga como navegar e o que extrair.

- Lida com paginação e rastreamento multinível: navegue por categorias, subcategorias e páginas de detalhe.

- Exporta para CSV/XLSX: descarregue os dados diretamente do navegador.

- Modelos da comunidade: muitos sitemaps partilhados para sites populares.

É perfeita para trabalhos rápidos e pontuais, ou para estudantes e pequenas equipas com orçamento limitado.

ScraperAPI: raspador de links escalável para desenvolvedores

é para desenvolvedores que querem buscar páginas web em escala sem se preocupar com proxies, bloqueios ou CAPTCHAs.

- Orientado por API: envie um URL e receba HTML ou dados extraídos.

- Lida com escala e medidas anti-bot: rotação de proxy, renderização de JS e resolução de CAPTCHA embutidas.

- Integra com o seu código: use com Python, Node.js ou qualquer linguagem.

- Preço: plano gratuito (~1000 chamadas de API), depois pagamento por requisição.

Ótimo para crawlers personalizados ou quando você precisa de fiabilidade e velocidade em escala.

ParseHub: raspador visual de links com seleção avançada

é uma aplicação de desktop (Windows, Mac, Linux) que permite criar projetos de scraping visualmente.

- Seleção e navegação avançadas: clique, crie loops e extraia links condicionalmente — até de elementos dinâmicos ou ocultos.

- Lida com páginas aninhadas: rastreie categorias, depois páginas de detalhe e, em seguida, extraia mais links.

- Exporta para CSV, Excel e JSON: execuções na nuvem e acesso à API nos planos pagos.

- Plano gratuito: 5 projetos, até 200 páginas por execução.

O ParseHub é um favorito entre profissionais de marketing e pesquisadores que querem potência sem código.

Scrapy: extrator de links em Python para desenvolvedores

é o padrão ouro para desenvolvedores Python que querem controlo total.

- Primeiro o código: crie spiders personalizados para rastrear e extrair links em qualquer escala.

- Lida com rastreamento distribuído: eficiente, assíncrono e altamente customizável.

- Exporta para CSV, JSON, XML ou base de dados: você controla a saída.

- Open source e gratuito: mas você precisará gerir o seu próprio ambiente.

Se você domina Python, o Scrapy é poderoso ao máximo.

Diffbot: raspador de links com IA para dados estruturados

é o “cérebro de IA” da raspagem web. Ele analisa páginas e devolve dados estruturados — incluindo links — sem configuração manual.

- Reconhecimento automático de conteúdo: envie um URL e receba dados estruturados (artigos, produtos, links etc.).

- Crawlbot e Knowledge Graph: rastreie sites inteiros ou consulte o enorme índice da web.

- Orientado por API: integre com as suas ferramentas de BI ou pipeline de dados.

- Preço enterprise: começa em cerca de US$ 299/mês, mas você recebe pelo que paga.

Ideal para empresas que querem dados limpos e estruturados sem gerir raspadores.

Cheerio: raspador de links leve para Node.js

é um parser HTML rápido, estilo jQuery, para Node.js.

- Muito rápido: analisa HTML em milissegundos.

- Sintaxe familiar: se você conhece jQuery, já conhece Cheerio.

- Ótimo para páginas estáticas: não renderiza JS, mas é perfeito para conteúdo renderizado no servidor.

- Open source e gratuito: combine com axios ou fetch para as requisições.

Ideal para desenvolvedores que criam scripts personalizados e querem velocidade e simplicidade.

Puppeteer: automação de navegador para extração avançada de links

é uma biblioteca Node.js para controlar o Chrome em modo headless.

- Automação completa do navegador: carregue páginas, clique, role e interaja como um utilizador real.

- Lida com conteúdo dinâmico e logins: perfeito para sites pesados em JavaScript ou fluxos complexos.

- Controlo refinado: espere por elementos, tire capturas de ecrã e intercepte pedidos de rede.

- Open source e gratuito: mas consome muitos recursos e é mais lento do que ferramentas leves.

Use o Puppeteer quando precisar extrair links de sites que não cooperam com raspadores básicos.

Comparação rápida: qual extrator de links atende às suas necessidades?

Aqui vai uma comparação rápida das 12 ferramentas:

| Ferramenta | Melhor para | Suporte a lote e subpáginas | Opções de exportação de dados | Preço |

|---|---|---|---|---|

| Thunderbit | Não programadores, negócios | Sim (IA, multinível) | Excel, CSV, Sheets, Notion, Airtable | Teste grátis, a partir de ~US$ 9/mês |

| Octoparse | Utilizadores no-code, analistas | Sim | CSV, Excel, JSON, armazenamento na nuvem | Plano gratuito, ~US$ 75/mês |

| Apify | Perfil semi-técnico, devs | Sim | CSV, JSON, Sheets via API | Créditos grátis, cobrança por uso |

| Bright Data | Enterprise | Sim (alto volume) | CSV, JSON, NDJSON via API | ~US$ 350/100 mil páginas |

| WebHarvy | Não programadores, desktop | Sim | Excel, CSV, JSON, XML, SQL | Licença paga |

| Extensão Web Scraper | Qualquer pessoa, rápido/gratuito | Sim | CSV, XLSX | Gratuito, open source |

| ScraperAPI | Desenvolvedores, usuários de API | Sim | JSON (HTML via API) | 1 mil requisições grátis, planos pagos |

| ParseHub | Não programadores, avançado | Sim | CSV, Excel, JSON, API | 5 projetos grátis, pago |

| Scrapy | Devs, Python | Sim | CSV, JSON, XML, BD | Gratuito, open source |

| Diffbot | Enterprise, IA | Sim (rastreamento com IA) | JSON (dados estruturados via API) | ~US$ 299/mês+ |

| Cheerio | Devs, Node.js | Sim (código personalizado) | Personalizado (JSON etc.) | Gratuito, open source |

| Puppeteer | Devs, sites complexos | Sim (automação completa) | Personalizado (saída via script) | Gratuito, open source |

Como escolher o raspador de links certo para sua empresa

Então, como decidir? Aqui vai o meu guia rápido:

- Sem habilidades de programação? Comece com Thunderbit, Octoparse, ParseHub, WebHarvy ou a extensão Web Scraper.

- Precisa de fluxos personalizados? Apify, ScraperAPI ou Cheerio são ótimos para desenvolvedores.

- Escala enterprise? Bright Data ou Diffbot foram feitos para isso.

- Desenvolvedor Python ou Node.js? Scrapy (Python) ou Cheerio/Puppeteer (Node.js) dão controlo total.

- Quer exportação direta para Sheets/Notion? Thunderbit é a melhor escolha.

Combine a ferramenta com o seu nível técnico, volume de dados e necessidades de integração. A maioria oferece teste gratuito, então não tenha medo de experimentar.

O valor único do Thunderbit para extração de links em 2026

Vamos voltar ao que realmente diferencia o Thunderbit:

- Simplicidade com IA: descreva em português simples o que você quer — a IA do Thunderbit trata do resto.

- Extração multinível: extraia links das páginas principais, siga para subpáginas e capture mais URLs — tudo num único fluxo.

- Importação em massa e processamento em lote: cole centenas de URLs, extraia links em lote e exporte dados estruturados instantaneamente.

- Integração ao fluxo de trabalho: exporte diretamente para Google Sheets, Notion, Airtable ou descarregue em CSV/Excel.

- Manutenção zero: a IA do Thunderbit adapta-se às mudanças do site, então você não fica constantemente a corrigir raspadores quebrados.

O Thunderbit faz a ponte entre “apenas extrair dados” e “obter dados que realmente dá para usar”. É a ferramenta que eu gostaria de ter tido anos atrás, quando estava afundado em tarefas manuais de dados.

Conclusão: extraia links com mais inteligência e melhore o seu fluxo de trabalho

Os dados da web são o combustível do crescimento dos negócios — e o extrator de links certo é o seu motor. Seja para criar listas de leads, monitorar concorrentes ou automatizar pesquisas, há aqui uma ferramenta que atende às suas necessidades e ao seu nível técnico.

Se quiser ver como é a extração moderna de links, . Acho que você vai ficar surpreendido com o tanto que dá para fazer em poucos cliques. E, se o Thunderbit não for a combinação perfeita, experimente algumas outras opções desta lista — nunca houve melhor momento para automatizar o trabalho chato e focar no que realmente importa.

Boa extração — e que os seus links estejam sempre limpos, estruturados e prontos para a ação. Se quiser aprofundar-se em raspagem web, confira o para mais guias e dicas.

Perguntas frequentes

1. Por que os extratores de links são essenciais?

Com quase metade do tráfego da internet vindo de bots e empresas a extrair dados de forma agressiva, os extratores de links são vitais para transformar o caos da web em insights acionáveis. Eles ajudam a automatizar tarefas como geração de leads, agregação de conteúdo, auditorias de SEO e monitorização de concorrentes, poupando muito tempo e esforço.

2. O que faz o Thunderbit destacar-se entre outros extratores de links?

O Thunderbit usa IA para simplificar a extração — basta descrever o seu objetivo em linguagem natural, e ele faz o resto. Ele oferece entrada em lote de URLs, extração multinível, deteção inteligente de campos e exportação fluida para plataformas como Google Sheets e Notion. É ideal para quem não programa e para utilizadores de negócio que querem resultados poderosos sem complicação técnica.

3. Existem ferramentas de extrator de links adequadas para desenvolvedores e fluxos personalizados?

Sim. Ferramentas como Apify, ScraperAPI, Cheerio, Puppeteer e Scrapy atendem desenvolvedores. Elas oferecem scripting, integração via API e flexibilidade para lidar com tarefas complexas de scraping, trabalhos em grande escala e automação avançada.

4. Quais ferramentas são melhores para usuários sem experiência em programação?

Thunderbit, Octoparse, ParseHub, WebHarvy e a extensão Web Scraper Chrome são as melhores opções para utilizadores não técnicos. Essas ferramentas oferecem interfaces visuais, modelos prontos e recursos orientados por IA que tornam a extração de links acessível a todos.

5. Como devo escolher o extrator de links certo para minhas necessidades?

Considere as suas habilidades técnicas, volume de dados e necessidades de exportação. Quem não programa deve optar por ferramentas como Thunderbit ou Octoparse, enquanto desenvolvedores podem preferir Scrapy ou Puppeteer. Empresas podem avaliar Bright Data ou Diffbot para operações em larga escala. Comece sempre com um teste gratuito para ver o que funciona melhor.