A web já não é apenas um parquinho digital — é o maior armazém de dados do mundo, e toda a gente, de equipas de vendas a analistas de mercado, está a correr para tirar partido disso. Mas sejamos honestos: tentar reunir dados da web manualmente é tão divertido como montar móveis da IKEA sem instruções (e com o dobro dos parafusos a sobrar).

À medida que as empresas dependem cada vez mais de inteligência de mercado em tempo real, preços competitivos e geração de leads, a necessidade de ferramentas eficientes e fiáveis de coleta de dados nunca foi tão grande. Na verdade, quase para tomar decisões, e o mercado global de web scraping deverá .

Se está cansado de copiar e colar, de perder leads novos ou simplesmente quer ver o que é possível quando deixa a automação fazer o trabalho pesado, está no sítio certo. Passei anos a construir e a testar ferramentas de extração web (e, sim, a liderar a equipa da ), por isso sei em primeira mão como a ferramenta certa pode transformar horas de trabalho braçal num processo de dois cliques, sem esforço. Quer seja alguém sem programação à procura de resultados imediatos, quer seja um developer que quer controlo total, esta lista com as 10 melhores ferramentas de coleta de dados vai ajudar a encontrar a opção ideal.

Porque é que escolher bem as suas ferramentas de coleta de dados importa

Vamos ser diretos: a diferença entre uma boa ferramenta de coleta de dados e uma mediana não é só conveniência — é um atalho para o crescimento do negócio. Quando automatiza a extração web, não está apenas a poupar tempo (embora um avaliador da G2 tenha dito que poupava ), está também a reduzir erros, a abrir novas oportunidades e a garantir que a sua equipa trabalha sempre com os dados mais recentes e precisos. A pesquisa manual é lenta, propensa a falhas e, muitas vezes, já está desatualizada quando termina. Com a ferramenta certa, pode monitorizar concorrentes, acompanhar preços ou montar listas de leads em minutos — não em dias.

Um exemplo concreto: uma retalhista de beleza usou web scraping para monitorizar o stock e os preços da concorrência, . Esse é o tipo de impacto que simplesmente não consegue com folhas de cálculo e força bruta.

Como avaliámos as melhores ferramentas de coleta de dados

Com tantas opções por aí, escolher a ferramenta certa pode parecer um speed dating numa conferência de tecnologia. Veja os critérios que usei para separar as melhores das restantes:

- Facilidade de utilização: Dá para começar sem um PhD em Python? Há interface visual ou assistência de IA para quem não programa?

- Capacidades de automação: Lida com paginação, subpáginas, conteúdo dinâmico e agendamento? Pode correr na nuvem para tarefas grandes?

- Preço e escalabilidade: Existe um plano grátis ou uma opção inicial acessível? Como é que o custo cresce à medida que as suas necessidades de dados aumentam?

- Conjunto de funcionalidades e integração: Dá para exportar para Excel, Google Sheets ou via API? Há modelos, agendamento ou limpeza de dados integrada?

- Ideal para quem: Para quem é que a ferramenta foi realmente pensada — utilizadores de negócios, developers ou equipas corporativas?

Incluí uma tabela comparativa rápida no final para ver como cada ferramenta se comporta.

Agora, vamos mergulhar nas 10 melhores ferramentas de coleta de dados para extração web eficiente em 2026.

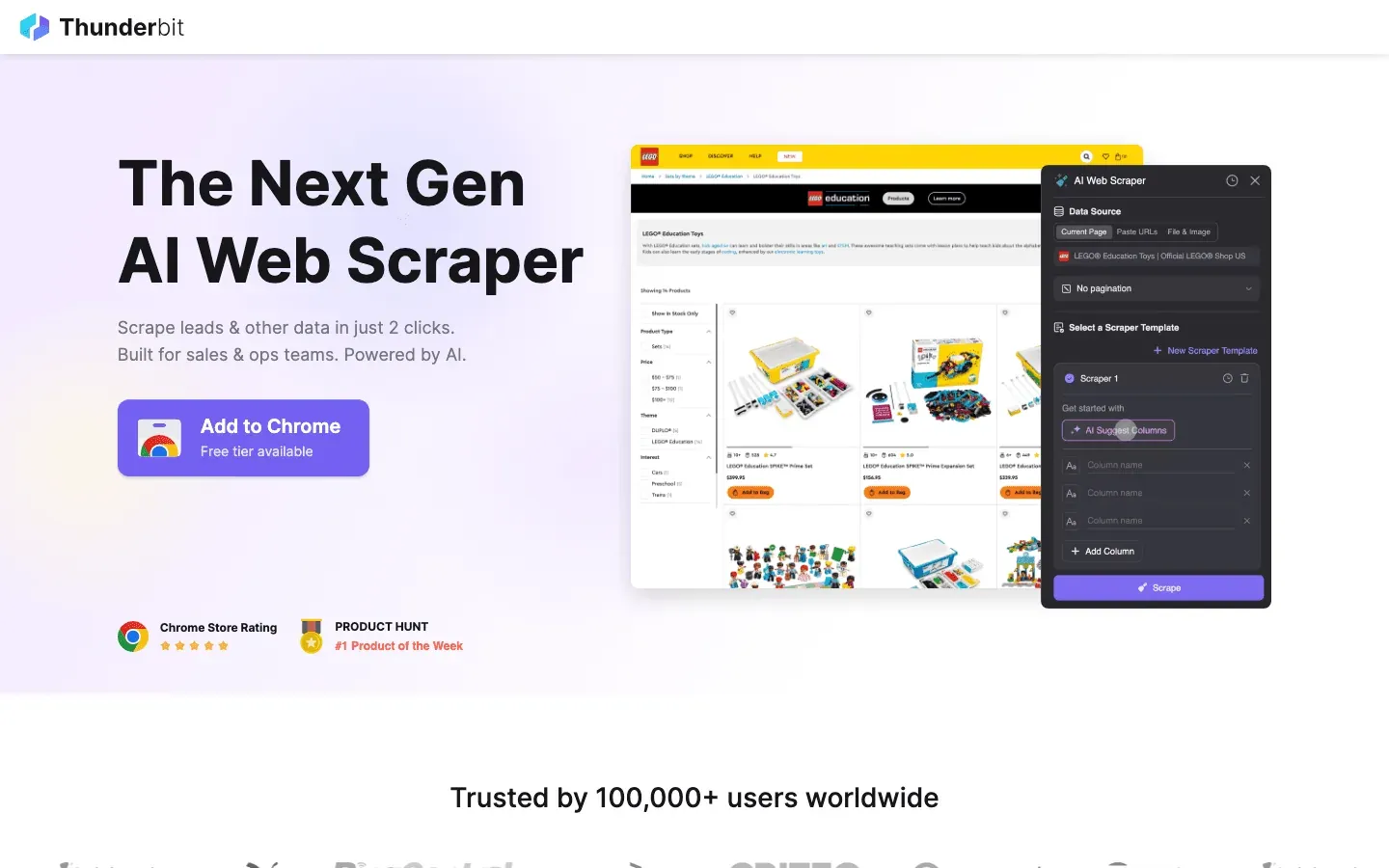

1. Thunderbit

é a minha recomendação principal para quem quer que a coleta de dados seja tão fácil como pedir comida em casa. Criada como uma extensão do Chrome com IA, a Thunderbit aposta em scraping em 2 cliques: basta clicar em “AI Suggest Fields” e deixar a IA descobrir o que está na página, depois clicar em “Scrape” para capturar os dados. Sem código, sem mexer em seletores — só resultado imediato.

é a minha recomendação principal para quem quer que a coleta de dados seja tão fácil como pedir comida em casa. Criada como uma extensão do Chrome com IA, a Thunderbit aposta em scraping em 2 cliques: basta clicar em “AI Suggest Fields” e deixar a IA descobrir o que está na página, depois clicar em “Scrape” para capturar os dados. Sem código, sem mexer em seletores — só resultado imediato.

O que torna a Thunderbit uma favorita entre equipas de vendas, marketing e ecommerce? Foi pensada para fluxos de trabalho de negócio reais:

- AI Suggest Fields: a IA lê a página e recomenda as melhores colunas para extrair — nomes, preços, e-mails, o que precisar.

- Extração de subpáginas: precisa de mais detalhes? A Thunderbit pode visitar automaticamente cada subpágina (como páginas de produto ou perfis do LinkedIn) e enriquecer a sua tabela.

- Exportação instantânea: envie os dados diretamente para Excel, Google Sheets, Airtable ou Notion. Todas as exportações são grátis.

- Modelos com um clique: para sites populares (Amazon, Zillow, Instagram), use modelos prontos para resultados ainda mais rápidos.

- Exportação de dados grátis: não há paywall para tirar os seus dados da ferramenta.

- Extração agendada: configure tarefas recorrentes em inglês simples (“toda segunda-feira às 9h”) — perfeito para monitorização de preços ou atualização semanal de leads.

A Thunderbit usa um sistema de créditos (1 crédito = 1 linha), com um para até 6 páginas (ou 10 com bónus de teste). Os planos pagos começam em US$15/mês para 500 créditos, o que a torna acessível para equipas de qualquer dimensão.

Se quiser ver a Thunderbit em ação, veja o nosso ou o . É a ferramenta que eu gostava de ter tido quando estava afundado em introdução manual de dados.

2. Octoparse

é uma potência no mundo da coleta de dados, especialmente para equipas corporativas que precisam de capacidade a sério. Oferece uma interface visual para desktop (Windows e Mac) onde pode criar fluxos de extração com ponto e clique — sem precisar de programar. Mas não se deixe enganar pela interface amigável: por baixo do capô, a Octoparse lida com logins, scroll infinito, proxies rotativos e até resolução de CAPTCHA.

é uma potência no mundo da coleta de dados, especialmente para equipas corporativas que precisam de capacidade a sério. Oferece uma interface visual para desktop (Windows e Mac) onde pode criar fluxos de extração com ponto e clique — sem precisar de programar. Mas não se deixe enganar pela interface amigável: por baixo do capô, a Octoparse lida com logins, scroll infinito, proxies rotativos e até resolução de CAPTCHA.

- Mais de 500 modelos prontos: comece depressa com modelos para Amazon, Twitter, LinkedIn e muito mais.

- Scraping na nuvem: execute tarefas nos servidores da Octoparse, agende trabalhos e escale projetos grandes.

- Acesso via API: integre os dados extraídos diretamente nas suas aplicações ou bases de dados.

- Automação avançada: lida com conteúdo dinâmico, paginação e fluxos de trabalho em várias etapas.

O plano grátis cobre 10 tarefas mais um generoso limite mensal de exportação de 50.000 linhas, por isso é um plano a sério — não é apenas uma amostra. Os planos pagos começam em US$69/mês no Standard (faturação anual; cerca de US$82/mês no pagamento mensal) e US$249/mês no Professional. A curva de aprendizagem é mais acentuada do que na Thunderbit, mas, se precisa de extrair milhares de páginas com fiabilidade e quer execução na nuvem, a Octoparse continua a ser uma das opções mais consolidadas que merecem uma análise séria. Preço verificado em em 2026-05-13.

3. Scrapy

é o padrão de ouro para developers que querem controlo total sobre os seus projetos de coleta de dados. É um framework Python de código aberto que permite programar spiders personalizados (crawlers) para qualquer site. Se consegue imaginar, consegue construir com Scrapy.

é o padrão de ouro para developers que querem controlo total sobre os seus projetos de coleta de dados. É um framework Python de código aberto que permite programar spiders personalizados (crawlers) para qualquer site. Se consegue imaginar, consegue construir com Scrapy.

- Programabilidade total: escreva código Python para definir exatamente como rastrear e interpretar qualquer site.

- Assíncrono e rápido: processa milhares de páginas em paralelo para projetos em grande escala.

- Extensível: adicione middleware para proxies, navegadores sem interface ou lógica personalizada.

- Comunidade forte: imensos tutoriais, plugins e apoio para cenários de scraping mais difíceis.

O Scrapy é gratuito e de código aberto, mas exige conhecimento de programação. Se tem uma equipa técnica ou quer criar um pipeline personalizado, é difícil bater o Scrapy. Para quem não programa, porém, a curva é íngreme.

4. ParseHub

é uma ferramenta visual de web scraping sem código, perfeita para quem não programa e enfrenta sites complexos. A interface de ponto e clique permite selecionar elementos, definir ações e montar fluxos de extração — até em sites com conteúdo dinâmico ou navegação complicada.

é uma ferramenta visual de web scraping sem código, perfeita para quem não programa e enfrenta sites complexos. A interface de ponto e clique permite selecionar elementos, definir ações e montar fluxos de extração — até em sites com conteúdo dinâmico ou navegação complicada.

- Construtor visual de fluxos: clique para selecionar dados, configurar paginação e lidar com pop-ups ou menus suspensos.

- Lida com conteúdo dinâmico: funciona com sites pesados em JavaScript e páginas interativas.

- Execução na nuvem e agendamento: corra extrações na nuvem e agende tarefas recorrentes.

- Exportação para CSV, Excel ou via API: integração fácil com as suas ferramentas favoritas.

O ParseHub oferece um plano grátis (5 projetos), com planos pagos a partir de . É um pouco mais caro do que alguns concorrentes, mas a abordagem visual torna-o acessível para analistas, profissionais de marketing e investigadores que precisam de mais do que uma simples extensão do Chrome.

5. Apify

é ao mesmo tempo uma plataforma e um marketplace para web crawling. Oferece uma enorme biblioteca de “Actors” prontos (scrapers prontos a usar) para sites populares, além da possibilidade de criar e executar os seus próprios crawlers personalizados na nuvem.

é ao mesmo tempo uma plataforma e um marketplace para web crawling. Oferece uma enorme biblioteca de “Actors” prontos (scrapers prontos a usar) para sites populares, além da possibilidade de criar e executar os seus próprios crawlers personalizados na nuvem.

- Mais de 5.000 Actors prontos: extraia dados de Google Maps, Amazon, Twitter e muito mais de imediato.

- Programação personalizada: developers podem usar JavaScript ou Python para criar crawlers avançados.

- Escala na nuvem: execute tarefas em paralelo, agende trabalhos e faça a gestão de dados na nuvem.

- API e integração: ligue os resultados às suas apps, fluxos de trabalho ou pipelines de dados.

A Apify oferece US$5 em crédito grátis para começar, depois passa para Starter por US$29/mês, Scale por US$199/mês e Business por US$999/mês — cada nível é “crédito da plataforma + pagamento conforme o uso pelas unidades de computação”, por isso o uso é mesmo o que dita a conta. Há alguma curva de aprendizagem, mas, se quer tanto Actors prontos a usar como a possibilidade de escrever os seus próprios crawlers em JS ou Python, a Apify é uma das opções mais fortes desta lista. Preço verificado em em 2026-05-13.

6. Data Miner

é uma extensão do Chrome criada para coleta rápida de dados baseada em modelos. É perfeita para utilizadores de negócio que querem capturar dados de tabelas ou listas sem qualquer configuração.

é uma extensão do Chrome criada para coleta rápida de dados baseada em modelos. É perfeita para utilizadores de negócio que querem capturar dados de tabelas ou listas sem qualquer configuração.

- Biblioteca enorme de modelos: mais de mil receitas para sites comuns (LinkedIn, Yelp etc.).

- Extração por ponto e clique: selecione um modelo, visualize os dados e exporte na hora.

- Baseado no navegador: funciona com a sua sessão atual — ótimo para extrair dados atrás de logins.

- Exportação para CSV ou Excel: leve os seus dados para uma folha de cálculo em segundos.

O cobre 500 páginas/mês, com planos pagos a partir de US$20/mês. É melhor para tarefas pequenas e pontuais ou quando precisa dos dados na hora — só não espere que dê conta de trabalhos massivos ou automação complexa.

7. Import.io

é uma plataforma de nível corporativo para organizações que precisam de integração contínua e fiável de dados da web. É mais do que um crawler — é um serviço gerido que entrega dados limpos e estruturados diretamente nos sistemas da sua empresa.

é uma plataforma de nível corporativo para organizações que precisam de integração contínua e fiável de dados da web. É mais do que um crawler — é um serviço gerido que entrega dados limpos e estruturados diretamente nos sistemas da sua empresa.

- Extração sem código: configuração visual para definir que dados recolher.

- Fluxos de dados em tempo real: envie dados para dashboards, ferramentas de análise ou bases de dados.

- Conformidade e fiabilidade: lida com rotação de IP, medidas anti-bot e conformidade legal.

- Serviços geridos: a equipa da Import.io pode configurar e manter os seus scrapers.

O preço é , com teste grátis de 14 dias para a plataforma SaaS. Se o seu negócio depende de dados da web sempre atualizados (pense em retalho, finanças ou pesquisa de mercado), vale a pena considerar a Import.io.

8. WebHarvy

é um scraper para desktop, feito para utilizadores de Windows que querem uma solução de ponto e clique sem assinatura. É especialmente popular entre pequenas empresas e pessoas que preferem uma compra única.

é um scraper para desktop, feito para utilizadores de Windows que querem uma solução de ponto e clique sem assinatura. É especialmente popular entre pequenas empresas e pessoas que preferem uma compra única.

- Deteção visual de padrões: clique nos elementos de dados e o WebHarvy deteta automaticamente padrões repetidos.

- Lida com texto, imagens e mais: extrai todos os tipos comuns de dados, incluindo e-mails e URLs.

- Paginação e agendamento: navegue por sites com várias páginas e configure extrações agendadas.

- Exportação para Excel, CSV, XML, JSON ou SQL: saída flexível para qualquer fluxo de trabalho.

Uma licença individual custa , o que o torna uma escolha económica para uso frequente — só tenha em conta que é exclusivo para Windows.

9. Mozenda

é uma plataforma de coleta de dados baseada na nuvem, criada para operações de negócio e necessidades contínuas de dados. Combina um designer de desktop (Windows) com execução e automação poderosas na nuvem.

é uma plataforma de coleta de dados baseada na nuvem, criada para operações de negócio e necessidades contínuas de dados. Combina um designer de desktop (Windows) com execução e automação poderosas na nuvem.

- Construtor visual de agentes: desenhe rotinas de extração com uma interface de ponto e clique.

- Escala na nuvem: execute vários agentes em paralelo, agende tarefas e faça a gestão dos dados de forma centralizada.

- Console de gestão de dados: combine, filtre e limpe conjuntos de dados após a extração.

- Suporte corporativo: gestores de conta dedicados e serviços geridos para equipas grandes.

O plano Pilot self-service da Mozenda custa US$500/mês (5.000 créditos de processamento, 10 agentes, 10 GB de armazenamento), e o plano Enterprise é sob consulta. Há também um nível Trial grátis de 14 dias com 500 créditos para quem quiser testar antes de fechar. A Mozenda é ideal para empresas que querem dados web fiáveis e recorrentes integrados nas operações diárias — o preço é real e a plataforma espera ser levada a sério. Preço verificado em em 2026-05-13.

10. BeautifulSoup

é a biblioteca clássica em Python para analisar HTML e XML. Não é um crawler completo, mas é muito apreciada por developers para projetos pequenos e personalizados de scraping.

é a biblioteca clássica em Python para analisar HTML e XML. Não é um crawler completo, mas é muito apreciada por developers para projetos pequenos e personalizados de scraping.

- Análise simples de HTML: extraia dados de páginas estáticas com facilidade.

- Funciona com Python Requests: combine com outras bibliotecas para obter e rastrear páginas.

- Flexível e leve: perfeita para scripts rápidos ou projetos educativos.

- Comunidade enorme: imensos tutoriais e respostas no Stack Overflow.

A BeautifulSoup é , mas vai precisar de escrever código e de lidar com a lógica de rastreamento por conta própria. É melhor para developers ou aprendizes que querem perceber a fundo como o web scraping funciona.

Tabela comparativa: ferramentas de coleta de dados em resumo

| Ferramenta | Facilidade de uso | Nível de automação | Preço | Opções de exportação | Ideal para |

|---|---|---|---|---|---|

| Thunderbit | Muito fácil, sem código | Alto (IA, subpáginas) | Teste grátis, a partir de US$15/mês | Excel, Sheets, Airtable, Notion, CSV | Vendas, marketing, ecommerce, quem não programa |

| Octoparse | Moderada, interface visual | Muito alto, nuvem | Grátis, US$83–US$299/mês | CSV, Excel, JSON, API | Empresas, equipas de dados, sites dinâmicos |

| Scrapy | Baixa (exige Python) | Alto (personalizável) | Grátis, código aberto | Qualquer uma (via código) | Developers, projetos personalizados em grande escala |

| ParseHub | Alta, visual | Alto (sites dinâmicos) | Grátis, a partir de US$189/mês | CSV, Excel, JSON, API | Quem não programa, estruturas web complexas |

| Apify | Moderada, flexível | Muito alto, nuvem | Grátis, US$29–US$999/mês | CSV, JSON, API, armazenamento na nuvem | Developers, empresas, Actors prontos ou personalizados |

| Data Miner | Muito fácil, no navegador | Baixo (manual) | Grátis, US$20–US$99/mês | CSV, Excel | Extrações rápidas e pontuais, conjuntos pequenos |

| Import.io | Moderada, gerida | Muito alto, corporativo | Personalizado, baseado em volume | CSV, JSON, API, integração direta | Empresas, integração contínua de dados |

| WebHarvy | Alta, desktop | Médio (agendamento) | US$129 pagamento único | Excel, CSV, XML, JSON, SQL | PMEs, utilizadores Windows, scraping frequente |

| Mozenda | Moderada, visual | Muito alto, nuvem | US$250–US$450+/mês | CSV, Excel, JSON, nuvem, BD | Operações corporativas contínuas e em grande escala |

| BeautifulSoup | Baixa (exige Python) | Baixo (código manual) | Grátis, código aberto | Qualquer uma (via código) | Developers, aprendizes, scripts pequenos e personalizados |

Como escolher a ferramenta certa de coleta de dados para a sua equipa

Escolher a melhor ferramenta de coleta de dados não é encontrar a “mais poderosa” — é encontrar a que melhor se adapta às competências, necessidades e orçamento da sua equipa. O meu conselho rápido é este:

- Quem não programa ou utilizadores de negócio: comece com Thunderbit, ParseHub ou Data Miner para resultados imediatos e configuração simples.

- Necessidades corporativas ou em grande escala: considere Octoparse, Mozenda ou Import.io para automação, agendamento e suporte.

- Developers ou projetos personalizados: Scrapy, Apify ou BeautifulSoup oferecem controlo total e flexibilidade.

- Orçamento apertado ou tarefas pontuais: WebHarvy (Windows) ou Data Miner (navegador) são económicos e simples.

Teste sempre as suas principais opções com uma avaliação gratuita nos sites-alvo reais — o que funciona num site pode não funcionar noutro. E não se esqueça da integração: se precisa dos dados em Sheets, Notion ou numa base de dados, certifique-se de que a ferramenta suporta isso de forma nativa.

Conclusão: desbloquear valor de negócio com as melhores ferramentas de coleta de dados

Os dados da web são o novo petróleo, mas só se tiver a máquina certa para os extrair e refinar. Com ferramentas modernas de coleta de dados, pode transformar horas de pesquisa manual em minutos de insights automatizados — impulsionando vendas mais inteligentes, marketing mais preciso e operações mais ágeis. Quer esteja a montar listas de leads, a acompanhar concorrentes ou simplesmente cansado de copiar e colar, existe uma ferramenta nesta lista que pode tornar a sua vida muito mais fácil.

Por isso, veja as necessidades da sua equipa, teste algumas destas ferramentas e descubra quanto mais pode fazer quando deixa a automação fazer o trabalho pesado. E, se quiser ver como é o scraping com IA em 2 cliques, . Boa coleta — e que os seus dados estejam sempre frescos, estruturados e prontos para a ação.

Perguntas frequentes

1. O que é uma ferramenta de coleta de dados e por que preciso de uma?

Uma ferramenta de coleta de dados automatiza o processo de extração de informação de sites. Poupa tempo, reduz erros e ajuda equipas a reunir dados atualizados para vendas, marketing, pesquisa e operações — de forma muito mais eficiente do que copiar e colar manualmente.

2. Qual ferramenta de coleta de dados é melhor para utilizadores sem conhecimentos técnicos?

Thunderbit, ParseHub e Data Miner são excelentes opções para quem não programa. A Thunderbit destaca-se pelo fluxo de trabalho com IA em 2 cliques, enquanto o ParseHub oferece uma abordagem visual para sites mais complexos.

3. Como os modelos de preço diferem entre as ferramentas de coleta de dados?

Os preços variam bastante: algumas ferramentas (como Thunderbit e Data Miner) oferecem planos grátis e opções mensais acessíveis, enquanto plataformas corporativas (como Import.io e Mozenda) usam preços personalizados ou baseados em volume. Verifique sempre se o custo da ferramenta está alinhado com a sua necessidade de dados.

4. Posso usar estas ferramentas para extração contínua e agendada de dados?

Sim — ferramentas como Thunderbit, Octoparse, Apify, Mozenda e Import.io suportam extrações agendadas ou recorrentes, tornando-as ideais para monitorização contínua de preços, geração de leads ou pesquisa de mercado.

5. O que devo considerar antes de escolher uma ferramenta de coleta de dados?

Considere as competências técnicas da sua equipa, a complexidade dos sites que precisa de rastrear, o volume de dados, as necessidades de integração e o orçamento. Teste algumas ferramentas com tarefas reais antes de subscrever um plano pago.

Para mais análises aprofundadas e guias práticos, veja o .

Saiba mais