Uma busca no GitHub por "amazon scraper" retorna cerca de . Se você filtrar para repositórios com push nos últimos seis meses, esse número cai para cerca de — pouco mais de 20%. O restante? Tutoriais abandonados, wrappers desatualizados e scripts que pararam de funcionar no momento em que a Amazon reforçou suas defesas.

Passei bastante tempo vasculhando repositórios de Amazon scraper, lendo issues no GitHub e acompanhando discussões da comunidade no Reddit e no Stack Overflow. O padrão é consistente: alguém encontra um repositório popular, gasta uma hora configurando tudo, roda uma vez e bate numa parede de CAPTCHAs ou erros 503. A postura anti-bot da Amazon em 2026 já não é a mesma de nem dois anos atrás — fingerprinting de TLS, análise comportamental e uso agressivo de CAPTCHAs tornaram o velho manual de "trocar user agents e torcer pelo melhor" praticamente inútil. Este guia cobre as melhores práticas que realmente importam se você quer obter dados confiáveis da Amazon a partir de um repositório do GitHub e o que fazer quando, não se, o seu scraper quebrar.

O que é um Amazon Scraper no GitHub (e por que tantos falham)?

Um repositório de Amazon scraper no GitHub costuma ser um script open-source — geralmente em Python, Node.js ou baseado em Scrapy — que extrai dados estruturados de páginas da Amazon. Os alvos de dados são bem conhecidos: título do produto, preço, ASIN, avaliações, contagem de reviews, disponibilidade, informações do vendedor, cards de resultados de busca e texto de avaliações.

A arquitetura costuma ser simples:

- Um cliente HTTP ou browser headless busca a página.

- Um parser de HTML ou JSON extrai os campos.

- Os dados são salvos em CSV, JSON ou em um banco de dados.

Os repositórios normalmente se dividem em quatro grupos:

- Bibliotecas Python leves (por exemplo, )

- Spiders de Scrapy (por exemplo, )

- Automatizadores de navegador com Selenium ou Playwright

- Projetos de wrapper de API que, na prática, são interfaces para um serviço comercial de extração de dados (por exemplo, )

O padrão de falha é previsível. A maioria dos repositórios quebra porque:

- A Amazon muda o layout da página ou trechos de HTML

- A Amazon responde com 503 ou CAPTCHA em vez de conteúdo real

- O fingerprint de TLS e HTTP do scraper deixa de parecer o de um navegador

- Divergências de localidade, idioma ou headers geram suspeita

- O mantenedor segue em frente depois de resolver seu caso de uso original e restrito

Muitos stars e "atualmente utilizável" são coisas bem diferentes. Na auditoria que fiz para este artigo, apenas cerca de três entre oito repositórios amplamente encontrados pareciam claramente ativos em 2026.

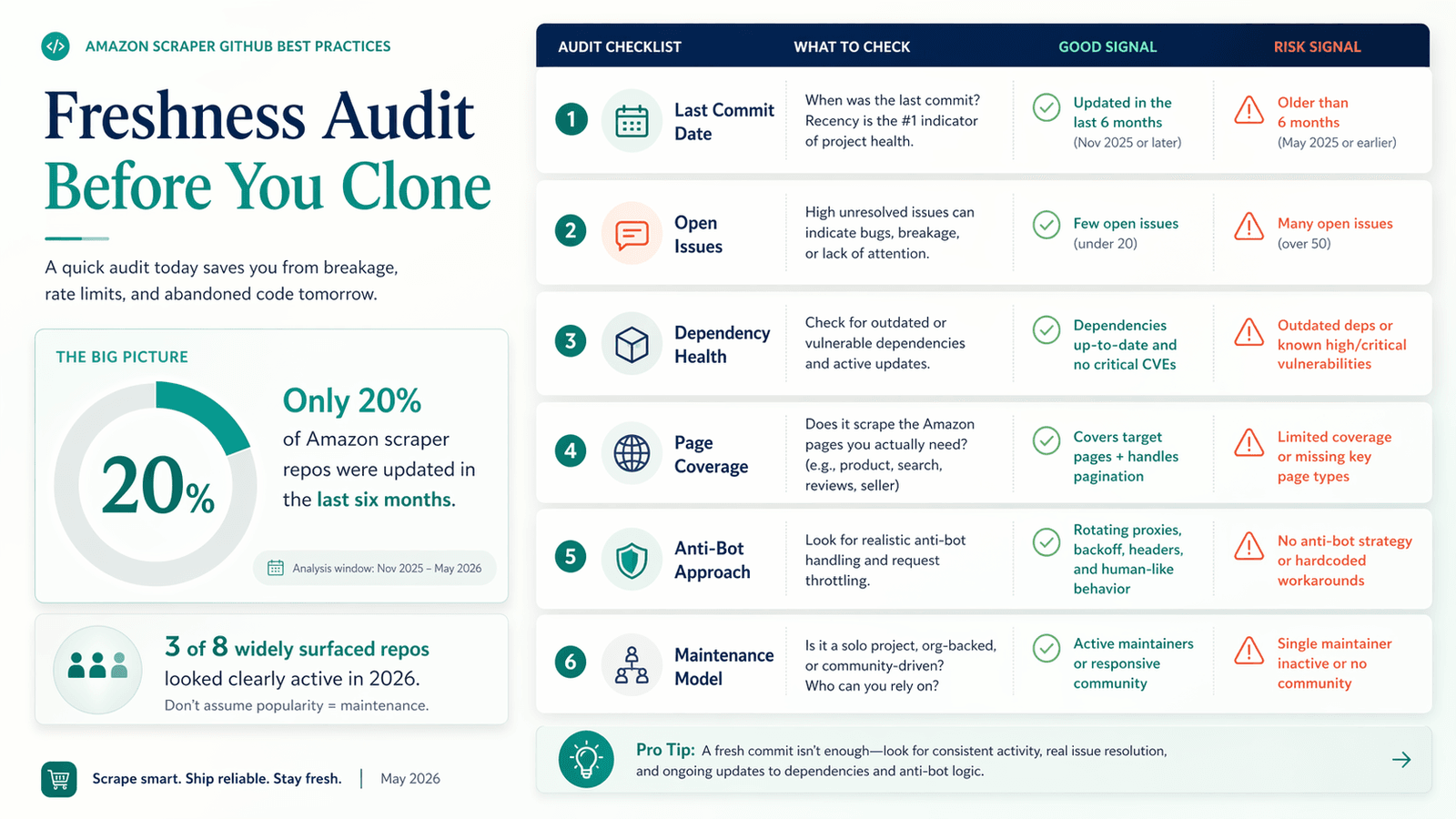

Faça uma auditoria de atualização de 2026 antes de clonar qualquer repositório Amazon Scraper do GitHub

Esse passo importa mais para a Amazon do que para a maioria dos outros alvos. A postura defensiva da Amazon muda mais rápido do que a de um site de e-commerce típico, então um repositório que funciona bem em um site institucional pode se tornar inútil na Amazon em poucas semanas. Mesmo assim, muitas listas de "best amazon scraper github" recomendam repositórios sem verificar se ainda funcionam. Os usuários perdem horas configurando ferramentas quebradas.

Como verificar se um repositório do GitHub ainda está vivo

Antes de fazer git clone de qualquer coisa, passe por estas verificações:

- Data do último commit: qualquer coisa com mais de 6 meses é um grande sinal de alerta na Amazon.

- Issues abertas vs. taxa de resposta: procure na aba Issues por "captcha", "503", "blocked" e "not working". Se esses relatos se acumularem sem resposta do mantenedor, desista.

- Saúde das dependências: abra

requirements.txtoupackage.json. Bibliotecas desatualizadas (por exemplo,requestsantigo sem tratamento moderno de TLS) são sinal vermelho. - Cobertura de tipos de páginas da Amazon: o repositório lida com páginas de produto, resultados de busca e reviews? Ou só com um tipo?

- Abordagem anti-bot: headers fixos sem suporte a proxy são uma abordagem de 2023 que não sobrevive a 2026.

Lista de verificação de atualização do Amazon Scraper no GitHub

| Sinal de atualização | O que verificar | Sinal de alerta 🚩 |

|---|---|---|

| Data do último commit | Feed de commits ou data de push do repositório | Mais de 6 meses |

| Issues abertas | Aba Issues — filtrar por "captcha", "503", "blocked" | Quebras repetidas sem resposta do mantenedor |

| Saúde das dependências | requirements.txt / package.json | Bibliotecas desatualizadas, sem estratégia moderna de TLS |

| Cobertura de páginas da Amazon | README + exemplos de código | Só lida com um tipo de página (por exemplo, produto, mas não busca ou reviews) |

| Abordagem anti-bot | Código-fonte, configuração de proxy | Apenas headers e strings de UA fixos |

| Modelo de manutenção | É um scraper de verdade, um tutorial ou um wrapper de API comercial? | O repositório é, na prática, apenas uma interface para um serviço pago |

O que a auditoria realmente encontrou

Analisei oito repositórios de Amazon scraper amplamente encontrados com base nesses critérios. Os resultados são um banho de realidade:

| Repositório / Ferramenta | Stars | Sinal do último commit | Escopo | Status em 2026 | Observações |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Wrapper de API gerenciada para scraping | Vivo, mas não é DIY | Atualizado, mas isso é, na prática, uma interface para um serviço gerenciado |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API gerenciada para busca, detalhes, reviews | Vivo, mas não é DIY | Boa cobertura, mas é um produto de API, não um scraper bruto |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Biblioteca Python leve | Vivo | O scraper direto do GitHub mais claro usando curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Apenas reviews | Limitado, mas utilizável | Antigo e muito específico para avaliações |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Último commit em 2023; repositório com push em 2024-08-20 | Spiders de Scrapy + middleware de proxy | Nível tutorial, envelhecido | Útil para aprender, não para uma stack pronta em 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI em Node para busca, detalhes, reviews | Alto risco | Cobertura ampla, mas a manutenção é antiga demais |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Busca para CSV | Morto para 2026 | Popular no passado, claramente desatualizado |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Tutorial de busca/produto | Morto para 2026 | Efetivamente um arquivo histórico |

As issues públicas contam a mesma história. tem uma issue intitulada "All requests receive captcha response." tem "Doesn't seem to be working." O scraper do tem "Bypass Amazon protection." Não são casos de borda obscuros — são os primeiros problemas que os usuários encontram.

O manual anti-bloqueio: como evitar bloqueios com um Amazon Scraper do GitHub

Ser bloqueado é o principal ponto de dor para qualquer pessoa usando um projeto de amazon scraper github. Conselhos genéricos como "use proxies e rotacione user agents" já não bastam. A pilha anti-bot da Amazon em 2025-2026 inclui fingerprinting de TLS, análise comportamental e implantação agressiva de CAPTCHAs. Você precisa de uma abordagem em camadas.

Correspondência de fingerprint TLS: por que o requests puro pode te banir

Essa é uma das técnicas anti-bloqueio mais negligenciadas. O fingerprinting de TLS funciona assim: quando seu script abre uma conexão segura com a Amazon, o servidor consegue saber muita coisa sobre o cliente pela forma como ele "aperta a mão" — os cipher suites oferecidos, a ordem das extensões, as configurações de HTTP/2. Navegadores usam configurações de TLS e HTTP/2 relativamente fixas, e essas combinações podem ser identificadas por técnicas como .

requests puro e configurações comuns de httpx podem copiar headers, mas não copiam o comportamento de TLS e HTTP/2 do Chrome. A Amazon percebe a diferença.

resolve isso diretamente. Ele oferece impersonação de navegador — os alvos suportados incluem chrome136, safari184 e firefox133 — para que o fingerprint TLS do seu cliente HTTP corresponda ao de um navegador real. A documentação alerta explicitamente contra a geração de strings JA3 aleatórias: fingerprints de navegador são em grande parte fixos por versão, e aleatoriedade inventada é mais fácil de detectar do que um fingerprint real copiado.

Os dados da comunidade batem com isso. Um confirma que o argumento impersonate é útil porque alterna perfis de navegador e mantém os headers alinhados. Outro observa que a Amazon bloqueia clientes com base no fingerprint TLS "depois de cerca de um ou dois meses." Um pergunta especificamente se a Amazon está fazendo fingerprint de python-requests (spoiler: sim).

Se você ainda usa requests puro como cliente principal para Amazon, mude essa premissa antes de atualizar qualquer outra coisa.

Rotação de proxy do jeito certo (e não apenas "use proxies")

O objetivo dos proxies não é rotacionar o máximo possível. O objetivo é fazer as sessões parecerem críveis.

Residential vs. datacenter: proxies de datacenter são mais baratos, mas mais fáceis de detectar. Proxies residential custam mais, mas são muito mais difíceis de a Amazon sinalizar. O começa em US$ 4,00/GB no pay-as-you-go, caindo para US$ 3,50/GB em planos maiores. O começa em US$ 6/GB. A Amazon se encaixa na categoria de "alvo sofisticado", em que proxies residential valem o prêmio.

Rotação por requisição vs. por sessão: aqui é onde a maioria dos tutoriais erra. Rotacionar proxies a cada requisição mantendo cookies e headers constantes pode parecer menos humano, não mais. O padrão mais seguro:

- Mantenha a navegação busca → produto → review na mesma sessão sticky quando possível

- Troque de sessão ao iniciar uma nova jornada de busca, e não a cada requisição

- Rotacione entre sessões, e não aleatoriamente dentro de uma única sessão de navegação

Um observou que IPs comuns de ISP não se saíam nem de longe tão bem quanto IPs móveis em sites populares de e-commerce. Outro relatou bloqueio mesmo com user agents rotativos e proxies residential — um bom lembrete de que proxies sozinhos não bastam.

Ritmo de requisições, backoff e limitação de taxa

As páginas 503 da Amazon não são azar aleatório. São feedback.

Um sobre scraping de mais de 500 ASINs relatou um 503 sempre no mesmo ponto, por volta do ASIN 101, mesmo com pausas. O padrão é antigo, mas a lição continua atual: volume bruto a partir de um único IP ou fingerprint acaba acionando as defesas.

Melhores práticas de ritmo para scrapers DIY do GitHub:

- Atrasos aleatórios entre requisições (não intervalos fixos, que são detectáveis)

- 2 a 5 segundos entre requisições públicas de produto para clientes HTTP simples

- Exponential backoff depois de 503 ou CAPTCHA — recue progressivamente em vez de tentar de novo imediatamente

- Menor concorrência do que você acha que precisa

- Logs fail-open em vez de loops apertados de retry

A maioria dos repositórios de amazon scraper github não traz limitação de taxa embutida. Você terá de adicionar isso manualmente.

Orquestração de headers: muito mais do que strings de User-Agent

A Amazon verifica o conjunto completo de headers, não apenas o User-Agent.

Um conjunto de headers realista de navegador deve incluir:

User-AgentAcceptAccept-LanguageAccept-Encoding- dicas

Sec-CH-*quando apropriado - comportamento de conexão consistente com o perfil de navegador escolhido

Os headers devem corresponder à localidade do marketplace. Um descobriu que a mesma configuração de bot só era detectada em algumas localidades, com outro comentarista apontando headers relacionados à região, como Accept-Language.

A regra: headers, perfil de TLS/navegador e geografia do proxy não podem se contradizer. Não envie headers de Chrome com um UA de Firefox. Não use proxy dos EUA com Accept-Language: de-DE.

Tratamento de CAPTCHA: quando resolver e quando recuar

Encontrar um CAPTCHA significa que a Amazon já está desconfiada. Resolvido ou não, isso não zera sua pontuação de confiança.

Para eventos isolados e pouco frequentes de CAPTCHA:

- O pacote PyPI é um resolvedor de CAPTCHA de texto da Amazon em puro Python, embora o último release seja de maio de 2023 — trate-o como ferramenta tática, não como estratégia durável

- O lista CAPTCHA da Amazon a US$ 0,45 por 1.000 resoluções

Para loops repetidos de CAPTCHA:

- Pare de tentar resolver e comece a recuar

- CAPTCHAs repetidos significam que a sessão foi queimada — resolvê-los não reconstrói a confiança no fingerprint, no histórico da sessão ou na reputação do IP

- Se os CAPTCHAs se agrupam por subnet de proxy, o problema é a camada de rede, não o parser

Quando você realmente precisa de um browser headless — e quando isso é exagero

A intuição errada é rodar Playwright para tudo.

Casos bons para usar browser:

- Resultados de busca que dependem de renderização JavaScript ou estado sensível à localidade

- Fluxos de review que redirecionam para páginas de login

- Fluxos em que cookies e contexto do navegador importam mais do que velocidade bruta

Casos ruins para usar browser:

- Páginas públicas comuns de produto

- Extração estática de detalhes de produto em que um cliente HTTP com aparência de navegador já basta

- Recuperação em massa em larga escala, quando eficiência computacional importa

Comece pelo cliente mais leve que funcionar. Um sobre scraping em escala descreveu a progressão: comece com requests, depois curl_cffi e só vá para um browser completo quando as opções mais leves falharem. Browsers headless são materialmente mais lentos e consomem mais recursos do que clientes HTTP para scraping de páginas de produto da Amazon.

Matriz de decisão anti-bloqueio para projetos Amazon Scraper no GitHub

| Cenário | Abordagem recomendada | Por quê |

|---|---|---|

| Páginas públicas de produto (pequena escala) | curl_cffi + sessão residential sticky | Caminho mais barato que ainda parece um navegador |

| Páginas de resultados de busca | Primeiro curl_cffi, Playwright só se a renderização ou o estado quebrarem o HTTP | A busca é mais sensível a estado e localidade |

| Reviews (exigem login) | Modo navegador com cookies/sessão reais | Login e fluxos dinâmicos de review são mais difíceis de emular em HTTP puro |

| Grande escala (5 mil+ por dia) | API de scraping gerenciada, unlocker ou plataforma no-code | Código DIY do GitHub sozinho vira um problema de infraestrutura |

Quando o seu projeto Amazon Scraper no GitHub quebrar: tenha um plano B sem código

Todo scraper experiente mantém um Plano B.

As atualizações da Amazon inevitavelmente quebrarão qualquer repositório do GitHub no pior momento possível. Para equipes de e-commerce, um scraper quebrado significa perder mudanças de preço, dados de concorrentes desatualizados e lacunas em dashboards.

Muita gente que pesquisa "amazon scraper github" na verdade são usuários de negócio — operações de e-commerce, marketing, pesquisadores de FBA — que tentaram soluções com código porque não encontraram opções melhores. Os dados de fóruns também mostram frustração real com a oficial da Amazon: acesso restritivo, dados limitados e que muitos vendedores não conseguem cumprir.

Por que os scrapers da Amazon no GitHub precisam de manutenção constante

A auditoria acima deixa isso claro:

- Repositórios desatualizados acumulam relatos de falhas sem correções

- Repositórios "funcionando" agora falam abertamente de medidas anti-bot no README

- Discussões da comunidade giram cada vez mais em torno de fingerprints de TLS, loops de CAPTCHA e qualidade de proxy — não de seletores CSS

Para usuários de negócio, esse custo de manutenção é o verdadeiro custo oculto. O repositório é gratuito. O seu tempo depurando isso às 2h da manhã não é.

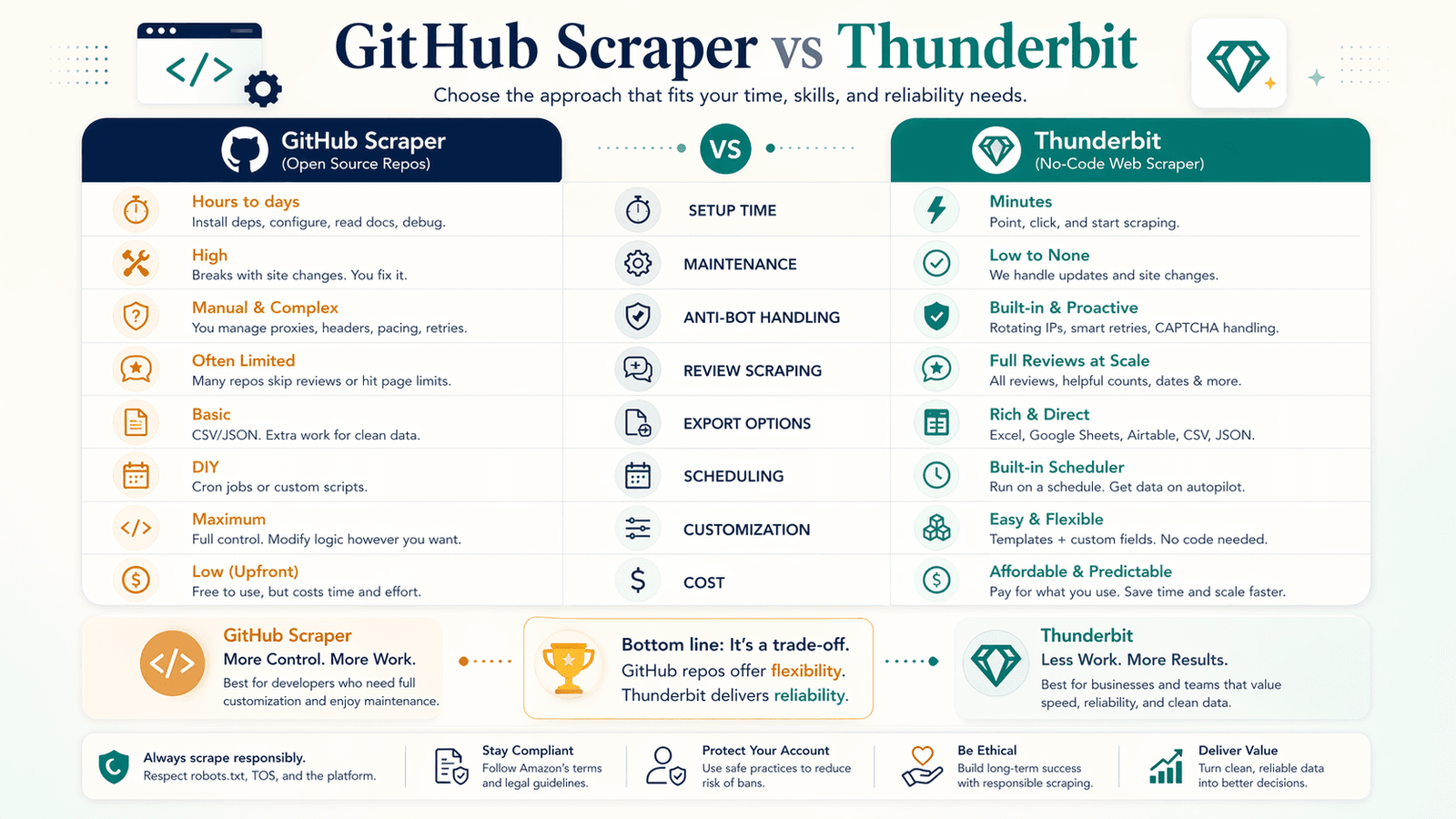

Thunderbit como uma alternativa prática de Amazon Scraper

oferece um que extrai título, preço, ASIN, avaliações, marca, disponibilidade, origem do envio e URL original — sem escrever código.

Na prática, isso significa:

- Scraping em 2 cliques em vez de configurar ambientes Python, dependências e proxies

- Modelo pronto para Amazon — sem overhead de IA, só extração com 1 clique

- Modo de scraping no navegador para páginas que exigem login (como páginas de reviews que frustram usuários de scrapers do GitHub)

- Scraping na nuvem para páginas públicas de produto em alta velocidade (50 páginas por vez)

- Exportação gratuita para Google Sheets, Airtable, Notion, Excel — não apenas CSV/JSON

- Scraper agendado para monitoramento contínuo de preços

- IA que se adapta a mudanças de layout — sem custo de manutenção para você

GitHub Amazon Scraper vs. Thunderbit: comparação honesta

| Fator | Scraper do GitHub (ex.: AmzPy) | Thunderbit |

|---|---|---|

| Tempo de configuração | 15–60 min (Python, dependências, proxies) | ~2 min (instalar a extensão do Chrome) |

| Manutenção | Você corrige as quebras | A IA se adapta a mudanças de layout |

| Tratamento anti-bot | DIY (proxies, headers, TLS) | Integrado (modos cloud + navegador) |

| Scraping de reviews (logado) | Gerenciamento de sessão complexo | Modo de scraping no navegador |

| Exportação de dados | Apenas CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Agendamento | DIY (cron, Airflow etc.) | Scraper agendado embutido |

| Personalização | Maior | Menor |

| Custo | Gratuito (mais custos com proxy) | Plano gratuito disponível; baseado em créditos |

A troca honesta: repositórios do GitHub oferecem mais personalização; o Thunderbit oferece mais confiabilidade. Se a sua equipe valoriza uptime acima de flexibilidade, o caminho no-code costuma ser a escolha mais racional.

Melhores práticas para scraping agendado e recorrente da Amazon

A maioria dos projetos de amazon scraper github é construída para execuções pontuais, mas casos reais de negócio — monitoramento de preços, acompanhamento de estoque, análise de concorrentes — exigem extrações recorrentes. Repositórios do GitHub quase nunca incluem agendamento nativo, forçando os usuários a montar cron jobs, Airflow ou fluxos no n8n.

Agendamento DIY para scrapers Amazon do GitHub

A configuração recorrente mínima viável:

- Cron job no Linux ou macOS para executar o script em um horário definido

- Logs append-only para depurar falhas depois

- Deduplicação por ASIN + timestamp para não armazenar dados duplicados

- Alertas de falha (até um e-mail simples em caso de saída não zero) para saber quando uma execução quebra às 3h da manhã

Para equipes mais complexas:

- n8n para automação leve de workflows (muito citado em discussões da comunidade)

- Airflow para pipelines agendados mais pesados

- Estado persistido em banco de dados se você precisa de diffs e histórico

A melhor prática principal não é o scheduler em si — é o gerenciamento de estado. Acompanhe a última execução bem-sucedida, o último conjunto de ASINs, preços alterados e URLs com erro.

Agendamento simplificado com Thunderbit

O do Thunderbit permite descrever o intervalo em linguagem natural, inserir URLs e clicar em "Agendar". A IA converte linguagem natural em um cron schedule — sem configuração técnica. Para equipes de e-commerce sem engenharia monitorando preços ou lançamentos de produtos concorrentes, isso reduz de forma significativa o atrito operacional.

Melhores práticas para extrações recorrentes da Amazon

Estas valem independentemente da ferramenta usada:

- Deduplicate por ASIN + janela de timestamp — não salve o mesmo produto duas vezes por execução

- Armazene preços como números, não como strings brutas — facilita a limpeza depois

- Adicione timestamps de extração a cada linha — você vai precisar deles para análise de tendências

- Acompanhe deltas, não apenas o estado atual — "o preço caiu 12% desde a semana passada" é mais útil do que "o preço é US$ 24,99"

- Alerta para mudanças significativas — uma redução de 15% no preço de um concorrente merece notificação; uma oscilação de 0,5% é ruído

- Pense no armazenamento de dados — arquivos planos funcionam para execuções pequenas; para 5 mil+ ASINs por dia, considere um banco de dados ou uma planilha na nuvem

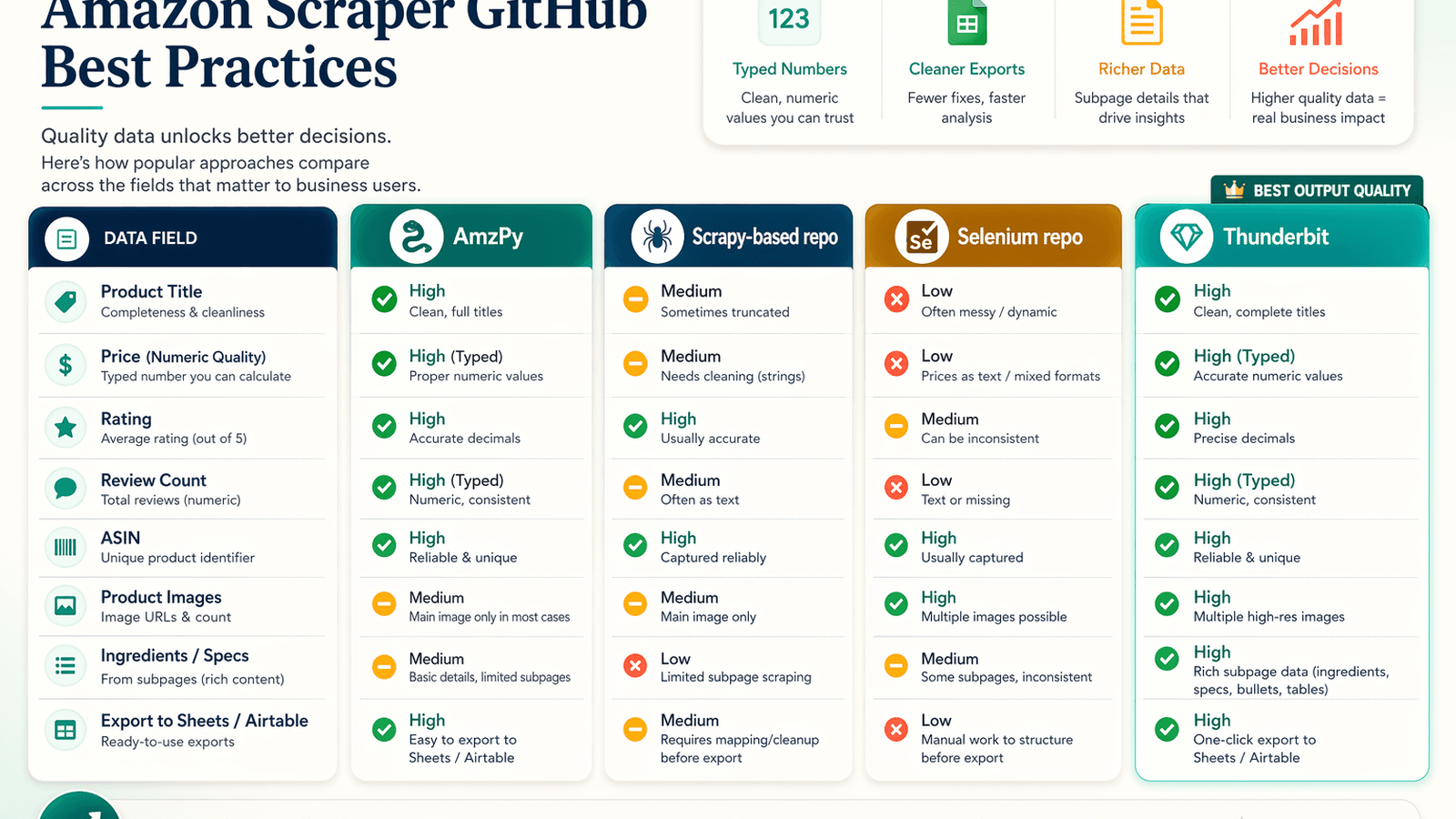

Qualidade de saída lado a lado: o que cada abordagem de Amazon Scraper do GitHub realmente retorna

Ninguém compara a qualidade real de saída entre repositórios de amazon scraper github. Os usuários se importam profundamente com a qualidade dos dados — "qual ferramenta entrega os dados mais limpos e completos" — mas precisam clonar e testar cada repositório por conta própria. Esta seção preenche essa lacuna.

O que os repositórios populares do GitHub realmente extraem — e o que deixam passar

Com base em amostras do README, exemplos públicos e formatos de saída documentados:

| Abordagem | O que extrai claramente | Lacunas / trade-offs comuns |

|---|---|---|

| amzpy | Título, preço, moeda, URL da imagem, avaliações, reviews, variantes, ASIN | Voltado a páginas de produto; menos rico em seções completas de reviews/especificações |

| tducret/amazon-scraper-python | CSV com título, avaliação, contagem de reviews, URL do produto, URL da imagem, ASIN | Desatualizado, focado em listings, história anti-bot fraca |

| python-scrapy-playbook scraper | Resultados de busca, páginas de produto, reviews, pipelines CSV/JSON | Nível tutorial; depende de middleware de proxy externo; provavelmente exige mais limpeza |

| omkarcloud/amazon-scraper | Busca, categoria, detalhes, principais reviews, muitas imagens/vídeos/especificações | Não é um scraper bruto — é um serviço de API gerenciada |

| Thunderbit Amazon template | Título, preço, ASIN, marca, avaliação, reviews, disponibilidade, origem do envio, enriquecimento de subpágina | Menos controle em nível de código do que scripts personalizados |

Tabela de comparação da qualidade de saída

| Campo de dados | AmzPy | Repositório baseado em Scrapy | Repositório Selenium | Thunderbit |

|---|---|---|---|---|

| Título do produto | ✅ | ✅ | ✅ | ✅ |

| Preço (numérico) | ⚠️ string | ✅ | ⚠️ string | ✅ (tipo numérico) |

| Avaliação | ✅ | ✅ | ✅ | ✅ |

| Contagem de reviews | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Imagens do produto | ❌ | ⚠️ apenas miniatura | ✅ | ✅ (alta resolução, exportável) |

| Ingredientes/especificações | ❌ | ❌ | ❌ | ✅ (via scraping de subpáginas + IA) |

| Exportação para Sheets/Airtable | ❌ | ❌ | ❌ | ✅ grátis |

Por que a formatação dos dados importa para usuários de negócio

Dados bagunçados criam trabalho oculto. Mesmo um scraper bem-sucedido pode ser um fracasso operacional se:

- Os preços forem strings com símbolos de moeda em vez de números limpos

- Valores ausentes forem inconsistentes (string vazia vs. null vs. "N/A")

- As imagens forem apenas miniaturas de baixa resolução

- Campos de reviews ou especificações precisarem de pós-processamento antes da análise

Para equipes de operações de e-commerce, dados limpos impactam diretamente a velocidade de análise e a tomada de decisão. A IA do Thunderbit formata os dados por tipo — números como números, datas como datas, URLs como URLs — para que fiquem prontos para uso imediato. Os repositórios do GitHub variam muito nesse ponto, e o tempo de limpeza soma rápido.

Referência rápida: checklist de melhores práticas para Amazon Scraper no GitHub

- Verifique a data do último commit antes de clonar. Mais de seis meses é um forte sinal de alerta na Amazon.

- Pesquise issues por "captcha", "503", "blocked" e "not working" antes de configurar.

- Prefira

curl_cffiou outro cliente HTTP que imite navegador em vez derequestspuro. - Mantenha headers, perfil de TLS, idioma e geografia do proxy consistentes — sem contradições.

- Use sessões sticky para fluxos de navegação; não rotacione a cada requisição sem critério.

- Adicione ritmo aleatório e exponential backoff.

- Trate CAPTCHAs repetidos como uma sessão queimada, não como um quebra-cabeça para brute force.

- Use browsers headless apenas quando clientes HTTP não conseguirem reproduzir a página de forma confiável.

- Armazene checkpoints e estado para que execuções falhas possam continuar com segurança.

- Tenha um plano de fallback — seja uma API gerenciada ou uma ferramenta no-code como .

Considerações legais e éticas para scraping da Amazon em 2026

Alguns pontos importantes, de forma breve.

A postura da Amazon é restritiva e está ficando ainda mais. Os sinais mais fortes:

- As próprias páginas de ajuda da Amazon agora retornam uma dizendo: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- O da Amazon bloqueia uma ampla gama de caminhos dinâmicos, de reviews, perfil, wishlist e listings de ofertas.

- A se opõe explicitamente a acesso de agentes disfarçados ou encobertos, à contornação de medidas de segurança e a identificar um agente falsamente como Google Chrome. A Amazon também sobre o incidente.

- A Amazon contra crawlers da OpenAI no fim de 2025.

O risco prático é claramente maior quando você sai de páginas públicas de produto e vai para fluxos autenticados, automação disfarçada ou extração comercial em alto volume. Isto não é aconselhamento jurídico — consulte sua equipe jurídica para o seu caso específico.

Principais conclusões: como obter dados confiáveis da Amazon sem ser bloqueado

Em ordem de importância:

- Audite antes de clonar. Parta do princípio de que a maioria dos resultados do GitHub está desatualizada, é tutorial ou é wrapper de APIs comerciais.

- Atualize primeiro sua camada de rede. Fingerprinting de TLS e coerência de sessão importam mais do que seletores HTML.

- Use sessões residential sticky, não caos aleatório de proxies. Rotacione entre sessões, não dentro delas.

- Faça o ritmo das requisições parecer humano, não um teste de estresse. Atrasos aleatórios e exponential backoff são inegociáveis.

- Resolva CAPTCHAs isolados; aposente sessões que sofreram bloqueio repetidamente. Não force brute um fingerprint queimado.

- Tenha um fallback. A Amazon vai mudar alguma coisa no meio da semana, e o seu scraper do GitHub vai quebrar. Uma ferramenta no-code mantida, como , ou uma API gerenciada pode manter sua pipeline viva enquanto você depura.

- Priorize a qualidade da saída. Dados limpos e tipados economizam mais tempo no restante do fluxo do que um scraper rápido, mas bagunçado.

Se você quer confiabilidade em vez de personalização, o Thunderbit oferece uma alternativa mantida — confira o ou assista aos tutoriais no . Desenvolvedores que querem controle total podem usar repositórios do GitHub sem problema — mas apenas com as práticas anti-bloqueio e de manutenção abordadas neste guia.

Perguntas frequentes

É legal fazer scraping de dados de produtos da Amazon com um scraper do GitHub?

Os Termos de Serviço da Amazon restringem a coleta automatizada de dados, e a empresa vem aplicando isso ativamente por meio de cartas de cease-and-desist e contramedidas técnicas (especialmente em 2025-2026). Fazer scraping de dados públicos de produtos fica numa área cinzenta; fazer scraping atrás de login ou disfarçar seu bot como um navegador real traz risco maior. Isto não é aconselhamento jurídico — consulte sua equipe jurídica para o seu caso específico.

Com que frequência os repositórios Amazon scraper do GitHub quebram?

Com frequência. A Amazon altera layouts de páginas, adiciona novas camadas anti-bot e descontinua endpoints regularmente. Na auditoria deste artigo, apenas cerca de 3 entre 8 repositórios amplamente encontrados pareciam claramente funcionais em 2026. Mesmo repositórios "funcionando" costumam ter issues abertas sobre CAPTCHAs e erros 503. Espere precisar depurar ou atualizar sua configuração a cada poucas semanas ou meses.

Qual é o melhor Amazon scraper no GitHub em 2026?

Não existe um único vencedor — depende do seu caso de uso e do seu conforto técnico. Para um scraper Python leve e direto, é uma das opções mais atuais. Para cobertura mais ampla via API gerenciada, funciona, mas não é realmente DIY. Aplique o checklist de atualização deste artigo para avaliar qualquer repositório antes de se comprometer.

O Thunderbit consegue raspar a Amazon sem codificar?

Sim. O do Thunderbit extrai título do produto, preço, ASIN, avaliações, marca, disponibilidade e muito mais com um único clique. Ele oferece modo de scraping no navegador para páginas com login, scraping na nuvem para páginas públicas em alta velocidade, scraping agendado para tarefas recorrentes e exportação gratuita para Google Sheets, Airtable, Notion e Excel. Você pode começar instalando a .

Como evitar que meu IP seja banido ao fazer scraping da Amazon?

Use uma abordagem em camadas: (1) troque o requests puro por um cliente que imita TLS, como curl_cffi, (2) use proxies residential com sessões sticky em vez de rotação aleatória de datacenter, (3) adicione ritmo aleatório e exponential backoff, (4) mantenha todo o conjunto de headers consistente com seu perfil de navegador e a localidade do marketplace, e (5) trate CAPTCHAs repetidos como um sinal para aposentar a sessão, não como um quebra-cabeça para resolver indefinidamente. Para mais detalhes, veja a matriz de decisão anti-bloqueio mais acima neste artigo.