Nettsiden er full av verdifulle data — enten du jobber med salg, netthandel eller markedsundersøkelser, er web scraping et hemmelig våpen for leadgenerering, prisovervåking og konkurranseanalyse. Men her er utfordringen: Etter hvert som flere virksomheter tar i bruk scraping, slår nettstedene hardere tilbake enn noen gang. Faktisk bruker over , og er nå blitt normalen. Har du noen gang sett et Python-script kjøre smertefritt i 20 minutter — før du plutselig møter en vegg av 403-feil — vet du hvor frustrerende det er.

Jeg har jobbet mange år med SaaS og automasjon, og jeg har sett på nært hold hvordan scraping-prosjekter kan gå fra «wow, dette er enkelt» til «hvorfor blir jeg blokkert overalt?» på et øyeblikk. Så la oss være praktiske: Jeg skal vise deg hvordan du gjør web scraping uten å bli blokkert i Python, dele de beste teknikkene og kodeeksemplene, og vise når det er på tide å vurdere AI-drevne alternativer som . Enten du er en Python-proff eller bare prøver å komme i mål med scraping-arbeidet, får du her et verktøysett for pålitelig datautvinning uten blokkeringer.

Hva betyr web scraping uten å bli blokkert i Python?

Kjernen i web scraping uten å bli blokkert er å hente data fra nettsteder på en måte som ikke utløser anti-bot-forsvaret deres. I Python-verdenen handler dette om mer enn å skrive en requests.get()-løkke — det handler om å gli inn, etterligne ekte brukere og ligge ett skritt foran deteksjonssystemene.

Hvorfor Python? — takket være enkel syntaks, et enormt økosystem (tenk: requests, BeautifulSoup, Scrapy, Selenium) og fleksibilitet til alt fra raske scripts til distribuerte crawlere. Men populariteten har en pris: mange anti-bot-systemer er nå finjustert for å oppdage Python-baserte scraping-mønstre.

Så hvis du vil scrape på en pålitelig måte, må du gå lenger enn det grunnleggende. Det betyr å forstå hvordan nettsteder oppdager boter, og hvordan du kan være smartere enn dem — uten å krysse noen etiske eller juridiske grenser.

Hvorfor det er viktig å unngå blokkeringer i Python-prosjekter for web scraping

Å bli blokkert er ikke bare en teknisk bagatell — det kan velte hele forretningsprosesser. La oss bryte det ned:

| Bruksområde | Konsekvens av å bli blokkert |

|---|---|

| Leadgenerering | Ufullstendige eller utdaterte prospektlister, tapte salg |

| Prisovervåking | Går glipp av konkurrentenes prisendringer, dårlige prisbeslutninger |

| Innholdsaggregasjon | Hull i nyheter, anmeldelser eller forskningsdata |

| Markedsinnsikt | Blinde flekker i sporing av konkurrenter eller bransje |

| Eiendomsannonser | Unøyaktige eller utdaterte eiendomsdata, tapte muligheter |

Når en scraper blir blokkert, mister du ikke bare data — du sløser med ressurser, risikerer compliance-problemer og kan ende opp med å ta dårlige forretningsbeslutninger basert på ufullstendig informasjon. I en verden der , er pålitelighet alt.

Hvordan nettsteder oppdager og blokkerer Python-webscrapere

Nettsteder har blitt svært flinke til å oppdage boter. Her er de vanligste anti-scraping-forsvarene du vil møte (, ):

- Svartelisting av IP-adresser: For mange forespørsler fra samme IP? Blokkert.

- Sjekk av User-Agent og headere: Forespørsler med manglende eller generiske headere (som Pythons standard

python-requests/2.25.1) skiller seg ut. - Rate limiting: For mange forespørsler på kort tid utløser nedstruping eller utestengelse.

- CAPTCHA-er: «Bevis at du er et menneske»-oppgaver som boter ikke kan løse (enkelt).

- Atferdsanalyse: Nettsteder ser etter robotaktige mønstre — som å klikke på samme knapp med samme intervall.

- Honeypots: Skjulte lenker eller felt som bare boter vil samhandle med.

- Browser fingerprinting: Innsamling av detaljer om nettleseren og enheten din for å avsløre automatiseringsverktøy.

- Sporing av informasjonskapsler og økter: Boter som ikke håndterer cookies eller sessioner riktig blir flagget.

Tenk på det som flyplassikkerhet: Hvis du ser ut, oppfører deg og beveger deg som alle andre, glir du rett gjennom. Dukker du opp i trenchcoat og solbriller, må du regne med flere spørsmål.

Viktige Python-teknikker for web scraping uten å bli blokkert

La oss komme til det som faktisk fungerer: hvordan du unngår blokkeringer når du scraper med Python. Her er de viktigste strategiene enhver scraper bør kunne:

Roterende proxyer og IP-adresser

Hvorfor det er viktig: Hvis alle forespørslene dine kommer fra samme IP, er du et lett mål for IP-sperrer. Roterende proxyer lar deg fordele forespørsler over mange IP-er, noe som gjør det langt vanskeligere å blokkere deg.

Slik gjør du det i Python:

1import requests

2proxies = [

3 "<http://proxy1.example.com:8000>",

4 "<http://proxy2.example.com:8000>",

5 # ...flere proxyer

6]

7for i, url in enumerate(urls):

8 proxy = {"http": proxies[i % len(proxies)]}

9 response = requests.get(url, proxies=proxy)

10 # behandle responsenDu kan bruke betalte proxy-tjenester (som residential eller roterende proxyer) for bedre pålitelighet ().

Sette User-Agent og egendefinerte headere

Hvorfor det er viktig: Standard headere fra Python roper «bot». Etterlign ekte nettlesere ved å sette user-agent og andre headere.

Eksempel på kode:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4 "Accept-Encoding": "gzip, deflate, br",

5 "Connection": "keep-alive"

6}

7response = requests.get(url, headers=headers)Roter user-agents for ekstra skjuling ().

Tilfeldiggjøring av forespørselstiming og mønstre

Hvorfor det er viktig: Boter er raske og forutsigbare; mennesker er trege og tilfeldige. Legg inn pauser og varier navigasjonen.

Python-tips:

1import time, random

2for url in urls:

3 response = requests.get(url)

4 time.sleep(random.uniform(2, 7)) # Vent 2–7 sekunderDu kan også tilfeldiggjøre klikkstier og skrollmønstre hvis du bruker Selenium.

Håndtering av cookies og sesjoner

Hvorfor det er viktig: Mange nettsteder krever cookies eller sesjonstoken for å gi tilgang til innhold. Boter som ignorerer dette blir blokkert.

Slik håndterer du det i Python:

1import requests

2session = requests.Session()

3response = session.get(url)

4# session håndterer cookies automatiskFor mer komplekse flyter kan du bruke Selenium til å fange opp og gjenbruke cookies.

Simulere menneskelig atferd med headless-browsere

Hvorfor det er viktig: Noen nettsteder bruker JavaScript, musebevegelser eller skrolling som signaler på ekte brukere. Headless-browsere som Selenium eller Playwright kan etterligne disse handlingene.

Eksempel med Selenium:

1from selenium import webdriver

2from selenium.webdriver.common.action_chains import ActionChains

3import random, time

4driver = webdriver.Chrome()

5driver.get(url)

6actions = ActionChains(driver)

7actions.move_by_offset(random.randint(0, 100), random.randint(0, 100)).perform()

8time.sleep(random.uniform(2, 5))Dette hjelper deg å omgå atferdsanalyse og dynamisk innhold ().

Avanserte strategier: omgå CAPTCHA-er og honeypots i Python

CAPTCHA-er er laget for å stoppe boter i det øyeblikket de dukker opp. Selv om noen Python-biblioteker kan løse enkle CAPTCHA-er, bruker de fleste seriøse scrapers tredjepartstjenester (som 2Captcha eller Anti-Captcha) for å løse dem mot betaling ().

Eksempel på integrasjon:

1# Pseudokode for bruk av 2Captcha API

2import requests

3captcha_id = requests.post("<https://2captcha.com/in.php>", data={...}).text

4# Vent på løsning, og send deretter inn med forespørselen dinHoneypots er skjulte felt eller lenker som bare boter vil samhandle med. Unngå å klikke på eller sende inn noe som ikke er synlig i en ekte nettleser ().

Bygge robuste request-headere med Python-biblioteker

I tillegg til user-agent kan du rotere og tilfeldiggjøre andre headere (som Referer, Accept, Origin osv.) for å gli enda bedre inn.

Med Scrapy:

1class MySpider(scrapy.Spider):

2 custom_settings = {

3 'DEFAULT_REQUEST_HEADERS': {

4 'User-Agent': '...',

5 'Accept-Language': 'en-US,en;q=0.9',

6 # Flere headere

7 }

8 }Med Selenium: Bruk nettleserprofiler eller utvidelser for å sette headere, eller injiser dem via JavaScript.

Hold headere-listen oppdatert — kopier ekte nettleserforespørsler via nettleserens utviklerverktøy for inspirasjon.

Når tradisjonell Python-scraping ikke er nok: fremveksten av anti-bot-teknologi

Slik er virkeligheten: Etter hvert som scraping blir mer populært, blir også anti-bot-oppgraderingene bedre. . AI-drevet deteksjon, dynamiske terskler for forespørsler og browser fingerprinting gjør det vanskeligere enn noen gang for selv avanserte Python-scripts å holde seg uoppdaget ().

Noen ganger vil du, uansett hvor smart koden din er, møte en vegg. Da er det på tide å vurdere en annen tilnærming.

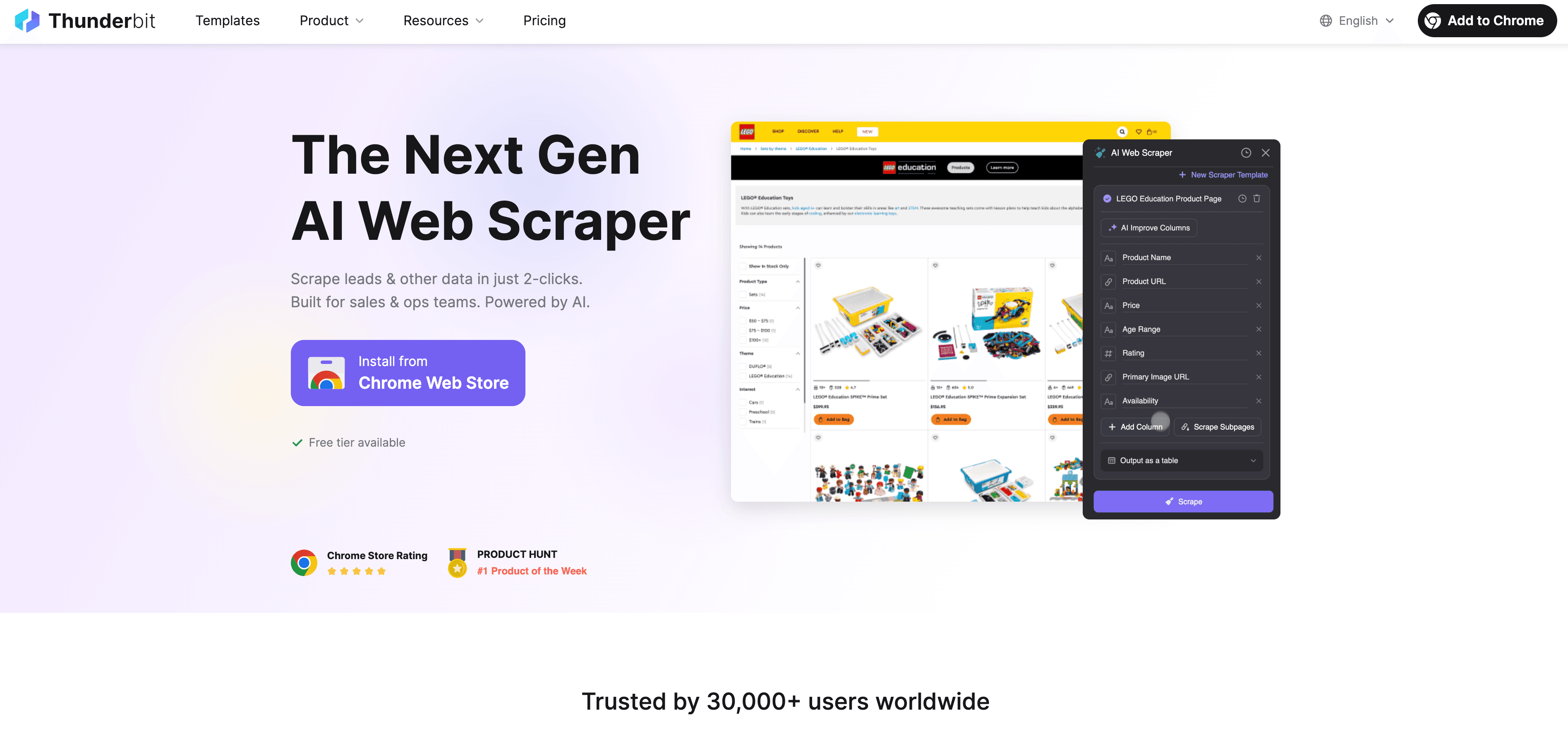

Thunderbit: et AI Web Scraper-alternativ til Python-scraping

Når Python når grensen sin, trer inn som en kodefri, AI-drevet web scraper bygget for forretningsbrukere — ikke bare utviklere. I stedet for å slite med proxyer, headere og CAPTCHA-er, leser Thunderbits AI-agent nettstedet, foreslår de beste feltene å hente ut og håndterer alt fra navigasjon på undersider til dataeksport.

Hva gjør Thunderbit annerledes?

- AI-forslag til felter: Klikk på «AI Suggest Fields», og Thunderbit skanner siden, anbefaler kolonner og genererer til og med instruksjoner for utvinning.

- Scraping av undersider: Thunderbit kan besøke hver underside (som produktdetaljer eller LinkedIn-profiler) og berike tabellen din automatisk.

- Cloud- eller nettleserscraping: Velg den raskeste løsningen — cloud for offentlige nettsteder, nettleser for sider som krever innlogging.

- Planlagt scraping: Sett det opp én gang, og la det være — Thunderbit kan kjøre scraping etter plan, så dataene dine alltid er oppdaterte.

- Umiddelbare maler: For populære nettsteder (Amazon, Zillow, Shopify osv.) tilbyr Thunderbit maler med ett klikk — ingen oppsett nødvendig.

- Gratis eksport av data: Eksporter til Excel, Google Sheets, Airtable eller Notion — uten ekstra kostnader.

Thunderbit er betrodd av over , og du trenger ikke å skrive en eneste linje med kode.

Hvordan Thunderbit hjelper brukere å unngå blokkeringer og automatisere datautvinning

Thunderbits AI etterligner ikke bare menneskelig atferd — den tilpasser seg hvert nettsted i sanntid, og reduserer risikoen for å bli blokkert. Slik fungerer det:

- AI tilpasser seg endringer i layout: Ikke flere ødelagte scripts når et nettsted oppdaterer designet sitt.

- Håndtering av undersider og paginering: Thunderbit følger automatisk lenker og sidelister, akkurat som en ekte bruker.

- Cloud-scraping i stor skala: Scrape opptil 50 sider om gangen, lynraskt.

- Ingen koding, ingen vedlikehold: Bruk tiden på analyse, ikke feilsøking.

For en dypere gjennomgang, se .

Sammenligning av Python-scraping vs. Thunderbit: hva bør du velge?

La oss sette dem opp side om side:

| Funksjon | Python-scraping | Thunderbit |

|---|---|---|

| Oppsettstid | Middels–høy (scripts, proxyer osv.) | Lav (2 klikk, AI gjør resten) |

| Teknisk ferdighetsnivå | Krever koding | Ingen koding nødvendig |

| Pålitelighet | Varierer (lett å ødelegge) | Høy (AI tilpasser seg endringer) |

| Risiko for blokkering | Middels–høy | Lav (AI etterligner brukeren, tilpasser seg) |

| Skalerbarhet | Krever egendefinert kode/cloud-oppsett | Innebygd cloud- og batch-scraping |

| Vedlikehold | Hyppig (endringer på nettstedet, blokkeringer) | Minimalt (AI justerer seg automatisk) |

| Eksportalternativer | Manuelt (CSV, DB) | Direkte til Sheets, Notion, Airtable, CSV |

| Kostnad | Gratis (men tidkrevende) | Gratis nivå, betalte planer for skalering |

Når du bør bruke Python:

- Du trenger full kontroll, egen logikk eller integrasjon med andre Python-arbeidsflyter.

- Du scraper nettsteder med minimale anti-bot-forsvar.

Når du bør bruke Thunderbit:

- Du vil ha fart, pålitelighet og null oppsett.

- Du scraper komplekse eller ofte endrende nettsteder.

- Du vil slippe å forholde deg til proxyer, CAPTCHA-er eller kode.

Steg-for-steg-guide: Slik setter du opp web scraping uten å bli blokkert i Python

La oss gå gjennom et praktisk eksempel: scraping av produktdata fra et eksempelnettsted, samtidig som vi følger beste praksis for å unngå blokkering.

1. Installer nødvendige biblioteker

1pip install requests beautifulsoup4 fake-useragent2. Forbered scriptet ditt

1import requests

2from bs4 import BeautifulSoup

3from fake_useragent import UserAgent

4import time, random

5ua = UserAgent()

6urls = ["<https://example.com/product/1>", "<https://example.com/product/2>"] # Erstatt med dine URL-er

7for url in urls:

8 headers = {

9 "User-Agent": ua.random,

10 "Accept-Language": "en-US,en;q=0.9"

11 }

12 response = requests.get(url, headers=headers)

13 if response.status_code == 200:

14 soup = BeautifulSoup(response.text, "html.parser")

15 # Hent ut data her

16 print(soup.title.text)

17 else:

18 print(f"Blokkert eller feil på {url}: {response.status_code}")

19 time.sleep(random.uniform(2, 6)) # Tilfeldig pause3. Legg til rotasjon av proxyer (valgfritt)

1proxies = [

2 "<http://proxy1.example.com:8000>",

3 "<http://proxy2.example.com:8000>",

4 # Flere proxyer

5]

6for i, url in enumerate(urls):

7 proxy = {"http": proxies[i % len(proxies)]}

8 headers = {"User-Agent": ua.random}

9 response = requests.get(url, headers=headers, proxies=proxy)

10 # ...resten av koden4. Håndter cookies og sesjoner

1session = requests.Session()

2for url in urls:

3 response = session.get(url, headers=headers)

4 # ...resten av koden5. Tips for feilsøking

- Hvis du ser mange 403-/429-feil, senk tempoet på forespørslene eller prøv nye proxyer.

- Hvis du møter CAPTCHA-er, vurder å bruke Selenium eller en CAPTCHA-løsningstjeneste.

- Sjekk alltid nettstedets

robots.txtog bruksvilkår.

Konklusjon og viktigste læringspunkter

Web scraping i Python er kraftfullt — men å bli blokkert er en konstant risiko etter hvert som anti-bot-teknologien utvikler seg. Den beste måten å unngå blokkeringer på? Kombiner tekniske beste praksiser (roterende proxyer, smarte headere, tilfeldige pauser, sesjonshåndtering og headless-browsere) med respekt for nettstedets regler og etikk.

Men noen ganger er selv de beste Python-triksene ikke nok. Det er der AI-drevne verktøy som virkelig skinner — de tilbyr en kodefri, blokk-resistent og bedriftsvennlig måte å hente ut dataene du trenger, raskt.

Vil du se hvor enkelt scraping kan være? og prøv selv — eller sjekk ut for flere tips og veiledninger om scraping.

Vanlige spørsmål

1. Hvorfor blokkerer nettsteder Python-webscrapere?

Nettsteder blokkerer scrapers for å beskytte dataene sine, forhindre overbelastning av serverne og stoppe automatiserte boter fra å misbruke tjenestene deres. Python-scripts er enkle å oppdage hvis de bruker standard headere, ikke håndterer cookies eller sender for mange forespørsler for raskt.

2. Hva er de mest effektive måtene å unngå å bli blokkert når du scraper med Python?

Bruk roterende proxyer, sett realistiske user-agent-verdier og headere, tilfeldiggjør timing på forespørsler, håndter cookies/sesjoner og simuler menneskelig atferd med verktøy som Selenium eller Playwright.

3. Hvordan hjelper Thunderbit med å unngå blokkeringer sammenlignet med Python-scripts?

Thunderbit bruker AI til å tilpasse seg sideoppsett, etterligne menneskelig surfing og håndtere undersider og paginering automatisk. Det reduserer risikoen for blokkeringer ved å gli inn og oppdatere tilnærmingen i sanntid — uten koding eller proxyer.

4. Når bør jeg bruke Python-scraping versus et AI-verktøy som Thunderbit?

Bruk Python når du trenger egen logikk, integrasjon med annen Python-kode, eller scraper enkle nettsteder. Bruk Thunderbit for rask, pålitelig og skalerbar scraping — spesielt når nettstedene er komplekse, endrer seg ofte eller blokkerer scripts aggressivt.

5. Er web scraping lovlig?

Web scraping er lovlig for offentlig tilgjengelige data, men du må respektere hvert nettsteds bruksvilkår, personvernregler og relevante lover. Aldri scrape sensitive eller private data, og bruk alltid scraping etisk og ansvarlig.

Klar for å scrape smartere, ikke hardere? Prøv Thunderbit og legg blokkeringene bak deg.

Les mer:

- Google News-scraping med Python: en steg-for-steg-guide

- Bygg et Best Buy-verktøy for prisovervåking med Python

- 14 måter å gjøre web scraping uten å bli blokkert

- 10 beste tips for å unngå å bli blokkert ved web scraping