“Du kan ha data uten informasjon, men du kan ikke ha informasjon uten data.” — *

Nylige anslag tyder på at det finnes over nettsteder på internett, med rundt 2 millioner nye innlegg publisert hver dag. Dette havet av data rommer verdifull innsikt som kan hjelpe deg å ta bedre beslutninger, men det er en hake: omtrent av det er ustrukturert, noe som betyr at det må bearbeides før det kan brukes. Det er her verktøy for webskraping kommer inn og blir uunnværlige for alle som vil hente ut data fra nettet.

Hvis du er ny på webskraping, kan ord som og virke litt skremmende. Men i AI-alderen er disse utfordringene mye enklere å overvinne. Dagens AI-drevne skrapeverktøy kan hjelpe deg i gang uten at du trenger dyp teknisk kunnskap. Med disse verktøyene kan du samle inn og behandle data raskt, helt uten kodeferdigheter.

De beste verktøyene og programvarene for webskraping

- for en brukervennlig AI-webskraper med de beste resultatene

- for sanntidsovervåking og masseuttrekk av data

- for automasjon uten kode og omfattende appintegrasjoner

- for mer profesjonell visuell webskraping

- for kraftig skraping uten kode, med omgåelse av IP-blokkering og botdeteksjon

- for avansert AI-drevet API for datauttrekk og kunnskapsgrafer

Prøv å bruke AI til webskraping

Prøv det! Du kan klikke, utforske og kjøre arbeidsflyten mens du ser på.

Hvordan fungerer webskraping?

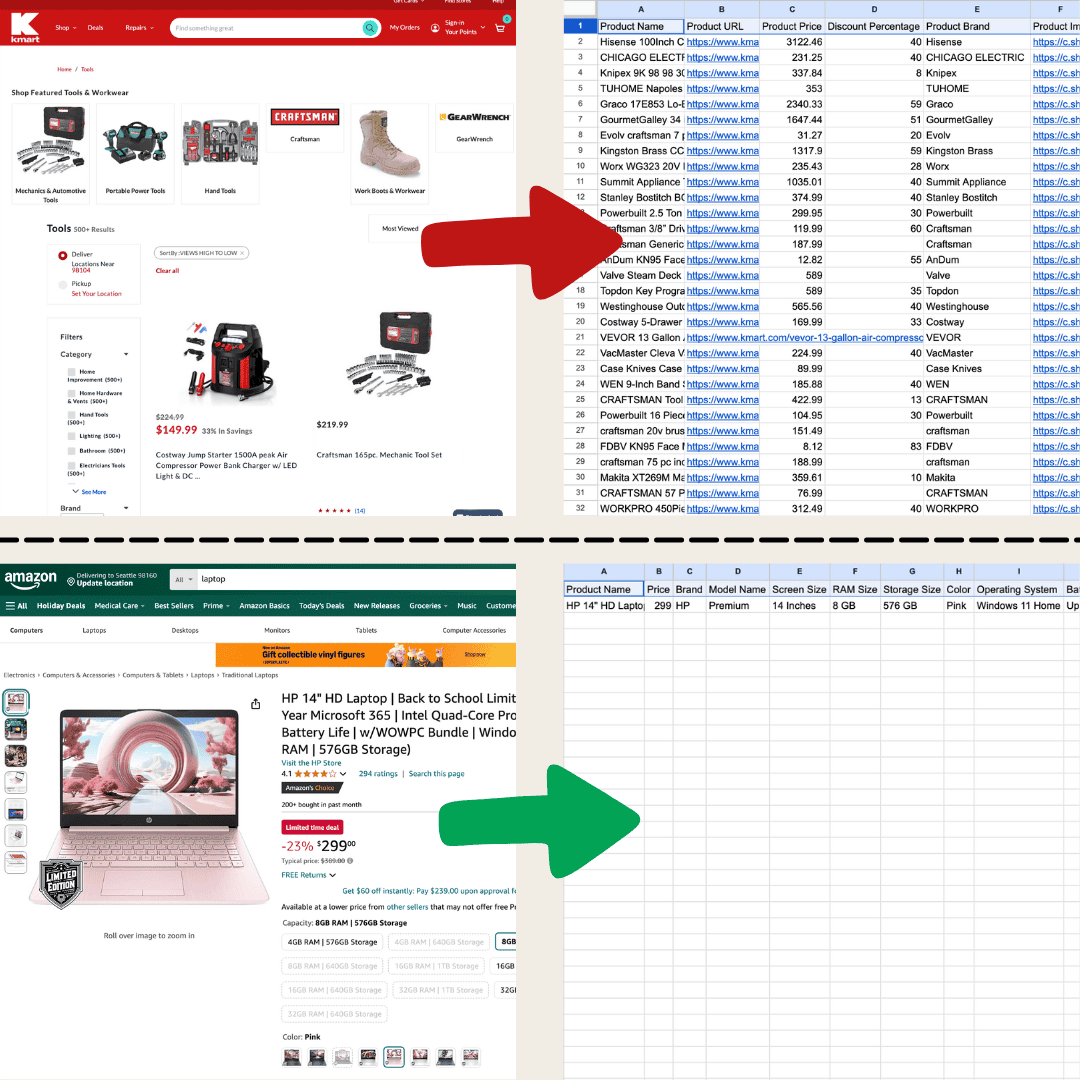

Webskraping handler om å hente data fra nettsteder. Du gir et verktøy et sett med instruksjoner, og så går det i gang med å trekke ut tekst, bilder eller det du trenger, og legge det inn i en tabell fra en nettside. Dette kan være nyttig til alt fra å følge priser på nettbutikker til å samle forskningsdata, eller bare bygge opp et solid Excel-ark eller Google Sheets.

Jeg laget dette med Thunderbit ved hjelp av AI Web Scraper.

Jeg laget dette med Thunderbit ved hjelp av AI Web Scraper.

Det finnes flere måter å gjøre det på. På det enkleste nivået kan du bare kopiere og lime inn manuelt, men det blir mye jobb hvis det er store datamengder. Derfor bruker de fleste én av tre metoder: tradisjonelle webskrapere, AI-webskrapere eller egendefinert kode.

Tradisjonelle webskrapere fungerer ved at du setter spesifikke regler for hvilke data som skal hentes, basert på strukturen på siden. For eksempel kan du be den hente produktnavn eller priser fra bestemte HTML-tagger. De fungerer best på nettsteder som ikke endrer seg så ofte, siden små justeringer i layouten betyr at du må inn og tilpasse skraperen.

Å bruke en tradisjonell skraper tar lang tid å lære, og det vil sannsynligvis kreve mange klikk før du er ferdig med oppsettet.

Å bruke en tradisjonell skraper tar lang tid å lære, og det vil sannsynligvis kreve mange klikk før du er ferdig med oppsettet.

AI-webskrapere betyr i praksis: ChatGPT leser hele nettstedet og henter deretter ut innhold basert på behovet ditt. Den kan håndtere datauttrekk, oversettelse og oppsummering samtidig. Den bruker naturlig språkbehandling til å analysere og forstå sidens oppbygning, noe som gjør at den takler endringer på nettstedet smidigere. Si at nettstedet omorganiserer seksjonene sine litt — en AI-webskraper kan ofte tilpasse seg uten at du trenger å skrive om noe. Derfor passer de godt for sider som krever mye vedlikehold, eller som har mer kompliserte strukturer.

AI-webskraperen er enkel å komme i gang med og gir deg detaljerte data på bare noen få klikk!

AI-webskraperen er enkel å komme i gang med og gir deg detaljerte data på bare noen få klikk!

Hvilken bør du velge? Det kommer an på. Hvis du er komfortabel med å fikse litt i kode, eller trenger å samle inn store mengder data fra et populært nettsted, kan tradisjonelle skrapere være svært effektive. Men hvis du er ny på webskraping eller vil ha noe som tåler endringer på nettstedet, er AI-webskrapere som regel det beste valget. Sjekk tabellen nedenfor for mer detaljerte scenarioer!

| Scenario | Beste valg |

|---|---|

| Lett skraping på sider som kataloger, nettbutikker eller andre nettsteder med lister | AI Web Scraper |

| Siden inneholder mindre enn 200 rader med data, og det tar for lang tid å bygge en skraper med en tradisjonell webskraper | AI Web Scraper |

| Dataene du skal skrape må ha et bestemt format for å lastes opp et annet sted. For eksempel: skrape kontaktinformasjon for opplasting til HubSpot. | AI Web Scraper |

| Nettsteder som brukes i stor skala, som titusenvis av Amazon-produktsider eller boliglister på Zillow. | Tradisjonell webskraper |

De beste verktøyene og programvarene for webskraping – kort oppsummert

| Verktøy | Priser | Nøkkelfunksjoner | Fordeler | Ulemper |

|---|---|---|---|---|

| Thunderbit | Fra 9 USD/måned, gratisnivå tilgjengelig | AI-webskraper, oppdager og formaterer data automatisk, støtter flere formater, eksport med ett klikk, brukervennlig grensesnitt. | Kodefri, AI-støtte, integrasjoner med apper som Google Sheets | Skraping i stor skala kan gå tregt, avanserte funksjoner kan koste mer |

| Browse AI | Fra 48,75 USD/måned, gratisnivå tilgjengelig | Grensesnitt uten kode, sanntidsovervåking, masseuttrekk av data, arbeidsflytintegrasjon. | Brukervennlig, integreres med Google Sheets og Zapier | Komplekse sider krever ekstra oppsett, masseskraping kan gi tidsavbrudd |

| Bardeen AI | Fra 60 USD/måned, gratisnivå tilgjengelig | Automasjon uten kode, integreres med 130+ apper, MagicBox gjør oppgaver om til arbeidsflyter. | Omfattende integrasjoner, skalerbar for bedrifter | Bratt læringskurve for nye brukere, tidkrevende oppsett |

| Web Scraper | Gratis for lokal bruk, 50 USD/måned for sky | Visuell oppretting av oppgaver, støtter dynamiske nettsteder (AJAX/JavaScript), skraping i skyen. | Fungerer godt for dynamiske sider | Krever teknisk kunnskap for best oppsett |

| Octoparse | Fra 119 USD/måned, gratisnivå tilgjengelig | Skraping uten kode, automatisk oppdagelse av sideelementer, skraping i skyen med planlagte oppgaver, malbibliotek for vanlige nettsteder. | Kraftige funksjoner for dynamiske sider, håndterer begrensninger | Komplekse sider krever læring |

| Diffbot | Fra 299 USD/måned | API for datauttrekk, reglerfritt API, NLP for ustrukturert tekst, omfattende kunnskapsgraf. | Sterk AI-uttrekkskapasitet, omfattende API-integrasjon, skraping i stor skala | Læringskurve for ikke-tekniske brukere, oppsettstid |

Den beste webskraperen i AI-alderen

Thunderbit er et kraftig og brukervennlig AI-verktøy for nettautomasjon som lar brukere uten kodeferdigheter enkelt hente ut og organisere data. Med gjør Thunderbits datauttrekk enkelt — brukere kan raskt hente ut webdata uten å samhandle manuelt med webelementer eller sette opp egne skrapere for ulike sidelayouter.

Nøkkelfunksjoner

- AI-drevet fleksibilitet: Thunderbits AI Web Scraper oppdager og formaterer webdata automatisk, så du slipper CSS-selektorer.

- Den enkleste skrapeopplevelsen: Alt du trenger å gjøre er å klikke «AI foreslå kolonne» og deretter «Skrap» på siden du vil hente data fra. Det er alt.

- Støtte for ulike dataformater: Thunderbit kan skrape URL-er og bilder, og vise innhentede data i flere formater.

- Automatisert databehandling: Thunderbits AI kan omformatere data underveis, inkludert å oppsummere, kategorisere og oversette dem til ønsket format.

- Enkel dataeksport: Eksporter data til Google Sheets, Airtable eller Notion med ett klikk, så blir databehandlingen enklere.

- Brukervennlig grensesnitt: Et intuitivt grensesnitt gjør det tilgjengelig for brukere på alle ferdighetsnivåer.

Priser

Thunderbit tilbyr trinnvise planer, fra 9 USD i måneden for 5 000 kreditter. Det går helt opp til 199 USD for 240 000 kreditter. Ved årsplan får du også alle kredittene på forhånd.

Fordeler:

- Sterk AI-støtte gjør datauttrekk og behandling enklere.

- Kodefri og tilgjengelig for brukere på alle ferdighetsnivåer.

- Perfekt for lett skraping, som kataloger, nettbutikker osv.

- Gode integrasjonsmuligheter for direkte eksport til populære apper.

Ulemper:

- Datauttrekk i stor skala kan ta litt tid for å sikre nøyaktighet.

- Enkelte avanserte funksjoner kan kreve betalt abonnement.

Vil du ha mer informasjon? Start med å , eller finn ut med Thunderbit.

Beste webskraper for overvåking av data og masseuttrekk

Browse AI

Browse AI er et robust skrapeverktøy uten kode, utviklet for å hjelpe brukere med å hente ut og overvåke data uten å skrive kode. Browse AI har noen AI-funksjoner, men er ikke helt på nivå med fullverdig AI-skraping. Likevel gjør det ting enklere for brukere som vil komme i gang.

Nøkkelfunksjoner

- Grensesnitt uten kode: Lar brukere lage egne arbeidsflyter med enkle klikk.

- Sanntidsovervåking: Bruker roboter til å følge med på endringer på nettsider og levere oppdatert informasjon.

- Masseuttrekk av data: Kan håndtere opptil 50 000 dataposter i én operasjon.

- Arbeidsflytintegrasjon: Kobler sammen flere roboter for mer kompleks databehandling.

Priser

Starter på 48,75 USD per måned, inkludert 2 000 kreditter. Et gratisnivå er tilgjengelig, med 50 kreditter per måned for å prøve grunnleggende funksjoner.

Fordeler:

- Tilbyr integrasjoner med Google Sheets og Zapier.

- Ferdigbygde roboter forenkler vanlige datauttrekksoppgaver.

Ulemper:

- Kan kreve ekstra konfigurasjon for komplekse sider.

- Hastigheten på masseskraping kan variere, og det kan noen ganger føre til tidsavbrudd.

Beste webskraper for arbeidsflytintegrasjon

Bardeen AI

Bardeen AI er et automasjonsverktøy uten kode som er utviklet for å strømlinjeforme arbeidsflyter ved å koble sammen ulike apper. Selv om det bruker AI til å lage egendefinert automasjon, mangler det tilpasningsevnen til et fullt AI-skrapeverktøy.

Nøkkelfunksjoner

- Automasjon uten kode: Lar brukere sette opp arbeidsflyter med klikk.

- MagicBox: Beskriver oppgaver i vanlig språk, som Bardeen AI gjør om til arbeidsflyter.

- Brede integrasjonsmuligheter: Integreres med over 130 apper, inkludert Google Sheets, Slack og LinkedIn.

Priser

Starter på 60 USD per måned, med 1 500 kreditter (omtrent 1 500 rader med data). Et gratisnivå tilbyr 100 kreditter i måneden for å prøve grunnleggende funksjoner.

Fordeler:

- Omfattende integrasjonsmuligheter støtter ulike behov i bedrifter.

- Fleksibelt og skalerbart for bedrifter i alle størrelser.

Ulemper:

- Nye brukere kan trenge tid for å lære hele plattformen.

- Førstegangsoppsettet kan være tidkrevende.

Beste visuelle webskraper for erfarne brukere

Web Scraper

Ja, du leste riktig: verktøyet heter «Web Scraper». Web Scraper er en populær nettleserutvidelse for Chrome og Firefox som lar brukere hente ut data uten kode, og som gir en visuell måte å lage skrapeoppgaver på. Du må likevel kanskje bruke et par dager på å se gjennom og lære av opplæringsvideoene ovenfor før du mestrer verktøyet fullt ut. Hvis du vil gjøre skraping lett for hodet, velger du AI Web Scraper.

Nøkkelfunksjoner

- Visuell oppretting: Lar brukere sette opp skrapeoppgaver ved å klikke på webelementer.

- Støtte for dynamiske nettsteder: Kan håndtere AJAX-forespørsler og JavaScript på dynamiske sider.

- Skraping i skyen: Planlegg oppgaver via Web Scraper Cloud for periodisk skraping.

Priser

Gratis for lokal bruk; betalte planer starter på 50 USD/måned for skyfunksjoner.

Fordeler:

- Fungerer godt for dynamiske sider.

- Gratis for lokal bruk.

Ulemper:

- Krever teknisk kunnskap for optimal oppsett.

- Endringer krever grundig testing.

Beste webskraper for å unngå IP-blokkering og botdeteksjon

Octoparse

Octoparse er en allsidig programvare for mer tekniske brukere som vil samle inn og overvåke spesifikke webdata uten kode, ideell for behov i stor skala. Octoparse er ikke avhengig av brukerens nettleser for å fungere; i stedet bruker den skyservere til datauttrekk. Dermed kan den tilby ulike metoder for å omgå IP-blokkering og visse typer botdeteksjon på nettsteder.

Nøkkelfunksjoner

- Skraping uten kode: Brukere kan lage skrapeoppgaver uten å skrive kode, noe som gjør verktøyet tilgjengelig for brukere med ulik teknisk bakgrunn.

- Smart automatisk deteksjon: Oppdager sidedata automatisk, finner raskt elementer som kan skrapes, og forenkler oppsettet.

- Skraping i skyen: Støtter dataskraping i skyen døgnet rundt, med planlagte skrapeoppgaver for fleksibel datauthenting.

- Omfattende malbibliotek: Tilbyr hundrevis av forhåndsdefinerte maler, slik at brukere raskt kan hente data fra populære nettsteder uten komplisert oppsett.

Priser

Octoparses prisplan starter på 119 USD per måned, inkludert 100 oppgaver. Et gratisnivå med 10 oppgaver per måned er også tilgjengelig for å teste grunnleggende funksjonalitet.

Fordeler:

- Kraftige funksjoner støtter skraping av dynamiske sider med høy tilpasningsevne.

- Gir løsninger for å håndtere skrapebegrensninger og problemer med dynamisk innhold.

Ulemper:

- Komplekse nettsidestrukturer kan kreve mer tid til oppsett.

- Nye brukere kan trenge tid til å lære bruksteknikkene.

Beste webskraper for avansert AI-drevet API for datauttrekk

Diffbot

Diffbot er et avansert verktøy for webdatauttrekk som bruker AI til å gjøre ustrukturert nettinnhold om til strukturert data. Med kraftige API-er og en kunnskapsgraf hjelper Diffbot brukere med å hente ut, analysere og administrere informasjon fra nettet, egnet for en rekke bransjer og bruksområder.

Nøkkelfunksjoner

- API for datauttrekk: Diffbot tilbyr et reglerfritt API for datauttrekk, som lar brukere ganske enkelt oppgi en URL for automatisk datauttrekk, uten å måtte sette opp egne regler for hvert nettsted.

- API for naturlig språkbehandling: Henter ut strukturerte enheter, relasjoner og sentiment fra ustrukturert tekst, og hjelper brukere med å bygge egne kunnskapsgrafer.

- Kunnskapsgraf: Diffbot har en av de største kunnskapsgrafene, med omfattende entitetsdata, inkludert detaljer om personer og organisasjoner.

Priser

Diffbots prisplan starter på 299 USD per måned, inkludert 250 000 kreditter (tilsvarende omtrent 250 000 API-baserte sideuttrekk).

Fordeler:

- Sterke reglerfrie datauttrekksfunksjoner med høy tilpasningsevne.

- Omfattende integrasjonsmuligheter for API-er gjør det enkelt å koble til eksisterende systemer.

- Støtter skraping i stor skala, egnet for virksomhetskritiske løsninger.

Ulemper:

- Førstegangsoppsettet kan kreve litt læring for ikke-tekniske brukere.

- Brukere må skrive et program for å kalle opp API-et.

Hva kan du bruke skrapere til?

Hvis du er ny på webskraping, er her noen populære bruksområder som kan hjelpe deg i gang. Mange bruker skrapere til å hente produktlister fra Amazon, trekke ut eiendomsdata fra Zillow eller samle bedriftsinformasjon fra Google Maps. Men det er bare begynnelsen — du kan bruke Thunderbits til å hente data fra nesten hvilket som helst nettsted, effektivisere oppgaver og spare tid i den daglige arbeidsflyten din. Enten det gjelder forskning, prissporing eller bygging av databaser, åpner webskraping for utallige måter å få internettdata til å jobbe for deg.

Vanlige spørsmål

-

Er webskraping lovlig?

Webskraping er som regel lovlig, men må følge nettstedets bruksvilkår og typen data som hentes. Gå alltid gjennom relevante retningslinjer og følg juridiske krav.

-

Trenger jeg programmeringsferdigheter for å bruke webskrapingsverktøy?

De fleste verktøyene som er omtalt her krever ikke programmeringsferdigheter, men verktøy som Octoparse og Web Scraper kan ha nytte av at brukeren har grunnleggende kunnskap om webstrukturer og en programmeringstankegang for å brukes optimalt.

-

Finnes det gratis verktøy for webskraping?

Ja, gratis verktøy som BeautifulSoup, Scrapy og Web Scraper finnes, og noen verktøy tilbyr også gratisplaner med begrensede funksjoner.

-

Hva er vanlige utfordringer ved webskraping?

Vanlige utfordringer inkluderer håndtering av dynamisk innhold, CAPTCHA-er, IP-blokkering og komplekse HTML-strukturer. Avanserte verktøy og teknikker kan løse disse problemene effektivt.

Lær mer:

-

Bruk AI til å jobbe helt uten anstrengelse.