Å ansette en web scraping-utvikler var før litt sånn «spesialbestilling» – noe som stort sett var forbeholdt data scientists eller den sjeldne, teknisk sterke markedsføreren. Spol frem til 2025, og det føles som om absolutt hvert salgs-, drifts- eller markedsføringsteam jeg prater med, er på jakt etter en frilans web scraping-ekspert eller en spesialist på uttrekk av webdata. Hvorfor? Fordi nettet er verdens største – og mest kaotiske – database, og presset for å gjøre det digitale rotet om til innsikt du faktisk kan handle på, bare øker. Jeg har sett på nært hold hvordan riktig (eller feil) ansettelse kan være forskjellen på et prosjekt som flyr, og et som krasjer – noen ganger ganske spektakulært.

Markedet for web scraping og datauttrekk vokser i høyt tempo, og globale investeringer forventes å firedobles det neste tiåret (). Men når nettsteder endrer seg hele tiden, anti-bot-forsvar blir smartere, og forretningsbrukere forventer renere og raskere data, er det viktigere enn noen gang å velge riktig person (eller riktig verktøy). Så enten du er gründer, teamleder eller bare «datapersonen» som fikk oppgaven i fanget, la oss gå gjennom hvordan du ansetter en web scraping-utvikler – og når du kanskje ikke trenger en i det hele tatt.

Hva gjør en web scraping-utvikler?

En web scraping-utvikler er bindeleddet mellom internettets «ville vesten» og de ryddige regnearkene teamet ditt faktisk trenger. Jobben deres er å gjøre skiftende, ustrukturert webinnhold om til strukturerte og pålitelige datasett – for eksempel CSV, JSON eller rett inn i en database. Men det handler ikke bare om å slenge sammen et kjapt script. Den virkelige jobben er å sørge for at løsningene fortsetter å funke når nettsteder endrer seg, håndtere paginering, undersider, anti-bot-hindre og alle de rare særtrekkene som følger med moderne web ().

Typiske ansvarsområder inkluderer:

- Analysere websider for å velge beste metode (HTML-scraping, API-kall, headless nettlesere)

- Håndtere dynamisk innhold, JavaScript-rendering og innlogging

- Styre paginering og beriking via undersider (for eksempel hente en produktliste og deretter besøke hver produktside for flere detaljer)

- Levere rene data klare for analyse (CSV, JSON, database eller direkte integrasjon)

- Sette opp overvåking, retries og varsler når ting ryker (for det gjør de)

- Dokumentere dataspec, feltdefinisjoner og oppdateringsfrekvens

Frilans web scraping-eksperter hentes ofte inn til engangsprosjekter, smale mål eller raske prototyper. Interne spesialister på uttrekk av webdata blir gjerne aktuelle når datauttrekk er en kjernefunksjon som må gå kontinuerlig – som daglig prisovervåking, leadgenerering eller drift av et internt dashboard ().

For ikke-tekniske team er disse rollene rett og slett gull. De gjør timer med manuell kopier-og-lim om til automatiserte arbeidsflyter, så analytikere og selgere kan bruke tiden på det som faktisk gir resultater.

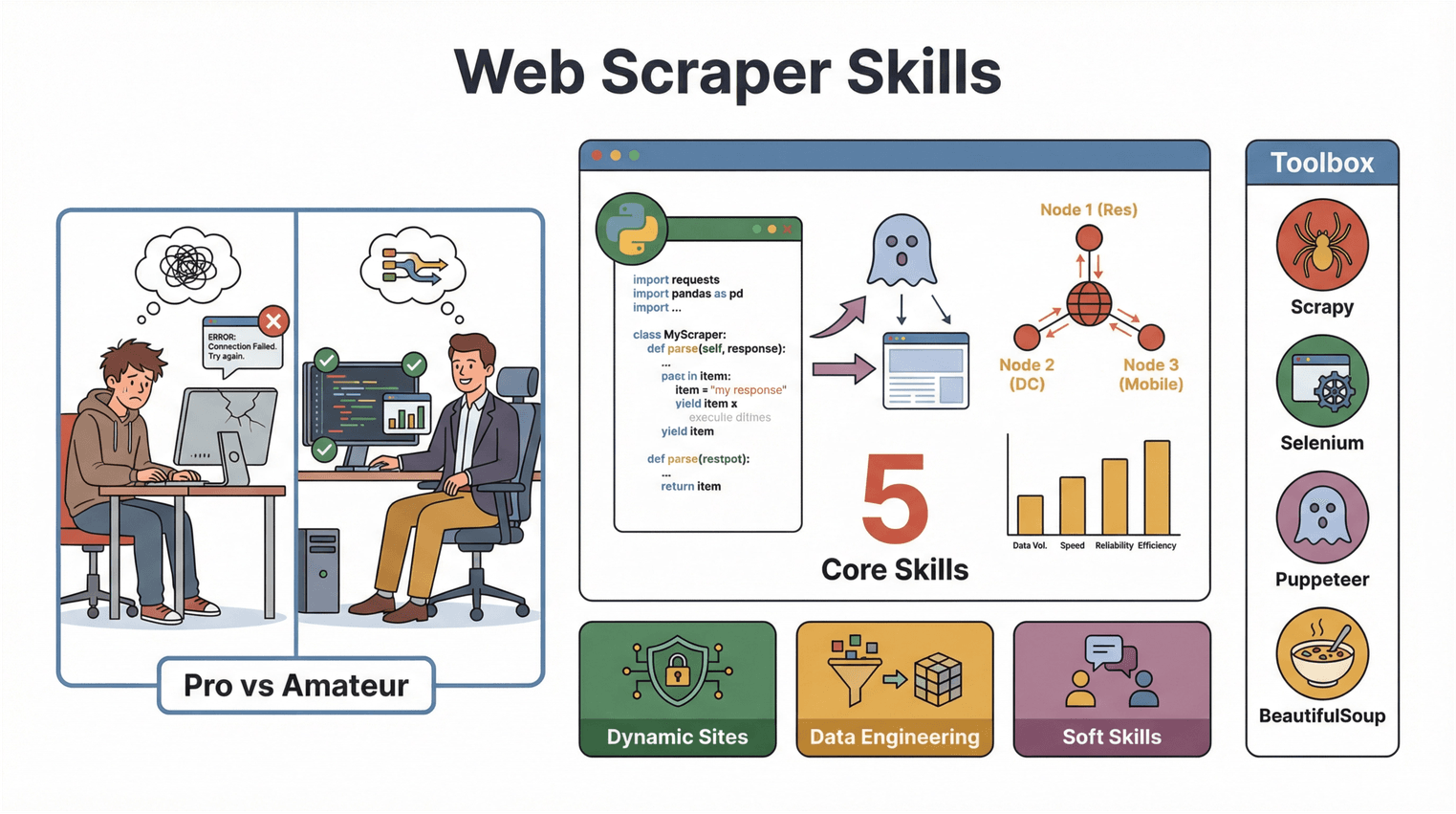

Viktige ferdigheter og erfaring å se etter når du skal ansette en web scraping-utvikler

Ikke alle som «kan scrape» er like gode. Gjennom årene har jeg sett utviklere som kan mekke et script på en ettermiddag – men som ikke klarer å holde det i live i mer enn en uke. Dette er ofte det som skiller proffene fra amatørene:

- Sterke programmeringsferdigheter: Python er førstevalget for mange, men JavaScript, Node.js eller til og med Go er også vanlig. Se etter erfaring med biblioteker som BeautifulSoup, Scrapy, Selenium eller Puppeteer.

- Erfaring med web scraping-verktøy: Kjennskap til både kodebaserte og no-code-verktøy (som ) er et stort pluss. De beste vet når de bør bruke et verktøy, og når de bør bygge fra bunnen av.

- Håndtering av dynamiske og beskyttede nettsteder: Moderne nettsteder er fulle av JavaScript og anti-bot-tiltak. Utvikleren bør være komfortabel med headless nettlesere, proxyer, CAPTCHA-er og sesjonshåndtering.

- Data engineering-tankegang: Det handler ikke bare om å hente data – rensing, deduplisering, validering og strukturering er minst like viktig.

- Myke ferdigheter: Kommunikasjon, nøyaktighet og evne til problemløsning. Du vil ha noen som stiller oppklarende spørsmål, ikke bare noen som sier «jadda, det fikser jeg».

Sjekkliste for tekniske ferdigheter

Her er en kjapp sjekkliste du kan bruke når du vurderer kandidater:

| Må-ha-ferdigheter | Kjekt å ha |

|---|---|

| Python (eller JS/Node) | Erfaring med skybaserte scraping-plattformer |

| HTML/CSS/DOM-parsing | Kjennskap til containerisering (Docker) |

| Håndtering av paginering og undersider | Oppsett av overvåking, logging og varsling |

| Anti-bot-strategier (proxyer, throttling) | Integrasjon i datapipelines (ETL, API-er) |

| Datavalidering og QA | Forståelse for compliance og personvern |

| Erfaring med verktøy som Thunderbit, Octoparse | Erfaring med AI-assistert uttrekk |

Et ekstra pluss: kandidater som kan bruke verktøy som kan ofte levere raskere og med mindre vedlikehold – spesielt for typiske forretningsoppgaver.

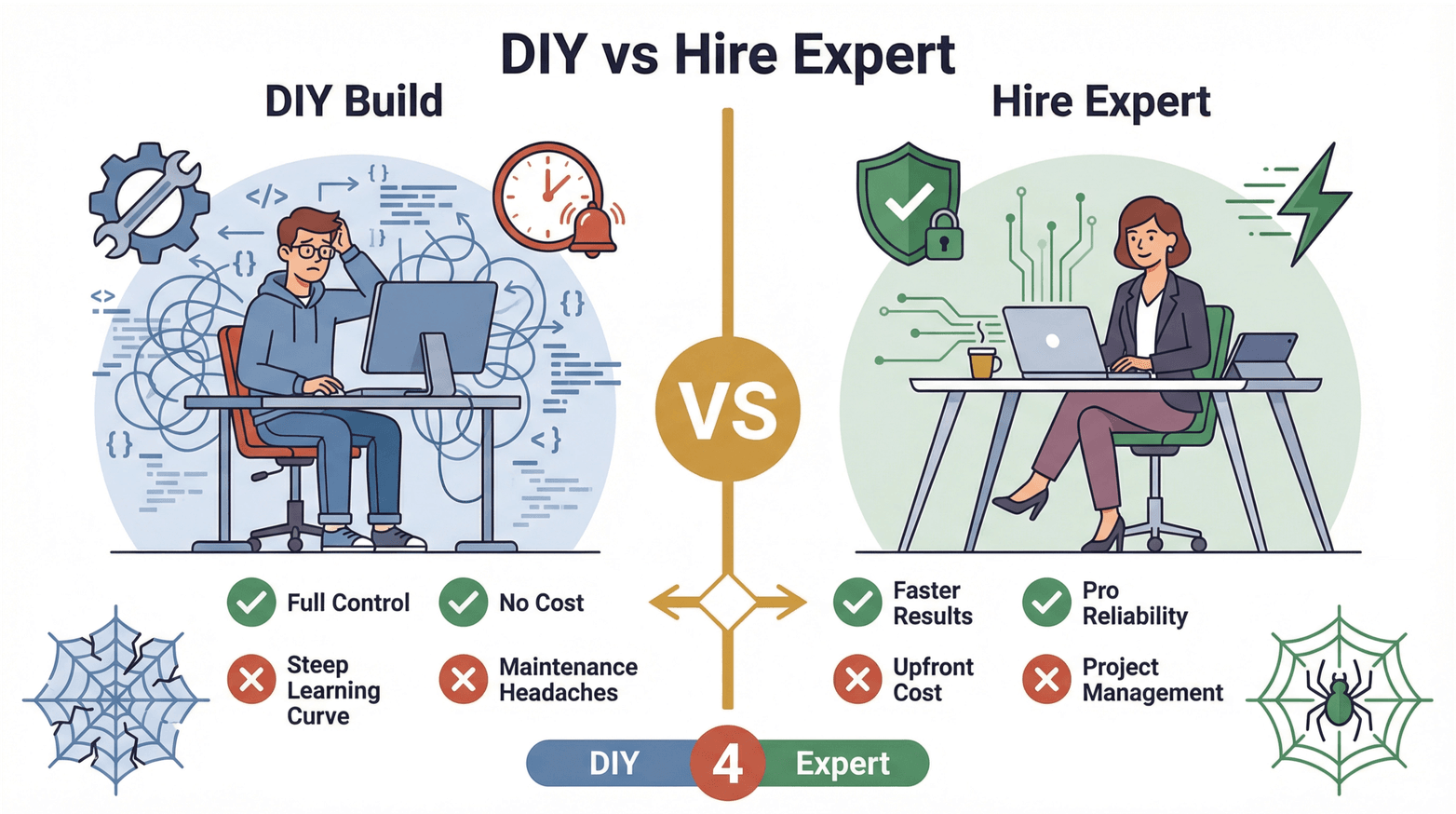

Gjør det selv vs. å ansette en web scraping-ekspert: kostnad og effektivitet

Så hva lønner seg egentlig: å brette opp ermene og bygge selv, eller å hente inn en frilans web scraping-ekspert? La oss se på forskjellene.

DIY (gjør det selv):

- Fordeler: Full kontroll, ingen eksterne kostnader, bra for læring.

- Ulemper: Bratt læringskurve, tar tid, vedlikehold blir fort en hodepine, og det er lett å undervurdere kompleksiteten.

Ansette en frilans web scraping-ekspert:

- Fordeler: Raskere leveranse, mer robust kvalitet, mindre risiko for at alt «knekker» når siden endres, tilgang til spisskompetanse.

- Ulemper: Kostnad i forkant, du må styre prosjektet, mulig kommunikasjonsfriksjon.

Kostnadstabell:

| Tilnærming | Typisk kostnad | Tid til leveranse | Vedlikehold |

|---|---|---|---|

| DIY | Din tid (alternativkostnad) | Dager til uker (hvis du lærer underveis) | Du har alt ansvar for feilretting |

| Frilans (timepris) | $20–$40/time (upwork.com) | 1–2 uker for de fleste prosjekter | Kan avtale løpende støtte |

| Frilans (fastpris) | $500–$5,000+ (upwork.com) | 1–4 uker, avhengig av omfang | Vedlikehold kan koste ekstra |

| Intern ansettelse | $100k+/år (glassdoor.com) | Løpende | Fullt eierskap (og full kostnad) |

Når gir DIY mening? Hvis du har teknisk bakgrunn, prosjektet er enkelt, og du liker å fikle. For alt som er forretningskritisk, i stort volum eller endrer seg ofte, lønner det seg fort å bruke en spesialist.

Når du bør velge en spesialist på uttrekk av webdata

Vurder å ansette en spesialist når:

- Du må hente data fra komplekse, dynamiske eller beskyttede nettsteder

- Dataene er forretningskritiske eller må oppdateres jevnlig

- Du trenger integrasjon mot andre systemer (CRM, databaser, API-er)

- Compliance, personvern eller juridiske hensyn er relevante

- Du vil slippe smertefullt, løpende vedlikehold og feilsøking

For raske engangsuttak eller enkel listebygging kan et verktøy som være alt du trenger.

Hvor finner du web scraping-utviklere og frilans-eksperter?

Det finnes mange steder å finne web scraping-kompetanse, men hver plattform har sine egne «greier».

- : Størst utvalg – fra nybegynnere til skikkelig erfarne. Bruk timepris eller fastpris, og jobb med milepæler for å redusere risiko.

- : Bra for budsjettstyrte prosjekter med tydelige leveranser. Bruk milepælsbetaling for å sikre fremdrift.

- : Premium, forhåndsvurderte kandidater. Passer hvis du vil outsource screening og er villig til å betale mer.

- Fiverr: Best for små, avgrensede oppgaver («gigs»). Vær forsiktig med komplekse eller langvarige prosjekter.

Tips for å sile kandidater:

- Se etter profiler med konkret web scraping-erfaring (ikke bare «Python developer»)

- Sjekk relevant bransjeerfaring (f.eks. netthandel, eiendom, B2B-leads)

- Gå gjennom portefølje og be om eksempler eller kodeutdrag

- Les anmeldelser og vurderinger nøye

Tips til screening og intervju

Ikke bare ta det på ordet – slik liker jeg å vurdere kandidater:

Viktige spørsmål:

- Kan du beskrive et nylig web scraping-prosjekt du leverte? Hva var utfordringene?

- Hvordan håndterer du nettsteder som bruker JavaScript eller har anti-bot-beskyttelse?

- Hvordan sikrer du datakvalitet og stabilitet over tid?

- Hvordan dokumenterer du arbeidet for overlevering eller fremtidig vedlikehold?

- Hvilken compliance-sjekkliste følger du før du starter et nytt prosjekt?

Praktiske tester:

- Gi et eksempelnettsted med liste + detaljsider. Be om en CSV med berikede data.

- Be om en kort «datakontrakt» (feltdefinisjoner, obligatoriske felt, oppdateringsfrekvens) før de koder.

- Be om en kort demo som henter en JavaScript-tung tabell.

Hvordan Thunderbit kan redusere behovet for web scraping-utviklere

Her er en liten hemmelighet: De fleste forretningsbrukere trenger ikke en skreddersydd, kodebasert scraper for hvert prosjekt. Verktøy som har virkelig endret spillereglene for ikke-tekniske team.

Thunderbit er en som lar deg hente strukturerte data fra nesten alle nettsteder med bare et par klikk. Du beskriver hva du vil ha, trykker «AI Suggest Fields», og Thunderbits AI fikser resten. Den håndterer også scraping av undersider, paginering og eksport direkte til Excel, Google Sheets, Airtable eller Notion.

Hvorfor er dette relevant for ansettelse? Fordi Thunderbit kutter ned antallet prosjekter som faktisk krever en utvikler. For salg, netthandel og research-team er det ofte raskere (og rimeligere) å bruke Thunderbit til rutineuttak, leadlister eller prisovervåking. Spar tung ingeniørinnsats til det som faktisk er komplisert.

Thunderbit vs. tradisjonelle web scraping-tilnærminger

La oss sammenligne Thunderbits arbeidsflyt med å ansette en frilans web scraping-ekspert:

| Faktor | Thunderbit | Frilans-ekspert |

|---|---|---|

| Oppstartstid | Minutter (ingen kode) | Dager til uker |

| Kostnad | Gratisnivå, deretter $15–$249/mnd (Thunderbit Pricing) | $500–$5,000+ per prosjekt |

| Vedlikehold | AI tilpasser seg endringer på siden | Manuelle oppdateringer kreves |

| Eksportmuligheter | Excel, Sheets, Airtable, Notion, CSV, JSON | Varierer (ofte CSV/JSON) |

| Undersider/paginering | Innebygd, 2 klikk | Krever skreddersydd kode |

| Best for | Raske, hyppige, lette oppgaver | Komplekse, store volum, spesialintegrasjoner |

Når bør du fortsatt ansette en utvikler? Når du trenger forretningskritiske datapipelines, «vanskelige mål» (innloggingsbeskyttede eller hardt forsvarte nettsteder), eller når du trenger skreddersydde integrasjoner og overvåking.

Slik lykkes du med outsourcet web scraping

Å ansette riktig person er bare starten. God prosjektstyring er det som holder alt på skinner (og hindrer de klassiske «hvor er dataene mine?»-øyeblikkene).

Beste praksis:

- Definer en tydelig «datakontrakt» tidlig: List opp alle felter, datatyper, oppdateringsfrekvens og akseptkriterier ().

- Bruk milepæler og escrow: Del prosjektet i etapper (prøvedatasett, full kjøring, planlagt kjøring, overvåking) og betal først når hver leveranse er godkjent ().

- Etabler QA-porter: Sørg for at data er deduplisert, validert og klar for ditt bruk.

- Planlegg vedlikehold: Scrapers går i stykker. Avtal retainer eller vedlikeholdsplan hvis dataene er kritiske.

- Dokumenter alt: Krev README, runbook og kjente feilsituasjoner. God dokumentasjon sparer deg for dyre overraskelser senere.

Tips for kommunikasjon og samarbeid

- Regelmessige innsjekker: Ukentlige oppdateringer eller demoer holder alle samkjørte.

- Felles prosjektverktøy: Bruk Trello, Asana eller Google Docs for å følge fremdrift og tilbakemeldinger.

- Tydelige eskaleringsløp: Avklar på forhånd hvordan blokkere og problemer håndteres.

- Oppmuntre til spørsmål: De beste frilanserne avklarer tidlig – og ofte.

Juridiske, etiske og compliance-hensyn når du ansetter for web scraping

Web scraping er ikke like «fritt fram» som før. Det finnes reelle juridiske og etiske hensyn – særlig rundt persondata, vilkår for bruk og anti-bot-tiltak.

Viktige punkter:

- Offentlige data ≠ fritt frem: Selv scraping av offentlig tilgjengelige data kan innebære juridisk risiko, spesielt hvis du omgår tekniske barrierer eller ignorerer vilkår ().

- Personvernlover gjelder: GDPR, CCPA og andre regelverk krever at du kan begrunne innsamling, minimere påvirkning og respektere reservasjoner ().

- Compliance-sjekkliste: Begrens scraping til godkjente nettsteder og datatyper, unngå sensitive/personlige data uten eksplisitt tillatelse, dokumenter prosessen og håndter legitimasjon sikkert ().

- Åpenhet: Vær tydelig med utvikleren om compliance-krav, og ta det inn i oppdragsbeskrivelsen.

Verktøy som Thunderbit kan hjelpe ved å fokusere på offentlig, forretningsrelevant data og gjøre det enklere å dokumentere hva du samler inn – og hvorfor.

Steg-for-steg: Slik ansetter du en web scraping-utvikler

Klar til å sette i gang? Her er en enkel og praktisk prosess:

- Definer behovet: Hvilke data trenger du? Fra hvilke nettsteder? Hvor ofte? I hvilket format?

- Lag en «datakontrakt»: List felter, datatyper, oppdateringsfrekvens og akseptkriterier.

- Velg plattform: Upwork, Freelancer, Toptal eller Fiverr – velg etter budsjett, tidslinje og hvor mye screening du vil gjøre.

- Publiser prosjektet: Vær konkret på leveranser, tidsfrister og compliance-krav.

- Screen kandidater: Bruk sjekklisten og intervjuspørsmålene over. Be om eksempler eller en liten betalt test.

- Avtal milepæler: Del opp i logiske etapper med tydelige leveranser.

- Følg opp prosjektet: Bruk faste innsjekker, QA-porter og delte verktøy for å spore fremdrift.

- Planlegg vedlikehold: Avklar hvordan oppdateringer, feilretting og endringer håndteres.

- Dokumenter alt: Krev README, runbook og en tydelig overlevering.

Og husk: For mange rutineoppgaver trenger du kanskje ikke å ansette i det hele tatt – prøv først og se om det dekker behovet.

Konklusjon og viktigste læringspunkter

Å ansette en web scraping-utvikler er ikke lenger bare for teknologigiganter – det er relevant for alle team som vil gjøre webdata om til forretningsverdi. Men når markedet for web scraping og datauttrekk vokser med over , blir både innsatsen (og kompleksiteten) høyere enn noen gang.

Dette er det viktigste:

- Se etter utviklere med solide programmeringsferdigheter, praktisk scraping-erfaring og en data engineering-tilnærming.

- Bruk plattformer som Upwork, Freelancer og Toptal for å finne og vurdere kandidater – men styr prosjektet med tydelige kontrakter, milepæler og QA-porter.

- For rutineoppgaver med rask levering kan verktøy som spare tid, penger og frustrasjon – helt uten kode.

- Ha alltid compliance, personvern og dokumentasjon høyt på agendaen.

- Best resultat kommer av klare forventninger, jevn kommunikasjon og vilje til å tilpasse seg når nettsteder (uansett) endrer seg.

Før du ansetter, spør deg selv: Er dette et engangsbehov, et tilbakevendende behov, eller en forretningskritisk pipeline? Noen ganger er det smarteste å gi teamet enkle verktøy – og spare tungt arbeid til når du virkelig trenger det.

Nysgjerrig på hvor mye du kan få til uten å ansette en utvikler? og test selv. Og vil du ha flere tips om web scraping, dataautomatisering eller hvordan du bygger en moderne datastack, ta en titt på .

Vanlige spørsmål (FAQ)

1. Hva er forskjellen på en frilans web scraping-ekspert og en intern spesialist på uttrekk av webdata?

En frilanser hentes som regel inn til konkrete, kortvarige prosjekter eller smale mål, mens en intern spesialist drifter løpende, forretningskritiske datapipelines og integrasjoner.

2. Hva koster det å ansette en web scraping-utvikler?

Frilansere tar ofte $20–$40 per time eller $500–$5,000+ per prosjekt, avhengig av kompleksitet. Interne roller kan koste $100k+ i året. Verktøy som Thunderbit tilbyr abonnement fra $15/mnd.

3. Hvilke ferdigheter bør jeg se etter når jeg ansetter en web scraping-utvikler?

Se etter sterke programmeringsferdigheter (Python, JS), erfaring med dynamiske nettsteder og anti-bot-strategier, data engineering-kompetanse og kjennskap til både kode- og no-code-verktøy som Thunderbit.

4. Når bør jeg bruke et verktøy som Thunderbit i stedet for å ansette en utvikler?

Thunderbit passer best for raske, hyppige eller engangsuttak, leadgenerering eller prisovervåking – spesielt når du trenger strukturerte eksporter og minimal oppstart. Ansett utvikler for komplekse, forretningskritiske eller svært skreddersydde prosjekter.

5. Hvilke juridiske eller compliance-problemer bør jeg vurdere ved web scraping?

Respekter alltid nettstedets vilkår, personvernlover (som GDPR/CCPA), og unngå å hente sensitive eller personlige data uten eksplisitt tillatelse. Dokumenter prosessen og sørg for at utvikleren følger beste praksis.

Klar for å lykkes med neste dataprosjekt? Start med riktig plan, riktige folk og riktige verktøy – så vil du bli overrasket over hvor mye mer du får gjort.

Les mer