“אפשר שיהיו לך נתונים בלי מידע, אבל אי אפשר שיהיה לך מידע בלי נתונים.” — *

הערכות עדכניות מראות שיש יותר מ־ אתרים באינטרנט, וכשני מיליון פוסטים חדשים מתפרסמים מדי יום. האוקיינוס הזה של נתונים טומן בחובו תובנות יקרות ערך לקבלת החלטות, אבל יש קאץ’: כ־ מהם אינם מובְנים, כלומר צריך לעבד אותם עוד לפני שאפשר להשתמש בהם. כאן נכנסים לתמונה כלי גריפת אתרים, והם הופכים לחיוניים לכל מי שרוצה להפיק ערך מנתונים מקוונים.

אם אתם חדשים בעולם גריפת האתרים, מונחים כמו ו־ עשויים להישמע קצת מאיימים. אבל בעידן ה־AI, הרבה יותר קל להתמודד עם האתגרים האלה. כלי הגריפה מבוססי ה־AI של היום יכולים לעזור לכם להתחיל בלי ידע טכני עמוק. הכלים האלה מאפשרים לאסוף ולעבד נתונים במהירות, בלי צורך בידע בקוד.

כלי ותוכנות גריפת האתרים הטובים ביותר

- עבור כלי גריפת אתרים AI קל לשימוש עם התוצאות הטובות ביותר

- לניטור בזמן אמת ולחילוץ נתונים בכמויות גדולות

- לאוטומציה ללא קוד עם אינטגרציות נרחבות לאפליקציות

- לגריפת אתרים חזותית ומקצועית יותר למשתמשים מנוסים

- לגריפה חזקה ללא קוד, תוך הימנעות מחסימת IP וזיהוי בוטים

- ל־API מתקדם לחילוץ נתונים בעזרת AI ולגרפי ידע

נסו להשתמש ב־AI לגריפת אתרים

נסו בעצמכם! אפשר ללחוץ, לחקור ולהריץ את התהליך תוך כדי הצפייה.

איך עובדת גריפת אתרים?

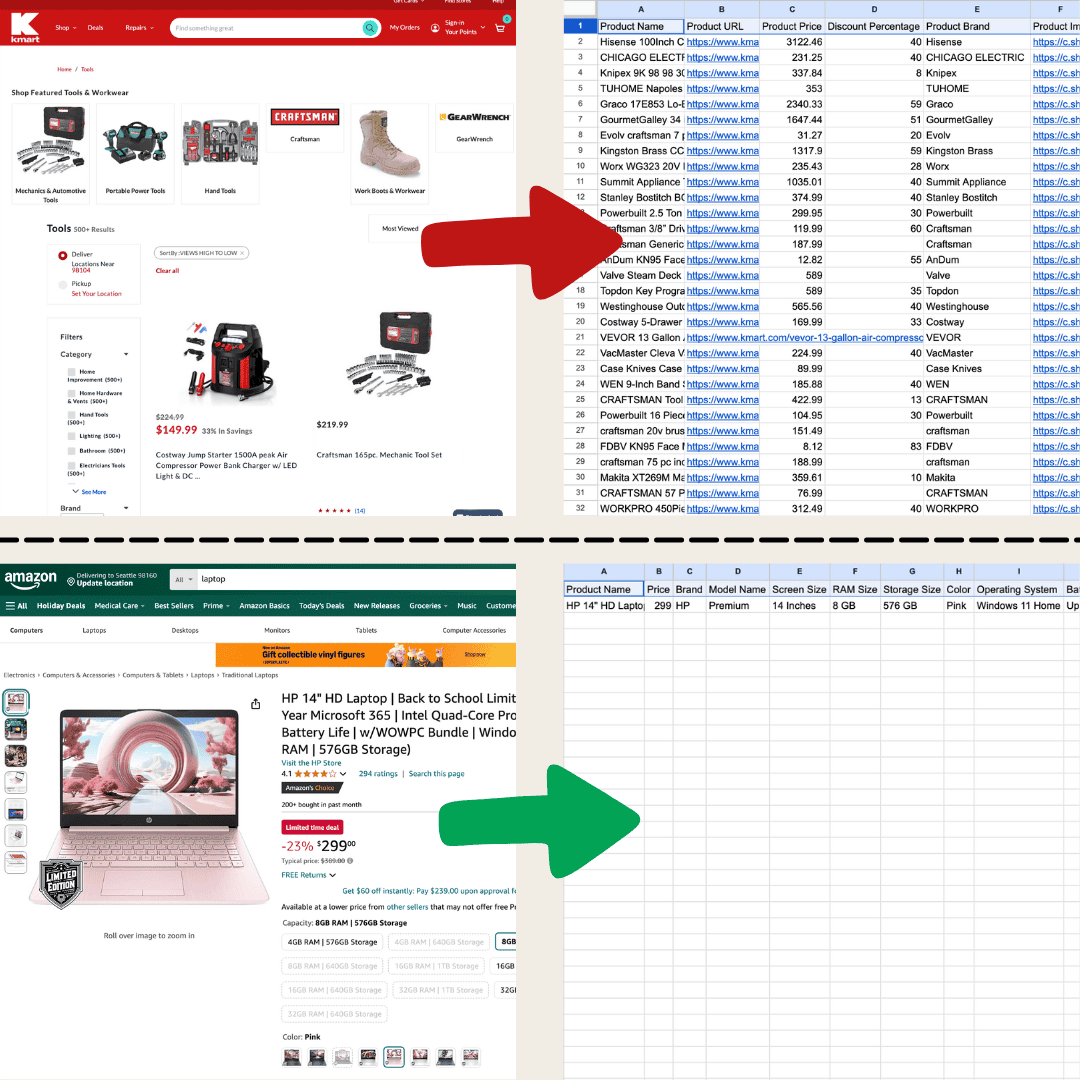

גריפת אתרים היא פשוט חילוץ נתונים מאתרים. אתם נותנים לכלי סדרת הוראות, והוא יוצא לאסוף טקסט, תמונות או כל מה שצריך לתוך טבלה מדף אינטרנט. זה שימושי לכל דבר — ממעקב אחר מחירים באתרי מסחר אלקטרוני ועד איסוף נתוני מחקר או אפילו פשוט בנייה של גיליון Excel או Google Sheets מסודר.

יצרתי את זה עם Thunderbit באמצעות AI Web Scraper.

יצרתי את זה עם Thunderbit באמצעות AI Web Scraper.

יש כמה דרכים לעשות את זה. ברמה הכי בסיסית, אפשר פשוט להעתיק ולהדביק בעצמכם, אבל זו הרבה עבודה אם יש המון נתונים. לכן רוב האנשים משתמשים באחת משלוש שיטות: כלי גריפה מסורתיים, כלי גריפת אתרים AI, או קוד מותאם אישית.

כלי גריפת אתרים מסורתיים עובדים באמצעות הגדרת כללים ספציפיים לגבי אילו נתונים לחלץ, בהתאם למבנה הדף. למשל, אפשר להגדיר אותם לאסוף שמות מוצרים או מחירים מתגי HTML מסוימים. הם עובדים הכי טוב באתרים שלא משתנים לעיתים קרובות, כי כל שינוי קטן בפריסה ידרוש מכם להיכנס ולכוון מחדש את הכלי.

שימוש בכלי גריפה מסורתי ידרוש זמן רב ללמידה, וסביר שתצטרכו עשרות קליקים כדי להשלים את ההגדרה.

שימוש בכלי גריפה מסורתי ידרוש זמן רב ללמידה, וסביר שתצטרכו עשרות קליקים כדי להשלים את ההגדרה.

כלי גריפת אתרים AI בעצם אומרים: ChatGPT קורא את כל האתר ואז מחלץ תוכן לפי מה שאתם צריכים. הוא יכול לטפל בו־זמנית בחילוץ נתונים, תרגום וסיכום. הם משתמשים בעיבוד שפה טבעית כדי לנתח ולהבין את מבנה האתר, ולכן הם מתמודדים טוב יותר עם שינויים באתר. אם האתר משנה קצת את הסידור של הסעיפים שלו — כלי גריפת אתרים AI עשוי להסתגל בלי שתצטרכו לכתוב שום דבר מחדש. לכן הם מעולים לאתרים שדורשים תחזוקה רבה או לאתרים עם מבנים מורכבים יותר.

קל להתחיל להשתמש בכלי הגריפת אתרים AI, ובכמה קליקים בלבד תקבלו נתונים מפורטים!

קל להתחיל להשתמש בכלי הגריפת אתרים AI, ובכמה קליקים בלבד תקבלו נתונים מפורטים!

אז במה כדאי לבחור? זה תלוי. אם נוח לכם להתעסק עם קוד או שאתם צריכים לאסוף כמויות גדולות של נתונים מאתר פופולרי, כלי גריפה מסורתיים יכולים להיות יעילים מאוד. אבל אם אתם חדשים בתחום או רוצים משהו שיודע להסתדר עם עדכוני אתר, כלי גריפת אתרים AI הם בדרך כלל הבחירה הטובה יותר. בדקו את הטבלה למטה לתרחישים מפורטים יותר!

| תרחיש | הבחירה הטובה ביותר |

|---|---|

| גריפה קלה בדפים כמו ספריות, אתרי קניות או כל אתר עם רשימה | כלי גריפת אתרים AI |

| הדף מכיל פחות מ־200 שורות נתונים, ובניית כלי גריפה מסורתי לוקחת יותר מדי זמן | כלי גריפת אתרים AI |

| הנתונים שצריך לחלץ חייבים להיות בפורמט מסוים לפני העלאה למקום אחר. לדוגמה: חילוץ פרטי קשר כדי להעלות ל־HubSpot. | כלי גריפת אתרים AI |

| אתרים בשימוש רחב ובקנה מידה גדול, כמו עשרות אלפי דפי מוצר ב־Amazon או רשימות נכסים ב־Zillow. | כלי גריפת אתרים מסורתי |

כלי ותוכנות גריפת האתרים הטובים ביותר במבט מהיר

| כלי | תמחור | תכונות עיקריות | יתרונות | חסרונות |

|---|---|---|---|---|

| Thunderbit | החל מ־9 דולר לחודש, כולל גרסה חינמית | כלי גריפת אתרים AI, מזהה ומעצב נתונים אוטומטית, תומך בכמה פורמטים, ייצוא בלחיצה אחת, ממשק ידידותי למשתמש. | ללא קוד, תמיכה ב־AI, אינטגרציות עם אפליקציות כמו Google Sheets | גריפה בקנה מידה גדול עשויה להיות איטית, ותכונות מתקדמות עשויות לעלות יותר |

| Browse AI | החל מ־48.75 דולר לחודש, כולל גרסה חינמית | ממשק ללא קוד, ניטור בזמן אמת, חילוץ נתונים בכמויות גדולות, אינטגרציית תהליכי עבודה. | ידידותי למשתמש, משתלב עם Google Sheets ו־Zapier | דפים מורכבים דורשים הגדרה נוספת, וגריפה בכמות גדולה עלולה לגרום ל־timeouts |

| Bardeen AI | החל מ־60 דולר לחודש, כולל גרסה חינמית | אוטומציה ללא קוד, אינטגרציה עם יותר מ־130 אפליקציות, MagicBox הופך משימות לתהליכי עבודה. | אינטגרציות נרחבות, ניתן להרחבה לעסקים | עקומת למידה חדה למשתמשים חדשים, ההגדרה גוזלת זמן |

| Web Scraper | חינם לשימוש מקומי, 50 דולר לחודש עבור הענן | יצירת משימות חזותית, תומך באתרים דינמיים (AJAX/JavaScript), גריפה בענן. | עובד היטב באתרים דינמיים | נדרש ידע טכני כדי להגדיר אותו בצורה מיטבית |

| Octoparse | החל מ־119 דולר לחודש, כולל גרסה חינמית | גריפה ללא קוד, זיהוי אוטומטי של רכיבי דף, גריפה בענן עם משימות מתוזמנות, ספריית תבניות לאתרים נפוצים. | תכונות חזקות לאתרים דינמיים, מתמודד עם מגבלות | אתרים מורכבים דורשים למידה |

| Diffbot | החל מ־299 דולר לחודש | API לחילוץ נתונים, API ללא חוקים, NLP לטקסט לא מובנה, גרף ידע נרחב. | חילוץ AI חזק, אינטגרציה נרחבת ל־API, גריפה בקנה מידה גדול | עקומת למידה למשתמשים לא טכניים, זמן הגדרה |

כלי גריפת האתרים הטוב ביותר בעידן ה־AI

Thunderbit הוא כלי אוטומציית אינטרנט מבוסס AI, חזק ונוח לשימוש, שמאפשר גם למי שאין לו ידע בקוד לחלץ ולארגן נתונים בקלות. עם , ה־ של Thunderbit מפשט את תהליך גריפת הנתונים — משתמשים יכולים לשלוף נתוני אינטרנט במהירות, בלי אינטראקציה ידנית עם רכיבי הדף ובלי להגדיר כלים נפרדים לכל פריסת דף.

תכונות עיקריות

- גמישות מבוססת AI: ה־AI Web Scraper של Thunderbit מזהה ומעצב נתוני אינטרנט אוטומטית, כך שאין צורך ב־CSS selectors.

- חוויית הגריפה הקלה ביותר: כל מה שצריך לעשות הוא ללחוץ על “AI suggest column” ואז ללחוץ על “Scrape” בדף שממנו רוצים לחלץ. זה הכול.

- תמיכה בפורמטי נתונים שונים: Thunderbit יכול לחלץ URLs, תמונות, ולהציג את הנתונים שנאספו בכמה פורמטים.

- עיבוד נתונים אוטומטי: ה־AI של Thunderbit יכול לעצב מחדש נתונים תוך כדי תנועה, כולל סיכום, סיווג ותרגום שלהם לפורמט הנדרש.

- ייצוא נתונים קל: ייצוא ל־Google Sheets, Airtable או Notion בלחיצה אחת, לפישוט ניהול הנתונים.

- ממשק ידידותי למשתמש: ממשק אינטואיטיבי שהופך אותו לנגיש למשתמשים בכל רמות המיומנות.

תמחור

Thunderbit מציע תוכניות מדורגות, החל מ־9 דולר לחודש עבור 5,000 קרדיטים. המחיר יכול להגיע עד 199 דולר עבור 240,000 קרדיטים. בנוסף, בתוכנית השנתית תקבלו את כל הקרדיטים מראש.

יתרונות:

- תמיכה חזקה ב־AI מפשטת את חילוץ ועיבוד הנתונים.

- ללא קוד, נגיש למשתמשים בכל רמות המיומנות.

- מושלם לגריפה קלה, למשל עבור ספריות, אתרי קניות וכו'.

- יכולות אינטגרציה גבוהות לייצוא ישיר לאפליקציות פופולריות.

חסרונות:

- גריפת נתונים בקנה מידה גדול עשויה לקחת זמן כדי להבטיח דיוק.

- חלק מהתכונות המתקדמות עשויות לדרוש מנוי בתשלום.

רוצים עוד מידע? התחילו ב, או גלו עם Thunderbit.

כלי גריפת האתרים הטוב ביותר לניטור נתונים ולחילוץ בכמות גדולה

Browse AI

Browse AI הוא כלי חזק לגריפת נתונים ללא קוד, שנועד לעזור למשתמשים לחלץ ולנטר נתונים בלי לכתוב קוד. ל־Browse AI יש כמה יכולות AI, אבל הוא עדיין לא ממש ברמה של גריפת AI מלאה. עם זאת, הוא בהחלט מקל על משתמשים להתחיל.

תכונות עיקריות

- ממשק ללא קוד: מאפשר למשתמשים ליצור תהליכי עבודה מותאמים אישית בכמה לחיצות פשוטות.

- ניטור בזמן אמת: משתמש בבוטים כדי לעקוב אחרי שינויים בדפי אינטרנט ולהעביר מידע מעודכן.

- חילוץ נתונים בכמויות גדולות: מסוגל לטפל בעד 50,000 רשומות נתונים בבת אחת.

- אינטגרציית תהליכי עבודה: מחבר כמה בוטים יחד לעיבוד נתונים מורכב יותר.

תמחור

המחיר מתחיל ב־48.75 דולר לחודש, כולל 2,000 קרדיטים. יש גם גרסה חינמית, עם 50 קרדיטים בחודש להתנסות בתכונות הבסיסיות.

יתרונות:

- כולל אינטגרציות עם Google Sheets ו־Zapier.

- בוטים מוכנים מראש מפשטים משימות נפוצות של חילוץ נתונים.

חסרונות:

- ייתכן שיידרש קונפיגורציה נוספת עבור דפים מורכבים.

- מהירות גריפה בכמות גדולה עשויה להשתנות, ולעיתים לגרום ל־timeouts.

כלי גריפת האתרים הטוב ביותר לאינטגרציית תהליכי עבודה

Bardeen AI

Bardeen AI הוא כלי אוטומציה ללא קוד שנועד לייעל תהליכי עבודה באמצעות חיבור בין אפליקציות שונות. למרות שהוא משתמש ב־AI כדי ליצור אוטומציות מותאמות אישית, הוא לא מציע את הגמישות של כלי גריפת AI מלא.

תכונות עיקריות

- אוטומציה ללא קוד: מאפשר למשתמשים להגדיר תהליכי עבודה בלחיצות.

- MagicBox: מתארים משימות בשפה פשוטה, ו־Bardeen AI ממיר אותן לתהליכי עבודה.

- אפשרויות אינטגרציה רחבות: משתלב עם יותר מ־130 אפליקציות, כולל Google Sheets, Slack ו־LinkedIn.

תמחור

המחיר מתחיל ב־60 דולר לחודש, כולל 1,500 קרדיטים (כ־1,500 שורות נתונים). הגרסה החינמית מציעה 100 קרדיטים בחודש להתנסות בתכונות הבסיסיות.

יתרונות:

- מגוון רחב של אינטגרציות תומך בצרכים עסקיים מגוונים.

- גמיש וניתן להרחבה לעסקים בכל גודל.

חסרונות:

- משתמשים חדשים עשויים להזדקק לזמן כדי ללמוד את הפלטפורמה המלאה.

- ההגדרה הראשונית עשויה לגזול זמן רב.

כלי גריפת האתרים החזותי הטוב ביותר למשתמשים מנוסים

Web Scraper

כן, קראתם נכון: הכלי נקרא "Web Scraper". Web Scraper הוא תוסף דפדפן פופולרי ל־Chrome ול־Firefox שמאפשר למשתמשים לחלץ נתונים בלי קוד, ומציע דרך חזותית ליצור משימות גריפה. עם זאת, ייתכן שתצטרכו להשקיע כמה ימים בצפייה בלמידה מההדרכות שלמעלה כדי לשלוט בכלי הזה באמת. אם אתם רוצים להפוך את הגריפה לקלה יותר למוח שלכם, בחרו ב־AI Web Scraper.

תכונות עיקריות

- יצירה חזותית: מאפשר למשתמשים להגדיר משימות גריפה על ידי לחיצה על רכיבי הדף.

- תמיכה באתרים דינמיים: יכול להתמודד עם בקשות AJAX ועם JavaScript באתרים דינמיים.

- גריפה בענן: ניתן לתזמן משימות דרך Web Scraper Cloud לגריפה תקופתית.

תמחור

חינם לשימוש מקומי; תוכניות בתשלום מתחילות ב־50 דולר לחודש עבור תכונות ענן.

יתרונות:

- עובד היטב באתרים דינמיים.

- חינם לשימוש מקומי.

חסרונות:

- נדרש ידע טכני להגדרה אופטימלית.

- נדרשת בדיקה מורכבת עבור שינויים.

כלי גריפת האתרים הטוב ביותר להימנעות מחסימת IP וזיהוי בוטים

Octoparse

Octoparse הוא תוכנה ורסטילית למשתמשים טכניים יותר, שמאפשרת לאסוף ולנטר נתוני אינטרנט ספציפיים בלי קוד, ומתאימה במיוחד לצרכי נתונים בקנה מידה גדול. Octoparse לא מסתמך על הדפדפן של המשתמש כדי לפעול; במקום זאת, הוא משתמש בשרתי ענן לחילוץ נתונים. לכן הוא יכול להציע שיטות שונות לעקיפת חסימות IP וזיהוי בוטים מסוימים באתרים.

תכונות עיקריות

- פעולה ללא קוד: משתמשים יכולים ליצור משימות גריפה בלי לכתוב קוד, כך שהכלי נגיש למשתמשים ברמות טכניות שונות.

- זיהוי אוטומטי חכם: מזהה אוטומטית נתוני דף, מאתר במהירות רכיבים זמינים לגריפה ומפשט את ההגדרה.

- גריפה בענן: תומך בגריפת נתונים בענן 24/7 עם משימות גריפה מתוזמנות לשליפה גמישה של נתונים.

- ספריית תבניות נרחבת: מציע מאות תבניות מוכנות מראש, כך שמשתמשים יכולים לגשת במהירות לנתונים מאתרים פופולריים בלי הגדרה מורכבת.

תמחור

תוכנית התמחור של Octoparse מתחילה ב־119 דולר לחודש, כולל 100 משימות. יש גם גרסה חינמית עם 10 משימות בחודש כדי לבדוק את הפונקציונליות הבסיסית שלו.

יתרונות:

- תכונות חזקות תומכות בגריפת אתרים דינמיים עם גמישות גבוהה.

- מספק פתרונות לטיפול במגבלות גריפה ובבעיות של תוכן דינמי.

חסרונות:

- מבני אתרים מורכבים עשויים לדרוש יותר זמן להגדרה.

- משתמשים חדשים עשויים להזדקק לזמן כדי ללמוד את שיטות השימוש.

כלי גריפת האתרים הטוב ביותר ל־API מתקדם לחילוץ נתונים מבוסס AI

Diffbot

Diffbot הוא כלי מתקדם לחילוץ נתוני אינטרנט, שמשתמש ב־AI כדי להפוך תוכן אינטרנט לא מובנה לנתונים מובנים. עם APIs חזקים וגרף ידע, Diffbot עוזר למשתמשים לחלץ, לנתח ולנהל מידע מהאינטרנט, ומתאים למגוון תעשיות ויישומים.

תכונות עיקריות

- API לחילוץ נתונים: ל־Diffbot יש API לחילוץ נתונים ללא כללים, כך שמשתמשים יכולים פשוט לספק URL והחילוץ יתבצע אוטומטית, בלי להגדיר כללים מותאמים אישית לכל אתר.

- API לעיבוד שפה טבעית: מחלץ ישויות, קשרים ורגש מובנים מטקסט לא מובנה, ועוזר למשתמשים לבנות גרפי ידע משלהם.

- גרף ידע: ל־Diffbot יש אחד מגרפי הידע הגדולים ביותר, המחבר נתוני ישויות נרחבים, כולל פרטים על אנשים וארגונים.

תמחור

תוכנית התמחור של Diffbot מתחילה ב־299 דולר לחודש, כולל 250,000 קרדיטים (המקבילים לכ־250,000 חילוצים של דפי אינטרנט מבוססי API).

יתרונות:

- יכולות חזקות לחילוץ נתונים ללא כללים, עם גמישות גבוהה.

- אפשרויות אינטגרציה נרחבות ל־API, לשילוב קל עם מערכות קיימות.

- תומך בגריפת נתונים בקנה מידה גדול, ומתאים ליישומים ברמת ארגון.

חסרונות:

- ההגדרה הראשונית עשויה לדרוש זמן למידה מסוים עבור משתמשים לא טכניים.

- כדי להשתמש ב־API, המשתמשים חייבים לכתוב תוכנית שתתקשר אליו.

למה אפשר להשתמש בכלי גריפה?

אם אתם חדשים בעולם גריפת האתרים, הנה כמה מקרי שימוש נפוצים שיעזרו לכם להתחיל. הרבה אנשים משתמשים בכלי גריפה כדי לאחזר רשימות מוצרים מ־Amazon, לשלוף נתוני נדל״ן מ־Zillow או לאסוף פרטי עסקים מ־Google Maps. אבל זה רק ההתחלה — אפשר להשתמש ב־Thunderbit כדי לאסוף נתונים כמעט מכל אתר, לייעל משימות ולחסוך זמן בשגרת העבודה היומית שלכם. בין אם מדובר במחקר, מעקב אחר מחירים או בניית מסדי נתונים, גריפת אתרים פותחת אינספור דרכים להפוך את נתוני האינטרנט למשהו שעובד בשבילכם.

שאלות נפוצות

-

האם גריפת אתרים היא חוקית?

גריפת אתרים היא בדרך כלל חוקית, אבל חייבים לפעול לפי תנאי השימוש של האתר ולפי אופי הנתונים שניגשים אליהם. תמיד כדאי לבדוק את המדיניות הרלוונטית ולציית להנחיות החוק.

-

האם צריך ידע בתכנות כדי להשתמש בכלי גריפת אתרים?

רוב הכלים שמופיעים כאן לא דורשים ידע בתכנות, אבל כלים כמו Octoparse ו־Web Scraper עשויים להיות יעילים יותר אם יש למשתמשים ידע בסיסי במבני אינטרנט וחשיבה תכנותית לשימוש מיטבי.

-

האם יש כלי גריפת אתרים בחינם?

כן, יש כלים חינמיים כמו BeautifulSoup, Scrapy ו־Web Scraper, וחלק מהכלים מציעים גם תוכניות חינמיות עם תכונות מוגבלות.

-

מהם האתגרים הנפוצים בגריפת אתרים?

אתגרים נפוצים כוללים טיפול בתוכן דינמי, CAPTCHAs, חסימת IP ומבני HTML מורכבים. כלים וטכניקות מתקדמות יכולים להתמודד עם הבעיות האלה ביעילות.

למדו עוד:

-

השתמשו ב־AI כדי לעבוד בלי מאמץ.