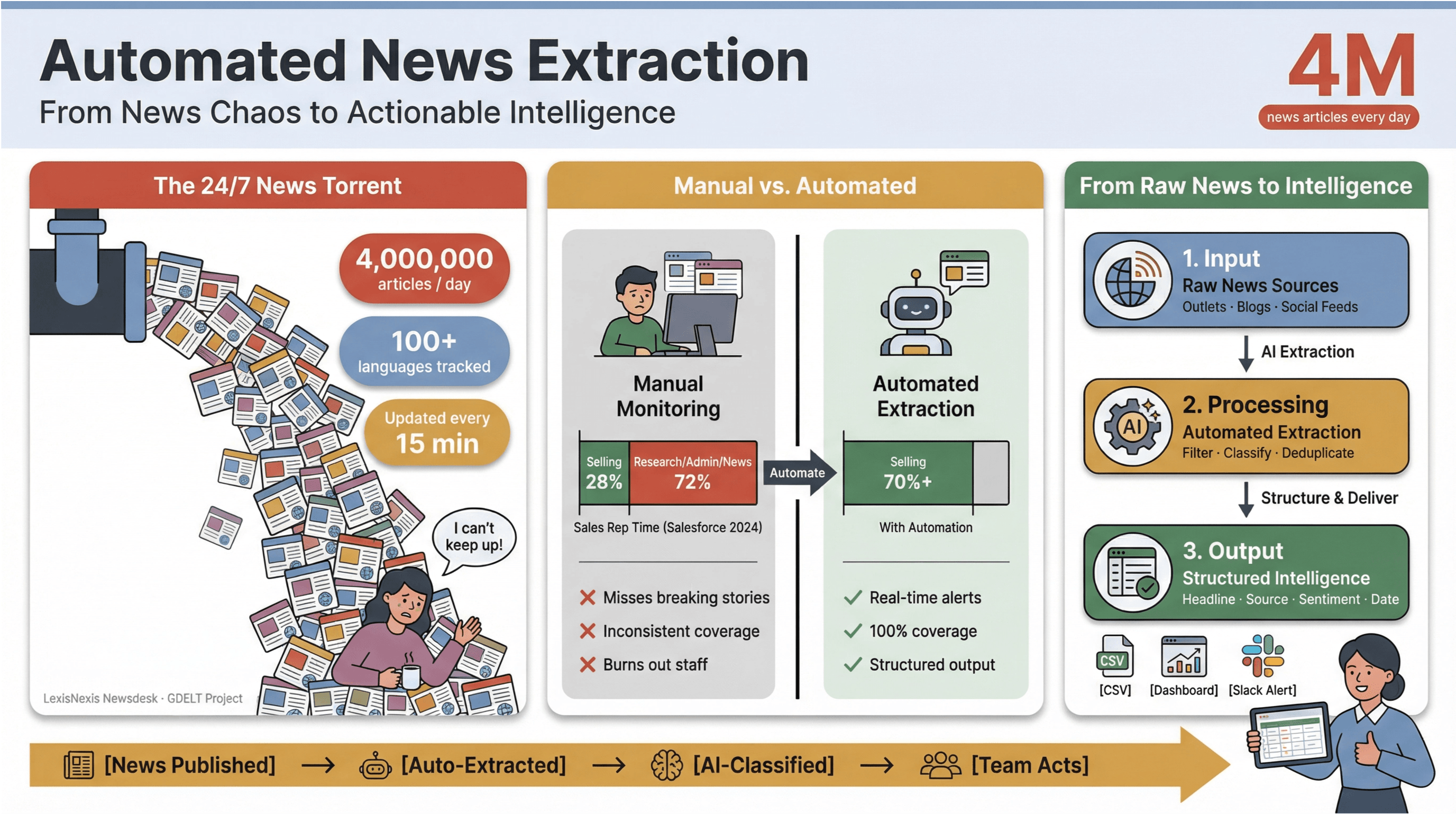

הקצב של החדשות הדיגיטליות היום פשוט מסחרר. בכל דקה מתפרסמות, מתעדכנות או נערכות בשקט אלפי כותרות — מאתרי חדשות מרכזיים, דרך בלוגים נישתיים ועד פידים חברתיים. כדי לשים את זה בפרופורציה, קולטת יותר מ־4 מיליון כתבות חדשות בכל יום, בעוד ש- עוקב אחר חדשות ביותר מ־100 שפות ומעדכן את הפיד הגלובלי שלו כל 15 דקות. לכל מי שעובד במדיה, במחקר או ב־business intelligence, לנסות לעמוד בקצב של המבול הזה ידנית זה כמו לרוקן ספינה טובעת עם ספל קפה.

ראיתי מקרוב איך מעקב ידני אחר חדשות שואב זמן ומבזבז משאבים. צוותי מכירות בפועל מבלים פחות משליש מהשבוע שלהם במכירה — — ואת שאר הזמן הם מאבדים למחקר, אדמיניסטרציה, וכן, גם להחלפת טאבים אינסופית בין אתרי חדשות. לכן חילוץ חדשות אוטומטי הפך לנשק הסודי של צוותים מודרניים: זו הדרך היחידה להפוך את הכאוס של מחזור החדשות 24/7 למודיעין מובנה ובר־פעולה — בלי לשחוק את הצוות ובלי לפספס את הסיפורים החשובים באמת.

בואו נצלול למה בעצם מתכוונים כשאומרים חילוץ חדשות אוטומטי, למה הוא חיוני לכל מי שאכפת לו מנתוני חדשות בזמן אמת, ואיך בונים תהליך עבודה חזק ותואם מדיניות בעזרת הכלים הטובים ביותר — כולל איך הופך את כל התהליך לפשוט באופן מפתיע, אפילו עבור אנשים לא טכניים כמו אמא שלי.

חילוץ חדשות אוטומטי: למה הוא חיוני לחדרי חדשות מודרניים

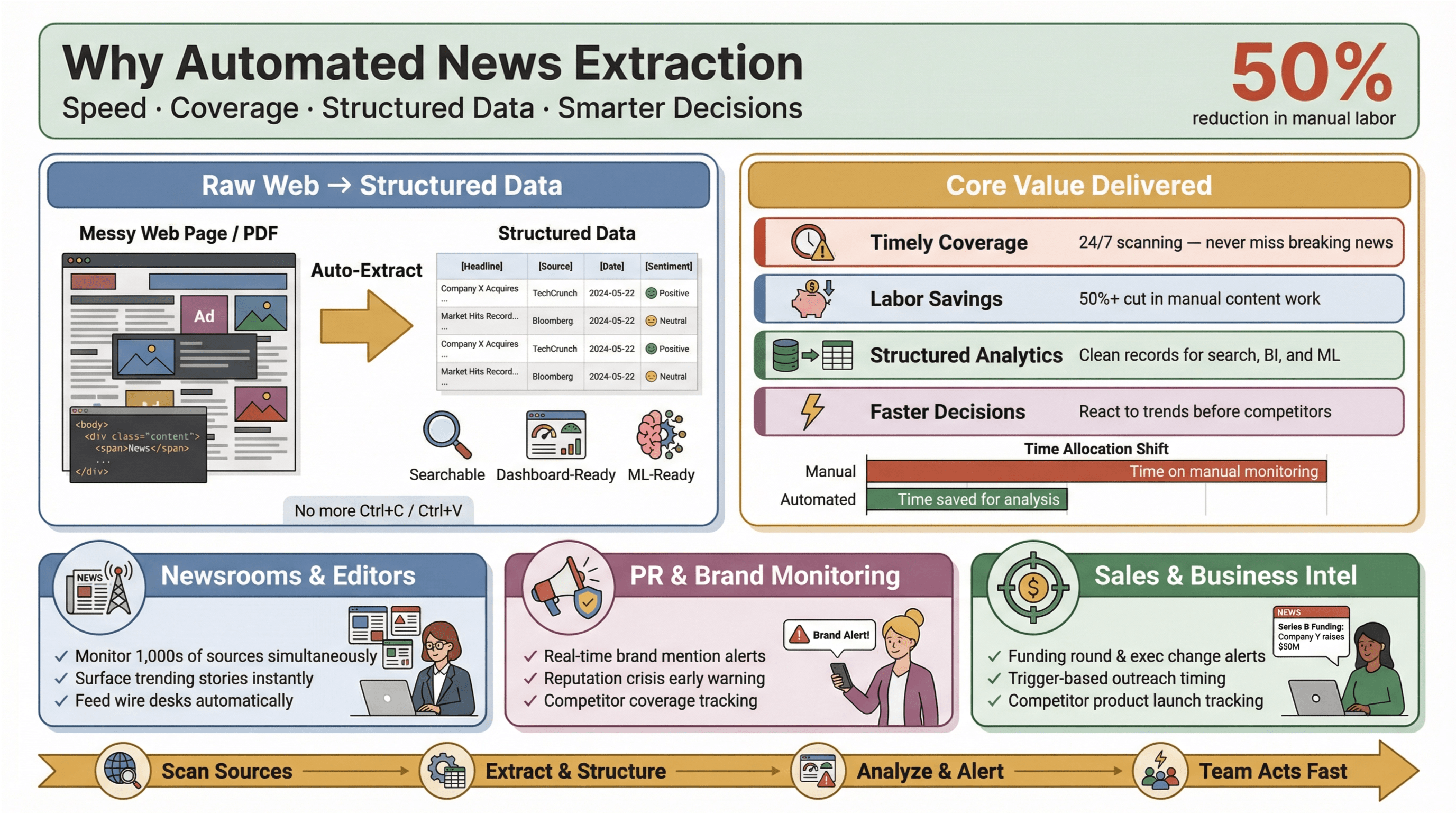

חילוץ חדשות אוטומטי הוא בדיוק מה שזה נשמע: שימוש בתוכנה כדי לאסוף תוכן חדשותי באופן אוטומטי ולהפוך אותו לנתונים מובנים וניתנים לחיפוש — תחשבו על שורות ועמודות במקום על דפי אינטרנט מבולגנים או קובצי PDF. בפועל, זה אומר שאתם יכולים לנטר מאות (או אלפי) מקורות, לחלץ שדות מרכזיים כמו כותרת, חותמת זמן, מחבר ותוכן הכתבה, ולהזרים את הנתונים האלה לדשבורדים, להתראות או למערכות אנליטיקה בהמשך הדרך — בלי לגעת פעם אחת ב־Ctrl+C/Ctrl+V.

למה זה חשוב? כי בנוף החדשות של היום, מהירות היא הכול. בין אם אתם עורכי חדשות, מנהלי PR שעוקבים אחרי אזכורי מותג, או אנליסטים עסקיים שמנטרים מהלכי מתחרים, מי שיודע ראשון יכול לעשות את ההבדל בין תפיסת הזדמנות לבין רדיפה אחריה. כלי חילוץ אוטומטיים מאפשרים גם לצוותים קטנים “להכות מעל המשקל” שלהם — לאסוף נתוני חדשות בזמן אמת מכל האינטרנט, להפחית עומס ידני, ולהבליט את הסיפורים שהכי חשובים.

למה זה חשוב? כי בנוף החדשות של היום, מהירות היא הכול. בין אם אתם עורכי חדשות, מנהלי PR שעוקבים אחרי אזכורי מותג, או אנליסטים עסקיים שמנטרים מהלכי מתחרים, מי שיודע ראשון יכול לעשות את ההבדל בין תפיסת הזדמנות לבין רדיפה אחריה. כלי חילוץ אוטומטיים מאפשרים גם לצוותים קטנים “להכות מעל המשקל” שלהם — לאסוף נתוני חדשות בזמן אמת מכל האינטרנט, להפחית עומס ידני, ולהבליט את הסיפורים שהכי חשובים.

וההשפעה אמיתית: מחקרים מראים שאוטומציה יכולה לקצץ את העבודה הידנית בעדכוני תוכן ב־לפחות 50%, ולפנות זמן לניתוח ולקבלת החלטות אמיתיים.

הערך המרכזי של חילוץ חדשות אוטומטי בתעשיית החדשות

בואו נרד לקרקע. מה בעצם חילוץ חדשות אוטומטי נותן לחדרי חדשות ולצוותים עסקיים?

- כיסוי מקיף ובזמן: לא מפספסים עוד סיפורי שבירה רק כי מישהו שכח לבדוק פיד.

- חיסכון בעבודה ובעלויות: צוותים קטנים ובינוניים יכולים לנטר כמויות מקורות כמו הגדולים — בלי לגייס צבא של מתמחים.

- נתונים מובנים לניתוח: במקום לנבור בכתבות לא מובנות, מקבלים רשומות נקיות ומסודרות שמוכנות לחיפוש, לדשבורדים וללמידת מכונה.

- החלטות מהירות וחכמות יותר: נתוני חדשות בזמן אמת מאפשרים להגיב לשינויים בשוק, למשברי PR או לטרנדים מתפתחים לפני המתחרים.

קחו לדוגמה PR ותקשורת: פלטפורמות כמו ו- מציבות ניטור מדיה בזמן אמת כמרכיב חיוני להגנה על מוניטין ולתגובה מהירה מול סיקור מזיק. במכירות, התראות חדשות בזמן אמת הופכות ל“כרטיסי טריגר” לאיתור לידים — תחשבו על סבבי גיוס, החלפת הנהלה או השקות מוצרים שמפעילים פנייה בדיוק ברגע הנכון.

בחירת כלי גריפת חדשות מתאימים לתרחישים שונים

לא כל כלי גריפת חדשות נולדו שווים. הבחירה הנכונה תלויה במטרות שלכם, ברמת הנוחות הטכנית שלכם ובסוגי החדשות שמעניינים אתכם. הנה מסגרת שתעזור לכם לבחור את מה שהכי מתאים:

הערכת קלות השימוש והנגישות

עבור רוב המשתמשים העסקיים והעיתונאים, קלות השימוש היא תנאי שאי אפשר לוותר עליו. אתם רוצים כלי שעובד ישר מהקופסה, בלי קוד ובלי הקמה מסובכת. פלטפורמות no-code ו־low-code כמו , ו- מאפשרות לבנות סקרייפרים בצורה ויזואלית — פשוט מצביעים, לוחצים ומחלצים.

Thunderbit, במיוחד, בולט בזכות תהליך דו-שלבי: מתארים מה רוצים, נותנים ל־AI להציע שדות, ואז לוחצים על “Scrape”. אפילו משתמשים לא טכניים יכולים להקים צינור נתוני חדשות בתוך דקות, לא שעות.

שיקולי אבטחה ופרטיות נתונים

עם נתונים גדולים באה גם אחריות גדולה. כלי גריפת חדשות ניגשים לעיתים לתוכן רגיש, ולכן אבטחה ותאימות חייבות להיות בראש סדר העדיפויות. חפשו:

- הצפנת נתונים (במעבר ובמנוחה)

- מדיניות פרטיות ברורה (Thunderbit, למשל, מצהירה שאינה מוכרת נתוני משתמשים וניגשת רק לתוכן שאתם בוחרים לגרוף)

- הרשאות מפורטות (במיוחד לתוספי דפדפן — תמיד בדקו לאילו נתונים הכלי יכול לגשת)

- עמידה בחוקים מקומיים (GDPR, CCPA, ועבור משתמשים באיחוד האירופי גם )

לשקט נפשי נוסף, בחרו ספקים מוכרים, ודאו את הרשאות התוסף, והגבילו את הגישה רק למה שנחוץ.

התאמת הכלים לסוגי חדשות ולצרכים של התעשייה

יש כלים שמצטיינים בתחומי חדשות מסוימים:

- פיננסים: APIs כמו ו- מציעים אשכולות, סנטימנט וזיהוי אירועים לחדשות פיננסיות.

- טכנולוגיה וסטארטאפים: גריפה מותאמת אישית עם Thunderbit או Octoparse מאפשרת לכוון לבלוגים נישתיים, הודעות לעיתונות או רשימות אירועים.

- פוליטיקה ומדיניות: מאגרי מידע מורשים כמו ו- מספקים גישה למקורות פרימיום ולארכיונים.

אם אתם צריכים לנטר שילוב של מקורות מרכזיים, נישתיים ובינלאומיים — כולל כאלה בלי APIs — סקרייפרים גמישים מבוססי AI כמו Thunderbit הם הבחירה הטובה ביותר.

היתרונות הייחודיים של Thunderbit לחילוץ נתוני חדשות בזמן אמת

עכשיו בואו נדבר על מה שהופך את לבחירה בולטת לחילוץ חדשות אוטומטי — במיוחד אם אתם רוצים נתוני חדשות בזמן אמת בלי כאבי הראש הטכניים.

Thunderbit הוא תוסף Chrome של web scraper מבוסס AI שנועד למשתמשים עסקיים, עיתונאים ואנליסטים שזקוקים לתוכן חדשות עדכני ומובנה מכל אתר. הנה למה הוא הפך לכלי המועדף עליי:

- AI Suggest Fields: Thunderbit קורא את עמוד החדשות ומציע אוטומטית את העמודות הטובות ביותר לחילוץ — כותרת, חותמת זמן, מחבר, תקציר ועוד. אין צורך להתעסק עם selectors או templates.

- גריפת תת-עמודים: צריכים את הכתבה המלאה, לא רק את הכותרת? Thunderbit יכול לבקר בכל קישור חדשות, לחלץ את הטקסט המלא, ישויות ותגיות, ולמזג הכול לטבלה אחת מובנית.

- ייצוא בכמות ועדכונים מיידיים: אפשר לייצא את נתוני החדשות ישירות ל־Excel, Google Sheets, Airtable או Notion בלחיצה אחת. אין יותר מרתוני העתק-הדבק או התעסקות עם CSV.

- גריפה מתוזמנת: הגדירו משימות חוזרות (שעה, יום או מרווחים מותאמים) כדי לשמור על צינור החדשות שלכם רענן — אידיאלי לחדשות מתפרצות, ניטור שוק או מחקר מתמשך.

- התאמה: ה־AI של Thunderbit מסתגל לשינויים בפריסה ולאתרי חדשות ארוכי-זנב, כך שאתם משקיעים פחות זמן בתיקון סקרייפרים שבורים ויותר זמן בניתוח הנתונים.

עם יותר מ- ודירוג של 4.8 כוכבים, צוותים ברחבי העולם סומכים עליו לכל דבר — מניטור PR ועד מודיעין תחרותי.

זיהוי שדות מונחה AI וגריפת תת-עמודים

אחת מהיכולות החזקות של Thunderbit היא זיהוי שדות מונחה AI. פשוט לוחצים על “AI Suggest Fields”, והכלי סורק את עמוד החדשות — מזהה שדות מרכזיים כמו כותרת, תאריך, מחבר ותקציר. אפשר לכוונן או להוסיף שדות מותאמים אישית (למשל, “סמנו את הכתבה כ־‘רווחים