יש משהו קצת 이상하게 만족스러운 בלראות רשימה מסודרת ומלאה של כל עמוד באתר—כמו הרגע שבו סוף סוף מוצאים את כל הגרביים אחרי כביסה. אבל אם אי פעם ניסיתם השגת עמודי אתר לצורך ביקורת תוכן, מיגרציה, או סתם כדי להבין מה מסתתר “במרתף הדיגיטלי”, אתם יודעים שזה כמעט אף פעם לא פשוט כמו שזה נשמע. ראיתי צוותים מבזבזים שעות (ולפעמים ימים) על חיבור רשימות ממפות אתר, חיפושי Google וייצוא מה‑CMS—רק כדי לגלות שעדיין חסרים להם עמודים חבויים או דינמיים. ואל תגרמו לי להתחיל לספר על הפעם שניסיתי לעזור לחבר לייצא את כל כתובות ה‑URL מ‑WordPress—בואו נגיד שהיה הרבה 커피 וקצת חרדה קיומית.

החדשות הטובות? לא חייבים להמשיך לשחק מחבואים דיגיטלי עם האתר שלכם. במדריך הזה אעבור איתכם על כל השיטות המרכזיות ל‑איתור כתובות URL באתר—מהשיטות הוותיקות ועד המודרניות—כולל איך כלים מבוססי AI כמו יכולים להפוך את התהליך למהיר משמעותית, מקיף יותר, וכן… אפילו די 재밌게. בין אם אתם אנשי שיווק, מפתחים, או פשוט מי שנפל עליו התפקיד “להביא את כל ה‑URLs”, תמצאו כאן צעדים פרקטיים, דוגמאות מהשטח והשוואות כנות שיעזרו לבחור את הגישה הנכונה לצוות שלכם.

למה בכלל צריך רשימה של עמודי אתר: שימושים מהעולם האמיתי

לפני שנצלול ל”איך”, בואו נדבר על ה”למה”. למה כל כך הרבה צוותים צריכים לאתר כתובות URL באתר? מסתבר שזה לא רק עניין של SEO—זו דרישה שחוזרת שוב ושוב בשיווק, מכירות, IT ותפעול. הנה כמה מהתרחישים הנפוצים:

- ביקורות תוכן ו‑SEO ואסטרטגיה: ביקורות תוכן הפכו לשגרה, כאשר . רשימת URL מלאה היא הבסיס למדידת ביצועים, עדכון תכנים ישנים ושיפור דירוגים. למעשה, .

- עיצוב מחדש ומיגרציות אתר: ), וכל מיגרציה דורשת מיפוי של כתובות קיימות כדי להימנע מקישורים שבורים ואובדן SEO.

- ציות ותחזוקה: צוותי תפעול צריכים לאתר עמודים יתומים או מיושנים—לפעמים מיקרו‑אתרים של קמפיינים ישנים שעדיין באוויר, רק מחכים להביך מישהו.

- ניתוח מתחרים: צוותי מכירות ושיווק אוספים איסוף נתונים מהאינטרנט מאתרי מתחרים כדי לרשום עמודי מוצר, תמחור או פוסטים בבלוג—בחיפוש אחר פערים או לידים.

- יצירת לידים ואאוטרי׳ץ: צוותי מכירות צריכים לעיתים להרכיב רשימות של מאתרי סניפים, ספריות דילרים או עמודי חברים לצורך פנייה.

- אינוונטור תוכן: אנשי תוכן מנהלים רשימה מתעדכנת של פוסטים, דפי נחיתה, PDFs ועוד—כדי להימנע מכפילויות ולמקסם ערך.

הנה טבלה קצרה שמסכמת את התרחישים:

| תרחיש | מי צריך את זה | למה רשימת עמודים מלאה חשובה |

|---|---|---|

| ביקורת SEO / ביקורת תוכן | מומחי SEO, אנשי שיווק תוכן | להעריך כל פריט תוכן; עמודים חסרים = ניתוח חלקי והחמצת הזדמנויות אופטימיזציה |

| מיגרציה/עיצוב מחדש של אתר | מפתחי ווב, SEO, IT, שיווק | למפות כתובות ישנות לחדשות, להגדיר הפניות, למנוע קישורים שבורים ואובדן SEO |

| ניתוח מתחרים | שיווק, מכירות | לראות את כל עמודי המתחרה לתובנות; עמודים חבויים יכולים לחשוף הזדמנויות |

| יצירת לידים | צוותי מכירות | לאסוף עמודי קשר/משאבים לאאוטרי׳ץ; מבטיח שלא מפספסים ליד פוטנציאלי |

| אינוונטור תוכן | שיווק תוכן | לשמור מאגר מעודכן, לזהות פערים, להימנע מכפילויות ולסקור עמודים ישנים |

וההשפעה של עמודים חסרים או חבויים? היא אמיתית. דמיינו שאתם מתכננים עיצוב מחדש ושוכחים דף נחיתה נסתר שעדיין ממיר, או מבצעים ביקורת ומפספסים 5% מהעמודים כי הם לא מאונדקסים. זה יכול להיות אובדן הכנסות, פגיעה ב‑SEO, ולפעמים גם כאב ראש תקשורתי שלא ראיתם מגיע.

דרכים נפוצות לאיתור כתובות URL באתר: השיטות המסורתיות

אוקיי, בואו ניכנס לפרטים: איך בפועל משיגים רשימה של עמודי אתר? יש כמה שיטות מוכרות—חלקן מהירות ומלוכלכות, אחרות יסודיות יותר (ולפעמים גם כואבות יותר). כך הן נראות:

חיפוש ב‑Google ואופרטורים

איך זה עובד:

פותחים Google ומקלידים site:yourwebsite.com. Google יציג את כל העמודים שהוא אינדקס עבור הדומיין. אפשר לצמצם עם מילות מפתח או תיקיות (למשל site:yourwebsite.com/blog).

מה מקבלים:

רשימה של עמודים מאונדקסים—כלומר, מה ש‑Google מכיר באתר.

מגבלות:

- מציג רק מה שמאונדקס, לא בהכרח את כל מה שקיים

- לרוב נעצר אחרי כמה מאות תוצאות, גם באתרים גדולים

- מפספס עמודים חדשים, חבויים או כאלה שנמנע מהם אינדוקס בכוונה

מתי להשתמש:

מצוין להצצה מהירה או לאתרים קטנים, אבל לא לביקורת מקיפה.

בדיקת robots.txt ו‑Sitemap.xml

איך זה עובד:

נכנסים ל‑yourwebsite.com/robots.txt ומחפשים שורות “Sitemap:”. פותחים את מפת האתר (בדרך כלל yourwebsite.com/sitemap.xml או /sitemap_index.xml). מפות אתר מציגות URLs שבעל האתר רוצה שיאונדקסו.

מה מקבלים:

רשימה של עמודים מרכזיים—לעיתים כל הפוסטים, עמודי מוצר וכו׳. .

מגבלות:

- מפת אתר כוללת רק עמודים שבעל האתר רוצה שיאונדקסו—עמודים חבויים או יתומים לרוב לא יופיעו

- מפות אתר עלולות להיות לא מעודכנות אם לא מייצרים אותן מחדש

- יש אתרים עם כמה מפות אתר; לפעמים צריך לחפש

מתי להשתמש:

מעולה אם אתם בעלי האתר או רוצים להבין מהר מה העמודים המרכזיים של מתחרה. רק זכרו: אתם רואים את מה שבעל האתר בחר להציג.

כלי “עכביש” ל‑SEO וסורקי אתרים

איך זה עובד:

כלים כמו Screaming Frog, Sitebulb או DeepCrawl מדמים זחלן של מנוע חיפוש. מזינים את כתובת האתר, והכלי עוקב אחרי קישורים פנימיים ובונה רשימת עמודים שנמצאו.

מה מקבלים:

פוטנציאלית כל עמוד שמקושר באתר, יחד עם נתונים כמו קודי סטטוס ותגיות מטא.

מגבלות:

- עמודים יתומים (שלא מקושרים משום מקום) לא יימצאו אלא אם מזינים אותם ידנית

- עמודים דינמיים או כאלה שנוצרים ב‑JavaScript עלולים להחמיץ, אלא אם הכלי תומך בגלישה Headless

- סריקה של אתרים גדולים יכולה לקחת זמן רב ולצרוך הרבה זיכרון

- דורש הגדרה וידע טכני

מתי להשתמש:

אידיאלי למומחי SEO או מפתחים שעושים ביקורות עמוקות. פחות ידידותי למי שלא טכני.

Google Search Console ו‑Analytics

איך זה עובד:

אם יש לכם גישה לאתר, אפשר לייצא רשימות URLs מ‑Google Search Console (GSC) ומ‑Analytics.

- GSC: דוחות כיסוי אינדקס וביצועים מציגים URLs מאונדקסים ומוחרגים (עד 1,000 בכל ייצוא, יותר דרך API).

- Analytics: מציג את כל העמודים שקיבלו תנועה בתקופה שנבחרה (GA4 מאפשר עד 100,000 שורות בייצוא).

מגבלות:

- GSC ו‑Analytics מציגים רק עמודים ש‑Google מכיר או שקיבלו תנועה

- מגבלות ייצוא (1,000 שורות ב‑GSC, 100k ב‑GA4)

- דורש בעלות/אימות; לא מתאים למחקר מתחרים

- עמודים ללא תנועה או ללא אינדוקס לא יופיעו

מתי להשתמש:

מצוין לאתר שלכם, במיוחד לפני מיגרציה או ביקורת. לא מתאים לניתוח מתחרים.

לוחות ניהול של CMS

איך זה עובד:

אם האתר שלכם על WordPress, Shopify או CMS אחר, לרוב אפשר לייצא רשימת עמודים ופוסטים ישירות מלוח הניהול (לפעמים בעזרת תוסף).

מה מקבלים:

רשימה של כל פריטי התוכן—עמודים, פוסטים, מוצרים וכו׳.

מגבלות:

- דורש גישת אדמין

- לא תמיד כולל עמודים שאינם “תוכן” או עמודים דינמיים

- אם האתר בנוי מכמה מערכות (בלוג, חנות, דוקומנטציה), צריך לאחד כמה ייצואים

מתי להשתמש:

הכי טוב לבעלי אתר שעושים אינוונטור תוכן או גיבוי. לא עוזר למחקר מתחרים.

המגבלות של השיטות המסורתיות להשגת עמודי אתר

בואו נהיה כנים: אף אחת מהשיטות האלה לא מושלמת. הנה סיכום הפערים העיקריים:

- מורכבות טכנית: הרבה שיטות דורשות מיומנויות טכניות או כלים ייעודיים. למי שלא טכני זה יכול להיות מחסום אמיתי. ביקורת תוכן ידנית יכולה לקחת .

- כיסוי חלקי: כל שיטה מפספסת סוגים מסוימים של עמודים—האינדקס של Google מפספס עמודים חדשים/לא מאונדקסים, מפות אתר מפספסות יתומים, זחלנים מפספסים לא מקושרים או דינמיים, וייצוא CMS מפספס כל מה שמחוץ למערכת.

- מאמץ ידני וזמן: לרוב צריך לשלב כמה מקורות, להסיר כפילויות ולנקות—עבודה סיזיפית ומועדת לטעויות. אנשים אפילו משתפים “טריקים” כמו העתקה ממפת אתר ל‑Excel או שימוש בסקריפטים בשורת פקודה.

- תחזוקה ורעננות: הרשימות מתיישנות מהר. בשיטות מסורתיות צריך להריץ מחדש בכל שינוי באתר.

- גישה והרשאות: חלק מהשיטות דורשות בעלות על האתר או הרשאות אדמין—לא רלוונטי למחקר מתחרים.

- עודף נתונים: כלי SEO יכולים להציף בנתונים טכניים כשכל מה שרציתם הוא רשימת URLs פשוטה.

בקיצור, התהליך המסורתי הוא כמו “לנסות לאפות עוגה כשהמתכון משתנה כל הזמן והתנור מדי פעם נועל אותך בחוץ”. (כן, זו אנלוגיה אמיתית של אסטרטג תוכן—ואני לגמרי מזדהה.)

הכירו את Thunderbit: הדרך מבוססת ה‑AI לאיתור כתובות URL באתר

ועכשיו לחלק הכיפי. מה אם הייתם יכולים פשוט לבקש מעוזר “לעבור על האתר הזה ולהוציא לי רשימה של כל העמודים”, והוא באמת היה עושה את זה—בלי קוד ובלי כאב ראש? זה בדיוק הרעיון של .

Thunderbit הוא AI web scraper כתוסף Chrome, שנבנה עבור משתמשים לא טכניים (אבל חזק מספיק גם למקצוענים). הוא משתמש ב‑AI כדי “להבין” את האתר, לארגן את הנתונים ולהוציא את כל כתובות ה‑URL—כולל עמודים חבויים, דינמיים ותוכן בעמודי משנה. לא צריך לכתוב קוד או להתעסק בהגדרות מסובכות. פשוט פותחים את האתר, לוחצים “AI Suggest Fields”, ונותנים ל‑Thunderbit לעשות את העבודה.

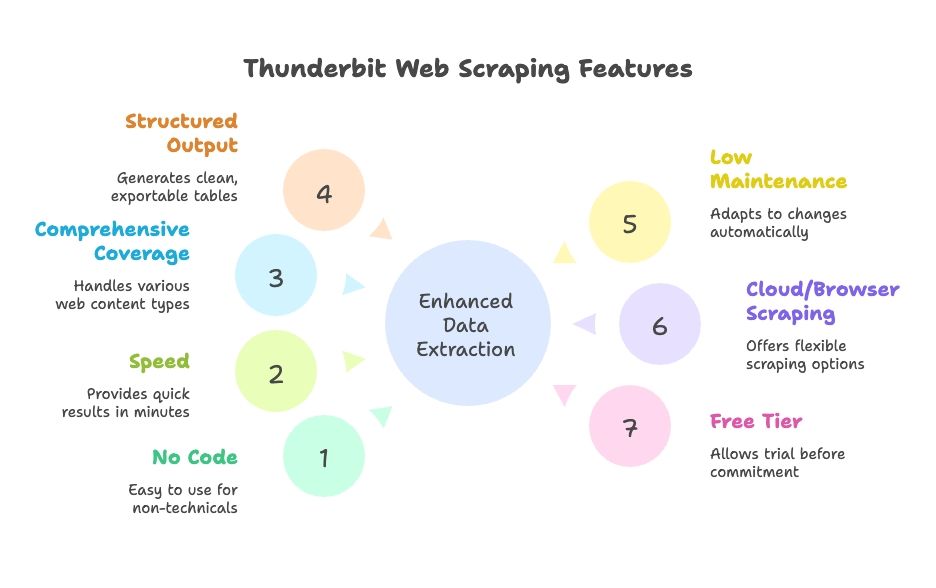

מה מייחד את Thunderbit:

- בלי קוד ובלי הקמה: ממשק בשפה טבעית, מונחה AI. כל אחד בצוות יכול להשתמש.

- מהירות: תוצאות בדקות, לא בשעות.

- כיסוי מקיף: תומך בתוכן דינמי, עימוד, גלילה אינסופית ועמודי משנה.

- פלט מובנה: טבלאות נקיות, מוכנות לייצוא ל‑Google Sheets, Excel, Airtable, Notion, CSV או JSON.

- תחזוקה מינימלית: ה‑AI מסתגל לשינויים באתר; פחות צורך בכיוונונים.

- איסוף נתונים בענן או בדפדפן: בוחרים מה מתאים לתהליך העבודה.

- יש שכבת שימוש חינמית: אפשר להתנסות לפני שמתחייבים.

איך Thunderbit הופך את איסוף עמודי האתר לפשוט

בואו נראה איך זה עובד בפועל. אראה לכם איך עוברים מ”אני צריך רשימה של כל עמודי האתר” ל”הנה גיליון, בוס” בכמה קליקים.

שלב 1: התקנה והפעלה של Thunderbit

הורידו את והצמידו אותו לדפדפן. היכנסו לאתר שתרצו לאסוף ממנו נתונים (למשל דף הבית) ולחצו על אייקון Thunderbit כדי לפתוח את הממשק.

טיפ למתקדמים: Thunderbit נותן קרדיטים חינמיים למשתמשים חדשים, כך שאפשר להתנסות בלי לשלוף כרטיס אשראי.

שלב 2: בחירת מקור הנתונים

ברירת המחדל של Thunderbit היא לאסוף מהעמוד הנוכחי, אבל אפשר גם להזין רשימת URLs (כמו מפת אתר או עמודי קטגוריה) אם רוצים להתחיל מאזור מסוים.

- ברוב האתרים, התחילו מדף הבית או מעמוד מפת האתר.

- באיקומרס, אולי עדיף להתחיל מעמוד קטגוריה או רשימת מוצרים.

שלב 3: שימוש ב‑“AI Suggest Fields” כדי לזהות URLs

כאן קורה הקסם. לחצו “AI Suggest Fields” (או “AI Suggest Columns”). ה‑AI של Thunderbit סורק את העמוד, מזהה תבניות ומציע עמודות כמו “כותרת עמוד” ו‑“כתובת עמוד” לכל הקישורים שהוא מוצא. אפשר להתאים את העמודות לפי הצורך.

- בדף הבית, תקבלו לרוב קישורי ניווט, פוטר וקישורים בולטים.

- במפת אתר, תקבלו רשימת URLs נקייה.

- אפשר להוסיף/להסיר עמודות או לחדד מה רוצים לחלץ.

ה‑AI של Thunderbit עושה את העבודה הקשה—אין צורך לכתוב XPath או CSS selectors. זה כמו 로봇 인턴 שבאמת מבין מה אתם רוצים.

שלב 4: הפעלת איסוף מעמודי משנה

רוב האתרים לא מציגים את כל העמודים בדף הבית. כאן נכנס Subpage Scraping של Thunderbit. מסמנים את עמודת ה‑URL כקישור “follow”, ו‑Thunderbit ייכנס לכל קישור שהוא מוצא ויאסוף עוד URLs מהעמודים הללו. אפשר אפילו להגדיר תבניות מקוננות לאיסוף רב‑שלבי.

- לרשימות עם עימוד או כפתורי “load more”, הפעילו Pagination & Scrolling כדי ש‑Thunderbit ימשיך עד שימצא הכול.

- לאתרים עם תתי‑דומיינים או אזורים (כמו בלוג ב‑), Thunderbit יכול לעקוב גם לשם אם תכוונו אותו.

שלב 5: הרצת האיסוף

לחצו “Scrape” וצפו ב‑Thunderbit עובד. הוא ימלא טבלה עם URLs (וכל שדה נוסף שבחרתם) בזמן אמת. באתרים גדולים אפשר לתת לזה לרוץ ברקע ולחזור כשזה מסתיים.

שלב 6: בדיקה וייצוא

בסיום, עברו על התוצאות—Thunderbit מאפשר למיין, לסנן ולהסיר כפילויות בתוך האפליקציה. לאחר מכן מייצאים בלחיצה אחת ל‑Google Sheets, Excel, CSV, Airtable, Notion או JSON. בלי העתק‑הדבק ובלי פורמטים מבולגנים.

כל התהליך? באתר קטן‑בינוני אפשר להגיע מריק לרשימת URLs מלאה בפחות מ‑10 דקות. באתרים גדולים זה עדיין מהיר בהרבה (ופחות מלחיץ) מאשר לחבר נתונים מכמה מקורות.

איתור עמודים חבויים ודינמיים עם Thunderbit

אחת התכונות האהובות עליי ב‑Thunderbit היא היכולת שלו להתמודד עם עמודים שכלים מסורתיים נוטים לפספס:

- תוכן שמרונדר ב‑JavaScript: כי Thunderbit רץ בדפדפן אמיתי, הוא יכול ללכוד עמודים שנטענים דינמית (כמו לוחות דרושים עם גלילה אינסופית או רשימות מוצרים).

- עמודים יתומים או לא מקושרים: אם יש לכם רמז (כמו מפת אתר או פונקציית חיפוש), Thunderbit יכול להשתמש בו כדי למצוא עמודים שלא מקושרים בשום מקום אחר.

- תתי‑דומיינים או אזורים: Thunderbit יכול לעקוב אחרי קישורים גם בין תתי‑דומיינים לפי הצורך, כדי לתת תמונה מלאה.

- אינטראקציה כמו משתמש: צריך למלא שדה חיפוש או ללחוץ על פילטר כדי לחשוף עמודים חבויים? AI Autofill של Thunderbit יכול לטפל גם בזה.

דוגמה מהשטח: צוות שיווק היה צריך לאתר את כל דפי הנחיתה הישנים—רבים מהם לא היו מקושרים לשום מקום אבל עדיין קיימים. באמצעות איסוף תוצאות חיפוש Google עם Thunderbit והזנת תבניות URL מוכרות, הם חשפו עשרות עמודים שנשכחו, וחסכו לחברה בלבול (וכמה כאבי ראש).

השוואה בין Thunderbit לשיטות המסורתיות: מהירות, פשטות וכיסוי

בואו נשווה את Thunderbit מול השיטות הקלאסיות:

| היבט | חיפוש “site:” ב-Google | מפת אתר XML | זחלן SEO (Screaming Frog) | Google Search Console | ייצוא CMS | Thunderbit AI Scraper |

|---|---|---|---|---|---|---|

| מהירות | מהיר מאוד, אבל מוגבל | מיידי אם קיים | משתנה (דקות עד שעות) | מהיר לאתרים קטנים | מיידי לאתרים קטנים | מהיר, הגדרה בדקות, איסוף אוטומטי |

| קלות שימוש | קל מאוד | קל | בינוני (דורש הגדרה) | בינוני | קל (אם יש אדמין) | קל מאוד, בלי קוד |

| כיסוי | נמוך (רק מאונדקס) | גבוה לעמודים המיועדים | גבוה לעמודים מקושרים | גבוה למאונדקסים, ייצוא מוגבל | בינוני (תוכן בלבד) | גבוה מאוד, כולל דינמי ועמודי משנה |

| פלט ואינטגרציות | העתקה ידנית | XML (דורש פירוק) | CSV עם הרבה נתונים נוספים | CSV/Excel, עד 1,000 שורות | CSV/XML, לעיתים דורש ניקוי | טבלה נקייה, ייצוא בלחיצה ל-Sheets, Excel ועוד |

| תחזוקה | הרצה ידנית | דורש עדכון | סריקה מחדש עם שינויי אתר | ייצוא תקופתי | ייצוא אחרי שינויים | נמוכה—ה-AI מסתגל, אפשר לתזמן איסוף |

Thunderbit מצטיין בקלות שימוש, שלמות ואינטגרציות. לכל שיטה מסורתית יש יתרונות, אבל לרוב צריך יותר מאמץ כדי לשלב תוצאות ולשמור אותן מעודכנות. ה‑AI של Thunderbit מסתגל לשינויים באתר, כך שלא צריך לכוונן כל הזמן או להריץ ייצואים ידניים.

איך לבחור את הגישה הנכונה: למי מתאימה איזו שיטה?

אז מה הכי מתאים לכם? הנה ההמלצה שלי, אחרי שנים של עזרה לצוותים “להשתלט” על נתוני האתר שלהם:

- מומחי SEO / מפתחים: אם אתם צריכים נתונים טכניים עמוקים (תגיות מטא, קישורים שבורים וכו׳) או מבצעים ביקורת באתר ענק, זחלן או סקריפט מותאם עדיין יכולים להיות הגיוניים. אבל גם אז, Thunderbit יכול לספק מהר רשימת URLs להזנה לכלים אחרים.

- משווקים, אסטרטגי תוכן, מנהלי פרויקטים: Thunderbit הוא מציל חיים. לא צריך לחכות ל‑IT שיריץ סקריפט או יאחד ייצואים. לאינוונטור תוכן, ניתוח מתחרים או ביקורת מהירה—אפשר לעשות לבד.

- צוותי מכירות / Lead Gen: Thunderbit מקל על שליפת רשימות של סניפים, עמודי אירועים או ספריות חברים מכל אתר—בלי קוד.

- אתרים קטנים / משימות קצרות: באתרים זעירים, בדיקה ידנית או מפת אתר עשויות להספיק. אבל ההקמה של Thunderbit כל כך מהירה שלרוב שווה להשתמש כדי לא לפספס.

- שיקולי תקציב: שיטות מסורתיות זולות (חוץ מהזמן שלכם). ל‑Thunderbit יש שכבה חינמית, ותוכניות בתשלום נגישות לרוב העסקים. הזמן שלכם שווה כסף.

- צרכי נתונים מאוד ייחודיים: אם צריך לוגיקה מורכבת או נתונים מאוד ספציפיים, ייתכן שתצטרכו לפתח scraper בעצמכם. אבל ה‑AI של Thunderbit מכסה את רוב המקרים עם מינימום הגדרה.

טיפים להחלטה:

- אם אתם בעלי האתר ויש פחות מ‑1,000 עמודים, נסו ייצוא מ‑Google Search Console—אבל בדקו שלמות.

- אם אין לכם גישה לאתר או שאתם צריכים נתוני מתחרים, Thunderbit או זחלן הם הבחירה.

- אם הזמן שלכם חשוב ואתם רוצים פתרון שמתרחב בקלות, קשה לנצח את Thunderbit.

- לשיתוף פעולה בצוות, הייצוא הישיר ל‑Google Sheets הוא יתרון גדול.

ארגונים רבים עובדים בשיטה היברידית: Thunderbit למשימות מהירות ולהעצמת משתמשים לא טכניים, וכלים מסורתיים לביקורות עמוקות.

נקודות מפתח: השגת עמודי אתר לכל צורך עסקי

נסכם:

- רשימה מלאה של עמודי האתר היא קריטית ל‑SEO, אסטרטגיית תוכן, מיגרציות ומחקר מכירות. היא מונעת הפתעות, קישורים שבורים והחמצת הזדמנויות. רוב המשווקים מבצעים ביקורת תוכן לפחות פעם בשנה ().

- יש שיטות מסורתיות, אבל לכל אחת יש חורים. אין גישה אחת שמבטיחה רשימה מלאה ומעודכנת. לרוב צריך ידע טכני ושילוב של כמה פלטים.

- איסוף נתונים מבוסס AI (Thunderbit) הוא פתרון מודרני. Thunderbit משתמש ב‑AI כדי לבצע את “החשיבה” והקליקים, ולהפוך איסוף נתונים מהאינטרנט לנגיש לכולם. הוא מטפל בתוכן דינמי, עמודי משנה ומייצא נתונים בפורמט מוכן לשימוש—חוסך זמן ומפחית טעויות. בהשוואות ישירות, Thunderbit עושה בדקות מה שפעם לקח שעות, עם כמעט אפס עקומת למידה ().

- התאימו את השיטה לצורך ולצוות. באתרים עצומים כדאי להשתמש בכלים שונים, אבל לרוב המשתמשים העסקיים Thunderbit לבדו יהיה כנראה הבחירה הטובה ביותר.

- שמרו על עדכניות. ביקורות תקופתיות מאפשרות לזהות בעיות מוקדם ולשמור על אתר רזה ואפקטיבי. תזמון האיסוף ב‑Thunderbit הופך את זה לריאלי, בעוד שתהליכים ידניים נוטים להידחות בגלל המאמץ.

מחשבה לסיום: אין יותר תירוצים לא לדעת מה יש באתר שלכם (או של המתחרים). עם הגישה הנכונה אפשר להשיג רשימה מקיפה של כל העמודים ולהשתמש בידע הזה כדי לשפר SEO, חוויית משתמש ואסטרטגיה עסקית. לעבוד חכם, לא קשה—לתת ל‑AI לעשות את העבודה הכבדה, ולוודא שאף עמוד לא נשאר מאחור.

צעדים הבאים

אם נמאס לכם לפחד ממשימת “תביאו לי את כל ה‑URLs”, ונסו אותו על האתר שלכם או על אתר מתחרה. תופתעו כמה זמן (ושפיות) זה חוסך. ואם תרצו להעמיק ב‑איסוף נתונים מהאינטרנט, עיינו במדריכים נוספים ב‑, כמו או .

שאלות נפוצות

1. למה שאצטרך רשימה של כל העמודים באתר?

צוותים ב‑SEO, שיווק, מכירות ו‑IT צריכים לעיתים רשימות URL מלאות למשימות כמו ביקורות תוכן, מיגרציות אתר, יצירת לידים וניתוח מתחרים. רשימה מלאה ומדויקת עוזרת להימנע מקישורים שבורים, מוודאת שתוכן לא מוכפל או נשכח, ומבליטה הזדמנויות חבויות.

2. מה הדרכים המסורתיות למצוא את כל כתובות ה‑URL באתר?

שיטות נפוצות כוללות חיפוש site: ב‑Google, בדיקת sitemap.xml ו‑robots.txt, סריקה עם כלי SEO כמו Screaming Frog, ייצוא נתונים מפלטפורמות CMS כמו WordPress, ושליפת עמודים מאונדקסים/עם תנועה מ‑Google Search Console ו‑Analytics. עם זאת, לכל שיטה יש מגבלות בכיסוי ובנוחות.

3. מה המגבלות של שיטות מסורתיות לאיתור URLs?

שיטות מסורתיות מפספסות לעיתים עמודים דינמיים, יתומים או לא מאונדקסים. הן יכולות לדרוש ידע טכני, לקחת שעות כדי לשלב ולנקות נתונים, ובדרך כלל לא מתרחבות טוב לאתרים גדולים או לביקורות חוזרות. לעיתים נדרשת גם בעלות על האתר או גישת אדמין—מה שלא תמיד אפשרי.

4. איך Thunderbit מפשט את תהליך איתור כל עמודי האתר?

Thunderbit הוא AI web scraper שסורק אתרים כמו משתמש אנושי—נכנס לעמודי משנה, מתמודד עם JavaScript ומבנה את הנתונים אוטומטית. אין צורך בקוד, הוא עובד כתוסף Chrome, ויכול לייצא רשימות URL נקיות ל‑Google Sheets, Excel, CSV ועוד בתוך דקות.

5. למי מתאים Thunderbit לעומת כלים מסורתיים?

Thunderbit אידיאלי למשווקים, אסטרטגי תוכן, צוותי מכירות ומשתמשים לא טכניים שרוצים רשימות URL מהירות ומלאות בלי התעסקות. כלים מסורתיים מתאימים יותר לביקורות טכניות שדורשות מטא‑דאטה עמוק או סקריפטים מותאמים. הרבה צוותים משתמשים בשניהם—Thunderbit למהירות ולפשטות, וכלים מסורתיים לניתוח מעמיק.