אני עדיין זוכר את היום שבו מישהו שאל אותי לראשונה: "Shuai, אתה יכול לגרד נתונים מהאתר הזה?" אז, ווב סקרייפינג היה טריק נישתי שרק קומץ מפתחים הכירו — Python ו‑BeautifulSoup היו כל מה שהיית צריך. קדימה להיום, ושוק ה‑freelance של Web Scraping התפוצץ והפך ל, עם צפי להכפיל את עצמו שוב עד 2030. עבודות מרחוק פורחות, והלקוחות כבר לא מחפשים רק "סקריפט שעובד" — הם רוצים פתרון עסקי מוכן לשימוש (ועדיף גם בקובץ CSV!), מהר.

וכאן העניין: התפקיד של מפתח Web Scraping פרילנסר השתנה מהיסוד. זה כבר לא רק עניין של כתיבת קוד. מצפים ממך לנהל את כל התהליך — מהגדרת הדרישות והוצאת הנתונים, דרך ניקוי שלהם, מסירה בפורמט הנכון, ואפילו ניהול סיכונים משפטיים. עם כלים כמו שמעלים את הרף מבחינת מהירות ואיכות, הציפיות רק ממשיכות לעלות. בין אם אתם ותיקים בתחום או רק בתחילת הדרך, נפרק כאן מה צריך כדי להצליח בעידן החדש הזה. אשתף ניסיון מהשטח, טיפים פרקטיים, ואיך Thunderbit יכול להפוך לכלי הסודי שלכם.

מה בעצם עושה היום מפתח Web Scraping פרילנסר?

בואו נדבר דוגרי: מפתח Web Scraping פרילנסר ב‑2025 לא דומה בכלל למישהו כזה מלפני חמש שנים. פעם, מסירת סקריפט Python הייתה מספיקה. היום מצפים מכם לקחת אחריות על כל הצינור — משיחת ה‑Zoom הראשונה ועד המסירה הסופית ל‑Google Sheets.

למה השינוי? כי הביקוש ל‑web scraping זינק. צפוי להגיע ל‑2.5 מיליארד דולר עד 2032, ו כבר משתמשות ב‑web scraping עבור AI ואנליטיקה. מסחר אלקטרוני, נדל"ן, פיננסים — כל תחום רוצה נתונים, ו צצות בכל מקום ב‑Upwork וב‑Freelancer. אבל גם התחרות שם.

מה שלקוחות מצפים לו היום הרבה מעבר ל"קוד":

- הבנה של מטרות עסקיות (לא רק מבנה ה‑HTML — למה בכלל צריכים את הנתונים האלה?)

- תקשורת ברורה ("אצלי זה עובד" פשוט לא מספיק)

- מסירת נתונים נקיים ומוכנים לשימוש

- ציות משפטי וניהול סיכונים

- תמיכה שוטפת

בקיצור, אתם צריכים להיות גם מפתחים, גם יועצים, גם מנהלי פרויקטים וגם מהנדסי נתונים — הכול באדם אחד. פרילנסרים שמספקים ערך "מקצה לקצה" כזה זוכים ללקוחות חוזרים ולתעריפים גבוהים יותר.

אילו מיומנויות צריך לעבודה ב‑Web Scraping: Python כבר לא מספיק

Python, BeautifulSoup ו‑Playwright הם בסיס הכרחי. אבל כדי לנצח בעבודות מרחוק ובשוק הגלובלי, צריך סט מיומנויות רחב יותר.

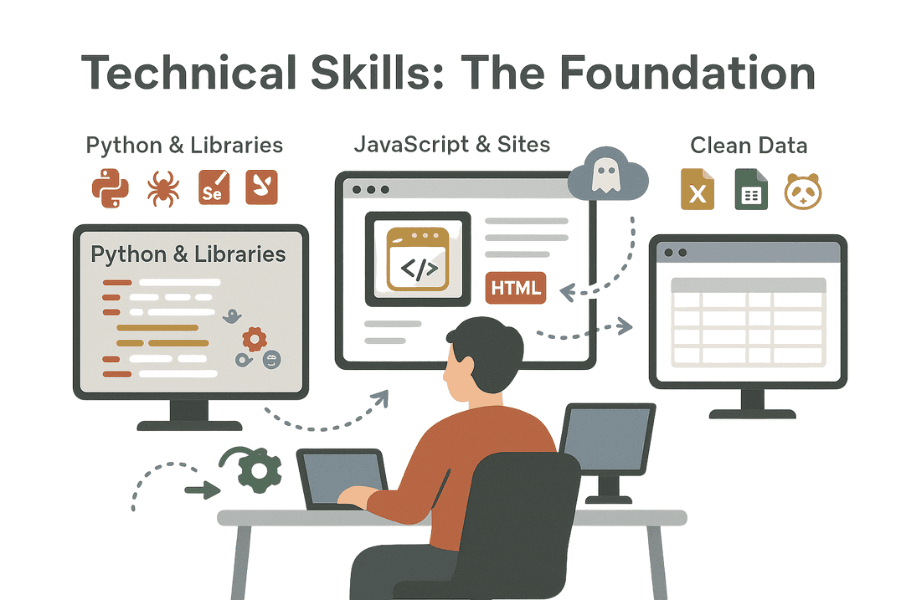

מיומנויות טכניות: היסוד

- Python וספריות: משתמשים ב‑Python, עם BeautifulSoup, Scrapy, Selenium ו‑Playwright ככלים המובילים.

- JavaScript ואתרים דינמיים: אתרים מודרניים נשענים מאוד על JavaScript לרינדור דינמי, ולכן דפדפנים חסרי ממשק וטיפול בתוכן דינמי הם חיוניים.

- APIs ואוטומציה: ידע בעבודה עם APIs של scraping ועם מסגרות אוטומציה נותן יתרון ברור.

- ניקוי נתונים: היכולת למסור נתונים מסודרים ומלוטשים באמצעות Pandas, Excel או Google Sheets חשובה יותר ממה שנדמה.

מה שבאמת מבדל אתכם

הנה מה שרוב הפרילנסרים מפספסים:

- תקשורת: האם אתם יכולים להסביר מושגים טכניים בצורה ברורה? האם תצליחו לדייק את הדרישות בשיחת פתיחה? זה מה שהופך פרויקט חד־פעמי לחוזה ארוך טווח.

- ניהול פרויקטים: עמידה בדד־ליינים, התמודדות חלקה עם שינויים בהיקף — אמינות נראית לעין ומתגמלת.

- רב־גוניות בכלים: מעבר לקוד, האם אתם יודעים להשתמש בכלים ללא קוד כמו ו‑web scraper APIs כדי לעבוד מהר יותר?

- ציות משפטי ואתיקה: נותנות עדיפות ל‑scraping אתי. ידע ב‑GDPR וב‑robots.txt הוא לא משהו שאפשר לוותר עליו.

למה Thunderbit (וכלים דומים) כל כך חשובים

שימוש בכלים מבוססי AI כמו Thunderbit משנה את כללי המשחק מבחינת פרודוקטיביות. לא עוד שעות של כתיבת selectors או באגים סביב pagination.

- אבטיפוס לדרישות בתוך דקות

- מתן שירות ללקוחות לא טכניים

- התמקדות בערך אמיתי — ויכולת לקחת יותר פרויקטים

מפתח ה‑Web Scraping הפרילנסר האידיאלי היום הוא היברידי: חלק מפתח, חלק יועץ, חלק שותף עסקי.

Thunderbit: הנשק הסודי של מפתח Web Scraping פרילנסר

במשך שנים בניתי מוצרי SaaS וכלי אוטומציה, והפיכת דברים לפשוטים ומהירים היא מפעל חיי. בדיוק בגלל זה בניתי את — כדי להעלים את החלקים הכואבים של Web Scraping, במיוחד לפרילנסרים.

Thunderbit הוא שמעביר אתכם מ"אני צריך את הנתונים האלה" ל"הנה הגיליון שלך" בכמה קליקים. בלי כוונון selectors, בלי כאבי ראש של debugging. הנה למה הוא עוזר למפתחים פרילנסרים לספק מהר יותר וטוב יותר.

יכולות ה‑AI של Thunderbit נבנו כדי לעזור לכם למסור נתונים מוכנים לעסק במהירות.

AI Suggest Fields: בלי ניחושים של selectors

אתם מכירים את התרגיל — בודקים HTML, מנחשים CSS selectors, ומתפללים שהאתר לא ישנה פריסה. ה‑AI Suggest Fields של Thunderbit משנה את כל זה. בלחיצה אחת, ה‑AI מנתח את הדף, מציע את העמודות הטובות ביותר לחילוץ, ומייצר prompt מותאם לכל שדה.

- מהירות: מה שבעבר לקח שעה, לוקח עכשיו דקות

- דיוק: ה‑AI מזהה שדות שאולי הייתם מפספסים, וכך מצמצם חוסרים בנתונים

- דמואים ללקוחות: אפשר להציג חילוץ לדוגמה במקום ולבנות אמון מיד

הפיצ'ר הזה לבדו יכול לקצר דרמטית את זמן ההקמה. זה כאילו יש לכם עוזר 24/7 שלא ישן אף פעם.

Subpage & Cloud Scraping: התמודדות קלה עם עבודות מורכבות

פרויקטים מהעולם האמיתי כמעט אף פעם לא נעצרים ב"תגרדו את הטבלה הזאת".

- מעבר לתת־עמודים (פרטי מוצר, פרופילי משתמש)

- טיפול ב‑pagination (גלילה אינסופית, כפתור "הבא")

- scraping בקנה מידה גדול על פני מאות או אלפי עמודים

ה‑Subpage Scraping של Thunderbit מאפשר ל‑AI לבקר אוטומטית בכל תת־עמוד ולשלוף פרטים נוספים — בלי לבנות crawler מותאם אישית.

עם Cloud Scraping, אפשר למשוך עד 50 עמודים במקביל בצד השרת.

- מסירה מהירה יותר: פרויקטים גדולים מסתיימים לפעמים בתוך שעה

- ללא מאמץ ידני: פרוקסים, מגבלות קצב וניסיונות חוזרים מטופלים אוטומטית

- Browser Mode: לאתרים שדורשים התחברות או נתונים רגישים, אפשר לגרד בבטחה באמצעות סשן הדפדפן של הלקוח עצמו

תבניות, ייצוא ועוד

- תבניות בלחיצה אחת: לאתרים פופולריים כמו Amazon, Zillow, Instagram ו‑Shopify יש תבניות מוכנות — פשוט מפעילים ועובדים

- ייצוא נתונים חינם: הורדה כ‑CSV או ייצוא ישיר ל‑Google Sheets, Excel, Airtable או Notion — בלי עמלות נוספות

- Scheduled Scrapers: הגדירו ריצות חוזרות (יומי, שבועי) והפכו פרויקטים חד־פעמיים להכנסה מנוי

Thunderbit תומך ב, כך שתוכלו לקחת בביטחון פרויקטים גלובליים מטוקיו ועד סאו פאולו.

אסטרטגיות גלובליות להשגת עבודות Remote ב‑Web Scraping

הלוואי שמישהו היה אומר לי את זה מוקדם יותר: כל העולם הוא לקוח פוטנציאלי. עבודות מרחוק ב‑Web Scraping לא מוגבלות לארה"ב ולבריטניה — שווקי צמיחה נמצאים גם באסיה‑פסיפיק ובאמריקה הלטינית. כוח העבודה הפרילנסרי ממשיך לגדול, עם וצמיחה דו־ספרתית במדינות כמו דרום אפריקה וקנדה.

איך לתפוס את הביקוש הגלובלי

- לנצל יכולות רב־לשוניות: עם התמיכה של Thunderbit ב‑34 שפות, תוכלו להציע בביטחון scraping לנתוני נדל"ן בגרמניה, גרידה של אתרי e‑commerce ביפן, או חילוץ נתונים מרשתות חברתיות בברזיל.

- להבליט את עצמכם בפלטפורמות: הדגישו פרויקטים רב־לשוניים ויכולת מסירה בפורמטים שונים ב‑Upwork, Freelancer ובאתרי משרות נישתיים.

- להציג ניסיון בינלאומי: אם כבר גרדתם בעבר אתרים בשפות זרות, שימו את זה בראש הפרופיל. מקרי בוחן רלוונטיים בונים אמינות מיידית.

איך לבדל את עצמכם

- זמני תגובה מהירים: גם כשיש הבדלי שעות, הצהרה ברורה על זמינות עושה הרבה.

- מסירות לדוגמה: השתמשו ב‑Thunderbit כדי לייצר מיד נתוני דוגמה מהאתר היעד — זה בונה אמון ומעלה את שיעור הזכייה שלכם.

- להדגיש עמידה בכללים: לקוחות רבים חוששים מסיכון משפטי. הפכו את הגישה האתית והמצייתת שלכם ליתרון מכירה גלוי.

בעידן העבודה מרחוק, הגיאוגרפיה כבר לא מהווה מחסום. עם הכלים והאסטרטגיה הנכונים, תוכלו לסגור לקוחות מ‑Silicon Valley ועד שנגחאי.

תמחור ומסירה: איך למקסם הכנסה כמפתח Web Scraping פרילנסר

בואו נדבר על כסף. תמחור פרויקטים של Web Scraping יכול להיות מאתגר, אבל הגישה הנכונה יכולה לשפר גם את ההכנסה וגם את שביעות הרצון של הלקוחות.

מודלי תמחור נפוצים

- לפי שעה: התעריפים נעים בדרך כלל בין בהתאם למורכבות ולרמת המיומנות.

- לפי פרויקט: סכום קבוע לכל תוצר. לקוחות אוהבים שקיפות בעלויות.

- לפי ערך: תמחור לפי הערך שהנתונים מייצרים (למשל, אוטומציה של 50 שעות עבודה ידנית, או יצירת צמיחה בהכנסות).

איך Thunderbit מחזק את כוח התמחור שלכם

עם Thunderbit אתם מקבלים יתרון גם במהירות וגם באיכות:

- מסירה מהירה יותר: פרויקטים שבעבר לקחו ימים, לוקחים עכשיו שעות

- פחות שגיאות: פחות debugging אומר פחות עבודה חוזרת

- הזדמנויות לשירות חוזר: אפשר להקים scraping מתוזמן ולהציע מנויים (למשל 200 דולר לחודש)

לקוחות מוכנים לשלם יותר עבור מהירות, אמינות ותמיכה שוטפת. אל תתמחרו לפי שעות — תתמחרו לפי הערך שאתם מספקים.

איך להציג את הערך

- להוביל עם ROI: להסביר איך הנתונים מייצרים הכנסות, חוסכים זמן או מפחיתים סיכון ללקוח

- להיות שקופים: לפרט בבירור הקמה, תחזוקה, עדכונים ואיך תטפלו בשינויים באתר

- להציע רמות שירות: בסיסי (חד־פעמי), סטנדרטי (עם ניקוי וניתוח), פרימיום (עדכונים חוזרים ותמיכה בעדיפות)

זכרו: הלקוחות לא משלמים על קוד. הם משלמים על תוצאות.

ציות לנתונים וניהול סיכונים: בניית אמון ויחסים ארוכי טווח

הנה האמת הלא נוחה: טעות אחת בציות יכולה לסיים מיד מערכת יחסים עם לקוח. עם שחוששות מהחוקיות של איסוף נתונים, ניהול סיכונים הוא לא בגדר רשות — הוא הכרח.

שיטות מומלצות

- לכבד את תנאי השימוש: תמיד לבדוק את ה‑ToS של האתר היעד. כשיש ספק, להתייעץ עם הלקוח או לבקש הרשאה.

- לעמוד בחוקי הגנת פרטיות: ב‑GDPR, CCPA ותקנות דומות, להיצמד רק לנתונים ציבוריים ולא רגישים. לא לטפל במידע אישי בלי הסכמה.

- להשתמש ב‑browser-based scraping: ה‑Browser Mode של Thunderbit מאפשר לגרד בצורה אתית באמצעות סשן ההתחברות של הלקוח.

- לשים לב למגבלות קצב: לא להפציץ שרתים בבקשות. ה‑Cloud Mode של Thunderbit מטפל בזה אוטומטית, אבל תמיד כדאי לבדוק.

איך לתקשר ציות

שילוב משפט פשוט בהצעות שלכם יכול לעשות הבדל גדול:

"כל איסוף הנתונים נעשה בהתאם לחוקי פרטיות המידע ולמדיניות האתר הרלוונטיים. אנו מתמקדים רק במידע זמין לציבור. כאשר נדרשת התחברות, אנו משתמשים בגישה המורשית של הלקוח לצורך חילוץ אתי."

פסקה אחת כזו ממקמת אתכם כמקצוענים, לא רק כקודרים.

מפרויקטים חד־פעמיים להכנסה קבועה: אוטומציה של הצלחת הלקוח

אם אתם רוצים הכנסה יציבה, המפתח הוא להפוך פרויקטים חד־פעמיים לשירותים חוזרים.

איך עושים את זה

- Scheduled scrapers: להשתמש במתזמן של Thunderbit כדי להגדיר ריצות יומיות, שבועיות או חודשיות

- תוצרים קבועים: להציע ניטור מחירים שבועי, אנליטיקה יומית לרשתות חברתיות, או דוחות שוק חודשיים

- מודל ריטיינר: לגבות דמי הקמה ועוד דמי תחזוקה חודשיים. הרבה לקוחות מוכנים לשלם 100–400 דולר לחודש עבור מסירת נתונים שוטפת.

דוגמה אמיתית

פרילנסר אחד הפך פרויקט יומי של חילוץ מחירי e‑commerce לדשבורד שמתעדכן אוטומטית עם חוזה חודשי. עם Thunderbit שמטפל באוטומציה, העבודה היומית מינימלית — אבל ההכנסה יציבה.

טיפ מקצועי

אחרי כל מסירה חד־פעמית, תמיד נסו למכור שירות חוזר. רוב הלקוחות אפילו לא חשבו כמה ערך יש לנתונים מתמשכים.

בניית המותג שלכם: איך לבלוט בשוק הפרילנס של Web Scraping

בשוק פרילנס צפוף, המותג שלכם הוא מה שיזכירו. הנה איך לבנות פרופיל בולט לעבודות מרחוק ובשוק הגלובלי.

צעדים מעשיים

- ללטש את הפרופיל: ב‑Upwork, LinkedIn ובאתר האישי, להבליט גם מיומנויות טכניות וגם השפעה עסקית

- להציג תוצאות: לפרסם מקרי בוחן, המלצות מלקוחות ונתוני דוגמה. למדוד השפעה — הכנסה שנוצרה, שעות שנחסכו

- ליצור תוכן: לכתוב על אתגרי web scraping, ציות והצלחות בבלוג או ב‑LinkedIn (המאמר הזה הוא דוגמה לכך!)

- להשתתף בקהילות: לענות על שאלות ב‑Reddit, בקבוצות LinkedIn ובפורומים של Web Scraping. גם תרומה ל‑open source עוזרת

- להדגיש גם כישורים טכניים וגם עסקיים: לקוחות מחפשים שותף, לא רק ספק. הראו שאתם מבינים את המטרות שלהם ויודעים למסור נתונים שאפשר לפעול איתם

התעשייה לא מפסיקה להשתנות. המשיכו ללמוד כלים חדשים כמו Thunderbit, הישארו מעודכנים בשינויים משפטיים, והתנסו בטכניקות חדשות — ככה נשארים צעד אחד לפני כולם.

סיכום: מפת הדרכים שלכם להצלחה כפרילנסרים ב‑Web Scraping

שוק ה‑freelance של Web Scraping צומח במהירות, אבל גם הציפיות. הנה תוכנית הפעולה שלכם:

- לספק ערך מקצה לקצה: להיות פותרי בעיות, לא רק כותבי קוד

- להרחיב מיומנויות: לשלוט גם בכלים מסורתיים (Python, APIs) וגם בפלטפורמות AI מודרניות (כמו Thunderbit)

- לתעדף ציות: לבנות אמון דרך עבודה אתית ושקופה

- לעבור למודל חוזר: לאוטומט ולמכור שירותי נתונים במודל מנוי

- לבנות את המותג שלכם: להשקיע בנוכחות אונליין, בפורטפוליו ובלמידה מתמשכת

פרילנסרים שעושים את זה לא רק שורדים — הם סוגרים לקוחות טובים יותר, גובים יותר, ובונים עסק שמחזיק לאורך זמן.

בין אם אתם רק מתחילים או רוצים לעלות רמה, זכרו: הצלחה ב‑freelance web scraping היא לא רק על חילוץ נתונים — היא על חילוץ הזדמנויות. תמשיכו ללמוד, תמשיכו להסתגל, תמשיכו לספק ערך. הלקוחות וההצלחה כבר יגיעו בעקבותיו.

מוכנים להקפיץ את הקריירה שלכם כפרילנסרים ב‑Web Scraping?

נסו את בחינם, בדקו את , וגלו עוד טיפים ומדריכים ב.

ואם אי פעם תמצאו את עצמכם עושים debugging ל‑selectors ב‑2 בלילה... פשוט תזכרו — ל‑AI יש לכם גב עכשיו (או לפחות, קחו קפה).

קריאה מומלצת:

מאחל לכם את ההצלחה הגדולה הבאה. שהנתונים שלכם תמיד יהיו נקיים, שהלקוחות יהיו מרוצים, ושהסקריפטים שלכם יעמדו איתן מול עיצוב מחדש של האתר!

שאלות נפוצות

1. אילו מיומנויות צריך מפתח Web Scraping פרילנסר מודרני?

מעבר ל‑Python ו‑BeautifulSoup, תצטרכו גם ספריות כמו Scrapy, Selenium ו‑Playwright, וגם יכולת להתמודד עם אתרים כבדים ב‑JavaScript, לעבוד עם APIs ולנקות נתונים באמצעות Pandas או Excel. תקשורת, ניהול פרויקטים וידע בציות משפטי חשובים באותה מידה. שליטה בכלים ללא קוד/AI כמו Thunderbit מעניקה יתרון תחרותי משמעותי.

2. איך השתנה התפקיד של מפתח Web Scraping פרילנסר בשנים האחרונות?

התפקיד התפתח ממסירת סקריפטים פשוטים לפתרונות מלאים מקצה לקצה: הבנת מטרות עסקיות, מסירת נתונים נקיים, הבטחת ציות משפטי ומתן תמיכה שוטפת. היום פרילנסרים משמשים גם כיועצים וגם כמנהלי פרויקטים.

3. מהו Thunderbit ואיך הוא עוזר למפתחים פרילנסרים של Web Scraping?

Thunderbit הוא תוסף Chrome ל‑web scraper מבוסס AI. הוא מציע הצעות שדות אוטומטיות, scraping של תתי־עמודים וענן, תבניות מוכנות לאתרים פופולריים ותמיכה רב־לשונית. מאבטיפוס מהיר ועד פרויקטים מורכבים ואוטומציה מתוזמנת — הוא עוזר לפרילנסרים לעשות יותר, ביעילות רבה יותר.

4. איך פרילנסרים יכולים למקסם הכנסה מפרויקטים של Web Scraping?

כדאי לשלב כמה מודלי תמחור — לפי שעה, לפי פרויקט ולפי ערך. כלים כמו Thunderbit עוזרים למסור מהר יותר ועם פחות טעויות. הציעו שירותי scraping חוזרים ומסירת נתונים במודל מנוי. תקשרו ROI בצורה ברורה והציעו חבילות שירות מדורגות כדי למקסם רווחיות.

5. מהן השיטות המומלצות לציות ולניהול סיכונים ב‑Web Scraping?

תמיד לבדוק את תנאי השימוש של האתר ולפעול לפי חוקי הגנת מידע כמו GDPR ו‑CCPA. לגרד רק נתונים ציבוריים ולא רגישים, אלא אם יש הסכמה מפורשת. להשתמש ב‑Browser Mode של Thunderbit לגישה אתית ומורשית. לכבד מגבלות קצב ולתקשר ללקוחות בצורה ברורה את גישת הציות שלכם.