אני אהיה כנה: בפעם הראשונה שניסיתי לחלץ כל URL מאתר גדול, חשבתי לעצמי, “כמה קשה זה כבר יכול להיות?” כמה שעות אחר כך עדיין דפדפתי בין דפים אינסופיים, העתקתי קישורים והדבקתי אותם לגיליון, ותהיתי על הבחירות שעשיתי בחיים. אם אי פעם ניסית למצוא את כל הדפים באתר — בין אם לצורך בדיקת תוכן, בניית רשימת לידים או מחקר תחרותי — אתה יודע כמה זה מתיש. זה מייגע, מועדת לטעויות, ובכנות, פשוט בזבוז של הזמן והכישרון שלך.

אבל הנה החדשות הטובות: כבר לא חייבים לעשות את זה בדרך הקשה. כלים מבוססי AI כמו משנים את כללי המשחק עבור משתמשים עסקיים, ומאפשרים למצוא את כל ה-URLs בדומיין בתוך דקות, לא ימים. למעשה, חברות שמשתמשות בכלי web scraping מונעי AI מדווחות על במשימות איסוף נתונים, וחלקן רואות אפילו לעומת שיטות ידניות. זו לא רק סטטיסטיקה — אלה שעות (או ימים) שהחזרתם לעצמכם.

אז בואו נצלול פנימה ונבין למה מציאת כל הדפים באתר כל כך מסובכת, למה מודלי AI כלליים כמו GPT או Claude לא באמת יכולים לעזור, ואיך סוכני AI ייעודיים — כמו Thunderbit — הופכים את התהליך הזה לפשוט. וכן, אני אעבור איתך על השלבים המדויקים כדי לחלץ כל URL שאתה צריך, גם אם אין לך רקע בתכנות.

למה כל כך קשה למצוא את כל ה-URLs בדומיין?

בואו נודה באמת: אתרים לא נבנו כדי למסור לך רשימה מסודרת של כל עמוד שהם מכילים. הם נבנו עבור מבקרים, לא עבור אנשים שמנסים למצוא את כל הדפים באתר בבת אחת. הנה למה המשימה הזו כל כך מתסכלת:

- טירוף של העתק-הדבק ידני: להקליק דרך כל תפריט, רשימה וספרייה, להעתיק URL-ים אחד אחד — זה מתכון לכאבי שורש כף היד (ולפספוס של חצי מהדפים).

- עמודים מחולקים וגלילה אינסופית: אתרים רבים מחלקים תוכן לכמה דפים או טוענים עוד תוצאות בזמן הגלילה. אם פספסת כפתור “הבא” או לא גללת מספיק, תפספס חלקים שלמים.

- מבני עמודים לא עקביים: יש עמודים שמציגים קישורים בפורמט אחד, ואחרים בפריסה אחרת. לעקוב אחרי הכול זה סיוט.

- עמודים חבויים או יתומים: לא כל עמוד מקושר מהניווט הראשי. חלקם קבורים עמוק, ונגישים רק דרך sitemap או חיפוש פנימי.

- טעות אנוש: ככל שצריך להעתיק יותר עמודים, כך הסיכוי לטעות גדל — URL-ים כפולים, שגיאות כתיב, או סתם דילוג על משהו.

ואם אתה עובד על אתר עם מאות או אלפי עמודים? תשכח מזה. חילוץ ידני פשוט לא מתרחב. כמו שאחת מצוותי הנתונים אמרה, מעבר למקרים טריוויאליים, .

מה המשמעות של “למצוא את כל הדפים באתר”?

לפני שנקפוץ לפתרונות, בואו נבהיר בדיוק מה אנחנו מחפשים.

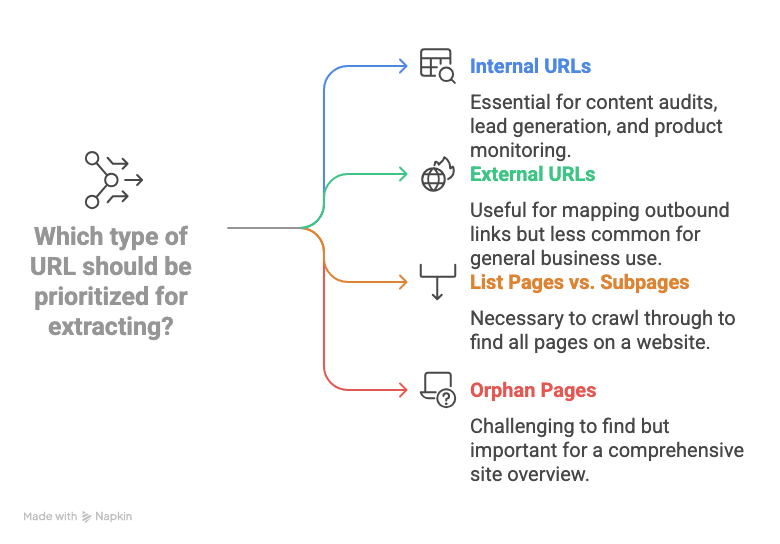

- URLs פנימיים: אלה קישורים שמובילים לעמודים באותו דומיין (כמו /about-us או /products/widget-123). ברוב מקרי השימוש העסקיים — בדיקות תוכן, יצירת לידים, ניטור מוצרים — ה-URLs הפנימיים הם המטרה העיקרית.

- URLs חיצוניים: קישורים שמובילים לאתרים אחרים. בדרך כלל לא צריך אותם, אלא אם ממפים קישורים יוצאים.

- עמודי רשימה מול תת-עמודים: לאתרים רבים יש עמודי “מוקד” או רשימה (למשל: עמודי קטגוריות, ארכיוני בלוג, ספריות) שמקשרים לעמודי פרטים (כמו עמודי מוצר או פרופיל). כדי באמת למצוא את כל הדפים באתר, צריך לזחול דרך הרשימות האלה ולתפוס כל תת-עמוד שאליו הן מקשרות.

- עמודים יתומים: עמודים שלא מקושרים משום מקום ברור. לפעמים אפשר לאתר אותם דרך sitemap או חיפוש פנימי, אבל קל מאוד לפספס אותם.

אז כשאנחנו מדברים על מציאת כל ה-URLs בדומיין, הכוונה היא: להשיג כל URL של עמוד פנימי, מהעמוד הראשי ועד לעמוד המוצר או המאמר העמוק ביותר, רצוי בפורמט שאפשר לעבוד איתו, כמו גיליון אלקטרוני.

שיטות מסורתיות למציאת כל ה-URLs בדומיין

יש כמה דרכים ישנות להתמודד עם זה, אבל לכל אחת יש סט משלה של כאבי ראש:

העתק-הדבק ידני וכלים בדפדפן

זו גישת ה”כוח הזרוע”: מקליקים על כל קישור, מעתיקים כל URL, מדביקים אותו לגיליון, ומקווים שלא פספסתם כלום. יש אנשים שמשתמשים בתוספי דפדפן כדי לשלוף את כל הקישורים מהעמוד הנוכחי, אבל עדיין צריך לחזור על זה לכל עמוד, ואתה נשאר לבד עם עימוד או אזורים חבויים. זה סביר לאתר של חמישה עמודים — הרבה פחות טוב לכל דבר גדול יותר.

שימוש בחיפוש אתר ו-sitemaps

- חיפוש site: של גוגל: מקלידים site:yourdomain.com בגוגל, ורואים אוסף של עמודים שנאונדקסו. אבל גוגל מציג רק את מה שהוא אינדקס (לעיתים מוגבל לכ-1,000 תוצאות), כך שתפספס עמודים חדשים, חבויים או באיכות נמוכה. עצמם מודים שזו לא פתרון מלא.

- XML Sitemaps: לאתרים רבים יש /sitemap.xml שמפרט URLs חשובים. מצוין — אם ה-sitemap מעודכן וכולל כל עמוד. אבל לא לכל אתר יש אחד כזה, ויש אתרים שמפצלים את ה-sitemap לכמה קבצים. עמודים יתומים לרוב לא נכנסים בכלל.

סורקים וסקריפטים טכניים

- כלי SEO (כמו Screaming Frog): הם מזחלים באתר כמו מנוע חיפוש ומפיקים רשימת URLs. הם חזקים, אבל דורשים הגדרה, קונפיגורציה, ולפעמים רישיון בתשלום לאתרים גדולים.

- סקריפטים ב-Python (כמו Scrapy): מפתחים יכולים לכתוב סקריפטים כדי לזחול ולחלץ URLs. אבל בואו נהיה ריאליים: אם אתה לא מרגיש בנוח עם קוד, זו לא אופציה. בנוסף, סקריפטים נשברים כשהפריסה של האתר משתנה, אז אתה תמיד רודף אחרי השינויים.

השורה התחתונה: שיטות מסורתיות הן או ידניות מדי, או לא מלאות, או טכניות מדי עבור רוב המשתמשים העסקיים. יש סיבה לכך שכל כך הרבה אנשים מוותרים באמצע.

למה מודלי AI כלליים לא יכולים לאוטומט לגמרי חילוץ URLs

אולי אתה חושב, “למה שלא פשוט אבקש מ-ChatGPT או Claude למצוא לי את כל הדפים באתר?” הלוואי שזה היה כל כך פשוט. זו המציאות:

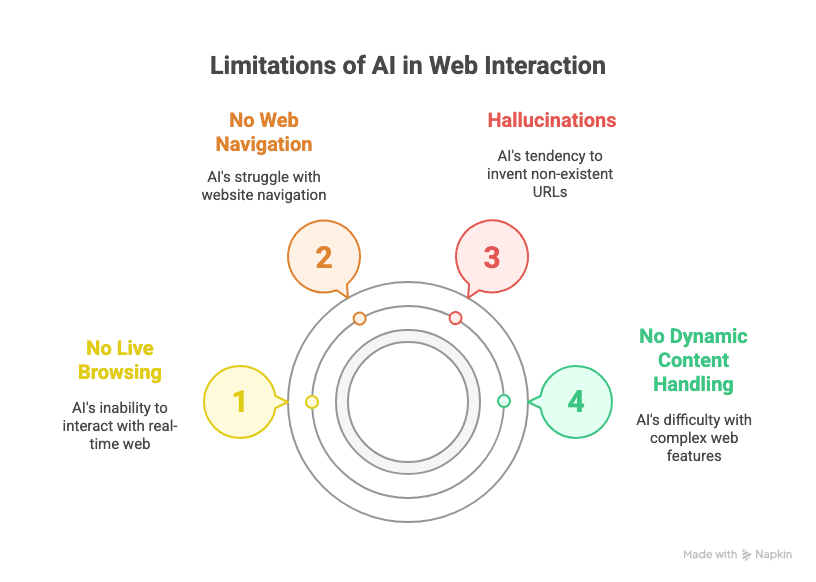

- אין גלישה חיה: מודלי AI כלליים כמו GPT או Claude לא באמת יכולים לגלוש באינטרנט בזמן אמת. הם לא “רואים” את המצב הנוכחי של האתר — הם עובדים על בסיס נתוני האימון שלהם או מה שהדבקת להם.

- אין ניווט באינטרנט: גם עם תוספים או מצב גלישה, LLM-ים לא יודעים להקליק על “הבא”, להתמודד עם גלילה אינסופית, או לעקוב בצורה שיטתית אחרי כל קישור באתר.

- הזיות: אם תבקש מ-AI כללי את כל ה-URLs בדומיין, הוא לרוב ימציא קישורים שנשמעים הגיוניים אבל לא באמת קיימים. (ראיתי אותו ממציא עמודי /about-us לאתרים שמעולם לא היה להם כזה.)

- אין טיפול בתוכן דינמי: אתרים שטוענים תוכן עם JavaScript, דורשים התחברות, או משתמשים בניווט מורכב — מחוץ להישג ידם של LLM-ים כלליים.

כמו ש אומר: “אם אתה רוצה לגרד מאות או אלפי דפים… ChatGPT לבדו פשוט לא מספיק.” צריך כלי שנבנה במיוחד למשימה.

סוכני AI אנכיים הם העתיד (ולמה זה חשוב)

כאן נכנס הניסיון שלי ב-SaaS ובאוטומציה: סוכני AI אנכיים — כלי AI שנבנו עבור תחום מסוים, כמו חילוץ נתוני web — הם הדרך היחידה לקבל תוצאות אמינות וניתנות להרחבה עבור משימות עסקיות. למה?

- LLM-ים כלליים נהדרים לכתיבה או חיפוש, אבל הם מועדים ל”הזיות” ולא יכולים להתמודד עם תהליכי עבודה מרובי שלבים וחוזרים בצורה יציבה שעסקים צריכים.

- כלי SaaS ארגוניים צריכים לאוטומט הרבה משימות מובנות וחוזרות. כאן סוכני AI אנכיים מצטיינים — הם נבנו לעשות דבר אחד, ולעשות אותו טוב, עם מינימום שגיאות.

- דוגמאות יש בשפע בכל התעשיות: Thunderbit לחילוץ נתוני web, Devin AI לפיתוח תוכנה, Alta לאוטומציית מכירות, IL VISTA של Infinity Learn לחינוך, Rippling ל-HR, Harvey למשפטים… והרשימה נמשכת.

בקיצור: אם אתה רוצה למצוא את כל הדפים באתר בצורה אמינה, אתה צריך סוכן AI אנכי שנבנה למשימה — לא צ’אטבוט כללי.

הכירו את Thunderbit: חילוץ URL-ים מבוסס AI לכולם

כאן נכנס . כתוסף Chrome של AI web scraper, Thunderbit נבנה עבור משתמשים עסקיים — בלי קוד, בלי הגדרה טכנית, רק תוצאות. הנה מה שהופך אותו לשונה:

- ממשק בשפה טבעית: פשוט תאר מה אתה רוצה (“רשום את כל כתובות העמודים באתר הזה”), ו-AI של Thunderbit יבין איך לחלץ את זה.

- AI Suggest Fields: Thunderbit סורק את העמוד ומציע אוטומטית שמות עמודות (כמו “Page URL”) — אין צורך להתעסק עם CSS selectors או XPath.

- טיפול בעימוד וגלילה אינסופית: Thunderbit יכול ללחוץ על “הבא” או לגלול למטה אוטומטית, כך שלא תפספס אף עמוד.

- ניווט בתת-עמודים: צריך להעמיק עוד? Thunderbit יכול לעקוב אחרי קישורים לתת-עמודים ולחלץ גם משם נתונים.

- ייצוא מובנה: מייצאים את התוצאות ישירות ל-Google Sheets, Excel, Notion, Airtable או CSV — בחינם ובלחיצה אחת.

- ללא צורך בקוד: אם אתה יודע לגלוש באתר, אתה יכול להשתמש ב-Thunderbit. זה כל כך פשוט.

ומכיוון ש-Thunderbit הוא סוכן AI אנכי, הוא נבנה ליציבות ולחזרתיות — מושלם למשתמשים עסקיים שצריכים לאוטומט את אותן משימות שוב ושוב.

צעד אחר צעד: איך למצוא את כל ה-URLs בדומיין עם Thunderbit

מוכן לראות איך זה עובד? הנה הדרכה לא טכנית לחילוץ כל URL שאתה צריך.

1. התקן את תוסף Thunderbit ל-Chrome

קודם כול: . הוא עובד ב-Chrome, Edge, Brave ובדפדפני Chromium אחרים. הצמד אותו לסרגל הכלים לגישה נוחה.

2. פתח את עמוד הרשימה או הספרייה שאליו אתה מכוון

נווט לאתר שממנו אתה רוצה לחלץ URLs. זה יכול להיות דף הבית, sitemap, ספרייה, או כל עמוד רשימה שמקשר לעמודים שמעניינים אותך.

3. הפעל את Thunderbit והגדר את השדות שלך

לחץ על האייקון של Thunderbit כדי לפתוח את התוסף. צור תבנית סקרייפר חדשה. כאן הקסם קורה:

- לחץ על “AI Suggest Fields”. ה-AI של Thunderbit יסרוק את העמוד ויציע עמודות — חפש אחת עם שם כמו “Page URL”, “Link” או דומה.

- אם לא מופיע השדה המדויק שאתה רוצה, פשוט הוסף עמודה בשם “Page URL” (או מה שמתאים). ה-AI של Thunderbit מאומן לזהות את המונחים האלה ולמפות אותם לנתונים הנכונים.

4. הפעל עימוד או גלילה, אם צריך

אם לעמוד היעד יש כמה דפים (למשל “עמוד 1, 2, 3…” או כפתור “טעינה נוספת”), הפעל עימוד ב-Thunderbit:

- עבור למצב “Click Pagination” לאתרים עם כפתור “הבא”, או “Infinite Scroll” לאתרים שטוענים עוד תוך כדי גלילה.

- Thunderbit יבקש ממך לבחור את כפתור “הבא” או את אזור הגלילה — פשוט לחץ עליו, וה-AI יטפל בשאר.

5. התחל לגרד ובדוק את התוצאות

לחץ על כפתור “Scrape”. Thunderbit יזחל דרך כל הדפים, ויאסוף כל URL שהוא מוצא. תראה את התוצאות מתמלאות בטבלה ישירות בתוך התוסף. עבור אתרים גדולים זה יכול לקחת כמה דקות, אבל זה עדיין הרבה יותר מהיר מלעשות הכול ידנית.

6. ייצא את רשימת ה-URLs שלך

כשהגרידה מסתיימת, לחץ על Export. אפשר לשלוח את הנתונים ישירות אל:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

הייצוא בחינם ושומר על כל העיצוב. לא עוד כאבי ראש של העתק-הדבק.

השוואה בין Thunderbit לפתרונות אחרים לחילוץ URLs

| שיטה | קלות שימוש | דיוק וכיסוי | יכולת התרחבות | אפשרויות ייצוא |

|---|---|---|---|---|

| העתק-הדבק ידני | כואב | נמוך (קל לפספס) | אין | ידני (Excel וכו') |

| מחלצי קישורים בדפדפן | בסדר לעמוד אחד | בינוני | חלש | ידני |

חיפוש Google site: | קל | בינוני (לא מלא) | מוגבל לכ-1,000 | ידני |

| XML Sitemap | קל (אם קיים) | טוב (אם מעודכן) | טוב | ידני/סקריפט |

| כלי SEO (Screaming Frog) | טכני | גבוה | גבוה (בתשלום) | CSV, Excel |

| סקריפטים ב-Python (Scrapy וכו') | טכני מאוד | גבוה | גבוה | מותאם אישית |

| Thunderbit | קל מאוד | גבוה מאוד | גבוה | Google Sheets, CSV וכו' |

Thunderbit נותן לך את הדיוק והסקייל של סורק מקצועי עם קלות השימוש של תוסף דפדפן. בלי קוד, בלי הגדרה, רק תוצאות.

בונוס: לחלץ יותר מ-URLs עם Thunderbit

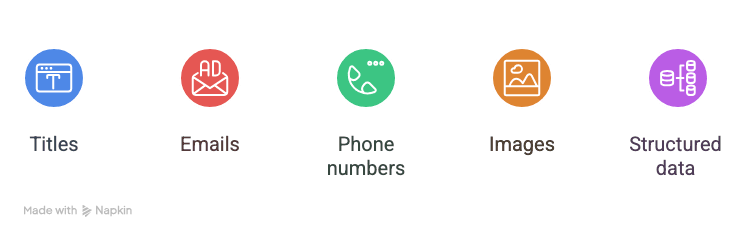

כאן זה נהיה באמת מעניין. Thunderbit הוא לא רק ל-URLs — אפשר לחלץ:

- כותרות

- אימיילים

- מספרי טלפון

- תמונות

- כל נתון מובנה בעמוד

למשל, אם אתה בונה רשימת לידים, אפשר לגרום ל-Thunderbit לאסוף את כתובת הפרופיל, השם, האימייל ומספר הטלפון מכל רשומת ספרייה — הכול במעבר אחד. אם אתה מבצע ביקורת למוצרים, אפשר לשלוף את URL המוצר, השם, המחיר ומצב המלאי. Thunderbit אפילו תומך ב-, כך שהוא יכול להיכנס לכל קישור ולחלץ פרטים גם משם.

וכן, מחלצי האימייל והטלפון של Thunderbit הם לגמרי בחינם. זה ביג דיל עבור צוותי מכירות ושיווק.

מסקנות עיקריות: איך למצוא את כל הדפים באתר עם AI

בואו נסכם:

- חילוץ כל ה-URLs מדומיין הוא משימה קשה עם כלים ידניים או כלליים.

- מודלי AI כלליים כמו GPT לא יכולים להתמודד עם ניווט באתר, עימוד או תוכן דינמי.

- סוכני AI אנכיים כמו Thunderbit נבנו במיוחד לחילוץ נתוני web — יציבים, חוזרים, וקלים לשימוש עבור משתמשים עסקיים.

- Thunderbit הופך את זה לפשוט: מתקינים את התוסף, משתמשים ב-AI כדי להציע שדות, מפעילים עימוד, מגרדים ומייצאים. בלי קוד, בלי טרחה.

- אפשר לחלץ הרבה יותר מ-URLs: כותרות, אימיילים, מספרי טלפון ועוד — מושלם ליצירת לידים, בדיקות או מחקר.

אם נמאס לך מהעתקה והדבקה של קישורים או מהתמודדות עם סורקים טכניים, . יש שכבה חינמית, כך שתוכל לראות בעצמך כמה זמן (ושפיות) תחסוך.

ואם אתה סקרן לגבי דרכים אחרות שבהן Thunderbit יכול לעזור — כמו , , או — בדוק את לעוד מדריכים וטיפים.

מוכן להחזיר לעצמך את הזמן שבזבזת על איסוף נתונים ידני? העתיד של חילוץ נתוני web הוא סוכני AI אנכיים — ו-Thunderbit מוביל את הדרך. נסה אותו, ותן לביקורת הבאה, לרשימת הלידים או לפרויקט המחקר שלך להיות הקל ביותר עד כה.

לקריאה נוספת

נ.ב. אם אי פעם תתפתה להעתיק ולהדביק 1,000 URL-ים ביד, פשוט תזכור: עכשיו יש לזה AI. שורשי כפות הידיים שלך (והבוס שלך) יודו לך.